Segment Anything Model (SAM)

欢迎来到使用 Segment Anything Model (简称 SAM) 进行 图像分割 的前沿领域。这款革命性的模型通过引入具有实时性能的可提示图像分割,改变了游戏规则,为该领域树立了新的标准。

SAM 简介:万物分割模型

Segment Anything Model,简称 SAM,是一种先进的图像分割模型,它允许可提示分割,从而在图像分析任务中提供无与伦比的通用性。SAM 构成了 Segment Anything 计划的核心,该计划是一个开创性的项目,它为图像分割引入了一种新颖的模型、任务和数据集。

SAM 的先进设计使其能够适应新的图像分布和任务,而无需事先了解,这种特性被称为零样本迁移。SAM 在庞大的 SA-1B 数据集 上进行了训练,该数据集包含超过 10 亿个掩码,分布在 1100 万张精心策划的图像中,SAM 已经展示了令人印象深刻的零样本性能,在许多情况下超过了之前完全监督的结果。

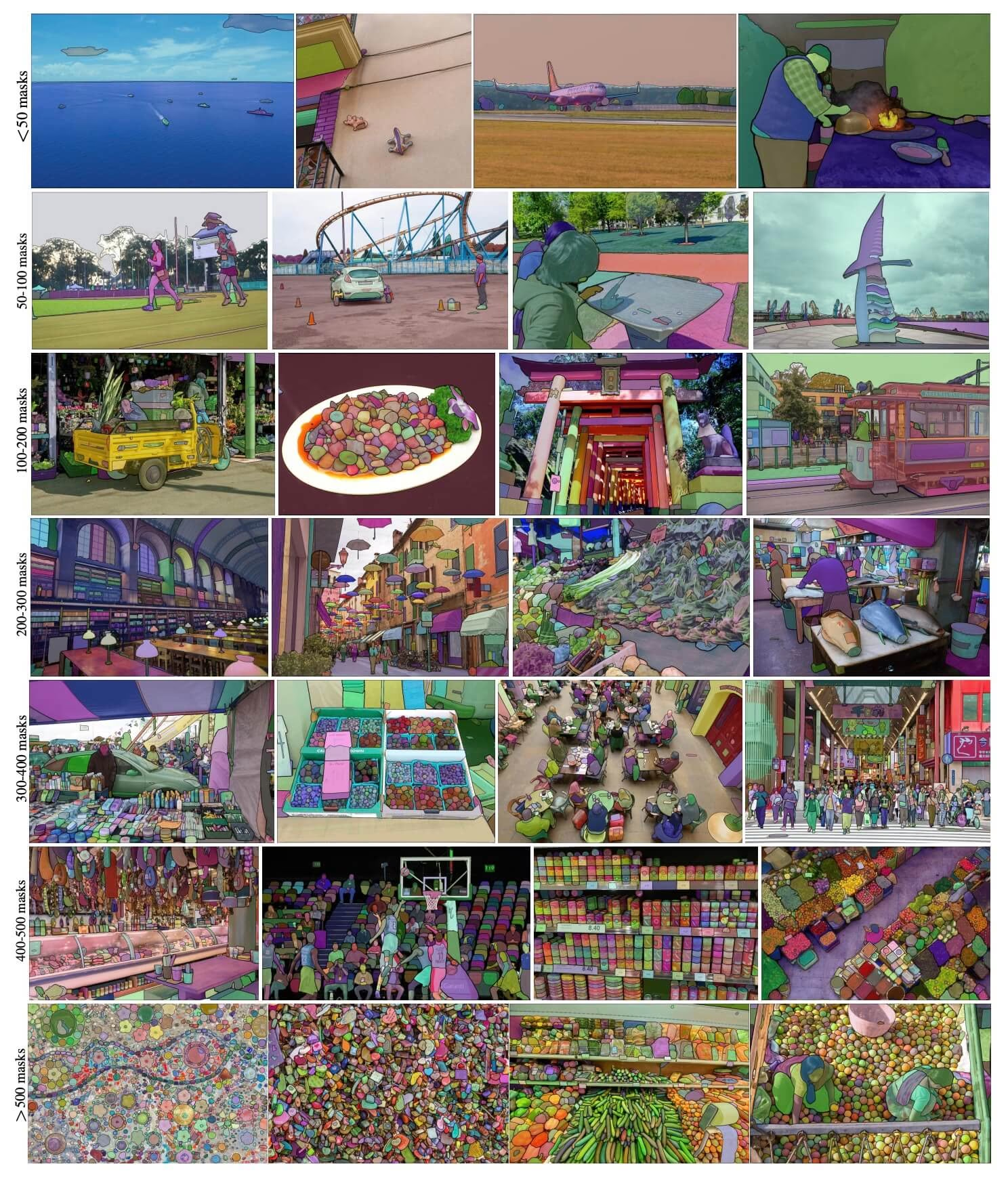

SA-1B 示例图像。 来自新引入的 SA-1B 数据集的叠加掩码的数据集图像。SA-1B 包含 1100 万张多样化、高分辨率、已授权和隐私保护的图像以及 11 亿个高质量分割掩码。这些掩码由 SAM 全自动注释,并且经过人工评级和大量实验验证,具有高质量和多样性。图像按每个图像的掩码数量分组以进行可视化(平均每个图像有 ∼100 个掩码)。

SA-1B 示例图像。 来自新引入的 SA-1B 数据集的叠加掩码的数据集图像。SA-1B 包含 1100 万张多样化、高分辨率、已授权和隐私保护的图像以及 11 亿个高质量分割掩码。这些掩码由 SAM 全自动注释,并且经过人工评级和大量实验验证,具有高质量和多样性。图像按每个图像的掩码数量分组以进行可视化(平均每个图像有 ∼100 个掩码)。

Segment Anything Model (SAM) 的主要特性

- 可提示分割任务: SAM 的设计考虑到了可提示分割任务,允许它从任何给定的提示(例如识别对象的空间或文本线索)生成有效的分割掩码。

- 高级架构: Segment Anything Model 采用强大的图像编码器、提示编码器和轻量级掩码解码器。这种独特的架构支持灵活的提示、实时掩码计算和分割任务中的模糊感知。

- SA-1B 数据集: 由 Segment Anything 项目引入,SA-1B 数据集包含超过 10 亿个 mask,覆盖 1100 万张图像。作为迄今为止最大的分割数据集,它为 SAM 提供了多样化和大规模的训练数据来源。

- 零样本性能: SAM 在各种分割任务中表现出出色的零样本性能,使其成为一个即用型工具,适用于各种应用,且几乎不需要提示工程。

要深入了解 Segment Anything 模型和 SA-1B 数据集,请访问Segment Anything GitHub并查阅研究论文Segment Anything。

可用模型、支持的任务和操作模式

此表展示了可用的模型及其特定的预训练权重、支持的任务,以及它们与不同操作模式(如推理、验证、训练和导出)的兼容性,其中✅表情符号表示支持的模式,❌表情符号表示不支持的模式。

| 模型类型 | 预训练权重 | 支持的任务 | 推理 | 验证 | 训练 | 导出 |

|---|---|---|---|---|---|---|

| SAM base | sam_b.pt | 实例分割 | ✅ | ❌ | ❌ | ❌ |

| SAM large | sam_l.pt | 实例分割 | ✅ | ❌ | ❌ | ❌ |

如何使用 SAM:图像分割的多功能性和强大功能

Segment Anything Model 可用于超出其训练数据的多种下游任务。这包括边缘检测、目标提议生成、实例分割和初步的文本到掩码预测。通过提示工程,SAM 可以快速适应零样本方式下的新任务和数据分布,使其成为满足您所有图像分割需求的多功能且强大的工具。

SAM 预测示例

使用提示分割

使用给定的提示分割图像。

from ultralytics import SAM

# Load a model

model = SAM("sam_b.pt")

# Display model information (optional)

model.info()

# Run inference with bboxes prompt

results = model("ultralytics/assets/zidane.jpg", bboxes=[439, 437, 524, 709])

# Run inference with single point

results = model(points=[900, 370], labels=[1])

# Run inference with multiple points

results = model(points=[[400, 370], [900, 370]], labels=[1, 1])

# Run inference with multiple points prompt per object

results = model(points=[[[400, 370], [900, 370]]], labels=[[1, 1]])

# Run inference with negative points prompt

results = model(points=[[[400, 370], [900, 370]]], labels=[[1, 0]])

分割一切

分割整个图像。

from ultralytics import SAM

# Load a model

model = SAM("sam_b.pt")

# Display model information (optional)

model.info()

# Run inference

model("path/to/image.jpg")

# Run inference with a SAM model

yolo predict model=sam_b.pt source=path/to/image.jpg

- 这里的逻辑是,如果您不传递任何提示(bboxes/点/掩码),则分割整个图像。

SAMPredictor 示例

通过这种方式,您可以设置一次图像,并多次运行提示推断,而无需多次运行图像编码器。

from ultralytics.models.sam import Predictor as SAMPredictor

# Create SAMPredictor

overrides = dict(conf=0.25, task="segment", mode="predict", imgsz=1024, model="mobile_sam.pt")

predictor = SAMPredictor(overrides=overrides)

# Set image

predictor.set_image("ultralytics/assets/zidane.jpg") # set with image file

predictor.set_image(cv2.imread("ultralytics/assets/zidane.jpg")) # set with np.ndarray

results = predictor(bboxes=[439, 437, 524, 709])

# Run inference with single point prompt

results = predictor(points=[900, 370], labels=[1])

# Run inference with multiple points prompt

results = predictor(points=[[400, 370], [900, 370]], labels=[1, 1])

# Run inference with negative points prompt

results = predictor(points=[[[400, 370], [900, 370]]], labels=[[1, 0]])

# Reset image

predictor.reset_image()

使用其他参数分割一切。

from ultralytics.models.sam import Predictor as SAMPredictor

# Create SAMPredictor

overrides = dict(conf=0.25, task="segment", mode="predict", imgsz=1024, model="mobile_sam.pt")

predictor = SAMPredictor(overrides=overrides)

# Segment with additional args

results = predictor(source="ultralytics/assets/zidane.jpg", crop_n_layers=1, points_stride=64)

注意

以上示例中返回的所有 results 在上述示例中是 结果 可轻松访问预测掩码和源图像的对象。

- 更多附加参数,用于

Segment everything参见Predictor/generate参考.

SAM 与 YOLO 的比较

SAM,我们将Meta的SAM-bUltralytics (包括YOLO26n-seg)进行比较:

| 模型 | 大小 (MB) | 参数 (M) | 速度 (CPU) (ms/im) |

|---|---|---|---|

| Meta SAM-b | 375 | 93.7 | 41703 |

| MobileSAM | 40.7 | 10.1 | 23802 |

| 带有 YOLOv8 主干 的 FastSAM-s | 23.9 | 11.8 | 58.0 |

| Ultralytics YOLOv8n-seg | 7.1(小52.8倍) | 3.4(低27.6倍) | 24.8(速度提升1682倍) |

| Ultralytics YOLO11n-seg | 6.2(小60.5倍) | 2.9(减少32.3倍) | 24.3(速度提升1716倍) |

| Ultralytics YOLO26n-seg | 6.7(缩小56.0倍) | 2.7(减少34.7倍) | 25.2(速度提升1655倍) |

本次比较展示了SAM变体和YOLO分割模型在模型尺寸和速度上的显著差异。尽管SAM提供了独特的自动分割能力,但YOLO模型,特别是YOLOv8n-seg、YOLO11n-seg和YOLO26n-seg,则显著更小、更快且计算效率更高。

SAM 使用PyTorch 测量,YOLO 使用ONNX 测量。测试在配备 16GB 内存的 2025 款 Apple M4 Air 上运行,使用 torch==2.10.0, ultralytics==8.4.31和 onnxruntime==1.24.4。要重现此测试:

示例

from ultralytics import ASSETS, SAM, YOLO, FastSAM

# Profile SAM-b, MobileSAM

for file in ["sam_b.pt", "mobile_sam.pt"]:

model = SAM(file)

model.info()

model(ASSETS)

# Profile FastSAM-s

model = FastSAM("FastSAM-s.pt")

model.info()

model(ASSETS)

# Profile YOLO models (ONNX)

for file_name in ["yolov8n-seg.pt", "yolo11n-seg.pt", "yolo26n-seg.pt"]:

model = YOLO(file_name)

model.info()

onnx_path = model.export(format="onnx", dynamic=True)

model = YOLO(onnx_path)

model(ASSETS)

自动标注:通往分割数据集的快速通道

自动标注是 SAM 的一项关键功能,允许用户使用预训练的检测模型生成分割数据集。此功能可实现对大量图像的快速准确标注,从而无需耗时的手动标注。

使用检测模型生成您的分割数据集

要使用 Ultralytics 框架自动标注您的数据集,请使用 auto_annotate function 如下所示:

示例

from ultralytics.data.annotator import auto_annotate

auto_annotate(data="path/to/images", det_model="yolo26x.pt", sam_model="sam_b.pt")

| 参数 | 类型 | 默认值 | 描述 |

|---|---|---|---|

data | str | 必需 | 包含用于标注或分割的目标图像的目录路径。 |

det_model | str | 'yolo26x.pt' | YOLO 检测模型路径,用于初始对象检测。 |

sam_model | str | 'sam_b.pt' | SAM 模型路径,用于 segment(支持 SAM、SAM2 变体和 MobileSAM 模型)。 |

device | str | '' | 计算设备(例如,'cuda:0'、'cpu',或者 '' 表示自动设备检测)。 |

conf | float | 0.25 | YOLO 检测置信度阈值,用于过滤弱检测。 |

iou | float | 0.45 | 用于非极大值抑制的 IoU 阈值,以过滤重叠框。 |

imgsz | int | 640 | 调整图像大小的输入尺寸(必须是 32 的倍数)。 |

max_det | int | 300 | 为了提高内存效率,每张图像的最大检测数量。 |

classes | list[int] | None | 要 detect 的类别索引列表(例如, [0, 1] 适用于人和自行车)。 |

output_dir | str | None | 用于保存标注的目录(默认为相对于数据路径的 '.\/labels')。 |

字段 auto_annotate 函数接受您的图像路径,以及可选参数,用于指定预训练的 detect 和 SAM segment 模型、运行模型的设备以及保存标注结果的输出目录。

使用预训练模型进行自动标注可以显著减少创建高质量分割数据集所需的时间和精力。此功能对于处理大量图像集合的研究人员和开发人员特别有益,因为它使他们能够专注于模型开发和评估,而不是手动标注。

引用和致谢

如果您发现 SAM 在您的研究或开发工作中很有用,请考虑引用我们的论文:

@misc{kirillov2023segment,

title={Segment Anything},

author={Alexander Kirillov and Eric Mintun and Nikhila Ravi and Hanzi Mao and Chloe Rolland and Laura Gustafson and Tete Xiao and Spencer Whitehead and Alexander C. Berg and Wan-Yen Lo and Piotr Dollár and Ross Girshick},

year={2023},

eprint={2304.02643},

archivePrefix={arXiv},

primaryClass={cs.CV}

}

我们要感谢 Meta AI 创建并维护了这一宝贵资源,为 计算机视觉 社区做出了贡献。

常见问题

Ultralytics 的 Segment Anything Model (SAM) 是什么?

Ultralytics 的 Segment Anything Model (SAM) 是一种革命性的图像分割模型,专为可提示分割任务而设计。它利用先进的架构,包括图像和提示编码器以及轻量级掩码解码器,从各种提示(如空间或文本提示)生成高质量的分割掩码。SAM 在广阔的 SA-1B 数据集上进行训练,擅长零样本性能,无需先验知识即可适应新的图像分布和任务。

如何使用 Segment Anything Model (SAM) 进行图像分割?

您可以使用 Segment Anything Model (SAM) 通过运行带有各种提示(如边界框或点)的推理来进行图像分割。这是一个使用 python 的示例:

from ultralytics import SAM

# Load a model

model = SAM("sam_b.pt")

# Segment with bounding box prompt

model("ultralytics/assets/zidane.jpg", bboxes=[439, 437, 524, 709])

# Segment with points prompt

model("ultralytics/assets/zidane.jpg", points=[900, 370], labels=[1])

# Segment with multiple points prompt

model("ultralytics/assets/zidane.jpg", points=[[400, 370], [900, 370]], labels=[[1, 1]])

# Segment with multiple points prompt per object

model("ultralytics/assets/zidane.jpg", points=[[[400, 370], [900, 370]]], labels=[[1, 1]])

# Segment with negative points prompt.

model("ultralytics/assets/zidane.jpg", points=[[[400, 370], [900, 370]]], labels=[[1, 0]])

或者,您可以使用命令行界面 (CLI) 中的 SAM 运行推理:

yolo predict model=sam_b.pt source=path/to/image.jpg

有关更详细的使用说明,请访问分割部分。

SAM 模型和 YOLO 模型在性能方面有何区别?

YOLO 相比,SAM、MobileSAM和FastSAM等SAM 通常体积更大、运行速度更慢,但具备独特的零样本分割能力。 例如,在CPU 上运行时,YOLO26n-seg 的体积仅为Meta 原始SAM 模型的1/56,运行速度则快了 1650 多倍。这使得YOLO 成为需要快速、轻量且计算高效的分割应用的理想选择,而SAM 则在灵活、可提示以及零样本分割任务中表现出色。

如何使用 SAM 自动标注我的数据集?

Ultralytics 的 SAM 提供自动标注功能,允许使用预训练的 detect 模型生成分割数据集。以下是 python 示例:

from ultralytics.data.annotator import auto_annotate

auto_annotate(data="path/to/images", det_model="yolo26x.pt", sam_model="sam_b.pt")

此函数接受图像路径和可选参数,用于预训练的detect和SAM分割模型,以及设备和输出目录规范。有关完整指南,请参阅自动标注。

哪些数据集用于训练 Segment Anything Model (SAM)?

SAM 在广泛的 SA-1B 数据集 上进行训练,该数据集包含超过 10 亿个掩码,涵盖 1100 万张图像。SA-1B 是迄今为止最大的分割数据集,提供高质量和多样化的训练数据,确保在各种分割任务中实现令人印象深刻的零样本性能。有关更多详细信息,请访问数据集部分。