Bereitstellung

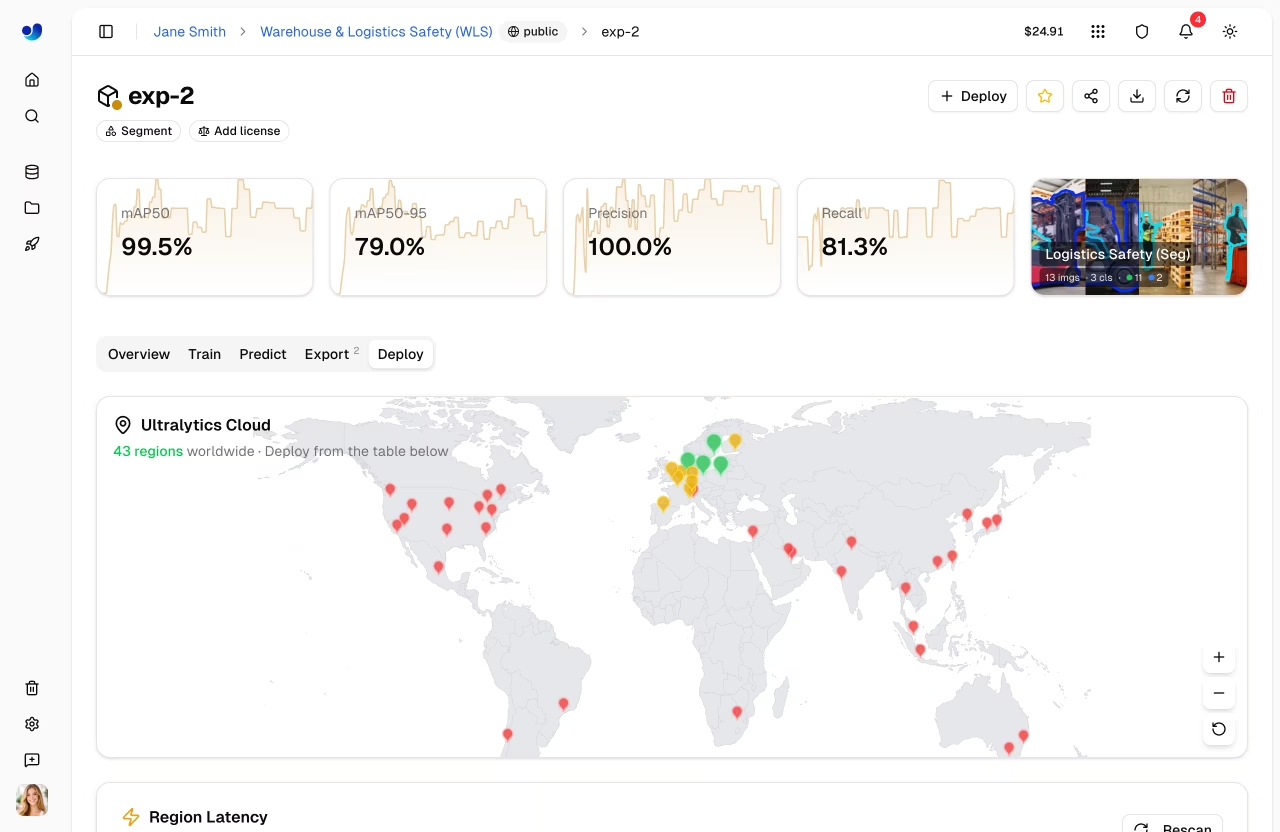

Ultralytics Platform bietet umfassende Bereitstellungsoptionen, um Ihre YOLO-Modelle in Produktion zu nehmen. Testen Sie Modelle mit browserbasierter Inferenz, stellen Sie sie auf dedizierten Endpunkten in 43 globalen Regionen bereit und überwachen Sie die Leistung in Echtzeit.

Ansehen: Erste Schritte mit Ultralytics – Bereitstellung

Überblick

Der Abschnitt Bereitstellung hilft Ihnen dabei:

- Test Modelle direkt im Browser mit dem

PredictRegisterkarte - auf dedizierten Endpunkten in 43 globalen Regionen zu bereitzustellen

- Überwachen Sie Anforderungsmetriken, Protokolle und Integritätsprüfungen

- Skalierung automatisch mit dem Traffic (einschließlich Skalierung auf Null).

Bereitstellungsoptionen

Ultralytics Platform bietet mehrere Bereitstellungspfade:

| Option | Beschreibung | Am besten geeignet für |

|---|---|---|

| Vorhersage-Registerkarte | Browserbasierte Inferenz mit Bild, Webcam und Beispielen | Entwicklung, Validierung |

| Geteilte Inferenz | Multi-Tenant-Service in 3 Regionen | Leichte Nutzung, Tests |

| Dedizierte Endpunkte | Single-Tenant-Services in 43 Regionen | Produktion, geringe Latenz |

Workflow

graph LR

A[✅ Test] --> B[⚙️ Configure]

B --> C[🌐 Deploy]

C --> D[📊 Monitor]

style A fill:#4CAF50,color:#fff

style B fill:#2196F3,color:#fff

style C fill:#FF9800,color:#fff

style D fill:#9C27B0,color:#fff| Phase | Beschreibung |

|---|---|

| Test | Modell mit dem Predict Registerkarte |

| Konfigurieren | Wählen Sie Region, Ressourcen und Bereitstellungsnamen aus. |

| Bereitstellung | Erstellen Sie einen dedizierten Endpunkt aus dem Deploy Registerkarte |

| Überwachen | Verfolgen Sie Anfragen, Latenzzeiten, Fehler und Protokolle in der Überwachung. |

Architektur

Geteilte Inferenz

Der gemeinsam genutzte Inferenzdienst wird in drei wichtigen Regionen ausgeführt und leitet Anfragen automatisch basierend auf Ihrer Datenregion weiter:

graph TB

User[User Request] --> API[Platform API]

API --> Router{Region Router}

Router -->|US users| US["US Predict Service<br/>Iowa"]

Router -->|EU users| EU["EU Predict Service<br/>Belgium"]

Router -->|AP users| AP["AP Predict Service<br/>Hong Kong"]

style User fill:#f5f5f5,color:#333

style API fill:#2196F3,color:#fff

style Router fill:#FF9800,color:#fff

style US fill:#4CAF50,color:#fff

style EU fill:#4CAF50,color:#fff

style AP fill:#4CAF50,color:#fff| Region | Standort |

|---|---|

| USA | Iowa, USA |

| EU | Belgien, Europa |

| AP | Hongkong, Asien-Pazifik |

Dedizierte Endpunkte

Bereitstellung in 43 Regionen weltweit in der Ultralytics Cloud:

- Amerika: 14 Regionen

- Europa: 13 Regionen

- Asien-Pazifik: 12 Regionen

- Naher Osten & Afrika: 4 Regionen

Jeder Endpunkt ist ein Single-Tenant-Dienst mit:

- Dedizierte Rechenressourcen (konfigurierbare CPU und Arbeitsspeicher)

- Automatische Skalierung (Skalierung auf Null im Leerlauf)

- Eindeutige Endpunkt-URL

- Unabhängige Überwachung, Protokolle und Zustandsprüfungen

Bereitstellungsseite

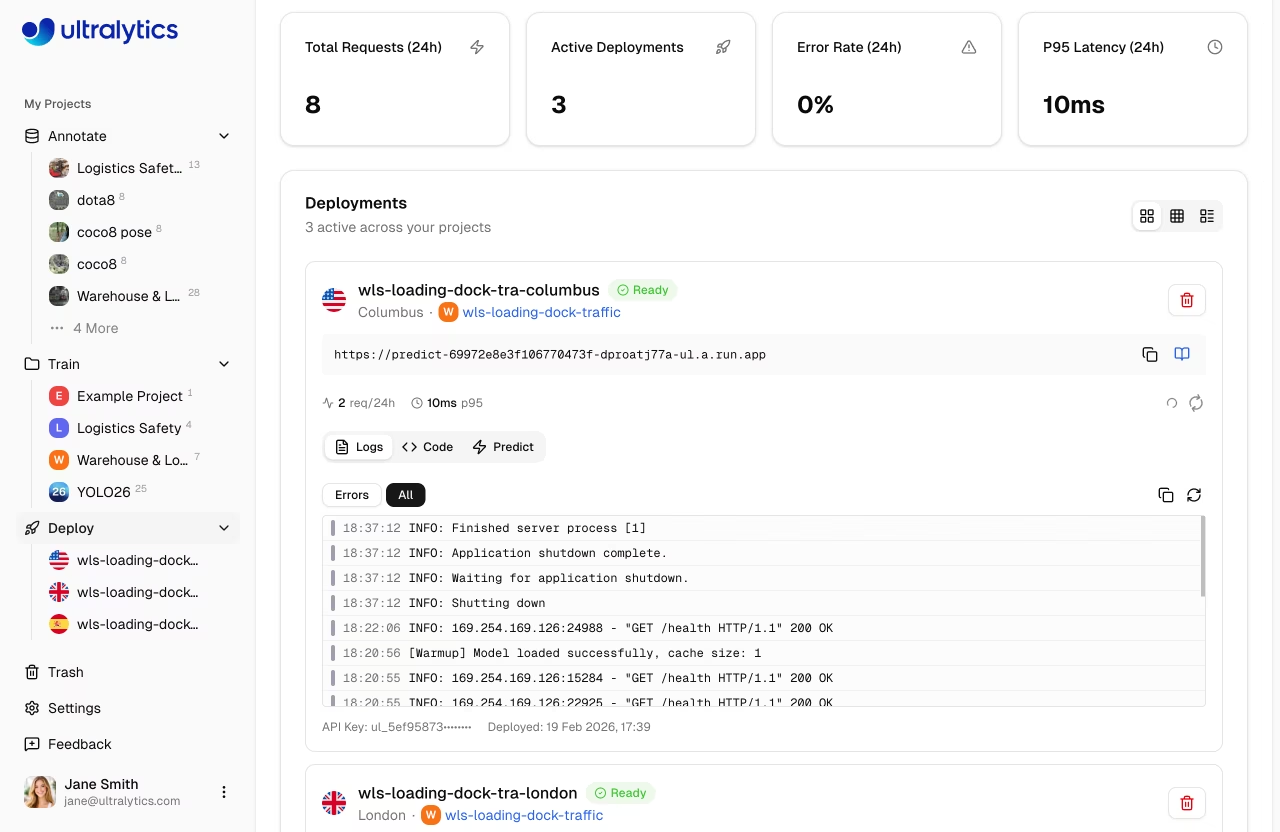

Greifen Sie über die Seitenleiste unter auf die globale Bereitstellungsseite zu Deploy. Diese Seite zeigt:

- Weltkarte mit Bereitstellungs-Region-Pins (interaktive Karte)

- Übersichtskarten: Gesamtanfragen (24h), Aktive Bereitstellungen, Fehlerrate (24h), P95 Latenz (24h)

- Bereitstellungsliste mit drei Ansichtsmodi: Karten, kompakt und Tabelle.

- Neue Bereitstellung-Schaltfläche zum Erstellen von Endpunkten aus jedem fertiggestellten Modell

Automatische Abfrage

Die Seite fragt alle 30 Sekunden nach Aktualisierungen der Metriken. Wenn sich Bereitstellungen in einem Übergangsstatus befinden (Erstellen, Bereitstellen, Beenden), erhöht sich die Abfragefrequenz auf alle 2–3 Sekunden, um nahezu sofortiges Feedback zu ermöglichen.

Hauptmerkmale

Globale Abdeckung

Stellen Sie nahe bei Ihren Benutzern bereit, mit 43 Regionen, die abdecken:

- Nordamerika, Südamerika

- Europa, Mittlerer Osten, Afrika

- Asien-Pazifik, Ozeanien

Auto-Skalierung

Endpunkte skalieren automatisch:

- Skalierung auf Null: Keine Kosten im Leerlauf (Standard).

- Hochskalieren: Automatische Bewältigung von Verkehrsspitzen.

Kosteneinsparungen

Die Skalierung auf Null ist standardmäßig aktiviert (min. Instanzen = 0). Sie zahlen nur für die aktive Inferenzzeit.

Geringe Latenz

Dedizierte Endpunkte bieten:

- Kaltstart: ~5-15 Sekunden (zwischengespeicherter Container), bis zu ~45 Sekunden (erste Bereitstellung)

- Warme Inferenz: 50-200 ms (modellabhängig)

- Regionales Routing für optimale Leistung

Gesundheitschecks

Jede laufende Bereitstellung umfasst eine automatische Zustandsprüfung mit:

- Live-Statusanzeige (fehlerfrei/fehlerhaft)

- Anzeige der Reaktionslatenz

- Automatisches Wiederholen bei Fehlfunktion (Abfrage alle 20 Sekunden)

- Schaltfläche für manuelle Aktualisierung

Schnellstart

Ein Modell in weniger als 2 Minuten bereitstellen:

- Ein Modell trainieren oder in ein Projekt hochladen

- Gehen Sie zur Registerkarte „Bereitstellen“ des Modells.

- Wählen Sie eine Region aus der Latenztabelle aus.

- Klicken Sie auf Bereitstellen — Ihr Endpunkt ist live

Schnelle Bereitstellung

Model → Deploy tab → Select region → Click Deploy → Endpoint URL ready

Nach der Bereitstellung verwenden Sie die Endpunkt-URL mit Ihrem API-Schlüssel, um Inferenzanfragen von jeder Anwendung aus zu senden.

Schnellzugriffe

- Inferenz: Modelle im Browser testen

- Endpunkte: Dedizierte Endpunkte bereitstellen

- Monitoring: Tracken Sie die Bereitstellungs-Performance

FAQ

Was ist der Unterschied zwischen geteilter und dedizierter Inferenz?

| Merkmal | Geteilt | Dediziert |

|---|---|---|

| Latenz | Variabel | Konsistent |

| Kosten | Kostenlos (im Preis inbegriffen) | Kostenlos (Basisversion), nutzungsabhängig (Erweiterte Version) |

| Skala | Begrenzt | Konfigurierbar |

| Regionen | 3 | 43 |

| URL | Generisch | Benutzerdefiniert |

| Rate | 20 Anfragen/Min. | Unbegrenzt |

Wie lange dauert die Bereitstellung?

Die Bereitstellung dedizierter Endpunkte dauert in der Regel 1-2 Minuten:

- Image-Pull (~30s)

- Container-Start (~30s)

- Zustandsprüfung (~30s)

Kann ich mehrere Modelle bereitstellen?

Ja, jedes Modell kann mehrere Endpunkte in verschiedenen Regionen haben. Es gibt keine Begrenzung der Gesamtzahl der Endpunkte (abhängig von Ihrem Plan).

Was passiert, wenn ein Endpunkt im Leerlauf ist?

Mit aktivierter Skalierung auf Null:

- Endpunkt skaliert nach Inaktivität herunter

- Erste Anfrage löst Kaltstart aus

- Nachfolgende Anfragen sind schnell

Die ersten Anfragen nach einer Leerlaufphase lösen einen Kaltstart aus.