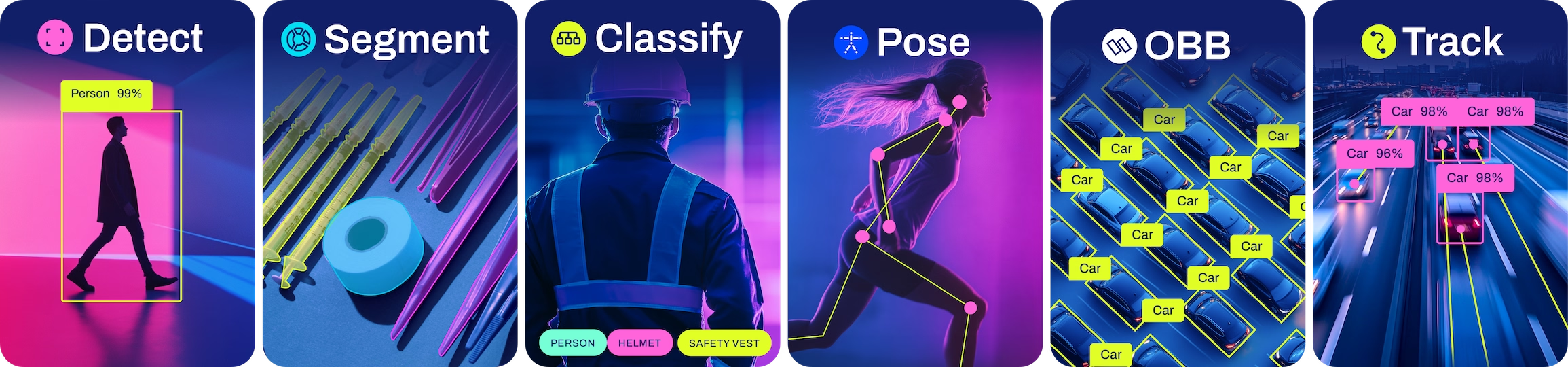

Computer-Vision-Aufgaben, die von Ultralytics YOLO26 unterstützt werden

Ultralytics YOLO26 ist ein vielseitiges KI-Framework, das mehrere Computer-Vision-Aufgaben unterstützt. Das Framework kann zur Durchführung von detect, segment, obb, Klassifizierung und Posenschätzung verwendet werden. Jede dieser Aufgaben hat ein anderes Ziel und einen anderen Anwendungsfall, sodass Sie verschiedene Computer-Vision-Herausforderungen mit einem einzigen Framework bewältigen können.

Ansehen: Entdecken Sie Ultralytics YOLO-Aufgaben: Objekterkennung, Segmentierung, OBB, Tracking und Pose-Schätzung.

Erkennung

detect ist die primäre Aufgabe, die von YOLO26 unterstützt wird. Dabei werden Objekte in einem Bild oder Videobild identifiziert und Begrenzungsrahmen um sie gezeichnet. Die erkannten Objekte werden basierend auf ihren Merkmalen in verschiedene Kategorien eingeteilt. YOLO26 kann mehrere Objekte in einem einzigen Bild oder Videobild mit hoher Genauigkeit und Geschwindigkeit detect, was es ideal für Echtzeitanwendungen wie Überwachungssysteme und autonome Fahrzeuge macht.

Bildsegmentierung

Segmentierung erweitert die Objekterkennung, indem sie Masken auf Pixelebene für jedes Objekt erzeugt. Diese Präzision ist nützlich für Anwendungen wie medizinische Bildgebung, landwirtschaftliche Analyse und Qualitätskontrolle in der Fertigung.

Klassifizierung

Klassifizierung beinhaltet die Kategorisierung ganzer Bilder basierend auf ihrem Inhalt. Diese Aufgabe ist unerlässlich für Anwendungen wie die Produktkategorisierung im E-Commerce, Inhaltsmoderation und Wildtierüberwachung.

Pose-Schätzung

Die Posenschätzung detect spezifische Schlüsselpunkte in Bildern oder Videobildern, um Bewegungen zu track oder Posen zu schätzen. Diese Schlüsselpunkte können menschliche Gelenke, Gesichtsmerkmale oder andere wichtige Punkte von Interesse darstellen. YOLO26 zeichnet sich durch Schlüsselpunkterkennung mit hoher Genauigkeit und Geschwindigkeit aus, was es wertvoll für Fitnessanwendungen, Sportanalysen und die Mensch-Computer-Interaktion macht.

OBB

Die Oriented Bounding Box (obb) detect erweitert die traditionelle Objekterkennung durch Hinzufügen eines Orientierungswinkels, um rotierte Objekte besser zu lokalisieren. Diese Fähigkeit ist besonders wertvoll für die Analyse von Luftbildern, die Dokumentenverarbeitung und industrielle Anwendungen, bei denen Objekte in verschiedenen Winkeln erscheinen. YOLO26 bietet hohe Genauigkeit und Geschwindigkeit für das detect von rotierten Objekten in verschiedenen Szenarien.

Fazit

Ultralytics YOLO26 unterstützt mehrere Computer-Vision-Aufgaben, darunter detect, segment, Klassifizierung, Erkennung orientierter Objekte und Schlüsselpunkterkennung. Jede Aufgabe adressiert spezifische Anforderungen in der Computer-Vision-Landschaft, von der grundlegenden Objektidentifikation bis zur detaillierten Posenschätzung. Durch das Verständnis der Fähigkeiten und Anwendungen jeder Aufgabe können Sie den am besten geeigneten Ansatz für Ihre spezifischen Computer-Vision-Herausforderungen auswählen und die leistungsstarken Funktionen von YOLO26 nutzen, um effektive Lösungen zu entwickeln.

FAQ

Welche Computer-Vision-Aufgaben kann Ultralytics YOLO26 ausführen?

Ultralytics YOLO26 ist ein vielseitiges KI-Framework, das verschiedene Computer-Vision-Aufgaben mit hoher Genauigkeit und Geschwindigkeit ausführen kann. Diese Aufgaben umfassen:

- Objekterkennung: Identifizierung und Lokalisierung von Objekten in Bildern oder Videoframes durch das Zeichnen von Begrenzungsrahmen um diese.

- Bildsegmentierung: Segmentierung von Bildern in verschiedene Regionen basierend auf ihrem Inhalt, nützlich für Anwendungen wie die medizinische Bildgebung.

- Classification: Kategorisierung ganzer Bilder basierend auf deren Inhalt.

- Pose Estimation: Erkennen spezifischer Keypoints in einem Bild- oder Videoframe, um Bewegungen oder Posen zu tracken.

- Orientierte Objekterkennung (OBB): Erkennung gedrehter Objekte mit einem zusätzlichen Ausrichtungswinkel für erhöhte Genauigkeit.

Wie verwende ich Ultralytics YOLO26 für die Objekterkennung?

Um Ultralytics YOLO26 für die Objekterkennung zu verwenden, befolgen Sie diese Schritte:

- Bereiten Sie Ihren Datensatz im entsprechenden Format vor.

- Trainieren Sie das YOLO26-Modell mithilfe der detect-Aufgabe.

- Verwenden Sie das Modell, um Vorhersagen zu treffen, indem Sie neue Bilder oder Videoframes einspeisen.

Beispiel

from ultralytics import YOLO

# Load a pretrained YOLO model (adjust model type as needed)

model = YOLO("yolo26n.pt") # n, s, m, l, x versions available

# Perform object detection on an image

results = model.predict(source="image.jpg") # Can also use video, directory, URL, etc.

# Display the results

results[0].show() # Show the first image results

# Run YOLO detection from the command line

yolo detect model=yolo26n.pt source="image.jpg" # Adjust model and source as needed

Weitere detaillierte Anweisungen finden Sie in unseren Erkennungsbeispielen.

Welche Vorteile bietet die Verwendung von YOLO26 für segment-Aufgaben?

Die Verwendung von YOLO26 für segment-Aufgaben bietet mehrere Vorteile:

- Hohe Genauigkeit: Die Segmentierungsaufgabe liefert präzise Masken auf Pixelebene.

- Geschwindigkeit: YOLO26 ist für Echtzeitanwendungen optimiert und bietet eine schnelle Verarbeitung selbst für hochauflösende Bilder.

- Vielfältige Anwendungen: Es ist ideal für medizinische Bildgebung, autonomes Fahren und andere Anwendungen, die eine detaillierte Bildsegmentierung erfordern.

Erfahren Sie mehr über die Vorteile und Anwendungsfälle von YOLO26 für segment in der Bildsegmentierungssektion.

Kann Ultralytics YOLO26 Posenschätzung und Schlüsselpunkterkennung durchführen?

Ja, Ultralytics YOLO26 kann Posenschätzung und Schlüsselpunkterkennung effektiv mit hoher Genauigkeit und Geschwindigkeit durchführen. Diese Funktion ist besonders nützlich für das track von Bewegungen in Sportanalysen, im Gesundheitswesen und in Mensch-Computer-Interaktionsanwendungen. YOLO26 detect Schlüsselpunkte in einem Bild oder Videobild, was eine präzise Posenschätzung ermöglicht.

Weitere Details und Implementierungstipps finden Sie in unseren Pose-Schätzungsbeispielen.

Warum sollte ich mich für Ultralytics YOLO26 für die Erkennung orientierter Objekte (obb) entscheiden?

Oriented Object Detection (obb) mit YOLO26 bietet eine verbesserte Präzision, indem Objekte mit einem zusätzlichen Winkelparameter detect werden. Diese Funktion ist vorteilhaft für Anwendungen, die eine genaue Lokalisierung rotierter Objekte erfordern, wie z.B. die Analyse von Luftbildern und die Lagerautomatisierung.

- Erhöhte Präzision: Die Winkelkomponente reduziert falsch positive Ergebnisse für gedrehte Objekte.

- Vielseitige Anwendungen: Nützlich für Aufgaben in der Geodatenanalyse, Robotik usw.

Weitere Details und Beispiele finden Sie im Abschnitt Orientierte Objekterkennung.