Instanzsegmentierung

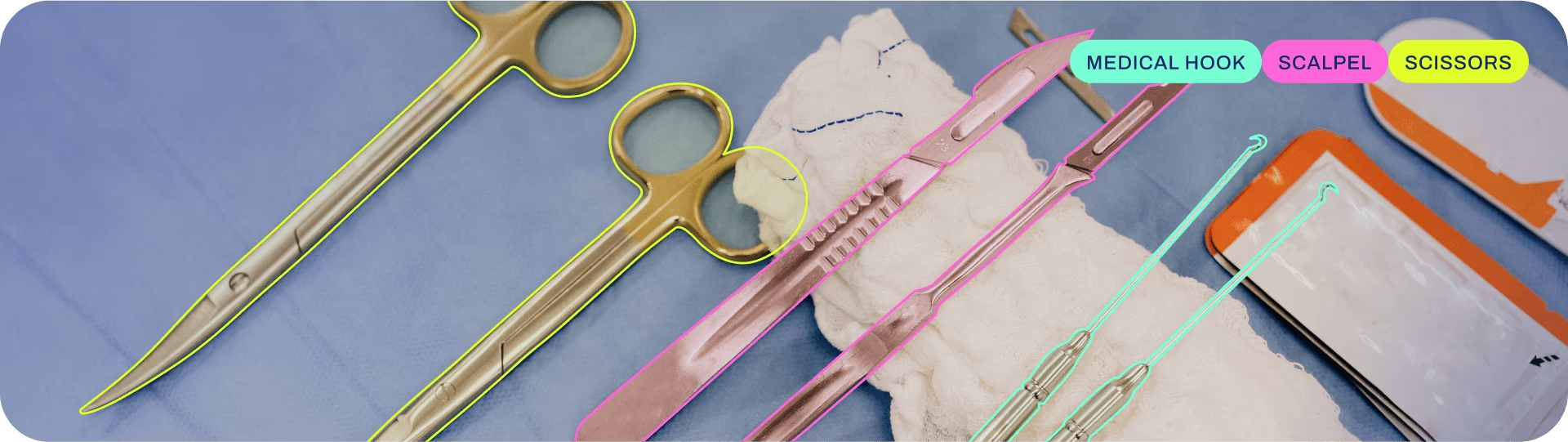

Die Instanzsegmentierung geht noch einen Schritt weiter als die Objekterkennung und beinhaltet die Identifizierung einzelner Objekte in einem Bild und deren Segmentierung vom Rest des Bildes.

Die Ausgabe eines Instanzsegmentierungsmodells ist ein Satz von Masken oder Konturen, die jedes Objekt im Bild umreißen, zusammen mit Klassenbezeichnungen und Konfidenzwerten für jedes Objekt. Die Instanzsegmentierung ist nützlich, wenn Sie nicht nur wissen müssen, wo sich Objekte in einem Bild befinden, sondern auch, wie ihre genaue Form ist.

Ansehen: Führen Sie die Segmentation mit einem vortrainierten Ultralytics YOLO Modell in Python aus.

Tipp

YOLO26 Segment-Modelle verwenden die -seg Suffix, d.h., yolo26n-seg.pt, und sind vortrainiert auf COCO.

Modelle

Vortrainierte YOLO26 Segment-Modelle werden hier gezeigt. Detect-, Segment- und Pose-Modelle sind auf dem COCO-Datensatz vortrainiert, während Classify-Modelle auf dem ImageNet-Datensatz vortrainiert sind.

Modelle werden beim ersten Gebrauch automatisch von der neuesten Ultralytics Version heruntergeladen.

| Modell | Größe (Pixel) | mAPbox 50-95(e2e) | mAPmask 50-95(e2e) | Geschwindigkeit CPU ONNX (ms) | Geschwindigkeit T4 TensorRT10 (ms) | Parameter (M) | FLOPs (B) |

|---|---|---|---|---|---|---|---|

| YOLO26n-seg | 640 | 39.6 | 33.9 | 53.3 ± 0.5 | 2.1 ± 0.0 | 2.7 | 9.1 |

| YOLO26s-seg | 640 | 47.3 | 40.0 | 118.4 ± 0.9 | 3.3 ± 0.0 | 10.4 | 34.2 |

| YOLO26m-seg | 640 | 52.5 | 44.1 | 328.2 ± 2.4 | 6.7 ± 0.1 | 23.6 | 121.5 |

| YOLO26l-seg | 640 | 54.4 | 45.5 | 387.0 ± 3.7 | 8.0 ± 0.1 | 28.0 | 139.8 |

| YOLO26x-seg | 640 | 56.5 | 47.0 | 787.0 ± 6.8 | 16.4 ± 0.1 | 62.8 | 313.5 |

- mAPval Werte gelten für Single-Model, Single-Scale auf COCO val2017 Datensatz.

Reproduzieren durchyolo val segment data=coco.yaml device=0 - Geschwindigkeit gemittelt über COCO-Validierungsbilder unter Verwendung eines Amazon EC2 P4d Instanz.

Reproduzieren durchyolo val segment data=coco.yaml batch=1 device=0|cpu - Parameter und FLOPs Die Werte gelten für das fusionierte Modell nach

model.fuse(), das Conv- und BatchNorm-Schichten zusammenführt und bei End-to-End-Modellen den zusätzlichen One-to-Many-detect-Kopf entfernt. Vortrainierte Checkpoints behalten die vollständige Trainingsarchitektur bei und können höhere Zählwerte aufweisen.

Trainieren

Trainieren Sie YOLO26n-seg auf dem COCO8-seg-Datensatz für 100 Epochen bei einer Bildgröße von 640. Eine vollständige Liste der verfügbaren Argumente finden Sie auf der Seite Konfiguration.

Beispiel

from ultralytics import YOLO

# Load a model

model = YOLO("yolo26n-seg.yaml") # build a new model from YAML

model = YOLO("yolo26n-seg.pt") # load a pretrained model (recommended for training)

model = YOLO("yolo26n-seg.yaml").load("yolo26n-seg.pt") # build from YAML and transfer weights

# Train the model

results = model.train(data="coco8-seg.yaml", epochs=100, imgsz=640)

# Build a new model from YAML and start training from scratch

yolo segment train data=coco8-seg.yaml model=yolo26n-seg.yaml epochs=100 imgsz=640

# Start training from a pretrained *.pt model

yolo segment train data=coco8-seg.yaml model=yolo26n-seg.pt epochs=100 imgsz=640

# Build a new model from YAML, transfer pretrained weights to it and start training

yolo segment train data=coco8-seg.yaml model=yolo26n-seg.yaml pretrained=yolo26n-seg.pt epochs=100 imgsz=640

Vollständige train Details zum Modus finden Sie auf der Trainieren Seite. Segmentierungsmodelle können auch auf Cloud-GPUs trainiert werden, und zwar über Ultralytics Plattform.

Datensatzformat

Das Format YOLO wird im Datensatz-Leitfaden ausführlich beschrieben. Um Ihren bestehenden Datensatz aus anderen Formaten (wie COCO .) in YOLO zu konvertieren, verwenden Sie bitte das Tool „JSON2YOLO“ von Ultralytics. Sie können Segmentierungsmasken auch auf Ultralytics mithilfe von Polygon-Werkzeugen und der SAM intelligenten Annotation erstellen.

Validieren

Validieren Sie das trainierte YOLO26n-seg-Modell Genauigkeit auf dem COCO8-seg-Datensatz. Es sind keine Argumente erforderlich, da die model behält sein Training data und Argumente als Modellattribute.

Beispiel

from ultralytics import YOLO

# Load a model

model = YOLO("yolo26n-seg.pt") # load an official model

model = YOLO("path/to/best.pt") # load a custom model

# Validate the model

metrics = model.val() # no arguments needed, dataset and settings remembered

metrics.box.map # map50-95(B)

metrics.box.map50 # map50(B)

metrics.box.map75 # map75(B)

metrics.box.maps # a list containing mAP50-95(B) for each category

metrics.box.image_metrics # per-image metrics dictionary for det with precision, recall, F1, TP, FP, and FN

metrics.seg.map # map50-95(M)

metrics.seg.map50 # map50(M)

metrics.seg.map75 # map75(M)

metrics.seg.maps # a list containing mAP50-95(M) for each category

metrics.seg.image_metrics # per-image metrics dictionary for seg with precision, recall, F1, TP, FP, and FN

yolo segment val model=yolo26n-seg.pt # val official model

yolo segment val model=path/to/best.pt # val custom model

Vorhersagen

Verwenden Sie ein trainiertes YOLO26n-seg-Modell, um Vorhersagen auf Bildern auszuführen.

Beispiel

from ultralytics import YOLO

# Load a model

model = YOLO("yolo26n-seg.pt") # load an official model

model = YOLO("path/to/best.pt") # load a custom model

# Predict with the model

results = model("https://ultralytics.com/images/bus.jpg") # predict on an image

# Access the results

for result in results:

xy = result.masks.xy # mask in polygon format

xyn = result.masks.xyn # normalized

masks = result.masks.data # mask in matrix format (num_objects x H x W)

yolo segment predict model=yolo26n-seg.pt source='https://ultralytics.com/images/bus.jpg' # predict with official model

yolo segment predict model=path/to/best.pt source='https://ultralytics.com/images/bus.jpg' # predict with custom model

Vollständige predict Details zum Modus finden Sie auf der Vorhersagen Seite.

Export

Exportieren Sie ein YOLO26n-seg-Modell in ein anderes Format wie ONNX, CoreML usw.

Beispiel

from ultralytics import YOLO

# Load a model

model = YOLO("yolo26n-seg.pt") # load an official model

model = YOLO("path/to/best.pt") # load a custom-trained model

# Export the model

model.export(format="onnx")

yolo export model=yolo26n-seg.pt format=onnx # export official model

yolo export model=path/to/best.pt format=onnx # export custom-trained model

Verfügbare YOLO26-seg Exportformate sind in der folgenden Tabelle aufgeführt. Sie können in jedes Format exportieren, indem Sie die format Argument, d.h. format='onnx' oder format='engine'. Sie können direkt auf exportierten Modellen vorhersagen oder validieren, d.h., yolo predict model=yolo26n-seg.onnx. Anwendungsbeispiele werden nach Abschluss des Exports für Ihr Modell angezeigt.

| Format | format Argument | Modell | Metadaten | Argumente |

|---|---|---|---|---|

| PyTorch | - | yolo26n-seg.pt | ✅ | - |

| TorchScript | torchscript | yolo26n-seg.torchscript | ✅ | imgsz, half, dynamic, optimize, nms, batch, device |

| ONNX | onnx | yolo26n-seg.onnx | ✅ | imgsz, half, dynamic, simplify, opset, nms, batch, device |

| OpenVINO | openvino | yolo26n-seg_openvino_model/ | ✅ | imgsz, half, dynamic, int8, nms, batch, data, fraction, device |

| TensorRT | engine | yolo26n-seg.engine | ✅ | imgsz, half, dynamic, simplify, workspace, int8, nms, batch, data, fraction, device |

| CoreML | coreml | yolo26n-seg.mlpackage | ✅ | imgsz, dynamic, half, int8, nms, batch, device |

| TF SavedModel | saved_model | yolo26n-seg_saved_model/ | ✅ | imgsz, keras, int8, nms, batch, data, fraction, device |

| TF GraphDef | pb | yolo26n-seg.pb | ❌ | imgsz, batch, device |

| TF Lite | tflite | yolo26n-seg.tflite | ✅ | imgsz, half, int8, nms, batch, data, fraction, device |

| TF Edge TPU | edgetpu | yolo26n-seg_edgetpu.tflite | ✅ | imgsz, int8, data, fraction, device |

| TF.js | tfjs | yolo26n-seg_web_model/ | ✅ | imgsz, half, int8, nms, batch, data, fraction, device |

| PaddlePaddle | paddle | yolo26n-seg_paddle_model/ | ✅ | imgsz, batch, device |

| MNN | mnn | yolo26n-seg.mnn | ✅ | imgsz, batch, int8, half, device |

| NCNN | ncnn | yolo26n-seg_ncnn_model/ | ✅ | imgsz, half, batch, device |

| IMX500 | imx | yolo26n-seg_imx_model/ | ✅ | imgsz, int8, data, fraction, nms, device |

| RKNN | rknn | yolo26n-seg_rknn_model/ | ✅ | imgsz, batch, name, device |

| ExecuTorch | executorch | yolo26n-seg_executorch_model/ | ✅ | imgsz, batch, device |

| Axelera | axelera | yolo26n-seg_axelera_model/ | ✅ | imgsz, batch, int8, data, fraction, device |

Vollständige export Details auf der Export Seite.

FAQ

Wie trainiere ich ein YOLO26 segment Modell auf einem benutzerdefinierten Datensatz?

Um ein YOLO26 Segmentierungsmodell auf einem benutzerdefinierten Datensatz zu trainieren, müssen Sie Ihren Datensatz zunächst im YOLO Segmentierungsformat vorbereiten. Sie können Tools wie JSON2YOLO verwenden, um Datensätze aus anderen Formaten zu konvertieren. Sobald Ihr Datensatz bereit ist, können Sie das Modell mit python- oder CLI-Befehlen trainieren:

Beispiel

from ultralytics import YOLO

# Load a pretrained YOLO26 segment model

model = YOLO("yolo26n-seg.pt")

# Train the model

results = model.train(data="path/to/your_dataset.yaml", epochs=100, imgsz=640)

yolo segment train data=path/to/your_dataset.yaml model=yolo26n-seg.pt epochs=100 imgsz=640

Weitere verfügbare Argumente finden Sie auf der Seite Konfiguration.

Was ist der Unterschied zwischen Objekterkennung und Instanzsegmentierung in YOLO26?

Objekt detect identifiziert und lokalisiert Objekte innerhalb eines Bildes, indem Begrenzungsrahmen um sie gezeichnet werden, während die Instanzsegmentierung nicht nur die Begrenzungsrahmen identifiziert, sondern auch die genaue Form jedes Objekts abgrenzt. YOLO26 Instanzsegmentierungsmodelle liefern Masken oder Konturen, die jedes detect Objekt umreißen, was besonders nützlich ist für Aufgaben, bei denen die genaue Form von Objekten wichtig ist, wie z.B. in der medizinischen Bildgebung oder beim autonomen Fahren.

Warum YOLO26 für die Instanzsegmentierung verwenden?

Ultralytics YOLO26 ist ein hochmodernes Modell, das für seine hohe Genauigkeit und Echtzeitleistung bekannt ist und sich daher ideal für Instanzsegmentierungsaufgaben eignet. YOLO26 Segment-Modelle sind auf dem COCO-Datensatz vortrainiert, was eine robuste Leistung über eine Vielzahl von Objekten hinweg gewährleistet. Darüber hinaus unterstützt YOLO Trainings-, Validierungs-, Vorhersage- und Exportfunktionen mit nahtloser Integration, was es sowohl für Forschungs- als auch für Industrieanwendungen äußerst vielseitig macht.

Wie lade und validiere ich ein vortrainiertes YOLO-Segmentierungsmodell?

Das Laden und Validieren eines vortrainierten YOLO-Segmentierungsmodells ist unkompliziert. Hier erfahren Sie, wie Sie dies mit Python und CLI tun können:

Beispiel

from ultralytics import YOLO

# Load a pretrained model

model = YOLO("yolo26n-seg.pt")

# Validate the model

metrics = model.val()

print("Mean Average Precision for boxes:", metrics.box.map)

print("Mean Average Precision for masks:", metrics.seg.map)

yolo segment val model=yolo26n-seg.pt

Diese Schritte liefern Ihnen Validierungsmetriken wie Mean Average Precision (mAP), die entscheidend für die Bewertung der Modellleistung sind.

Wie kann ich ein YOLO-Segmentierungsmodell in das ONNX-Format exportieren?

Das Exportieren eines YOLO-Segmentierungsmodells in das ONNX-Format ist einfach und kann mit Python- oder CLI-Befehlen erfolgen:

Beispiel

from ultralytics import YOLO

# Load a pretrained model

model = YOLO("yolo26n-seg.pt")

# Export the model to ONNX format

model.export(format="onnx")

yolo export model=yolo26n-seg.pt format=onnx

Weitere Informationen zum Exportieren in verschiedene Formate finden Sie auf der Seite Export.