Modelltraining

Die Ultralytics Platform bietet umfassende Tools für das Training von YOLO-Modellen, von der Organisation von Experimenten bis zur Ausführung von Cloud-Trainingsjobs mit Echtzeit-Metrik-Streaming.

Ansehen: Erste Schritte mit Ultralytics – Train

Überblick

Der Abschnitt Training hilft Ihnen dabei:

- Modelle in Projekte organisieren für eine einfachere Verwaltung

- Trainieren Sie auf Cloud-GPUs mit einem einzigen Klick.

- Überwachen Sie Echtzeit-Metriken während des Trainings.

- Vergleichen Sie die Modellleistung über Experimente hinweg.

- Export in über 17 Bereitstellungsformate (siehe unterstützte Formate)

Workflow

graph LR

A[📁 Project] --> B[⚙️ Configure]

B --> C[🚀 Train]

C --> D[📈 Monitor]

D --> E[📦 Export]

style A fill:#4CAF50,color:#fff

style B fill:#2196F3,color:#fff

style C fill:#FF9800,color:#fff

style D fill:#9C27B0,color:#fff

style E fill:#00BCD4,color:#fff| Phase | Beschreibung |

|---|---|

| Projekt | Erstellen Sie einen Arbeitsbereich, um verwandte Modelle zu organisieren. |

| Konfigurieren | Datensatz, Basismodell und Trainingsparameter auswählen |

| Trainieren | Ausführen auf Cloud-GPUs oder Ihrer lokalen Hardware. |

| Überwachen | Echtzeit-Verlustkurven und Metriken anzeigen. |

| Export | In über 17 Bereitstellungsformate konvertieren (Details) |

Trainingsoptionen

Ultralytics Platform unterstützt mehrere Trainingsansätze:

| Methode | Beschreibung | Am besten geeignet für |

|---|---|---|

| Cloud-Training | Trainieren Sie auf Ultralytics -GPUs | Keine lokale GPU, Skalierbarkeit |

| Lokale Schulung | Lokal trainieren, Metriken an die Plattform streamen | Vorhandene Hardware, Datenschutz |

| Colab-Training | Verwenden Sie Google mit Plattformintegration | Kostenloser GPU-Zugang |

GPU-Optionen

Verfügbare GPUs für Cloud-Training auf Ultralytics Cloud:

| GPU | Generation | VRAM | Kosten/Stunde | Am besten geeignet für |

|---|---|---|---|---|

| RTX 2000 Ada | Ada | 16 GB | $0.24 | Kleine Datensätze, zum Testen |

| RTX A4500 | Ampere | 20 GB | $0.25 | Kleine bis mittlere Datensätze |

| RTX 4000 Ada | Ada | 20 GB | $0.26 | Mittlere Datensätze |

| RTX A5000 | Ampere | 24 GB | $0.27 | Mittlere Datensätze |

| L4 | Ada | 24 GB | $0.39 | Für Inferenz optimiert |

| A40 | Ampere | 48 GB | $0.40 | Größere Batch-Größen |

| RTX 3090 | Ampere | 24 GB | $0.46 | Allgemeines Training |

| RTX A6000 | Ampere | 48 GB | $0.49 | Große Modelle |

| RTX PRO 4500 | Blackwell | 32 GB | $0.54 | Hervorragendes Preis-Leistungs-Verhältnis |

| RTX 4090 | Ada | 24 GB | $0.59 | Bestes Preis-Leistungs-Verhältnis |

| RTX 6000 Ada | Ada | 48 GB | $0.77 | Training mit großen Batches |

| L40S | Ada | 48 GB | $0.86 | Training mit großen Batches |

| RTX 5090 | Blackwell | 32 GB | $0.89 | Neueste Consumer-Generation |

| L40 | Ada | 48 GB | $0.99 | Große Modelle |

| A100 PCIe | Ampere | 80 GB | $1.39 | Produktionstraining |

| A100 SXM | Ampere | 80 GB | $1.49 | Produktionstraining |

| RTX PRO 6000 | Blackwell | 96 GB | $1.69 | Empfohlener Standard |

| H100 PCIe | Hopper | 80 GB | $2.39 | Hochleistungs-Training |

| H100 SXM | Hopper | 80 GB | $2.69 | Schnellstes Training |

| H100 NVL | Hopper | 94 GB | $3.07 | Maximale Leistung |

| H200 NVL | Hopper | 143 GB | $3.39 | Maximaler Speicher (Pro+) |

| H200 SXM | Hopper | 141 GB | $3.59 | Maximale Leistung (Pro+) |

| B200 | Blackwell | 180 GB | $4.99 | Größte Modelle (Pro+) |

Zugriff auf GPU

Für die GPUs H200 und B200 ist ein Pro- oder Enterprise-Tarif erforderlich. Alle anderen GPUs sind in allen Tarifen verfügbar, einschließlich des kostenlosen Tarifs.

Anmelde-Credits

Neue Konten erhalten Anmelde-Gutschriften für Schulungen. Weitere Informationen finden Sie unter „Abrechnung “.

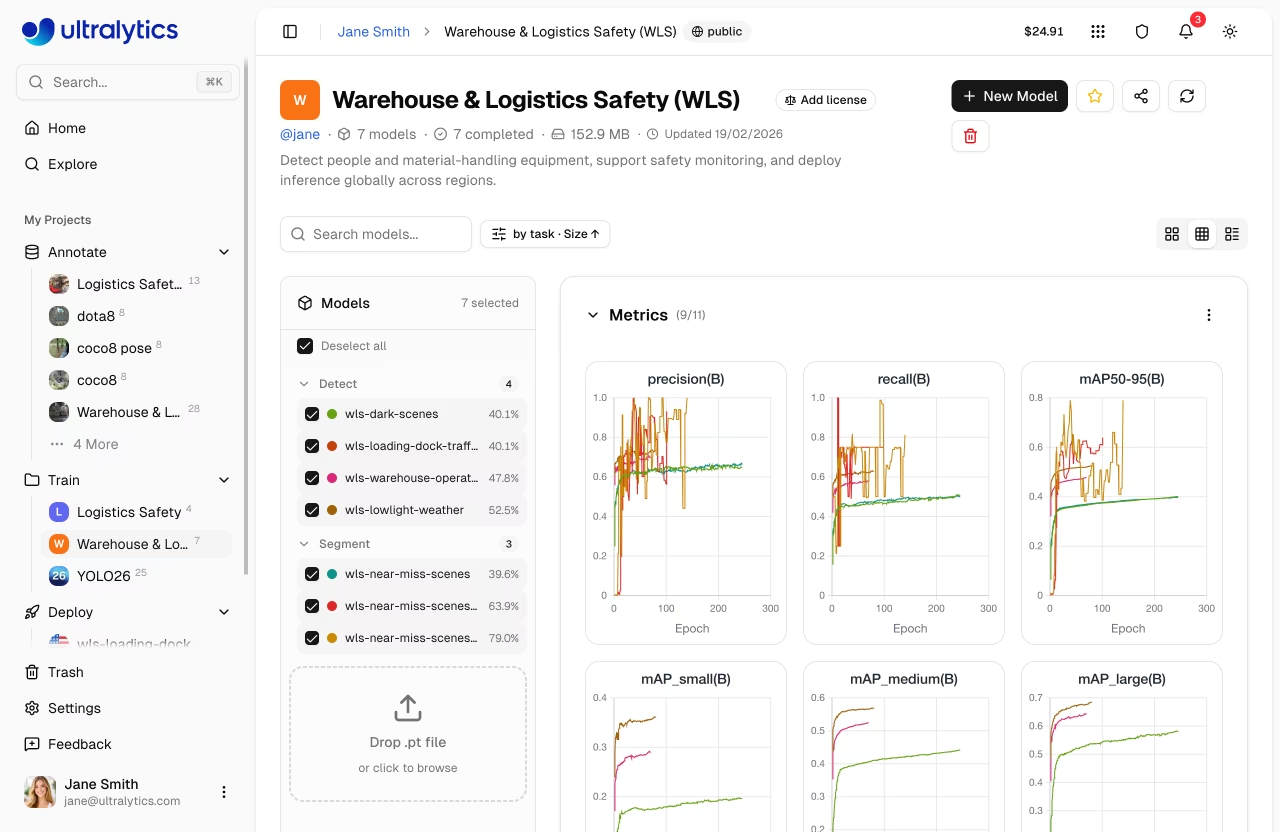

Echtzeit-Metriken

Während des Trainings Live-Metriken über drei Unterregisterkarten anzeigen:

graph LR

A[Charts] --> B[Loss Curves]

A --> C[Performance Metrics]

D[Console] --> E[Live Logs]

D --> F[Error Detection]

G[System] --> H[GPU Utilization]

G --> I[Memory & Temp]

style A fill:#2196F3,color:#fff

style D fill:#FF9800,color:#fff

style G fill:#9C27B0,color:#fff| Unterregisterkarte | Metriken |

|---|---|

| Diagramme | Box-/Klassen-/DFL-Verlust, mAP50, mAP50-95, Precision, Recall |

| Konsole | Live-Trainingsprotokolle mit ANSI-Farben und Fehlererkennung |

| System | GPU , Speicher, Temperatur, CPU, Festplatte |

Automatische Checkpoints

Die Plattform speichert automatisch Checkpoints zu jedem Zeitpunkt. Das beste Modell (höchster mAP) und das endgültige Modell werden immer beibehalten.

Schnellstart

Starten Sie in weniger als einer Minute mit Cloud-Schulungen:

- Erstellen Sie ein Projekt in der Seitenleiste

- Klicken Sie auf Neues Modell

- Wählen Sie ein Modell, einen Datensatz und GPU aus.

- Klicken Sie auf Training starten

export ULTRALYTICS_API_KEY="YOUR_API_KEY"

yolo train model=yolo26n.pt data=ul://username/datasets/my-dataset \

epochs=100 project=username/my-project name=exp1

from ultralytics import YOLO

model = YOLO("yolo26n.pt")

model.train(

data="ul://username/datasets/my-dataset",

epochs=100,

project="username/my-project",

name="exp1",

)

Schnellzugriffe

- Projekte: Organisieren Sie Ihre Modelle und Experimente

- Modelle: Verwalten Sie trainierte Checkpoints

- Cloud-Training: Trainieren Sie auf Cloud-GPUs

FAQ

Wie lange dauert das Training?

Die Trainingszeit hängt ab von:

- Datensatzgröße (Anzahl der Bilder)

- Modellgröße (n, s, m, l, x)

- Anzahl der Epochen

- Ausgewählter GPU-Typ

Ein typischer Trainingslauf mit 1000 Bildern, YOLO26n, 100 Epochen auf einer RTX PRO 6000 dauert etwa 2-3 Stunden. Kleinere Läufe (500 Bilder, 50 Epochen auf einer RTX 4090) sind in weniger als einer Stunde abgeschlossen. Detaillierte Schätzungen finden Sie unter Kostenbeispiele.

Kann ich mehrere Modelle gleichzeitig trainieren?

Ja. Die Anzahl der gleichzeitigen Cloud-Trainings hängt von Ihrem Tarif ab: Der kostenlose Tarif erlaubt 3, der Pro-Tarif 10 und der Enterprise-Tarif ist unbegrenzt. Für zusätzliche parallele Trainings nutzen Sie Remote-Trainings von mehreren Rechnern aus.

Was passiert, wenn das Training fehlschlägt?

Wenn das Training fehlschlägt:

- Checkpoints werden bei jeder Epoche gespeichert

- Sie können vom letzten Checkpoint aus fortfahren

- Guthaben werden nur für die abgeschlossene Rechenzeit berechnet

Wie wähle ich die richtige GPU aus?

| Szenario | Empfohlene GPU |

|---|---|

| Die meisten Ausbildungsplätze | RTX PRO 6000 |

| Große Datensätze oder Batch-Größen | H100 SXM oder H200 (Pro+) |

| Budgetbewusst | RTX 4090 |