Link to this sectionEntenda como exportar para o formato TF SavedModel a partir do YOLO26#

Implantar modelos de machine learning pode ser um desafio. No entanto, usar um formato de modelo eficiente e flexível pode facilitar o seu trabalho. O TF SavedModel é uma estrutura de aprendizado de máquina de código aberto usada pelo TensorFlow para carregar modelos de aprendizado de máquina de forma consistente. É como uma mala para modelos do TensorFlow, tornando-os fáceis de transportar e usar em diferentes dispositivos e sistemas.

Aprender a exportar para TF SavedModel a partir de modelos Ultralytics YOLO26 pode ajudar você a implantar modelos facilmente em diferentes plataformas e ambientes. Neste guia, percorreremos como converter seus modelos para o formato TF SavedModel, simplificando o processo de executar inferências com seus modelos em diferentes dispositivos.

Link to this sectionPor que você deve exportar para o TF SavedModel?#

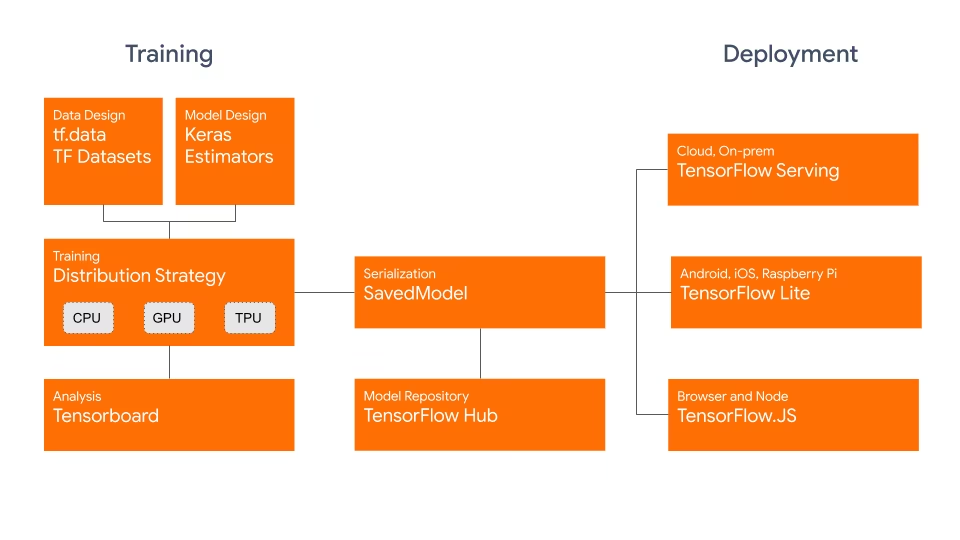

O formato TensorFlow SavedModel faz parte do ecossistema TensorFlow desenvolvido pelo Google, conforme mostrado abaixo. Ele foi projetado para salvar e serializar modelos do TensorFlow perfeitamente. Ele encapsula os detalhes completos dos modelos, como arquitetura, pesos e até mesmo informações de compilação. Isso torna simples compartilhar, implantar e continuar o treinamento em diferentes ambientes.

O TF SavedModel tem uma vantagem importante: sua compatibilidade. Ele funciona bem com TensorFlow Serving, TensorFlow Lite e TensorFlow.js. Essa compatibilidade torna mais fácil compartilhar e implantar modelos em várias plataformas, incluindo aplicativos da web e móveis. O formato TF SavedModel é útil tanto para pesquisa quanto para produção. Ele fornece uma maneira unificada de gerenciar seus modelos, garantindo que estejam prontos para qualquer aplicação.

Link to this sectionPrincipais recursos dos TF SavedModels#

Aqui estão os principais recursos que tornam o TF SavedModel uma ótima opção para desenvolvedores de IA:

-

Portabilidade: O TF SavedModel fornece um formato de serialização hermético, recuperável e independente de linguagem. Eles permitem que sistemas e ferramentas de nível superior produzam, consumam e transformem modelos do TensorFlow. Os SavedModels podem ser facilmente compartilhados e implantados em diferentes plataformas e ambientes.

-

Facilidade de implantação: O TF SavedModel agrupa o gráfico computacional, os parâmetros treinados e os metadados necessários em um único pacote. Eles podem ser facilmente carregados e usados para inferência sem a necessidade do código original que criou o modelo. Isso torna a implantação de modelos TensorFlow simples e eficiente em vários ambientes de produção.

-

Gerenciamento de ativos: O TF SavedModel suporta a inclusão de ativos externos, como vocabulários, embeddings ou tabelas de consulta. Esses ativos são armazenados junto com a definição do gráfico e as variáveis, garantindo que estejam disponíveis quando o modelo for carregado. Esse recurso simplifica o gerenciamento e a distribuição de modelos que dependem de recursos externos.

Link to this sectionOpções de implantação com TF SavedModel#

Antes de mergulharmos no processo de exportar modelos YOLO26 para o formato TF SavedModel, vamos explorar alguns cenários típicos de implantação onde esse formato é usado.

O TF SavedModel oferece várias opções para implantar seus modelos de machine learning:

-

TensorFlow Serving: O TensorFlow Serving é um sistema de serviço flexível e de alto desempenho projetado para ambientes de produção. Ele suporta nativamente TF SavedModels, facilitando a implantação e o serviço de seus modelos em plataformas de nuvem, servidores locais ou edge devices.

-

Plataformas de nuvem: Grandes provedores de nuvem como Google Cloud Platform (GCP), Amazon Web Services (AWS) e Microsoft Azure oferecem serviços para implantar e executar modelos TensorFlow, incluindo TF SavedModels. Esses serviços fornecem infraestrutura escalável e gerenciada, permitindo que você implante e dimensione seus modelos facilmente.

-

Dispositivos móveis e embarcados: O TensorFlow Lite, uma solução leve para executar modelos de machine learning em dispositivos móveis, embarcados e IoT, suporta a conversão de TF SavedModels para o formato TensorFlow Lite. Isso permite que você implante seus modelos em uma ampla gama de dispositivos, desde smartphones e tablets até microcontroladores e edge devices.

-

TensorFlow Runtime: O TensorFlow Runtime (

tfrt) é um runtime de alto desempenho para executar gráficos TensorFlow. Ele fornece APIs de nível inferior para carregar e executar TF SavedModels em ambientes C++. O TensorFlow Runtime oferece melhor desempenho em comparação com o runtime padrão do TensorFlow. Ele é adequado para cenários de implantação que exigem inferência de baixa latência e integração estreita com bases de código C++ existentes.

Link to this sectionExportando modelos YOLO26 para TF SavedModel#

Ao exportar modelos YOLO26 para o formato TF SavedModel, você aumenta sua adaptabilidade e facilidade de implantação em várias plataformas.

Link to this sectionInstalação#

Para instalar o pacote necessário, execute:

# Install the required package for YOLO26

pip install ultralyticsPara instruções detalhadas e melhores práticas relacionadas ao processo de instalação, confere o nosso guia de instalação Ultralytics. Ao instalar os pacotes necessários para o YOLO26, se encontrares dificuldades, consulta o nosso guia de problemas comuns para soluções e dicas.

Link to this sectionUso#

Todos os modelos Ultralytics YOLO26 são projetados para suportar exportação pronta para uso, tornando fácil integrá-los ao seu fluxo de trabalho de implantação preferido. Você pode ver a lista completa de formatos de exportação suportados e opções de configuração para escolher a melhor configuração para sua aplicação.

O formato TF SavedModel suporta os modos Export, Predict e Validate. Exporte seu modelo e, em seguida, carregue o modelo exportado para executar a inferência ou validar sua precisão.

from ultralytics import YOLO

# Load a YOLO26 model

model = YOLO("yolo26n.pt")

# Export the model to TF SavedModel format

model.export(format="saved_model") # creates '/yolo26n_saved_model'from ultralytics import YOLO

# Load the exported TF SavedModel model

model = YOLO("./yolo26n_saved_model")

# Run inference

results = model("https://ultralytics.com/images/bus.jpg")from ultralytics import YOLO

# Load the exported TF SavedModel model

model = YOLO("./yolo26n_saved_model")

# Validate accuracy on the COCO8 dataset

metrics = model.val(data="coco8.yaml")Link to this sectionArgumentos de Exportação#

| Argumento | Tipo | Padrão | Descrição |

|---|---|---|---|

format | str | 'saved_model' | Formato de destino para o modelo exportado, definindo a compatibilidade com vários ambientes de implantação. |

imgsz | int ou tuple | 640 | Desired image size for the model input. Can be an integer for square images or a tuple (height, width) for specific dimensions. |

keras | bool | False | Habilita a exportação para o formato Keras, fornecendo compatibilidade com o TensorFlow serving e APIs. |

int8 | bool | False | Ativa a quantização INT8, comprimindo ainda mais o modelo e acelerando a inferência com perda mínima de precisão, principalmente para dispositivos de borda. |

nms | bool | False | Adiciona a Supressão Não-Máxima (NMS), essencial para um pós-processamento de detecção preciso e eficiente. |

batch | int | 1 | Especifica o tamanho da inferência em lote do modelo de exportação ou o número máximo de imagens que o modelo exportado processará simultaneamente no modo predict. |

data | str | 'coco8.yaml' | Caminho para o arquivo de configuração do dataset (padrão: coco8.yaml), essencial para quantização. |

fraction | float | 1.0 | Especifica a fração do dataset a ser usada para calibração de quantização INT8. Permite calibrar em um subconjunto do dataset completo, útil para experimentos ou quando os recursos são limitados. Se não for especificado com INT8 habilitado, o dataset completo será usado. |

device | str | None | Especifica o dispositivo para exportação: CPU (device=cpu), MPS para Apple silicon (device=mps). |

Para mais detalhes sobre o processo de exportação, visite a página de documentação da Ultralytics sobre exportação.

Link to this sectionImplantando modelos YOLO26 TF SavedModel exportados#

Agora que você exportou seu modelo YOLO26 para o formato TF SavedModel, o próximo passo é implantá-lo. O primeiro passo principal e recomendado para executar um modelo TF SavedModel é usar o método YOLO("yolo26n_saved_model/"), conforme mostrado anteriormente no snippet de código de uso.

No entanto, para obter instruções detalhadas sobre como implantar seus modelos TF SavedModel, dê uma olhada nos seguintes recursos:

-

TensorFlow Serving: Aqui está a documentação do desenvolvedor sobre como implantar seus modelos TF SavedModel usando o TensorFlow Serving.

-

Executar um TensorFlow SavedModel em Node.js: Uma postagem no blog do TensorFlow sobre como executar um TensorFlow SavedModel diretamente em Node.js sem conversão.

-

Implantando na nuvem: Uma postagem no blog do TensorFlow sobre a implantação de um modelo TensorFlow SavedModel na Cloud AI Platform.

Link to this sectionResumo#

Neste guia, exploramos como exportar modelos Ultralytics YOLO26 para o formato TF SavedModel. Ao exportar para o TF SavedModel, você ganha a flexibilidade de otimizar, implantar e escalar seus modelos YOLO26 em uma ampla gama de plataformas.

Para obter mais detalhes sobre o uso, visite a documentação oficial do TF SavedModel.

Para obter mais informações sobre como integrar o Ultralytics YOLO26 com outras plataformas e estruturas, não se esqueça de conferir nossa página de guia de integração. Ela está repleta de ótimos recursos para ajudar você a aproveitar ao máximo o YOLO26 em seus projetos.

Link to this sectionFAQ#

Link to this sectionComo faço para exportar um modelo Ultralytics YOLO para o formato TensorFlow SavedModel?#

Exportar um modelo Ultralytics YOLO para o formato TensorFlow SavedModel é simples. Você pode usar Python ou CLI para realizar isso:

from ultralytics import YOLO

# Load a YOLO26 model

model = YOLO("yolo26n.pt")

# Export the model to TF SavedModel format

model.export(format="saved_model") # creates '/yolo26n_saved_model'

# Load the exported TF SavedModel for inference

tf_savedmodel_model = YOLO("./yolo26n_saved_model")

results = tf_savedmodel_model("https://ultralytics.com/images/bus.jpg")Consulte a documentação de exportação do Ultralytics para obter mais detalhes.

Link to this sectionPor que devo usar o formato TensorFlow SavedModel?#

O formato TensorFlow SavedModel oferece várias vantagens para a implantação de modelo:

- Portabilidade: Ele fornece um formato independente de linguagem, facilitando o compartilhamento e a implantação de modelos em diferentes ambientes.

- Compatibilidade: Integra-se perfeitamente com ferramentas como TensorFlow Serving, TensorFlow Lite e TensorFlow.js, que são essenciais para implantar modelos em várias plataformas, incluindo aplicativos da web e móveis.

- Encapsulamento completo: Codifica a arquitetura do modelo, os pesos e as informações de compilação, permitindo o compartilhamento e a continuação do treinamento de forma direta.

Para mais benefícios e opções de implantação, confira as opções de implantação de modelos Ultralytics YOLO.

Link to this sectionQuais são os cenários típicos de implantação para TF SavedModel?#

O TF SavedModel pode ser implantado em vários ambientes, incluindo:

- TensorFlow Serving: Ideal para ambientes de produção que exigem serviço de modelo escalável e de alto desempenho.

- Plataformas de nuvem: Suporta os principais serviços de nuvem como Google Cloud Platform (GCP), Amazon Web Services (AWS) e Microsoft Azure para implantação de modelos escaláveis.

- Dispositivos móveis e embarcados: Usar o TensorFlow Lite para converter TF SavedModels permite a implantação em dispositivos móveis, dispositivos IoT e microcontroladores.

- TensorFlow Runtime: Para ambientes C++ que precisam de inferência de baixa latência com melhor desempenho.

Para opções detalhadas de implantação, visite os guias oficiais sobre como implantar modelos TensorFlow.

Link to this sectionComo posso instalar os pacotes necessários para exportar modelos YOLO26?#

Para exportar modelos YOLO26, você precisa instalar o pacote ultralytics. Execute o seguinte comando no seu terminal:

pip install ultralyticsPara obter instruções de instalação mais detalhadas e práticas recomendadas, consulte nosso guia de instalação do Ultralytics. Se encontrar algum problema, consulte nosso guia de problemas comuns.

Link to this sectionQuais são os principais recursos do formato TensorFlow SavedModel?#

O formato TF SavedModel é benéfico para desenvolvedores de IA devido aos seguintes recursos:

- Portabilidade: Permite compartilhamento e implantação em vários ambientes sem esforço.

- Facilidade de implantação: Encapsula o gráfico computacional, os parâmetros treinados e os metadados em um único pacote, o que simplifica o carregamento e a inferência.

- Gerenciamento de ativos: Suporta ativos externos como vocabulários, garantindo que estejam disponíveis quando o modelo carregar.

Para mais detalhes, explore a documentação oficial do TensorFlow.