التدريب السحابي

منصة Ultralytics للتدريب السحابي توفر تدريبًا بنقرة واحدة على وحدات معالجة الرسوميات (GPU) السحابية، مما يجعل تدريب النماذج متاحًا دون إعداد معقد. قم بتدريب نماذج YOLO مع بث المقاييس في الوقت الفعلي وحفظ نقاط الفحص تلقائيًا.

graph LR

A[Configure] --> B[Start Training]

B --> C[Provision GPU]

C --> D[Download Dataset]

D --> E[Train]

E --> F[Stream Metrics]

F --> G[Save Checkpoints]

G --> H[Complete]

style A fill:#2196F3,color:#fff

style B fill:#FF9800,color:#fff

style E fill:#9C27B0,color:#fff

style H fill:#4CAF50,color:#fffحوار التدريب

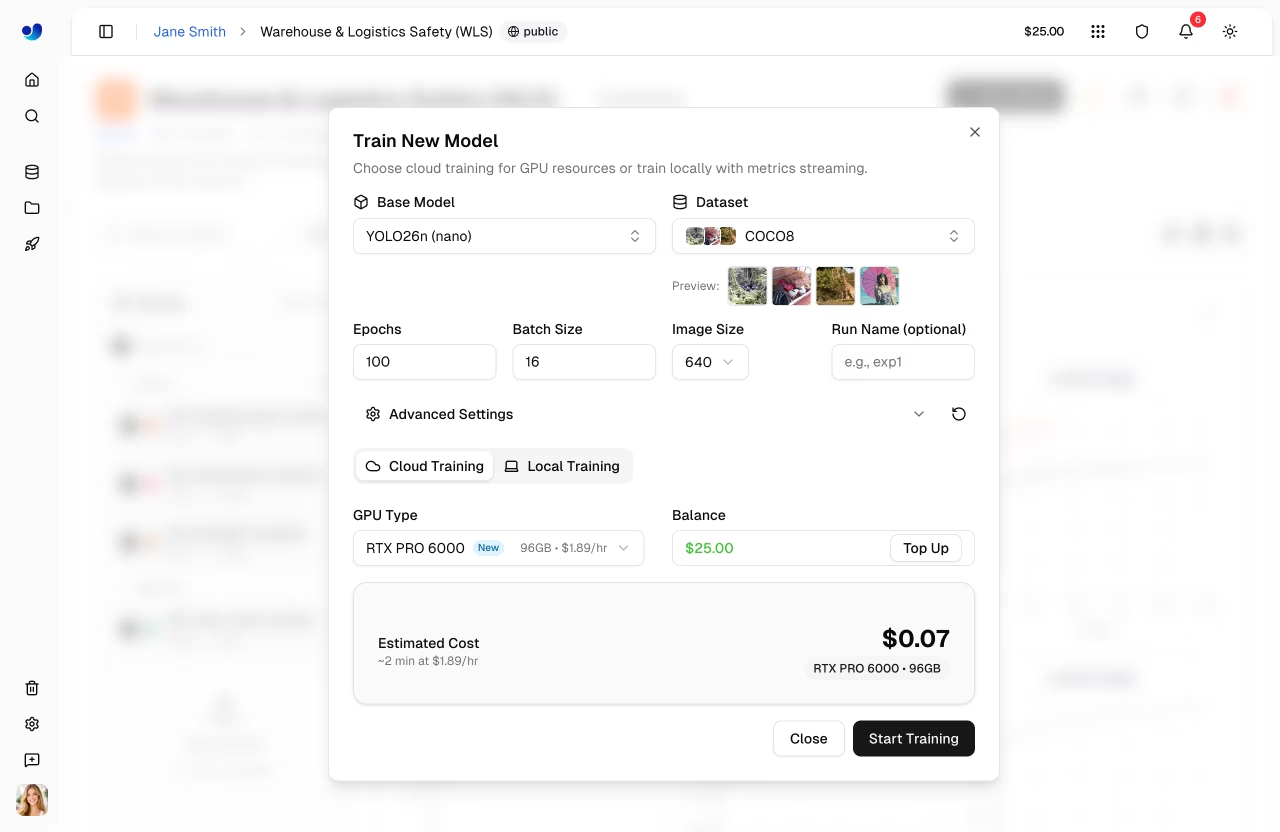

ابدأ التدريب من واجهة المستخدم للمنصة بالنقر فوق " نموذج جديد" في أي صفحة مشروع (أو "تدريب من صفحة مجموعة بيانات"). يحتوي مربع حوار التدريب على علامتي تبويب: "تدريب سحابي " و" تدريب محلي".

الخطوة 1: حدد النموذج الأساسي

اختر من نماذج YOLO26 الرسمية أو نماذجك المدربة الخاصة:

| الفئة | الوصف |

|---|---|

| رسمي | جميع نماذج YOLO26 الـ 25 (5 أحجام × 5 مهام) |

| نماذجك | نماذجك المكتملة للتحسين |

يتم تنظيم النماذج الرسمية حسب نوع المهمة (الكشف، التجزئة، الوضع، OBB، التصنيف) بأحجام تتراوح من النانو إلى xlarge.

الخطوة 2: حدد مجموعة البيانات

اختر مجموعة بيانات للتدريب عليها (انظر مجموعات البيانات):

| الخيار | الوصف |

|---|---|

| رسمي | مجموعات بيانات منسقة من Ultralytics |

| مجموعات بياناتك | مجموعات البيانات التي قمت بتحميلها |

متطلبات مجموعة البيانات

يجب أن تكون مجموعات البيانات في ready الحالة مع صورة واحدة على الأقل في تقسيم التدريب، وصورة واحدة في تقسيم التحقق أو الاختبار، وصورة واحدة على الأقل مصنفة.

عدم التوافق بين المهام

يظهر تحذير عدم تطابق المهام إذا كانت مهمة النموذج (مثل detect) لا تتطابق مع مهمة مجموعة البيانات (مثل segment). سيفشل التدريب إذا تابعت بمهام غير متطابقة. تأكد من أن كل من النموذج ومجموعة البيانات يستخدمان نفس نوع المهمة، كما هو موضح في أدلة المهام.

الخطوة 3: تكوين المعلمات

تعيين معلمات التدريب الأساسية:

| المعلمة | الوصف | افتراضي |

|---|---|---|

| الحقب | عدد تكرارات التدريب | 100 |

| حجم الدفعة | العينات لكل تكرار | 16 |

| حجم الصورة | دقة الإدخال (قائمة منسدلة 320/416/512/640/1280، أو 32-4096 في محرر YAML) | 640 |

| اسم التشغيل | اسم اختياري للتدريب | تلقائي |

الخطوة 4: الإعدادات المتقدمة (اختياري)

قم بتوسيع الإعدادات المتقدمة للوصول إلى محرر المعلمات الكامل المستند إلى YAML مع أكثر من 40 معلمة تدريب منظمة حسب المجموعة (انظر مرجع التكوين):

| المجموعة | المعلمات |

|---|---|

| معدل التعلم | lr0، lrf، momentum، weight_decay، warmup_epochs، warmup_momentum، warmup_bias_lr |

| المحسّن | SGD MuSGD، Adam AdamW NAdam، RAdam، RMSProp، Adamax |

| أوزان الخسارة | box, cls, dfl, pose, kobj, label_smoothing |

| تعزيز الألوان | hsv_h، hsv_s، hsv_v |

| التعزيز الهندسي. | درجات، إزاحة، تحجيم، قص، منظور |

| تقوية Flip & Mix. | flipud، fliplr، mosaic، mixup، copy_paste |

| التحكم في التدريب | الصبر، البذرة، الحتمية، amp، cos_lr، close_mosaic، save_period |

| مجموعة البيانات | fraction، freeze، single_cls، rect، multi_scale، resume |

المعلمات مدركة للمهام (على سبيل المثال، copy_paste يظهر فقط segment المقطع، pose/kobj فقط لمهام الوضع). A معدل تظهر شارة عندما تختلف القيم عن الإعدادات الافتراضية، ويمكنك إعادة تعيين الكل إلى الإعدادات الافتراضية باستخدام زر إعادة التعيين.

مثال: تعزيز الضبط لمجموعات البيانات الصغيرة

For small datasets (<1000 images), increase augmentation to reduce overfitting:

mosaic: 1.0 # Keep mosaic on

mixup: 0.3 # Add mixup blending

copy_paste: 0.3 # Add copy-paste (segment only)

fliplr: 0.5 # Horizontal flip

degrees: 10.0 # Slight rotation

scale: 0.9 # Aggressive scaling

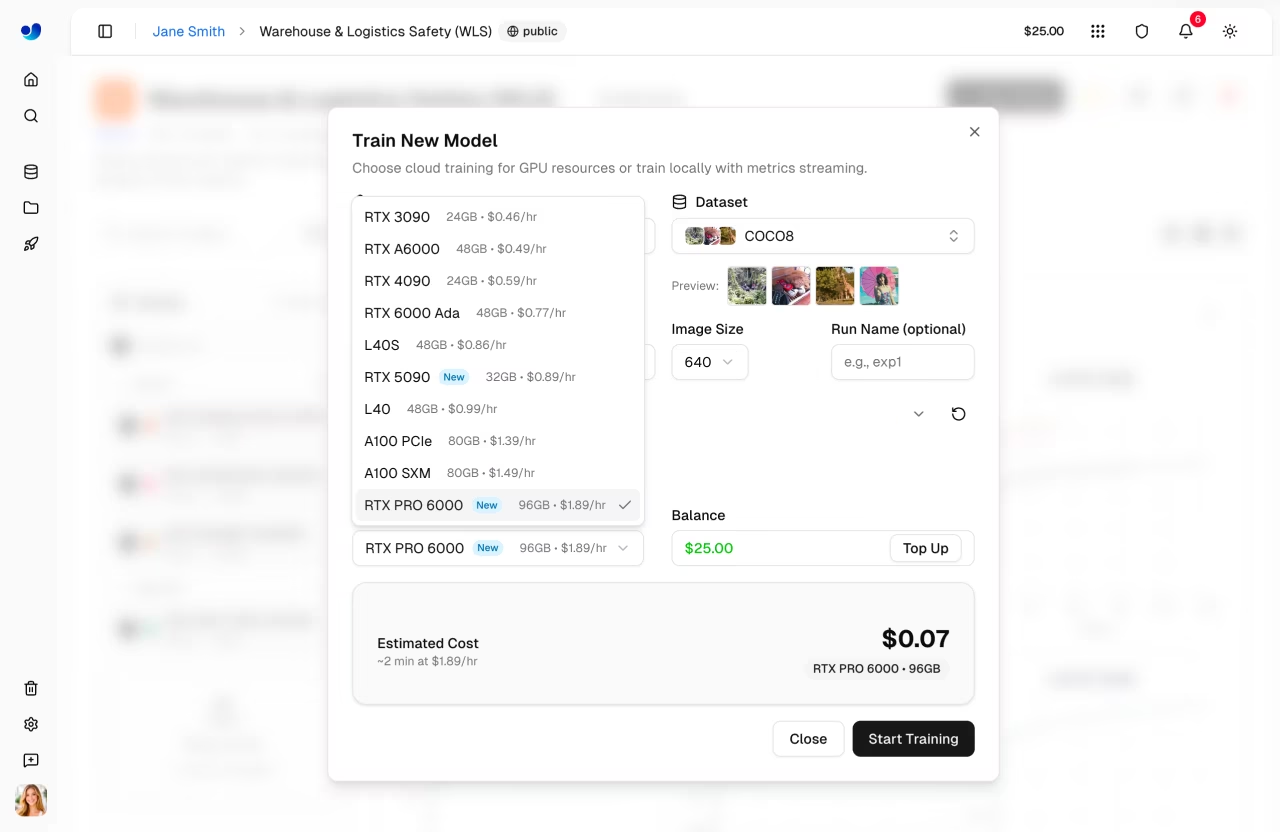

الخطوة 5: حدد GPU علامة التبويب السحابة)

اختر وحدة معالجة الرسوميات (GPU) الخاصة بك من سحابة Ultralytics:

| GPU | الجيل | VRAM | التكلفة/الساعة | الأفضل لـ |

|---|---|---|---|---|

| RTX 2000 Ada | آدا | 16 جيجابايت | $0.24 | مجموعات بيانات صغيرة، للاختبار |

| RTX A4500 | أمبير | 20 جيجابايت | $0.25 | مجموعات بيانات صغيرة إلى متوسطة |

| RTX 4000 Ada | آدا | 20 جيجابايت | $0.26 | مجموعات بيانات متوسطة |

| RTX A5000 | أمبير | 24 جيجابايت | $0.27 | مجموعات بيانات متوسطة |

| L4 | آدا | 24 جيجابايت | $0.39 | مُحسّن للاستدلال |

| A40 | أمبير | 48 جيجابايت | $0.40 | أحجام دفعات أكبر |

| RTX 3090 | أمبير | 24 جيجابايت | $0.46 | تدريب عام |

| RTX A6000 | أمبير | 48 جيجابايت | $0.49 | النماذج الكبيرة |

| RTX PRO 4500 | بلاكويل | 32 جيجابايت | $0.54 | قيمة ممتازة مقابل الأداء |

| RTX 4090 | آدا | 24 جيجابايت | $0.59 | أفضل سعر/أداء |

| RTX 6000 Ada | آدا | 48 جيجابايت | $0.77 | تدريب الدفعات الكبيرة |

| L40S | آدا | 48 جيجابايت | $0.86 | تدريب الدفعات الكبيرة |

| RTX 5090 | بلاكويل | 32 جيجابايت | $0.89 | أحدث جيل استهلاكي |

| L40 | آدا | 48 جيجابايت | $0.99 | النماذج الكبيرة |

| A100 PCIe | أمبير | 80 جيجابايت | $1.39 | التدريب للإنتاج |

| A100 SXM | أمبير | 80 جيجابايت | $1.49 | التدريب للإنتاج |

| RTX PRO 6000 | بلاكويل | 96 جيجابايت | $1.69 | الافتراضي الموصى به |

| H100 PCIe | هوبر | 80 جيجابايت | $2.39 | تدريب عالي الأداء |

| H100 SXM | هوبر | 80 جيجابايت | $2.69 | التدريب الأسرع |

| H100 NVL | هوبر | 94 جيجابايت | $3.07 | أقصى أداء |

| H200 NVL | هوبر | 143 جيجابايت | $3.39 | الذاكرة القصوى (Pro+) |

| H200 SXM | هوبر | 141 جيجابايت | $3.59 | الأداء الأقصى (Pro+) |

| B200 | بلاكويل | 180 جيجابايت | $4.99 | أكبر النماذج (Pro+) |

اختيار الـ GPU

- RTX PRO 6000: 96 جيجابايت من جيل بلاكويل، الافتراضي الموصى به لمعظم المهام.

- A100 SXM: مطلوب لأحجام الدفعات الكبيرة أو النماذج الضخمة.

- H100/H200: أقصى أداء للتدريب الحساس للوقت (يتطلب H200 Pro أو Enterprise)

- B200: بنية NVIDIA Blackwell لأعباء العمل المتطورة (تتطلب Pro أو Enterprise)

يعرض مربع الحوار رصيدك الحالي وزر " تعبئة الرصيد ". يتم حساب التكلفة والمدة التقديرية بناءً على التكوين الخاص بك (حجم النموذج، صور مجموعة البيانات، العصور، GPU ).

الخطوة 6: بدء التدريب

انقر على بدء التدريب لتشغيل مهمتك. المنصة:

- توفر مثيل GPU

- تحمل مجموعة بياناتك

- تبدأ التدريب

- تبث المقاييس في الوقت الفعلي

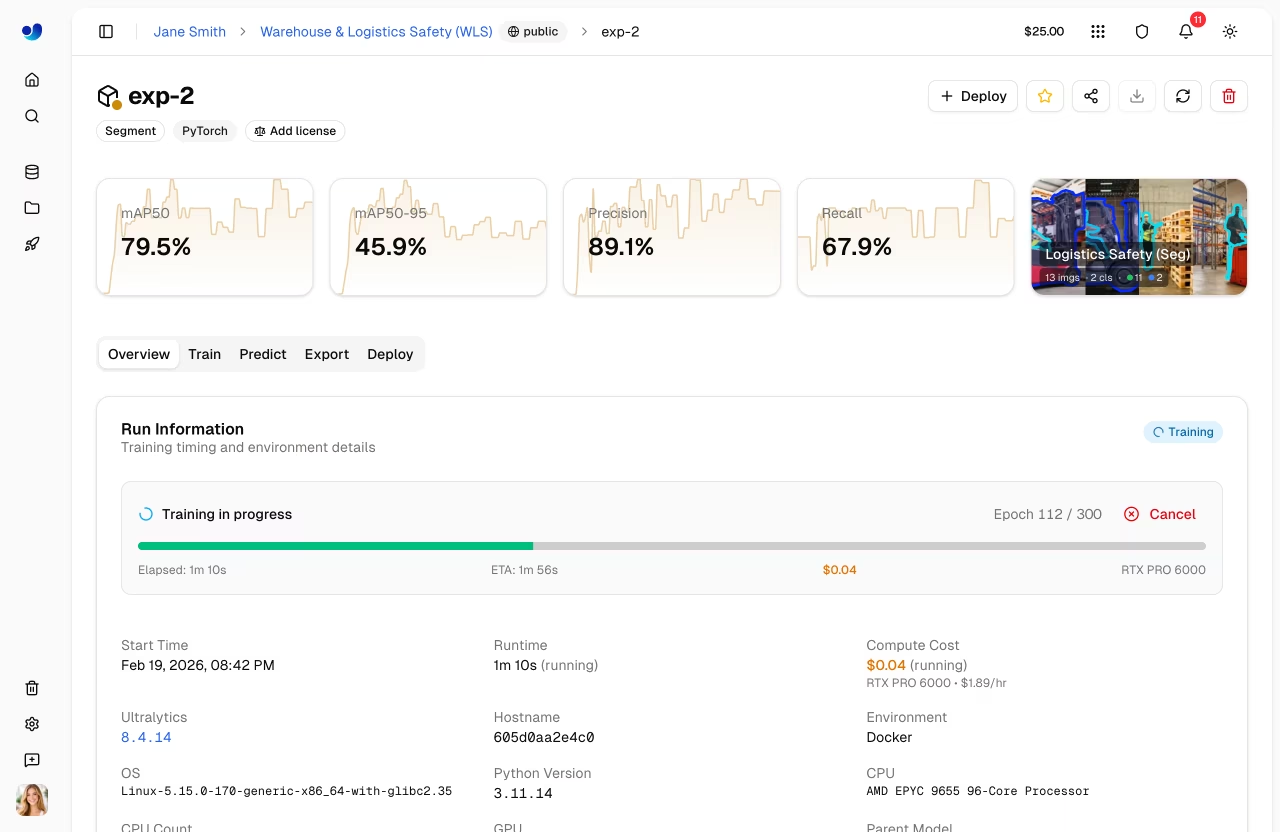

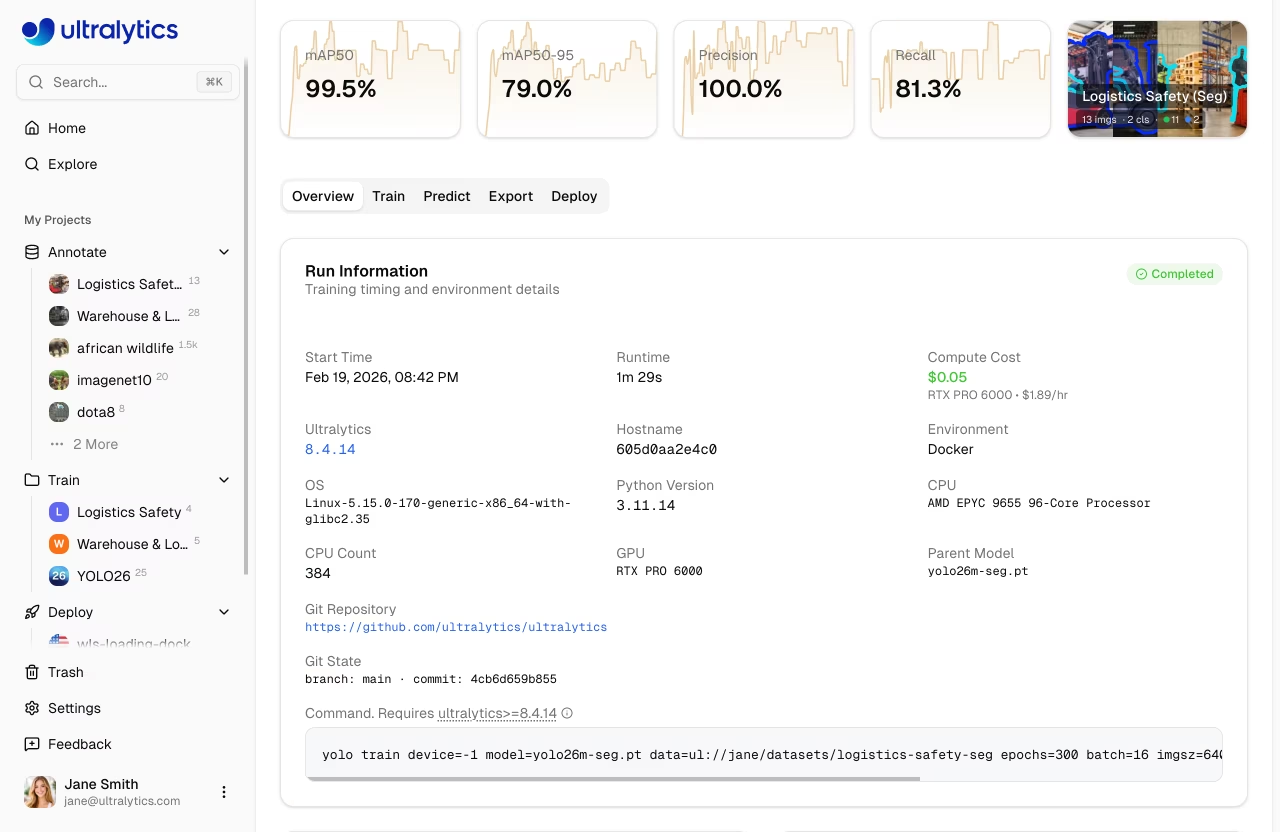

دورة حياة الوظيفة التدريبية

تتقدم مهام التدريب عبر الحالات التالية:

| الحالة | الوصف |

|---|---|

| قيد الانتظار | تم إرسال المهمة، في انتظار GPU |

| البدء | GPU ، ويجري تنزيل مجموعة البيانات والنموذج |

| الجري | التدريب قيد التنفيذ، وتدفق المقاييس في الوقت الفعلي |

| مكتمل | انتهى التدريب بنجاح |

| فشل | فشل التدريب (انظر سجلات وحدة التحكم للحصول على التفاصيل) |

| ملغاة | تم إلغاء التدريب من قبل المستخدم |

أرصدة مجانية

تحصل الحسابات الجديدة على رصيد تسجيل — 5 دولارات للبريد الإلكتروني الشخصي و25 دولارًا للبريد الإلكتروني الخاص بالشركة. تحقق من رصيدك في الإعدادات > الفواتير.

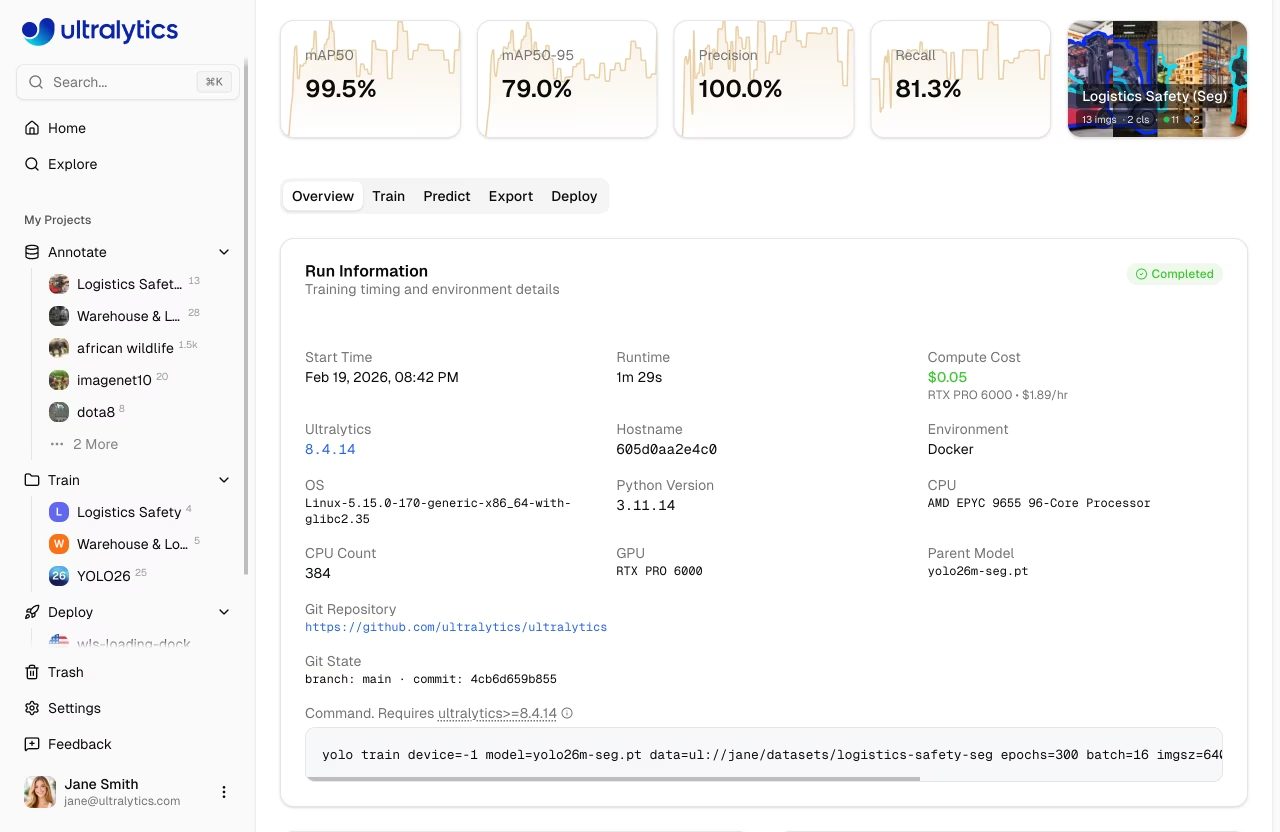

مراقبة التدريب

اعرض تقدم التدريب في الوقت الفعلي في علامة التبويب "تدريب" في صفحة النموذج:

علامة تبويب فرعية للمخططات

| مقياس (Metric) | الوصف |

|---|---|

| الخسارة | خسارة التدريب والتحقق |

| mAP | متوسط الدقة المتوسطة |

| الدقة | التنبؤات الإيجابية الصحيحة |

| الاسترجاع | الحقائق الأساسية المكتشفة |

علامة تبويب فرعية لوحدة التحكم

إخراج وحدة التحكم المباشر مع دعم ألوان ANSI وأشرطة التقدم واكتشاف الأخطاء.

علامة تبويب فرعية للنظام

GPU والذاكرة ودرجة الحرارة ووحدة CPU المركزية ( CPU والقرص في الوقت الفعلي.

نقاط الفحص

يتم حفظ نقاط التحقق تلقائيًا:

- كل حقبة: يتم حفظ أحدث الأوزان

- أفضل نموذج: يتم الاحتفاظ بنقطة التحقق ذات أعلى mAP

- النموذج النهائي: الأوزان عند اكتمال التدريب

إلغاء التدريب

انقر على إلغاء التدريب في صفحة النموذج لإيقاف مهمة قيد التشغيل:

- تم إنهاء مثيل الحوسبة

- يتوقف احتساب الرصيد

- يتم الاحتفاظ بنقاط التحقق المحفوظة حتى تلك النقطة

التدريب عن بُعد

graph LR

A[Local GPU] --> B[Train]

B --> C[ultralytics Package]

C --> D[Stream Metrics]

D --> E[Platform Dashboard]

style A fill:#FF9800,color:#fff

style C fill:#2196F3,color:#fff

style E fill:#4CAF50,color:#fffتدرب على أجهزتك الخاصة أثناء بث المقاييس إلى المنصة.

متطلبات إصدار الحزمة

يتطلب تكامل المنصة ultralytics>=8.4.14. الإصدارات الأقدم لن تعمل مع المنصة.

pip install -U ultralytics

إعداد مفتاح API

- انتقل إلى

Settings > Profile(قسم مفاتيح API) - أنشئ مفتاحًا جديدًا (أو تنشئه المنصة تلقائيًا عند فتح علامة تبويب التدريب المحلي)

- عيّن متغير البيئة:

export ULTRALYTICS_API_KEY="YOUR_API_KEY"

التدريب بالبث

استخدم project و name معلمات لبث المقاييس:

yolo train model=yolo26n.pt data=coco.yaml epochs=100 \

project=username/my-project name=experiment-1

from ultralytics import YOLO

model = YOLO("yolo26n.pt")

model.train(

data="coco.yaml",

epochs=100,

project="username/my-project",

name="experiment-1",

)

تعرض علامة التبويب " التدريب المحلي " في مربع حوار التدريب أمرًا تم تكوينه مسبقًا مع مفتاح API الخاص بك والمعلمات المحددة والحجج المتقدمة المضمنة.

استخدام مجموعات بيانات المنصة

تدرب باستخدام مجموعات البيانات المخزنة على المنصة باستخدام ul:// تنسيق URI:

yolo train model=yolo26n.pt data=ul://username/datasets/my-dataset epochs=100 \

project=username/my-project name=exp1

from ultralytics import YOLO

model = YOLO("yolo26n.pt")

model.train(

data="ul://username/datasets/my-dataset",

epochs=100,

project="username/my-project",

name="exp1",

)

في ul:// يقوم تنسيق URI بتنزيل مجموعة البيانات وتكوينها تلقائيًا. يتم ربط النموذج تلقائيًا بمجموعة البيانات على المنصة (انظر استخدام مجموعات بيانات المنصة).

الفواتير

تعتمد تكاليف التدريب على استخدام GPU:

تقدير التكاليف

قبل بدء التدريب، تقدر المنصة التكلفة الإجمالية عن طريق:

- تقدير الثواني لكل حقبة من حجم مجموعة البيانات، تعقيد النموذج، حجم الصورة، حجم الدفعة، وسرعة GPU.

- حساب إجمالي وقت التدريب بضرب الثواني لكل حقبة في عدد الحقب، ثم إضافة النفقات العامة للبدء.

- حساب التكلفة التقديرية من إجمالي ساعات التدريب مضروبة في السعر بالساعة لوحدة معالجة الرسوميات (GPU)

العوامل المؤثرة على التكلفة:

| العامل | التأثير |

|---|---|

| حجم مجموعة البيانات | المزيد من الصور = وقت تدريب أطول (الأساس: حوالي 2.8 ثانية لحساب 1000 صورة على RTX 4090) |

| حجم النموذج | النماذج الأكبر حجماً (m، l، x) تتدرب بشكل أبطأ من (n، s) |

| عدد العصور | مضاعف مباشر لوقت التدريب |

| حجم الصورة | كلما زاد حجم imgsz زادت الحسابات: 320px=0.25x، 640px=1.0x (خط الأساس)، 1280px=4.0x |

| حجم الدفعة | الدفعات الأكبر حجماً أكثر كفاءة (الدفعة 32 = ~0.85x الوقت، الدفعة 8 = ~1.2x الوقت مقابل الدفعة 16 الأساسية) |

| GPU | تقلل وحدات معالجة الرسومات الأسرع من وقت التدريب (على سبيل المثال، H100 SXM = أسرع بحوالي 3.4 مرة من RTX 4090) |

| تكاليف بدء التشغيل | ما يصل إلى 5 دقائق لتهيئة المثيل وتنزيل البيانات والتحضير (يتناسب مع حجم مجموعة البيانات) |

أمثلة على التكاليف

التقديرات

تقديرات التكلفة تقريبية وتعتمد على عدة عوامل. يعرض مربع حوار التدريب تقديرًا في الوقت الفعلي قبل بدء التدريب.

| السيناريو | GPU | التكلفة التقديرية |

|---|---|---|

| 500 صورة، YOLO26n، 50 حقبة تدريبية | RTX 4090 | ~0.50 دولار |

| 1000 صورة، YOLO26n، 100 حقبة | RTX PRO 6000 | حوالي 5 دولارات |

| 5000 صورة، YOLO26s، 100 حقبة تدريبية | H100 SXM | حوالي 23 دولارًا |

سير عمل الفوترة

graph LR

A[Estimate Cost] --> B[Balance Check]

B --> C[Train]

C --> D[Charge Actual Runtime]

style A fill:#2196F3,color:#fff

style B fill:#FF9800,color:#fff

style C fill:#9C27B0,color:#fff

style D fill:#4CAF50,color:#fffسير عمل فواتير التدريب السحابي:

- التقدير: التكلفة محسوبة قبل بدء التدريب

- التحقق من الرصيد: يتم التحقق من الاعتمادات المتاحة قبل الإطلاق

- تدريب: يتم تشغيل المهمة على الحوسبة المحددة

- الرسوم: التكلفة النهائية تستند إلى وقت التشغيل الفعلي.

حماية المستهلك

تتتبع الفوترة الاستخدام الفعلي للحوسبة، بما في ذلك التشغيلات الجزئية التي تم إلغاؤها. لا يتم تحصيل رسوم منك أبدًا مقابل تشغيلات التدريب الفاشلة.

الفوترة حسب حالة المهمة

| الحالة | مشحون؟ |

|---|---|

| مكتمل | نعم — GPU استخدام GPU الفعلي |

| ملغاة | نعم — GPU من البداية حتى الإلغاء |

| فشل | لا — لا يتم احتساب تكلفة المحاولات الفاشلة |

| عالق | جزئي — يتم احتساب تكلفة وقت التدريب الفعلي فقط |

لا توجد رسوم على الأخطاء

إذا فشل تشغيل التدريب بسبب خطأ في التكوين أو مشكلة في نفاد الذاكرة أو أي عطل آخر، فلن يتم تحصيل أي رسوم منك. ولا يتم احتساب الرسوم إلا على وقت الحوسبة الناجح. أما المهام المتوقفة (التي لا تظهر فيها أي نشاط لمدة 4 ساعات أو أكثر)، فيتم إنهاؤها تلقائيًا ولا يتم احتساب الرسوم إلا على الوقت الذي GPU فعليًا في التدريب، وليس على وقت الخمول.

طرق الدفع

| الطريقة | الوصف |

|---|---|

| رصيد الحساب | رصيد مُحمّل مسبقًا |

| الدفع لكل مهمة | يتم الخصم عند اكتمال المهمة |

الحد الأدنى للرصيد

يحتاج بدء التدريب إلى رصيد متاح إيجابي وائتمانات كافية لتغطية التكلفة التقديرية للوظيفة.

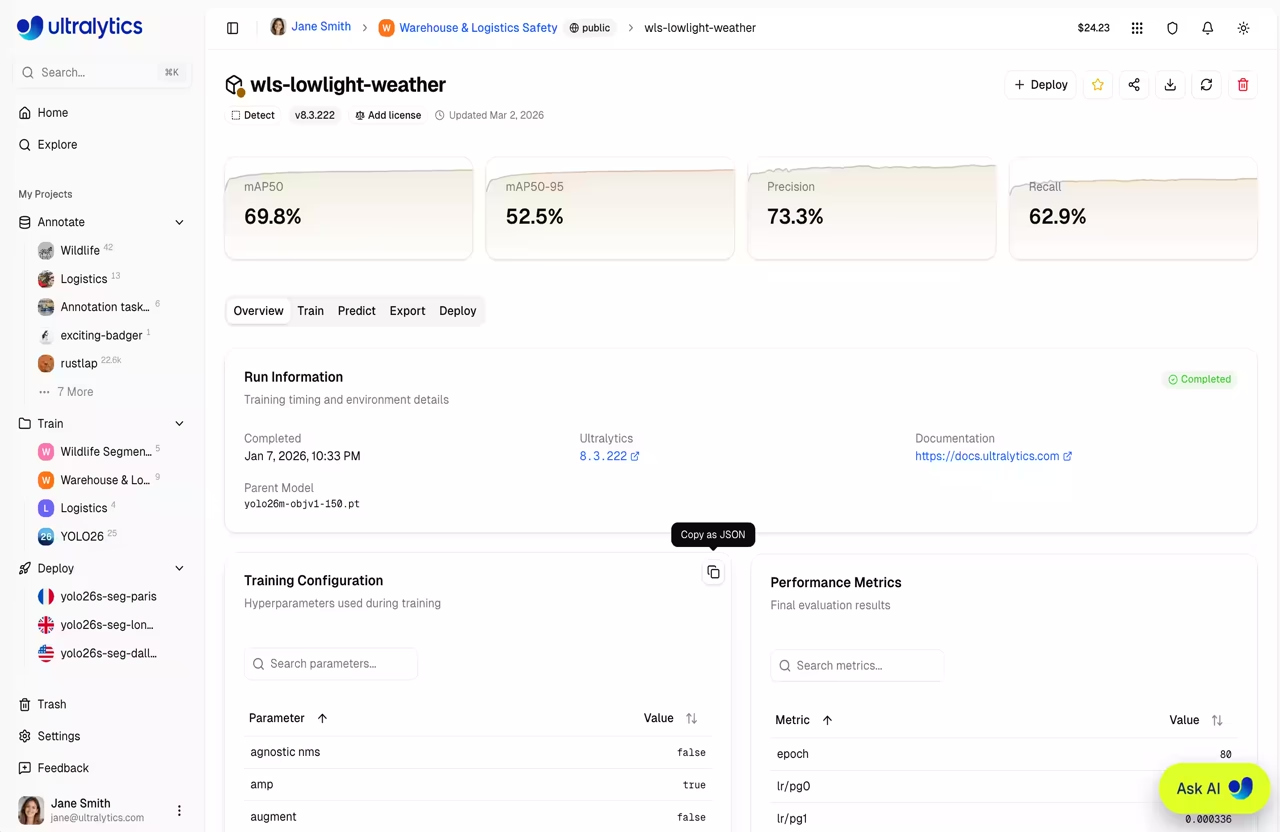

عرض تكاليف التدريب

بعد التدريب، يمكنك عرض التكاليف التفصيلية في علامة تبويب الفواتير:

- تفصيل التكلفة لكل حقبة (epoch)

- إجمالي وقت الـ GPU

- تنزيل تقرير التكلفة

نصائح للتدريب

اختيار حجم النموذج المناسب

| النموذج | المعلمات | الأفضل لـ |

|---|---|---|

| YOLO26n | 2.4M | أجهزة حافة، في الوقت الفعلي |

| YOLO26s | 9.5M | توازن بين السرعة والدقة |

| YOLO26m | 20.4M | دقة أعلى |

| YOLO26l | 24.8M | دقة الإنتاج |

| YOLO26x | 55.7M | أقصى دقة |

تحسين وقت التدريب

استراتيجيات توفير التكاليف

- ابدأ صغيرًا: اختبر بـ 10-20 حقبة على وحدة معالجة رسومات اقتصادية للتحقق من عمل مجموعة البيانات والتكوين الخاص بك.

- استخدم وحدة معالجة رسومات (GPU) مناسبة: يتعامل RTX PRO 6000 مع معظم أعباء العمل بشكل جيد.

- التحقق من صحة مجموعة البيانات: إصلاح مشكلات التسمية قبل الإنفاق على التدريب.

- راقب مبكرًا: ألغِ التدريب إذا استقرت الخسارة — أنت تدفع فقط مقابل وقت الحوسبة المستخدم.

استكشاف الأخطاء وإصلاحها

| إشكالية | الحل |

|---|---|

| التدريب متوقف عند 0% | تحقق من تنسيق مجموعة البيانات، ثم أعد المحاولة |

| نفاد الذاكرة | قلل حجم الدفعة أو استخدم GPU أكبر |

| دقة ضعيفة | زيادة عدد الدورات (epochs)، والتحقق من جودة البيانات |

| التدريب بطيء | النظر في استخدام GPU أسرع |

| خطأ عدم تطابق المهام | تأكد من تطابق مهام النموذج ومجموعة البيانات |

الأسئلة الشائعة

كم يستغرق التدريب؟

يعتمد وقت التدريب على:

- حجم مجموعة البيانات

- حجم النموذج

- عدد الدورات التدريبية

- GPU المحدد

الأوقات النموذجية (1000 صورة، 100 دورة تدريبية):

| النموذج | RTX PRO 6000 | A100 SXM |

|---|---|---|

| YOLO26n | حوالي 20 دقيقة | حوالي 15 دقيقة |

| YOLO26m | حوالي 40 دقيقة | حوالي 30 دقيقة |

| YOLO26x | حوالي 80 دقيقة | حوالي 60 دقيقة |

أوقات تقريبية

أوقات التدريب تقريبية وتختلف باختلاف مدى تعقيد مجموعة البيانات وإعدادات التوسيع وحجم الدفعة. استخدم تقدير التكلفة الموجود في مربع حوار التدريب للحصول على توقعات أكثر دقة.

هل يمكنني التدريب طوال الليل؟

نعم، يستمر التدريب حتى الاكتمال. ستتلقى إشعارًا عند انتهاء التدريب. تأكد من أن حسابك يحتوي على رصيد كافٍ للتدريب القائم على الحقبة.

ماذا يحدث إذا نفدت أرصدتي؟

إذا وصل رصيدك إلى الصفر أثناء عملية تدريب، فسيستمر التدريب حتى النهاية وسيصبح رصيدك سالبًا. وهذا يضمن عدم انقطاع مهمة التدريب أبدًا أثناء سير العملية.

بعد اكتمال التدريب، ستحتاج إلى إضافة رصيد لإعادة رصيدك إلى الإيجابي قبل بدء مهام تدريب جديدة. يتم الاحتفاظ بنموذجك المكتمل ونقاط الفحص وجميع مخرجات التدريب بالكامل بغض النظر عن الرصيد.

رصيد سالب

الرصيد السلبي يمنع فقط بدء مهام تدريب جديدة. تستمر عمليات النشر الحالية وميزات المنصة الأخرى في العمل بشكل طبيعي. أضف رصيدًا عبر الإعدادات > الفوترة أو قم بتمكين التعبئة التلقائية لتجنب الانقطاعات.

ماذا يحدث إذا تجاوزت تكلفة التدريب المبلغ المقدر؟

تقديرات التكلفة تقريبية — قد يختلف وقت التدريب الفعلي بسبب عوامل مثل سرعة تحميل البيانات، وتسخين GPU، وسلوك تقارب النموذج. إذا تجاوزت التكلفة الفعلية التقدير، فقد يصبح رصيدك سالبًا (انظر أعلاه). المنصة لا توقف التدريب بناءً على التقدير.

لإدارة التكاليف:

- متابعة تقدم التدريب في الوقت الفعلي وإلغاؤه مبكرًا إذا لزم الأمر

- تمكين ميزة " التعبئة التلقائية " لتجديد الرصيد تلقائيًا

- ابدأ بجولات أقصر (عدد أقل من الدورات) لمعايرة التوقعات

هل يمكنني استخدام وسائط تدريب مخصصة؟

نعم، قم بتوسيع قسم الإعدادات المتقدمة في مربع حوار التدريب للوصول إلى محرر YAML مع أكثر من 40 معلمة قابلة للتكوين. يتم تضمين القيم غير الافتراضية في كل من أوامر التدريب السحابية والمحلية.

يدعم محرر YAML أيضًا استيراد الإعدادات من عمليات التدريب السابقة:

- النسخ من نموذج موجود: في صفحة أي نموذج مكتمل، تحتوي بطاقة "تكوين التدريب" على زر نسخ كـ JSON. انسخ JSON والصقه مباشرة في محرر YAML — فهو يكتشف تنسيق JSON تلقائيًا ويستورد جميع المعلمات.

- الصق YAML أو JSON: الصق أي تكوين تدريب صالح بصيغة YAML أو JSON في المحرر. يتم التحقق من صحة المعلمات تلقائيًا، مع تقييد القيم خارج النطاق وعرض التحذيرات.

- سحب الملفات وإفلاتها: اسحب

.yamlأو.jsonملفًا مباشرةً في المحرر لاستيراد معلماته.

وهذا يجعل من السهل إعادة إنتاج إعدادات التدريب السابقة أو تعديلها دون الحاجة إلى إعادة إدخال كل معلمة يدويًّا.

هل يمكنني التدريب من صفحة مجموعة بيانات؟

نعم، يفتح زر "تدريب " الموجود في صفحات مجموعة البيانات مربع حوار التدريب مع مجموعة البيانات محددة مسبقًا ومقفلة. ثم تحدد مشروعًا ونموذجًا لبدء التدريب.

مرجع معلمات التدريب

| المعلمة | النوع | افتراضي | النطاق | الوصف |

|---|---|---|---|---|

epochs | عدد صحيح | 100 | 1-10000 | عدد دورات التدريب (epochs) |

batch | عدد صحيح | 16 | 1-512 | حجم الدفعة |

imgsz | عدد صحيح | 640 | 32-4096 | حجم الصورة المدخلة |

patience | عدد صحيح | 100 | 1-1000 | صبر الإيقاف المبكر |

seed | عدد صحيح | 0 | 0-2147483647 | بذرة عشوائية للتكرار |

deterministic | منطقي | صحيح | - | وضع التدريب الحتمي |

amp | منطقي | صحيح | - | الدقة المختلطة التلقائية |

close_mosaic | عدد صحيح | 10 | 0-50 | تعطيل الفسيفساء في العصور النهائية N |

save_period | عدد صحيح | -1 | -1-100 | حفظ نقطة التحقق كل N فترات |

workers | عدد صحيح | 8 | 0-64 | عاملات تحميل البيانات |

cache | اختر | خطأ | ram/disk/false | تخزين الصور مؤقتًا |

| المعلمة | النوع | افتراضي | النطاق | الوصف |

|---|---|---|---|---|

lr0 | عائم | 0.01 | 0.0001-0.1 | معدل التعلم الأولي |

lrf | عائم | 0.01 | 0.01-1.0 | عامل معدل التعلم النهائي |

momentum | عائم | 0.937 | 0.6-0.98 | زخم SGD |

weight_decay | عائم | 0.0005 | 0.0-0.001 | تنظيم L2 |

warmup_epochs | عائم | 3.0 | 0-5 | حقبة التسخين |

warmup_momentum | عائم | 0.8 | 0.5-0.95 | زخم الإحماء |

warmup_bias_lr | عائم | 0.1 | 0.0-0.2 | تحيز الإحماء LR |

cos_lr | منطقي | خطأ | - | مجدول معدل التعلم الجيبي |

| المعلمة | النوع | افتراضي | النطاق | الوصف |

|---|---|---|---|---|

hsv_h | عائم | 0.015 | 0.0-0.1 | زيادة تشبع الألوان HSV |

hsv_s | عائم | 0.7 | 0.0-1.0 | تشبع HSV |

hsv_v | عائم | 0.4 | 0.0-1.0 | قيمة HSV |

degrees | عائم | 0.0 | -45-45 | درجات الدوران |

translate | عائم | 0.1 | 0.0-1.0 | كسر الإزاحة |

scale | عائم | 0.5 | 0.0-1.0 | عامل المقياس |

shear | عائم | 0.0 | -10-10 | درجات القص |

perspective | عائم | 0.0 | 0.0-0.001 | تحويل المنظور |

fliplr | عائم | 0.5 | 0.0-1.0 | احتمالية القلب الأفقي |

flipud | عائم | 0.0 | 0.0-1.0 | احتمالية القلب العمودي |

mosaic | عائم | 1.0 | 0.0-1.0 | توسيع الفسيفساء |

mixup | عائم | 0.0 | 0.0-1.0 | توسيع Mixup |

copy_paste | عائم | 0.0 | 0.0-1.0 | نسخ ولصق (segment) |

| المعلمة | النوع | افتراضي | النطاق | الوصف |

|---|---|---|---|---|

fraction | عائم | 1.0 | 0.1-1.0 | جزء من مجموعة البيانات المراد استخدامها |

freeze | عدد صحيح | فارغ | 0-100 | عدد الطبقات المراد تجميدها |

single_cls | منطقي | خطأ | - | تعامل مع جميع الفئات كفئة واحدة |

rect | منطقي | خطأ | - | تدريب مستطيل |

multi_scale | عائم | 0.0 | 0.0-1.0 | نطاق تدريب متعدد المستويات |

val | منطقي | صحيح | - | تشغيل التحقق أثناء التدريب |

resume | منطقي | خطأ | - | استئناف التدريب من نقطة التفتيش |

| القيمة | الوصف |

|---|---|

auto | اختيار تلقائي (افتراضي) |

SGD | هبوط التدرج العشوائي |

MuSGD | SGD Muon SGD |

Adam | محسن Adam |

AdamW | Adam مع اضمحلال الوزن |

NAdam | محسن NAdam |

RAdam | محسن RAdam |

RMSProp | محسن RMSProp |

Adamax | مُحسِّن Adamax |

| المعلمة | النوع | افتراضي | النطاق | الوصف |

|---|---|---|---|---|

box | عائم | 7.5 | 1-50 | وزن خسارة الصندوق |

cls | عائم | 0.5 | 0.2-4 | وزن فقدان التصنيف |

dfl | عائم | 1.5 | 0.4-6 | فقدان بؤري في التوزيع |

pose | عائم | 12.0 | 1-50 | فقدان الوزن (الوضع فقط) |

kobj | عائم | 1.0 | 0.5-10 | كيفية تحديد النقاط الرئيسية (الوضع) |

label_smoothing | عائم | 0.0 | 0.0-0.1 | عامل تنعيم الملصق |

معاملات خاصة بالمهمة

تنطبق بعض المعاملات على مهام محددة فقط:

- مهام الكشف فقط (detect، segment، pose، obb — ليس classify):

box,dfl,degrees,translate,shear,perspective,mosaic,mixup,close_mosaic - القطاع فقط:

copy_paste - الوقوف فقط:

pose(وزن الخسارة),kobj(موضوعية النقاط الرئيسية)