फास्ट सेगमेंट कुछ भी मॉडल (FastSAM)

फास्ट सेगमेंट कुछ भी मॉडल (FastSAM) सेगमेंट एनीथिंग कार्य के लिए एक उपन्यास, रीयल-टाइम सीएनएन-आधारित समाधान है। यह कार्य विभिन्न संभावित उपयोगकर्ता इंटरैक्शन संकेतों के आधार पर किसी भी वस्तु को एक छवि के भीतर विभाजित करने के लिए डिज़ाइन किया गया है। FastSAM प्रतिस्पर्धी प्रदर्शन को बनाए रखते हुए कम्प्यूटेशनल मांगों को महत्वपूर्ण रूप से कम करता है, जिससे यह विभिन्न प्रकार के दृष्टि कार्यों के लिए एक व्यावहारिक विकल्प बन जाता है।

सतर्कता: ऑब्जेक्ट ट्रैकिंग का उपयोग करना FastSAM के साथ Ultralytics

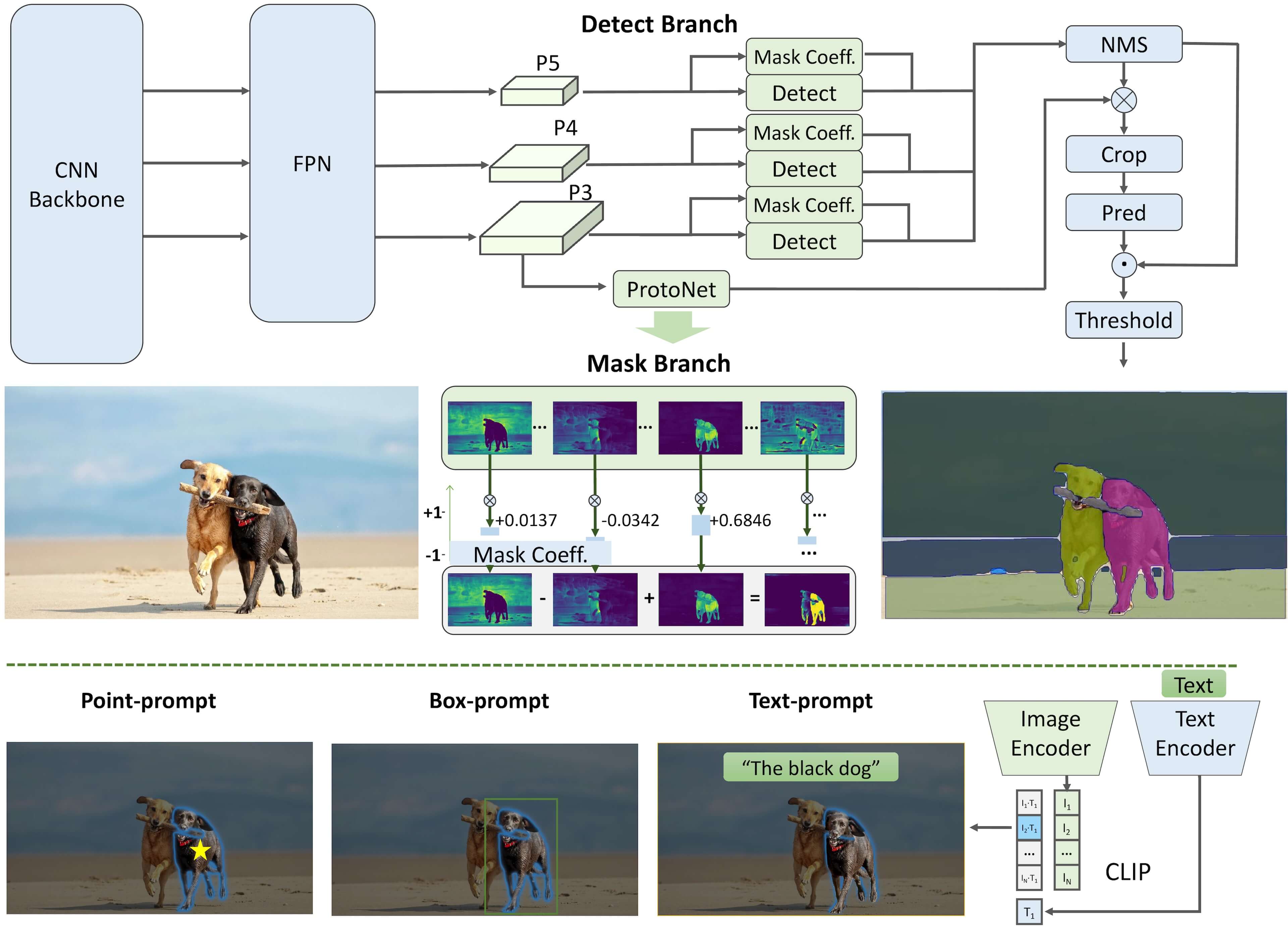

मॉडल वास्तुकला

विहंगावलोकन

FastSAM की सीमाओं को संबोधित करने के लिए डिज़ाइन किया गया है सेगमेंट कुछ भी मॉडल (SAM), पर्याप्त कम्प्यूटेशनल संसाधन आवश्यकताओं के साथ एक भारी ट्रांसफार्मर मॉडल। वही FastSAM सेगमेंट को कुछ भी कार्य को दो अनुक्रमिक चरणों में अलग करता है: सभी-उदाहरण विभाजन और शीघ्र-निर्देशित चयन। पहला चरण उपयोग करता है YOLOv8-seg छवि में सभी उदाहरणों के विभाजन मास्क का उत्पादन करने के लिए। दूसरे चरण में, यह प्रॉम्प्ट के अनुरूप क्षेत्र-की-रुचि को आउटपुट करता है।

प्रमुख विशेषताऐं

-

वास्तविक समय समाधान: सीएनएन की कम्प्यूटेशनल दक्षता का लाभ उठाकर, FastSAM सेगमेंट कुछ भी कार्य के लिए एक वास्तविक समय समाधान प्रदान करता है, जिससे यह औद्योगिक अनुप्रयोगों के लिए मूल्यवान हो जाता है जिन्हें त्वरित परिणामों की आवश्यकता होती है।

-

दक्षता और प्रदर्शन: FastSAM प्रदर्शन की गुणवत्ता से समझौता किए बिना कम्प्यूटेशनल और संसाधन मांगों में उल्लेखनीय कमी प्रदान करता है। यह तुलनीय प्रदर्शन प्राप्त करता है SAM लेकिन काफी कम कम्प्यूटेशनल संसाधनों के साथ, वास्तविक समय के आवेदन को सक्षम करना।

-

शीघ्र-निर्देशित विभाजन: FastSAM विभिन्न संभावित उपयोगकर्ता इंटरैक्शन संकेतों द्वारा निर्देशित छवि के भीतर किसी भी वस्तु को विभाजित कर सकते हैं, विभिन्न परिदृश्यों में लचीलापन और अनुकूलन क्षमता प्रदान करते हैं।

-

आधारित YOLOv8-सेग: FastSAM पर आधारित है YOLOv8-SEG, एक ऑब्जेक्ट डिटेक्टर जो एक इंस्टेंस सेगमेंटेशन ब्रांच से लैस है। यह इसे एक छवि में सभी उदाहरणों के विभाजन मास्क को प्रभावी ढंग से उत्पन्न करने की अनुमति देता है।

-

बेंचमार्क पर प्रतिस्पर्धी परिणाम: एमएस कोको पर ऑब्जेक्ट प्रस्ताव कार्य पर, FastSAM की तुलना में काफी तेज गति से उच्च स्कोर प्राप्त करता है SAM एक ही पर NVIDIA RTX 3090, त्याची कार्यक्षमता आणि क्षमता प्रदर्शित करते.

-

व्यावहारिक अनुप्रयोग: प्रस्तावित दृष्टिकोण वास्तव में उच्च गति पर बड़ी संख्या में दृष्टि कार्यों के लिए एक नया, व्यावहारिक समाधान प्रदान करता है, वर्तमान तरीकों की तुलना में दसियों या सैकड़ों गुना तेज।

-

मॉडल संपीड़न व्यवहार्यता: FastSAM एक पथ की व्यवहार्यता को दर्शाता है जो संरचना से पहले एक कृत्रिम शुरू करके कम्प्यूटेशनल प्रयास को काफी कम कर सकता है, इस प्रकार सामान्य दृष्टि कार्यों के लिए बड़े मॉडल वास्तुकला के लिए नई संभावनाएं खोल सकता है।

उपलब्ध मॉडल, समर्थित कार्य और ऑपरेटिंग मोड

यह तालिका उपलब्ध मॉडलों को उनके विशिष्ट पूर्व-प्रशिक्षित भार, उनके द्वारा समर्थित कार्यों और अनुमान, सत्यापन, प्रशिक्षण और निर्यात जैसे विभिन्न ऑपरेटिंग मोड के साथ उनकी संगतता के साथ प्रस्तुत करती है, जो समर्थित मोड के लिए इमोजी और ❌ असमर्थित मोड के लिए इमोजी द्वारा ✅ इंगित की जाती है।

| मॉडल प्रकार | पूर्व-प्रशिक्षित वजन | समर्थित कार्य | अनुमान | मान्यता | प्रशिक्षण | निर्यातित माल |

|---|---|---|---|---|---|---|

| FastSAM-दक्षिणी | FastSAM-s.pt | इंस्टेंस सेगमेंटेशन | ✅ | ❌ | ❌ | ✅ |

| FastSAM-एक्स | FastSAM-x.pt | इंस्टेंस सेगमेंटेशन | ✅ | ❌ | ❌ | ✅ |

उपयोग के उदाहरण

वही FastSAM मॉडल को अपने में एकीकृत करना आसान है Python अनुप्रयोगों। Ultralytics उपयोगकर्ता के अनुकूल प्रदान करता है Python API और CLI विकास को सुव्यवस्थित करने के लिए आदेश।

उपयोग की भविष्यवाणी करें

किसी छवि पर ऑब्जेक्ट डिटेक्शन करने के लिए, predict विधि जैसा कि नीचे दिखाया गया है:

उदाहरण

from ultralytics import FastSAM

from ultralytics.models.fastsam import FastSAMPrompt

# Define an inference source

source = "path/to/bus.jpg"

# Create a FastSAM model

model = FastSAM("FastSAM-s.pt") # or FastSAM-x.pt

# Run inference on an image

everything_results = model(source, device="cpu", retina_masks=True, imgsz=1024, conf=0.4, iou=0.9)

# Prepare a Prompt Process object

prompt_process = FastSAMPrompt(source, everything_results, device="cpu")

# Everything prompt

results = prompt_process.everything_prompt()

# Bbox default shape [0,0,0,0] -> [x1,y1,x2,y2]

results = prompt_process.box_prompt(bbox=[200, 200, 300, 300])

# Text prompt

results = prompt_process.text_prompt(text="a photo of a dog")

# Point prompt

# points default [[0,0]] [[x1,y1],[x2,y2]]

# point_label default [0] [1,0] 0:background, 1:foreground

results = prompt_process.point_prompt(points=[[200, 200]], pointlabel=[1])

prompt_process.plot(annotations=results, output="./")

यह स्निपेट पूर्व-प्रशिक्षित मॉडल लोड करने और छवि पर पूर्वानुमान चलाने की सरलता को प्रदर्शित करता है।

नोट

सभी लौट आए results उपरोक्त उदाहरणों में हैं परिणाम ऑब्जेक्ट जो आसानी से अनुमानित मास्क और स्रोत छवि तक पहुंचने की अनुमति देता है।

वैल उपयोग

डेटासेट पर मॉडल का सत्यापन निम्नानुसार किया जा सकता है:

उदाहरण

कृपया ध्यान दें कि FastSAM केवल वस्तु के एकल वर्ग का पता लगाने और विभाजन का समर्थन करता है। इसका मतलब है कि यह सभी वस्तुओं को एक ही वर्ग के रूप में पहचानेगा और खंडित करेगा। इसलिए, डेटासेट तैयार करते समय, आपको सभी ऑब्जेक्ट श्रेणी आईडी को 0 में बदलने की आवश्यकता है।

ट्रैक उपयोग

किसी छवि पर ऑब्जेक्ट ट्रैकिंग करने के लिए, track विधि जैसा कि नीचे दिखाया गया है:

उदाहरण

FastSAM आधिकारिक उपयोग

FastSAM से सीधे भी उपलब्ध है https://github.com/CASIA-IVA-Lab/FastSAM कोष। यहां उन विशिष्ट चरणों का संक्षिप्त विवरण दिया गया है जिनका आप उपयोग कर सकते हैं FastSAM:

संस्थापन

-

क्लोन करें FastSAM कोष:

-

के साथ एक कोंडा वातावरण बनाएं और सक्रिय करें Python 3.9:

-

क्लोन किए गए रिपॉजिटरी पर नेविगेट करें और आवश्यक पैकेज स्थापित करें:

-

CLIP मॉडल स्थापित करें:

उदाहरण उपयोग

-

प्रयोग FastSAM अनुमान के लिए। उदाहरण आदेश:

-

एक छवि में सब कुछ खंडित करें:

-

टेक्स्ट प्रॉम्प्ट का उपयोग करके विशिष्ट ऑब्जेक्ट्स को सेगमेंट करें:

-

ऑब्जेक्ट्स को बाउंडिंग बॉक्स के भीतर सेगमेंट करें (xywh प्रारूप में बॉक्स निर्देशांक प्रदान करें):

-

विशिष्ट बिंदुओं के पास वस्तुओं को खंडित करें:

-

इसके अतिरिक्त, आप कोशिश कर सकते हैं FastSAM Colab डेमो के माध्यम से याHuggingFace एक दृश्य अनुभव के लिए वेब डेमो।

प्रशंसा पत्र और पावती

हम स्वीकार करना चाहेंगे FastSAM वास्तविक समय उदाहरण विभाजन के क्षेत्र में उनके महत्वपूर्ण योगदान के लिए लेखक:

मूल FastSAM कागज arXiv पर पाया जा सकता है। लेखकों ने अपना काम सार्वजनिक रूप से उपलब्ध कराया है, और कोडबेस को GitHub पर एक्सेस किया जा सकता है। हम क्षेत्र को आगे बढ़ाने और उनके काम को व्यापक समुदाय के लिए सुलभ बनाने में उनके प्रयासों की सराहना करते हैं।

अक्सर पूछे जाने वाले प्रश्न

क्या है FastSAM और यह किससे अलग है SAM?

FastSAM, फास्ट सेगमेंट एनीथिंग मॉडल के लिए छोटा, एक वास्तविक समय दृढ़ तंत्रिका नेटवर्क (सीएनएन) आधारित समाधान है जिसे ऑब्जेक्ट सेगमेंटेशन कार्यों में उच्च प्रदर्शन को बनाए रखते हुए कम्प्यूटेशनल मांगों को कम करने के लिए डिज़ाइन किया गया है। सेगमेंट एनीथिंग मॉडल के विपरीत (SAM), जो एक भारी ट्रांसफार्मर-आधारित वास्तुकला का उपयोग करता है, FastSAM लिवरेज Ultralytics YOLOv8दो चरणों में कुशल उदाहरण विभाजन के लिए -SEG: शीघ्र-निर्देशित चयन के बाद सभी-उदाहरण विभाजन।

कैसे करता है FastSAM वास्तविक समय विभाजन प्रदर्शन प्राप्त करें?

FastSAM के साथ सभी-उदाहरण विभाजन में विभाजन कार्य को अलग करके वास्तविक समय विभाजन प्राप्त करता है YOLOv8-एसईजी और शीघ्र-निर्देशित चयन चरण। सीएनएन की कम्प्यूटेशनल दक्षता का उपयोग करके, FastSAM प्रतिस्पर्धी प्रदर्शन को बनाए रखते हुए कम्प्यूटेशनल और संसाधन मांगों में महत्वपूर्ण कमी प्रदान करता है। यह दोहरे चरण का दृष्टिकोण सक्षम बनाता है FastSAM त्वरित परिणामों की आवश्यकता वाले अनुप्रयोगों के लिए उपयुक्त तेज और कुशल विभाजन प्रदान करने के लिए।

के व्यावहारिक अनुप्रयोग क्या हैं FastSAM?

FastSAM विभिन्न प्रकार के कंप्यूटर विज़न कार्यों के लिए व्यावहारिक है जिनके लिए वास्तविक समय विभाजन प्रदर्शन की आवश्यकता होती है। अनुप्रयोगों में शामिल हैं:

- गुणवत्ता नियंत्रण और आश्वासन के लिए औद्योगिक स्वचालन

- सुरक्षा और निगरानी के लिए वास्तविक समय वीडियो विश्लेषण

- वस्तु का पता लगाने और विभाजन के लिए स्वायत्त वाहन

- सटीक और त्वरित विभाजन कार्यों के लिए चिकित्सा इमेजिंग

विभिन्न उपयोगकर्ता इंटरैक्शन संकेतों को संभालने की इसकी क्षमता बनाता है FastSAM विविध परिदृश्यों के लिए अनुकूलनीय और लचीला।

मैं इसका उपयोग कैसे करूं FastSAM में अनुमान के लिए मॉडल Python?

का उपयोग करना FastSAM में अनुमान के लिए Python, आप नीचे दिए गए उदाहरण का अनुसरण कर सकते हैं:

from ultralytics import FastSAM

from ultralytics.models.fastsam import FastSAMPrompt

# Define an inference source

source = "path/to/bus.jpg"

# Create a FastSAM model

model = FastSAM("FastSAM-s.pt") # or FastSAM-x.pt

# Run inference on an image

everything_results = model(source, device="cpu", retina_masks=True, imgsz=1024, conf=0.4, iou=0.9)

# Prepare a Prompt Process object

prompt_process = FastSAMPrompt(source, everything_results, device="cpu")

# Everything prompt

ann = prompt_process.everything_prompt()

# Bounding box prompt

ann = prompt_process.box_prompt(bbox=[200, 200, 300, 300])

# Text prompt

ann = prompt_process.text_prompt(text="a photo of a dog")

# Point prompt

ann = prompt_process.point_prompt(points=[[200, 200]], pointlabel=[1])

prompt_process.plot(annotations=ann, output="./")

अनुमान विधियों के बारे में अधिक जानकारी के लिए, दस्तावेज़ीकरण के उपयोग की भविष्यवाणी अनुभाग देखें।

किस प्रकार के संकेत करते हैं FastSAM विभाजन कार्यों के लिए समर्थन?

FastSAM विभाजन कार्यों का मार्गदर्शन करने के लिए कई शीघ्र प्रकारों का समर्थन करता है:

- सब कुछ शीघ्र: सभी दृश्यमान वस्तुओं के लिए विभाजन उत्पन्न करता है।

- बाउंडिंग बॉक्स (BBox) प्रॉम्प्ट: निर्दिष्ट बाउंडिंग बॉक्स के भीतर ऑब्जेक्ट सेगमेंट करता है।

- टेक्स्ट प्रॉम्प्ट: विवरण से मेल खाने वाली वस्तुओं को खंडित करने के लिए वर्णनात्मक पाठ का उपयोग करता है।

- प्वाइंट प्रॉम्प्ट: विशिष्ट उपयोगकर्ता-परिभाषित बिंदुओं के पास ऑब्जेक्ट को सेगमेंट करता है।

यह लचीलापन अनुमति देता है FastSAM उपयोगकर्ता इंटरैक्शन परिदृश्यों की एक विस्तृत श्रृंखला के अनुकूल होने के लिए, विभिन्न अनुप्रयोगों में इसकी उपयोगिता को बढ़ाना। इन संकेतों का उपयोग करने के बारे में अधिक जानकारी के लिए, मुख्य विशेषताएं अनुभाग देखें।

बनाया गया 2023-11-12, अपडेट किया गया 2024-07-18

लेखक: लाफिंग-क्यू (2), ग्लेन-जोचर (13), रिजवान मुनव्वर (2), बेरी-डिंग (1)