Link to this sectionDataset COCO#

Il dataset COCO (Common Objects in Context) è un dataset su larga scala per il rilevamento di oggetti, la segmentazione e la generazione di didascalie. È progettato per incoraggiare la ricerca su un'ampia varietà di categorie di oggetti ed è comunemente utilizzato per il benchmarking di modelli di computer vision. È un dataset essenziale per ricercatori e sviluppatori che lavorano su attività di rilevamento di oggetti, segmentazione e stima della posa.

Watch: Ultralytics COCO Dataset Overview

Link to this sectionModelli preaddestrati COCO#

| Modello | dimensione (pixel) | mAPval 50-95 | mAPval 50-95(e2e) | Velocità CPU ONNX (ms) | Velocità T4 TensorRT10 (ms) | params (M) | FLOPs (B) |

|---|---|---|---|---|---|---|---|

| YOLO26n | 640 | 40.9 | 40.1 | 38.9 ± 0.7 | 1.7 ± 0.0 | 2.4 | 5.4 |

| YOLO26s | 640 | 48.6 | 47.8 | 87.2 ± 0.9 | 2.5 ± 0.0 | 9.5 | 20.7 |

| YOLO26m | 640 | 53.1 | 52.5 | 220.0 ± 1.4 | 4.7 ± 0.1 | 20.4 | 68.2 |

| YOLO26l | 640 | 55.0 | 54.4 | 286.2 ± 2.0 | 6.2 ± 0.2 | 24.8 | 86.4 |

| YOLO26x | 640 | 57.5 | 56.9 | 525.8 ± 4.0 | 11.8 ± 0.2 | 55.7 | 193.9 |

Link to this sectionCaratteristiche principali#

- COCO contiene 330K immagini, di cui 200K con annotazioni per attività di rilevamento di oggetti, segmentazione e didascalie.

- Il dataset comprende 80 categorie di oggetti, inclusi oggetti comuni come automobili, biciclette e animali, nonché categorie più specifiche come ombrelli, borse e attrezzature sportive.

- Le annotazioni includono riquadri di delimitazione degli oggetti (bounding box), maschere di segmentazione e didascalie per ogni immagine.

- COCO fornisce metriche di valutazione standardizzate come la mean Average Precision (mAP) per il rilevamento di oggetti e la mean Average Recall (mAR) per le attività di segmentazione, rendendolo adatto al confronto delle prestazioni dei modelli.

Link to this sectionStruttura del dataset#

Il dataset COCO è suddiviso in tre sottoinsiemi:

- Train2017: questo sottoinsieme contiene 118K immagini per l'addestramento di modelli di rilevamento di oggetti, segmentazione e didascalie.

- Val2017: questo sottoinsieme contiene 5K immagini utilizzate per scopi di validazione durante l'addestramento del modello.

- Test2017: Questo subset è composto da 20K immagini utilizzate per testare e valutare le prestazioni dei modelli addestrati. Le annotazioni ground truth per questo subset non sono disponibili pubblicamente e i risultati vengono inviati al COCO evaluation server per la valutazione delle prestazioni.

Link to this sectionApplicazioni#

Il dataset COCO è ampiamente utilizzato per l'addestramento e la valutazione di modelli di deep learning nel rilevamento di oggetti (come Ultralytics YOLO, Faster R-CNN e SSD), instance segmentation (come Mask R-CNN) e rilevamento di keypoint (come OpenPose). La diversa serie di categorie di oggetti del dataset, l'elevato numero di immagini annotate e le metriche di valutazione standardizzate lo rendono una risorsa essenziale per ricercatori e professionisti della computer vision.

Link to this sectionDataset YAML#

Un file YAML (Yet Another Markup Language) viene utilizzato per definire la configurazione del dataset. Contiene informazioni sui percorsi, le classi e altre informazioni pertinenti del dataset. Nel caso del dataset COCO, il file coco.yaml è mantenuto su https://github.com/ultralytics/ultralytics/blob/main/ultralytics/cfg/datasets/coco.yaml.

# Ultralytics 🚀 AGPL-3.0 License - https://ultralytics.com/license

# COCO 2017 dataset https://cocodataset.org by Microsoft

# Documentation: https://docs.ultralytics.com/datasets/detect/coco/

# Example usage: yolo train data=coco.yaml

# parent

# ├── ultralytics

# └── datasets

# └── coco ← downloads here (20.1 GB)

# Train/val/test sets as 1) dir: path/to/imgs, 2) file: path/to/imgs.txt, or 3) list: [path/to/imgs1, path/to/imgs2, ..]

path: coco # dataset root dir

train: train2017.txt # train images (relative to 'path') 118287 images

val: val2017.txt # val images (relative to 'path') 5000 images

test: test-dev2017.txt # 20288 of 40670 images, submit via https://cocodataset.org/#detection-eval

# Classes

names:

0: person

1: bicycle

2: car

3: motorcycle

4: airplane

5: bus

6: train

7: truck

8: boat

9: traffic light

10: fire hydrant

11: stop sign

12: parking meter

13: bench

14: bird

15: cat

16: dog

17: horse

18: sheep

19: cow

20: elephant

21: bear

22: zebra

23: giraffe

24: backpack

25: umbrella

26: handbag

27: tie

28: suitcase

29: frisbee

30: skis

31: snowboard

32: sports ball

33: kite

34: baseball bat

35: baseball glove

36: skateboard

37: surfboard

38: tennis racket

39: bottle

40: wine glass

41: cup

42: fork

43: knife

44: spoon

45: bowl

46: banana

47: apple

48: sandwich

49: orange

50: broccoli

51: carrot

52: hot dog

53: pizza

54: donut

55: cake

56: chair

57: couch

58: potted plant

59: bed

60: dining table

61: toilet

62: tv

63: laptop

64: mouse

65: remote

66: keyboard

67: cell phone

68: microwave

69: oven

70: toaster

71: sink

72: refrigerator

73: book

74: clock

75: vase

76: scissors

77: teddy bear

78: hair drier

79: toothbrush

# Download script/URL (optional)

download: |

from pathlib import Path

from ultralytics.utils import ASSETS_URL

from ultralytics.utils.downloads import download

# Download labels

segments = True # segment or box labels

dir = Path(yaml["path"]) # dataset root dir

urls = [ASSETS_URL + ("/coco2017labels-segments.zip" if segments else "/coco2017labels.zip")] # labels

download(urls, dir=dir.parent)

# Download data

urls = [

"http://images.cocodataset.org/zips/train2017.zip", # 19G, 118k images

"http://images.cocodataset.org/zips/val2017.zip", # 1G, 5k images

"http://images.cocodataset.org/zips/test2017.zip", # 7G, 41k images (optional)

]

download(urls, dir=dir / "images", threads=3)Link to this sectionUtilizzo#

Per addestrare un modello YOLO26n sul dataset COCO per 100 epoch con una dimensione dell'immagine di 640, puoi utilizzare i seguenti frammenti di codice. Per un elenco completo degli argomenti disponibili, fai riferimento alla pagina di Addestramento del modello.

from ultralytics import YOLO

# Load a model

model = YOLO("yolo26n.pt") # load a pretrained model (recommended for training)

# Train the model

results = model.train(data="coco.yaml", epochs=100, imgsz=640)Link to this sectionEsempi di immagini e annotazioni#

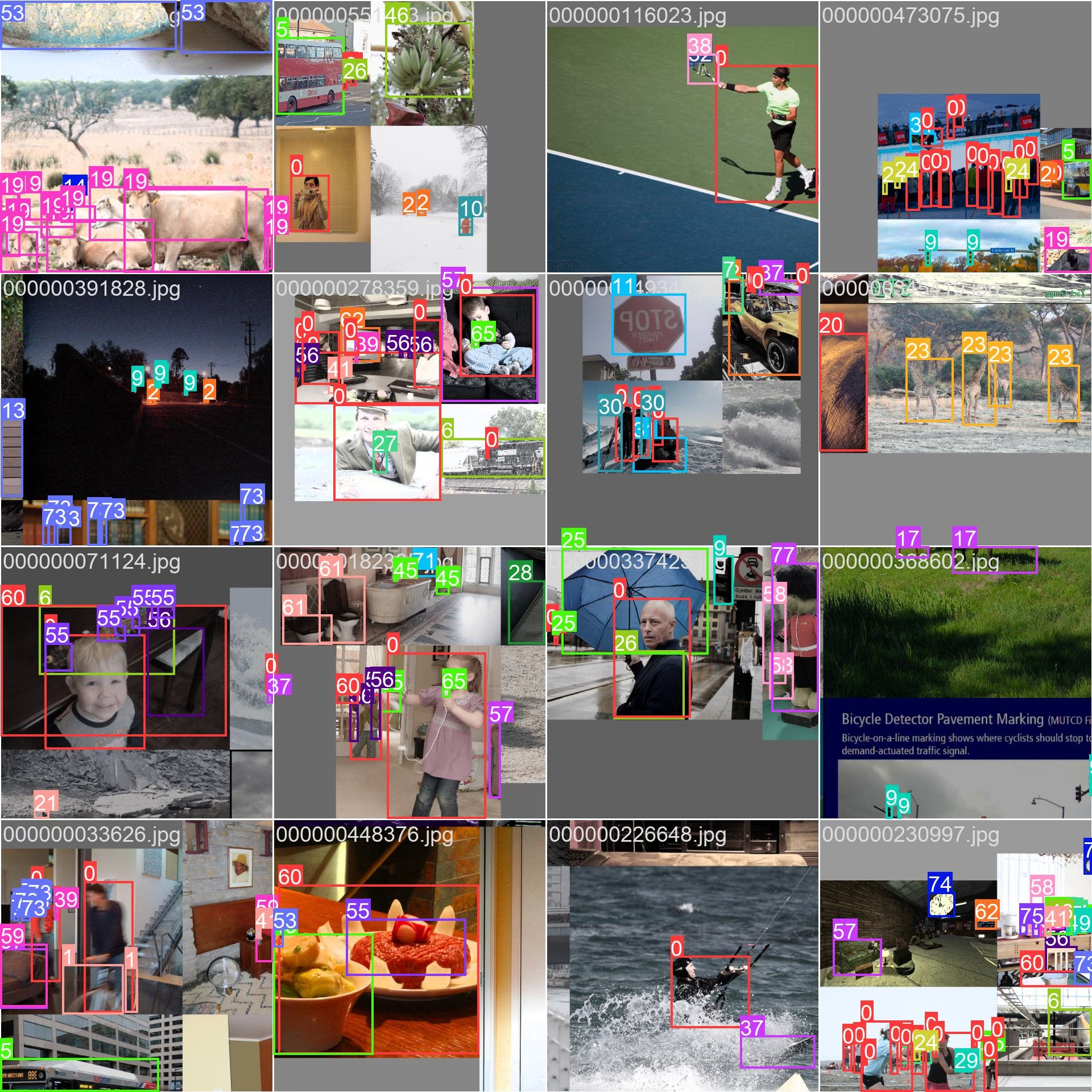

Il dataset COCO contiene una serie diversificata di immagini con varie categorie di oggetti e scene complesse. Ecco alcuni esempi di immagini dal dataset, insieme alle loro corrispondenti annotazioni:

- Immagine Mosaico: Questa immagine mostra un batch di addestramento composto da immagini del dataset a mosaico. Il mosaico è una tecnica utilizzata durante l'addestramento che combina più immagini in un'unica immagine per aumentare la varietà di oggetti e scene all'interno di ogni batch di addestramento. Ciò aiuta a migliorare la capacità del modello di generalizzare a diverse dimensioni, proporzioni e contesti degli oggetti.

L'esempio mostra la varietà e la complessità delle immagini nel dataset COCO e i vantaggi dell'utilizzo del mosaico durante il processo di addestramento.

Link to this sectionCitazioni e riconoscimenti#

Se utilizzi il dataset COCO nel tuo lavoro di ricerca o sviluppo, cita il seguente articolo:

@misc{lin2015microsoft,

title={Microsoft COCO: Common Objects in Context},

author={Tsung-Yi Lin and Michael Maire and Serge Belongie and Lubomir Bourdev and Ross Girshick and James Hays and Pietro Perona and Deva Ramanan and C. Lawrence Zitnick and Piotr Dollár},

year={2015},

eprint={1405.0312},

archivePrefix={arXiv},

primaryClass={cs.CV}

}Desideriamo ringraziare il COCO Consortium per aver creato e mantenuto questa preziosa risorsa per la comunità della computer vision. Per maggiori informazioni sul dataset COCO e sui suoi creatori, visita il sito web del dataset COCO.

Link to this sectionFAQ#

Link to this sectionCos'è il dataset COCO e perché è importante per la computer vision?#

Il dataset COCO (Common Objects in Context) è un dataset su larga scala utilizzato per il rilevamento di oggetti, la segmentazione e la generazione di didascalie. Contiene 330K immagini con annotazioni dettagliate per 80 categorie di oggetti, rendendolo essenziale per il benchmarking e l'addestramento di modelli di computer vision. I ricercatori utilizzano COCO grazie alle sue diverse categorie e alle metriche di valutazione standardizzate come la mean Average Precision (mAP).

Link to this sectionCome posso addestrare un modello YOLO utilizzando il dataset COCO?#

Per addestrare un modello YOLO26 utilizzando il dataset COCO, puoi utilizzare i seguenti frammenti di codice:

from ultralytics import YOLO

# Load a model

model = YOLO("yolo26n.pt") # load a pretrained model (recommended for training)

# Train the model

results = model.train(data="coco.yaml", epochs=100, imgsz=640)Fai riferimento alla pagina di Addestramento per maggiori dettagli sugli argomenti disponibili.

Link to this sectionQuali sono le caratteristiche principali del dataset COCO?#

Il dataset COCO include:

- 330K immagini, con 200K annotate per il rilevamento di oggetti, la segmentazione e la generazione di didascalie.

- 80 categorie di oggetti che spaziano da articoli comuni come auto e animali a quelli specifici come borse e attrezzature sportive.

- Metriche di valutazione standardizzate per il rilevamento di oggetti (mAP) e la segmentazione (mean Average Recall, mAR).

- Tecnica di Mosaicing nei batch di addestramento per migliorare la generalizzazione del modello su varie dimensioni di oggetti e contesti.

Link to this sectionDove posso trovare modelli YOLO26 preaddestrati sul dataset COCO?#

I modelli YOLO26 preaddestrati sul dataset COCO possono essere scaricati dai link forniti nella documentazione. Esempi includono:

Questi modelli variano per dimensioni, mAP e velocità di inferenza, offrendo opzioni per diversi requisiti di prestazioni e risorse.

Link to this sectionCome è strutturato il dataset COCO e come lo utilizzo?#

Il dataset COCO è suddiviso in tre sottoinsiemi:

- Train2017: 118K immagini per l'addestramento.

- Val2017: 5K immagini per la validazione durante l'addestramento.

- Test2017: 20K immagini per il benchmarking dei modelli addestrati. I risultati devono essere inviati al COCO evaluation server per la valutazione delle prestazioni.

Il file di configurazione YAML del dataset è disponibile su coco.yaml, che definisce percorsi, classi e dettagli del dataset.