Link to this sectionDeployment#

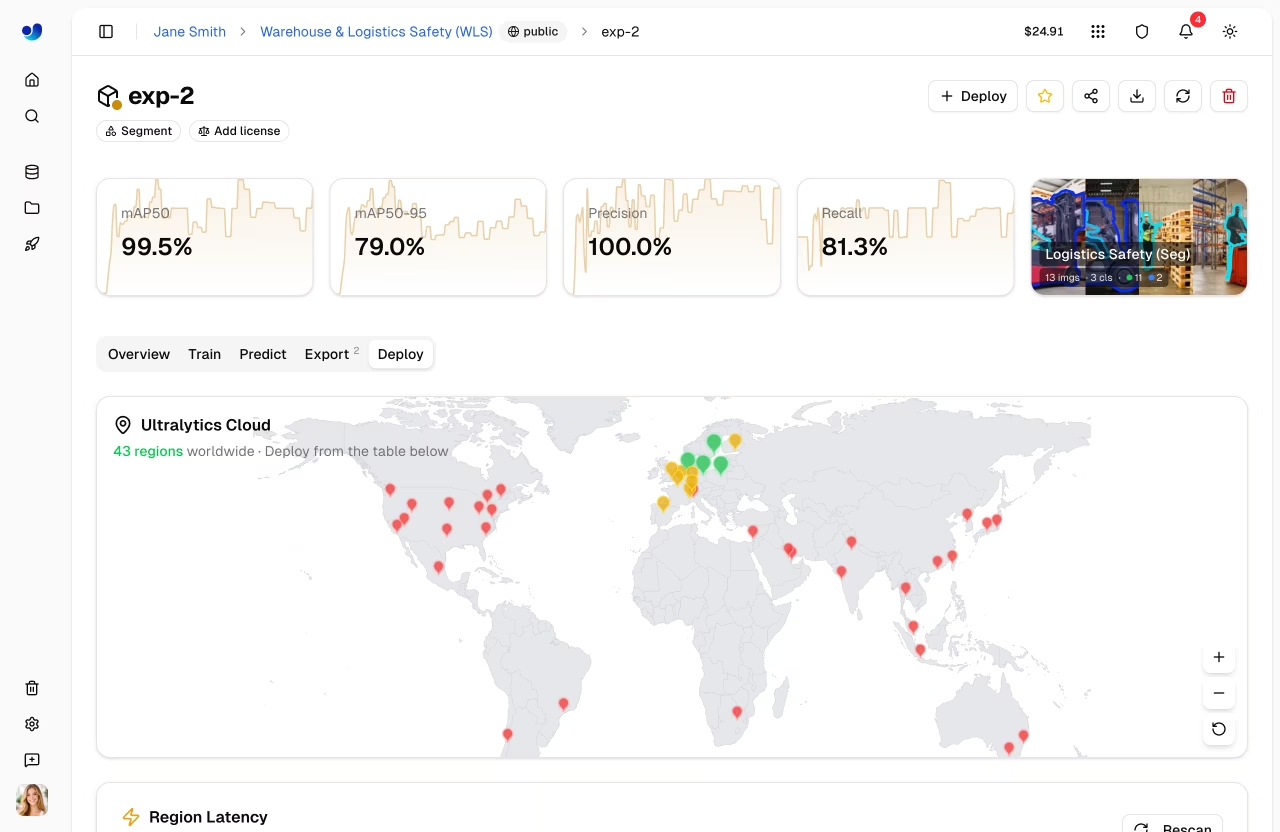

Ultralytics Platform fornisce opzioni di distribuzione complete per mettere in produzione i tuoi modelli YOLO. Testa i modelli con l'inferenza basata su browser, distribuiscili su endpoint dedicati in 43 regioni globali e monitora le prestazioni in tempo reale.

Watch: Get Started with Ultralytics Platform - Deploy

Link to this sectionPanoramica#

La sezione Deployment ti aiuta a:

- Testare i modelli direttamente nel browser con la scheda

Predict - Distribuire su endpoint dedicati in 43 regioni globali

- Monitorare metriche delle richieste, log e controlli di integrità

- Effettuare lo scale to zero quando sei inattivo (le distribuzioni attualmente eseguono una singola istanza attiva)

Link to this sectionOpzioni di Deployment#

Ultralytics Platform offre molteplici percorsi di distribuzione:

| Opzione | Descrizione | Ideale per |

|---|---|---|

| Scheda Predict | Inferenza basata su browser con immagine, webcam ed esempi | Sviluppo, convalida |

| Inferenza Condivisa | Servizio multi-tenant in 3 regioni | Utilizzo leggero, test |

| Endpoint Dedicati | Servizi single-tenant in 43 regioni | Produzione, bassa latenza |

Link to this sectionFlusso di lavoro#

graph LR

A[✅ Test] --> B[⚙️ Configure]

B --> C[🌐 Deploy]

C --> D[📊 Monitor]

style A fill:#4CAF50,color:#fff

style B fill:#2196F3,color:#fff

style C fill:#FF9800,color:#fff

style D fill:#9C27B0,color:#fff| Fase | Descrizione |

|---|---|

| Test | Convalida il modello con la scheda Predict |

| Configura | Seleziona la regione e il nome della distribuzione (le distribuzioni utilizzano risorse predefinite fisse) |

| Distribuisci | Crea un endpoint dedicato dalla scheda Deploy |

| Monitora | Tieni traccia di richieste, latenza, errori e log in Monitoring |

Link to this sectionArchitettura#

Link to this sectionInferenza Condivisa#

Il servizio di inferenza condivisa viene eseguito in 3 regioni chiave, instradando automaticamente le richieste in base alla regione dei tuoi dati:

graph TB

User[User Request] --> API[Platform API]

API --> Router{Region Router}

Router -->|US users| US["US Predict Service<br/>Iowa"]

Router -->|EU users| EU["EU Predict Service<br/>Belgium"]

Router -->|AP users| AP["AP Predict Service<br/>Taiwan"]

style User fill:#f5f5f5,color:#333

style API fill:#2196F3,color:#fff

style Router fill:#FF9800,color:#fff

style US fill:#4CAF50,color:#fff

style EU fill:#4CAF50,color:#fff

style AP fill:#4CAF50,color:#fff| Regione (Region) | Posizione |

|---|---|

| USA | Iowa, USA |

| UE | Belgio, Europa |

| AP | Taiwan, Asia-Pacifico |

Link to this sectionEndpoint Dedicati#

Distribuisci in 43 regioni in tutto il mondo su Ultralytics Cloud:

- Americhe: 14 regioni

- Europa: 13 regioni

- Asia-Pacifico: 12 regioni

- Medio Oriente e Africa: 4 regioni

Ogni endpoint è un servizio single-tenant con:

- Risorse predefinite di

1 CPU,2 GiBdi memoria,minInstances=0,maxInstances=1 - Scale-to-zero quando inattivo

- URL dell'endpoint univoco

- Monitoraggio, log e controlli di integrità indipendenti

Link to this sectionPagina Deployments#

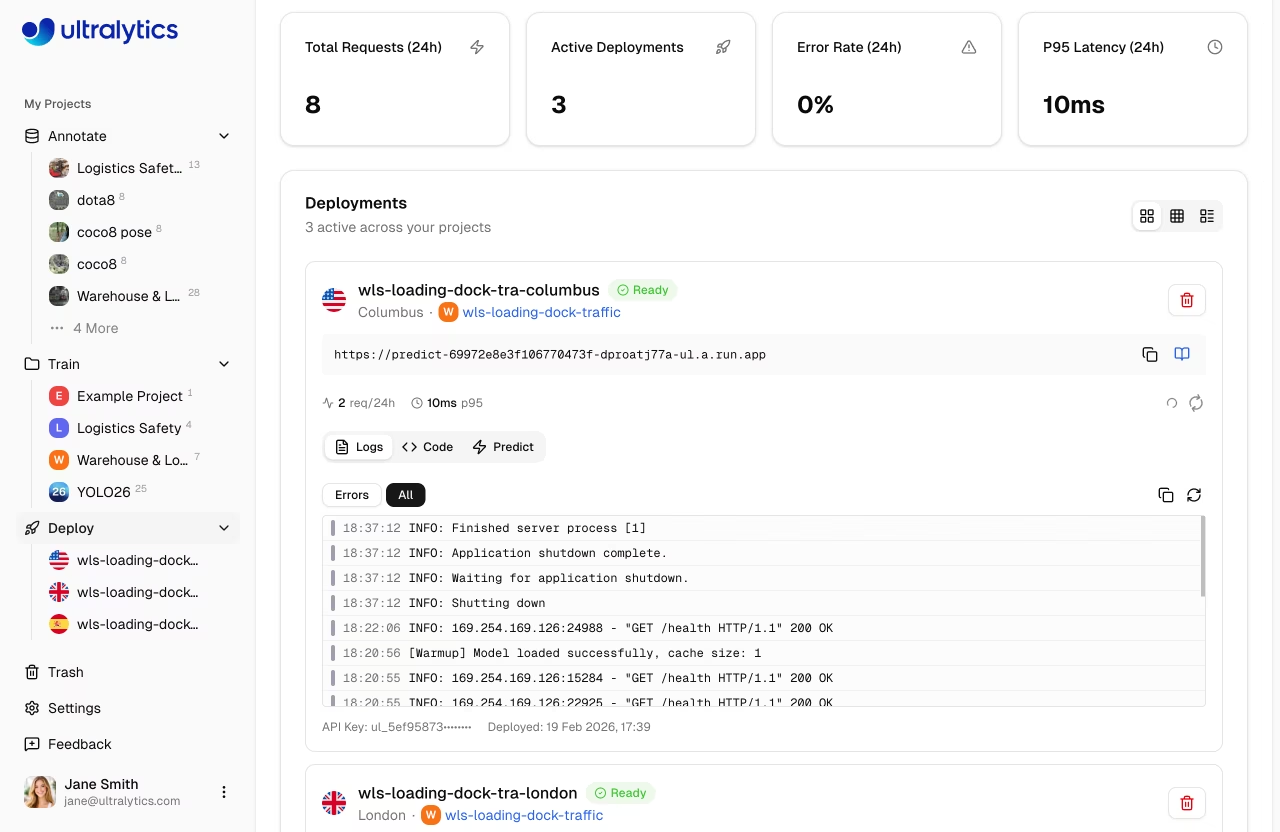

Accedi alla pagina globale delle distribuzioni dalla barra laterale sotto Deploy. Questa pagina mostra:

- Mappa del mondo con i pin delle regioni distribuite (mappa interattiva)

- Schede di panoramica: Richieste totali (24h), Distribuzioni attive, Tasso di errore (24h), Latenza P95 (24h)

- Elenco distribuzioni con tre modalità di visualizzazione: schede, compatta e tabella

- Pulsante New Deployment per creare endpoint da qualsiasi modello completato

La pagina esegue il polling ogni 15 secondi normalmente. Quando le distribuzioni sono in uno stato di transizione (creating, deploying o stopping), il polling aumenta a ogni 3 secondi per un feedback più rapido.

Link to this sectionCaratteristiche principali#

Link to this sectionCopertura Globale#

Distribuisci vicino ai tuoi utenti con 43 regioni che coprono:

- Nord America, Sud America

- Europa, Medio Oriente, Africa

- Asia Pacifico, Oceania

Link to this sectionComportamento di Scaling#

Gli endpoint attualmente si comportano come segue:

- Scale to zero: Nessun costo quando inattivo (impostazione predefinita)

- Singola istanza attiva:

maxInstancesè attualmente limitato a1su tutti i piani

Lo scale-to-zero è abilitato per impostazione predefinita (min instances = 0). Paghi solo per il tempo di inferenza attivo.

Link to this sectionBassa Latenza#

Gli endpoint dedicati forniscono:

- Cold start: ~5-15 secondi (contenitore memorizzato nella cache), fino a ~45 secondi (prima distribuzione)

- Inferenza a caldo: 50-200ms (dipendente dal modello)

- Instradamento regionale per prestazioni ottimali

Link to this sectionControlli di Integrità#

Ogni distribuzione in esecuzione include un controllo di integrità automatico con:

- Indicatore di stato live (sano/non sano)

- Visualizzazione della latenza di risposta

- Riprova automatica quando non è sano (polling ogni 20 secondi)

- Pulsante di aggiornamento manuale

Link to this sectionAvvio rapido#

Distribuisci un modello in meno di 2 minuti:

- Addestra o carica un modello su un progetto

- Vai alla scheda Deploy del modello

- Seleziona una regione dalla tabella di latenza

- Clicca su Deploy — il tuo endpoint è attivo

Model → Deploy tab → Select region → Click Deploy → Endpoint URL ready

Una volta distribuito, usa l'URL dell'endpoint con la tua API key per inviare richieste di inferenza da qualsiasi applicazione.

Link to this sectionLink rapidi#

- Inferenza: Testa i modelli nel browser

- Endpoint: Distribuisci endpoint dedicati

- Monitoraggio: Tieni traccia delle prestazioni della distribuzione

Link to this sectionFAQ#

Link to this sectionQual è la differenza tra inferenza condivisa e dedicata?#

| Caratteristica | Condivisa | Dedicato |

|---|---|---|

| Latenza | Variabile | Coerente |

| Costo | Gratuito (incluso) | Gratuito (base), basato sull'utilizzo (avanzato) |

| Scala | Limitata | Scale-to-zero, istanza singola |

| Regioni | 3 | 43 |

| URL | Generico | Personalizzato |

| Tasso | 20 rich/min | Illimitato |

Link to this sectionQuanto tempo richiede la distribuzione?#

La distribuzione dell'endpoint dedicato richiede solitamente 1-2 minuti:

- Pull dell'immagine (~30s)

- Avvio del contenitore (~30s)

- Controllo di integrità (~30s)

Link to this sectionPosso distribuire più modelli?#

Sì, ogni modello può avere più endpoint in regioni diverse. Il numero di distribuzioni è limitato dal piano: Free 3, Pro 10, Enterprise unlimited.

Link to this sectionCosa succede quando un endpoint è inattivo?#

Con lo scale-to-zero abilitato:

- L'endpoint si riduce dopo l'inattività

- La prima richiesta attiva un avvio a freddo (cold start)

- Le richieste successive sono veloci

Le prime richieste dopo un periodo di inattività attivano un avvio a freddo.