Link to this sectionMonitoraggio#

Ultralytics Platform fornisce il monitoraggio per gli endpoint distribuiti. Tieni traccia delle metriche delle richieste, visualizza i log e controlla lo stato di salute con il polling automatico.

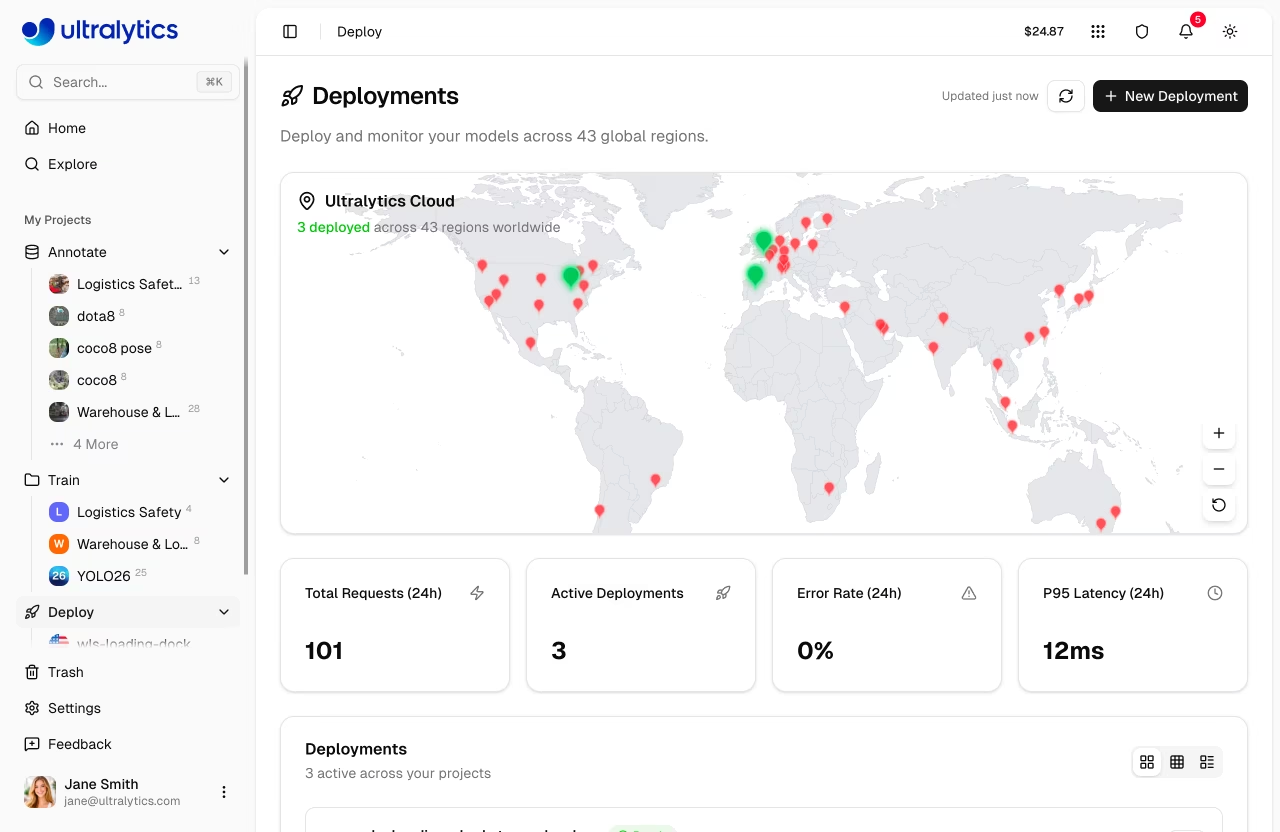

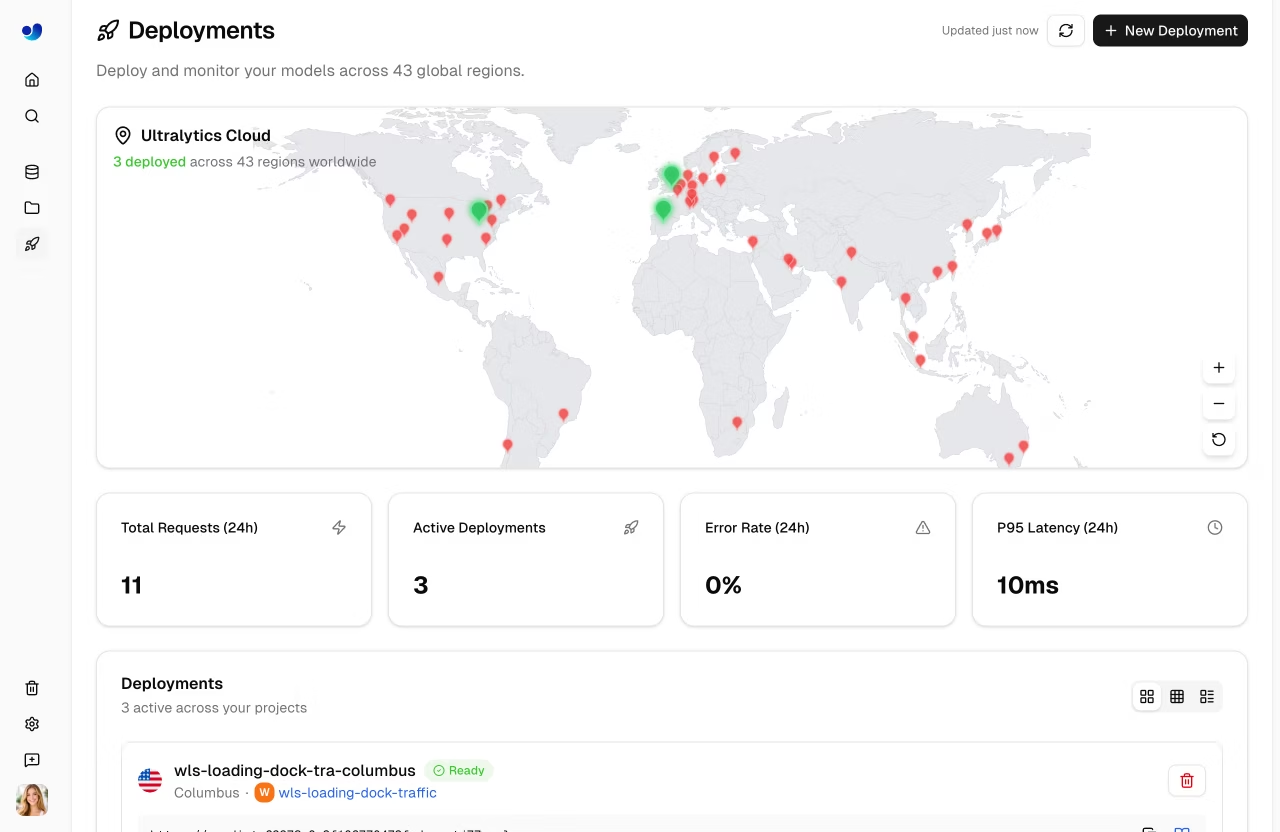

Link to this sectionDashboard delle distribuzioni#

La pagina Deploy nella barra laterale funge da dashboard di monitoraggio per tutte le tue distribuzioni. Combina la mappa del mondo, le metriche generali e la gestione delle distribuzioni in un'unica vista. Consulta Dedicated Endpoints per creare e gestire le distribuzioni.

graph TB

subgraph Dashboard

Map[World Map] --- Cards[Overview Cards]

Cards --- List[Deployments List]

end

subgraph "Per Deployment"

Metrics[Metrics Row]

Health[Health Check]

Logs[Logs Tab]

Code[Code Tab]

Predict[Predict Tab]

end

List --> Metrics

List --> Health

List --> Logs

List --> Code

List --> Predict

style Dashboard fill:#f5f5f5,color:#333

style Map fill:#2196F3,color:#fff

style Cards fill:#FF9800,color:#fff

style List fill:#4CAF50,color:#fffLink to this sectionSchede di panoramica#

Quattro schede di riepilogo nella parte superiore della pagina mostrano:

| Metrica | Descrizione |

|---|---|

| Richieste totali (24h) | Richieste su tutti gli endpoint |

| Distribuzioni attive | Endpoint attualmente in esecuzione |

| Tasso di errore (24h) | Percentuale di richieste fallite |

| Latenza P95 (24h) | Tempo di risposta al 95° percentile |

La scheda del tasso di errore si illumina di rosso quando il tasso supera il 5%. Controlla la scheda Logs sulle singole distribuzioni per diagnosticare gli errori.

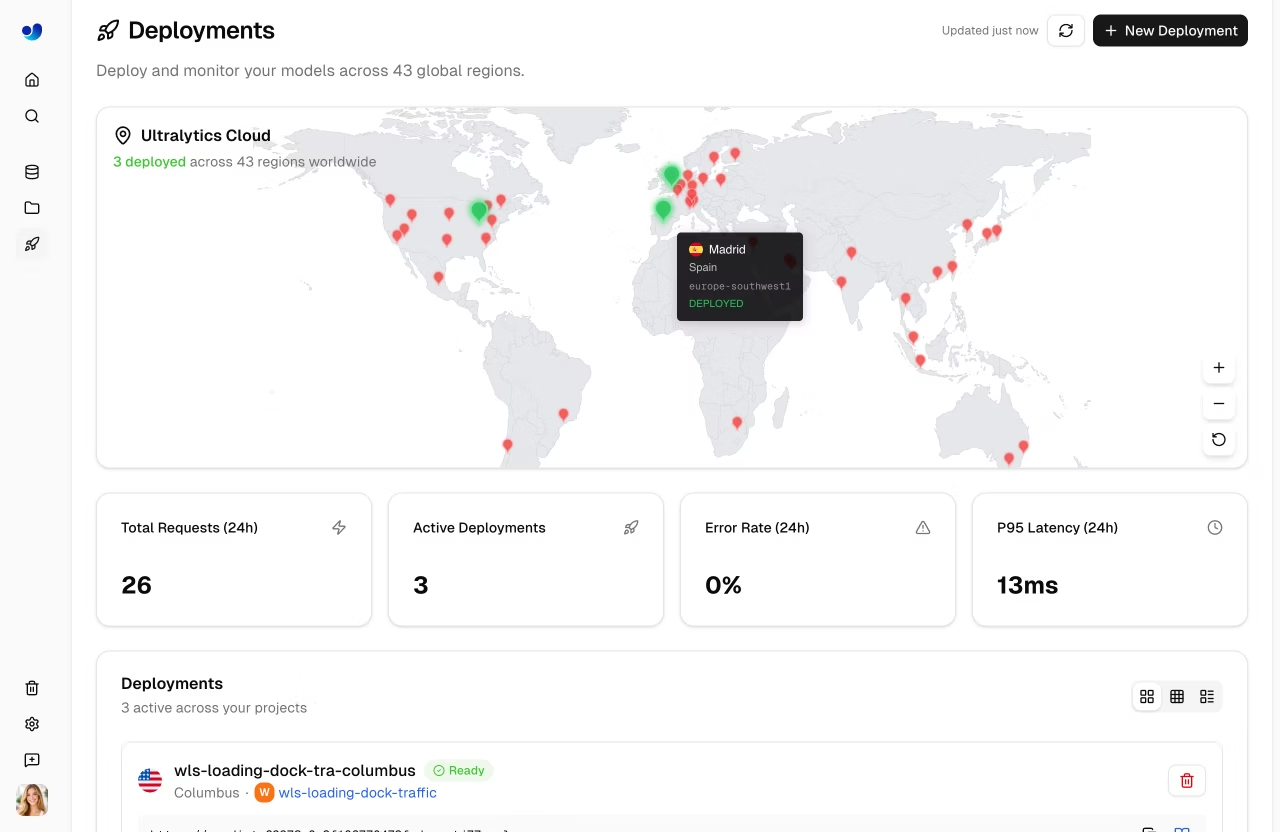

Link to this sectionMappa del mondo#

La mappa interattiva del mondo mostra:

- Pin di regione per tutte le 43 regioni disponibili

- Pin verdi per le regioni con distribuzioni attive

- Pin blu animati per le regioni con distribuzioni attive in corso

- La dimensione dei pin varia in base allo stato della distribuzione e alla latenza

Link to this sectionElenco delle distribuzioni#

Sotto le schede di panoramica, l'elenco delle distribuzioni mostra tutti gli endpoint nei tuoi progetti. Usa il selettore della modalità di visualizzazione per passare tra:

| Visualizza | Descrizione |

|---|---|

| Schede | Schede di dettaglio complete con schede per metriche, log, codice e previsioni |

| Compatta | Griglia di schede più piccole (1-4 colonne) con metriche chiave |

| Tabella | DataTable con colonne ordinabili: Nome, Regione, Stato, Richieste, P95, Errori |

La dashboard esegue il polling ogni 15 secondi per gli aggiornamenti dello stato della distribuzione. Quando le distribuzioni sono in uno stato transitorio (creating, deploying o stopping), il polling aumenta a ogni 3 secondi. I grafici delle metriche si aggiornano ogni 60 secondi. Clicca sul pulsante di aggiornamento per aggiornamenti immediati.

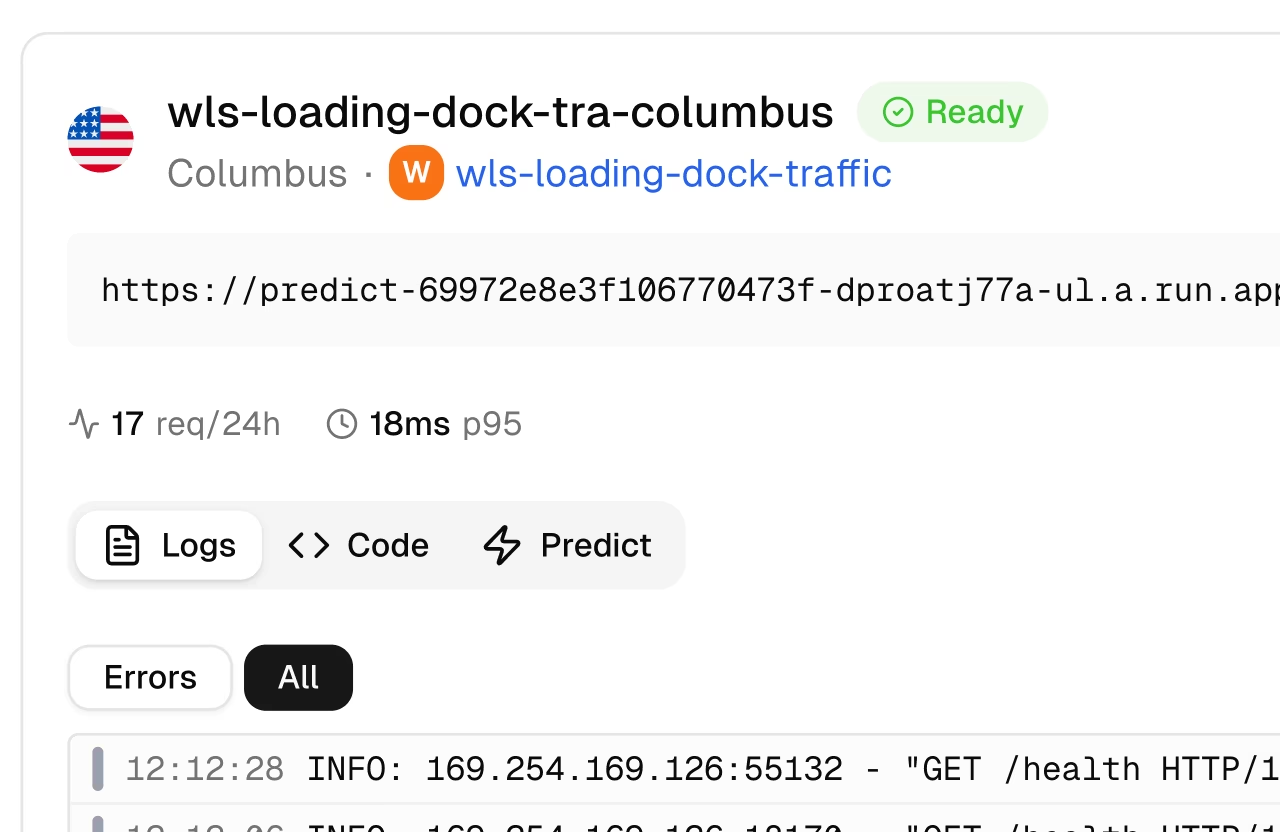

Link to this sectionMetriche per singola distribuzione#

Ogni scheda di distribuzione (nella vista schede) mostra metriche in tempo reale:

Link to this sectionRiga delle metriche#

| Metrica | Descrizione |

|---|---|

| Richieste | Conteggio delle richieste (24h) con icona |

| Latenza P95 | Tempo di risposta al 95° percentile |

| Tasso di errore | Percentuale di richieste fallite |

Le metriche vengono recuperate dall'endpoint API sparkline e si aggiornano ogni 60 secondi.

Link to this sectionControllo Integrità#

Le distribuzioni in esecuzione mostrano un indicatore di controllo della salute:

| Indicatore | Significato |

|---|---|

| Cuore verde | Sano — mostra la latenza di risposta |

| Cuore rosso | Non sano — mostra il messaggio di errore |

| Icona rotante | Controllo della salute in corso |

I controlli di salute riprovano automaticamente ogni 20 secondi quando non sono sani. Clicca sull'icona di aggiornamento per attivare manualmente un controllo della salute. Il controllo della salute utilizza un timeout di 55 secondi per adattarsi agli avvii a freddo sugli endpoint scale-to-zero.

Il controllo della salute utilizza un timeout di 55 secondi per considerare gli avvii a freddo sugli endpoint scale-to-zero (fino a ~45 secondi nel caso peggiore). Una volta che l'endpoint si è scaldato, i controlli di salute si completano in millisecondi.

Link to this sectionLog#

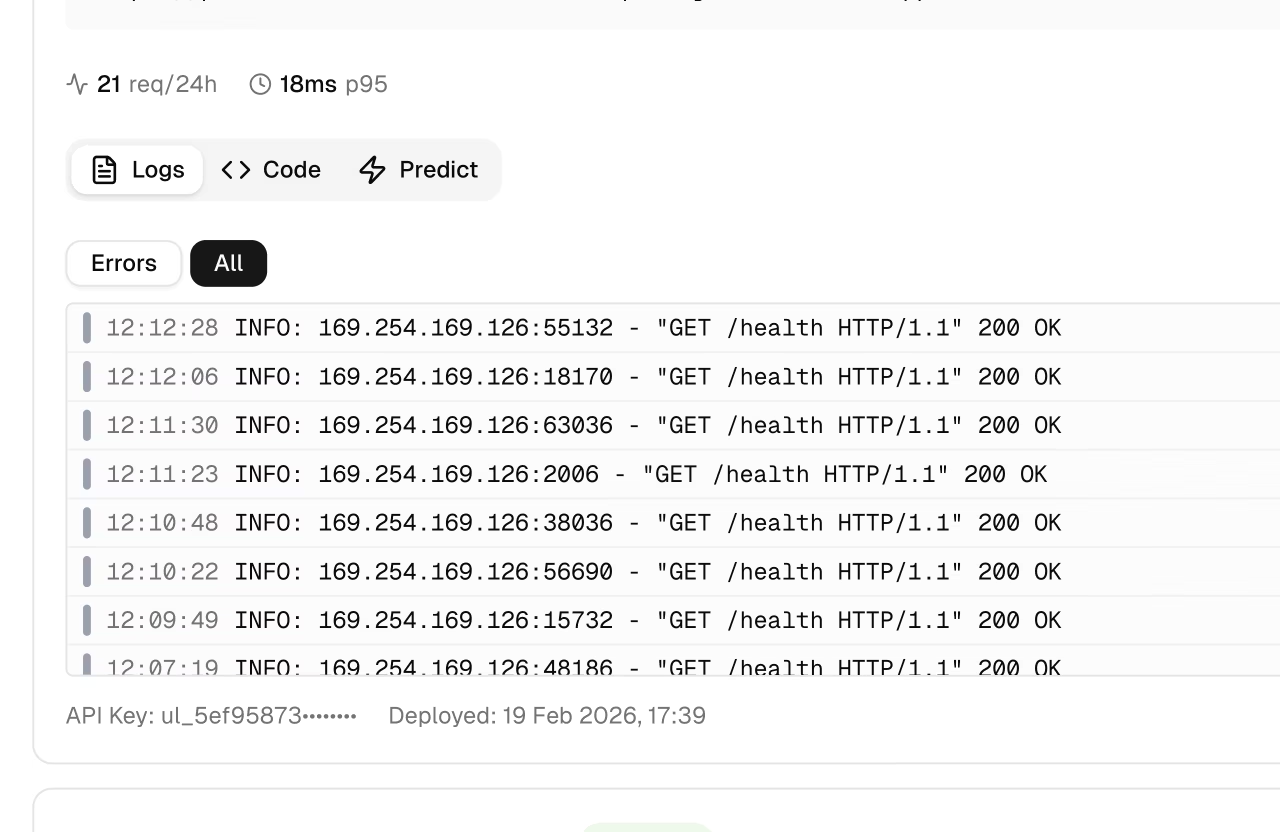

Ogni scheda di distribuzione include una scheda Logs per visualizzare le voci di log recenti:

Link to this sectionVoci di log#

Ogni voce di log mostra:

| Campo | Descrizione |

|---|---|

| Gravità | Barra codificata a colori (vedi sotto) |

| Timestamp | Ora della richiesta (formato locale) |

| Messaggio | Contenuto del log |

| Informazioni HTTP | Codice di stato e latenza (se applicabile) |

Filtra i log per gravità usando i pulsanti di filtro:

| Livello | Colore | Descrizione |

|---|---|---|

| DEBUG | Grigio | Messaggi di debug |

| INFO | Blu | Richieste normali |

| WARNING | Giallo | Problemi non critici |

| ERROR | Rosso | Richieste fallite |

| CRITICAL | Rosso scuro | Errori critici |

L'interfaccia mostra le 20 voci più recenti. L'API imposta di default 50 voci per richiesta (massimo 200).

Durante l'indagine sugli errori: prima clicca su Errori per filtrare sulle voci ERROR e WARNING, quindi controlla i timestamp e i codici di stato HTTP. Copia i log negli appunti per condividerli con il tuo team.

Link to this sectionEsempi di codice#

Ogni scheda di distribuzione include una scheda Code che mostra codice API pronto all'uso con il tuo URL endpoint effettivo e la chiave API:

import requests

# Deployment endpoint

url = "https://predict-abc123.run.app/predict"

# Headers with your deployment API key

headers = {"Authorization": "Bearer YOUR_API_KEY"}

# Inference parameters

data = {"conf": 0.25, "iou": 0.7, "imgsz": 640}

# Send image for inference

with open("image.jpg", "rb") as f:

response = requests.post(url, headers=headers, data=data, files={"file": f})

print(response.json())Quando visualizzi la scheda Code nella piattaforma, il tuo URL endpoint e la chiave API vengono compilati automaticamente. Copia il codice ed eseguilo direttamente. Consulta API Keys per generare una chiave.

Link to this sectionPrevisione su deployment#

La scheda Predict su ogni scheda di deployment fornisce un pannello di previsione integrato: la stessa interfaccia della scheda Predict del modello, ma che esegue l'inferenza tramite l'endpoint di deployment invece che tramite il servizio condiviso. Questo è utile per testare un endpoint distribuito direttamente dal browser. Consulta Inference per i dettagli sui parametri e i formati di risposta.

Link to this sectionEndpoint API#

Link to this sectionPanoramica del monitoraggio#

GET /api/monitoringRestituisce metriche aggregate per tutti i deployment di proprietà dell'utente autenticato. Consapevole dell'area di lavoro tramite il parametro di query opzionale owner.

Link to this sectionMetriche di deployment#

GET /api/deployments/{deploymentId}/metrics?sparkline=true&range=24hRestituisce dati sparkline e metriche di riepilogo per uno specifico deployment. Intervallo di aggiornamento: 60 secondi.

| Parametro | Tipo | Descrizione |

|---|---|---|

sparkline | bool | Includi dati sparkline |

range | stringa | Intervallo di tempo: 1h, 6h, 24h, 7d o 30d |

Link to this sectionLog di deployment#

GET /api/deployments/{deploymentId}/logs?limit=50&severity=ERROR,WARNINGRestituisce voci di log recenti con filtro di gravità opzionale e impaginazione.

| Parametro | Tipo | Descrizione |

|---|---|---|

limit | int | Numero massimo di voci da restituire (predefinito: 50, massimo: 200) |

severity | stringa | Filtro di gravità separato da virgole |

pageToken | stringa | Token di paginazione dalla risposta precedente |

Link to this sectionStato di salute del deployment#

GET /api/deployments/{deploymentId}/healthRestituisce lo stato del controllo di integrità con la latenza di risposta.

{

"healthy": true,

"status": 200,

"latencyMs": 142,

"serverTiming": { "db": 8, "ping": 142, "total": 150 }

}Link to this sectionOttimizzazione delle prestazioni#

Usa i dati di monitoraggio per ottimizzare i tuoi deployment:

Se la latenza è troppo elevata:

- Controlla il conteggio delle istanze (potresti averne bisogno di più)

- Verifica che la dimensione del modello sia appropriata

- Considera una regione più vicina

- Controlla le dimensioni delle immagini inviate

Passa da imgsz=1280 a imgsz=640 per un accelerazione di ~4x con una perdita di precisione minima per la maggior parte dei casi d'uso. Effettua il deployment in una regione più vicina ai tuoi utenti per una latenza di rete inferiore.

Link to this sectionFAQ#

Link to this sectionPer quanto tempo vengono conservati i dati?#

| Tipo di dato | Conservazione |

|---|---|

| Metriche | 30 giorni |

| Log | 7 giorni |

Link to this sectionPosso configurare un monitoraggio esterno?#

Sì, gli URL degli endpoint funzionano con strumenti di monitoraggio esterni:

- Monitoraggio dell'uptime (Pingdom, UptimeRobot)

- Strumenti APM (Datadog, New Relic)

- Controlli di integrità personalizzati tramite l'endpoint

/health

Link to this sectionQuanto sono accurati i numeri di latenza?#

Le metriche di latenza misurano:

- P50: Tempo di risposta mediano

- P95: 95° percentile

- P99: 99° percentile

Questi rappresentano il tempo di elaborazione lato server, non includendo la latenza di rete verso i tuoi utenti.

Link to this sectionPerché le mie metriche sono in ritardo?#

Le metriche hanno un ritardo di ~2 minuti dovuto a:

- Pipeline di aggregazione delle metriche

- Finestre di aggregazione

- Caching della dashboard

Per il debug in tempo reale, controlla i log che sono quasi istantanei.

Link to this sectionPosso monitorare più endpoint insieme?#

Sì, la pagina dei deployment mostra tutti gli endpoint con schede di panoramica aggregate. Usa la visualizzazione a tabella per confrontare le prestazioni tra i vari deployment.