Link to this sectionTreinamento de modelos#

A Ultralytics Platform fornece ferramentas abrangentes para o treinamento de modelos YOLO, desde a organização de experimentos até a execução de trabalhos de treinamento em nuvem com streaming de métricas em tempo real.

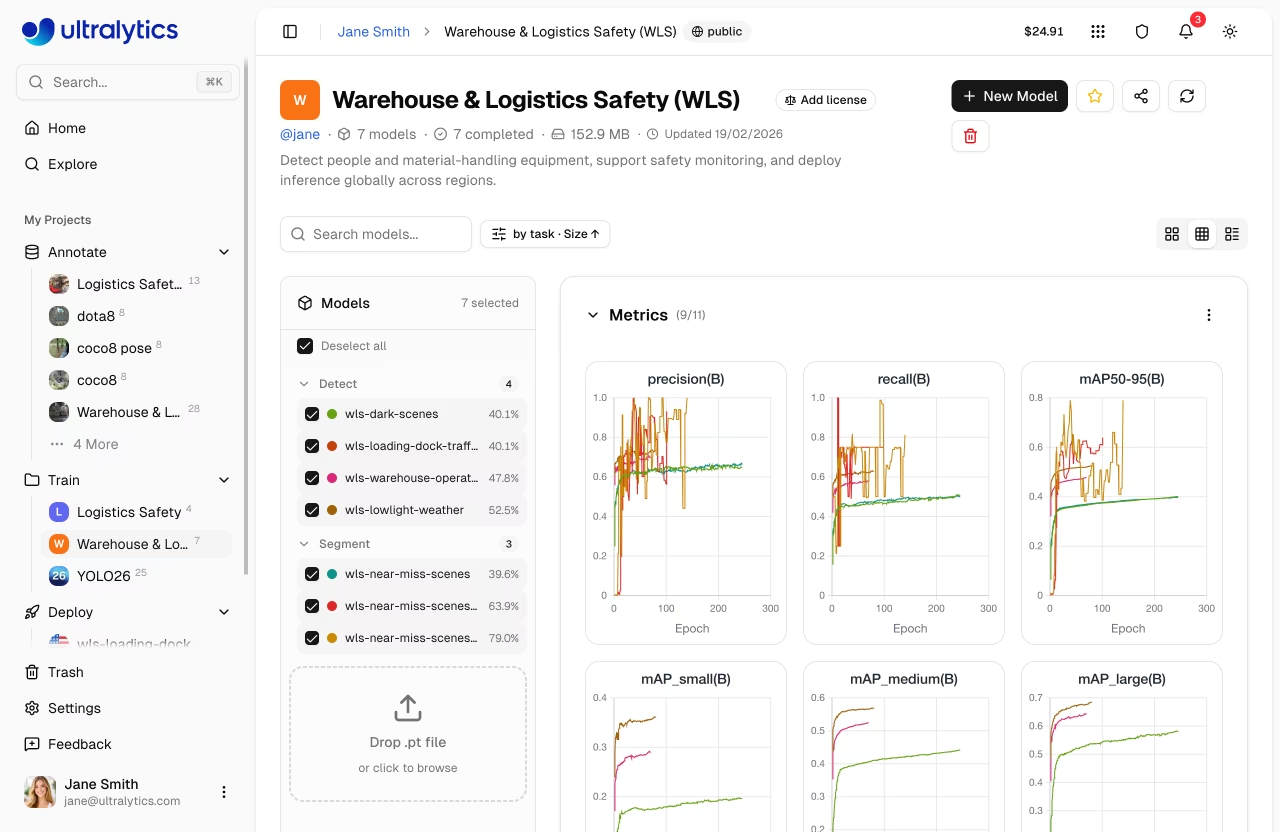

Watch: Get Started with Ultralytics Platform - Train

Link to this sectionVisão geral#

A seção de Treinamento ajuda você a:

- Organizar modelos em projetos para facilitar o gerenciamento

- Treinar em GPUs na nuvem com um único clique

- Monitorar métricas em tempo real durante o treinamento

- Comparar o desempenho do modelo entre experimentos

- Exportar para mais de 19 formatos de implantação (veja formatos suportados)

Link to this sectionFluxo de trabalho#

graph LR

A[📁 Project] --> B[⚙️ Configure]

B --> C[🚀 Train]

C --> D[📈 Monitor]

D --> E[📦 Export]

style A fill:#4CAF50,color:#fff

style B fill:#2196F3,color:#fff

style C fill:#FF9800,color:#fff

style D fill:#9C27B0,color:#fff

style E fill:#00BCD4,color:#fff| Etapa | Descrição |

|---|---|

| Projeto | Crie um espaço de trabalho para organizar modelos relacionados |

| Configurar | Selecione o dataset, o modelo base e os parâmetros de treinamento |

| Treinar | Execute em GPUs na nuvem ou no seu hardware local |

| Monitorar | Visualize curvas de perda e métricas em tempo real |

| Exportar | Converta para mais de 19 formatos de implantação (detalhes) |

Link to this sectionOpções de Treinamento#

A Ultralytics Platform suporta múltiplas abordagens de treinamento:

| Método | Descrição | Melhor para |

|---|---|---|

| Treinamento em Nuvem | Treine em GPUs da Ultralytics Cloud | Sem GPU local, escalabilidade |

| Treinamento Local | Treine localmente, envie métricas para a plataforma | Hardware existente, privacidade |

| Treinamento no Colab | Use o Google Colab com integração à plataforma | Acesso gratuito a GPU |

Link to this sectionOpções de GPU#

GPUs disponíveis para treinamento em nuvem na Ultralytics Cloud:

| GPU | Geração | VRAM | Custo/Hora | Melhor para |

|---|---|---|---|---|

| RTX 2000 Ada | Ada | 16 GB | $0.24 | Datasets pequenos, testes |

| RTX A4500 | Ampere | 20 GB | $0.25 | Datasets pequenos a médios |

| RTX 4000 Ada | Ada | 20 GB | $0.26 | Datasets médios |

| RTX A5000 | Ampere | 24 GB | $0.27 | Datasets médios |

| L4 | Ada | 24 GB | $0.39 | Otimizada para inferência |

| A40 | Ampere | 48 GB | $0.44 | Tamanhos de lote maiores |

| RTX 3090 | Ampere | 24 GB | $0.46 | Treinamento geral |

| RTX A6000 | Ampere | 48 GB | $0.49 | Modelos grandes |

| RTX PRO 4500 | Blackwell | 32 GB | $0.64 | Ótima relação preço/desempenho |

| RTX 4090 | Ada | 24 GB | $0.69 | Melhor relação preço/desempenho |

| RTX 6000 Ada | Ada | 48 GB | $0.77 | Treinamento com lotes grandes |

| L40S | Ada | 48 GB | $0.86 | Treinamento com lotes grandes |

| RTX 5090 | Blackwell | 32 GB | $0.99 | Última geração de consumidor |

| L40 | Ada | 48 GB | $0.99 | Modelos grandes |

| A100 PCIe | Ampere | 80 GB | $1.39 | Treinamento de produção |

| A100 SXM | Ampere | 80 GB | $1.49 | Treinamento de produção |

| RTX PRO 6000 | Blackwell | 96 GB | $1.89 | Padrão recomendado |

| H100 PCIe | Hopper | 80 GB | $2.39 | Treinamento de alto desempenho |

| H100 SXM | Hopper | 80 GB | $2.99 | Treinamento mais rápido |

| H100 NVL | Hopper | 94 GB | $3.07 | Desempenho máximo |

| H200 NVL | Hopper | 143 GB | $3.39 | Memória máxima |

| H200 SXM | Hopper | 141 GB | $3.99 | Desempenho máximo |

| B200 | Blackwell | 180 GB | $5.49 | Modelos grandes (Pro+) |

| B300 | Blackwell | 288 GB | $7.39 | Modelos maiores (Pro+) |

As GPUs B200 e B300 requerem um plano Pro ou Enterprise. Todas as outras GPUs estão disponíveis em todos os planos, incluindo o Gratuito.

Novas contas recebem créditos de inscrição para treinamento. Verifique Faturamento para detalhes.

Link to this sectionMétricas em Tempo Real#

Durante o treinamento, veja métricas ao vivo em três subguias:

graph LR

A[Charts] --> B[Loss Curves]

A --> C[Performance Metrics]

D[Console] --> E[Live Logs]

D --> F[Error Detection]

G[System] --> H[GPU Utilization]

G --> I[Memory & Temp]

style A fill:#2196F3,color:#fff

style D fill:#FF9800,color:#fff

style G fill:#9C27B0,color:#fff| Subguia | Métricas |

|---|---|

| Gráficos | Perda de Box/classe/DFL, mAP50, mAP50-95, precisão, recall |

| Console | Logs de treinamento ao vivo com cor ANSI e detecção de erro |

| Sistema | Utilização da GPU, memória, temperatura, CPU, disco |

Para treinamento na nuvem, o melhor modelo (best.pt, o checkpoint com o maior mAP) é salvo automaticamente e disponibilizado para download, exportação e implantação após a conclusão do treinamento.

Link to this sectionInício Rápido#

Comece com o treinamento na nuvem em menos de um minuto:

- Crie um projeto na barra lateral

- Clique em Novo Modelo

- Selecione um modelo, conjunto de dados e GPU

- Clique em Iniciar Treinamento

Link to this sectionLinks Rápidos#

- Projetos: Organize seus modelos e experimentos

- Modelos: Gerencie checkpoints treinados

- Treinamento na Nuvem: Treine em GPUs na nuvem

Link to this sectionFAQ#

Link to this sectionQuanto tempo leva o treinamento?#

O tempo de treinamento depende de:

- Tamanho do conjunto de dados (número de imagens)

- Tamanho do modelo (n, s, m, l, x)

- Número de épocas

- Tipo de GPU selecionado

Uma execução de treinamento típica com 1000 imagens, YOLO26n, 100 épocas em uma RTX PRO 6000 leva cerca de 5-10 minutos. Execuções menores (500 imagens, 50 épocas em uma RTX 4090) completam em menos de uma hora. Veja exemplos de custo para estimativas detalhadas.

Link to this sectionPosso treinar vários modelos simultaneamente?#

Sim. Os limites de treinamento simultâneo na nuvem dependem do seu plano: Gratuito permite 3, Pro permite 10, e Enterprise é ilimitado. Para treinamento paralelo adicional, use o treinamento remoto a partir de várias máquinas.

Link to this sectionO que acontece se o treinamento falhar?#

Se o treinamento falhar:

- O modelo é marcado como falho e a instância de computação é encerrada

- Podes iniciar uma nova execução de treino a partir do modelo base

- Créditos são cobrados apenas pelo tempo de processamento concluído

Link to this sectionComo escolho a GPU certa?#

| Cenário | GPU Recomendada |

|---|---|

| A maioria dos trabalhos de treinamento | RTX PRO 6000 |

| Grandes conjuntos de dados ou tamanhos de lote | H100 SXM ou H200 |

| Orçamento limitado | RTX 4090 |