Link to this section手部关键点数据集#

Link to this section介绍#

手部关键点数据集包含 26,768 张标注了关键点的手部图像,非常适合训练 Ultralytics YOLO 等模型进行姿态估计任务。这些标注是使用 Google MediaPipe 库生成的,确保了高准确性和一致性,且该数据集与 Ultralytics YOLO26 格式兼容。

Watch: Hand Keypoints Estimation with Ultralytics YOLO26 | Human Hand Pose Estimation Tutorial

Link to this section手部地标#

Link to this sectionKeypoints#

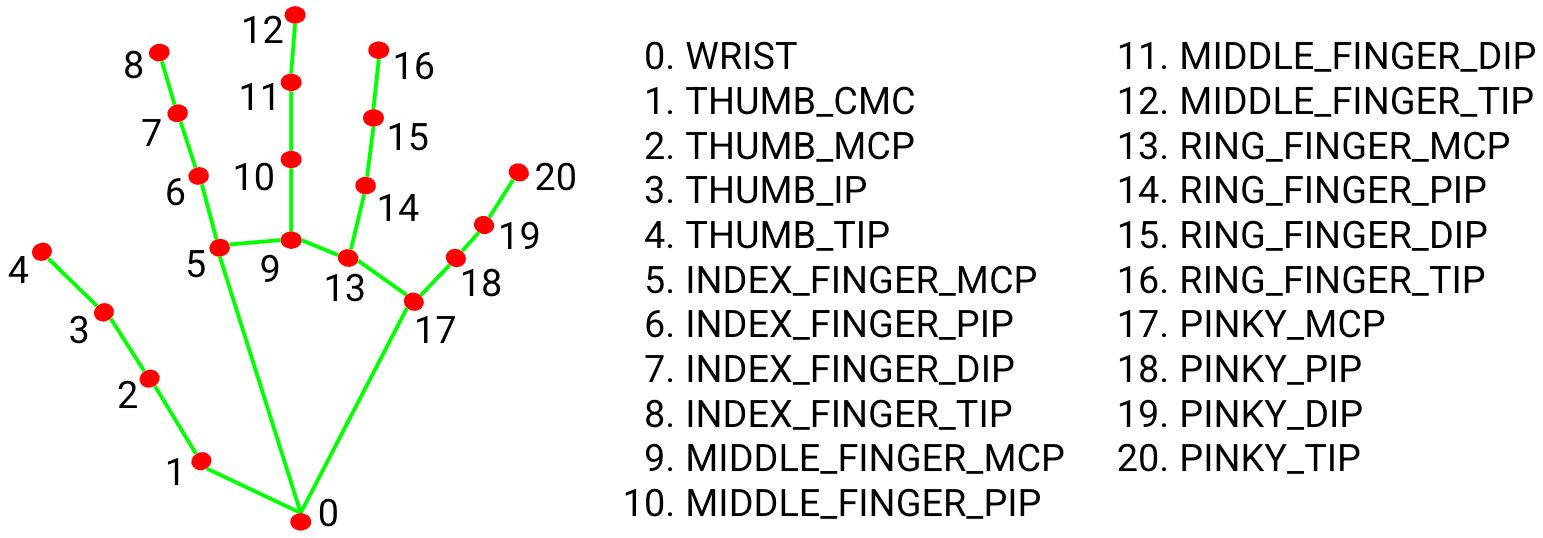

该数据集包含用于手部检测的关键点。关键点标注如下:

- 手腕

- 拇指(4 个点)

- 食指(4 个点)

- 中指(4 个点)

- 无名指(4 个点)

- 小指(4 个点)

每只手总共有 21 个关键点。

Link to this section主要特性#

- 大型数据集:包含 26,768 张带有手部关键点标注的图像。

- YOLO26 兼容性:标签以 YOLO 关键点格式提供,可直接用于 YOLO26 模型。

- 21 个关键点:详细的手部姿态表示,涵盖手腕和每根手指的四个点。

Link to this section数据集结构#

手部关键点数据集分为两个子集:

- Train:此子集包含来自手部关键点数据集的 18,776 张图像,已标注用于训练姿态估计模型。

- Val:此子集包含 7,992 张图像,可在模型训练期间用于验证。

Link to this section应用场景#

手部关键点可用于手势识别、AR/VR 控制、机器人操作以及医疗保健中的手部运动分析。它们还可应用于动画中的动作捕捉以及安全领域的生物特征认证系统。通过对手指位置的详细追踪,能够实现与虚拟对象的精确交互以及非接触式控制界面。

Link to this section数据集 YAML#

YAML(Yet Another Markup Language)文件用于定义数据集配置。它包含有关数据集路径、类别以及其他相关信息。对于手部关键点数据集,hand-keypoints.yaml 文件托管在 https://github.com/ultralytics/ultralytics/blob/main/ultralytics/cfg/datasets/hand-keypoints.yaml。

# Ultralytics 🚀 AGPL-3.0 License - https://ultralytics.com/license

# Hand Keypoints dataset by Ultralytics

# Documentation: https://docs.ultralytics.com/datasets/pose/hand-keypoints/

# Example usage: yolo train data=hand-keypoints.yaml

# parent

# ├── ultralytics

# └── datasets

# └── hand-keypoints ← downloads here (369 MB)

# Train/val/test sets as 1) dir: path/to/imgs, 2) file: path/to/imgs.txt, or 3) list: [path/to/imgs1, path/to/imgs2, ..]

path: hand-keypoints # dataset root dir

train: images/train # train images (relative to 'path') 18776 images

val: images/val # val images (relative to 'path') 7992 images

# Keypoints

kpt_shape: [21, 3] # number of keypoints, number of dims (2 for x,y or 3 for x,y,visible)

flip_idx: [0, 1, 2, 4, 3, 10, 11, 12, 13, 14, 5, 6, 7, 8, 9, 15, 16, 17, 18, 19, 20]

# Classes

names:

0: hand

# Keypoint names per class

kpt_names:

0:

- wrist

- thumb_cmc

- thumb_mcp

- thumb_ip

- thumb_tip

- index_mcp

- index_pip

- index_dip

- index_tip

- middle_mcp

- middle_pip

- middle_dip

- middle_tip

- ring_mcp

- ring_pip

- ring_dip

- ring_tip

- pinky_mcp

- pinky_pip

- pinky_dip

- pinky_tip

# Download script/URL (optional)

download: https://github.com/ultralytics/assets/releases/download/v0.0.0/hand-keypoints.zipLink to this section使用方法#

要在手部关键点数据集上训练 YOLO26n-pose 模型 100 个 epoch,图像尺寸设为 640,你可以使用以下代码片段。有关可用参数的完整列表,请参阅模型 Training 页面。

from ultralytics import YOLO

# Load a model

model = YOLO("yolo26n-pose.pt") # load a pretrained model (recommended for training)

# Train the model

results = model.train(data="hand-keypoints.yaml", epochs=100, imgsz=640)Link to this section样本图像和标注#

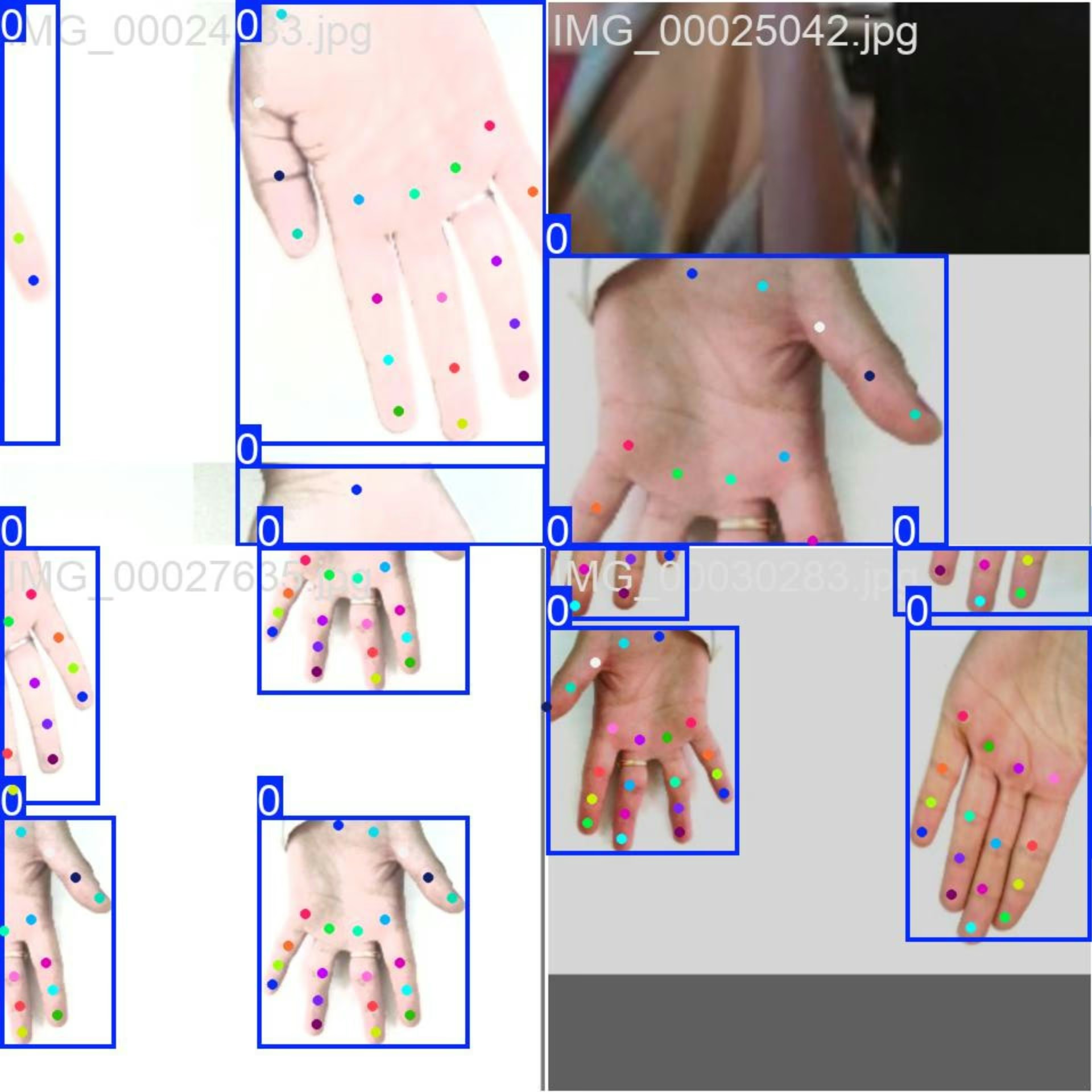

手部关键点数据集包含各种各样标注了关键点的人手图像。以下是来自该数据集的图像示例,以及它们对应的标注:

- 马赛克图像:此图像展示了由马赛克数据集图像组成的训练批次。马赛克是一种在训练期间使用的技术,它将多张图像合并为单张图像,以增加每个训练批次中目标和场景的多样性。这有助于提高模型对不同目标尺寸、长宽比和上下文的泛化能力。

该示例展示了手部关键点数据集中图像的多样性和复杂性,以及在训练过程中使用马赛克增强的好处。

Link to this section引文与致谢#

如果你在研究或开发工作中使用了手部关键点数据集,请注明以下来源:

我们要感谢以下来源提供此数据集中使用的图像:

这些图像是在各平台提供的相应许可下收集和使用的,并根据 知识共享署名-非商业性使用-相同方式共享 4.0 国际许可协议 进行分发。

我们还要感谢该数据集的创建者 Rion Dsilva,感谢他对视觉 AI 研究的杰出贡献。

Link to this section常见问题 (FAQ)#

Link to this section如何使用手部关键点数据集训练 YOLO26 模型?#

要使用手部关键点数据集训练 YOLO26 模型,你可以使用 Python 或命令行界面 (CLI)。以下是训练 YOLO26n-pose 模型 100 个 epoch,图像尺寸为 640 的示例:

from ultralytics import YOLO

# Load a model

model = YOLO("yolo26n-pose.pt") # load a pretrained model (recommended for training)

# Train the model

results = model.train(data="hand-keypoints.yaml", epochs=100, imgsz=640)有关可用参数的完整列表,请参考模型 Training 页面。

Link to this section手部关键点数据集的主要特点是什么?#

手部关键点数据集专为高级姿态估计任务而设计,包含以下几个主要特点:

- 大型数据集:包含 26,768 张带有手部关键点标注的图像。

- YOLO26 兼容性:可直接用于 YOLO26 模型。

- 21 个关键点:详细的手部姿态表示,包括手腕和手指关节。

有关更多详细信息,你可以浏览手部关键点数据集部分。

Link to this section哪些应用可以从使用手部关键点数据集中受益?#

手部关键点数据集可应用于多个领域,包括:

- 手势识别:增强人机交互。

- AR/VR 控制:改善增强现实和虚拟现实中的用户体验。

- 机器人操作:实现对机械手的精确控制。

- 医疗保健:分析手部动作以进行医学诊断。

- 动画:捕捉动作以制作逼真的动画。

- 生物特征认证:增强安全系统。

有关更多信息,请参阅应用部分。

Link to this section手部关键点数据集是如何构建的?#

手部关键点数据集分为两个子集:

- Train:包含 18,776 张图像,用于训练姿态估计模型。

- Val:包含 7,992 张图像,可在模型训练期间用于验证。

这种结构确保了全面的训练和验证过程。有关更多详细信息,请参阅数据集结构部分。

Link to this section如何使用数据集 YAML 文件进行训练?#

数据集配置定义在 YAML 文件中,该文件包含路径、类别以及其他相关信息。hand-keypoints.yaml 文件可以在 hand-keypoints.yaml 找到。

要使用此 YAML 文件进行训练,请在训练脚本或 CLI 命令中指定它,如上面的训练示例所示。有关更多详细信息,请参阅数据集 YAML 部分。