Link to this sectionModelltraining#

Die Ultralytics Platform bietet umfassende Tools für das Training von YOLO-Modellen, von der Organisation von Experimenten bis hin zur Ausführung von Cloud-Trainingsjobs mit Echtzeit-Metrik-Streaming.

Watch: Get Started with Ultralytics Platform - Train

Link to this sectionÜbersicht#

Der Trainingsbereich hilft dir dabei:

- Modelle in Projekten zur einfacheren Verwaltung zu organisieren

- Auf Cloud-GPUs mit einem Klick zu trainieren

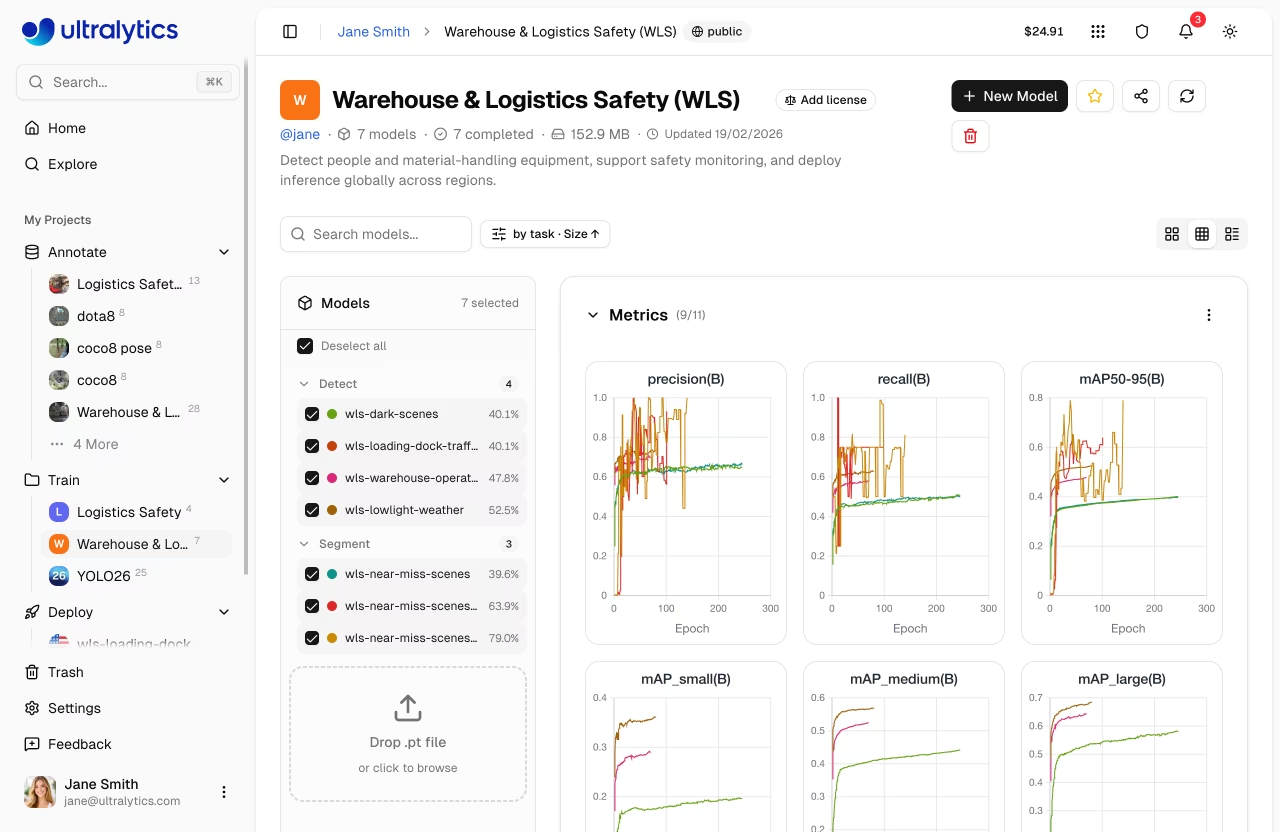

- Echtzeit-Metriken während des Trainings zu überwachen

- Modellleistung über Experimente hinweg zu vergleichen

- In über 19 Deployment-Formate zu exportieren (siehe unterstützte Formate)

Link to this sectionWorkflow#

graph LR

A[📁 Project] --> B[⚙️ Configure]

B --> C[🚀 Train]

C --> D[📈 Monitor]

D --> E[📦 Export]

style A fill:#4CAF50,color:#fff

style B fill:#2196F3,color:#fff

style C fill:#FF9800,color:#fff

style D fill:#9C27B0,color:#fff

style E fill:#00BCD4,color:#fff| Phase | Beschreibung |

|---|---|

| Projekt | Erstelle einen Arbeitsbereich, um zusammengehörige Modelle zu organisieren |

| Konfigurieren | Wähle Datensatz, Basismodell und Trainingsparameter aus |

| Trainieren | Führe das Training auf Cloud-GPUs oder deiner lokalen Hardware aus |

| Überwachen | Sieh dir Echtzeit-Verlustkurven und Metriken an |

| Exportieren | Konvertiere in über 19 Deployment-Formate (Details) |

Link to this sectionTrainingsoptionen#

Die Ultralytics Platform unterstützt mehrere Trainingsansätze:

| Methode | Beschreibung | Am besten für |

|---|---|---|

| Cloud-Training | Trainiere auf Ultralytics Cloud GPUs | Keine lokale GPU, Skalierbarkeit |

| Lokales Training | Trainiere lokal, streame Metriken an die Plattform | Vorhandene Hardware, Datenschutz |

| Colab-Training | Nutze Google Colab mit Plattform-Integration | Kostenloser GPU-Zugang |

Link to this sectionGPU-Optionen#

Verfügbare GPUs für das Cloud-Training auf der Ultralytics Cloud:

| GPU | Generation | VRAM | Kosten/Stunde | Am besten für |

|---|---|---|---|---|

| RTX 2000 Ada | Ada | 16 GB | $0.24 | Kleine Datensätze, Tests |

| RTX A4500 | Ampere | 20 GB | $0.25 | Kleine bis mittlere Datensätze |

| RTX 4000 Ada | Ada | 20 GB | $0.26 | Mittlere Datensätze |

| RTX A5000 | Ampere | 24 GB | $0.27 | Mittlere Datensätze |

| L4 | Ada | 24 GB | $0.39 | Optimiert für Inferenz |

| A40 | Ampere | 48 GB | $0.44 | Größere Batch-Größen |

| RTX 3090 | Ampere | 24 GB | $0.46 | Allgemeines Training |

| RTX A6000 | Ampere | 48 GB | $0.49 | Große Modelle |

| RTX PRO 4500 | Blackwell | 32 GB | $0.64 | Großartiges Preis-Leistungs-Verhältnis |

| RTX 4090 | Ada | 24 GB | $0.69 | Bestes Preis-Leistungs-Verhältnis |

| RTX 6000 Ada | Ada | 48 GB | $0.77 | Training mit großen Batches |

| L40S | Ada | 48 GB | $0.86 | Training mit großen Batches |

| RTX 5090 | Blackwell | 32 GB | $0.99 | Neueste Consumer-Generation |

| L40 | Ada | 48 GB | $0.99 | Große Modelle |

| A100 PCIe | Ampere | 80 GB | $1.39 | Produktionstraining |

| A100 SXM | Ampere | 80 GB | $1.49 | Produktionstraining |

| RTX PRO 6000 | Blackwell | 96 GB | $1.89 | Empfohlener Standard |

| H100 PCIe | Hopper | 80 GB | $2.39 | Hochleistungstraining |

| H100 SXM | Hopper | 80 GB | $2.99 | Schnellstes Training |

| H100 NVL | Hopper | 94 GB | 3,07 $ | Maximale Leistung |

| H200 NVL | Hopper | 143 GB | 3,39 $ | Maximaler Speicher |

| H200 SXM | Hopper | 141 GB | 3,99 $ | Maximale Leistung |

| B200 | Blackwell | 180 GB | 5,49 $ | Große Modelle (Pro+) |

| B300 | Blackwell | 288 GB | 7,39 $ | Größte Modelle (Pro+) |

B200- und B300-GPUs erfordern einen Pro- oder Enterprise-Plan. Alle anderen GPUs sind in allen Plänen einschließlich Free verfügbar.

Neue Konten erhalten ein Startguthaben für das Training. Details findest du unter Abrechnung.

Link to this sectionEchtzeit-Metriken#

Während des Trainings kannst du Live-Metriken in drei Unterreitern einsehen:

graph LR

A[Charts] --> B[Loss Curves]

A --> C[Performance Metrics]

D[Console] --> E[Live Logs]

D --> F[Error Detection]

G[System] --> H[GPU Utilization]

G --> I[Memory & Temp]

style A fill:#2196F3,color:#fff

style D fill:#FF9800,color:#fff

style G fill:#9C27B0,color:#fff| Unter-Reiter | Metriken |

|---|---|

| Diagramme | Box/Klasse/DFL-Loss, mAP50, mAP50-95, Präzision, Recall |

| Konsole | Live-Trainingsprotokolle mit ANSI-Farben und Fehlererkennung |

| System | GPU-Auslastung, Speicher, Temperatur, CPU, Festplatte |

Beim Cloud-Training wird das beste Modell (best.pt, der Checkpoint mit dem höchsten mAP) automatisch gespeichert und nach Abschluss des Trainings zum Download, Export und Deployment bereitgestellt.

Link to this sectionKurzanleitung#

Starte dein Cloud-Training in unter einer Minute:

- Erstelle ein Projekt in der Seitenleiste

- Klicke auf Neues Modell

- Wähle ein Modell, einen Datensatz und eine GPU aus

- Klicke auf Training starten

Link to this sectionSchnellzugriff#

- Projekte: Organisiere deine Modelle und Experimente

- Modelle: Verwalte trainierte Checkpoints

- Cloud-Training: Trainiere auf Cloud-GPUs

Link to this sectionFAQ#

Link to this sectionWie lange dauert das Training?#

Die Trainingsdauer hängt ab von:

- Datensatzgröße (Anzahl der Bilder)

- Modellgröße (n, s, m, l, x)

- Anzahl der Epochen

- Ausgewählter GPU-Typ

Ein typischer Trainingslauf mit 1000 Bildern, YOLO26n und 100 Epochen auf einer RTX PRO 6000 dauert etwa 5-10 Minuten. Kleinere Läufe (500 Bilder, 50 Epochen auf RTX 4090) sind in unter einer Stunde abgeschlossen. Siehe Kostenbeispiele für detaillierte Schätzungen.

Link to this sectionKann ich mehrere Modelle gleichzeitig trainieren?#

Ja. Die Anzahl der gleichzeitigen Cloud-Trainings hängt von deinem Plan ab: Free erlaubt 3, Pro erlaubt 10, und Enterprise ist unbegrenzt. Für zusätzliches paralleles Training kannst du das Remote-Training von mehreren Maschinen aus nutzen.

Link to this sectionWas passiert, wenn das Training fehlschlägt?#

Wenn das Training fehlschlägt:

- Das Modell wird als fehlgeschlagen markiert und die Compute-Instanz wird beendet

- Du kannst einen neuen Trainingsdurchlauf ausgehend vom Basismodell starten

- Guthaben wird nur für die tatsächlich genutzte Rechenzeit berechnet

Link to this sectionWie wähle ich die richtige GPU?#

| Szenario | Empfohlene GPU |

|---|---|

| Die meisten Trainingsaufgaben | RTX PRO 6000 |

| Große Datensätze oder Batch-Größen | H100 SXM oder H200 |

| Budgetbewusst | RTX 4090 |