Link to this sectionConjunto de datos COCO128#

Link to this sectionIntroducción#

Ultralytics COCO128 es un conjunto de datos pequeño pero versátil de detección de objetos compuesto por las primeras 128 imágenes del conjunto de entrenamiento COCO 2017. Este conjunto de datos es ideal para probar y depurar modelos de detección de objetos, o para experimentar con nuevos enfoques de detección. Con 128 imágenes, es lo suficientemente pequeño como para ser fácilmente manejable, pero lo bastante diverso como para probar los flujos de trabajo de entrenamiento en busca de errores y actuar como una comprobación de integridad antes de entrenar con conjuntos de datos más grandes.

Watch: Ultralytics COCO Dataset Overview

Este conjunto de datos está diseñado para su uso con Ultralytics Platform y YOLO26.

Link to this sectionYAML del conjunto de datos#

Se utiliza un archivo YAML (Yet Another Markup Language) para definir la configuración del conjunto de datos. Contiene información sobre las rutas, las clases y otra información relevante del conjunto de datos. En el caso del conjunto de datos COCO128, el archivo coco128.yaml se mantiene en https://github.com/ultralytics/ultralytics/blob/main/ultralytics/cfg/datasets/coco128.yaml.

# Ultralytics 🚀 AGPL-3.0 License - https://ultralytics.com/license

# COCO128 dataset https://www.kaggle.com/datasets/ultralytics/coco128 (first 128 images from COCO train2017) by Ultralytics

# Documentation: https://docs.ultralytics.com/datasets/detect/coco/

# Example usage: yolo train data=coco128.yaml

# parent

# ├── ultralytics

# └── datasets

# └── coco128 ← downloads here (7 MB)

# Train/val/test sets as 1) dir: path/to/imgs, 2) file: path/to/imgs.txt, or 3) list: [path/to/imgs1, path/to/imgs2, ..]

path: coco128 # dataset root dir

train: images/train2017 # train images (relative to 'path') 128 images

val: images/train2017 # val images (relative to 'path') 128 images

test: # test images (optional)

# Classes

names:

0: person

1: bicycle

2: car

3: motorcycle

4: airplane

5: bus

6: train

7: truck

8: boat

9: traffic light

10: fire hydrant

11: stop sign

12: parking meter

13: bench

14: bird

15: cat

16: dog

17: horse

18: sheep

19: cow

20: elephant

21: bear

22: zebra

23: giraffe

24: backpack

25: umbrella

26: handbag

27: tie

28: suitcase

29: frisbee

30: skis

31: snowboard

32: sports ball

33: kite

34: baseball bat

35: baseball glove

36: skateboard

37: surfboard

38: tennis racket

39: bottle

40: wine glass

41: cup

42: fork

43: knife

44: spoon

45: bowl

46: banana

47: apple

48: sandwich

49: orange

50: broccoli

51: carrot

52: hot dog

53: pizza

54: donut

55: cake

56: chair

57: couch

58: potted plant

59: bed

60: dining table

61: toilet

62: tv

63: laptop

64: mouse

65: remote

66: keyboard

67: cell phone

68: microwave

69: oven

70: toaster

71: sink

72: refrigerator

73: book

74: clock

75: vase

76: scissors

77: teddy bear

78: hair drier

79: toothbrush

# Download script/URL (optional)

download: https://github.com/ultralytics/assets/releases/download/v0.0.0/coco128.zipLink to this sectionUso#

Para entrenar un modelo YOLO26n en el conjunto de datos COCO128 durante 100 épocas con un tamaño de imagen de 640, puedes usar los siguientes fragmentos de código. Para obtener una lista completa de los argumentos disponibles, consulta la página de Entrenamiento del modelo.

from ultralytics import YOLO

# Load a model

model = YOLO("yolo26n.pt") # load a pretrained model (recommended for training)

# Train the model

results = model.train(data="coco128.yaml", epochs=100, imgsz=640)Link to this sectionImágenes y anotaciones de muestra#

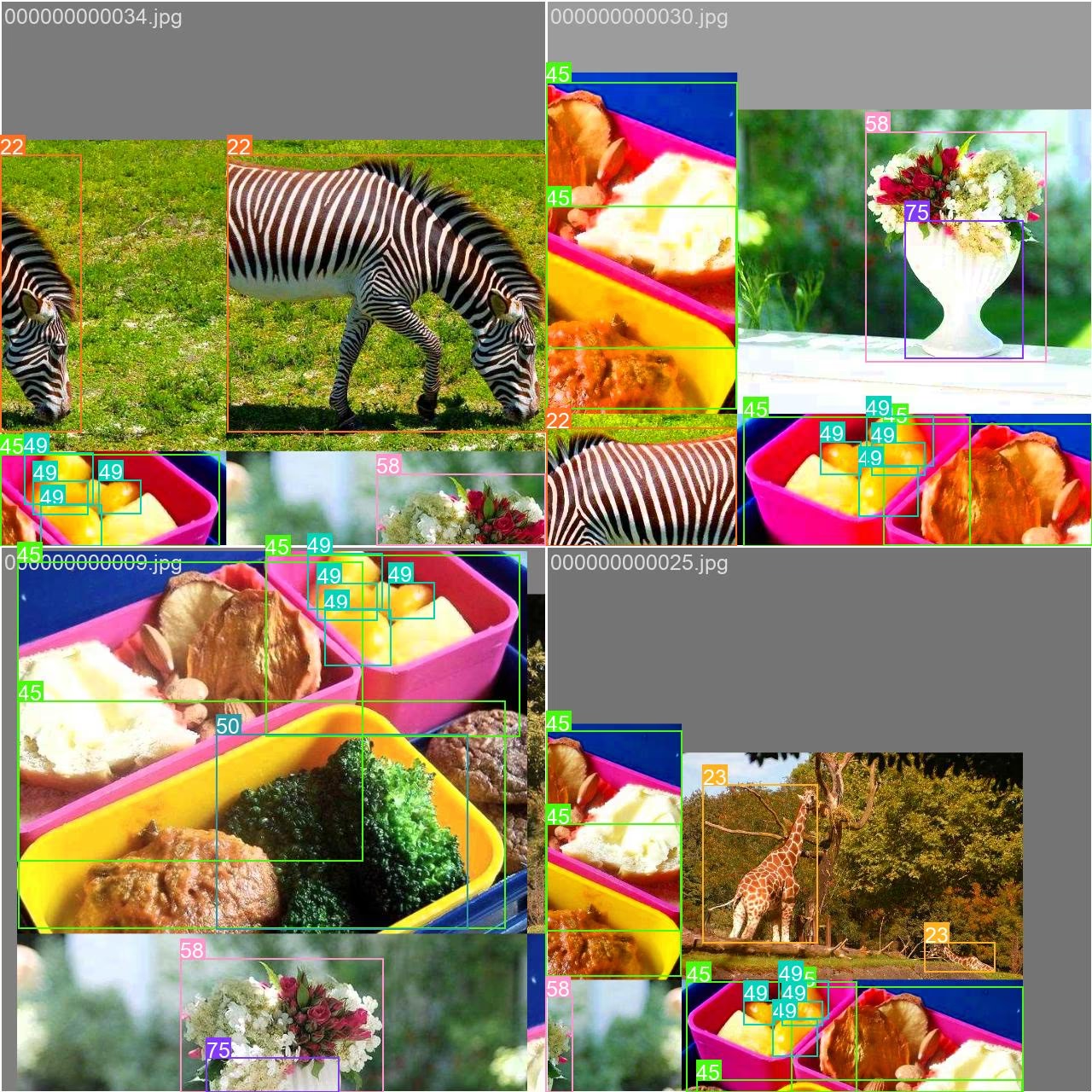

Aquí tienes algunos ejemplos de imágenes del conjunto de datos COCO128, junto con sus anotaciones correspondientes:

- Imagen en mosaico: esta imagen muestra un lote de entrenamiento compuesto por imágenes en mosaico del conjunto de datos. El mosaico es una técnica utilizada durante el entrenamiento que combina múltiples imágenes en una sola para aumentar la variedad de objetos y escenas dentro de cada lote de entrenamiento. Esto ayuda a mejorar la capacidad del modelo para generalizar a diferentes tamaños de objeto, relaciones de aspecto y contextos.

El ejemplo muestra la variedad y complejidad de las imágenes en el conjunto de datos COCO128 y los beneficios de usar mosaico (mosaicing) durante el proceso de entrenamiento.

Link to this sectionCitas y reconocimientos#

Si utilizas el conjunto de datos COCO en tu trabajo de investigación o desarrollo, por favor cita el siguiente artículo:

@misc{lin2015microsoft,

title={Microsoft COCO: Common Objects in Context},

author={Tsung-Yi Lin and Michael Maire and Serge Belongie and Lubomir Bourdev and Ross Girshick and James Hays and Pietro Perona and Deva Ramanan and C. Lawrence Zitnick and Piotr Dollár},

year={2015},

eprint={1405.0312},

archivePrefix={arXiv},

primaryClass={cs.CV}

}Nos gustaría agradecer al Consorcio COCO por crear y mantener este valioso recurso para la comunidad de visión artificial. Para obtener más información sobre el conjunto de datos COCO y sus creadores, visita el sitio web del conjunto de datos COCO.

Link to this sectionPreguntas frecuentes#

Link to this section¿Para qué se utiliza el conjunto de datos Ultralytics COCO128?#

El conjunto de datos Ultralytics COCO128 es un subconjunto compacto que contiene las primeras 128 imágenes del conjunto de datos de entrenamiento COCO 2017. Se utiliza principalmente para probar y depurar modelos de detección de objetos, experimentar con nuevos enfoques de detección y validar flujos de trabajo de entrenamiento antes de escalar a conjuntos de datos más grandes. Su tamaño manejable lo hace perfecto para iteraciones rápidas, a la vez que proporciona suficiente diversidad para ser un caso de prueba significativo.

Link to this section¿Cómo entreno un modelo YOLO26 usando el conjunto de datos COCO128?#

Para entrenar un modelo YOLO26 en el conjunto de datos COCO128, puedes usar Python o comandos de CLI. Aquí te explico cómo:

from ultralytics import YOLO

# Load a pretrained model

model = YOLO("yolo26n.pt")

# Train the model

results = model.train(data="coco128.yaml", epochs=100, imgsz=640)Para obtener más opciones y parámetros de entrenamiento, consulta la documentación de Entrenamiento.

Link to this section¿Cuáles son los beneficios de usar el aumento de mosaico (mosaic augmentation) con COCO128?#

El aumento de mosaico, como se muestra en las imágenes de muestra, combina múltiples imágenes de entrenamiento en una sola imagen compuesta. Esta técnica ofrece varios beneficios al entrenar con COCO128:

- Aumenta la variedad de objetos y contextos dentro de cada lote de entrenamiento

- Mejora la generalización del modelo en diferentes tamaños de objetos y relaciones de aspecto

- Mejora el rendimiento de detección para objetos a varias escalas

- Maximiza la utilidad de un conjunto de datos pequeño mediante la creación de muestras de entrenamiento más diversas

Esta técnica es especialmente valiosa para conjuntos de datos más pequeños como COCO128, ayudando a los modelos a aprender características más robustas a partir de datos limitados.

Link to this section¿Cómo se compara COCO128 con otras variantes del conjunto de datos COCO?#

COCO128 (128 imágenes) se sitúa entre COCO8 (8 imágenes) y el conjunto de datos COCO completo (más de 118.000 imágenes) en términos de tamaño:

- COCO8: Contiene solo 8 imágenes (4 de entrenamiento, 4 de validación), ideal para pruebas rápidas y depuración

- COCO128: Contiene 128 imágenes, equilibrado entre tamaño y diversidad

- COCO completo: Contiene más de 118.000 imágenes de entrenamiento, integral pero requiere muchos recursos

COCO128 proporciona un buen punto medio, ofreciendo más diversidad que COCO8 mientras sigue siendo mucho más manejable que el conjunto de datos COCO completo para experimentación y desarrollo inicial de modelos.

Link to this section¿Puedo usar COCO128 para otras tareas además de la detección de objetos?#

Aunque COCO128 está diseñado principalmente para la detección de objetos, las anotaciones del conjunto de datos se pueden adaptar para otras tareas de visión artificial:

- Segmentación de instancias: Usando las máscaras de segmentación proporcionadas en las anotaciones

- Detección de puntos clave (keypoints): Para imágenes que contienen personas con anotaciones de puntos clave

- Aprendizaje por transferencia (transfer learning): Como punto de partida para ajustar modelos para tareas personalizadas

Para tareas especializadas como la segmentación, considera el uso de variantes creadas específicamente como COCO8-seg, que incluyen las anotaciones apropiadas.