Link to this sectionDespliegue#

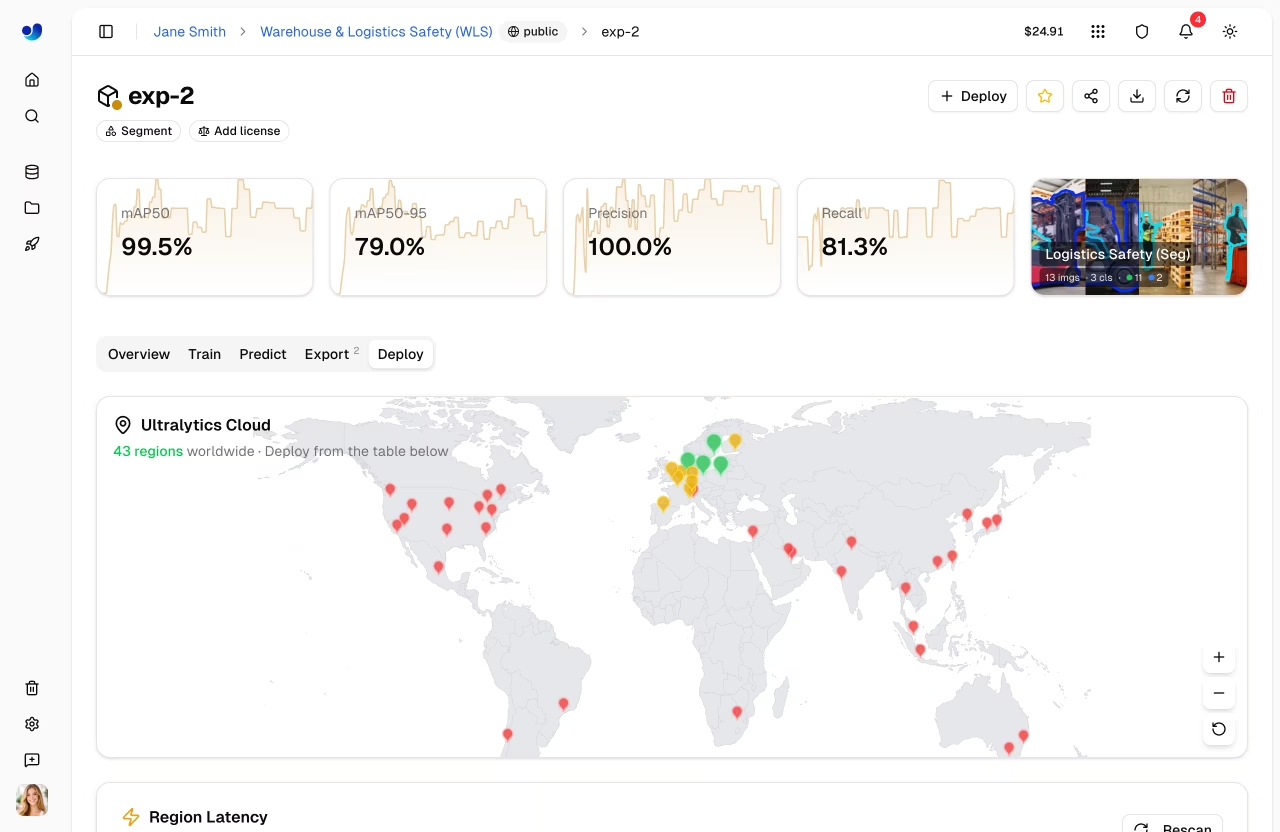

Ultralytics Platform ofrece completas opciones de despliegue para poner tus modelos YOLO en producción. Prueba modelos mediante inferencia en el navegador, despliega en puntos de conexión dedicados en 43 regiones globales y supervisa el rendimiento en tiempo real.

Watch: Get Started with Ultralytics Platform - Deploy

Link to this sectionDescripción general#

La sección de Despliegue te ayuda a:

- Probar modelos directamente en el navegador con la pestaña

Predict - Desplegar en puntos de conexión dedicados en 43 regiones globales

- Supervisar métricas de peticiones, registros y comprobaciones de estado

- Escalar a cero cuando esté inactivo (los despliegues ejecutan actualmente una única instancia activa)

Link to this sectionOpciones de despliegue#

Ultralytics Platform ofrece múltiples rutas de despliegue:

| Opción | Descripción | Ideal para |

|---|---|---|

| Pestaña Predict | Inferencia basada en navegador con imágenes, webcam y ejemplos | Desarrollo, validación |

| Inferencia compartida | Servicio multiinquilino en 3 regiones | Uso ligero, pruebas |

| Puntos de conexión dedicados | Servicios de inquilino único en 43 regiones | Producción, baja latencia |

Link to this sectionFlujo de trabajo#

graph LR

A[✅ Test] --> B[⚙️ Configure]

B --> C[🌐 Deploy]

C --> D[📊 Monitor]

style A fill:#4CAF50,color:#fff

style B fill:#2196F3,color:#fff

style C fill:#FF9800,color:#fff

style D fill:#9C27B0,color:#fff| Etapa | Descripción |

|---|---|

| Probar | Valida el modelo con la pestaña Predict |

| Configurar | Selecciona la región y el nombre del despliegue (los despliegues usan recursos predeterminados fijos) |

| Deploy (Desplegar) | Crea un punto de conexión dedicado desde la pestaña Deploy |

| Monitorizar | Realiza el seguimiento de peticiones, latencia, errores y registros en Monitoring |

Link to this sectionArquitectura#

Link to this sectionInferencia compartida#

El servicio de inferencia compartida se ejecuta en 3 regiones clave, dirigiendo automáticamente las peticiones según tu región de datos:

graph TB

User[User Request] --> API[Platform API]

API --> Router{Region Router}

Router -->|US users| US["US Predict Service<br/>Iowa"]

Router -->|EU users| EU["EU Predict Service<br/>Belgium"]

Router -->|AP users| AP["AP Predict Service<br/>Taiwan"]

style User fill:#f5f5f5,color:#333

style API fill:#2196F3,color:#fff

style Router fill:#FF9800,color:#fff

style US fill:#4CAF50,color:#fff

style EU fill:#4CAF50,color:#fff

style AP fill:#4CAF50,color:#fff| Región | Ubicación |

|---|---|

| EE. UU. | Iowa, EE. UU. |

| UE | Bélgica, Europa |

| AP | Taiwán, Asia-Pacífico |

Link to this sectionPuntos de conexión dedicados#

Despliega en 43 regiones de todo el mundo en Ultralytics Cloud:

- América: 14 regiones

- Europa: 13 regiones

- Asia-Pacífico: 12 regiones

- Oriente Medio y África: 4 regiones

Cada punto de conexión es un servicio de inquilino único con:

- Recursos predeterminados de

1 CPU,2 GiBde memoria,minInstances=0,maxInstances=1 - Escalado a cero cuando esté inactivo

- URL de punto de conexión única

- Supervisión, registros y comprobaciones de estado independientes

Link to this sectionPágina de despliegues#

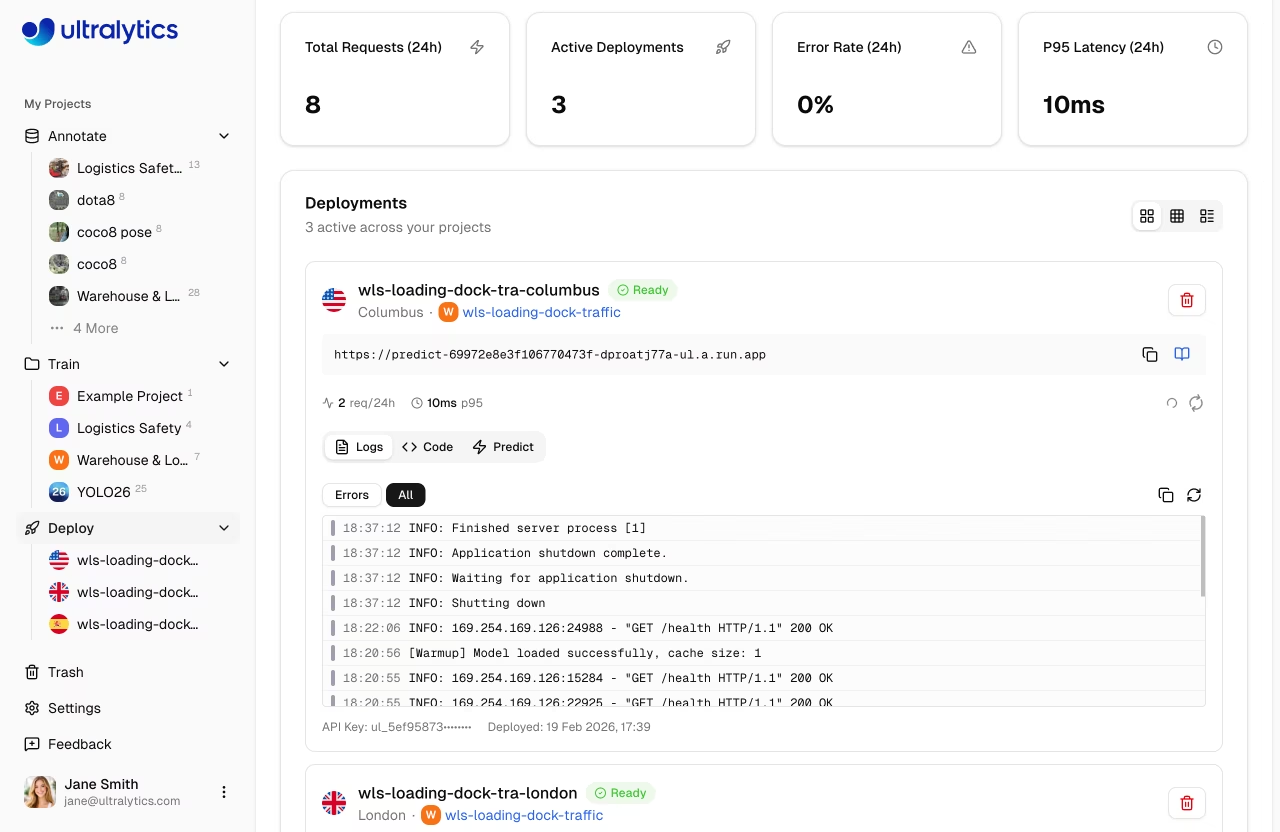

Accede a la página de despliegues globales desde la barra lateral en Deploy. Esta página muestra:

- Mapa mundial con chinchetas de regiones desplegadas (mapa interactivo)

- Tarjetas de resumen: Peticiones totales (24 h), Despliegues activos, Tasa de errores (24 h), Latencia P95 (24 h)

- Lista de despliegues con tres modos de visualización: tarjetas, compacto y tabla

- Botón Nuevo despliegue para crear puntos de conexión desde cualquier modelo completado

La página realiza sondeos cada 15 segundos normalmente. Cuando los despliegues están en un estado de transición (creating, deploying o stopping), el sondeo aumenta a cada 3 segundos para una respuesta más rápida.

Link to this sectionCaracterísticas clave#

Link to this sectionCobertura global#

Despliega cerca de tus usuarios con 43 regiones que cubren:

- Norteamérica, Sudamérica

- Europa, Oriente Medio, África

- Asia Pacífico, Oceanía

Link to this sectionComportamiento de escalado#

Los puntos de conexión funcionan actualmente de la siguiente manera:

- Escalado a cero: Sin coste cuando está inactivo (predeterminado)

- Única instancia activa:

maxInstancesestá limitado actualmente a1en todos los planes

El escalado a cero está habilitado por defecto (instancias mínimas = 0). Solo pagas por el tiempo de inferencia activo.

Link to this sectionBaja latencia#

Los puntos de conexión dedicados ofrecen:

- Arranque en frío: ~5-15 segundos (contenedor en caché), hasta ~45 segundos (primer despliegue)

- Inferencia en caliente: 50-200 ms (depende del modelo)

- Enrutamiento regional para un rendimiento óptimo

Link to this sectionComprobaciones de estado#

Cada despliegue en ejecución incluye una comprobación de estado automática con:

- Indicador de estado en vivo (saludable/no saludable)

- Visualización de la latencia de respuesta

- Reintento automático cuando no es saludable (sondea cada 20 segundos)

- Botón de actualización manual

Link to this sectionInicio rápido#

Despliega un modelo en menos de 2 minutos:

- Entrena o carga un modelo en un proyecto

- Ve a la pestaña Deploy del modelo

- Selecciona una región de la tabla de latencia

- Haz clic en Deploy: tu punto de conexión está activo

Model → Deploy tab → Select region → Click Deploy → Endpoint URL ready

Una vez desplegado, utiliza la URL del punto de conexión con tu clave de API para enviar peticiones de inferencia desde cualquier aplicación.

Link to this sectionEnlaces rápidos#

- Inferencia: Prueba modelos en el navegador

- Puntos de conexión: Despliega puntos de conexión dedicados

- Supervisión: Realiza el seguimiento del rendimiento del despliegue

Link to this sectionFAQ#

Link to this section¿Cuál es la diferencia entre la inferencia compartida y la dedicada?#

| Característica | Compartida | Dedicada |

|---|---|---|

| Latencia | Variable | Consistente |

| Coste | Gratuito (incluido) | Gratuito (básico), basado en el uso (avanzado) |

| Escalado | Limitado | Escalado a cero, instancia única |

| Regiones | 3 | 43 |

| URL | Genérica | Personalizado |

| Tasa | 20 pet./min | 20 pet./min a través de la Plataforma; ilimitado en la URL del endpoint directo |

Link to this section¿Cuánto tarda el despliegue?#

El despliegue de un endpoint dedicado suele tardar entre 1 y 2 minutos:

- Extracción de la imagen (~30 s)

- Inicio del contenedor (~30 s)

- Comprobación de estado (~30 s)

Link to this section¿Puedo desplegar varios modelos?#

Yes, each model can have multiple endpoints in different regions. Deployment counts are limited by plan: Free 3, Pro 10, Enterprise unlimited.

Link to this section¿Qué ocurre cuando un endpoint está inactivo?#

Con el escalado a cero activado:

- El endpoint se reduce tras un periodo de inactividad

- La primera petición activa un arranque en frío

- Las peticiones posteriores son rápidas

Las primeras peticiones tras un periodo de inactividad activan un arranque en frío.