Link to this sectionEntrenamiento de modelos#

Ultralytics Platform proporciona herramientas integrales para entrenar modelos YOLO, desde la organización de experimentos hasta la ejecución de trabajos de entrenamiento en la nube con transmisión de métricas en tiempo real.

Watch: Get Started with Ultralytics Platform - Train

Link to this sectionDescripción general#

La sección de Entrenamiento te ayuda a:

- Organizar modelos en proyectos para una gestión más sencilla

- Entrenar en GPU en la nube con un solo clic

- Monitorizar métricas en tiempo real durante el entrenamiento

- Comparar el rendimiento de los modelos entre experimentos

- Exportar a más de 19 formatos de despliegue (consulta los formatos compatibles)

Link to this sectionFlujo de trabajo#

graph LR

A[📁 Project] --> B[⚙️ Configure]

B --> C[🚀 Train]

C --> D[📈 Monitor]

D --> E[📦 Export]

style A fill:#4CAF50,color:#fff

style B fill:#2196F3,color:#fff

style C fill:#FF9800,color:#fff

style D fill:#9C27B0,color:#fff

style E fill:#00BCD4,color:#fff| Etapa | Descripción |

|---|---|

| Proyecto | Crea un espacio de trabajo para organizar modelos relacionados |

| Configurar | Selecciona el dataset, el modelo base y los parámetros de entrenamiento |

| Entrenar | Ejecuta en GPU en la nube o en tu hardware local |

| Monitorizar | Visualiza curvas de pérdida y métricas en tiempo real |

| Exportar | Convierte a más de 19 formatos de despliegue (detalles) |

Link to this sectionOpciones de entrenamiento#

Ultralytics Platform admite varios enfoques de entrenamiento:

| Método | Descripción | Ideal para |

|---|---|---|

| Entrenamiento en la nube | Entrena en las GPU en la nube de Ultralytics | Sin GPU local, escalabilidad |

| Entrenamiento local | Entrena localmente, transmite métricas a la plataforma | Hardware existente, privacidad |

| Entrenamiento en Colab | Usa Google Colab con integración en la plataforma | Acceso gratuito a GPU |

Link to this sectionOpciones de GPU#

GPU disponibles para el entrenamiento en la nube de Ultralytics Cloud:

| GPU | Generación | VRAM | Coste/hora | Ideal para |

|---|---|---|---|---|

| RTX 2000 Ada | Ada | 16 GB | $0.24 | Datasets pequeños, pruebas |

| RTX A4500 | Ampere | 20 GB | $0.25 | Datasets pequeños a medianos |

| RTX 4000 Ada | Ada | 20 GB | $0.26 | Datasets medianos |

| RTX A5000 | Ampere | 24 GB | $0.27 | Datasets medianos |

| L4 | Ada | 24 GB | $0.39 | Optimizado para inferencia |

| A40 | Ampere | 48 GB | $0.44 | Tamaños de lote más grandes |

| RTX 3090 | Ampere | 24 GB | $0.46 | Entrenamiento general |

| RTX A6000 | Ampere | 48 GB | $0.49 | Modelos grandes |

| RTX PRO 4500 | Blackwell | 32 GB | $0.64 | Gran relación precio/rendimiento |

| RTX 4090 | Ada | 24 GB | $0.69 | Mejor relación precio/rendimiento |

| RTX 6000 Ada | Ada | 48 GB | $0.77 | Entrenamiento con lotes grandes |

| L40S | Ada | 48 GB | $0.86 | Entrenamiento con lotes grandes |

| RTX 5090 | Blackwell | 32 GB | $0.99 | Última generación de consumo |

| L40 | Ada | 48 GB | $0.99 | Modelos grandes |

| A100 PCIe | Ampere | 80 GB | $1.39 | Entrenamiento de producción |

| A100 SXM | Ampere | 80 GB | $1.49 | Entrenamiento de producción |

| RTX PRO 6000 | Blackwell | 96 GB | $1.89 | Predeterminado recomendado |

| H100 PCIe | Hopper | 80 GB | $2.39 | Entrenamiento de alto rendimiento |

| H100 SXM | Hopper | 80 GB | $2.99 | Entrenamiento más rápido |

| H100 NVL | Hopper | 94 GB | 3,07 $ | Máximo rendimiento |

| H200 NVL | Hopper | 143 GB | 3,39 $ | Máxima memoria |

| H200 SXM | Hopper | 141 GB | 3,99 $ | Máximo rendimiento |

| B200 | Blackwell | 180 GB | 5,49 $ | Modelos grandes (Pro+) |

| B300 | Blackwell | 288 GB | 7,39 $ | Modelos más grandes (Pro+) |

Las GPU B200 y B300 requieren un plan Pro o Enterprise. El resto de las GPU están disponibles en todos los planes, incluido el gratuito.

Las cuentas nuevas reciben créditos de registro para el entrenamiento. Consulta Facturación para más detalles.

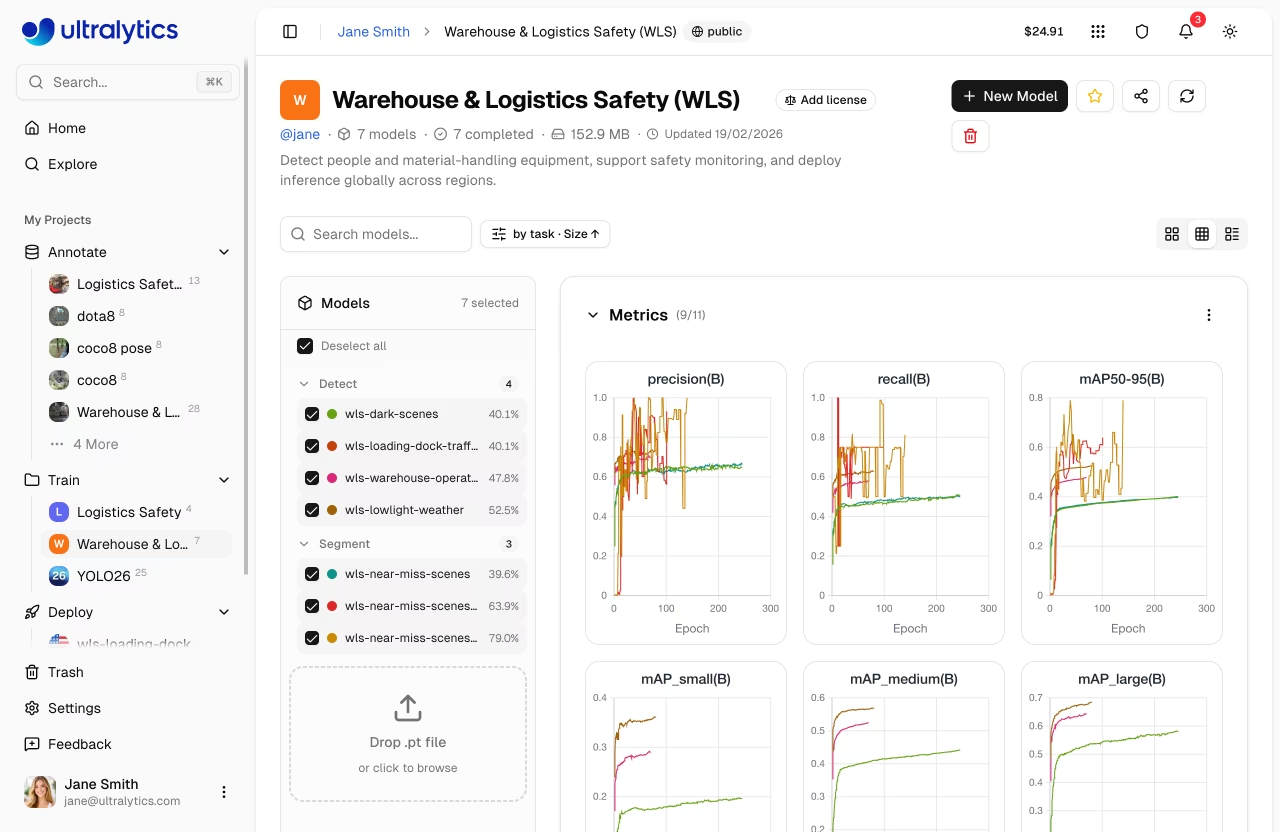

Link to this sectionMétricas en tiempo real#

Durante el entrenamiento, visualiza métricas en directo en tres subpestanas:

graph LR

A[Charts] --> B[Loss Curves]

A --> C[Performance Metrics]

D[Console] --> E[Live Logs]

D --> F[Error Detection]

G[System] --> H[GPU Utilization]

G --> I[Memory & Temp]

style A fill:#2196F3,color:#fff

style D fill:#FF9800,color:#fff

style G fill:#9C27B0,color:#fff| Subpestana | Métricas |

|---|---|

| Gráficos | Pérdida de BBox/clase/DFL, mAP50, mAP50-95, precisión, recall |

| Consola | Registros de entrenamiento en directo con color ANSI y detección de errores |

| Sistema | Utilización de GPU, memoria, temperatura, CPU, disco |

Para el entrenamiento en la nube, el mejor modelo (best.pt, el punto de control con mayor mAP) se guarda automáticamente y está disponible para descarga, exportación y despliegue una vez completado el entrenamiento.

Link to this sectionInicio rápido#

Empieza con el entrenamiento en la nube en menos de un minuto:

- Crea un proyecto en la barra lateral

- Haz clic en Nuevo modelo

- Selecciona un modelo, un conjunto de datos y una GPU

- Haz clic en Iniciar entrenamiento

Link to this sectionEnlaces rápidos#

- Proyectos: Organiza tus modelos y experimentos

- Modelos: Gestiona puntos de control entrenados

- Entrenamiento en la nube: Entrena con GPU en la nube

Link to this sectionFAQ#

Link to this section¿Cuánto tarda el entrenamiento?#

El tiempo de entrenamiento depende de:

- Tamaño del conjunto de datos (número de imágenes)

- Tamaño del modelo (n, s, m, l, x)

- Número de épocas

- Tipo de GPU seleccionado

Una ejecución de entrenamiento típica con 1000 imágenes, YOLO26n, 100 épocas en una RTX PRO 6000 tarda unos 5-10 minutos. Las ejecuciones más pequeñas (500 imágenes, 50 épocas en una RTX 4090) se completan en menos de una hora. Consulta los ejemplos de costes para ver estimaciones detalladas.

Link to this section¿Puedo entrenar varios modelos simultáneamente?#

Sí. Los límites de entrenamiento en la nube concurrente dependen de tu plan: Free permite 3, Pro permite 10 y Enterprise es ilimitado. Para un entrenamiento paralelo adicional, utiliza el entrenamiento remoto desde múltiples máquinas.

Link to this section¿Qué ocurre si el entrenamiento falla?#

Si el entrenamiento falla:

- El modelo se marca como fallido y la instancia de computación se termina

- Puedes iniciar una nueva ejecución de entrenamiento desde el modelo base

- Los créditos solo se cobran por el tiempo de cómputo completado

Link to this section¿Cómo elijo la GPU adecuada?#

| Escenario | GPU recomendada |

|---|---|

| La mayoría de los trabajos de entrenamiento | RTX PRO 6000 |

| Grandes conjuntos de datos o tamaños de lote | H100 SXM o H200 |

| Presupuesto ajustado | RTX 4090 |