Link to this sectionTareas de visión artificial compatibles con Ultralytics YOLO26#

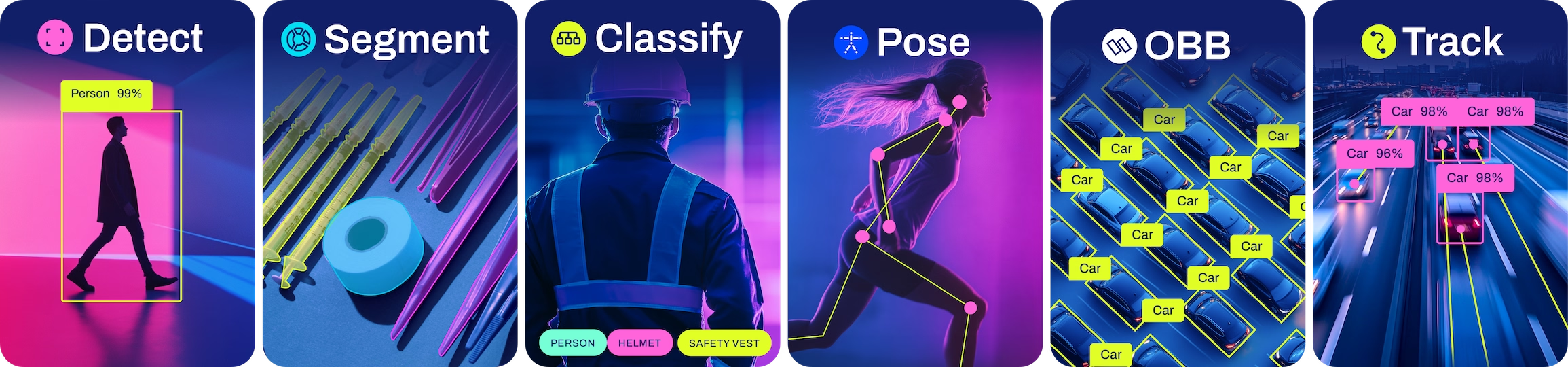

Ultralytics YOLO26 es un marco de trabajo de IA versátil que admite múltiples tareas de visión artificial. El marco de trabajo puede utilizarse para realizar detección, segmentación, segmentación semántica, OBB, clasificación y estimación de pose. Cada una de estas tareas tiene un objetivo y un caso de uso diferentes, lo que te permite abordar diversos retos de visión artificial con un único marco de trabajo.

Watch: Explore Ultralytics YOLO Tasks: Object Detection, Segmentation, OBB, Tracking, and Pose Estimation.

Link to this sectionDetección#

La detección es la tarea principal soportada por YOLO26. Consiste en identificar objetos en una imagen o fotograma de vídeo y dibujar cajas delimitadoras a su alrededor. Los objetos detectados se clasifican en diferentes categorías según sus características. YOLO26 puede detectar múltiples objetos en una sola imagen o fotograma de vídeo con gran precisión y velocidad, lo que la hace ideal para aplicaciones en tiempo real como sistemas de vigilancia y vehículos autónomos.

Link to this sectionSegmentación de imágenes#

La segmentación lleva la detección de objetos más allá al producir máscaras a nivel de píxel para cada objeto. Esta precisión es útil para aplicaciones como imagen médica, análisis agrícola y control de calidad en fabricación.

Link to this sectionSegmentación semántica#

La segmentación semántica asigna una etiqueta de clase a cada píxel de una imagen, produciendo un mapa de clases denso de toda la escena. A diferencia de la segmentación de instancias, no distingue entre objetos individuales de la misma clase. Esto la hace ideal para la conducción autónoma, el análisis de escenas y la cartografía de cobertura del suelo, donde entender la disposición espacial completa es más importante que identificar objetos individuales.

Ejemplos de segmentación semántica

Link to this sectionClasificación#

La clasificación consiste en categorizar imágenes completas basándose en su contenido. Esta tarea es esencial para aplicaciones como la categorización de productos en comercio electrónico, la moderación de contenido y la monitorización de vida silvestre.

Link to this sectionEstimación de pose#

La estimación de pose detecta puntos clave específicos en imágenes o fotogramas de vídeo para rastrear movimientos o estimar poses. Estos puntos clave pueden representar articulaciones humanas, rasgos faciales u otros puntos de interés significativos. YOLO26 destaca en la detección de puntos clave con gran precisión y velocidad, lo que la hace valiosa para aplicaciones de fitness, analítica deportiva y interacción humano-computadora.

Link to this sectionOBB#

La detección de caja delimitadora orientada (OBB, por sus siglas en inglés) mejora la detección de objetos tradicional al añadir un ángulo de orientación para localizar mejor los objetos rotados. Esta capacidad es particularmente valiosa para el análisis de imágenes aéreas, el procesamiento de documentos y las aplicaciones industriales donde los objetos aparecen en varios ángulos. YOLO26 ofrece una alta precisión y velocidad para detectar objetos rotados en diversos escenarios.

Link to this sectionConclusión#

Ultralytics YOLO26 admite múltiples tareas de visión artificial, incluidas la detección, la segmentación de instancias, la segmentación semántica, la clasificación, la detección de objetos orientados y la detección de puntos clave. Cada tarea aborda necesidades específicas en el panorama de la visión artificial, desde la identificación básica de objetos hasta el análisis detallado de poses. Al comprender las capacidades y aplicaciones de cada tarea, puedes seleccionar el enfoque más adecuado para tus desafíos específicos de visión artificial y aprovechar las potentes funciones de YOLO26 para construir soluciones efectivas.

Link to this sectionPreguntas frecuentes#

Link to this section¿Qué tareas de visión artificial puede realizar Ultralytics YOLO26?#

Ultralytics YOLO26 es un marco de trabajo de IA versátil capaz de realizar diversas tareas de visión artificial con gran precisión y velocidad. Estas tareas incluyen:

- Detección de objetos: Identificar y localizar objetos en imágenes o fotogramas de vídeo dibujando cajas delimitadoras a su alrededor.

- Segmentación de imágenes: Segmentar imágenes en diferentes regiones según su contenido, útil para aplicaciones como la imagen médica.

- Segmentación semántica: Asignar una etiqueta de clase a cada píxel en una imagen para una comprensión densa de la escena.

- Clasificación: Categorizar imágenes completas según su contenido.

- Estimación de pose: Detectar puntos clave específicos en una imagen o fotograma de vídeo para rastrear movimientos o poses.

- Detección de objetos orientados (OBB): Detectar objetos rotados con un ángulo de orientación añadido para una mayor precisión.

Link to this section¿Cómo uso Ultralytics YOLO26 para la detección de objetos?#

Para usar Ultralytics YOLO26 para la detección de objetos, sigue estos pasos:

- Prepara tu conjunto de datos en el formato apropiado.

- Entrena el modelo YOLO26 usando la tarea de detección.

- Usa el modelo para hacer predicciones introduciendo nuevas imágenes o fotogramas de vídeo.

from ultralytics import YOLO

# Load a pretrained YOLO model (adjust model type as needed)

model = YOLO("yolo26n.pt") # n, s, m, l, x versions available

# Perform object detection on an image

results = model.predict(source="image.jpg") # Can also use video, directory, URL, etc.

# Display the results

results[0].show() # Show the first image resultsPara obtener instrucciones más detalladas, consulta nuestros ejemplos de detección.

Link to this section¿Cuáles son los beneficios de usar YOLO26 para tareas de segmentación?#

Usar YOLO26 para tareas de segmentación proporciona varias ventajas:

- Alta precisión: La tarea de segmentación proporciona máscaras precisas a nivel de píxel.

- Velocidad: YOLO26 está optimizado para aplicaciones en tiempo real, ofreciendo un procesamiento rápido incluso para imágenes de alta resolución.

- Múltiples aplicaciones: Es ideal para imagen médica, conducción autónoma y otras aplicaciones que requieren una segmentación detallada de imágenes.

Aprende más sobre los beneficios y casos de uso de YOLO26 para la segmentación en la sección de segmentación de imágenes.

Link to this section¿Puede Ultralytics YOLO26 manejar la estimación de pose y la detección de puntos clave?#

Sí, Ultralytics YOLO26 puede realizar eficazmente la estimación de pose y la detección de puntos clave con gran precisión y velocidad. Esta función es especialmente útil para rastrear movimientos en analítica deportiva, atención sanitaria y aplicaciones de interacción humano-computadora. YOLO26 detecta puntos clave en una imagen o fotograma de vídeo, lo que permite una estimación de pose precisa.

Para más detalles y consejos de implementación, visita nuestros ejemplos de estimación de pose.

Link to this section¿Por qué debería elegir Ultralytics YOLO26 para la detección de objetos orientados (OBB)?#

La detección de objetos orientados (OBB) con YOLO26 proporciona una mayor precisión al detectar objetos con un parámetro de ángulo adicional. Esta función es beneficiosa para aplicaciones que requieren una localización precisa de objetos rotados, como el análisis de imágenes aéreas y la automatización de almacenes.

- Precisión aumentada: El componente angular reduce los falsos positivos para objetos rotados.

- Aplicaciones versátiles: Útil para tareas en análisis geoespacial, robótica, etc.

Echa un vistazo a la sección de detección de objetos orientados para más detalles y ejemplos.