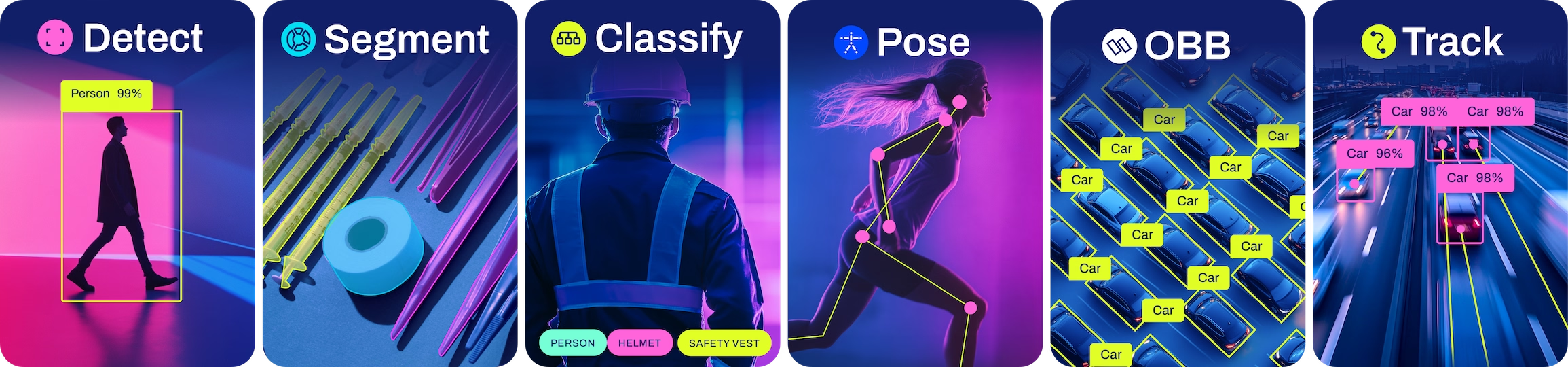

Tâches de vision par ordinateur prises en charge par Ultralytics YOLO26

Ultralytics YOLO26 est un framework d'IA polyvalent qui prend en charge plusieurs tâches de vision par ordinateur. Le framework peut être utilisé pour effectuer de la détection, de la segmentation, de la segmentation sémantique, de l'OBB, de la classification et de l'estimation de pose. Chacune de ces tâches a un objectif et un cas d'utilisation différents, ce qui te permet de relever divers défis de vision par ordinateur avec un seul framework.

Watch: Explore Ultralytics YOLO Tasks: Object Detection, Segmentation, OBB, Tracking, and Pose Estimation.

Détection

La détection est la tâche principale prise en charge par YOLO26. Elle consiste à identifier des objets dans une image ou une séquence vidéo et à dessiner des boîtes englobantes autour d'eux. Les objets détectés sont classés en différentes catégories en fonction de leurs caractéristiques. YOLO26 peut détecter plusieurs objets dans une seule image ou séquence vidéo avec une grande précision et une grande vitesse, ce qui le rend idéal pour des applications en temps réel comme les systèmes de surveillance et les véhicules autonomes.

Segmentation d'image

La segmentation va plus loin que la détection d'objets en produisant des masques au niveau des pixels pour chaque objet. Cette précision est utile pour des applications telles que l'imagerie médicale, l'analyse agricole et le contrôle qualité dans la fabrication.

Segmentation sémantique

La segmentation sémantique attribue une étiquette de classe à chaque pixel d'une image, produisant une carte de classe dense de toute la scène. Contrairement à la segmentation d'instance, elle ne distingue pas les objets individuels d'une même classe. Cela la rend idéale pour la conduite autonome, l'analyse de scène et la cartographie de l'occupation des sols, où comprendre la disposition spatiale globale importe plus que l'identification d'objets individuels.

Exemples de segmentation sémantique

Classification

La classification consiste à catégoriser des images entières en fonction de leur contenu. Cette tâche est essentielle pour des applications comme la catégorisation de produits dans le commerce électronique, la modération de contenu et le suivi de la faune.

Estimation de pose

L'estimation de pose détecte des points clés spécifiques dans des images ou des séquences vidéo pour suivre des mouvements ou estimer des poses. Ces points clés peuvent représenter des articulations humaines, des traits du visage ou d'autres points d'intérêt significatifs. YOLO26 excelle dans la détection de points clés avec une grande précision et vitesse, ce qui le rend précieux pour les applications de fitness, l'analyse sportive et l'interaction homme-machine.

OBB

La détection de boîte englobante orientée (OBB) améliore la détection d'objets traditionnelle en ajoutant un angle d'orientation pour mieux localiser les objets pivotés. Cette capacité est particulièrement précieuse pour l'analyse d'imagerie aérienne, le traitement de documents et les applications industrielles où les objets apparaissent sous divers angles. YOLO26 offre une grande précision et vitesse pour la détection d'objets pivotés dans divers scénarios.

Conclusion

Ultralytics YOLO26 prend en charge plusieurs tâches de vision par ordinateur, notamment la détection, la segmentation d'instance, la segmentation sémantique, la classification, la détection d'objets orientés et la détection de points clés. Chaque tâche répond à des besoins spécifiques dans le paysage de la vision par ordinateur, de l'identification basique d'objets à l'analyse détaillée de poses. En comprenant les capacités et les applications de chaque tâche, tu peux sélectionner l'approche la plus appropriée pour tes défis spécifiques de vision par ordinateur et tirer parti des fonctionnalités puissantes de YOLO26 pour construire des solutions efficaces.

FAQ

Quelles tâches de vision par ordinateur Ultralytics YOLO26 peut-il effectuer ?

Ultralytics YOLO26 est un framework d'IA polyvalent capable d'effectuer diverses tâches de vision par ordinateur avec une grande précision et vitesse. Ces tâches incluent :

- Détection d'objets : Identification et localisation d'objets dans des images ou des séquences vidéo en dessinant des boîtes englobantes autour d'eux.

- Segmentation d'image : Segmentation d'images en différentes régions basées sur leur contenu, utile pour des applications comme l'imagerie médicale.

- Segmentation sémantique : Attribution d'une étiquette de classe à chaque pixel dans une image pour une compréhension dense de la scène.

- Classification : Catégorisation d'images entières en fonction de leur contenu.

- Estimation de pose : Détection de points clés spécifiques dans une image ou une séquence vidéo pour suivre des mouvements ou des poses.

- Détection d'objets orientés (OBB) : Détection d'objets pivotés avec un angle d'orientation ajouté pour une précision accrue.

Comment utiliser Ultralytics YOLO26 pour la détection d'objets ?

Pour utiliser Ultralytics YOLO26 pour la détection d'objets, suis ces étapes :

- Prépare ton jeu de données dans le format approprié.

- Entraîne le modèle YOLO26 en utilisant la tâche de détection.

- Utilise le modèle pour faire des prédictions en y soumettant de nouvelles images ou séquences vidéo.

from ultralytics import YOLO

# Load a pretrained YOLO model (adjust model type as needed)

model = YOLO("yolo26n.pt") # n, s, m, l, x versions available

# Perform object detection on an image

results = model.predict(source="image.jpg") # Can also use video, directory, URL, etc.

# Display the results

results[0].show() # Show the first image resultsPour des instructions plus détaillées, consulte nos exemples de détection.

Quels sont les avantages d'utiliser YOLO26 pour les tâches de segmentation ?

Utiliser YOLO26 pour des tâches de segmentation offre plusieurs avantages :

- Haute précision : La tâche de segmentation fournit des masques précis au niveau des pixels.

- Vitesse : YOLO26 est optimisé pour les applications en temps réel, offrant un traitement rapide même pour les images haute résolution.

- Applications multiples : Il est idéal pour l'imagerie médicale, la conduite autonome et d'autres applications nécessitant une segmentation d'image détaillée.

Apprends-en plus sur les avantages et les cas d'utilisation de YOLO26 pour la segmentation dans la section segmentation d'image.

Ultralytics YOLO26 peut-il gérer l'estimation de pose et la détection de points clés ?

Oui, Ultralytics YOLO26 peut effectuer efficacement l'estimation de pose et la détection de points clés avec une grande précision et vitesse. Cette fonctionnalité est particulièrement utile pour suivre des mouvements dans l'analyse sportive, la santé et les applications d'interaction homme-machine. YOLO26 détecte les points clés dans une image ou une séquence vidéo, permettant une estimation de pose précise.

Pour plus de détails et de conseils d'implémentation, visite nos exemples d'estimation de pose.

Pourquoi devrais-je choisir Ultralytics YOLO26 pour la détection d'objets orientés (OBB) ?

La détection d'objets orientés (OBB) avec YOLO26 offre une précision améliorée en détectant les objets avec un paramètre d'angle supplémentaire. Cette fonctionnalité est bénéfique pour les applications nécessitant une localisation précise d'objets pivotés, comme l'analyse d'imagerie aérienne et l'automatisation en entrepôt.

- Précision accrue : Le composant d'angle réduit les faux positifs pour les objets pivotés.

- Applications polyvalentes : Utile pour des tâches d'analyse géospatiale, de robotique, etc.

Consulte la section détection d'objets orientés pour plus de détails et d'exemples.