समझें कि कैसे निर्यात करें TF SavedModel से प्रारूपित करें YOLOv8

मशीन लर्निंग मॉडल को तैनात करना चुनौतीपूर्ण हो सकता है। हालांकि, एक कुशल और लचीले मॉडल प्रारूप का उपयोग करने से आपका काम आसान हो सकता है। TF SavedModel एक ओपन-सोर्स मशीन-लर्निंग फ्रेमवर्क है जिसका उपयोग किसके द्वारा किया जाता है? TensorFlow मशीन-लर्निंग मॉडल को लगातार तरीके से लोड करने के लिए। यह एक सूटकेस की तरह है TensorFlow मॉडल, उन्हें विभिन्न उपकरणों और प्रणालियों पर ले जाने और उपयोग करने में आसान बनाते हैं।

निर्यात करना सीखना TF SavedModel से Ultralytics YOLOv8 मॉडल आपको विभिन्न प्लेटफार्मों और वातावरणों में आसानी से मॉडल तैनात करने में मदद कर सकते हैं। इस गाइड में, हम आपके मॉडल को TF SavedModel प्रारूप, विभिन्न उपकरणों पर अपने मॉडल के साथ निष्कर्ष चलाने की प्रक्रिया को सरल बनाना।

आपको निर्यात क्यों करना चाहिए TF SavedModel?

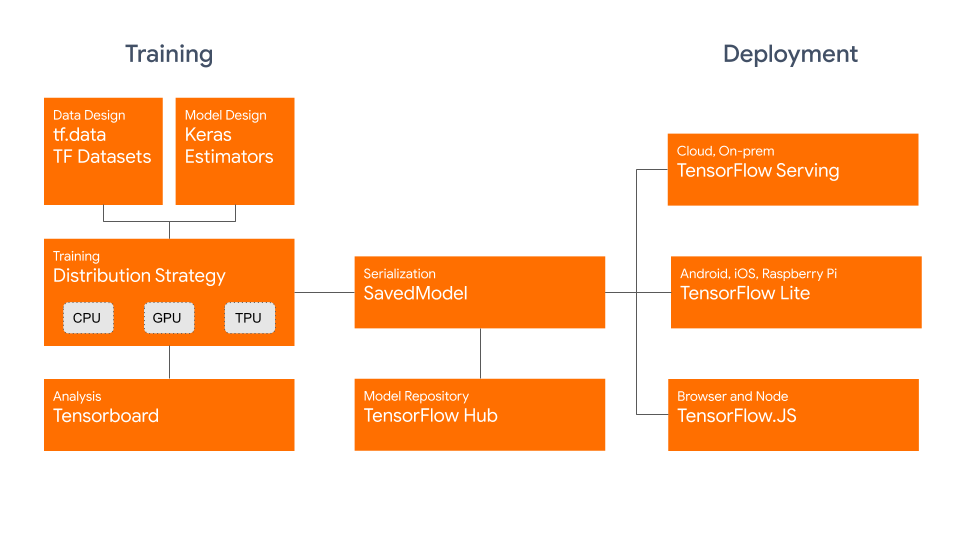

वही TensorFlow SavedModel format का एक हिस्सा है TensorFlow द्वारा विकसित पारिस्थितिकी तंत्र Google जैसा कि नीचे दिखाया गया है। इसे सहेजने और क्रमबद्ध करने के लिए डिज़ाइन किया गया है TensorFlow मॉडल निर्बाध रूप से। यह वास्तुकला, वजन और यहां तक कि संकलन जानकारी जैसे मॉडलों का पूरा विवरण समाहित करता है। यह विभिन्न वातावरणों में प्रशिक्षण साझा करना, तैनात करना और जारी रखना आसान बनाता है।

वही TF SavedModel एक महत्वपूर्ण लाभ है: इसकी संगतता। यह अच्छी तरह से काम करता है TensorFlow सेवारत TensorFlow लाइट, और TensorFlow।जे एस। यह संगतता वेब और मोबाइल एप्लिकेशन सहित विभिन्न प्लेटफार्मों पर मॉडल साझा करना और तैनात करना आसान बनाती है। वही TF SavedModel प्रारूप अनुसंधान और उत्पादन दोनों के लिए उपयोगी है। यह आपके मॉडल को प्रबंधित करने का एक एकीकृत तरीका प्रदान करता है, यह सुनिश्चित करता है कि वे किसी भी एप्लिकेशन के लिए तैयार हैं।

की मुख्य विशेषताएं TF सहेजे गए मॉडल

यहाँ प्रमुख विशेषताएं हैं जो बनाती हैं TF SavedModel एआई डेवलपर्स के लिए एक बढ़िया विकल्प:

-

पोर्टेबिलिटी: TF SavedModel एक भाषा-तटस्थ, पुनर्प्राप्त करने योग्य, भली भांति बंद क्रमांकन प्रारूप प्रदान करता है। वे उच्च-स्तरीय प्रणालियों और उपकरणों को उत्पादन, उपभोग और बदलने में सक्षम बनाते हैं TensorFlow मॉडल। सेवमॉडल को विभिन्न प्लेटफार्मों और वातावरणों में आसानी से साझा और तैनात किया जा सकता है।

-

तैनाती में आसानी: TF SavedModel कम्प्यूटेशनल ग्राफ, प्रशिक्षित पैरामीटर और आवश्यक मेटाडेटा को एक पैकेज में बंडल करता है। उन्हें आसानी से लोड किया जा सकता है और मॉडल बनाने वाले मूल कोड की आवश्यकता के बिना अनुमान के लिए उपयोग किया जा सकता है। यह की तैनाती करता है TensorFlow विभिन्न उत्पादन वातावरण में सीधे और कुशल मॉडल।

-

संपत्ति प्रबंधन: TF SavedModel बाहरी संपत्तियों जैसे शब्दावली, एम्बेडिंग, या लुकअप टेबल को शामिल करने का समर्थन करता है। इन संपत्तियों को ग्राफ परिभाषा और चर के साथ संग्रहीत किया जाता है, यह सुनिश्चित करते हुए कि मॉडल लोड होने पर वे उपलब्ध हैं। यह सुविधा बाहरी संसाधनों पर निर्भर मॉडल के प्रबंधन और वितरण को सरल बनाती है।

के साथ परिनियोजन विकल्प TF SavedModel

इससे पहले कि हम निर्यात की प्रक्रिया में गोता लगाएँ YOLOv8 करने के लिए मॉडल TF SavedModel प्रारूप, आइए कुछ विशिष्ट परिनियोजन परिदृश्यों का पता लगाएं जहां इस प्रारूप का उपयोग किया जाता है।

TF SavedModel आपके मशीन लर्निंग मॉडल को तैनात करने के लिए विकल्पों की एक श्रृंखला प्रदान करता है:

-

TensorFlow सेवारत: TensorFlow सर्विंग एक लचीली, उच्च-प्रदर्शन वाली सर्विंग प्रणाली है जिसे उत्पादन वातावरण के लिए डिज़ाइन किया गया है। यह मूल रूप से समर्थन करता है TF SavedModels, क्लाउड प्लेटफ़ॉर्म, ऑन-प्रिमाइसेस सर्वर या किनारे की डिवाइसेस पर आपके मॉडल को परिनियोजित करना और प्रस्तुत करना आसान बनाता है.

-

क्लाउड प्लेटफार्म: प्रमुख क्लाउड प्रदाता जैसे Google क्लाउड प्लेटफ़ॉर्म (GCP), Amazon Web Services (AWS), और Microsoft Azure परिनियोजन और चलाने के लिए सेवाएँ प्रदान करता है TensorFlow मॉडल, सहित TF सहेजे गए मॉडल। ये सेवाएं स्केलेबल और प्रबंधित बुनियादी ढांचा प्रदान करती हैं, जिससे आप अपने मॉडल को आसानी से तैनात और स्केल कर सकते हैं।

-

मोबाइल और एम्बेडेड डिवाइस: TensorFlow लाइट, मोबाइल, एम्बेडेड और IoT उपकरणों पर मशीन लर्निंग मॉडल चलाने के लिए एक हल्का समाधान, परिवर्तित करने का समर्थन करता है TF सहेजे गए मॉडल को TensorFlow लाइट प्रारूप। यह आपको अपने मॉडल को स्मार्टफोन और टैबलेट से लेकर माइक्रोकंट्रोलर और एज डिवाइस तक उपकरणों की एक विस्तृत श्रृंखला पर तैनात करने की अनुमति देता है।

-

TensorFlow रनटाइम: TensorFlow रनटाइम (

tfrt) निष्पादन के लिए एक उच्च-प्रदर्शन रनटाइम है TensorFlow रेखांकन। यह लोडिंग और रनिंग के लिए निचले स्तर के एपीआई प्रदान करता है TF C++ वातावरण में सहेजे गए मॉडल। TensorFlow रनटाइम मानक की तुलना में बेहतर प्रदर्शन प्रदान करता है TensorFlow रनटाइम। यह तैनाती परिदृश्यों के लिए उपयुक्त है जिनके लिए कम-विलंबता अनुमान और मौजूदा सी ++ कोडबेस के साथ तंग एकीकरण की आवश्यकता होती है।

निर्यात YOLOv8 करने के लिए मॉडल TF SavedModel

निर्यात करके YOLOv8 करने के लिए मॉडल TF SavedModel प्रारूप, आप उनकी अनुकूलन क्षमता और विभिन्न प्लेटफार्मों पर तैनाती में आसानी को बढ़ाते हैं।

संस्थापन

आवश्यक पैकेज स्थापित करने के लिए, चलाएं:

स्थापना प्रक्रिया से संबंधित विस्तृत निर्देशों और सर्वोत्तम प्रथाओं के लिए, हमारी जाँच करें Ultralytics इंस्टालेशन गाइड। के लिए आवश्यक पैकेज स्थापित करते समय YOLOv8, अगर आपको कोई कठिनाई आती है, तो समाधान और सुझावों के लिए हमारी सामान्य समस्याएं मार्गदर्शिका देखें.

उपयोग

उपयोग के निर्देशों में गोता लगाने से पहले, यह ध्यान रखना महत्वपूर्ण है कि सभी Ultralytics YOLOv8 मॉडल निर्यात के लिए उपलब्ध हैं, आप यह सुनिश्चित कर सकते हैं कि आपके द्वारा चुना गया मॉडल यहां निर्यात कार्यक्षमता का समर्थन करता है।

उपयोग

from ultralytics import YOLO

# Load the YOLOv8 model

model = YOLO("yolov8n.pt")

# Export the model to TF SavedModel format

model.export(format="saved_model") # creates '/yolov8n_saved_model'

# Load the exported TF SavedModel model

tf_savedmodel_model = YOLO("./yolov8n_saved_model")

# Run inference

results = tf_savedmodel_model("https://ultralytics.com/images/bus.jpg")

समर्थित निर्यात विकल्पों के बारे में अधिक जानकारी के लिए, पर जाएँ Ultralytics परिनियोजन विकल्पों पर प्रलेखन पृष्ठ।

निर्यात की गई तैनाती YOLOv8 TF SavedModel मॉडल

अब जब आपने अपना निर्यात कर लिया है YOLOv8 के लिए मॉडल TF SavedModel प्रारूप, अगला कदम इसे तैनात करना है। चलाने के लिए प्राथमिक और अनुशंसित पहला कदम TF GraphDef मॉडल का उपयोग करना है YOLO("./yolov8n_saved_model") मेथड है, जैसा कि पहले इस्तेमाल कोड स्निपेट में दिखाया गया था.

हालाँकि, अपने परिनियोजन के बारे में गहन निर्देशों के लिए TF SavedModel मॉडल, निम्नलिखित संसाधनों पर एक नज़र डालें:

-

TensorFlow प्रस्तुत करना: यहां डेवलपर दस्तावेज़ दिया गया है कि आप अपना परिनियोजन कैसे करें TF SavedModel का उपयोग कर मॉडल TensorFlow सेवारत।

-

एक चलाएँ TensorFlow SavedModel Node.js में: ए TensorFlow एक चलाने पर ब्लॉग पोस्ट TensorFlow SavedModel रूपांतरण के बिना सीधे Node.js में।

-

क्लाउड पर तैनाती: ए TensorFlow एक तैनात करने पर ब्लॉग पोस्ट TensorFlow SavedModel क्लाउड एआई प्लेटफॉर्म पर मॉडल।

सारांश

इस गाइड में, हमने पता लगाया कि निर्यात कैसे करें Ultralytics YOLOv8 करने के लिए मॉडल TF SavedModel प्रारूप। निर्यात करके TF SavedModel, आप अपने अनुकूलन करने, तैनात करने और स्केल करने के लिए लचीलापन प्राप्त करते हैं YOLOv8 प्लेटफार्मों की एक विस्तृत श्रृंखला पर मॉडल।

उपयोग के बारे में अधिक जानकारी के लिए, पर जाएँ TF SavedModel आधिकारिक दस्तावेज।

एकीकृत करने के बारे में अधिक जानकारी के लिए Ultralytics YOLOv8 अन्य प्लेटफार्मों और रूपरेखाओं के साथ, हमारे एकीकरण गाइड पृष्ठ को देखना न भूलें। यह आपको अधिकतम लाभ उठाने में मदद करने के लिए महान संसाधनों से भरा हुआ है YOLOv8 अपनी परियोजनाओं में।

अक्सर पूछे जाने वाले प्रश्न

मैं एक निर्यात कैसे करूं Ultralytics YOLO करने के लिए मॉडल TensorFlow SavedModel प्रारूप?

एक निर्यात Ultralytics YOLO करने के लिए मॉडल TensorFlow SavedModel प्रारूप सीधा है। आप या तो उपयोग कर सकते हैं Python नहीं तो CLI इसे प्राप्त करने के लिए:

निर्यात YOLOv8 तक TF SavedModel

from ultralytics import YOLO

# Load the YOLOv8 model

model = YOLO("yolov8n.pt")

# Export the model to TF SavedModel format

model.export(format="saved_model") # creates '/yolov8n_saved_model'

# Load the exported TF SavedModel for inference

tf_savedmodel_model = YOLO("./yolov8n_saved_model")

results = tf_savedmodel_model("https://ultralytics.com/images/bus.jpg")

का संदर्भ लें Ultralytics अधिक जानकारी के लिए निर्यात दस्तावेज़ीकरण।

मुझे TensorFlow SavedModel प्रारूप?

वही TensorFlow SavedModel प्रारूप मॉडल परिनियोजन के लिए कई लाभ प्रदान करता है:

- सुवाह्यता: यह एक भाषा-तटस्थ प्रारूप प्रदान करता है, जिससे विभिन्न वातावरणों में मॉडल साझा करना और तैनात करना आसान हो जाता है।

- अनुकूलता: जैसे उपकरणों के साथ मूल रूप से एकीकृत करता है TensorFlow सेवारत TensorFlow लाइट, और TensorFlow.js, जो वेब और मोबाइल एप्लिकेशन सहित विभिन्न प्लेटफार्मों पर मॉडल तैनात करने के लिए आवश्यक हैं।

- पूर्ण एनकैप्सुलेशन: मॉडल आर्किटेक्चर, वजन और संकलन जानकारी को एन्कोड करता है, जिससे सीधे साझाकरण और प्रशिक्षण निरंतरता की अनुमति मिलती है।

अधिक लाभ और परिनियोजन विकल्पों के लिए, देखें Ultralytics YOLO मॉडल परिनियोजन विकल्प।

के लिए विशिष्ट परिनियोजन परिदृश्य क्या हैं TF SavedModel?

TF SavedModel विभिन्न वातावरणों में तैनात किया जा सकता है, जिनमें शामिल हैं:

- TensorFlow सेवारत: स्केलेबल और उच्च-प्रदर्शन मॉडल सेवा की आवश्यकता वाले उत्पादन वातावरण के लिए आदर्श।

- क्लाउड प्लेटफार्म: जैसे प्रमुख क्लाउड सेवाओं का समर्थन करता है Google क्लाउड प्लेटफ़ॉर्म (GCP), Amazon Web Services (AWS), और Microsoft Azure for scalable model deployment.

- मोबाइल और एम्बेडेड डिवाइस: का उपयोग करके TensorFlow परिवर्तित करने के लिए लाइट TF सहेजे गए मॉडल मोबाइल उपकरणों, IoT उपकरणों और माइक्रोकंट्रोलर पर परिनियोजन की अनुमति देते हैं।

- TensorFlow रनटाइम: सी ++ वातावरण के लिए बेहतर प्रदर्शन के साथ कम-विलंबता अनुमान की आवश्यकता होती है।

विस्तृत परिनियोजन विकल्पों के लिए, आधिकारिक गाइड पर जाएं परिनियोजन TensorFlow मॉडल।

मैं निर्यात करने के लिए आवश्यक पैकेज कैसे स्थापित कर सकता हूं YOLOv8 मॉडल?

निर्यात करने के लिए YOLOv8 मॉडल, आपको स्थापित करने की आवश्यकता है ultralytics पैकेज। अपने टर्मिनल में निम्न कमांड चलाएँ:

अधिक विस्तृत स्थापना निर्देशों और सर्वोत्तम प्रथाओं के लिए, हमारे देखें Ultralytics इंस्टालेशन गाइड। अगर आपको कोई समस्या आती है, तो हमारी सामान्य समस्याएं मार्गदर्शिका देखें.

की प्रमुख विशेषताएं क्या हैं TensorFlow SavedModel प्रारूप?

TF SavedModel निम्नलिखित विशेषताओं के कारण एआई डेवलपर्स के लिए प्रारूप फायदेमंद है:

- सुवाह्यता: सहजता से विभिन्न वातावरणों में साझाकरण और परिनियोजन की अनुमति देता है।

- तैनाती में आसानी: कम्प्यूटेशनल ग्राफ, प्रशिक्षित पैरामीटर और मेटाडेटा को एक पैकेज में एनकैप्सुलेट करता है, जो लोडिंग और अनुमान को सरल करता है।

- संपत्ति प्रबंधन: शब्दावली जैसी बाहरी संपत्तियों का समर्थन करता है, यह सुनिश्चित करता है कि मॉडल लोड होने पर वे उपलब्ध हों।

अधिक जानकारी के लिए, एक्सप्लोर करें अफ़सर TensorFlow दस्तावेज़ीकरण।

बनाया गया 2024-03-23, अपडेट किया गया 2024-07-05

लेखक: ग्लेन-जोचर (5), बुरहान-क्यू (1), अबिरामी-वीना (1)