Modelli supportati da Ultralytics

Benvenuti nella documentazione del modello di Ultralytics! Offriamo supporto per una vasta gamma di modelli, ognuno dei quali è adattato a compiti specifici come il rilevamento di oggetti, la segmentazione di istanze, la classificazione di immagini, la stima della posa e il tracciamento multi-oggetto. Se sei interessato a contribuire con la tua architettura di modello a Ultralytics, consulta la nostra Guida per i contributi.

Modelli in evidenza

Ecco alcuni dei modelli chiave supportati:

- YOLOv3: La terza iterazione della famiglia di modelli YOLO, originariamente di Joseph Redmon, nota per le sue efficienti capacità di rilevamento di oggetti in tempo reale.

- YOLOv4: Un aggiornamento nativo di darknet a YOLOv3, rilasciato da Alexey Bochkovskiy nel 2020.

- YOLOv5: Una versione migliorata dell'architettura YOLO di Ultralytics, che offre migliori compromessi tra prestazioni e velocità rispetto alle versioni precedenti.

- YOLOv6: Rilasciato da Meituan nel 2022 e utilizzato in molti robot di consegna autonomi dell'azienda.

- YOLOv7: Modelli YOLO aggiornati rilasciati nel 2022 dagli autori di YOLOv4. È supportata solo l'inferenza.

- YOLOv8: Un modello versatile con funzionalità avanzate come la segmentazione di istanze, la stima di pose/punti chiave e la classificazione.

- YOLOv9: Un modello sperimentale addestrato sul codebase Ultralytics YOLOv5 che implementa la Programmable Gradient Information (PGI).

- YOLOv10: Di Tsinghua University, caratterizzato da addestramento NMS-free e architettura guidata dall'efficienza-accuratezza, che offre prestazioni e latenza all'avanguardia.

- YOLO11: I modelli YOLO di Ultralytics che offrono alte prestazioni su molteplici attività tra cui detection, segmentation, stima della posa, tracking e classificazione.

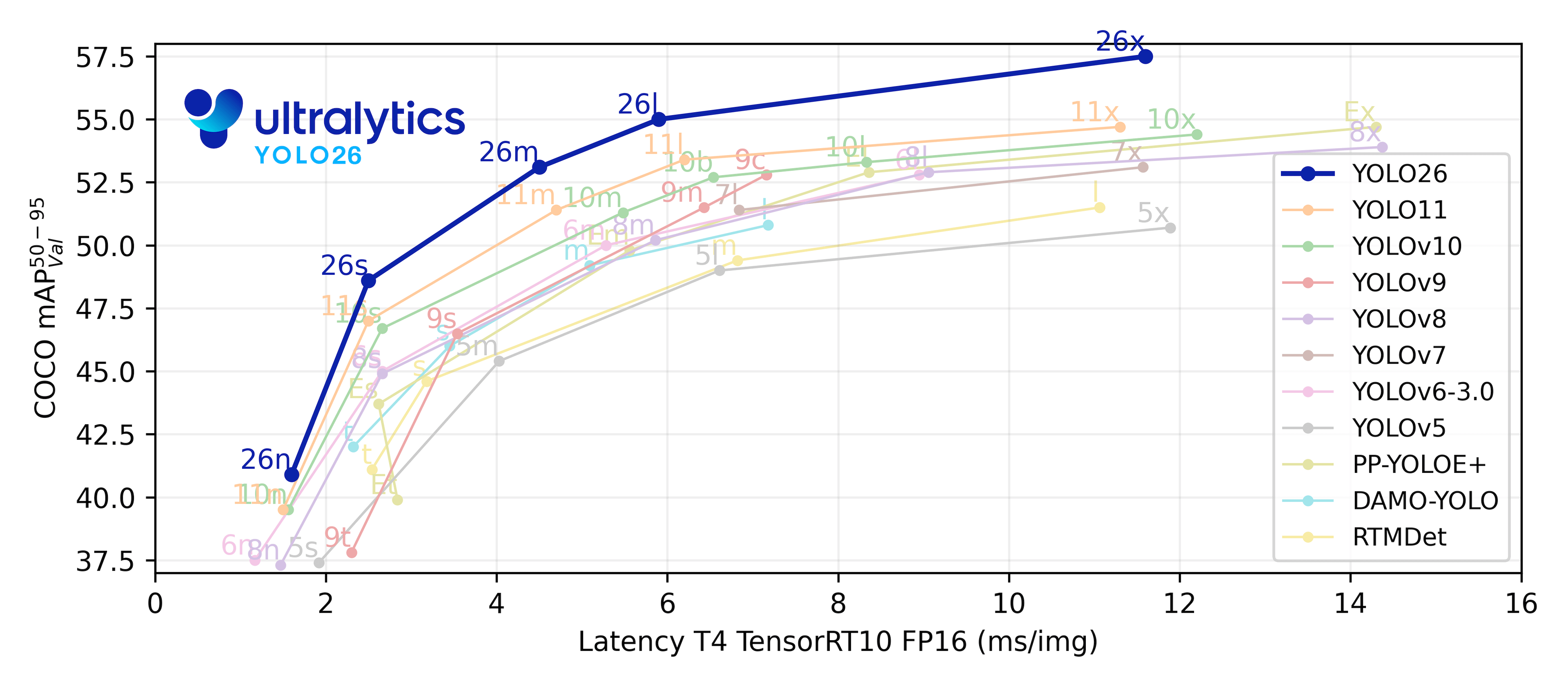

- YOLO26 🚀 NOVITÀ: L' ultimo modello YOLO di nuova generazione di Ultralytics ottimizzato per il deployment per l'edge con inferenza end-to-end NMS-free.

- Segment Anything Model (SAM): Il Segment Anything Model (SAM) originale di Meta.

- Segment Anything Model 2 (SAM2): La prossima generazione del Segment Anything Model di Meta per video e immagini.

- Segment Anything Model 3 (SAM3) 🚀 NOVITÀ: La terza generazione del modello Segment Anything di Meta con Segmentazione Concettuale Promptabile per la segmentazione basata su testo e su esempi di immagini.

- Mobile Segment Anything Model (MobileSAM): MobileSAM per applicazioni mobili, sviluppato dalla Kyung Hee University.

- Fast Segment Anything Model (FastSAM): FastSAM sviluppato da Image & Video Analysis Group, Institute of Automation, Chinese Academy of Sciences.

- YOLO-NAS: Modelli YOLO Neural Architecture Search (NAS).

- Real-Time Detection Transformers (RT-DETR): Modelli Transformer (RT-DETR) di Detection in tempo reale PaddlePaddle di Baidu.

- YOLO-World: Modelli di rilevamento oggetti a vocabolario aperto in tempo reale di Tencent AI Lab.

- YOLOE: Un rilevatore di oggetti a vocabolario aperto migliorato che mantiene le prestazioni in tempo reale di YOLO rilevando classi arbitrarie al di là dei suoi dati di addestramento.

Guarda: Esegui i modelli Ultralytics YOLO con poche righe di codice.

Introduzione: esempi di utilizzo

Questo esempio fornisce semplici esempi di addestramento e inferenza YOLO. Per la documentazione completa su questi e altri modi, consultare le pagine della documentazione di Predict, Train, Val ed Export.

Si noti che l'esempio seguente mette in evidenza i modelli YOLO11 Detect per il rilevamento di oggetti. Per ulteriori attività supportate, consultare i documenti Segment, Classify e Pose.

Esempio

PyTorch pre-addestrato *.pt modelli, così come la configurazione *.yaml file possono essere passati alla YOLO(), SAM(), NAS() e RTDETR() classi per creare un'istanza del modello in python:

from ultralytics import YOLO

# Load a COCO-pretrained YOLO26n model

model = YOLO("yolo26n.pt")

# Display model information (optional)

model.info()

# Train the model on the COCO8 example dataset for 100 epochs

results = model.train(data="coco8.yaml", epochs=100, imgsz=640)

# Run inference with the YOLO26n model on the 'bus.jpg' image

results = model("path/to/bus.jpg")

Sono disponibili comandi CLI per eseguire direttamente i modelli:

# Load a COCO-pretrained YOLO26n model and train it on the COCO8 example dataset for 100 epochs

yolo train model=yolo26n.pt data=coco8.yaml epochs=100 imgsz=640

# Load a COCO-pretrained YOLO26n model and run inference on the 'bus.jpg' image

yolo predict model=yolo26n.pt source=path/to/bus.jpg

Contributo di nuovi modelli

Sei interessato a contribuire con il tuo modello a Ultralytics? Ottimo! Siamo sempre aperti ad ampliare il nostro portafoglio di modelli.

Fork del Repository: Inizia effettuando il fork del repository GitHub di Ultralytics.

Clona il tuo Fork: Clona il tuo fork sulla tua macchina locale e crea un nuovo branch su cui lavorare.

Implementa il tuo Modello: Aggiungi il tuo modello seguendo gli standard di codifica e le linee guida fornite nella nostra Guida per i Contributori.

Test Approfonditi: Assicurati di testare a fondo il tuo modello, sia isolatamente che come parte della pipeline.

Crea una Pull Request: Una volta che sei soddisfatto del tuo modello, crea una pull request al repository principale per la revisione.

Revisione del Codice e Unione: Dopo la revisione, se il tuo modello soddisfa i nostri criteri, verrà unito nel repository principale.

Per passaggi dettagliati, consulta la nostra Guida per i Contributori.

FAQ

Qual è l'ultimo modello Ultralytics YOLO?

L'ultimo modello Ultralytics YOLO è YOLO26, rilasciato a gennaio 2026. YOLO26 offre inferenza end-to-end NMS-free, deployment ottimizzato per l'edge e supporta tutte e cinque le attività (detection, segmentation, classificazione, stima della posa e OBB) oltre alle versioni a vocabolario aperto. Per carichi di lavoro di produzione stabili, sia YOLO26 che YOLO11 sono scelte raccomandate.

Come posso addestrare un modello YOLO su dati personalizzati?

L'addestramento di un modello YOLO su dati personalizzati può essere facilmente realizzato utilizzando le librerie di Ultralytics. Ecco un rapido esempio:

Esempio

from ultralytics import YOLO

# Load a YOLO model

model = YOLO("yolo26n.pt") # or any other YOLO model

# Train the model on custom dataset

results = model.train(data="custom_data.yaml", epochs=100, imgsz=640)

yolo train model=yolo26n.pt data='custom_data.yaml' epochs=100 imgsz=640

Per istruzioni più dettagliate, visita la pagina di documentazione Train.

Quali versioni di YOLO sono supportate da Ultralytics?

Ultralytics supporta una gamma completa di versioni YOLO (You Only Look Once) da YOLOv3 a YOLO11, insieme a modelli come YOLO-NAS, SAM e RT-DETR. Ogni versione è ottimizzata per varie attività come detection, segmentation e classificazione. Per informazioni dettagliate su ciascun modello, consultare la documentazione Modelli supportati da Ultralytics.

Perché dovrei usare Ultralytics Platform per progetti di machine learning?

Ultralytics Platform fornisce una piattaforma no-code end-to-end per l'addestramento, il deployment e la gestione dei modelli YOLO. Semplifica i flussi di lavoro complessi, consentendo agli utenti di concentrarsi sulle prestazioni e sull'applicazione del modello. La piattaforma offre anche capacità di addestramento su cloud, una gestione completa dei dataset e interfacce intuitive sia per i principianti che per gli sviluppatori esperti.

Che tipi di attività possono eseguire i modelli Ultralytics YOLO?

I modelli Ultralytics YOLO sono versatili e possono eseguire compiti quali il rilevamento di oggetti, la segmentazione di istanze, la classificazione, la stima della posa e il rilevamento di oggetti orientati (OBB). L'ultimo modello, YOLO26, supporta tutte e cinque le attività più il rilevamento a vocabolario aperto. Per i dettagli sulle attività specifiche, fare riferimento alle pagine delle attività.