Link to this sectionUltralytics YOLO26がサポートするコンピュータビジョンタスク#

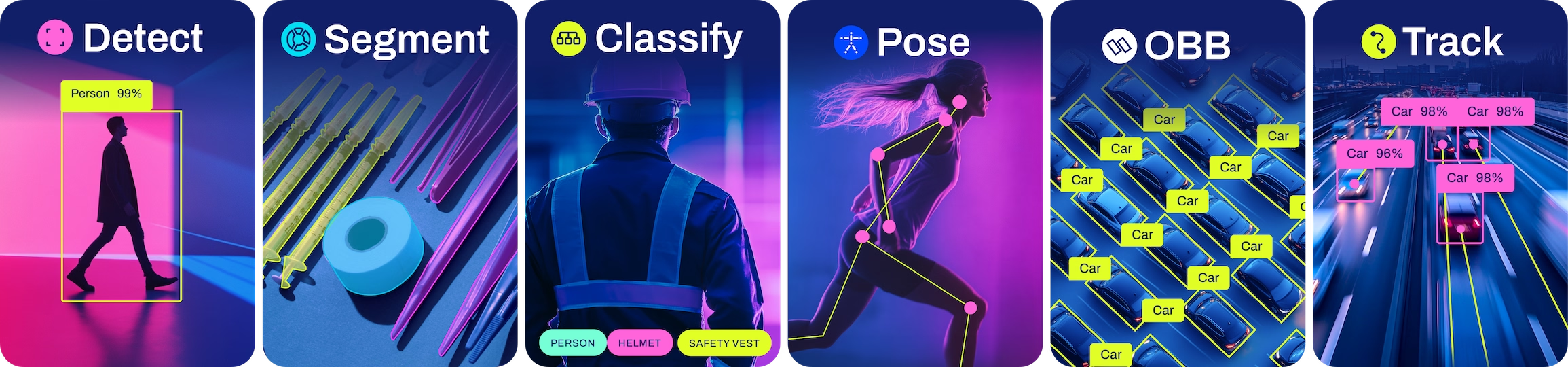

Ultralytics YOLO26は、多様なコンピュータビジョン タスクをサポートする汎用的なAIフレームワークです。このフレームワークは、検出、セグメンテーション、セマンティックセグメンテーション、OBB、分類、および姿勢推定を実行するために使用できます。これらのタスクにはそれぞれ異なる目的とユースケースがあり、単一のフレームワークでさまざまなコンピュータビジョンの課題に対処できます。

Watch: Explore Ultralytics YOLO Tasks: Object Detection, Segmentation, OBB, Tracking, and Pose Estimation.

Link to this section検出#

検出は、YOLO26がサポートする主要なタスクです。これには、画像やビデオフレーム内のオブジェクトを識別し、その周囲をバウンディングボックスで囲むことが含まれます。検出されたオブジェクトは、その特徴に基づいて異なるカテゴリに分類されます。YOLO26は、単一の画像またはビデオフレーム内の複数のオブジェクトを高い精度と速度で検出できるため、監視システムや自動運転車のようなリアルタイムアプリケーションに最適です。

Link to this section画像セグメンテーション#

セグメンテーションは、オブジェクトごとにピクセルレベルのマスクを生成することで、物体検出をさらに高度化させます。この精度は、医療画像処理、農業分析、製造品質管理などのアプリケーションで役立ちます。

Link to this sectionセマンティックセグメンテーション#

セマンティックセグメンテーションは、画像内のすべてのピクセルにクラスラベルを割り当て、シーン全体を高密度なクラスマップとして生成します。インスタンスセグメンテーションとは異なり、同じクラスの個々のオブジェクトを区別しません。このため、個々のオブジェクトを識別することよりも、空間全体のレイアウトを理解することが重要な自動運転、シーン解析、土地被覆マッピングに最適です。

Link to this section分類#

分類は、画像全体の内容に基づいてカテゴリ分けを行うタスクです。このタスクは、Eコマースにおける製品の分類、コンテンツモデレーション、野生動物のモニタリングなどのアプリケーションに不可欠です。

Link to this section姿勢推定#

姿勢推定は、画像やビデオフレーム内の特定のキーポイントを検出して、動きを追跡したり姿勢を推定したりします。これらのキーポイントは、人間の関節、顔の特徴、その他の重要なポイントを表すことができます。YOLO26はキーポイント検出において高い精度と速度を誇り、フィットネスアプリケーション、スポーツ分析、ヒューマンコンピュータインタラクションに有用です。

Link to this sectionOBB#

指向性バウンディングボックス(OBB)検出は、従来の物体検出に回転角を追加することで、回転したオブジェクトをより正確に配置できるようにします。この機能は、オブジェクトがさまざまな角度で出現する航空写真分析、文書処理、産業用アプリケーションにおいて特に価値があります。YOLO26は、多様なシナリオにおいて回転したオブジェクトを高精度かつ高速に検出します。

Link to this section結論#

Ultralytics YOLO26は、検出、インスタンスセグメンテーション、セマンティックセグメンテーション、分類、指向性物体検出、キーポイント検出を含む、複数のコンピュータビジョンタスクをサポートしています。各タスクは、基本的な物体識別から詳細な姿勢分析に至るまで、コンピュータビジョンの領域における特定のニーズに対応します。各タスクの能力とアプリケーションを理解することで、特定のコンピュータビジョンの課題に対して最も適切なアプローチを選択し、YOLO26の強力な機能を活用して効果的なソリューションを構築できます。

Link to this sectionFAQ#

Link to this sectionUltralytics YOLO26で実行可能なコンピュータビジョンタスクは何ですか?#

Ultralytics YOLO26は、さまざまなコンピュータビジョンタスクを高精度かつ高速に実行できる汎用的なAIフレームワークです。これらのタスクには以下が含まれます。

- 物体検出: 画像やビデオフレーム内のオブジェクトをバウンディングボックスで囲むことで、特定および配置します。

- 画像セグメンテーション: コンテンツに基づいて画像を異なる領域にセグメント化します。医療画像処理などのアプリケーションに役立ちます。

- セマンティックセグメンテーション: シーンの詳細な理解のために、画像内のすべてのピクセルにクラスラベルを割り当てます。

- 分類: 内容に基づいて画像全体をカテゴリ分けします。

- 姿勢推定: 画像やビデオフレーム内の特定のキーポイントを検出して、動きや姿勢を追跡します。

- 指向性物体検出 (OBB): 精度向上のため、回転したオブジェクトを向きの角度を含めて検出します。

Link to this sectionUltralytics YOLO26を使用した物体検出の方法を教えてください。#

Ultralytics YOLO26で物体検出を使用するには、次の手順に従います。

- データセットを適切な形式で準備します。

- 検出タスクを使用してYOLO26モデルを学習させます。

- 新しい画像やビデオフレームを入力して、モデルを使用して予測を行います。

from ultralytics import YOLO

# Load a pretrained YOLO model (adjust model type as needed)

model = YOLO("yolo26n.pt") # n, s, m, l, x versions available

# Perform object detection on an image

results = model.predict(source="image.jpg") # Can also use video, directory, URL, etc.

# Display the results

results[0].show() # Show the first image results詳細については、検出の例を確認してください。

Link to this sectionYOLO26をセグメンテーションタスクに使用する利点は何ですか?#

YOLO26をセグメンテーションタスクに使用すると、いくつかの利点があります。

- 高い精度: セグメンテーションタスクは、正確なピクセルレベルのマスクを提供します。

- 速度: YOLO26はリアルタイムアプリケーション向けに最適化されており、高解像度画像でも高速な処理を提供します。

- 多目的な応用: 医療画像処理、自動運転、その他詳細な画像セグメンテーションを必要とするアプリケーションに最適です。

セグメンテーションにおけるYOLO26の利点とユースケースの詳細については、画像セグメンテーションセクションを参照してください。

Link to this sectionUltralytics YOLO26は姿勢推定とキーポイント検出を扱えますか?#

はい、Ultralytics YOLO26は、高い精度と速度で姿勢推定とキーポイント検出を効果的に実行できます。この機能は、スポーツ分析、ヘルスケア、ヒューマンコンピュータインタラクションのアプリケーションで動きを追跡する際に特に有用です。YOLO26は画像やビデオフレーム内のキーポイントを検出し、正確な姿勢推定を可能にします。

詳細や実装のヒントについては、姿勢推定の例をご覧ください。

Link to this sectionなぜ指向性物体検出 (OBB) にUltralytics YOLO26を選ぶべきなのですか?#

YOLO26による指向性物体検出 (OBB) は、角度パラメータを追加してオブジェクトを検出することで、精度を向上させます。この機能は、航空写真分析や倉庫の自動化など、回転したオブジェクトの正確な位置特定を必要とするアプリケーションに役立ちます。

- 精度の向上: 角度コンポーネントにより、回転したオブジェクトに対する誤検出が減少します。

- 多用途: 地理空間分析、ロボティクスなどのタスクに役立ちます。

詳細や例については、指向性物体検出セクションを確認してください。