Link to this sectionConjunto de dados KITTI#

O conjunto de dados kitti é um dos benchmarks mais influentes para condução autónoma e visão computacional. Lançado pelo Instituto de Tecnologia de Karlsruhe e pelo Instituto Tecnológico de Toyota em Chicago, contém dados de câmara estéreo, LiDAR e GPS/IMU recolhidos a partir de cenários de condução do mundo real.

Watch: How to Train Ultralytics YOLO26 on the KITTI Dataset 🚀

É amplamente utilizado para avaliar algoritmos em deteção de objetos, estimativa de profundidade, fluxo ótico e odometria visual. O conjunto de dados é totalmente compatível com o Ultralytics YOLO26 para tarefas de deteção de objetos 2D e pode ser facilmente integrado na plataforma Ultralytics para treino e avaliação.

Link to this sectionEstrutura do Dataset#

O conjunto de teste original do kitti é excluído aqui, uma vez que não contém anotações ground-truth.

No total, o conjunto de dados inclui 7.481 imagens, cada uma emparelhada com anotações detalhadas para objetos como carros, peões, ciclistas e outros elementos rodoviários. O conjunto de dados está dividido em dois subconjuntos principais:

- Conjunto de treino: Contém 5.985 imagens com etiquetas anotadas usadas para o treino do modelo.

- Conjunto de validação: Inclui 1.496 imagens com as respetivas anotações usadas para avaliação de desempenho e benchmarking.

Link to this sectionAplicações#

O conjunto de dados kitti permite avanços na condução autónoma e robótica, suportando tarefas como:

- Perceção de veículos autónomos: Treino de modelos para detetar e seguir veículos, peões e obstáculos para uma navegação segura em sistemas de condução autónoma.

- Compreensão de cenários 3D: Suporte à estimativa de profundidade, visão estéreo e localização de objetos 3D para ajudar as máquinas a compreender ambientes espaciais.

- Fluxo ótico e previsão de movimento: Permite a análise de movimento para prever a movimentação de objetos e melhorar o planeamento de trajetórias em ambientes dinâmicos.

- Benchmarking de visão computacional: Serve como um benchmark padrão para avaliar o desempenho em múltiplas tarefas de visão, incluindo deteção e seguimento de objetos.

Link to this sectionYAML do Dataset#

A Ultralytics define a configuração do conjunto de dados kitti usando um ficheiro YAML. Este ficheiro especifica os caminhos do conjunto de dados, rótulos de classe e metadados necessários para o treino. O ficheiro de configuração está disponível em https://github.com/ultralytics/ultralytics/blob/main/ultralytics/cfg/datasets/kitti.yaml.

# Ultralytics 🚀 AGPL-3.0 License - https://ultralytics.com/license

# KITTI dataset by Karlsruhe Institute of Technology and Toyota Technological Institute at Chicago

# Documentation: https://docs.ultralytics.com/datasets/detect/kitti/

# Example usage: yolo train data=kitti.yaml

# parent

# ├── ultralytics

# └── datasets

# └── kitti ← downloads here (390.5 MB)

# Train/val/test sets as 1) dir: path/to/imgs, 2) file: path/to/imgs.txt, or 3) list: [path/to/imgs1, path/to/imgs2, ..]

path: kitti # dataset root dir

train: images/train # train images (relative to 'path') 5985 images

val: images/val # val images (relative to 'path') 1496 images

names:

0: car

1: van

2: truck

3: pedestrian

4: person_sitting

5: cyclist

6: tram

7: misc

# Download script/URL (optional)

download: https://github.com/ultralytics/assets/releases/download/v0.0.0/kitti.zipLink to this sectionUtilização#

Para treinar um modelo YOLO26n no conjunto de dados kitti durante 100 epochs com um tamanho de imagem de 640, usa os seguintes comandos. Para mais detalhes, consulta a página Training.

from ultralytics import YOLO

# Load a pretrained YOLO26 model

model = YOLO("yolo26n.pt")

# Train on kitti dataset

results = model.train(data="kitti.yaml", epochs=100, imgsz=640)Também podes realizar tarefas de avaliação, inference e export diretamente a partir da linha de comandos ou da Python API usando o mesmo ficheiro de configuração.

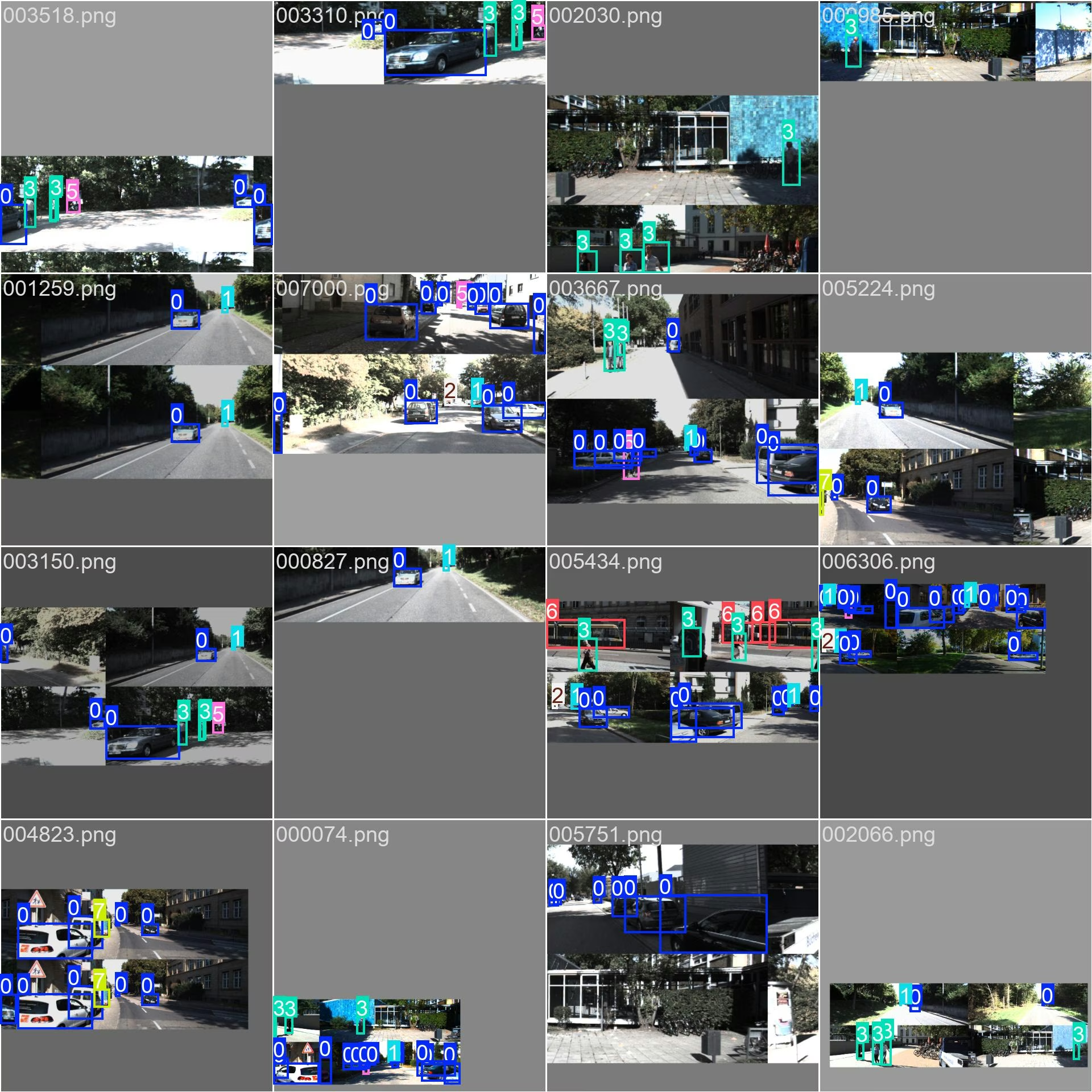

Link to this sectionAmostra de Imagens e Anotações#

O conjunto de dados kitti fornece diversos cenários de condução. Cada imagem inclui anotações de caixa delimitadora para tarefas de deteção de objetos 2D. Os exemplos demonstram a rica variedade do conjunto de dados, permitindo uma generalização robusta do modelo em diversas condições do mundo real.

Link to this sectionCitações e Agradecimentos#

Se usares o conjunto de dados kitti na tua investigação, por favor cita o seguinte artigo:

@article{Geiger2013IJRR,

author = {Andreas Geiger and Philip Lenz and Christoph Stiller and Raquel Urtasun},

title = {Vision meets Robotics: The KITTI Dataset},

journal = {International Journal of Robotics Research (IJRR)},

year = {2013}

}Reconhecemos o KITTI Vision Benchmark Suite por fornecer este conjunto de dados abrangente que continua a moldar o progresso na visão computacional, robótica e sistemas autónomos. Visita o kitti website para mais informações.

Link to this sectionFAQs#

Link to this sectionPara que é utilizado o conjunto de dados kitti?#

O conjunto de dados kitti é utilizado principalmente para investigação em visão computacional na condução autónoma, suportando tarefas como deteção de objetos, estimativa de profundidade, fluxo ótico e localização 3D.

Link to this sectionQuantas imagens estão incluídas no conjunto de dados kitti?#

O conjunto de dados inclui 5.985 imagens de treino rotuladas e 1.496 imagens de validação capturadas em cenas urbanas, rurais e de autoestrada. O conjunto de teste original é excluído aqui, uma vez que não contém anotações ground-truth.

Link to this sectionQue classes de objetos estão anotadas no conjunto de dados?#

O kitti inclui anotações para objetos como carros, peões, ciclistas, camiões, elétricos e outros utentes da estrada.

Link to this sectionPosso treinar modelos Ultralytics YOLO26 usando o conjunto de dados kitti?#

Sim, o kitti é totalmente compatível com o Ultralytics YOLO26. Podes train e validate modelos diretamente usando o ficheiro de configuração YAML fornecido.

Link to this sectionOnde posso encontrar o ficheiro de configuração do conjunto de dados kitti?#

Podes aceder ao ficheiro YAML em https://github.com/ultralytics/ultralytics/blob/main/ultralytics/cfg/datasets/kitti.yaml.