Neural Magic'in DeepSparse Motoru ile YOLO26 Çıkarımlarını Optimize Etme

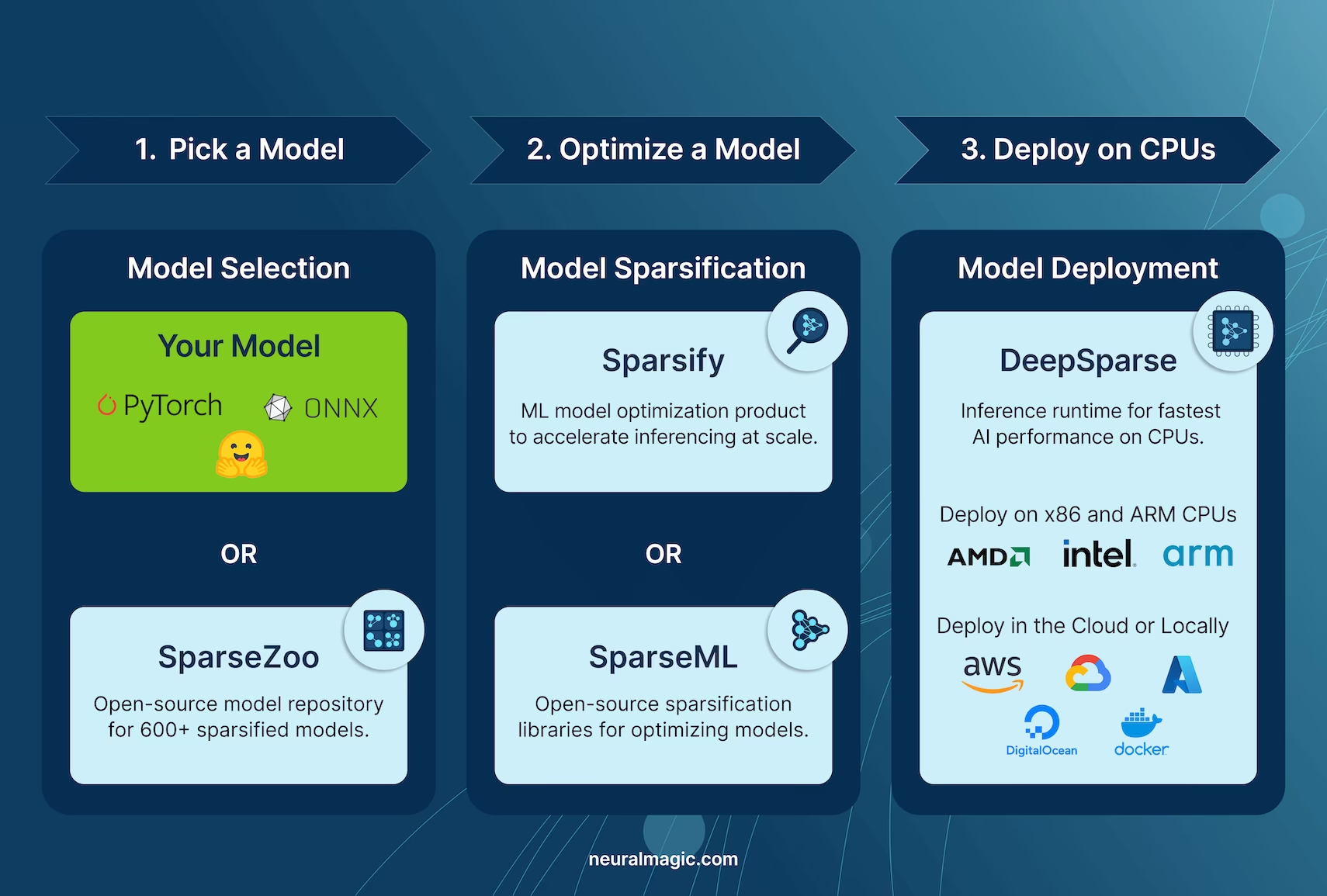

Nesne algılama modellerini, Ultralytics YOLO26 gibi, çeşitli donanımlara dağıtırken, optimizasyon gibi benzersiz sorunlarla karşılaşabilirsiniz. İşte bu noktada YOLO26'nın Neural Magic'in DeepSparse Motoru ile entegrasyonu devreye girer. Bu entegrasyon, YOLO26 modellerinin yürütülme şeklini dönüştürür ve doğrudan CPU'lar üzerinde GPU düzeyinde performans sağlar.

Bu kılavuz, Neural Magic'in DeepSparse'unu kullanarak YOLO26'yı nasıl dağıtacağınızı, çıkarımları nasıl çalıştıracağınızı ve optimize edildiğinden emin olmak için performansı nasıl kıyaslayacağınızı gösterir.

SparseML Kullanım Ömrü Sonu

Neural Magic şuydu: Ocak 2025'te Red Hat tarafından satın alındı, ve topluluk sürümlerini kullanımdan kaldırıyor deepsparse, sparseml, sparsezoove sparsify kütüphaneler. Ek bilgi için, yayınlanan bildirime bakın Readme dosyasında sparseml GitHub deposu.

Neural Magic'in DeepSparse'u

Neural Magic'in DeepSparse'u, sinir ağlarının CPU'lar üzerindeki yürütülmesini optimize etmek için tasarlanmış bir çıkarım çalışma zamanıdır. Doğruluğu korurken hesaplama taleplerini önemli ölçüde azaltmak için seyreklik, budama ve niceleme gibi gelişmiş teknikler uygular. DeepSparse, çeşitli cihazlarda verimli ve ölçeklenebilir sinir ağı yürütmesi için çevik bir çözüm sunar.

Neural Magic'in DeepSparse'unu YOLO26 ile Entegre Etmenin Faydaları

DeepSparse kullanarak YOLO26'yı nasıl dağıtacağımıza dalmadan önce, DeepSparse kullanmanın faydalarını anlayalım. Bazı temel avantajlar şunlardır:

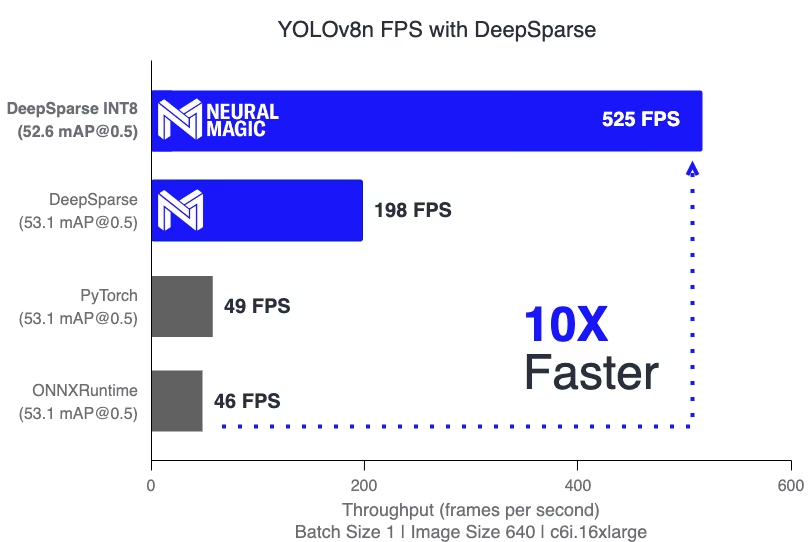

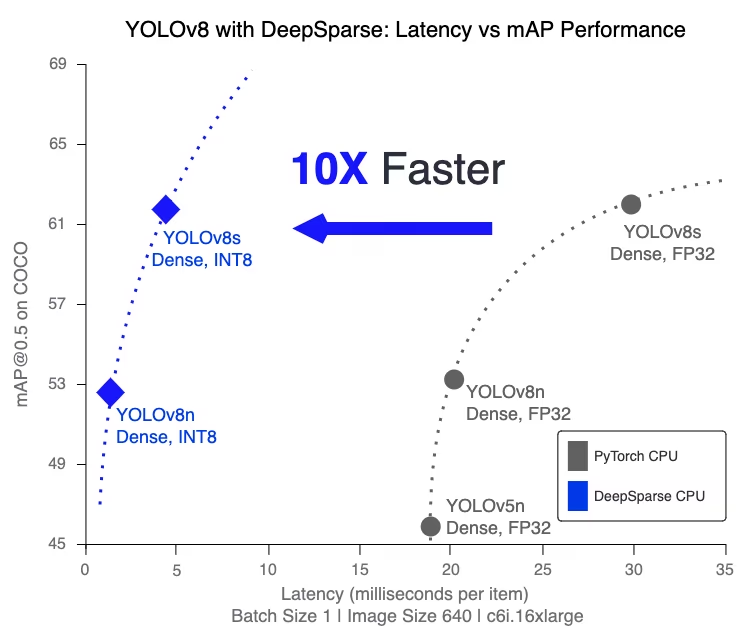

- Gelişmiş Çıkarım Hızı: Geleneksel yöntemlere kıyasla YOLO'nun çıkarım yeteneklerini önemli ölçüde hızlandırarak 525 FPS'ye kadar (YOLO11n üzerinde) ulaşır.

- Optimize Edilmiş Model Verimliliği: YOLO26'nın verimliliğini artırmak için budama ve niceleme kullanır, model boyutunu ve hesaplama gereksinimlerini azaltırken doğruluğu korur.

Standart CPU'larda Yüksek Performans: CPU'larda GPU benzeri performans sunarak çeşitli uygulamalar için daha erişilebilir ve uygun maliyetli bir seçenek sunar.

Kolaylaştırılmış Entegrasyon ve Dağıtım: Görüntü ve video açıklama özelliklerini de içeren, YOLO26'nın uygulamalara kolay entegrasyonu için kullanıcı dostu araçlar sunar.

Çeşitli Model Türleri için Destek: Hem standart hem de seyrekliği optimize edilmiş YOLO26 modelleriyle uyumludur, dağıtım esnekliği sağlar.

Uygun Maliyetli ve Ölçeklenebilir Çözüm: Operasyonel giderleri azaltır ve gelişmiş nesne algılama modellerinin ölçeklenebilir dağıtımını sunar.

Neural Magic'in DeepSparse Teknolojisi Nasıl Çalışır?

Neural Magic'in DeepSparse teknolojisi, insan beyninin sinir ağı hesaplamasındaki verimliliğinden ilham almıştır. Beyinden aşağıdaki iki temel ilkeyi benimser:

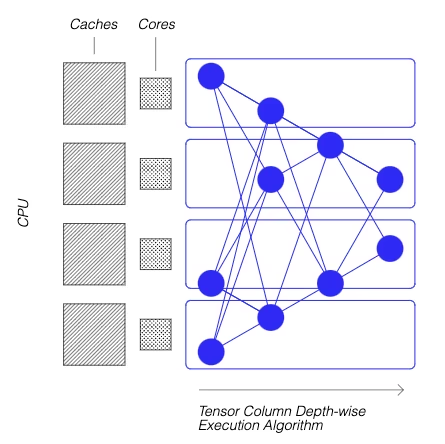

Seyreklik: Seyreltme işlemi, doğruluktan ödün vermeden daha küçük ve daha hızlı modellere yol açan derin öğrenme ağlarından yedekli bilgileri ayıklamayı içerir. Bu teknik, ağın boyutunu ve hesaplama ihtiyaçlarını önemli ölçüde azaltır.

Referans Yerelliği (Locality of Reference): DeepSparse, ağı Tensor Sütunlarına ayırarak benzersiz bir yürütme yöntemi kullanır. Bu sütunlar, tamamen CPU'nun önbelleğine sığacak şekilde derinlemesine yürütülür. Bu yaklaşım, beynin verimliliğini taklit ederek veri hareketini en aza indirir ve CPU'nun önbellek kullanımını en üst düzeye çıkarır.

Özel Bir Veri Kümesi Üzerinde Eğitilmiş YOLO26'nın Seyrek Bir Sürümünü Oluşturma

Neural Magic tarafından geliştirilen açık kaynaklı bir model deposu olan SparseZoo, önceden seyreltilmiş YOLO26 model kontrol noktaları koleksiyonu sunar. Ultralytics ile sorunsuz bir şekilde entegre olan SparseML ile kullanıcılar, bu seyrek kontrol noktalarını belirli veri kümeleri üzerinde basit bir komut satırı arayüzü kullanarak zahmetsizce ince ayar yapabilirler.

Daha fazla ayrıntı için Neural Magic'in SparseML YOLO26 belgelerine göz atın.

Kullanım: DeepSparse Kullanarak YOLO26'yı Dağıtma

Neural Magic'in DeepSparse'u ile YOLO26'yı dağıtmak birkaç basit adım içerir. Kullanım talimatlarına dalmadan önce, Ultralytics tarafından sunulan YOLO26 modelleri yelpazesini kontrol ettiğinizden emin olun. Bu, proje gereksinimleriniz için en uygun modeli seçmenize yardımcı olacaktır. İşte nasıl başlayabileceğiniz.

Adım 1: Kurulum

Gerekli paketleri kurmak için şunu çalıştırın:

Kurulum

# Install the required packages

pip install deepsparse[yolov8]

Adım 2: YOLO26'yı ONNX Formatına Aktarma

DeepSparse Motoru, YOLO26 modellerini ONNX formatında gerektirir. Modelinizi bu formata aktarmak, DeepSparse ile uyumluluk için çok önemlidir. YOLO26 modellerini dışa aktarmak için aşağıdaki komutu kullanın:

Model Dışa Aktarma

# Export YOLO26 model to ONNX format

yolo task=detect mode=export model=yolo26n.pt format=onnx opset=13

Bu komut şunu kaydedecektir: yolo26n.onnx modelinizi diskinize kaydetmenizi sağlar.

Adım 3: Çıkarımları Dağıtma ve Çalıştırma

YOLO26 modeliniz ONNX formatında olduğunda, DeepSparse kullanarak dağıtım yapabilir ve çıkarımlar çalıştırabilirsiniz. Bu, sezgisel Python API'leri ile kolayca yapılabilir:

Çıkarımları Dağıtma ve Çalıştırma

from deepsparse import Pipeline

# Specify the path to your YOLO26 ONNX model

model_path = "path/to/yolo26n.onnx"

# Set up the DeepSparse Pipeline

yolo_pipeline = Pipeline.create(task="yolov8", model_path=model_path)

# Run the model on your images

images = ["path/to/image.jpg"]

pipeline_outputs = yolo_pipeline(images=images)

Adım 4: Performansı Kıyaslama

YOLO26 modelinizin DeepSparse üzerinde en iyi şekilde performans gösterdiğini kontrol etmek önemlidir. İş hacmini ve gecikmeyi analiz etmek için modelinizin performansını kıyaslayabilirsiniz:

Kıyaslama

# Benchmark performance

deepsparse.benchmark model_path="path/to/yolo26n.onnx" --scenario=sync --input_shapes="[1,3,640,640]"

Adım 5: Ek Özellikler

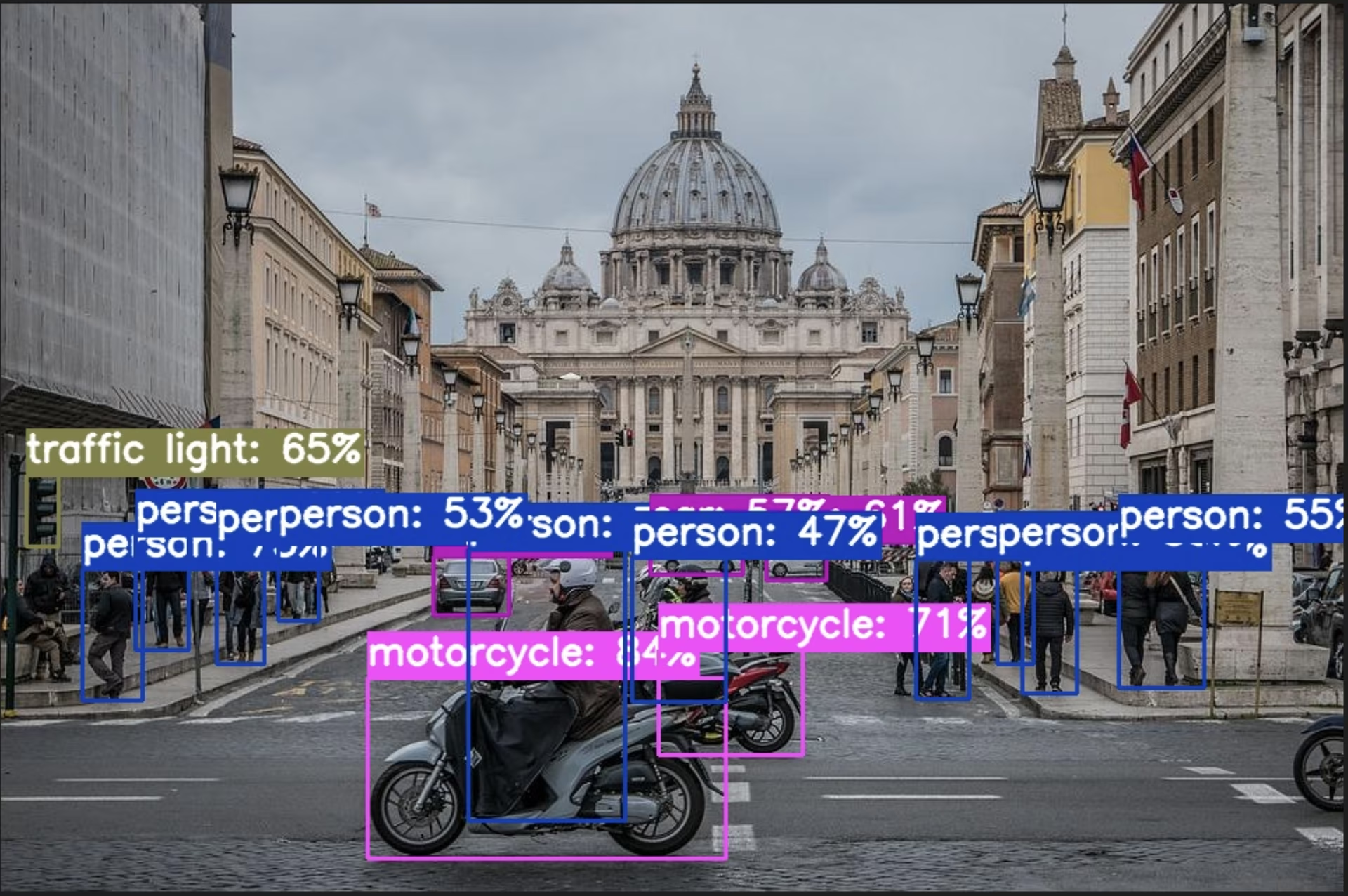

DeepSparse, görüntü açıklama ve veri kümesi değerlendirmesi gibi uygulamalarda YOLO26'nın pratik entegrasyonu için ek özellikler sunar.

Ek Özellikler

# For image annotation

deepsparse.yolov8.annotate --source "path/to/image.jpg" --model_filepath "path/to/yolo26n.onnx"

# For evaluating model performance on a dataset

deepsparse.yolov8.eval --model_path "path/to/yolo26n.onnx"

Açıklama ekle komutunu çalıştırmak, belirttiğiniz görüntüyü işler, nesneleri algılar ve açıklamalı görüntüyü sınırlayıcı kutular ve sınıflandırmalarla kaydeder. Açıklamalı görüntü, bir açıklama-sonuçları klasöründe saklanacaktır. Bu, modelin algılama yeteneklerinin görsel bir temsilini sağlamaya yardımcı olur.

eval komutunu çalıştırdıktan sonra, kesinlik, geri çağırma ve mAP (ortalama Hassasiyet Ortalaması) gibi ayrıntılı çıktı metrikleri alacaksınız. Bu, modelinizin veri kümesi üzerindeki performansına dair kapsamlı bir görünüm sunar ve YOLO26 modellerinizi belirli kullanım durumları için ince ayar yapmak ve optimize etmek, yüksek doğruluk ve verimlilik sağlamak için özellikle yararlıdır.

Özet

Bu kılavuz, Ultralytics'in YOLO26'sını Neural Magic'in DeepSparse Motoru ile entegre etmeyi inceledi. Bu entegrasyonun, GPU düzeyinde verimlilik ve gelişmiş sinir ağı seyreklik teknikleri sunarak YOLO26'nın CPU platformlarındaki performansını nasıl artırdığını vurguladı.

Daha ayrıntılı bilgi ve gelişmiş kullanım için Neural Magic tarafından hazırlanan DeepSparse belgelerini ziyaret edin. Ayrıca YOLO26 entegrasyon kılavuzunu keşfedebilir ve YouTube'da bir tanıtım oturumu izleyebilirsiniz.

Ek olarak, çeşitli YOLO26 entegrasyonları hakkında daha geniş bir anlayış için, bir dizi başka heyecan verici entegrasyon olanağını keşfedebileceğiniz Ultralytics entegrasyon kılavuzu sayfasını ziyaret edin.

SSS

Neural Magic'in DeepSparse Motoru nedir ve YOLO26 performansını nasıl optimize eder?

Neural Magic'in DeepSparse Motoru, seyreklik, budama ve niceleme gibi gelişmiş teknikler aracılığıyla sinir ağlarının CPU'lar üzerinde yürütülmesini optimize etmek için tasarlanmış bir çıkarım çalışma zamanıdır. DeepSparse'u YOLO26 ile entegre ederek, standart CPU'larda GPU benzeri performans elde edebilir, çıkarım hızını, model verimliliğini ve genel performansı doğruluğu koruyarak önemli ölçüde artırabilirsiniz. Daha fazla ayrıntı için Neural Magic'in DeepSparse bölümüne göz atın.

Neural Magic'in DeepSparse'unu kullanarak YOLO26'yı dağıtmak için gerekli paketleri nasıl kurabilirim?

Neural Magic'in DeepSparse'u ile YOLO26'yı dağıtmak için gerekli paketleri kurmak basittir. Bunları CLI kullanarak kolayca kurabilirsiniz. İşte çalıştırmanız gereken komut:

pip install deepsparse[yolov8]

Kurulduktan sonra, ortamınızı kurmak ve DeepSparse'u YOLO26 ile kullanmaya başlamak için Kurulum bölümünde verilen adımları izleyin.

YOLO26 modellerini DeepSparse ile kullanmak için ONNX formatına nasıl dönüştürürüm?

YOLO26 modellerini DeepSparse ile uyumluluk için gerekli olan ONNX formatına dönüştürmek için aşağıdaki CLI komutunu kullanabilirsiniz:

yolo task=detect mode=export model=yolo26n.pt format=onnx opset=13

Bu komut, YOLO26 modelinizi dışa aktaracaktır (yolo26n.pt) biçimine (yolo26n.onnx), DeepSparse Motoru tarafından kullanılabilen bir formattır. Model dışa aktarımı hakkında daha fazla bilgiyi şurada bulabilirsiniz: Model Dışa Aktarma bölümü.

DeepSparse Motoru üzerinde YOLO26 performansını nasıl kıyaslarım?

DeepSparse üzerinde YOLO26 performansını kıyaslamak, modelinizin optimize edildiğinden emin olmak için iş hacmi ve gecikmeyi analiz etmenize yardımcı olur. Bir kıyaslama çalıştırmak için aşağıdaki CLI komutunu kullanabilirsiniz:

deepsparse.benchmark model_path="path/to/yolo26n.onnx" --scenario=sync --input_shapes="[1,3,640,640]"

Bu komut size hayati performans metrikleri sağlayacaktır. Daha fazla ayrıntı için Performans Kıyaslama bölümüne bakın.

Nesne algılama görevleri için Neural Magic'in DeepSparse'unu YOLO26 ile neden kullanmalıyım?

Neural Magic'in DeepSparse'unu YOLO26 ile entegre etmek çeşitli avantajlar sunar:

- Gelişmiş Çıkarım Hızı: DeepSparse'un optimizasyon yeteneklerini göstererek 525 FPS'ye kadar (YOLO11n üzerinde) ulaşır.

- Optimize Edilmiş Model Verimliliği: Doğruluğu korurken model boyutunu ve hesaplama ihtiyaçlarını azaltmak için seyreklik, budama ve niceleme tekniklerini kullanır.

- Standart CPU'larda Yüksek Performans: Uygun maliyetli CPU donanımında GPU benzeri performans sunar.

- Kolaylaştırılmış Entegrasyon: Kolay dağıtım ve entegrasyon için kullanıcı dostu araçlar.

- Esneklik: Hem standart hem de seyreklik optimize edilmiş YOLO26 modellerini destekler.

- Uygun Maliyetli: Verimli kaynak kullanımı yoluyla operasyonel giderleri azaltır.

Bu avantajlara daha derinlemesine bakmak için Neural Magic'in DeepSparse'unu YOLO26 ile Entegre Etmenin Faydaları bölümünü ziyaret edin.