クラウドトレーニング

Ultralytics Platformのクラウドトレーニングは、クラウドGPUでのワンクリックトレーニングを提供し、複雑なセットアップなしでモデルトレーニングを可能にします。リアルタイムのメトリクスストリーミングと自動チェックポイント保存機能により、YOLOモデルをトレーニングできます。

graph LR

A[Configure] --> B[Start Training]

B --> C[Provision GPU]

C --> D[Download Dataset]

D --> E[Train]

E --> F[Stream Metrics]

F --> G[Save Checkpoints]

G --> H[Complete]

style A fill:#2196F3,color:#fff

style B fill:#FF9800,color:#fff

style E fill:#9C27B0,color:#fff

style H fill:#4CAF50,color:#fffトレーニング対話

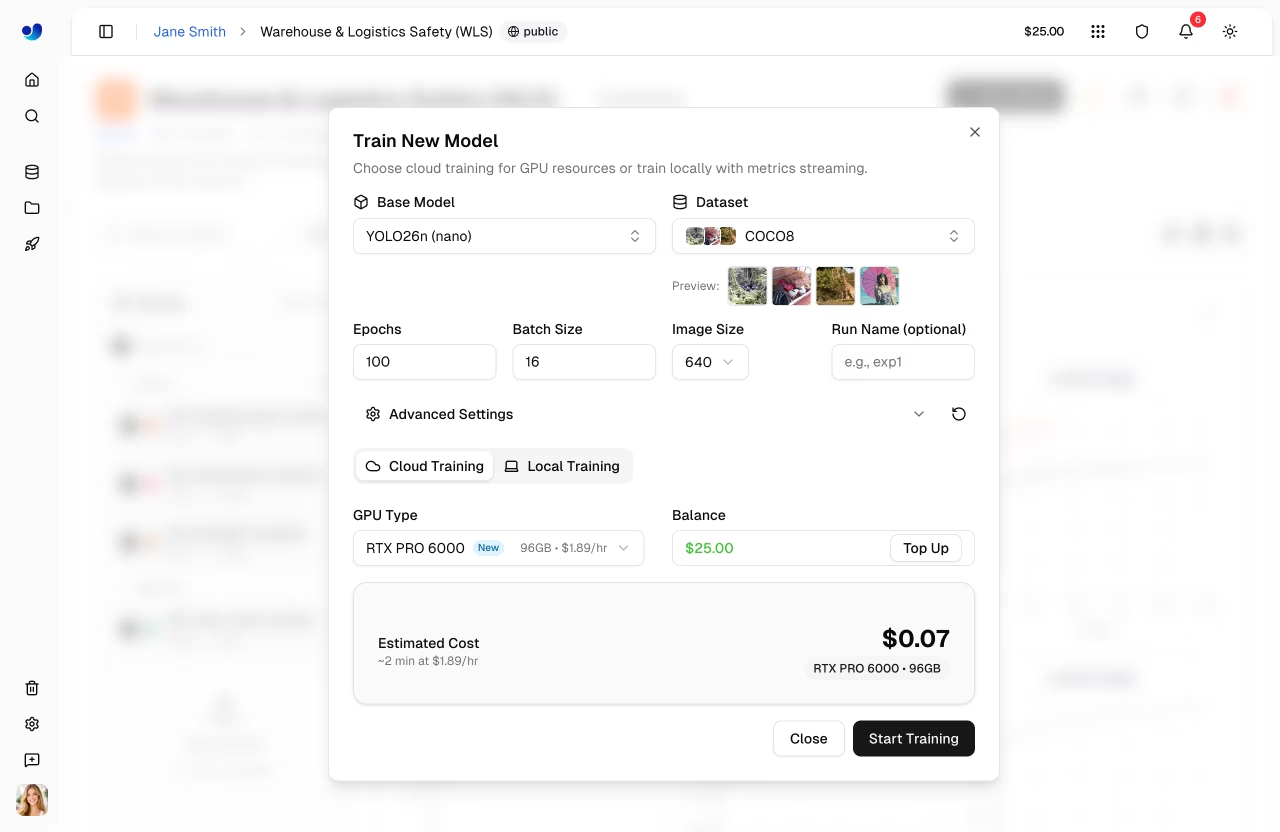

プラットフォームのUIからトレーニングを開始するには、任意のプロジェクトページで「新規モデル」をクリックするか(またはデータセットページからトレーニングを開始)、トレーニングダイアログの2つのタブ「クラウドトレーニング」と「ローカルトレーニング」を使用します。

ステップ1: 基本モデルを選択

公式のYOLO26モデル、またはご自身で学習させたモデルから選択してください。

| カテゴリー | 説明 |

|---|---|

| 公式 | すべての25個のYOLO26モデル (5サイズ x 5タスク) |

| あなたのモデル | 微調整用の完成モデル |

公式モデルはタスクタイプ(検出、セグメンテーション、姿勢推定、OBB、分類)別に整理され、サイズはnanoからxlargeまで用意されています。

ステップ2: データセットを選択する

トレーニングに使用するデータセットを選択してください(データセットを参照):

| オプション | 説明 |

|---|---|

| 公式 | Ultralytics製の厳選されたデータセット |

| あなたのデータセット | アップロード済みのデータセット |

データセット要件

データセットは次の形式である必要があります ready トレーニング分割に少なくとも1枚の画像、検証またはテスト分割に1枚の画像、および少なくとも1枚のラベル付き画像を含むステータス。

タスクの不一致

モデルタスク(例: detect)がデータセットタスク(例: segment)と一致しない場合、タスク不一致の警告が表示されます。不一致のタスクで続行すると、トレーニングは失敗します。タスクガイドに記載されているように、モデルとデータセットの両方が同じタスクタイプを使用していることを確認してください。

ステップ3: パラメータの設定

コアトレーニングパラメータを設定する:

| パラメータ | 説明 | デフォルト |

|---|---|---|

| エポック数 | トレーニングイテレーション数 | 100 |

| バッチサイズ | イテレーションあたりのサンプル数 | 16 |

| 画像サイズ | 入力解像度(320/416/512/640/1280 ドロップダウン、または YAML エディタでは 32-4096) | 640 |

| 実行名 | トレーニングランの任意の名称 | 自動 |

ステップ4: 詳細設定(任意)

詳細設定を展開すると、40以上のトレーニングパラメータがグループ別に整理された完全なyamlベースのパラメータエディタにアクセスできます(設定リファレンスを参照)。

| グループ | パラメータ |

|---|---|

| 学習率 | 学習率, 学習率, モーメンタム, 減衰率, ウォームアップエポック数, ウォームアップモーメンタム, ウォームアップバイアス学習率 |

| オプティマイザ | SGD, MuSGD,Adam,AdamW, NAdam, RAdam, RMSProp, Adamax |

| 損失重量 | box, cls, dfl, pose, kobj, label_smoothing |

| 色彩拡張 | HSV_H, HSV_S, HSV_V |

| 幾何学的拡張 | 角度、移動、スケール、シアー、パースペクティブ |

| フリップ&ミックス拡張 | flipud、fliplr、mosaic、MixUp、copy_paste |

| 訓練管理 | 忍耐、種、決定論的、アンプ、cos_lr、close_mosaic、save_period |

| データセット | フラクション、フリーズ、シングルクラス、矩形、マルチスケール、再開 |

パラメータはタスクを意識している(例: copy_paste segment のみに表示されます。 pose/kobj ポーズタスク専用)。A 修正済み 値がデフォルトと異なる場合にバッジが表示され、リセットボタンですべてをデフォルトにリセットできます。

例: 小規模データセットのためのデータ拡張の調整

For small datasets (<1000 images), increase augmentation to reduce overfitting:

mosaic: 1.0 # Keep mosaic on

mixup: 0.3 # Add mixup blending

copy_paste: 0.3 # Add copy-paste (segment only)

fliplr: 0.5 # Horizontal flip

degrees: 10.0 # Slight rotation

scale: 0.9 # Aggressive scaling

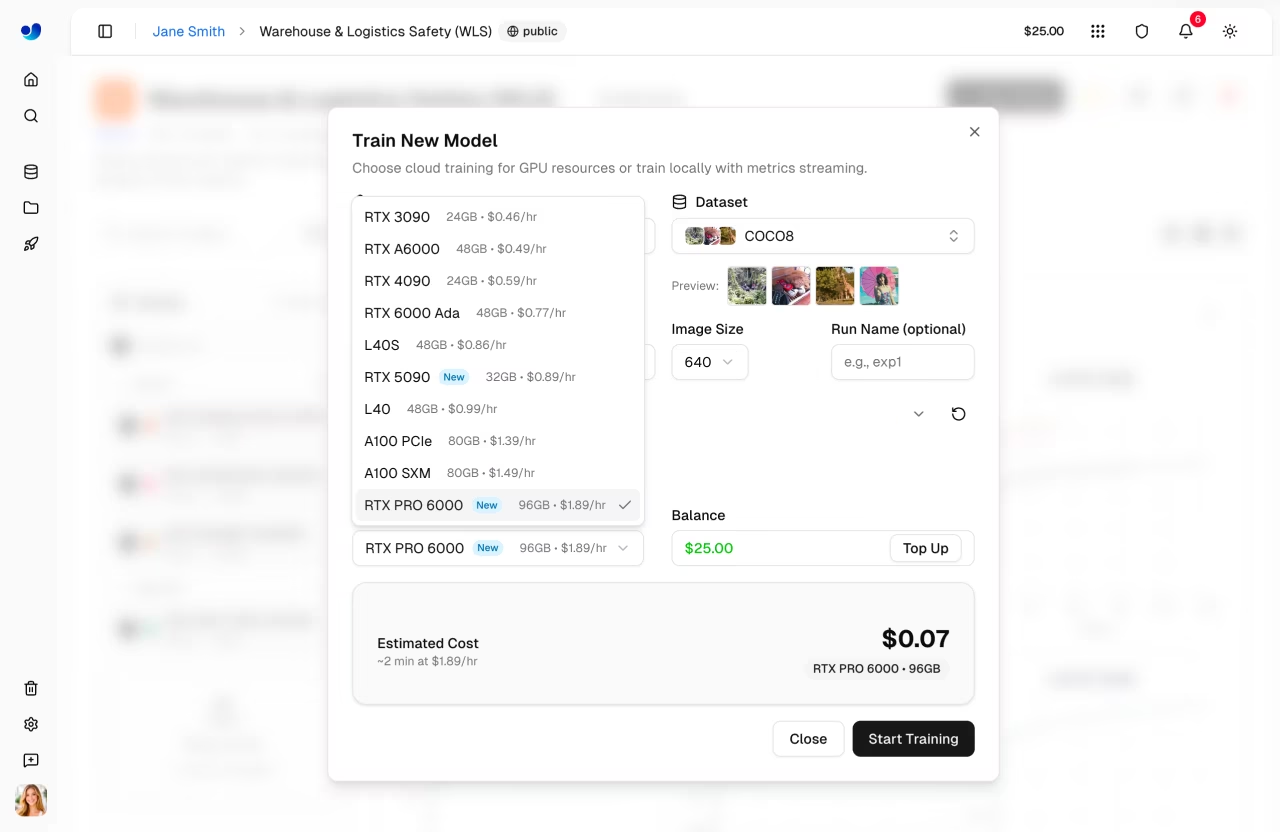

ステップ5:GPU クラウドタブ)

Ultralytics CloudからGPUを選択してください。

| GPU | 世代 | VRAM | 1時間あたりのコスト | 最適な用途 |

|---|---|---|---|---|

| RTX 2000 Ada | Ada | 16 GB | $0.24 | 小規模データセット、テスト |

| RTX A4500 | Ampere | 20 GB | $0.25 | 小規模~中規模データセット |

| RTX 4000 Ada | Ada | 20 GB | $0.26 | 中規模データセット |

| RTX A5000 | Ampere | 24 GB | $0.27 | 中規模データセット |

| L4 | Ada | 24 GB | $0.39 | 推論に最適化 |

| A40 | Ampere | 48 GB | $0.40 | より大きなバッチサイズ |

| RTX 3090 | Ampere | 24 GB | $0.46 | 一般的なトレーニング |

| RTX A6000 | Ampere | 48 GB | $0.49 | 大規模モデル |

| RTX PRO 4500 | Blackwell | 32 GB | $0.54 | 優れた価格性能比 |

| RTX 4090 | Ada | 24 GB | $0.59 | 最高のコストパフォーマンス |

| RTX 6000 Ada | Ada | 48 GB | $0.77 | 大規模バッチ学習 |

| L40S | Ada | 48 GB | $0.86 | 大規模バッチ学習 |

| RTX 5090 | Blackwell | 32 GB | $0.89 | 最新のコンシューマー世代 |

| L40 | Ada | 48 GB | $0.99 | 大規模モデル |

| A100 PCIe | Ampere | 80 GB | $1.39 | 本番環境での学習 |

| A100 SXM | Ampere | 80 GB | $1.49 | 本番環境での学習 |

| RTX PRO 6000 | Blackwell | 96 GB | $1.69 | 推奨されるデフォルト |

| H100 PCIe | Hopper | 80 GB | $2.39 | 高性能トレーニング |

| H100 SXM | Hopper | 80 GB | $2.69 | 最速の学習 |

| H100 NVL | Hopper | 94 GB | $3.07 | 最大限のパフォーマンス |

| H200 NVL | Hopper | 143 GB | $3.39 | 最大メモリ (Pro+) |

| H200 SXM | Hopper | 141 GB | $3.59 | 最大パフォーマンス (Pro+) |

| B200 | Blackwell | 180 GB | $4.99 | 最大規模のモデル (Pro+) |

GPUの選択

- RTX PRO 6000: 96 GB Blackwell世代、ほとんどのジョブで推奨されるデフォルト

- A100 SXM: 大規模なバッチサイズや大規模なモデルに必要です。

- H100/H200: 時間に制約のあるトレーニング向けに最大限のパフォーマンスを発揮します (H200にはProまたはEnterpriseが必要です)

- B200: 最先端のワークロード向けNVIDIA Blackwellアーキテクチャ(ProまたはEnterpriseが必要)

ダイアログには現在の残高と「チャージ」ボタンが表示されます。見積もり費用と所要時間は、設定内容(モデルサイズ、データセット画像数、エポック数、GPU )に基づいて計算されます。

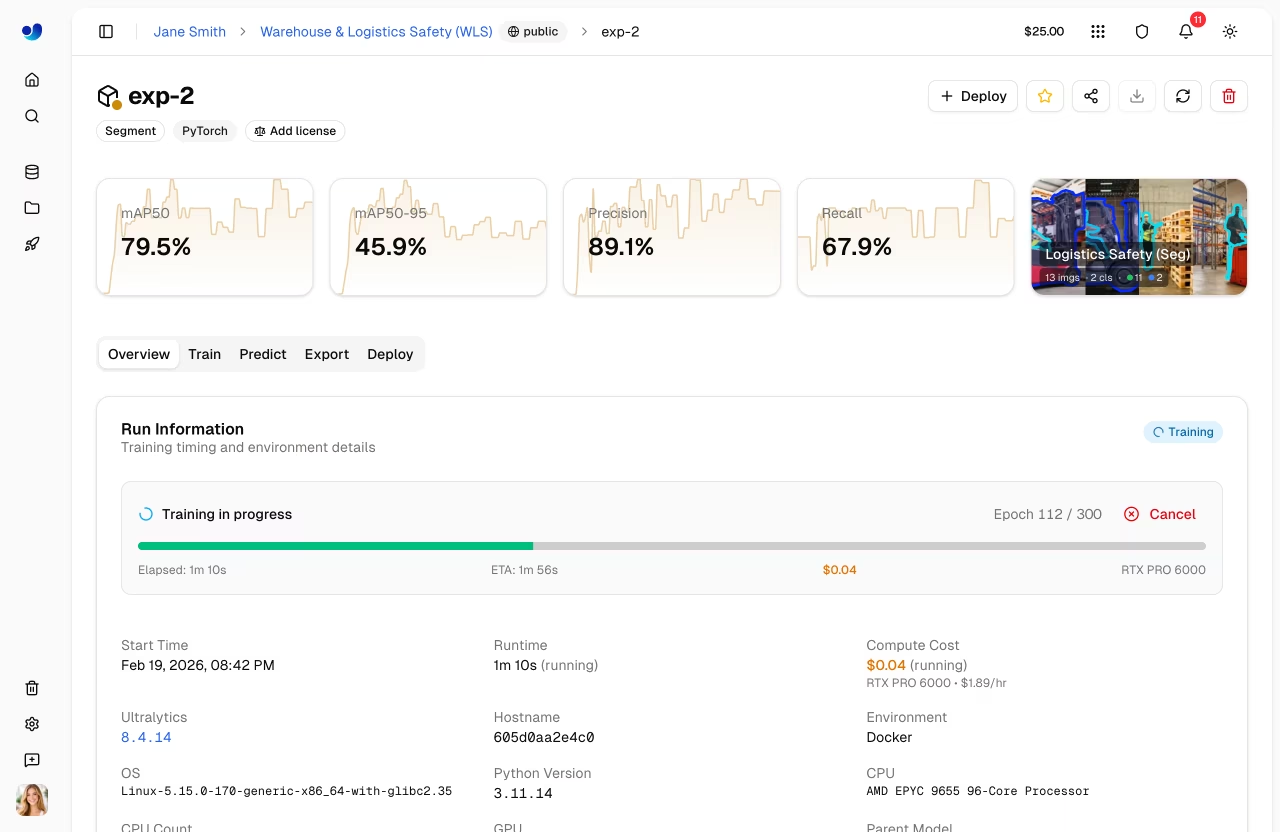

ステップ6: トレーニングを開始する

トレーニングを開始をクリックしてジョブを起動します。プラットフォームは以下の通りです:

- GPUインスタンスをプロビジョニングします

- データセットをダウンロードします

- トレーニングを開始します

- メトリクスをリアルタイムでストリーミングします

トレーニング業務ライフサイクル

トレーニングジョブは以下のステータスを経て進行します:

| ステータス | 説明 |

|---|---|

| 保留中 | ジョブを送信しました。GPU を待機中です。 |

| 開始 | GPU 。データセットとモデルのダウンロード中です。 |

| ランニング | トレーニング進行中、メトリクスがリアルタイムでストリーミング中 |

| 完了 | トレーニングは無事に終了しました |

| 失敗 | トレーニングに失敗しました(詳細はコンソールログを参照してください) |

| キャンセル済み | トレーニングはユーザーによってキャンセルされました |

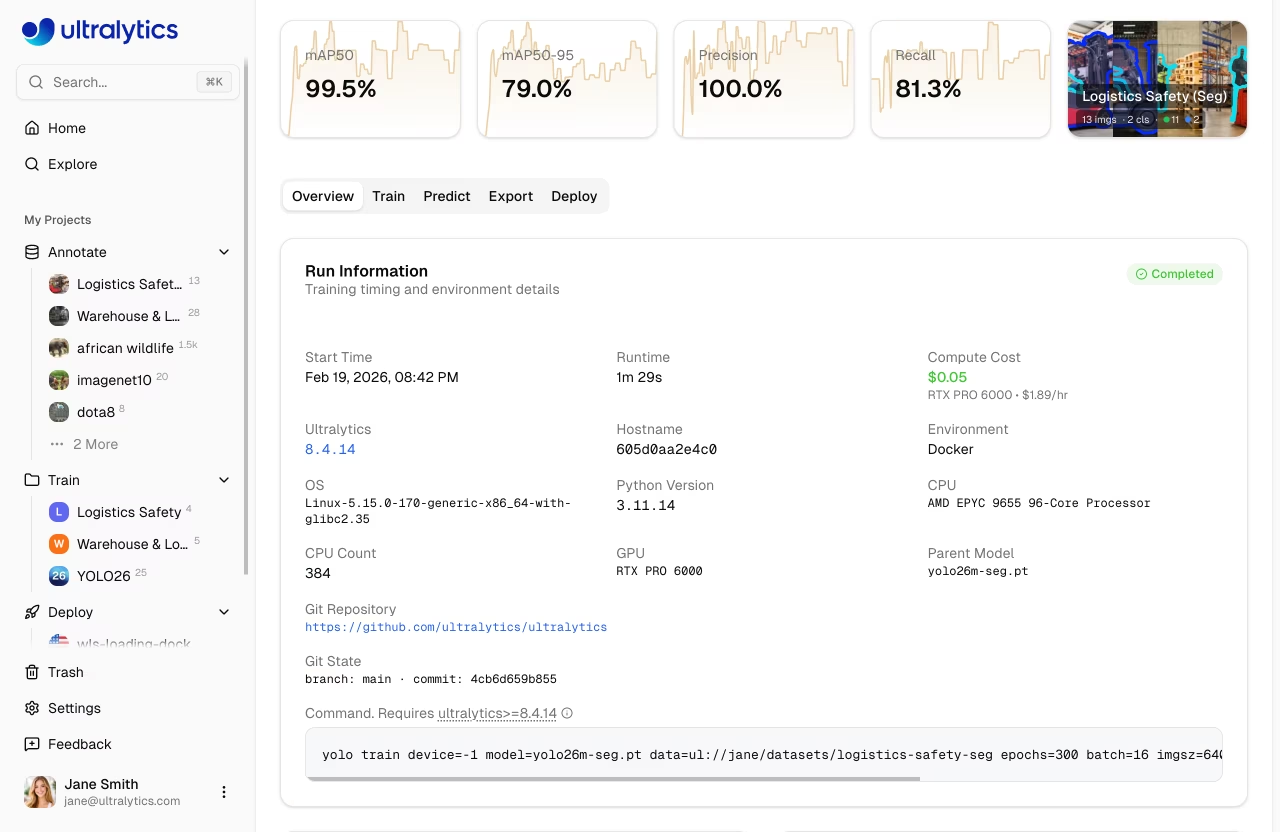

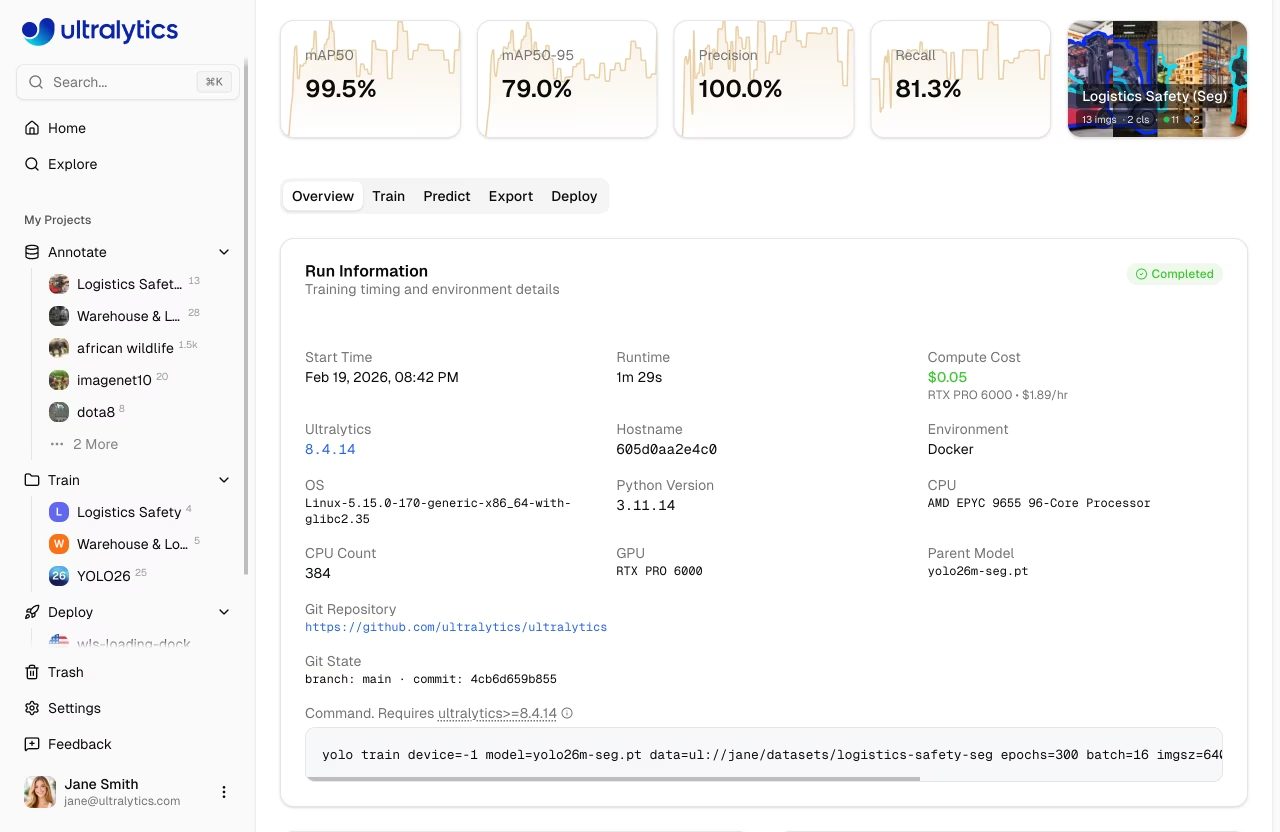

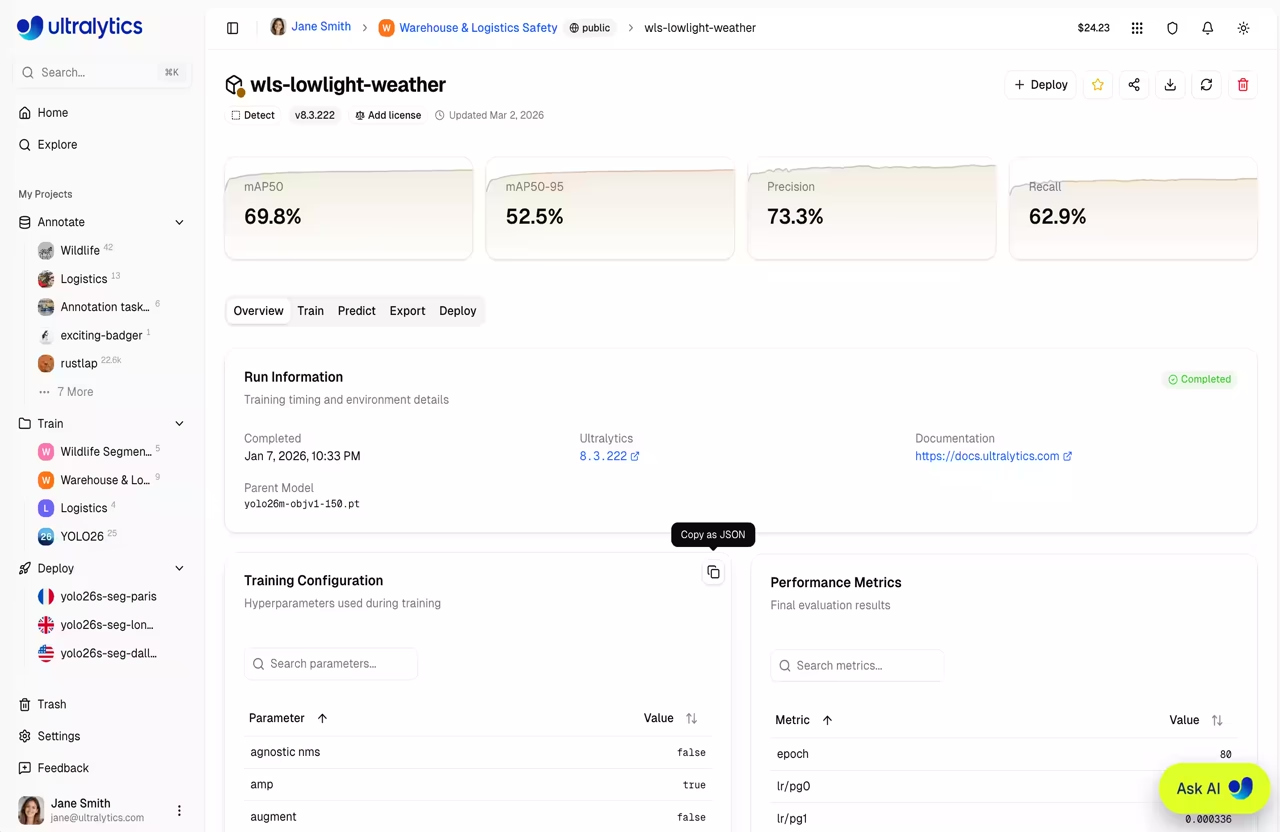

トレーニングを監視する

モデルページの「トレーニング」タブで、トレーニングの進捗状況をリアルタイムで確認できます:

チャートサブタブ

| メトリック | 説明 |

|---|---|

| 損失 | 訓練および検証損失 |

| mAP | 平均適合率 |

| 適合率 | 正しく検出された陽性予測 |

| 再現率 | 検出された正解データ |

コンソールサブタブ

ANSIカラー対応、進行状況バー、エラー検出機能を備えたライブコンソール出力。

システムサブタブ

GPU 、メモリ、温度、CPU、ディスク使用量。

チェックポイント

チェックポイントは自動的に保存されます:

- 各エポック: 最新の重みが保存されます

- 最良モデル: 最高のmAPチェックポイントが保持されます

- 最終モデル: 訓練完了時の重み

トレーニングのキャンセル

モデルページでトレーニングをキャンセルをクリックすると、実行中のジョブが停止します。

- コンピューティングインスタンスが終了しました

- クレジットの課金が停止されます

- その時点までに保存されたチェックポイントは保持されます

リモートトレーニング

graph LR

A[Local GPU] --> B[Train]

B --> C[ultralytics Package]

C --> D[Stream Metrics]

D --> E[Platform Dashboard]

style A fill:#FF9800,color:#fff

style C fill:#2196F3,color:#fff

style E fill:#4CAF50,color:#fff自社ハードウェア上でトレーニングを行いながら、メトリクスをプラットフォームにストリーミングします。

パッケージバージョンの要件

プラットフォーム連携にはultralytics>=8.4.14が必要です。これより古いバージョンはプラットフォームでは動作しません。

pip install -U ultralytics

API キーのセットアップ

- 行く

Settings > Profile(APIキーセクション) - 新しいキーを作成します(または、ローカルトレーニングタブを開くとプラットフォームが自動的に作成します)。

- 環境変数を設定します:

export ULTRALYTICS_API_KEY="YOUR_API_KEY"

ストリーミングでのトレーニング

以下を使用します project および name メトリクスをストリーミングするためのパラメータ:

yolo train model=yolo26n.pt data=coco.yaml epochs=100 \

project=username/my-project name=experiment-1

from ultralytics import YOLO

model = YOLO("yolo26n.pt")

model.train(

data="coco.yaml",

epochs=100,

project="username/my-project",

name="experiment-1",

)

トレーニングダイアログの「ローカルトレーニング」タブには、APIキー、選択されたパラメータ、および高度な引数が含まれた事前設定済みコマンドが表示されます。

プラットフォームデータセットの使用

プラットフォームに保存されたデータセットを使用してトレーニングする ul:// URI形式:

yolo train model=yolo26n.pt data=ul://username/datasets/my-dataset epochs=100 \

project=username/my-project name=exp1

from ultralytics import YOLO

model = YOLO("yolo26n.pt")

model.train(

data="ul://username/datasets/my-dataset",

epochs=100,

project="username/my-project",

name="exp1",

)

The ul:// URI形式は自動的にデータセットをダウンロードし設定します。モデルはプラットフォーム上のデータセットに自動的にリンクされます(参照 プラットフォームデータセットの使用)。

請求

トレーニング費用はGPUの使用量に基づきます:

コスト見積もり

トレーニング開始前に、プラットフォームは総コストを次のように見積もります。

- エポックあたりの秒数を見積もる: データセットサイズ、モデルの複雑さ、画像サイズ、バッチサイズ、GPU速度から

- 総トレーニング時間の計算(1エポックあたりの秒数にエポック数を乗算し、起動オーバーヘッドを追加)

- 推定コストの計算(総トレーニング時間にGPUの時間単価を乗じて)

コストに影響を与える要因:

| 因子 | 影響 |

|---|---|

| データセットサイズ | 画像数が多いほど学習時間が長くなる(基準値:RTX 4090で1000枚あたり約2.8秒の計算時間) |

| モデルサイズ | より大きなモデル(m, l, x)は(n, s)よりも学習速度が遅い |

| エポック数 | 訓練時間に対する直接的な乗数 |

| 画像サイズ | 画像サイズが大きいほど計算量が増加:320px=0.25倍、640px=1.0倍(基準値)、1280px=4.0倍 |

| バッチサイズ | より大きなバッチは効率的である(バッチ32 = 約0.85倍の時間、バッチ8 = 約1.2倍の時間、バッチ16を基準値として) |

| GPU | より高速なGPUはトレーニング時間を短縮します(例:H100 SXMはRTX 4090より約3.4倍高速)。 |

| スタートアップのオーバーヘッド | インスタンスの初期化、データのダウンロード、ウォームアップに最大5分(データセットのサイズに応じて変動) |

費用例

推定

コスト見積もりは概算であり、多くの要因に依存します。学習ダイアログには、学習を開始する前のリアルタイムの見積もりが表示されます。

| シナリオ | GPU | 推定費用 |

|---|---|---|

| 500画像、YOLO26n、50エポック | RTX 4090 | 約0.50ドル |

| 1000枚の画像、YOLO26n、100エポック | RTX PRO 6000 | 約5ドル |

| 5000枚の画像、YOLO26s、100エポック | H100 SXM | 約23ドル |

請求フロー

graph LR

A[Estimate Cost] --> B[Balance Check]

B --> C[Train]

C --> D[Charge Actual Runtime]

style A fill:#2196F3,color:#fff

style B fill:#FF9800,color:#fff

style C fill:#9C27B0,color:#fff

style D fill:#4CAF50,color:#fffクラウドトレーニングの請求フロー:

- 見積もり:トレーニング開始前に算出された費用

- 残高チェック: 起動前に利用可能なクレジットが確認されます。

- 学習: ジョブは選択されたコンピューティングで実行されます

- 料金: 最終費用は実際の実行時間に基づきます。

消費者保護

請求は、キャンセルされた部分的な実行を含む実際の計算使用量を追跡します。失敗したトレーニング実行に対して課金されることはありません。

ジョブステータスによる請求

| ステータス | 課金されましたか? |

|---|---|

| 完了 | はい — 実際に使用されたGPU |

| キャンセル済み | はい — 開始からキャンセルまでのGPU |

| 失敗 | いいえ、失敗した実行には料金はかかりません |

| 行き詰まる | 一部請求 — 実際のトレーニング時間のみを請求 |

誤りによる追加料金は発生しません

トレーニングの実行が、設定エラー、メモリ不足、その他の問題により失敗した場合、料金は発生しません。課金対象となるのは、正常に完了した実行時間のみです。スタックしたジョブ(4時間以上活動がないもの)は自動的に終了され、GPU 実際にトレーニングGPU 時間のみが課金対象となり、アイドル時間は課金されません。

支払い方法

| メソッド | 説明 |

|---|---|

| アカウント残高 | 事前チャージ済みクレジット |

| ジョブごとの支払い | ジョブ完了時に課金 |

最低残高

トレーニング開始には、利用可能な残高がプラスであり、見積もり作業費用に十分なクレジットが必要です。

トレーニングコストの表示

トレーニング後、詳細な費用は請求タブで確認できます:

- エポックごとの費用内訳

- 総GPU時間

- 費用レポートのダウンロード

トレーニングのヒント

適切なモデルサイズの選択

| モデル | パラメータ | 最適な用途 |

|---|---|---|

| YOLO26n | 2.4M | リアルタイム、エッジデバイス |

| YOLO26s | 9.5M | 速度と精度のバランス |

| YOLO26m | 20.4M | より高い精度 |

| YOLO26l | 24.8M | プロダクション精度 |

| YOLO26x | 55.7M | 最大精度 |

トレーニング時間の最適化

コスト削減戦略

- 小規模から開始: 低予算のGPUで10〜20エポックでテストし、データセットと設定が機能することを確認します。

- 適切なGPUを使用する: RTX PRO 6000はほとんどのワークロードを適切に処理します

- データセットを検証する: トレーニングに費用をかける前にラベリングの問題を修正してください

- 早期監視: 損失がプラトーに達したらトレーニングをキャンセルします — 使用した計算時間に対してのみ支払います。

トラブルシューティング

| 問題 | ソリューション |

|---|---|

| トレーニングが0%で停止する | データセットの形式を確認し、再試行する |

| メモリ不足 | バッチサイズを減らすか、より大きなGPUを使用する |

| 精度が低い | エポック数を増やす、データ品質を確認する |

| トレーニングが遅い | より高速なGPUを検討する |

| タスク不一致エラー | モデルとデータセットのタスクが一致していることを確認してください |

よくある質問

トレーニングにはどのくらいの時間がかかりますか?

トレーニング時間は以下によって異なります:

- データセットサイズ

- モデルサイズ

- エポック数

- 選択されたGPU

一般的な時間 (画像1000枚、100エポック):

| モデル | RTX PRO 6000 | A100 SXM |

|---|---|---|

| YOLO26n | 約20分 | 約15分 |

| YOLO26m | 約40分 | 約30分 |

| YOLO26x | 約80分 | 約60分 |

おおよその時間

トレーニング時間は目安であり、データセットの複雑さ、データ拡張の設定、バッチサイズによって異なります。より正確な予測については、トレーニングダイアログのコスト見積もりを参照してください。

一晩中トレーニングできますか?

はい、トレーニングは完了するまで続行されます。トレーニングが終了すると通知が届きます。エポックベースのトレーニングに十分な残高がアカウントにあることを確認してください。

クレジットがなくなったらどうなりますか?

トレーニング実行中にクレジット残高がゼロになった場合でも、トレーニングは最後まで継続され、残高はマイナスになります。これにより、トレーニングジョブが実行途中で中断されることがなくなります。

トレーニングが完了した後、新しいトレーニングジョブを開始する前に、残高をプラスに戻すためにクレジットを追加する必要があります。完了したモデル、チェックポイント、およびすべてのトレーニング成果物は、残高に関係なく完全に保持されます。

マイナス残高

残高がマイナスの場合、新規トレーニングジョブの開始のみが制限されます。既存のデプロイメントやその他のプラットフォーム機能は通常通り動作し続けます。中断を避けるには、設定 > 請求からクレジットを追加するか、自動チャージを有効にしてください。

見積もり額より研修費用が高くなった場合はどうなりますか?

コスト見積もりは概算であり、データ読み込み速度、GPUウォームアップ、モデルの収束挙動などの要因により、実際の学習時間は異なる場合があります。実際のコストが見積もりを超えた場合、残高がマイナスになる可能性があります(上記参照)。プラットフォームは見積もりに基づいて学習を停止しません。

コスト管理のため:

- トレーニングの進捗状況をリアルタイムで把握し、必要に応じて早期に中止する

- クレジットを自動的に補充するために自動チャージを有効にする

- まずは短い実行(エポック数を少なく)から始めて、期待値を調整してください

カスタムトレーニング引数を使用できますか?

はい、トレーニングダイアログの「詳細設定」セクションを展開すると、40以上の設定可能なパラメータを備えたYAMLエディタにアクセスできます。デフォルト以外の値は、クラウドおよびローカルのトレーニングコマンドの両方に含まれます。

このYAMLエディタでは、過去のトレーニング実行から設定をインポートすることも可能です:

- 既存モデルからコピー: 完了したモデルのページには、トレーニング設定カードにJSONとしてコピーボタンがあります。JSONをコピーしてYAMLエディタに直接貼り付けると、JSON形式が自動検出され、すべてのパラメータがインポートされます。

- yamlまたはJSONを貼り付け: 有効なyamlまたはJSONトレーニング設定をエディタに貼り付けます。パラメータは自動的に検証され、範囲外の値はクランプされ、警告が表示されます。

- ファイルをドラッグ&ドロップ: ドラッグ

.yamlまたは.jsonパラメーターをインポートするには、ファイルをエディターに直接ドラッグします。

これにより、各パラメータを手動で再入力することなく、以前のトレーニング設定を簡単に再現したり、改良を加えたりすることができます。

データセットページからトレーニングできますか?

はい、データセットページの「Train」ボタンをクリックすると、データセットが事前選択されロックされた状態でトレーニングダイアログが開きます。その後、プロジェクトとモデルを選択してトレーニングを開始します。

トレーニングパラメーターリファレンス

| パラメータ | 種類 | デフォルト | 範囲 | 説明 |

|---|---|---|---|---|

epochs | int | 100 | 1-10000 | トレーニングエポック数 |

batch | int | 16 | 1-512 | バッチサイズ |

imgsz | int | 640 | 32-4096 | 入力画像サイズ |

patience | int | 100 | 1-1000 | 早期停止の許容回数 |

seed | int | 0 | 0-2147483647 | 再現性のための乱数シード |

deterministic | bool | 真実 | - | 決定論的トレーニングモード |

amp | bool | 真実 | - | 自動混合精度 |

close_mosaic | int | 10 | 0-50 | 最終Nエポックでモザイクを無効にする |

save_period | int | -1 | -1-100 | Nエポックごとにチェックポイントを保存する |

workers | int | 8 | 0-64 | データローダーワーカー数 |

cache | 選択 | false | RAMディスク/偽 | 画像をキャッシュ |

| パラメータ | 種類 | デフォルト | 範囲 | 説明 |

|---|---|---|---|---|

lr0 | float | 0.01 | 0.0001-0.1 | 初期学習率 |

lrf | float | 0.01 | 0.01-1.0 | 最終学習率係数 |

momentum | float | 0.937 | 0.6-0.98 | SGD momentum |

weight_decay | float | 0.0005 | 0.0-0.001 | L2正則化 |

warmup_epochs | float | 3.0 | 0-5 | ウォームアップエポック |

warmup_momentum | float | 0.8 | 0.5-0.95 | ウォームアップの勢い |

warmup_bias_lr | float | 0.1 | 0.0-0.2 | ウォームアップバイアス LR |

cos_lr | bool | False | - | コサイン学習率スケジューラー |

| パラメータ | 種類 | デフォルト | 範囲 | 説明 |

|---|---|---|---|---|

hsv_h | float | 0.015 | 0.0-0.1 | HSV色相拡張 |

hsv_s | float | 0.7 | 0.0-1.0 | HSV彩度 |

hsv_v | float | 0.4 | 0.0-1.0 | HSV明度 |

degrees | float | 0.0 | -45-45 | 回転角度 |

translate | float | 0.1 | 0.0-1.0 | 平行移動比率 |

scale | float | 0.5 | 0.0-1.0 | スケール係数 |

shear | float | 0.0 | -10-10 | せん断度 |

perspective | float | 0.0 | 0.0-0.001 | 視点変換 |

fliplr | float | 0.5 | 0.0-1.0 | 水平反転確率 |

flipud | float | 0.0 | 0.0-1.0 | 垂直反転確率 |

mosaic | float | 1.0 | 0.0-1.0 | モザイク拡張 |

mixup | float | 0.0 | 0.0-1.0 | MixUp拡張 |

copy_paste | float | 0.0 | 0.0-1.0 | コピー&ペースト (segment) |

| パラメータ | 種類 | デフォルト | 範囲 | 説明 |

|---|---|---|---|---|

fraction | float | 1.0 | 0.1-1.0 | 使用するデータセットの割合 |

freeze | int | null | 0-100 | 凍結する層の数 |

single_cls | bool | False | - | すべてのクラスを一つのクラスとして扱う |

rect | bool | False | - | 長方形のトレーニング |

multi_scale | float | 0.0 | 0.0-1.0 | 多段階訓練場 |

val | bool | 真実 | - | トレーニング中に検証を実行する |

resume | bool | False | - | チェックポイントからトレーニングを再開する |

| 値 | 説明 |

|---|---|

auto | 自動選択 (デフォルト) |

SGD | 確率的勾配降下法 |

MuSGD | ミューオンSGD |

Adam | Adam オプティマイザ |

AdamW | 重み減衰付きAdam |

NAdam | NAdamオプティマイザ |

RAdam | RAdamオプティマイザ |

RMSProp | RMSProp最適化アルゴリズム |

Adamax | Adamaxオプティマイザ |

| パラメータ | 種類 | デフォルト | 範囲 | 説明 |

|---|---|---|---|---|

box | float | 7.5 | 1-50 | ボックス損失の重み |

cls | float | 0.5 | 0.2-4 | 分類損失重み |

dfl | float | 1.5 | 0.4-6 | 分布焦点損失 |

pose | float | 12.0 | 1-50 | ポーズによる減量(ポーズのみ) |

kobj | float | 1.0 | 0.5-10 | キーポイントの物体性(姿勢) |

label_smoothing | float | 0.0 | 0.0-0.1 | ラベル平滑化係数 |

タスク固有のパラメータ

一部のパラメータは特定のタスクにのみ適用されます:

- 検出タスクのみ (detect、segment、pose、obb — classifyではない):

box,dfl,degrees,translate,shear,perspective,mosaic,mixup,close_mosaic - セグメントのみ:

copy_paste - ポーズのみ:

pose(損失重み),kobj(キーポイントの物体性)