Link to this sectionCOCO-Segデータセット#

COCO-Segデータセットは、COCO (Common Objects in Context) データセットの拡張版であり、インスタンスセグメンテーションの研究を支援するために特別に設計されています。COCOと同じ画像を使用しますが、より詳細なセグメンテーションアノテーションが導入されています。このデータセットは、インスタンスセグメンテーションタスクに取り組む研究者や開発者にとって、特にUltralytics YOLOモデルのトレーニングにおいて不可欠なリソースです。

Link to this sectionCOCO-Seg事前学習済みモデル#

| モデル | サイズ (ピクセル) | mAPbox 50-95(e2e) | mAPmask 50-95(e2e) | 速度 CPU ONNX (ms) | 速度 T4 TensorRT10 (ms) | パラメータ (M) | FLOPs (B) |

|---|---|---|---|---|---|---|---|

| YOLO26n-seg | 640 | 39.6 | 33.9 | 53.3 ± 0.5 | 2.1 ± 0.0 | 2.7 | 9.1 |

| YOLO26s-seg | 640 | 47.3 | 40.0 | 118.4 ± 0.9 | 3.3 ± 0.0 | 10.4 | 34.2 |

| YOLO26m-seg | 640 | 52.5 | 44.1 | 328.2 ± 2.4 | 6.7 ± 0.1 | 23.6 | 121.5 |

| YOLO26l-seg | 640 | 54.4 | 45.5 | 387.0 ± 3.7 | 8.0 ± 0.1 | 28.0 | 139.8 |

| YOLO26x-seg | 640 | 56.5 | 47.0 | 787.0 ± 6.8 | 16.4 ± 0.1 | 62.8 | 313.5 |

Link to this section主な特徴#

- COCO-Segは、オリジナルのCOCOから330K枚の画像を保持しています。

- このデータセットは、オリジナルのCOCOデータセットに含まれる80種類のオブジェクトカテゴリで構成されています。

- アノテーションには、画像内の各オブジェクトに対するより詳細なインスタンスセグメンテーションマスクが含まれるようになりました。

- COCO-Segは、物体検出のための平均適合率 (mAP) や、インスタンスセグメンテーションタスクのための平均再現率 (mAR) といった標準化された評価指標を提供しており、モデル性能の効率的な比較を可能にします。

Link to this sectionデータセットの構造#

COCO-Segデータセットは、3つのサブセットに分割されています。

- Train2017: インスタンスセグメンテーションモデルをトレーニングするための118K枚の画像。

- Val2017: モデル開発中のバリデーションに使用される5K枚の画像。

- Test2017: ベンチマークに使用される20K枚の画像。このサブセットのグラウンドトゥルースアノテーションは公開されていないため、予測結果をCOCO evaluation serverに提出してスコアリングを行う必要があります。

Link to this sectionアプリケーション#

COCO-Segは、YOLOモデルのようなインスタンスセグメンテーションにおけるディープラーニングモデルのトレーニングおよび評価に広く使用されています。アノテーション済み画像の膨大な数、オブジェクトカテゴリの多様性、そして標準化された評価指標により、コンピュータビジョンの研究者や実務家にとって不可欠なリソースとなっています。

Link to this sectionデータセット YAML#

データセットの設定を定義するために、YAML (Yet Another Markup Language) ファイルが使用されます。これにはデータセットのパス、クラス、その他の関連情報が含まれています。COCO-Segデータセットの場合、coco.yamlファイルはhttps://github.com/ultralytics/ultralytics/blob/main/ultralytics/cfg/datasets/coco.yamlで管理されています。

# Ultralytics 🚀 AGPL-3.0 License - https://ultralytics.com/license

# COCO 2017 dataset https://cocodataset.org by Microsoft

# Documentation: https://docs.ultralytics.com/datasets/detect/coco/

# Example usage: yolo train data=coco.yaml

# parent

# ├── ultralytics

# └── datasets

# └── coco ← downloads here (20.1 GB)

# Train/val/test sets as 1) dir: path/to/imgs, 2) file: path/to/imgs.txt, or 3) list: [path/to/imgs1, path/to/imgs2, ..]

path: coco # dataset root dir

train: train2017.txt # train images (relative to 'path') 118287 images

val: val2017.txt # val images (relative to 'path') 5000 images

test: test-dev2017.txt # 20288 of 40670 images, submit via https://cocodataset.org/#detection-eval

# Classes

names:

0: person

1: bicycle

2: car

3: motorcycle

4: airplane

5: bus

6: train

7: truck

8: boat

9: traffic light

10: fire hydrant

11: stop sign

12: parking meter

13: bench

14: bird

15: cat

16: dog

17: horse

18: sheep

19: cow

20: elephant

21: bear

22: zebra

23: giraffe

24: backpack

25: umbrella

26: handbag

27: tie

28: suitcase

29: frisbee

30: skis

31: snowboard

32: sports ball

33: kite

34: baseball bat

35: baseball glove

36: skateboard

37: surfboard

38: tennis racket

39: bottle

40: wine glass

41: cup

42: fork

43: knife

44: spoon

45: bowl

46: banana

47: apple

48: sandwich

49: orange

50: broccoli

51: carrot

52: hot dog

53: pizza

54: donut

55: cake

56: chair

57: couch

58: potted plant

59: bed

60: dining table

61: toilet

62: tv

63: laptop

64: mouse

65: remote

66: keyboard

67: cell phone

68: microwave

69: oven

70: toaster

71: sink

72: refrigerator

73: book

74: clock

75: vase

76: scissors

77: teddy bear

78: hair drier

79: toothbrush

# Download script/URL (optional)

download: |

from pathlib import Path

from ultralytics.utils import ASSETS_URL

from ultralytics.utils.downloads import download

# Download labels

segments = True # segment or box labels

dir = Path(yaml["path"]) # dataset root dir

urls = [ASSETS_URL + ("/coco2017labels-segments.zip" if segments else "/coco2017labels.zip")] # labels

download(urls, dir=dir.parent)

# Download data

urls = [

"http://images.cocodataset.org/zips/train2017.zip", # 19G, 118k images

"http://images.cocodataset.org/zips/val2017.zip", # 1G, 5k images

"http://images.cocodataset.org/zips/test2017.zip", # 7G, 41k images (optional)

]

download(urls, dir=dir / "images", threads=3)Link to this section使用方法#

YOLO26n-segモデルをCOCO-Segデータセットで100エポック分、画像サイズ640でトレーニングするには、以下のコードスニペットを使用できます。利用可能な引数の詳細なリストについては、モデルのトレーニングページを参照してください。

from ultralytics import YOLO

# Load a model

model = YOLO("yolo26n-seg.pt") # load a pretrained model (recommended for training)

# Train the model

results = model.train(data="coco.yaml", epochs=100, imgsz=640)Link to this sectionサンプル画像とアノテーション#

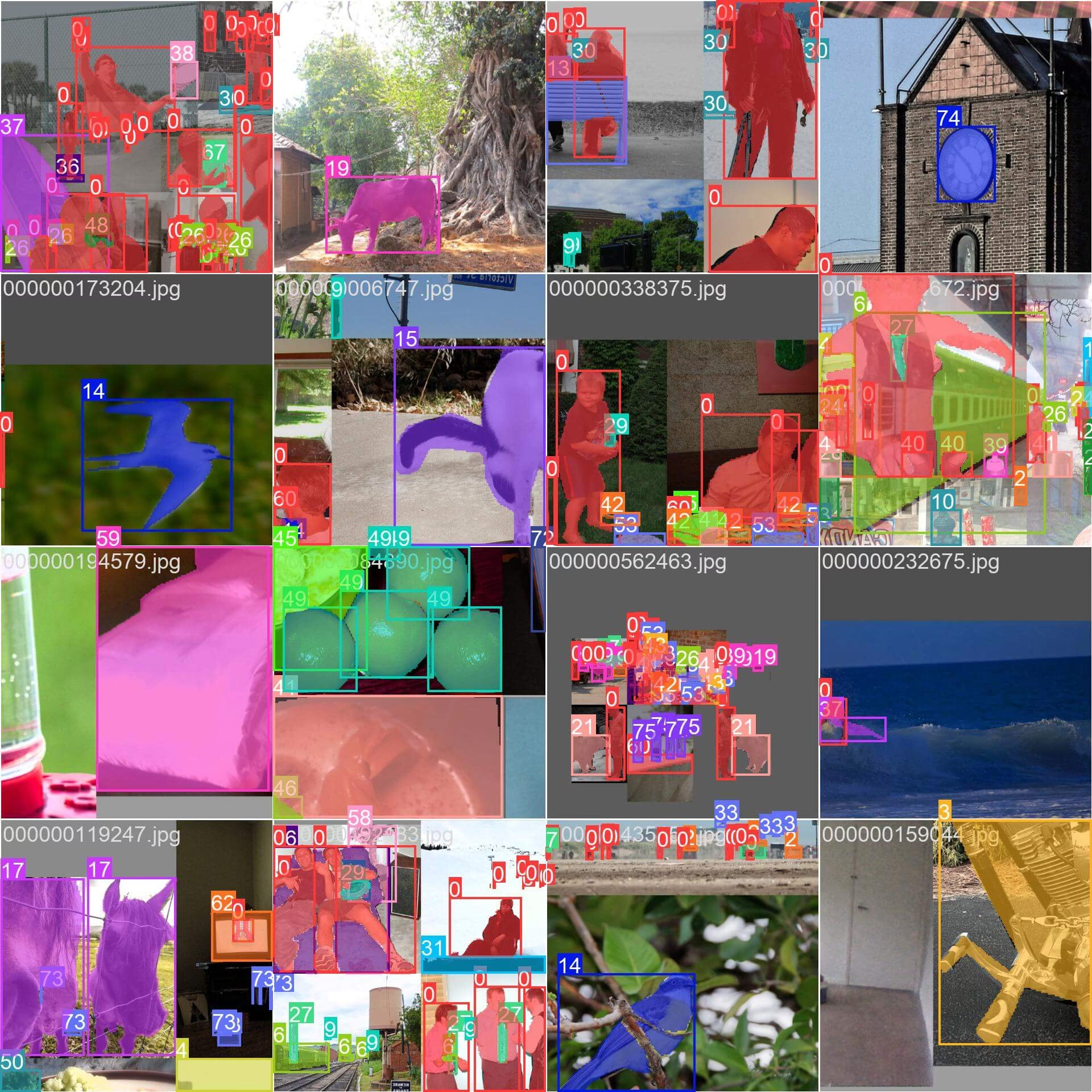

COCO-Segは、前身であるCOCOと同様に、さまざまなオブジェクトカテゴリと複雑なシーンを含む多様な画像セットを備えています。しかし、COCO-Segでは画像内の各オブジェクトに対してより詳細なインスタンスセグメンテーションマスクが導入されています。以下は、データセット内の画像とそれに対応するインスタンスセグメンテーションマスクの例です。

- モザイク画像: この画像は、モザイク処理されたデータセット画像で構成されるトレーニングバッチを示しています。モザイクは、トレーニング中に複数の画像を1つの画像に結合して、各トレーニングバッチ内のオブジェクトやシーンの多様性を高めるために使用される手法です。これは、さまざまなオブジェクトサイズ、アスペクト比、コンテキストに対してモデルが汎化する能力を向上させるのに役立ちます。

この例は、COCO-Segデータセット内の画像の多様性と複雑さ、およびトレーニングプロセス中にモザイク処理を使用する利点を示しています。

Link to this section引用と謝辞#

研究や開発の仕事でCOCO-Segデータセットを使用する場合は、オリジナルのCOCO論文を引用し、COCO-Segへの拡張について言及してください。

@misc{lin2015microsoft,

title={Microsoft COCO: Common Objects in Context},

author={Tsung-Yi Lin and Michael Maire and Serge Belongie and Lubomir Bourdev and Ross Girshick and James Hays and Pietro Perona and Deva Ramanan and C. Lawrence Zitnick and Piotr Dollár},

year={2015},

eprint={1405.0312},

archivePrefix={arXiv},

primaryClass={cs.CV}

}コンピュータビジョンコミュニティのためのこの貴重なリソースを作成・維持してくださったCOCOコンソーシアムに感謝いたします。COCOデータセットとその作成者に関する詳細については、COCOデータセットのウェブサイトをご覧ください。

Link to this sectionよくある質問 (FAQ)#

Link to this sectionCOCO-Segデータセットとは何ですか?また、オリジナルのCOCOデータセットとどう違いますか?#

COCO-Segデータセットは、インスタンスセグメンテーションタスク用に特別に設計された、オリジナルのCOCO (Common Objects in Context) データセットの拡張版です。COCOデータセットと同じ画像を使用していますが、COCO-Segにはより詳細なセグメンテーションアノテーションが含まれており、オブジェクトインスタンスセグメンテーションに注力する研究者や開発者にとって強力なリソースとなっています。

Link to this sectionCOCO-Segデータセットを使用してYOLO26モデルをトレーニングするにはどうすればよいですか?#

YOLO26n-segモデルをCOCO-Segデータセットで100エポック分、画像サイズ640でトレーニングするには、以下のコードスニペットを使用できます。利用可能な引数の詳細なリストについては、モデルのトレーニングページを参照してください。

from ultralytics import YOLO

# Load a model

model = YOLO("yolo26n-seg.pt") # load a pretrained model (recommended for training)

# Train the model

results = model.train(data="coco.yaml", epochs=100, imgsz=640)Link to this sectionCOCO-Segデータセットの主な特徴は何ですか?#

COCO-Segデータセットには、いくつかの主要な特徴があります。

- オリジナルのCOCOデータセットから330K枚の画像を保持。

- オリジナルのCOCOにある80種類のオブジェクトカテゴリをアノテーション。

- 各オブジェクトに対してより詳細なインスタンスセグメンテーションマスクを提供。

- Uses standardized evaluation metrics such as mean Average Precision (mAP) for object detection and mean Average Recall (mAR) for instance segmentation tasks.

Link to this sectionCOCO-Segで利用可能な事前学習済みモデルは何ですか?また、その性能指標はどうなっていますか?#

COCO-Segデータセットは、多様な性能指標を持つ複数の事前学習済みYOLO26セグメンテーションモデルをサポートしています。利用可能なモデルとその主要指標の概要は以下の通りです。

| モデル | サイズ (ピクセル) | mAPbox 50-95(e2e) | mAPmask 50-95(e2e) | 速度 CPU ONNX (ms) | 速度 T4 TensorRT10 (ms) | パラメータ (M) | FLOPs (B) |

|---|---|---|---|---|---|---|---|

| YOLO26n-seg | 640 | 39.6 | 33.9 | 53.3 ± 0.5 | 2.1 ± 0.0 | 2.7 | 9.1 |

| YOLO26s-seg | 640 | 47.3 | 40.0 | 118.4 ± 0.9 | 3.3 ± 0.0 | 10.4 | 34.2 |

| YOLO26m-seg | 640 | 52.5 | 44.1 | 328.2 ± 2.4 | 6.7 ± 0.1 | 23.6 | 121.5 |

| YOLO26l-seg | 640 | 54.4 | 45.5 | 387.0 ± 3.7 | 8.0 ± 0.1 | 28.0 | 139.8 |

| YOLO26x-seg | 640 | 56.5 | 47.0 | 787.0 ± 6.8 | 16.4 ± 0.1 | 62.8 | 313.5 |

これらのモデルは、軽量なYOLO26n-segから強力なYOLO26x-segまで幅広く、さまざまなアプリケーション要件に合わせて速度と精度の異なるトレードオフを提供します。モデル選択の詳細については、Ultralyticsモデルページをご覧ください。

Link to this sectionCOCO-Segデータセットはどのように構成されており、どのようなサブセットが含まれていますか?#

COCO-Segデータセットは、特定のトレーニングおよび評価のニーズに合わせて3つのサブセットに分割されています。

- Train2017: 主にインスタンスセグメンテーションモデルのトレーニングに使用される118K枚の画像が含まれています。

- Val2017: トレーニングプロセス中のバリデーションに使用される5K枚の画像で構成されています。

- Test2017: 学習済みモデルのテストおよびベンチマーク用に予約された20K枚の画像で構成されています。このサブセットのグラウンドトゥルースアノテーションは公開されておらず、パフォーマンス結果は評価のためにCOCO evaluation serverへ提出される点に注意してください。

小規模な実験ニーズには、COCO train 2017セットからわずか8枚の画像を含んだコンパクトなバージョンであるCOCO8-segデータセットの使用も検討してください。