Link to this section推論#

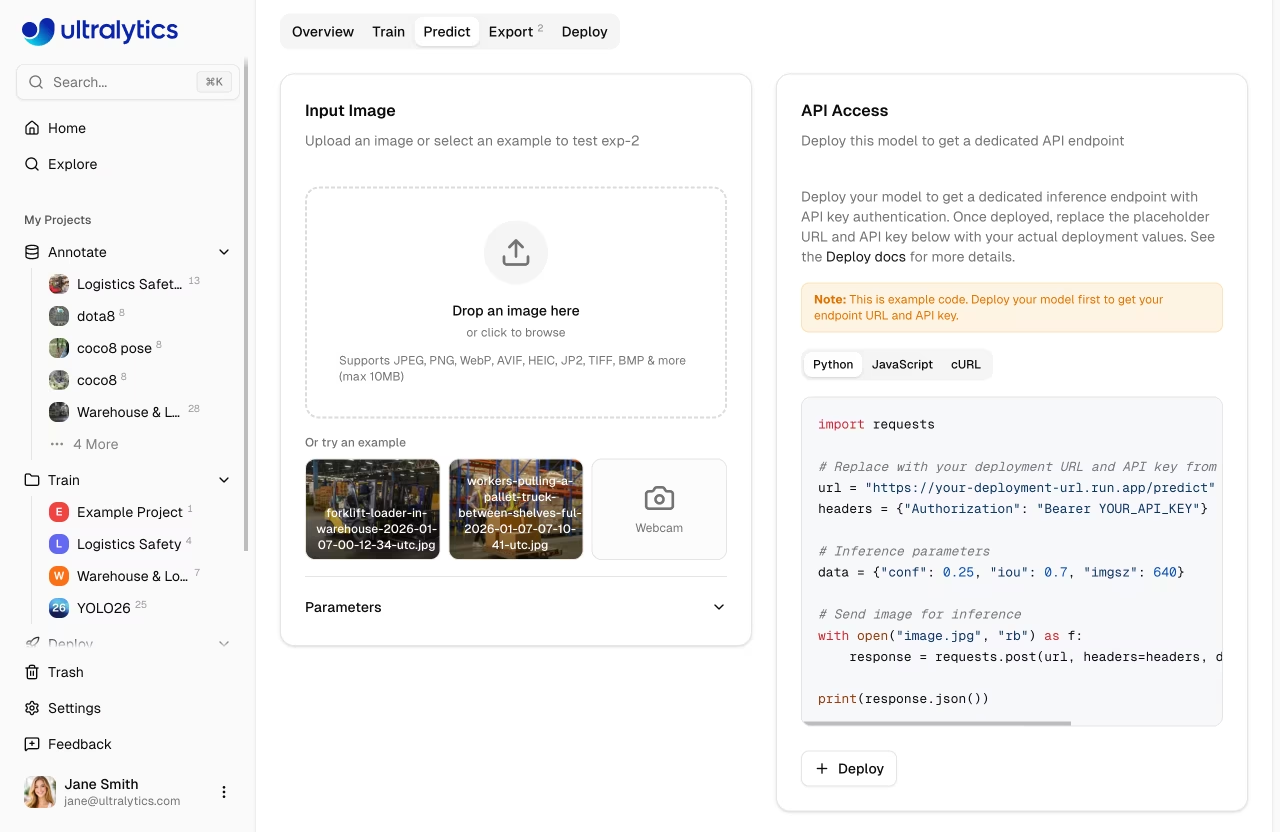

Ultralytics Platformは、トレーニング済みモデルをテストするための推論APIを提供します。ブラウザベースのPredictタブを使用して迅速に検証するか、REST APIを使用してプログラムからアクセスしてください。

Link to this section推論タブ#

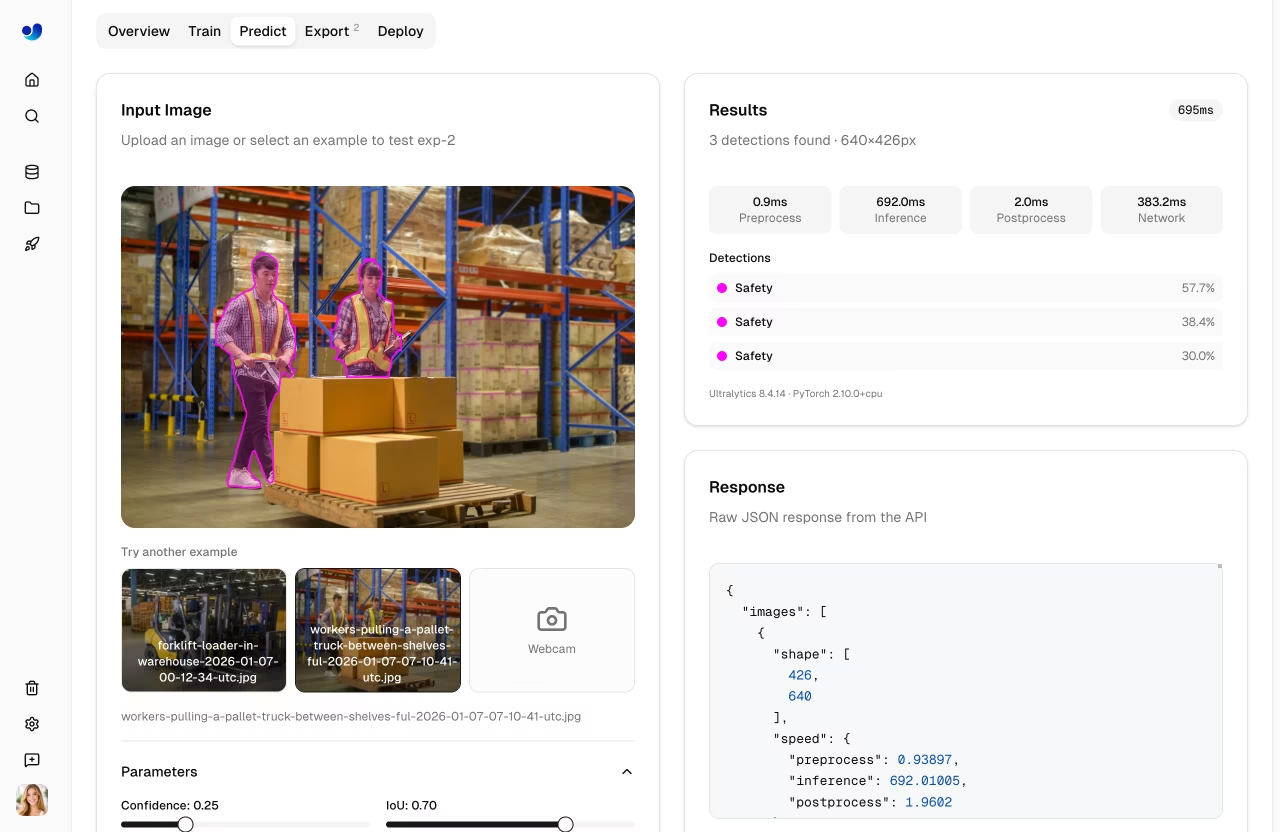

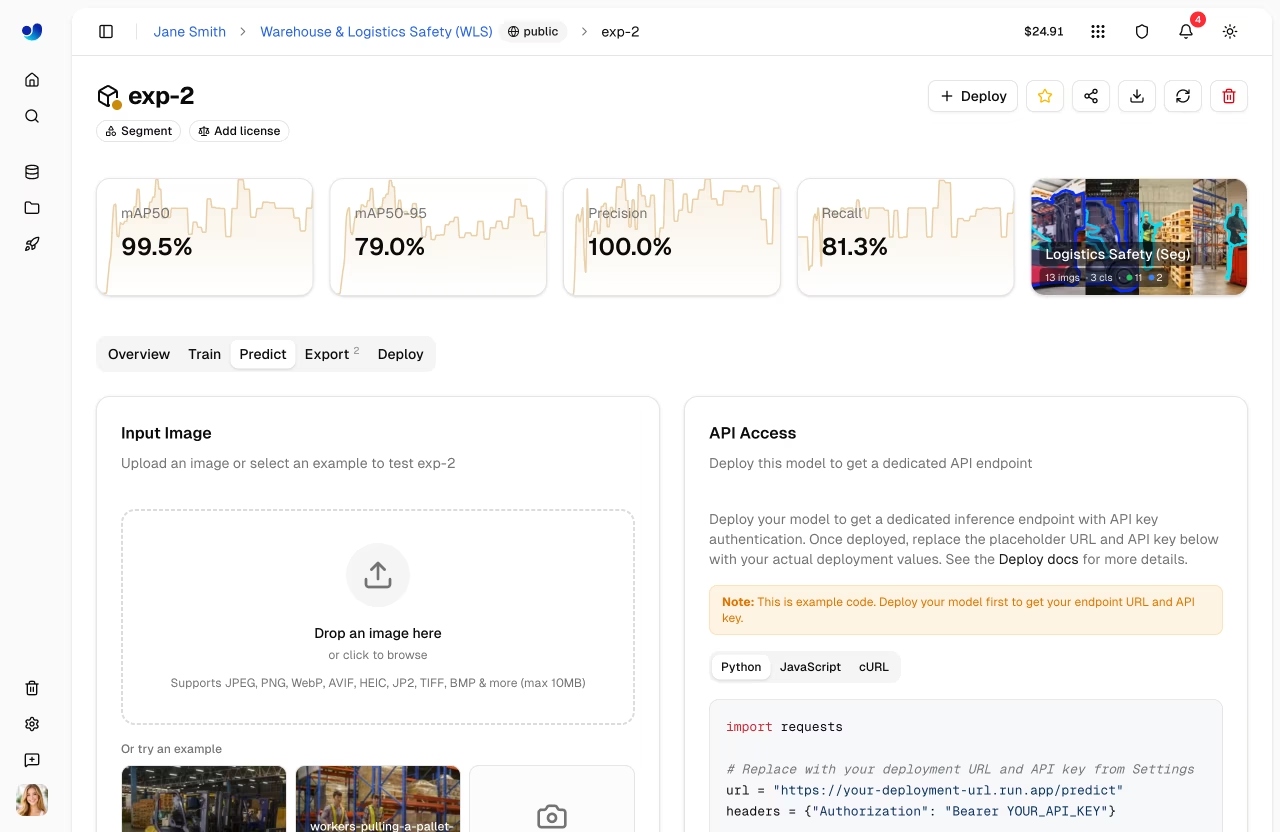

すべてのモデルには、ブラウザベースの推論を行うためのPredictタブが含まれています。

- モデルのページへ移動します

- Predictタブをクリックします

- 画像をアップロードするか、例を使用するか、Webカメラを開きます

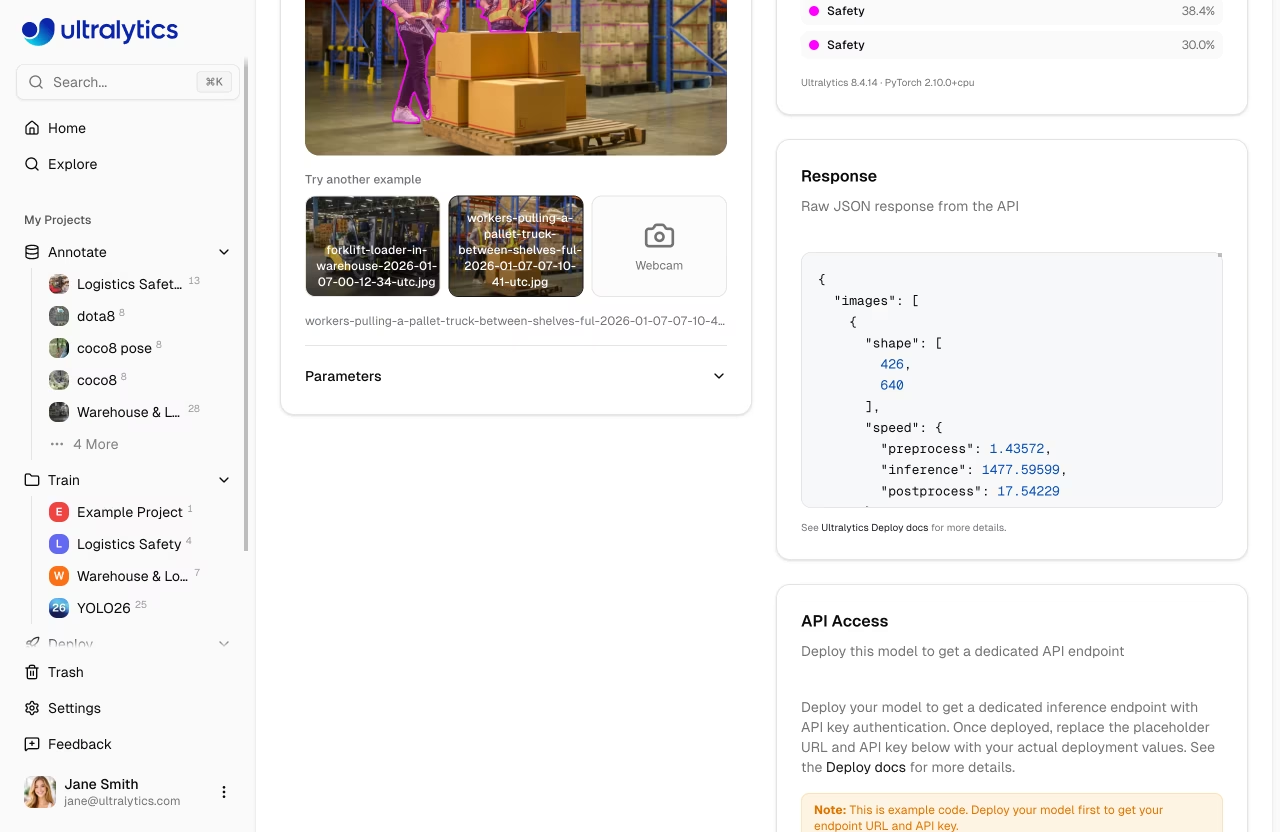

- バウンディングボックスのオーバーレイ付きの予測を即座に確認できます

Link to this section入力方法#

予測パネルは複数の入力方法をサポートしています。

| メソッド | 説明 |

|---|---|

| 画像のアップロード | ドラッグ&ドロップ、またはクリックして画像をアップロードします |

| サンプル画像 | 組み込みのサンプル(データセット画像またはデフォルト)をクリックします |

| Webカメラキャプチャ | シングルフレームキャプチャが可能なライブカメラフィード |

graph LR

A[Upload Image] --> D[Auto-Inference]

B[Example Image] --> D

C[Webcam Capture] --> D

D --> E[Results + Overlays]

style D fill:#2196F3,color:#fff

style E fill:#4CAF50,color:#fffLink to this section画像をアップロード#

ドラッグ&ドロップ、またはクリックしてアップロードします:

- 対応フォーマット: JPEG, PNG, WebP, AVIF, HEIC, JP2, TIFF, BMP, DNG, MPO

- 最大サイズ: 10MB

- 自動推論: アップロード後に結果が自動的に表示されます

予測パネルは、画像のアップロード、サンプルの選択、またはWebカメラのフレームキャプチャを行うと自動的に推論を実行します。ボタンをクリックする必要はありません。

Link to this sectionサンプル画像#

予測パネルには、モデルに関連付けられたデータセットのサンプル画像が表示されます。データセットがリンクされていない場合は、デフォルトのサンプルが使用されます:

| 画像 | コンテンツ |

|---|---|

bus.jpg | 車両が映った街中のシーン |

zidane.jpg | 人が映ったスポーツシーン |

OBBモデルの場合は、代わりにボートや空港の航空写真が表示されます。

サンプル画像はページ読み込み時にプリロードされるため、サンプルをクリックするとダウンロード待ち時間なしでほぼ瞬時に推論がトリガーされます。

Link to this sectionWebcam#

Webカメラカードをクリックしてライブカメラフィードを開始します:

- プロンプトが表示されたらカメラへのアクセスを許可します

- ビデオプレビューをクリックしてフレームをキャプチャします

- キャプチャしたフレームに対して自動的に推論が実行されます

- もう一度クリックするとWebカメラが再起動します

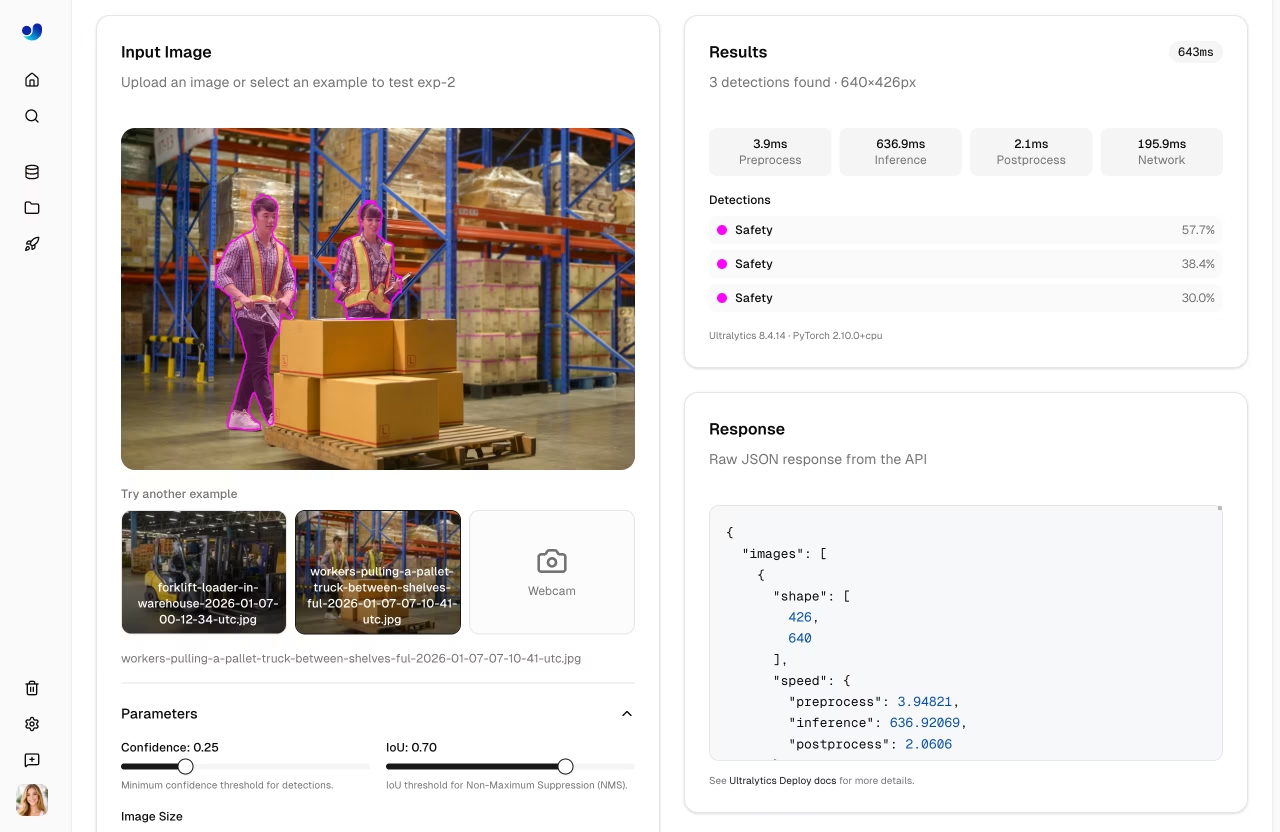

Link to this section結果を表示#

推論結果が表示されます:

- バウンディングボックスとクラスラベル(SVGオーバーレイ)

- 各検出の信頼度スコア

- クラスカラー(データセットのカラーパレットまたはUltralyticsデフォルトパレット)

- 速度の内訳: 前処理、推論、後処理、およびネットワーク時間

結果パネルには以下が表示されます:

| フィールド | 説明 |

|---|---|

| 検出リスト | クラス名と信頼度を含む各検出結果 |

| 速度統計 | 前処理、推論、後処理、ネットワーク(ms) |

| JSONレスポンス | コードブロック内の生のAPIレスポンス |

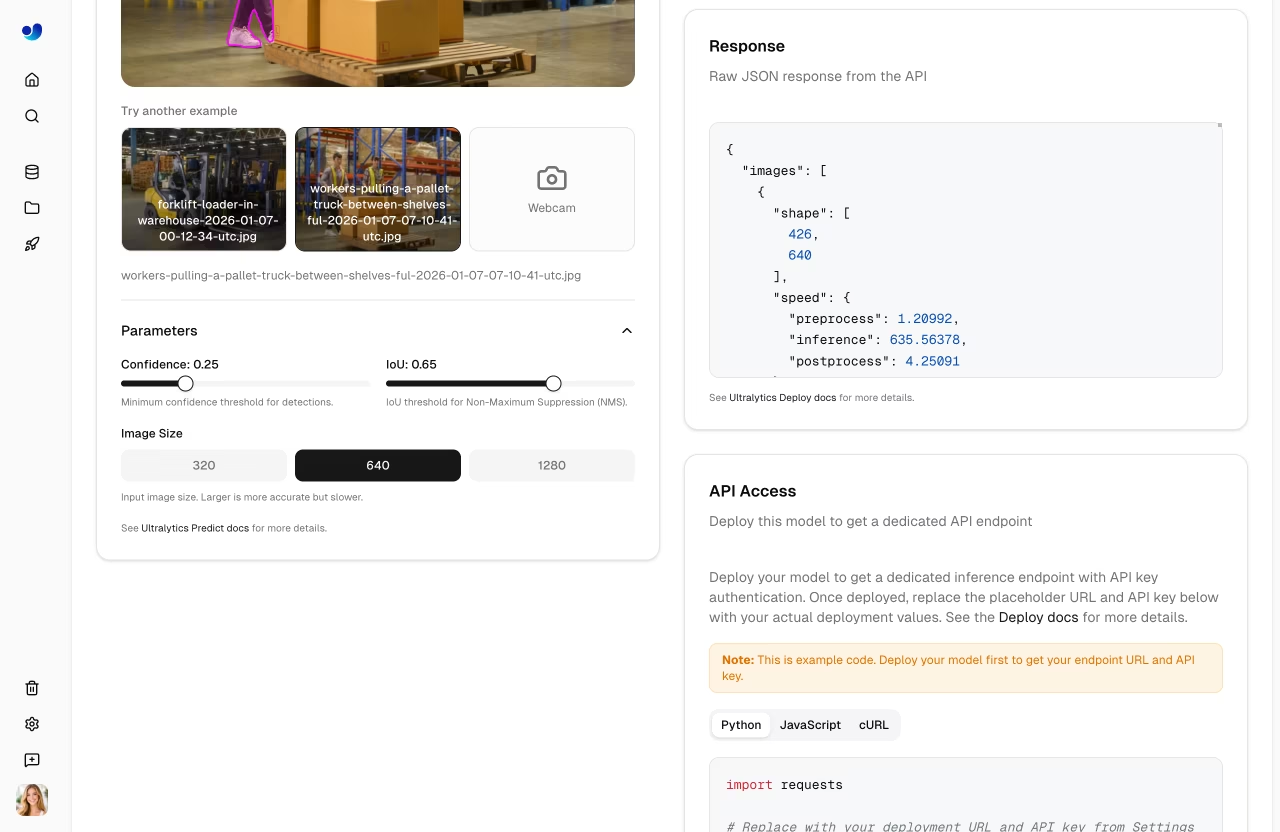

Link to this section推論パラメータ#

折りたたみ可能なパラメータセクション内のパラメータを使用して、検出動作を調整します:

| パラメータ | 範囲 | デフォルト | 説明 |

|---|---|---|---|

| Confidence | 0.01 – 1.0 | 0.25 | 最小信頼度しきい値 |

| IoU | 0.0 – 0.95 | 0.7 | NMS IoUしきい値 |

| Image Size | 320, 640, 1280 (UIトグル) | 640 | 入力リサイズ次元(APIは32~1280の任意の値を許可します) |

パラメータを変更すると、500msのデバウンスを挟んで現在の画像に対する推論が自動的に再実行されます。再アップロードは不要です。

Link to this section信頼度しきい値#

信頼度に基づいて予測をフィルタリングします:

- 高 (0.5以上): 予測数は減少しますが、より確実性が高い結果になります

- 低 (0.1-0.25): より多くの予測が得られますが、ノイズが含まれる可能性があります

- デフォルト (0.25): ほとんどのユースケースでバランスが取れています

Link to this sectionIoUしきい値#

NMS (Non-Maximum Suppression) を制御します:

- 高 (0.7以上): 重なり合うボックスをより多く許可します

- 低 (0.3-0.5): 近接する検出結果をより積極的に統合します

- デフォルト (0.7): ほとんどのユースケースでバランスの取れたNMS動作を提供します

Link to this sectionデプロイメント予測#

実行中の専用エンドポイントには、デプロイメントカードに直接Predictタブが含まれています。これは共有の予測サービスではなくデプロイメント独自の推論サービスを使用するため、ブラウザから直接デプロイされたエンドポイントをテストできます。

Link to this sectionREST API#

プログラムから推論にアクセスします:

Link to this section認証#

リクエストにAPIキーを含めてください:

Authorization: Bearer YOUR_API_KEY自身のスクリプト、ノートブック、またはアプリから推論を実行するには、APIキーを含める必要があります。Settings > API Keysでキーを生成してください。

Link to this sectionエンドポイント#

POST https://platform.ultralytics.com/api/models/{modelId}/predictLink to this sectionリクエスト#

import requests

url = "https://platform.ultralytics.com/api/models/MODEL_ID/predict"

headers = {"Authorization": "Bearer YOUR_API_KEY"}

files = {"file": open("image.jpg", "rb")}

data = {"conf": 0.25, "iou": 0.7, "imgsz": 640}

response = requests.post(url, headers=headers, files=files, data=data)

print(response.json())

Link to this sectionリクエストパラメータ#

| パラメータ | タイプ | デフォルト | 範囲 | 説明 |

|---|---|---|---|---|

file | ファイル | - | - | 画像またはビデオファイル(sourceが設定されている場合を除き必須) |

conf | float | 0.25 | 0.01 – 1.0 | 最小信頼度しきい値 |

iou | float | 0.7 | 0.0 – 0.95 | NMS IoUしきい値 |

imgsz | int | 640 | 32 – 1280 | 入力画像のサイズ(ピクセル単位) |

normalize | bool | false | - | バウンディングボックスの座標を0~1で返します |

decimals | int | 5 | 0 – 10 | 座標値の小数点以下の精度 |

source | string | - | - | 画像URLまたはbase64文字列(fileの代替として使用) |

Link to this sectionレスポンス#

{

"images": [

{

"shape": [1080, 1920],

"results": [

{

"class": 0,

"name": "person",

"confidence": 0.92,

"box": { "x1": 100, "y1": 50, "x2": 300, "y2": 400 }

},

{

"class": 2,

"name": "car",

"confidence": 0.87,

"box": { "x1": 400, "y1": 200, "x2": 600, "y2": 350 }

}

],

"speed": {

"preprocess": 1.2,

"inference": 12.5,

"postprocess": 2.3

}

}

],

"metadata": {

"imageCount": 1,

"functionTimeCall": 0.018,

"model": "model.pt",

"version": {

"ultralytics": "8.x.x",

"torch": "2.6.0",

"torchvision": "0.21.0",

"python": "3.13.0"

}

}

}

Link to this sectionレスポンスフィールド#

| フィールド | タイプ | 説明 |

|---|---|---|

images | 配列 | 処理された画像のリスト |

images[].shape | 配列 | 画像サイズ [高さ, 幅] |

images[].results | 配列 | 検出結果のリスト |

images[].results[].class | int | クラスインデックス (整数ID) |

images[].results[].name | string | クラス名 |

images[].results[].confidence | float | 検出の信頼度 (0-1) |

images[].results[].box | オブジェクト | バウンディングボックスの座標 |

images[].speed | オブジェクト | ミリ秒単位の処理時間 |

metadata | オブジェクト | リクエストのメタデータおよびバージョン情報 |

Link to this sectionタスク固有のレスポンス#

レスポンス形式はタスクによって異なります:

{

"class": 0,

"name": "person",

"confidence": 0.92,

"box": {"x1": 100, "y1": 50, "x2": 300, "y2": 400}

}Link to this section請求#

共有推論(Predictタブおよび/api/models/{id}/predictエンドポイント)は、すべてのプランで追加費用なしで含まれています。共有推論にはリクエストごとの課金はありません。

より高いスループットを必要とする本番環境のワークロードには、専用エンドポイントをデプロイしてください。

Link to this sectionレート制限#

Shared inference is rate-limited to 20 requests/min per API key. When throttled, the API returns 429 with a Retry-After header. See the full rate limit reference for all endpoint categories.

レート制限なしの無制限推論、予測可能なスループット、一貫した低レイテンシのレスポンスを実現するために、専用エンドポイントをデプロイしてください。ローカルでの推論については、Predictモードガイドを参照してください。

Link to this sectionエラーハンドリング#

一般的なエラーレスポンス:

| コード | メッセージ | 解決策 |

|---|---|---|

| 400 | 無効な画像 | ファイル形式を確認してください |

| 401 | 未承認 | APIキーを確認してください |

| 404 | モデルが見つかりません | モデルIDを確認してください |

| 429 | レート制限 | 待機して再試行するか、無制限のスループットのために専用エンドポイントを使用してください |

| 500 | サーバーエラー | リクエストを再試行 |

| 503 | サービス利用不可 | Predictサービスが起動中または到達不能です。しばらく待ってから再試行してください |

Link to this sectionよくある質問 (FAQ)#

Link to this section動画で推論を実行できますか?#

どちらの推論方法も動画ファイルを受け付けます:

- 専用エンドポイントは動画ファイルを直接受け付けます。サポートされている形式(最大100 MB):ASF、AVI、GIF、M4V、MKV、MOV、MP4、MPEG、MPG、TS、WEBM、WMV。各フレームが個別に処理され、フレームごとの結果が返されます。詳細は専用エンドポイントを参照してください。

- 共有推論(

/api/models/{id}/predict)は同じPredictサービスを使用し、同じ動画形式を受け付けます。ただし、UIのブラウザPredictタブは画像のみをアップロードします。動画ワークフローには、REST APIを直接使用するか、専用エンドポイントを使用してください。共有エンドポイントも20リクエスト/分にレート制限されているため、負荷の高い動画ワークロードには専用エンドポイントの方が適しています。

Link to this sectionアノテーション付き画像を取得するにはどうすればよいですか?#

APIはJSON形式の予測結果を返します。可視化するには:

- 予測結果を使用してローカルでボックスを描画する

- Ultralyticsの

plot()メソッドを使用する:

from ultralytics import YOLO

model = YOLO("yolo26n.pt")

results = model("image.jpg")

results[0].save("annotated.jpg")完全な結果APIと可視化オプションについては、Predictモードのドキュメントを参照してください。

Link to this section最大画像サイズはどれくらいですか?#

- アップロード制限: 10MB

- 推奨: 高速な推論のために5MB未満

- 自動リサイズ: 画像は選択された

Image Sizeパラメータに合わせてリサイズされます

大きな画像は、アスペクト比を維持したまま自動的にリサイズされます。

Link to this sectionバッチ推論を実行できますか?#

現在のAPIは1リクエストにつき1画像を処理します。バッチ処理を行うには:

- リクエストを並行して送信する

- より高いスループットのために専用エンドポイントを使用する

- 大量のバッチにはローカルでの推論を検討する

import concurrent.futures

import requests

url = "https://predict-abc123.run.app/predict"

headers = {"Authorization": "Bearer YOUR_API_KEY"}

images = ["img1.jpg", "img2.jpg", "img3.jpg"]

def predict(image_path):

with open(image_path, "rb") as f:

return requests.post(url, headers=headers, files={"file": f}).json()

with concurrent.futures.ThreadPoolExecutor(max_workers=4) as executor:

results = list(executor.map(predict, images))