Link to this sectionYOLOv10: 실시간 엔드투엔드 객체 탐지#

YOLOv10, released in May 2024 and built on the Ultralytics Python package by researchers at Tsinghua University, introduces a new approach to real-time object detection, addressing both the post-processing and model architecture deficiencies found in previous YOLO versions. By eliminating non-maximum suppression (NMS) and optimizing various model components, YOLOv10 achieved excellent performance with significantly reduced computational overhead at its time of release. Its NMS-free end-to-end design pioneered an approach that has been further developed in YOLO26.

Watch: How to Train YOLOv10 on SKU-110k Dataset using Ultralytics | Retail Dataset

Link to this section개요#

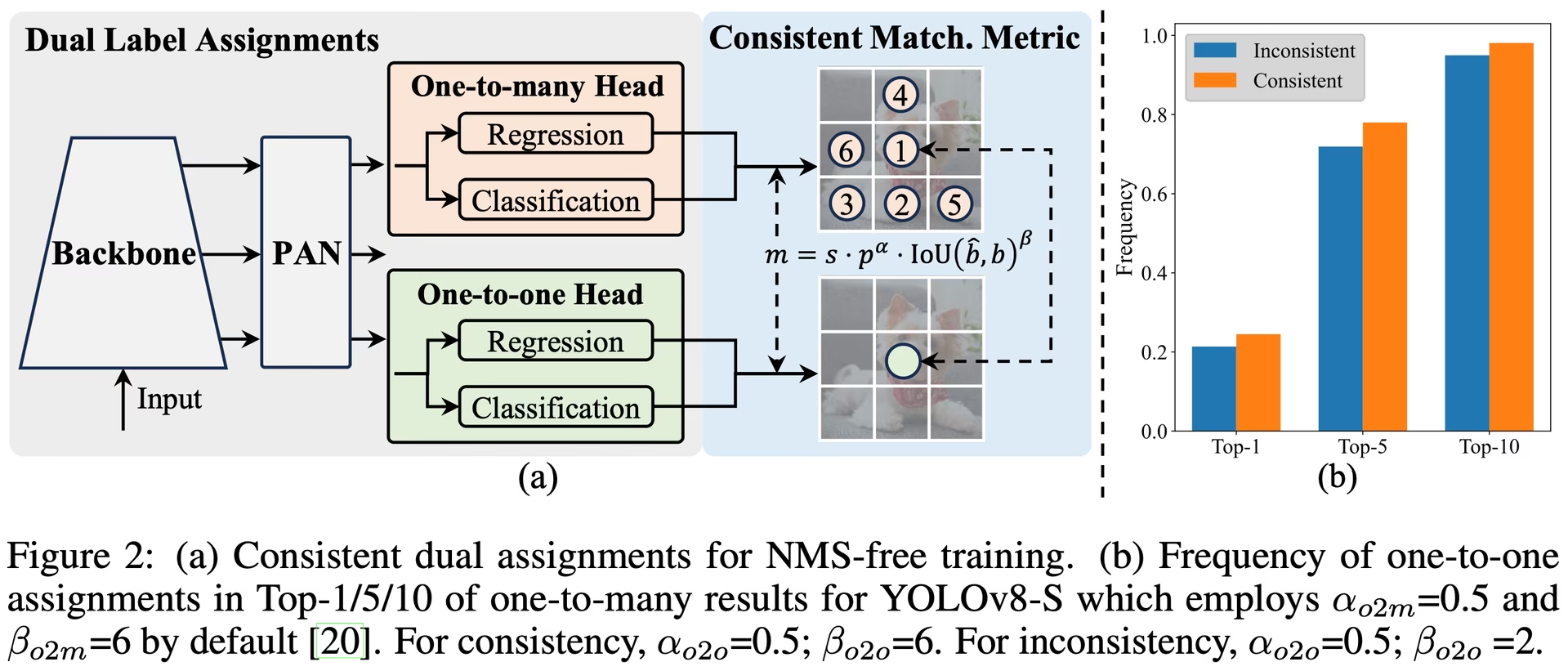

실시간 객체 탐지는 이미지 내 객체 카테고리와 위치를 낮은 지연 시간으로 정확하게 예측하는 것을 목표로 합니다. YOLO 시리즈는 성능과 효율성 간의 균형 덕분에 이 연구 분야의 선두를 지켜왔습니다. 그러나 NMS에 대한 의존성과 아키텍처의 비효율성은 최적의 성능을 저해해 왔습니다. YOLOv10은 NMS가 필요 없는 학습을 위한 consistent dual assignments와 총체적인 효율성-정확도 중심의 모델 설계 전략을 도입하여 이러한 문제를 해결합니다.

Link to this section아키텍처#

YOLOv10의 아키텍처는 이전 YOLO 모델의 강점을 기반으로 구축되면서 여러 핵심 혁신을 도입했습니다. 모델 아키텍처는 다음 구성 요소로 이루어져 있습니다:

- Backbone: feature extraction을 담당하며, YOLOv10의 백본은 CSPNet(Cross Stage Partial Network)의 개선된 버전을 사용하여 그래디언트 흐름을 개선하고 연산 중복을 줄입니다.

- Neck: 서로 다른 스케일의 특징을 집계하여 헤드로 전달하도록 설계되었습니다. 효과적인 멀티스케일 특징 융합을 위한 PAN(Path Aggregation Network) 레이어를 포함합니다.

- One-to-Many Head: 학습 중 객체당 여러 예측을 생성하여 풍부한 감독 신호를 제공하고 학습 정확도를 향상시킵니다.

- One-to-One Head: 추론 중 객체당 단일 최적 예측을 생성하여 NMS의 필요성을 제거함으로써 지연 시간을 줄이고 효율성을 개선합니다.

Link to this section주요 특징#

- NMS-Free Training: 일관된 이중 할당을 활용하여 NMS의 필요성을 없애고 inference latency를 줄입니다.

- Holistic Model Design: 경량 분류 헤드, 공간-채널 분리 다운샘플링, 순위 기반 블록 설계를 포함하여 효율성과 정확도 관점에서 다양한 구성 요소를 포괄적으로 최적화합니다.

- Enhanced Model Capabilities: 대형 커널 convolutions과 부분적 self-attention 모듈을 통합하여 큰 연산 비용 없이 성능을 개선합니다.

Link to this section모델 변형#

YOLOv10은 다양한 애플리케이션 요구를 충족하기 위해 여러 모델 스케일로 제공됩니다:

- YOLOv10n: 자원이 극도로 제한된 환경을 위한 Nano 버전.

- YOLOv10s: 속도와 정확도의 균형을 맞춘 Small 버전.

- YOLOv10m: 일반적인 용도를 위한 Medium 버전.

- YOLOv10b: 더 높은 정확도를 위해 너비를 늘린 Balanced 버전.

- YOLOv10l: 연산 자원 증가를 대가로 더 높은 정확도를 제공하는 Large 버전.

- YOLOv10x: 최대의 정확도와 성능을 위한 Extra-large 버전.

Link to this section성능#

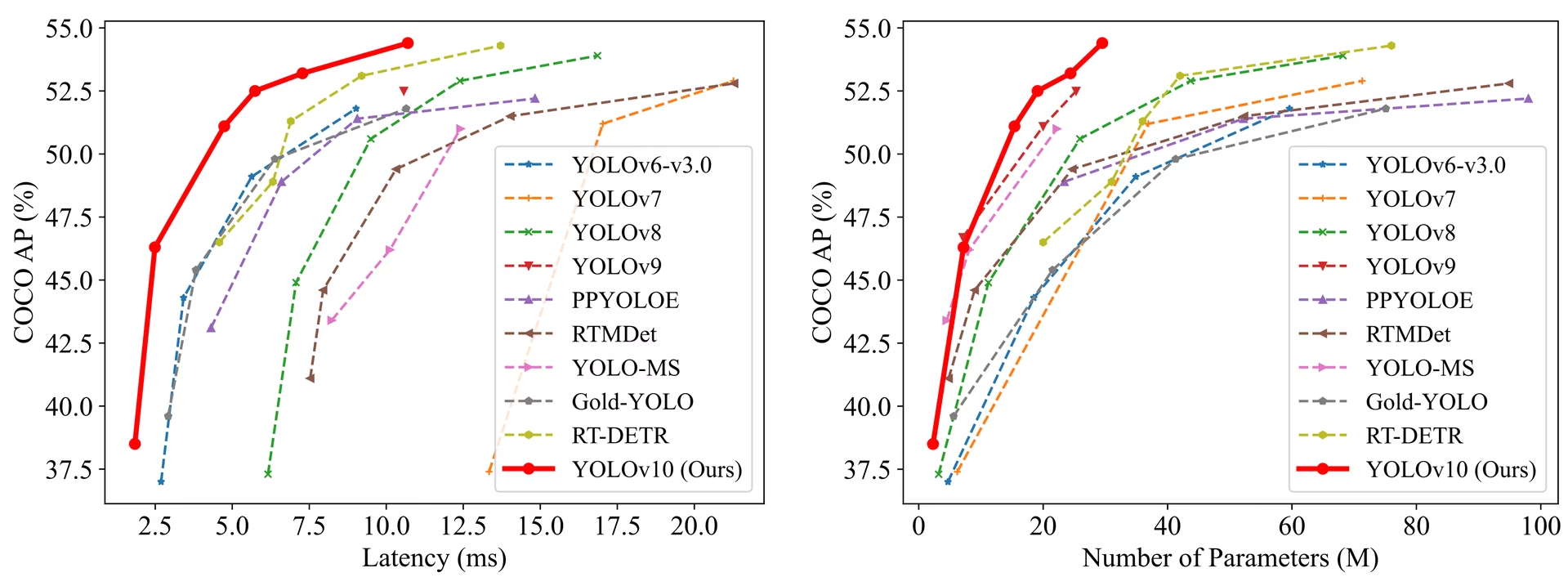

YOLOv10은 정확도와 효율성 측면에서 이전 YOLO 버전 및 기타 최신 모델보다 뛰어난 성능을 보입니다. 예를 들어, YOLOv10s는 COCO 데이터셋에서 비슷한 AP를 가지면서 RT-DETR-R18보다 1.8배 빠르며, YOLOv10b는 동일한 성능에서 YOLOv9-C보다 지연 시간이 46% 적고 파라미터가 25% 적습니다.

T4 GPU에서 TensorRT FP16으로 측정된 지연 시간입니다.

| 모델 | 입력 크기 | APval | FLOPs (G) | 지연 시간 (ms) |

|---|---|---|---|---|

| [YOLOv10n][1] | 640 | 38.5 | 6.7 | 1.84 |

| [YOLOv10s][2] | 640 | 46.3 | 21.6 | 2.49 |

| [YOLOv10m][3] | 640 | 51.1 | 59.1 | 4.74 |

| [YOLOv10b][4] | 640 | 52.5 | 92.0 | 5.74 |

| [YOLOv10l][5] | 640 | 53.2 | 120.3 | 7.28 |

| [YOLOv10x][6] | 640 | 54.4 | 160.4 | 10.70 |

Link to this section방법론#

Link to this sectionNMS가 필요 없는 학습을 위한 일관된 이중 할당#

YOLOv10은 학습 중에 one-to-many와 one-to-one 전략을 결합한 이중 라벨 할당을 사용하여 풍부한 감독과 효율적인 엔드투엔드 배포를 보장합니다. 일관된 매칭 메트릭은 두 전략 간의 감독을 정렬하여 inference 중 예측 품질을 향상시킵니다.

Link to this section총체적 효율성-Accuracy 중심의 모델 설계#

Link to this section효율성 개선#

- Lightweight Classification Head: depth-wise separable convolution을 사용하여 분류 헤드의 연산 오버헤드를 줄입니다.

- Spatial-Channel Decoupled Down sampling: 공간 축소와 채널 변조를 분리하여 정보 손실과 연산 비용을 최소화합니다.

- Rank-Guided Block Design: 고유한 단계 중복성을 기반으로 블록 설계를 조정하여 최적의 파라미터 활용을 보장합니다.

Link to this section정확도 개선#

- Large-Kernel Convolution: receptive field를 확장하여 특징 추출 능력을 향상시킵니다.

- Partial Self-Attention (PSA): self-attention 모듈을 통합하여 최소한의 오버헤드로 글로벌 표현 학습을 개선합니다.

Link to this section실험 및 결과#

YOLOv10은 COCO와 같은 표준 벤치마크에서 광범위하게 테스트되어 우수한 성능과 효율성을 입증했습니다. 이 모델은 다양한 변형 전반에서 최첨단 결과를 달성하며, 이전 버전 및 다른 동시대 탐지기와 비교하여 지연 시간과 정확도 측면에서 상당한 개선을 보여줍니다.

Link to this section비교#

다른 최신 탐지기와의 비교:

- YOLOv10s / x는 비슷한 정확도에서 RT-DETR-R18 / R101보다 1.8배 / 1.3배 빠름

- YOLOv10b는 동일한 정확도에서 YOLOv9-C보다 파라미터가 25% 적고 지연 시간이 46% 낮음

- YOLOv10l / x는 파라미터가 1.8배 / 2.3배 적으면서 YOLOv8l / x보다 0.3 AP / 0.5 AP 뛰어난 성능을 보임

YOLOv10 변형 모델과 다른 최신 모델들에 대한 자세한 비교는 다음과 같습니다:

| 모델 | 파라미터 (M) | FLOPs (G) | mAPval 50-95 | 지연 시간 (ms) | 지연 시간-순방향 (ms) |

|---|---|---|---|---|---|

| YOLOv6-3.0-N | 4.7 | 11.4 | 37.0 | 2.69 | 1.76 |

| Gold-YOLO-N | 5.6 | 12.1 | 39.6 | 2.92 | 1.82 |

| YOLOv8n | 3.2 | 8.7 | 37.3 | 6.16 | 1.77 |

| YOLOv10n | 2.3 | 6.7 | 39.5 | 1.84 | 1.79 |

| YOLOv6-3.0-S | 18.5 | 45.3 | 44.3 | 3.42 | 2.35 |

| Gold-YOLO-S | 21.5 | 46.0 | 45.4 | 3.82 | 2.73 |

| YOLOv8s | 11.2 | 28.6 | 44.9 | 7.07 | 2.33 |

| YOLOv10s | 7.2 | 21.6 | 46.8 | 2.49 | 2.39 |

| RT-DETR-R18 | 20.0 | 60.0 | 46.5 | 4.58 | 4.49 |

| YOLOv6-3.0-M | 34.9 | 85.8 | 49.1 | 5.63 | 4.56 |

| Gold-YOLO-M | 41.3 | 87.5 | 49.8 | 6.38 | 5.45 |

| YOLOv8m | 25.9 | 78.9 | 50.6 | 9.50 | 5.09 |

| YOLOv10m | 15.4 | 59.1 | 51.3 | 4.74 | 4.63 |

| YOLOv6-3.0-L | 59.6 | 150.7 | 51.8 | 9.02 | 7.90 |

| Gold-YOLO-L | 75.1 | 151.7 | 51.8 | 10.65 | 9.78 |

| YOLOv8l | 43.7 | 165.2 | 52.9 | 12.39 | 8.06 |

| RT-DETR-R50 | 42.0 | 136.0 | 53.1 | 9.20 | 9.07 |

| YOLOv10l | 24.4 | 120.3 | 53.4 | 7.28 | 7.21 |

| YOLOv8x | 68.2 | 257.8 | 53.9 | 16.86 | 12.83 |

| RT-DETR-R101 | 76.0 | 259.0 | 54.3 | 13.71 | 13.58 |

| YOLOv10x | 29.5 | 160.4 | 54.4 | 10.70 | 10.60 |

Params 및 FLOPs 값은 model.fuse() 후의 융합된 모델에 대한 것입니다. 이 과정은 Conv 및 BatchNorm 레이어를 병합하고 보조적인 one-to-many 감지 헤드를 제거합니다. 사전 학습된 체크포인트는 전체 학습 아키텍처를 유지하므로 더 높은 수치를 보일 수 있습니다.

Link to this section사용 예시#

YOLOv10을 사용하여 새로운 이미지를 예측합니다. 모델은 Ultralytics Platform을 통해 클라우드 GPU에서 학습할 수도 있습니다:

from ultralytics import YOLO

# Load a pretrained YOLOv10n model

model = YOLO("yolov10n.pt")

# Perform object detection on an image

results = model("image.jpg")

# Display the results

results[0].show()사용자 지정 데이터셋에서 YOLOv10을 학습하려면:

from ultralytics import YOLO

# Load YOLOv10n model from scratch

model = YOLO("yolov10n.yaml")

# Train the model

model.train(data="coco8.yaml", epochs=100, imgsz=640)Link to this section지원되는 태스크 및 모드#

YOLOv10 모델 시리즈는 고성능 Object Detection을 위해 최적화된 다양한 모델을 제공합니다. 이 모델들은 다양한 계산 요구 사항과 정확도 요구 사항을 충족하며, 광범위한 애플리케이션에 활용될 수 있습니다.

| 모델 | 파일명 | 작업(Tasks) | 추론 | 검증 | 학습 | 내보내기 (Export) |

|---|---|---|---|---|---|---|

| YOLOv10 | yolov10n.pt yolov10s.pt yolov10m.pt yolov10l.pt yolov10x.pt | 객체 감지 | ✅ | ✅ | ✅ | ✅ |

Link to this sectionYOLOv10 내보내기#

YOLOv10에 도입된 새로운 연산으로 인해, Ultralytics에서 제공하는 모든 내보내기 형식이 현재 지원되는 것은 아닙니다. 다음 표는 YOLOv10을 위해 Ultralytics를 사용하여 성공적으로 변환된 형식을 보여줍니다. YOLOv10에 추가적인 내보내기 형식 지원을 추가하기 위해 기여 사항을 제공할 수 있다면 자유롭게 pull request를 생성해 주시기 바랍니다.

| 내보내기 형식 | 내보내기 지원 | 내보낸 모델 추론 | 참고 사항 |

|---|---|---|---|

| TorchScript | ✅ | ✅ | 표준 PyTorch 모델 형식입니다. |

| ONNX | ✅ | ✅ | 배포를 위해 널리 지원됩니다. |

| OpenVINO | ✅ | ✅ | Intel 하드웨어에 최적화되었습니다. |

| TensorRT | ✅ | ✅ | NVIDIA GPU에 최적화되었습니다. |

| CoreML | ✅ | ✅ | Apple 기기로 제한됩니다. |

| TF SavedModel | ✅ | ✅ | TensorFlow의 표준 모델 형식입니다. |

| TF GraphDef | ✅ | ✅ | 레거시 TensorFlow 형식입니다. |

| TF Lite | ✅ | ✅ | 모바일 및 임베디드 기기에 최적화되었습니다. |

| TF Edge TPU | ✅ | ✅ | Google의 Edge TPU 기기 전용입니다. |

| TF.js | ✅ | ✅ | 브라우저 사용을 위한 JavaScript 환경입니다. |

| PaddlePaddle | ❌ | ❌ | 중국에서 널리 사용되며 글로벌 지원은 적습니다. |

| NCNN | ✅ | ❌ | 레이어 torch.topk가 존재하지 않거나 등록되지 않음 |

Link to this section결론#

YOLOv10은 이전 YOLO 버전의 단점을 해결하고 혁신적인 설계 전략을 통합함으로써 출시 당시 실시간 객체 탐지의 새로운 표준을 정립했습니다. NMS를 사용하지 않는 접근 방식은 YOLO 제품군에서 end-to-end 객체 탐지를 개척했습니다. 향상된 성능과 NMS를 사용하지 않는 추론을 제공하는 최신 Ultralytics 모델은 YOLO26을 참조하십시오.

Link to this section인용 및 감사의 글#

We would like to acknowledge the YOLOv10 authors from Tsinghua University for their extensive research and significant contributions to the Ultralytics framework:

@article{THU-MIGyolov10,

title={YOLOv10: Real-Time End-to-End Object Detection},

author={Ao Wang, Hui Chen, Lihao Liu, et al.},

journal={arXiv preprint arXiv:2405.14458},

year={2024},

institution={Tsinghua University},

license = {AGPL-3.0}

}상세한 구현, 아키텍처 혁신 및 실험 결과는 Tsinghua University 팀의 YOLOv10 연구 논문 및 GitHub 저장소를 참조하십시오.

Link to this sectionFAQ#

Link to this sectionYOLOv10이란 무엇이며 이전 YOLO 버전과 어떻게 다른가요?#

Tsinghua University 연구진이 개발한 YOLOv10은 실시간 객체 탐지에 몇 가지 주요 혁신을 도입했습니다. 학습 중 일관된 이중 할당(consistent dual assignments)을 사용하고 계산 오버헤드를 줄이면서 성능을 극대화하도록 모델 구성 요소를 최적화하여 NMS(non-maximum suppression)의 필요성을 제거했습니다. 아키텍처 및 주요 기능에 대한 자세한 내용은 YOLOv10 개요 섹션을 확인하십시오.

Link to this sectionYOLOv10을 사용하여 추론을 실행하려면 어떻게 시작해야 하나요?#

간편한 추론을 위해 Ultralytics YOLO Python 라이브러리나 명령줄 인터페이스(CLI)를 사용할 수 있습니다. 아래는 YOLOv10을 사용하여 새로운 이미지를 예측하는 예시입니다:

from ultralytics import YOLO

# Load the pretrained YOLOv10n model

model = YOLO("yolov10n.pt")

results = model("image.jpg")

results[0].show()더 많은 사용 예시는 사용 예시 섹션을 방문하십시오.

Link to this sectionYOLOv10은 어떤 모델 변형을 제공하며 그 용도는 무엇인가요?#

YOLOv10은 다양한 용도에 맞게 여러 모델 변형을 제공합니다:

- YOLOv10n: 리소스가 극도로 제한된 환경에 적합

- YOLOv10s: 속도와 정확성의 균형을 유지합니다.

- YOLOv10m: 범용적인 용도로 사용됩니다.

- YOLOv10b: 너비를 늘려 더 높은 정확도를 제공합니다.

- YOLOv10l: 계산 리소스를 희생하여 높은 정확도를 제공합니다.

- YOLOv10x: 최대의 정확도와 성능을 제공합니다.

각 변형 모델은 서로 다른 계산 요구 사항과 정확도 요건에 맞춰 설계되어 다양한 애플리케이션에 유연하게 활용할 수 있습니다. 자세한 내용은 Model Variants 섹션을 확인해 주십시오.

Link to this sectionYOLOv10의 NMS-free 접근 방식은 어떻게 성능을 향상합니까?#

YOLOv10은 학습을 위해 일관된 이중 할당(consistent dual assignments) 방식을 채택하여 추론 중 NMS(Non-Maximum Suppression)의 필요성을 제거합니다. 이러한 접근 방식은 추론 지연 시간을 줄이고 예측 효율성을 향상합니다. 또한, 아키텍처에는 추론을 위한 일대일(one-to-one) 헤드가 포함되어 있어 각 객체에 대해 단일 최적 예측을 보장합니다. 자세한 설명은 Consistent Dual Assignments for NMS-Free Training 섹션을 참조하십시오.

Link to this sectionYOLOv10 모델의 내보내기(export) 옵션은 어디에서 찾을 수 있습니까?#

YOLOv10은 TorchScript, ONNX, OpenVINO, TensorRT를 포함한 여러 내보내기 형식을 지원합니다. 다만, YOLOv10의 새로운 작업으로 인해 Ultralytics에서 제공하는 모든 내보내기 형식이 현재 지원되지는 않습니다. 지원되는 형식 및 내보내기 방법에 대한 자세한 내용은 Exporting YOLOv10 섹션을 방문해 주십시오.

Link to this sectionYOLOv10 모델의 성능 벤치마크는 어떻게 됩니까?#

YOLOv10은 정확도와 효율성 모두에서 이전 YOLO 버전 및 기타 최신 모델보다 뛰어난 성능을 보입니다. 예를 들어, YOLOv10s는 COCO 데이터셋에서 유사한 AP를 유지하면서 RT-DETR-R18보다 1.8배 빠릅니다. YOLOv10b는 동일한 성능 수준에서 YOLOv9-C 대비 지연 시간이 46% 감소하고 파라미터가 25% 적습니다. 상세 벤치마크 결과는 Comparisons 섹션에서 확인할 수 있습니다.