Link to this sectionНабор данных VOC#

Набор данных PASCAL VOC (Visual Object Classes) — это широко известный набор данных для обнаружения объектов, сегментации и классификации. Он разработан для поощрения исследований различных категорий объектов и часто используется для бенчмаркинга моделей компьютерного зрения. Это важный набор данных для исследователей и разработчиков, работающих над задачами обнаружения объектов, сегментации и классификации.

Watch: How to Train Ultralytics YOLO26 on the Pascal VOC Dataset | Object Detection 🚀

Link to this sectionОсновные характеристики#

- Набор данных VOC включает два основных соревнования: VOC2007 и VOC2012.

- Набор данных включает 20 категорий объектов, в том числе распространенные объекты, такие как автомобили, велосипеды и животные, а также более специфические категории, например, лодки, диваны и обеденные столы.

- Аннотации включают ограничивающие рамки объектов и метки классов для задач обнаружения и классификации объектов, а также маски сегментации для задач сегментации.

- VOC предоставляет стандартизированные метрики оценки, такие как mean Average Precision (mAP), для обнаружения и классификации объектов, что делает его подходящим для сравнения производительности моделей.

Link to this sectionСтруктура набора данных#

Набор данных VOC разделен на три подмножества:

- Train: Это подмножество содержит изображения для обучения моделей обнаружения объектов, сегментации и классификации.

- Validation: Это подмножество содержит изображения, используемые для целей валидации во время обучения модели.

- Test: Это подмножество состоит из изображений, используемых для тестирования и бенчмаркинга обученных моделей. Истинные аннотации (ground truth) для этого подмножества публично недоступны, и результаты исторически отправлялись на сервер оценки PASCAL VOC для оценки производительности.

Link to this sectionПриложения#

Набор данных VOC широко используется для обучения и оценки моделей deep learning в задачах обнаружения объектов (таких как Ultralytics YOLO, Faster R-CNN и SSD), instance segmentation (таких как Mask R-CNN) и image classification. Разнообразный набор категорий объектов, большое количество аннотированных изображений и стандартизированные метрики оценки делают этот набор данных важным ресурсом для исследователей и специалистов в области computer vision.

Link to this sectionYAML набора данных#

Для определения конфигурации набора данных используется файл YAML (Yet Another Markup Language). Он содержит информацию о путях к набору данных, классах и другие соответствующие данные. В случае с набором данных VOC файл VOC.yaml поддерживается по адресу https://github.com/ultralytics/ultralytics/blob/main/ultralytics/cfg/datasets/VOC.yaml.

# Ultralytics 🚀 AGPL-3.0 License - https://ultralytics.com/license

# PASCAL VOC dataset http://host.robots.ox.ac.uk/pascal/VOC by University of Oxford

# Documentation: https://docs.ultralytics.com/datasets/detect/voc/

# Example usage: yolo train data=VOC.yaml

# parent

# ├── ultralytics

# └── datasets

# └── VOC ← downloads here (2.8 GB)

# Train/val/test sets as 1) dir: path/to/imgs, 2) file: path/to/imgs.txt, or 3) list: [path/to/imgs1, path/to/imgs2, ..]

path: VOC

train: # train images (relative to 'path') 16551 images

- images/train2012

- images/train2007

- images/val2012

- images/val2007

val: # val images (relative to 'path') 4952 images

- images/test2007

test: # test images (optional)

- images/test2007

# Classes

names:

0: aeroplane

1: bicycle

2: bird

3: boat

4: bottle

5: bus

6: car

7: cat

8: chair

9: cow

10: diningtable

11: dog

12: horse

13: motorbike

14: person

15: pottedplant

16: sheep

17: sofa

18: train

19: tvmonitor

# Download script/URL (optional) ---------------------------------------------------------------------------------------

download: |

import xml.etree.ElementTree as ET

from pathlib import Path

from ultralytics.utils.downloads import download

from ultralytics.utils import ASSETS_URL, TQDM

def convert_label(path, lb_path, year, image_id):

"""Converts XML annotations from VOC format to YOLO format by extracting bounding boxes and class IDs."""

def convert_box(size, box):

dw, dh = 1.0 / size[0], 1.0 / size[1]

x, y, w, h = (box[0] + box[1]) / 2.0 - 1, (box[2] + box[3]) / 2.0 - 1, box[1] - box[0], box[3] - box[2]

return x * dw, y * dh, w * dw, h * dh

with open(path / f"VOC{year}/Annotations/{image_id}.xml") as in_file, open(lb_path, "w", encoding="utf-8") as out_file:

tree = ET.parse(in_file)

root = tree.getroot()

size = root.find("size")

w = int(size.find("width").text)

h = int(size.find("height").text)

names = list(yaml["names"].values()) # names list

for obj in root.iter("object"):

cls = obj.find("name").text

if cls in names and int(obj.find("difficult").text) != 1:

xmlbox = obj.find("bndbox")

bb = convert_box((w, h), [float(xmlbox.find(x).text) for x in ("xmin", "xmax", "ymin", "ymax")])

cls_id = names.index(cls) # class id

out_file.write(" ".join(str(a) for a in (cls_id, *bb)) + "\n")

# Download

dir = Path(yaml["path"]) # dataset root dir

urls = [

f"{ASSETS_URL}/VOCtrainval_06-Nov-2007.zip", # 446MB, 5012 images

f"{ASSETS_URL}/VOCtest_06-Nov-2007.zip", # 438MB, 4953 images

f"{ASSETS_URL}/VOCtrainval_11-May-2012.zip", # 1.95GB, 17126 images

]

download(urls, dir=dir / "images", threads=3, exist_ok=True) # download and unzip over existing (required)

# Convert

path = dir / "images/VOCdevkit"

for year, image_set in ("2012", "train"), ("2012", "val"), ("2007", "train"), ("2007", "val"), ("2007", "test"):

imgs_path = dir / "images" / f"{image_set}{year}"

lbs_path = dir / "labels" / f"{image_set}{year}"

imgs_path.mkdir(exist_ok=True, parents=True)

lbs_path.mkdir(exist_ok=True, parents=True)

with open(path / f"VOC{year}/ImageSets/Main/{image_set}.txt") as f:

image_ids = f.read().strip().split()

for id in TQDM(image_ids, desc=f"{image_set}{year}"):

f = path / f"VOC{year}/JPEGImages/{id}.jpg" # old img path

lb_path = (lbs_path / f.name).with_suffix(".txt") # new label path

f.rename(imgs_path / f.name) # move image

convert_label(path, lb_path, year, id) # convert labels to YOLO formatLink to this sectionИспользование#

Чтобы обучить модель YOLO26n на наборе данных VOC в течение 100 epochs с размером изображения 640, ты можешь использовать следующие фрагменты кода. Полный список доступных аргументов смотри на странице Training модели.

from ultralytics import YOLO

# Load a model

model = YOLO("yolo26n.pt") # load a pretrained model (recommended for training)

# Train the model

results = model.train(data="VOC.yaml", epochs=100, imgsz=640)Link to this sectionПримеры изображений и аннотаций#

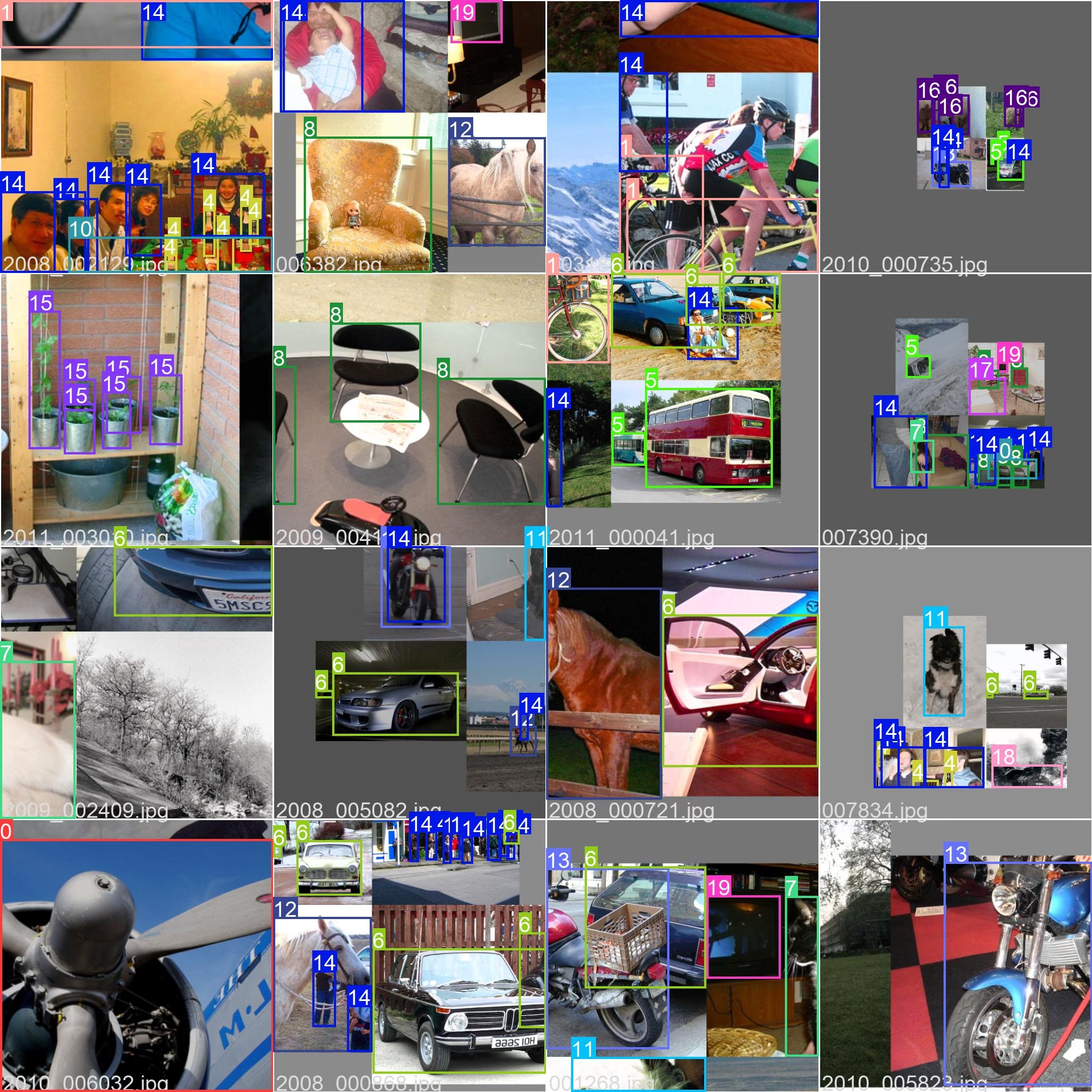

Набор данных VOC содержит разнообразный набор изображений с различными категориями объектов и сложными сценами. Вот несколько примеров изображений из набора данных вместе с соответствующими аннотациями:

- Мозаичное изображение: это изображение демонстрирует обучающую выборку, состоящую из мозаичных изображений набора данных. Мозаика — это метод, используемый во время обучения, который объединяет несколько изображений в одно, чтобы увеличить разнообразие объектов и сцен в каждой обучающей выборке. Это помогает улучшить способность модели к обобщению на разные размеры объектов, соотношения сторон и контексты.

Этот пример демонстрирует разнообразие и сложность изображений в наборе данных VOC, а также преимущества использования мозаики (mosaicing) в процессе обучения.

Link to this sectionЦитирование и благодарности#

Если ты используешь набор данных VOC в своей исследовательской или разработческой работе, пожалуйста, сошлися на следующую статью:

@misc{everingham2010pascal,

title={The PASCAL Visual Object Classes (VOC) Challenge},

author={Mark Everingham and Luc Van Gool and Christopher K. I. Williams and John Winn and Andrew Zisserman},

year={2010},

eprint={0909.5206},

archivePrefix={arXiv},

primaryClass={cs.CV}

}Мы хотели бы поблагодарить консорциум PASCAL VOC за создание и поддержку этого ценного ресурса для сообщества computer vision. Для получения дополнительной информации о наборе данных VOC и его создателях посети сайт набора данных PASCAL VOC.

Link to this sectionЧасто задаваемые вопросы (FAQ)#

Link to this sectionЧто такое набор данных PASCAL VOC и почему он важен для задач компьютерного зрения?#

Набор данных PASCAL VOC (Visual Object Classes) — это известный бенчмарк для object detection, сегментации и классификации в компьютерном зрении. Он включает полные аннотации, такие как ограничивающие рамки, метки классов и маски сегментации для 20 различных категорий объектов. Исследователи широко используют его для оценки производительности таких моделей, как Faster R-CNN, YOLO и Mask R-CNN, благодаря стандартизированным метрикам оценки, таким как mean Average Precision (mAP).

Link to this sectionКак мне обучить модель YOLO26, используя набор данных VOC?#

Чтобы обучить модель YOLO26 с использованием набора данных VOC, тебе нужна конфигурация набора данных в файле YAML. Вот пример для начала обучения модели YOLO26n в течение 100 эпох с размером изображения 640:

from ultralytics import YOLO

# Load a model

model = YOLO("yolo26n.pt") # load a pretrained model (recommended for training)

# Train the model

results = model.train(data="VOC.yaml", epochs=100, imgsz=640)Link to this sectionКакие основные соревнования включены в набор данных VOC?#

Набор данных VOC включает два основных соревнования: VOC2007 и VOC2012. Эти соревнования проверяют возможности обнаружения объектов, сегментации и классификации по 20 разнообразным категориям объектов. Каждое изображение тщательно аннотировано ограничивающими рамками, метками классов и масками сегментации. Соревнования предоставляют стандартизированные метрики, такие как mAP, облегчая сравнение и бенчмаркинг различных моделей компьютерного зрения.

Link to this sectionКак набор данных PASCAL VOC улучшает бенчмаркинг и оценку моделей?#

Набор данных PASCAL VOC улучшает бенчмаркинг и оценку моделей благодаря детальным аннотациям и стандартизированным метрикам, таким как mean Average Precision (mAP). Эти метрики имеют решающее значение для оценки производительности моделей обнаружения и классификации объектов. Разнообразные и сложные изображения в наборе данных обеспечивают комплексную оценку модели в различных реальных сценариях.

Link to this sectionКак использовать набор данных VOC для semantic segmentation в моделях YOLO?#

Чтобы использовать набор данных VOC для задач семантической сегментации с моделями YOLO, тебе нужно правильно настроить набор данных в файле YAML. Файл YAML определяет пути и классы, необходимые для обучения моделей сегментации. Проверь конфигурационный файл YAML набора данных VOC по ссылке VOC.yaml для получения детальных настроек. Для задач сегментации ты должен использовать специализированную модель, например yolo26n-seg.pt, вместо модели обнаружения.