YOLOv10: Phát hiện đối tượng đầu cuối theo thời gian thực

YOLOv10, ra mắt vào tháng 5 năm 2024 và được xây dựng trên gói python của Ultralytics bởi các nhà nghiên cứu tại Đại học Thanh Hoa, giới thiệu một cách tiếp cận mới để detect đối tượng thời gian thực, giải quyết cả những thiếu sót về xử lý hậu kỳ và kiến trúc mô hình được tìm thấy trong các phiên bản YOLO trước đó. Bằng cách loại bỏ non-maximum suppression (NMS) và tối ưu hóa các thành phần mô hình khác nhau, YOLOv10 đã đạt được hiệu suất xuất sắc với chi phí tính toán giảm đáng kể tại thời điểm ra mắt. Thiết kế end-to-end không NMS của nó đã tiên phong một cách tiếp cận đã được phát triển thêm trong YOLO26.

Xem: Cách huấn luyện YOLOv10 trên tập dữ liệu SKU-110k bằng Ultralytics | Tập dữ liệu bán lẻ

Tổng quan

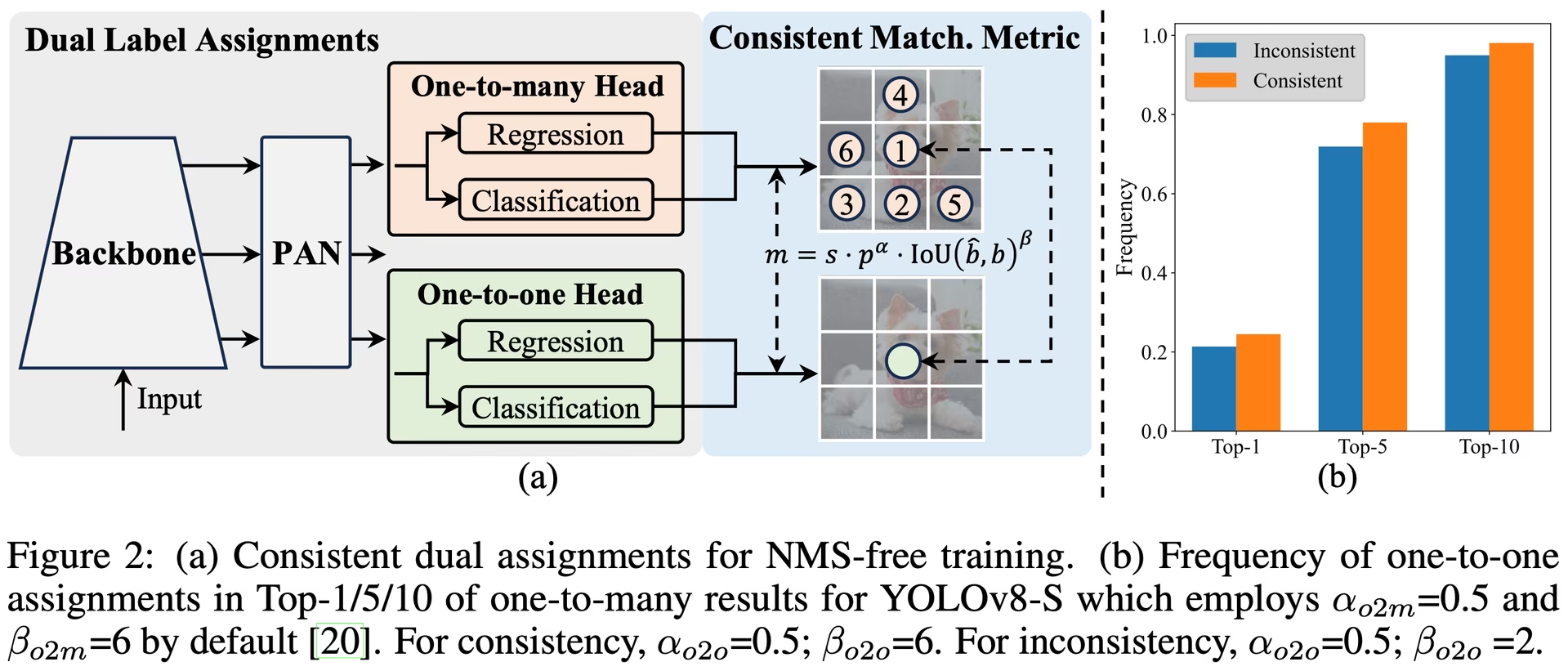

Phát hiện đối tượng thời gian thực nhằm mục đích dự đoán chính xác các danh mục và vị trí đối tượng trong hình ảnh với độ trễ thấp. Loạt YOLO đã đi đầu trong nghiên cứu này nhờ sự cân bằng giữa hiệu suất và hiệu quả. Tuy nhiên, việc phụ thuộc vào NMS và những bất cập về kiến trúc đã cản trở hiệu suất tối ưu. YOLOv10 giải quyết những vấn đề này bằng cách giới thiệu gán kép nhất quán cho huấn luyện không NMS và một chiến lược thiết kế mô hình toàn diện dựa trên hiệu quả-độ chính xác.

Kiến trúc

Kiến trúc của YOLOv10 được xây dựng dựa trên những điểm mạnh của các mô hình YOLO trước đây đồng thời giới thiệu một số đổi mới quan trọng. Kiến trúc mô hình bao gồm các thành phần sau:

- Backbone: Chịu trách nhiệm trích xuất đặc trưng, backbone trong YOLOv10 sử dụng phiên bản cải tiến của CSPNet (Cross Stage Partial Network) để cải thiện luồng gradient và giảm sự dư thừa tính toán.

- Neck (Cổ): Neck được thiết kế để tổng hợp các đặc trưng từ các tỷ lệ khác nhau và chuyển chúng đến head. Nó bao gồm các lớp PAN (Path Aggregation Network) để hợp nhất các đặc trưng đa tỷ lệ một cách hiệu quả.

- One-to-Many Head (Đầu một-nhiều): Tạo ra nhiều dự đoán cho mỗi đối tượng trong quá trình huấn luyện để cung cấp các tín hiệu giám sát phong phú và cải thiện độ chính xác học tập.

- One-to-One Head: Tạo ra một dự đoán tốt nhất duy nhất cho mỗi đối tượng trong quá trình suy luận để loại bỏ nhu cầu về NMS, từ đó giảm độ trễ và cải thiện hiệu quả.

Các tính năng chính

- Huấn luyện Không NMS: Sử dụng các gán kép nhất quán để loại bỏ nhu cầu về NMS, giảm độ trễ suy luận.

- Thiết Kế Mô Hình Tổng Thể: Tối ưu hóa toàn diện các thành phần khác nhau từ cả góc độ hiệu quả và độ chính xác, bao gồm các head phân loại nhẹ, giảm mẫu tách rời không gian-kênh và thiết kế khối có hướng dẫn xếp hạng.

- Nâng cao khả năng của mô hình: Kết hợp các tích chập kernel lớn và các mô-đun tự chú ý một phần để cải thiện hiệu suất mà không tốn nhiều chi phí tính toán.

Các biến thể mô hình

YOLOv10 có nhiều quy mô mô hình khác nhau để đáp ứng các nhu cầu ứng dụng khác nhau:

- YOLOv10n: Phiên bản Nano cho các môi trường cực kỳ hạn chế về tài nguyên.

- YOLOv10s: Phiên bản nhỏ cân bằng giữa tốc độ và độ chính xác.

- YOLOv10m: Phiên bản trung bình để sử dụng cho mục đích đa năng.

- YOLOv10b: Phiên bản cân bằng với độ rộng tăng lên để có độ chính xác cao hơn.

- YOLOv10l: Phiên bản lớn cho độ chính xác cao hơn với chi phí tài nguyên tính toán tăng lên.

- YOLOv10x: Phiên bản cực lớn cho độ chính xác và hiệu suất tối đa.

Hiệu suất

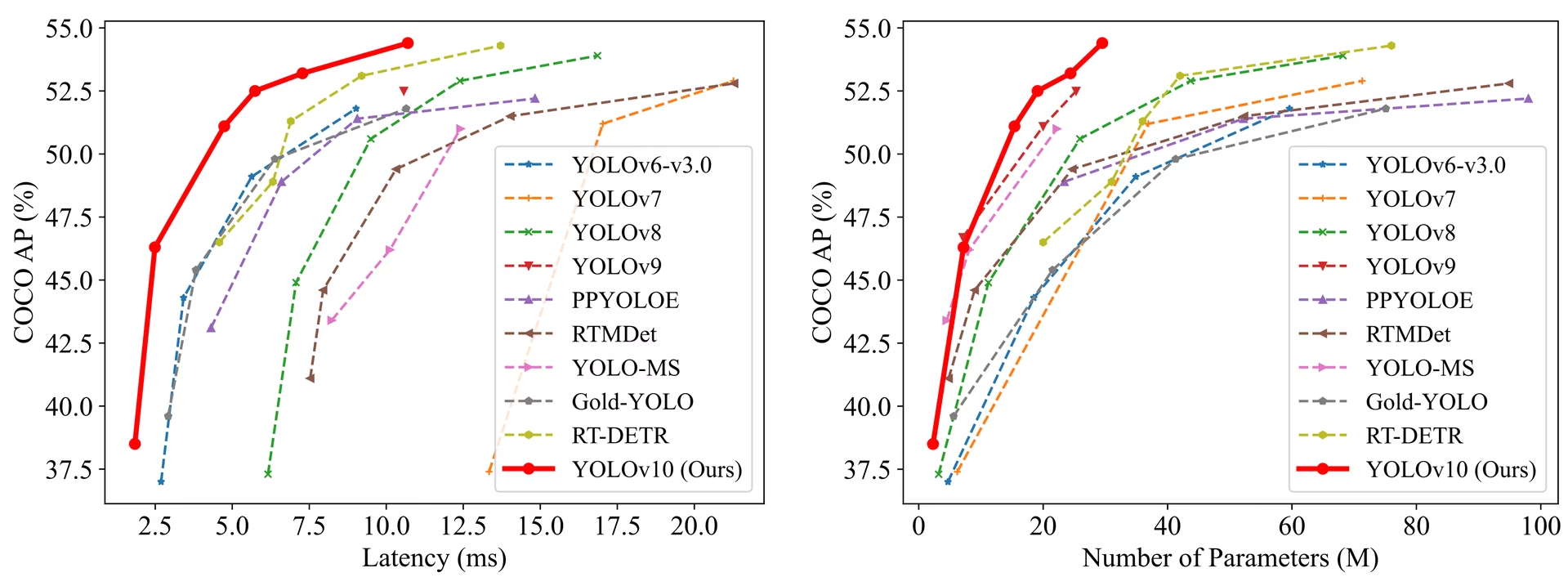

YOLOv10 vượt trội hơn các phiên bản YOLO trước đó và các mô hình tiên tiến khác về độ chính xác và hiệu quả. Ví dụ, YOLOv10s nhanh hơn 1.8 lần so với RT-DETR-R18 với AP tương tự trên tập dữ liệu COCO, và YOLOv10b có độ trễ thấp hơn 46% và ít tham số hơn 25% so với YOLOv9-C với cùng hiệu suất.

Hiệu suất

Độ trễ được đo bằng TensorRT FP16 trên T4 GPU.

| Mô hình | Kích Thước Đầu Vào | APval | FLOPs (G) | Độ Trễ (ms) |

|---|---|---|---|---|

| YOLOv10n | 640 | 38.5 | 6.7 | 1.84 |

| YOLOv10s | 640 | 46.3 | 21.6 | 2.49 |

| YOLOv10m | 640 | 51.1 | 59.1 | 4.74 |

| YOLOv10b | 640 | 52.5 | 92.0 | 5.74 |

| YOLOv10l | 640 | 53.2 | 120.3 | 7.28 |

| YOLOv10x | 640 | 54.4 | 160.4 | 10.70 |

Phương pháp luận

Gán Kép Nhất Quán cho Huấn luyện Không NMS

YOLOv10 sử dụng gán nhãn kép, kết hợp các chiến lược một-nhiều và một-đối-một trong quá trình huấn luyện để đảm bảo giám sát phong phú và triển khai end-to-end hiệu quả. Chỉ số khớp nhất quán điều chỉnh sự giám sát giữa cả hai chiến lược, nâng cao chất lượng dự đoán trong quá trình suy luận.

Thiết Kế Mô Hình Tổng Thể Tập Trung vào Hiệu Quả-Độ Chính Xác

Nâng cao hiệu quả

- Head Phân Loại Nhẹ: Giảm chi phí tính toán của head phân loại bằng cách sử dụng các convolution tách lớp theo chiều sâu.

- Giảm Mẫu Tách Rời Không Gian-Kênh: Tách rời giảm không gian và điều biến kênh để giảm thiểu mất mát thông tin và chi phí tính toán.

- Thiết Kế Khối Có Hướng Dẫn Xếp Hạng: Điều chỉnh thiết kế khối dựa trên tính dư thừa giai đoạn vốn có, đảm bảo sử dụng tham số tối ưu.

Nâng cao độ chính xác

- Convolution với Kernel Lớn: Mở rộng trường đón nhận (receptive field) để tăng cường khả năng trích xuất đặc trưng.

- Tự Chú Ý Từng Phần (PSA): Kết hợp các mô-đun tự chú ý để cải thiện khả năng học biểu diễn toàn cục với chi phí tối thiểu.

Các thí nghiệm và kết quả

YOLOv10 đã được thử nghiệm rộng rãi trên các điểm chuẩn tiêu chuẩn như COCO, chứng minh hiệu suất và hiệu quả vượt trội. Mô hình đạt được kết quả tiên tiến nhất trên các biến thể khác nhau, cho thấy những cải tiến đáng kể về độ trễ và độ chính xác so với các phiên bản trước và các bộ detect hiện đại khác.

So sánh

So với các detector hiện đại khác:

- YOLOv10s / x nhanh hơn 1.8× / 1.3× so với RT-DETR-R18 / R101 với độ chính xác tương đương

- YOLOv10b có ít tham số hơn 25% và độ trễ thấp hơn 46% so với YOLOv9-C ở cùng độ chính xác

- YOLOv10l / x vượt trội hơn YOLOv8l / x với 0.3 AP / 0.5 AP và ít hơn 1.8× / 2.3× tham số

Hiệu suất

Dưới đây là bảng so sánh chi tiết các biến thể YOLOv10 với các mô hình tiên tiến khác:

| Mô hình | Tham Số (M) | FLOPs (G) | mAPval 50-95 | Độ Trễ (ms) | Độ Trễ-forward (ms) |

|---|---|---|---|---|---|

| YOLOv6-3.0-N | 4.7 | 11.4 | 37.0 | 2.69 | 1.76 |

| Gold-YOLO-N | 5.6 | 12.1 | 39.6 | 2.92 | 1.82 |

| YOLOv8n | 3.2 | 8.7 | 37.3 | 6.16 | 1.77 |

| YOLOv10n | 2.3 | 6.7 | 39.5 | 1.84 | 1.79 |

| YOLOv6-3.0-S | 18.5 | 45.3 | 44.3 | 3.42 | 2.35 |

| Gold-YOLO-S | 21.5 | 46.0 | 45.4 | 3.82 | 2.73 |

| YOLOv8s | 11.2 | 28.6 | 44.9 | 7.07 | 2.33 |

| YOLOv10s | 7.2 | 21.6 | 46.8 | 2.49 | 2.39 |

| RT-DETR-R18 | 20.0 | 60.0 | 46.5 | 4.58 | 4.49 |

| YOLOv6-3.0-M | 34.9 | 85.8 | 49.1 | 5.63 | 4.56 |

| Gold-YOLO-M | 41.3 | 87.5 | 49.8 | 6.38 | 5.45 |

| YOLOv8m | 25.9 | 78.9 | 50.6 | 9.50 | 5.09 |

| YOLOv10m | 15.4 | 59.1 | 51.3 | 4.74 | 4.63 |

| YOLOv6-3.0-L | 59.6 | 150.7 | 51.8 | 9.02 | 7.90 |

| Gold-YOLO-L | 75.1 | 151.7 | 51.8 | 10.65 | 9.78 |

| YOLOv8l | 43.7 | 165.2 | 52.9 | 12.39 | 8.06 |

| RT-DETR-R50 | 42.0 | 136.0 | 53.1 | 9.20 | 9.07 |

| YOLOv10l | 24.4 | 120.3 | 53.4 | 7.28 | 7.21 |

| YOLOv8x | 68.2 | 257.8 | 53.9 | 16.86 | 12.83 |

| RT-DETR-R101 | 76.0 | 259.0 | 54.3 | 13.71 | 13.58 |

| YOLOv10x | 29.5 | 160.4 | 54.4 | 10.70 | 10.60 |

Các giá trị Params và FLOPs dành cho mô hình đã được hợp nhất sau đó. model.fuse()Phương pháp này kết hợp các lớp Conv và BatchNorm và loại bỏ phần phát hiện phụ trợ một-nhiều. Các điểm kiểm tra được huấn luyện trước giữ nguyên kiến trúc huấn luyện đầy đủ và có thể hiển thị số lượng cao hơn.

Ví dụ sử dụng

Để dự đoán hình ảnh mới với YOLOv10 Các mô hình cũng có thể được huấn luyện trên GPU đám mây thông qua Nền tảng Ultralytics :

Ví dụ

from ultralytics import YOLO

# Load a pretrained YOLOv10n model

model = YOLO("yolov10n.pt")

# Perform object detection on an image

results = model("image.jpg")

# Display the results

results[0].show()

# Load a COCO-pretrained YOLOv10n model and run inference on the 'bus.jpg' image

yolo detect predict model=yolov10n.pt source=path/to/bus.jpg

Để huấn luyện YOLOv10 trên tập dữ liệu tùy chỉnh:

Ví dụ

from ultralytics import YOLO

# Load YOLOv10n model from scratch

model = YOLO("yolov10n.yaml")

# Train the model

model.train(data="coco8.yaml", epochs=100, imgsz=640)

# Build a YOLOv10n model from scratch and train it on the COCO8 example dataset for 100 epochs

yolo train model=yolov10n.yaml data=coco8.yaml epochs=100 imgsz=640

# Build a YOLOv10n model from scratch and run inference on the 'bus.jpg' image

yolo predict model=yolov10n.yaml source=path/to/bus.jpg

Các Tác vụ và Chế độ được Hỗ trợ

Dòng mô hình YOLOv10 cung cấp một loạt các mô hình, mỗi mô hình được tối ưu hóa cho phát hiện đối tượng hiệu suất cao. Các mô hình này đáp ứng các nhu cầu tính toán và yêu cầu độ chính xác khác nhau, giúp chúng linh hoạt cho nhiều ứng dụng.

| Mô hình | Tên tập tin | Nhiệm vụ | Suy luận | Xác thực | Huấn luyện | Xuất |

|---|---|---|---|---|---|---|

| YOLOv10 | yolov10n.pt yolov10s.pt yolov10m.pt yolov10l.pt yolov10x.pt | Phát Hiện Đối Tượng | ✅ | ✅ | ✅ | ✅ |

Xuất YOLOv10

Do các phép toán mới được giới thiệu trong YOLOv10, không phải tất cả các định dạng xuất do Ultralytics cung cấp đều được hỗ trợ hiện tại. Bảng sau đây phác thảo các định dạng đã được chuyển đổi thành công bằng Ultralytics cho YOLOv10. Vui lòng mở một pull request nếu bạn có thể đóng góp thay đổi để thêm hỗ trợ xuất các định dạng bổ sung cho YOLOv10.

| Định dạng xuất | Hỗ trợ xuất | Suy luận mô hình đã xuất | Ghi chú |

|---|---|---|---|

| TorchScript | ✅ | ✅ | Định dạng mô hình PyTorch tiêu chuẩn. |

| ONNX | ✅ | ✅ | Được hỗ trợ rộng rãi để triển khai. |

| OpenVINO | ✅ | ✅ | Được tối ưu hóa cho phần cứng Intel. |

| TensorRT | ✅ | ✅ | Được tối ưu hóa cho NVIDIA GPU. |

| CoreML | ✅ | ✅ | Giới hạn cho các thiết bị Apple. |

| TF SavedModel | ✅ | ✅ | Định dạng mô hình tiêu chuẩn của TensorFlow. |

| TF GraphDef | ✅ | ✅ | Định dạng TensorFlow cũ. |

| TF Lite | ✅ | ✅ | Được tối ưu hóa cho thiết bị di động và nhúng. |

| TF Edge TPU | ✅ | ✅ | Dành riêng cho các thiết bị Google Edge TPU. |

| TF.js | ✅ | ✅ | Môi trường JavaScript để sử dụng trên trình duyệt. |

| PaddlePaddle | ❌ | ❌ | Phổ biến ở Trung Quốc; ít được hỗ trợ trên toàn cầu hơn. |

| NCNN | ✅ | ❌ | Lớp torch.topk không tồn tại hoặc chưa được đăng ký |

Kết luận

YOLOv10 đã thiết lập một tiêu chuẩn mới trong detect đối tượng thời gian thực tại thời điểm ra mắt bằng cách khắc phục những thiếu sót của các phiên bản YOLO trước đó và kết hợp các chiến lược thiết kế đổi mới. Cách tiếp cận không NMS của nó đã tiên phong detect đối tượng end-to-end trong họ YOLO. Để biết mô hình Ultralytics mới nhất với hiệu suất cải thiện và suy luận không NMS, hãy xem YOLO26.

Trích dẫn và Lời cảm ơn

Chúng tôi xin ghi nhận các tác giả YOLOv10 từ Đại học Thanh Hoa vì những nghiên cứu sâu rộng và đóng góp đáng kể của họ cho framework Ultralytics:

@article{THU-MIGyolov10,

title={YOLOv10: Real-Time End-to-End Object Detection},

author={Ao Wang, Hui Chen, Lihao Liu, et al.},

journal={arXiv preprint arXiv:2405.14458},

year={2024},

institution={Tsinghua University},

license = {AGPL-3.0}

}

Để biết chi tiết triển khai, đổi mới kiến trúc và kết quả thử nghiệm, vui lòng tham khảo bài báo nghiên cứu và kho lưu trữ GitHub của YOLOv10 do nhóm Đại học Thanh Hoa thực hiện.

Câu hỏi thường gặp

YOLOv10 là gì và nó khác gì so với các phiên bản YOLO trước đây?

YOLOv10, được phát triển bởi các nhà nghiên cứu tại Đại học Thanh Hoa, giới thiệu một số đổi mới quan trọng trong phát hiện đối tượng thời gian thực. Nó loại bỏ nhu cầu về non-maximum suppression (NMS) bằng cách sử dụng các gán kép nhất quán trong quá trình huấn luyện và các thành phần mô hình được tối ưu hóa để đạt hiệu suất vượt trội với chi phí tính toán giảm. Để biết thêm chi tiết về kiến trúc và các tính năng chính của nó, hãy xem phần tổng quan về YOLOv10.

Làm thế nào để tôi bắt đầu chạy suy luận bằng YOLOv10?

Để suy luận dễ dàng, bạn có thể sử dụng thư viện python Ultralytics YOLO hoặc giao diện dòng lệnh (CLI). Dưới đây là các ví dụ về dự đoán hình ảnh mới bằng YOLOv10:

Ví dụ

from ultralytics import YOLO

# Load the pretrained YOLOv10n model

model = YOLO("yolov10n.pt")

results = model("image.jpg")

results[0].show()

yolo detect predict model=yolov10n.pt source=path/to/image.jpg

Để có thêm các ví dụ về cách sử dụng, hãy truy cập phần Ví dụ Sử dụng của chúng tôi.

YOLOv10 cung cấp những biến thể mô hình nào và các trường hợp sử dụng của chúng là gì?

YOLOv10 cung cấp một số biến thể mô hình để phục vụ các trường hợp sử dụng khác nhau:

- YOLOv10n: Phù hợp cho các môi trường cực kỳ hạn chế về tài nguyên

- YOLOv10s: Cân bằng giữa tốc độ và độ chính xác

- YOLOv10m: Sử dụng cho mục đích đa năng

- YOLOv10b: Độ chính xác cao hơn với độ rộng tăng lên

- YOLOv10l: Độ chính xác cao với chi phí tài nguyên tính toán

- YOLOv10x: Độ chính xác và hiệu suất tối đa

Mỗi biến thể được thiết kế cho các nhu cầu tính toán và yêu cầu độ chính xác khác nhau, làm cho chúng trở nên linh hoạt cho nhiều ứng dụng. Khám phá phần Các biến thể Mô hình để biết thêm thông tin.

Cách tiếp cận không NMS trong YOLOv10 cải thiện hiệu suất như thế nào?

YOLOv10 loại bỏ nhu cầu về non-maximum suppression (NMS) trong quá trình suy luận bằng cách sử dụng các gán kép nhất quán cho huấn luyện. Cách tiếp cận này giúp giảm độ trễ suy luận và nâng cao hiệu quả dự đoán. Kiến trúc cũng bao gồm một đầu one-to-one cho suy luận, đảm bảo rằng mỗi đối tượng nhận được một dự đoán tốt nhất duy nhất. Để có giải thích chi tiết, hãy xem phần Gán kép nhất quán cho huấn luyện không NMS.

Tôi có thể tìm các tùy chọn xuất cho mô hình YOLOv10 ở đâu?

YOLOv10 hỗ trợ một số định dạng xuất, bao gồm TorchScript, ONNX, OpenVINO và TensorRT. Tuy nhiên, không phải tất cả các định dạng xuất do Ultralytics cung cấp đều được hỗ trợ hiện tại cho YOLOv10 do các phép toán mới của nó. Để biết chi tiết về các định dạng được hỗ trợ và hướng dẫn xuất, hãy truy cập phần Xuất YOLOv10.

Các điểm chuẩn hiệu suất cho mô hình YOLOv10 là gì?

YOLOv10 vượt trội hơn các phiên bản YOLO trước đó và các mô hình tiên tiến khác về cả độ chính xác và hiệu quả. Ví dụ, YOLOv10s nhanh hơn 1.8 lần so với RT-DETR-R18 với AP tương tự trên tập dữ liệu COCO. YOLOv10b cho thấy độ trễ ít hơn 46% và ít hơn 25% tham số so với YOLOv9-C với cùng hiệu suất. Các điểm chuẩn chi tiết có thể được tìm thấy trong phần So sánh.