Xuất Ultralytics YOLO NCNN

Triển khai các mô hình thị giác máy tính trên các thiết bị có sức mạnh tính toán hạn chế, chẳng hạn như hệ thống di động hoặc nhúng, đòi hỏi phải lựa chọn định dạng cẩn thận. Sử dụng định dạng được tối ưu hóa đảm bảo rằng ngay cả các thiết bị bị hạn chế tài nguyên cũng có thể xử lý hiệu quả các tác vụ thị giác máy tính nâng cao.

Việc xuất sang định dạng NCNN cho phép bạn tối ưu hóa các mô hình Ultralytics YOLO26 của mình cho các ứng dụng nhẹ dựa trên thiết bị. Hướng dẫn này bao gồm cách chuyển đổi các mô hình của bạn sang định dạng NCNN để cải thiện hiệu suất trên thiết bị di động và nhúng.

Tại sao nên xuất sang NCNN?

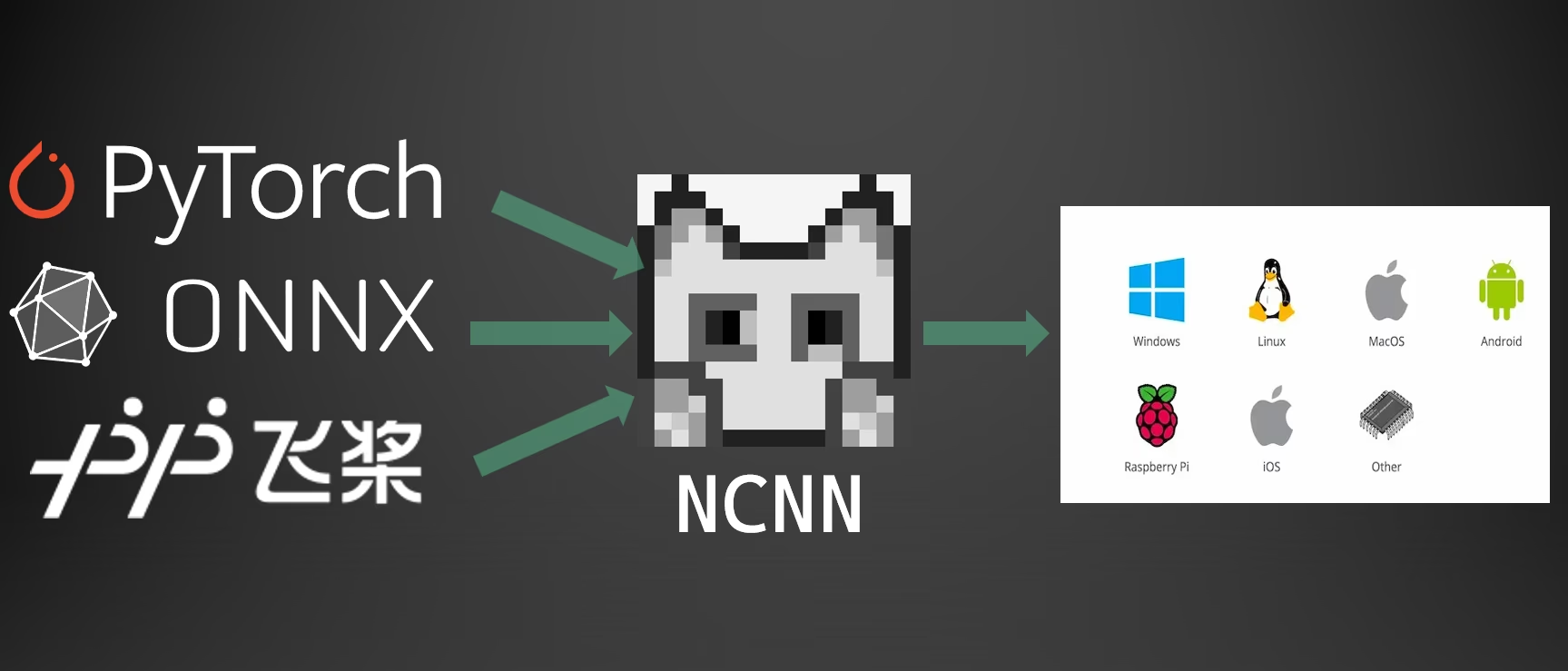

Framework NCNN, được phát triển bởi Tencent, là một framework tính toán suy luận neural network hiệu suất cao được tối ưu hóa đặc biệt cho các nền tảng di động, bao gồm điện thoại di động, thiết bị nhúng và thiết bị IoT. NCNN tương thích với nhiều nền tảng, bao gồm Linux, Android, iOS và macOS.

NCNN nổi tiếng với tốc độ xử lý nhanh trên các CPU di động và cho phép triển khai nhanh chóng các mô hình học sâu lên các nền tảng di động, biến nó thành một lựa chọn tuyệt vời để xây dựng các ứng dụng được hỗ trợ bởi AI.

Các tính năng chính của mô hình NCNN

Các mô hình NCNN cung cấp một số tính năng chính cho phép học máy trên thiết bị, giúp các nhà phát triển triển khai mô hình trên các thiết bị di động, nhúng và biên:

Hiệu quả và Hiệu suất cao: Các mô hình NCNN nhẹ và được tối ưu hóa cho các thiết bị di động và nhúng như Raspberry Pi với tài nguyên hạn chế, đồng thời duy trì độ chính xác cao trong các tác vụ thị giác máy tính.

Lượng tử hóa: NCNN hỗ trợ lượng tử hóa, một kỹ thuật giúp giảm độ chính xác của trọng số và kích hoạt mô hình để cải thiện hiệu suất và giảm mức sử dụng bộ nhớ.

Khả năng tương thích: Các mô hình NCNN tương thích với các framework học sâu phổ biến bao gồm TensorFlow, Caffe và ONNX, cho phép các nhà phát triển tận dụng các mô hình và quy trình làm việc hiện có.

Dễ sử dụng: NCNN cung cấp các công cụ thân thiện với người dùng để chuyển đổi mô hình giữa các định dạng, đảm bảo khả năng tương tác mượt mà trên các môi trường phát triển khác nhau.

Tăng tốc GPU bằng Vulkan: NCNN hỗ trợ Vulkan để suy luận tăng tốc GPU trên nhiều nhà cung cấp bao gồm AMD, Intel và các GPU không phải của NVIDIA, cho phép triển khai hiệu suất cao trên nhiều loại phần cứng hơn.

Các tùy chọn triển khai với NCNN

Các mô hình NCNN tương thích với nhiều nền tảng triển khai:

Triển khai trên thiết bị di động: Tối ưu hóa cho Android và iOS, cho phép tích hợp liền mạch vào các ứng dụng di động để suy luận hiệu quả trên thiết bị.

Hệ thống nhúng và thiết bị IoT: Lý tưởng cho các thiết bị có tài nguyên hạn chế như Raspberry Pi và NVIDIA Jetson. Nếu suy luận tiêu chuẩn trên Raspberry Pi với Hướng dẫn Ultralytics là không đủ, NCNN có thể mang lại cải thiện hiệu suất đáng kể.

Triển khai trên máy tính để bàn và máy chủ: Hỗ trợ triển khai trên Linux, Windows và macOS cho các quy trình làm việc phát triển, huấn luyện và đánh giá.

Tăng tốc GPU Vulkan

NCNN hỗ trợ tăng tốc GPU thông qua Vulkan, cho phép suy luận hiệu suất cao trên nhiều loại GPU bao gồm AMD, Intel và các card đồ họa không phải của NVIDIA. Điều này đặc biệt hữu ích cho:

- Hỗ trợ GPU đa nhà cung cấp: Không giống như CUDA, vốn chỉ giới hạn ở GPU NVIDIA, Vulkan hoạt động trên nhiều nhà cung cấp GPU.

- Hệ thống đa GPU: Chọn một thiết bị Vulkan cụ thể trong các hệ thống có nhiều GPU bằng cách sử dụng

device="vulkan:0",device="vulkan:1", v.v. - Triển khai biên và máy tính để bàn: Tận dụng tăng tốc GPU trên các thiết bị không có CUDA.

Để sử dụng tăng tốc Vulkan, hãy chỉ định thiết bị Vulkan khi chạy suy luận:

Suy luận Vulkan

from ultralytics import YOLO

# Load the exported NCNN model

ncnn_model = YOLO("./yolo26n_ncnn_model")

# Run inference with Vulkan GPU acceleration (first Vulkan device)

results = ncnn_model("https://ultralytics.com/images/bus.jpg", device="vulkan:0")

# Use second Vulkan device in multi-GPU systems

results = ncnn_model("https://ultralytics.com/images/bus.jpg", device="vulkan:1")

# Run inference with Vulkan GPU acceleration

yolo predict model='./yolo26n_ncnn_model' source='https://ultralytics.com/images/bus.jpg' device=vulkan:0

Yêu cầu về Vulkan

Đảm bảo bạn đã cài đặt trình điều khiển Vulkan cho GPU của mình. Hầu hết các trình điều khiển GPU hiện đại đều bao gồm hỗ trợ Vulkan theo mặc định. Bạn có thể xác minh tính khả dụng của Vulkan bằng các công cụ như vulkaninfo trên Linux hoặc Vulkan SDK trên Windows.

Xuất sang NCNN: Chuyển đổi mô hình YOLO26 của bạn

Bạn có thể mở rộng khả năng tương thích của mô hình và tính linh hoạt triển khai bằng cách chuyển đổi các mô hình YOLO26 sang định dạng NCNN.

Cài đặt

Để cài đặt các gói cần thiết, hãy chạy:

Cài đặt

# Install the required package for YOLO26

pip install ultralytics

Để biết hướng dẫn chi tiết và các phương pháp hay nhất, hãy xem Hướng dẫn cài đặt Ultralytics. Nếu bạn gặp bất kỳ khó khăn nào, hãy tham khảo Hướng dẫn các vấn đề thường gặp của chúng tôi để tìm giải pháp.

Cách sử dụng

Tất cả các mô hình Ultralytics YOLO26 đều được thiết kế để hỗ trợ xuất ngay lập tức, giúp dễ dàng tích hợp chúng vào quy trình triển khai ưa thích của bạn. Bạn có thể xem danh sách đầy đủ các định dạng xuất được hỗ trợ và các tùy chọn cấu hình để chọn thiết lập tốt nhất cho ứng dụng của mình.

Cách sử dụng

from ultralytics import YOLO

# Load the YOLO26 model

model = YOLO("yolo26n.pt")

# Export the model to NCNN format

model.export(format="ncnn") # creates '/yolo26n_ncnn_model'

# Load the exported NCNN model

ncnn_model = YOLO("./yolo26n_ncnn_model")

# Run inference

results = ncnn_model("https://ultralytics.com/images/bus.jpg")

# Export a YOLO26n PyTorch model to NCNN format

yolo export model=yolo26n.pt format=ncnn # creates '/yolo26n_ncnn_model'

# Run inference with the exported model

yolo predict model='./yolo26n_ncnn_model' source='https://ultralytics.com/images/bus.jpg'

Các đối số xuất

| Đối số | Loại | Mặc định | Mô tả |

|---|---|---|---|

format | str | 'ncnn' | Dạng mục tiêu cho mô hình được xuất, xác định khả năng tương thích với các môi trường triển khai khác nhau. |

imgsz | int hoặc tuple | 640 | Kích thước hình ảnh mong muốn cho đầu vào của mô hình. Có thể là một số nguyên cho hình ảnh vuông hoặc một bộ giá trị (height, width) cho các kích thước cụ thể. |

half | bool | False | Cho phép lượng tử hóa FP16 (nửa độ chính xác), giảm kích thước mô hình và có khả năng tăng tốc độ suy luận trên phần cứng được hỗ trợ. |

batch | int | 1 | Chỉ định kích thước suy luận theo lô của mô hình xuất hoặc số lượng hình ảnh tối đa mà mô hình đã xuất sẽ xử lý đồng thời ở chế độ predict chế độ. |

device | str | None | Chỉ định thiết bị để xuất: GPU (device=0), CPU (device=cpu), MPS cho Apple silicon (device=mps). |

Để biết thêm chi tiết về quy trình xuất, hãy truy cập trang tài liệu Ultralytics về xuất.

Triển khai các mô hình YOLO26 NCNN đã xuất

Sau khi xuất các mô hình Ultralytics YOLO26 của bạn sang định dạng NCNN, bạn có thể triển khai chúng bằng cách sử dụng YOLO("yolo26n_ncnn_model/") phương pháp như được hiển thị trong ví dụ sử dụng ở trên. Để biết hướng dẫn triển khai cụ thể cho từng nền tảng, hãy xem các tài nguyên sau:

Android: Xây dựng và tích hợp các mô hình NCNN để detect đối tượng trong ứng dụng Android.

macOS: Triển khai các mô hình NCNN trên hệ thống macOS.

Linux: Triển khai các mô hình NCNN trên thiết bị Linux bao gồm Raspberry Pi và các hệ thống nhúng tương tự.

Windows x64: Triển khai các mô hình NCNN trên Windows x64 bằng Visual Studio.

Tóm tắt

Hướng dẫn này đã đề cập đến việc xuất các mô hình Ultralytics YOLO26 sang định dạng NCNN để cải thiện hiệu quả và tốc độ trên các thiết bị hạn chế tài nguyên.

Để biết thêm chi tiết, hãy tham khảo tài liệu NCNN chính thức. Đối với các tùy chọn xuất khác, vui lòng truy cập trang hướng dẫn tích hợp của chúng tôi.

Câu hỏi thường gặp

Làm cách nào để xuất các mô hình Ultralytics YOLO26 sang định dạng NCNN?

Để xuất mô hình Ultralytics YOLO26 của bạn sang định dạng NCNN:

Python: Sử dụng

exportphương thức từ lớp YOLO.from ultralytics import YOLO # Load the YOLO26 model model = YOLO("yolo26n.pt") # Export to NCNN format model.export(format="ncnn") # creates '/yolo26n_ncnn_model'CLI: Sử dụng

yolo exportcommand.yolo export model=yolo26n.pt format=ncnn # creates '/yolo26n_ncnn_model'

Để biết các tùy chọn xuất chi tiết, xem tài liệu Export.

Những lợi ích của việc xuất các mô hình YOLO26 sang NCNN là gì?

Việc xuất các mô hình Ultralytics YOLO26 của bạn sang NCNN mang lại một số lợi ích:

- Hiệu quả: Các mô hình NCNN được tối ưu hóa cho các thiết bị di động và nhúng, đảm bảo hiệu suất cao ngay cả với tài nguyên tính toán hạn chế.

- Lượng tử hóa: NCNN hỗ trợ các kỹ thuật như lượng tử hóa giúp cải thiện tốc độ mô hình và giảm mức sử dụng bộ nhớ.

- Khả năng tương thích rộng: Bạn có thể triển khai các mô hình NCNN trên nhiều nền tảng, bao gồm Android, iOS, Linux và macOS.

- Tăng tốc GPU bằng Vulkan: Tận dụng khả năng tăng tốc GPU trên các GPU của AMD, Intel và các GPU không phải của NVIDIA khác thông qua Vulkan để suy luận nhanh hơn.

Để biết thêm chi tiết, xem phần Tại sao nên xuất sang NCNN?.

Tại sao nên sử dụng NCNN cho các ứng dụng AI trên thiết bị di động?

NCNN, được phát triển bởi Tencent, được tối ưu hóa đặc biệt cho các nền tảng di động. Các lý do chính để sử dụng NCNN bao gồm:

- Hiệu suất cao: Được thiết kế để xử lý nhanh chóng và hiệu quả trên CPU di động.

- Đa nền tảng: Tương thích với các framework phổ biến như TensorFlow và ONNX, giúp bạn dễ dàng chuyển đổi và triển khai các mô hình trên các nền tảng khác nhau.

- Hỗ trợ Cộng đồng: Hỗ trợ cộng đồng tích cực đảm bảo những cải tiến và cập nhật liên tục.

Để biết thêm thông tin, xem phần Các tính năng chính của mô hình NCNN.

Những nền tảng nào được hỗ trợ để triển khai mô hình NCNN?

NCNN rất linh hoạt và hỗ trợ nhiều nền tảng khác nhau:

- Thiết bị di động: Android, iOS.

- Hệ thống nhúng và thiết bị IoT: Các thiết bị như Raspberry Pi và NVIDIA Jetson.

- Máy tính để bàn và Máy chủ: Linux, Windows và macOS.

Để cải thiện hiệu suất trên Raspberry Pi, hãy cân nhắc sử dụng định dạng NCNN như được trình bày chi tiết trong Hướng dẫn Raspberry Pi của chúng tôi.

Làm cách nào để triển khai các mô hình Ultralytics YOLO26 NCNN trên Android?

Để triển khai các mô hình YOLO26 của bạn trên Android:

- Xây dựng cho Android: Làm theo hướng dẫn NCNN Build for Android.

- Tích hợp với ứng dụng của bạn: Sử dụng NCNN Android SDK để tích hợp mô hình đã xuất vào ứng dụng của bạn để suy luận hiệu quả trên thiết bị.

Để biết hướng dẫn chi tiết, hãy xem Triển khai các mô hình YOLO26 NCNN đã xuất.

Để biết thêm các hướng dẫn nâng cao và trường hợp sử dụng, hãy truy cập hướng dẫn triển khai Ultralytics.

Làm cách nào để sử dụng tăng tốc GPU Vulkan với các mô hình NCNN?

NCNN hỗ trợ Vulkan để tăng tốc GPU trên các GPU của AMD, Intel và các GPU không phải của NVIDIA khác. Để sử dụng Vulkan:

from ultralytics import YOLO

# Load NCNN model and run with Vulkan GPU

model = YOLO("yolo26n_ncnn_model")

results = model("image.jpg", device="vulkan:0") # Use first Vulkan device

Đối với các hệ thống đa GPU, hãy chỉ định chỉ số thiết bị (ví dụ, vulkan:1 cho GPU thứ hai). Đảm bảo rằng các driver Vulkan đã được cài đặt cho GPU của bạn. Xem Tăng tốc GPU Vulkan phần để biết thêm chi tiết.