Link to this section快速入门指南:Seeed Studio reCamera 与 Ultralytics YOLO26#

reCamera was introduced for the AI community at YOLO Vision 2024 (YV24), Ultralytics annual hybrid event. It is mainly designed for edge AI applications, offering powerful processing capabilities and effortless deployment.

凭借对多种硬件配置和开源资源的支持,它成为了在边缘侧进行原型设计和部署创新 计算机视觉 解决方案 的理想平台。

Link to this section为什么选择 reCamera?#

reCamera 系列专为边缘 AI 应用而生,旨在满足开发者和创新者的需求。以下是它的突出优势:

-

RISC-V 驱动的性能:其核心是基于 RISC-V 架构的 SG200X 处理器,在保持能效的同时为边缘 AI 任务提供卓越的性能。凭借每秒执行 1 万亿次运算(1 TOPS)的能力,它能轻松处理诸如实时 目标检测 等严苛任务。

-

优化的视频技术:支持 H.264 和 H.265 等先进视频压缩标准,在不牺牲画质的前提下减少存储和带宽需求。HDR 成像、3D 降噪和镜头校正等功能确保了即使在复杂环境下也能获得专业的视觉效果。

-

高能效双处理架构:当 SG200X 处理复杂的 AI 任务时,较小的 8 位微控制器负责管理简单操作以节省功耗,这使得 reCamera 非常适合电池供电或低功耗设置。

-

模块化且可升级的设计:reCamera 采用模块化结构,由核心板、传感器板和基板这三个主要组件组成。这种设计让开发者能够轻松更换或升级组件,确保了项目的灵活性和面向未来的可扩展性。

Link to this sectionreCamera 快速硬件设置#

请按照 reCamera 快速入门指南 进行设备的初始配置,例如将设备连接到 WiFi 网络,并访问 Node-RED Web UI 以快速预览检测结果。

Link to this section使用预装的 YOLO26 模型进行推理#

reCamera 预装了四款 Ultralytics YOLO26 模型,你只需在 Node-RED 控制面板中选择你所需的模型即可。

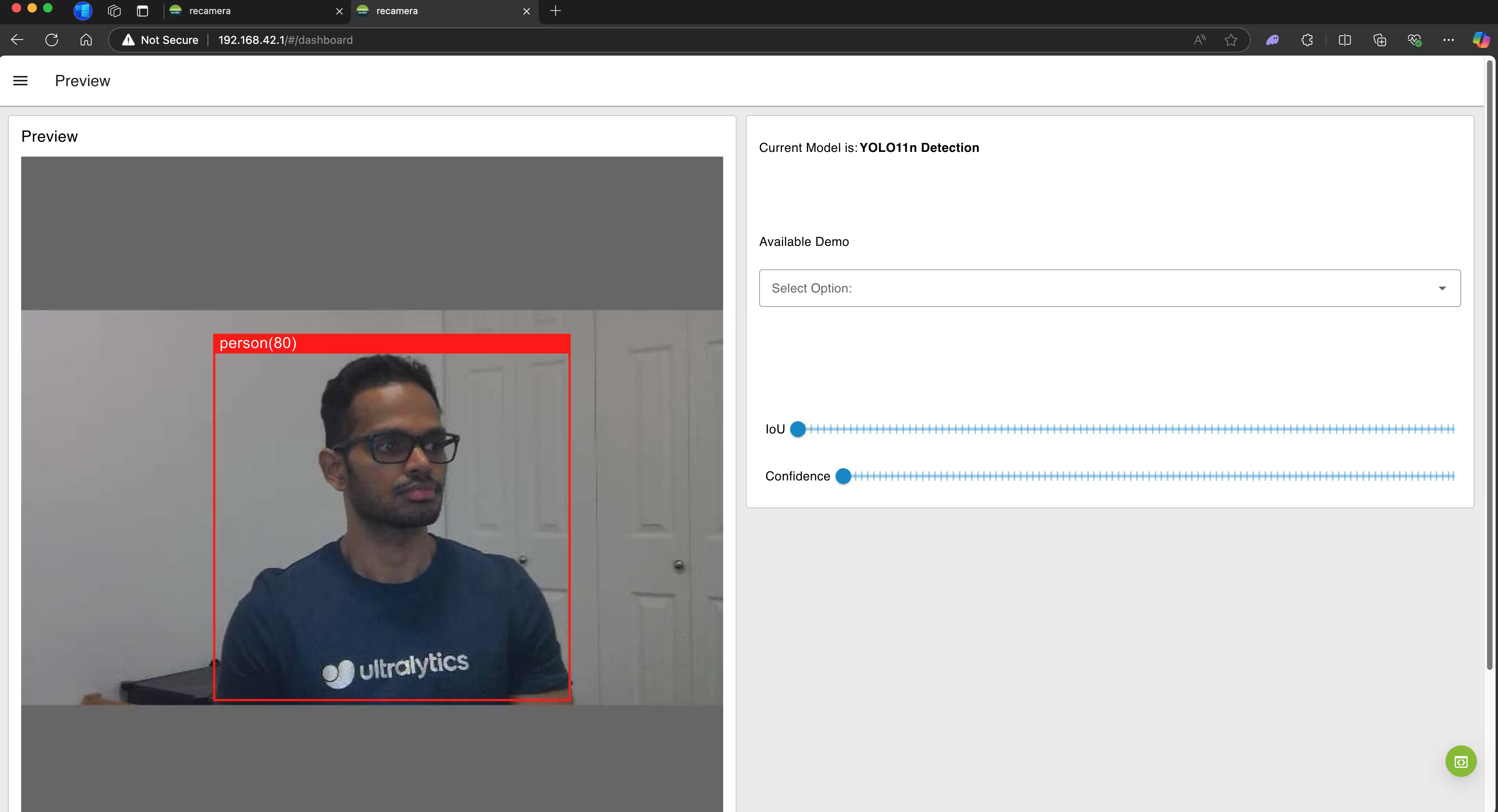

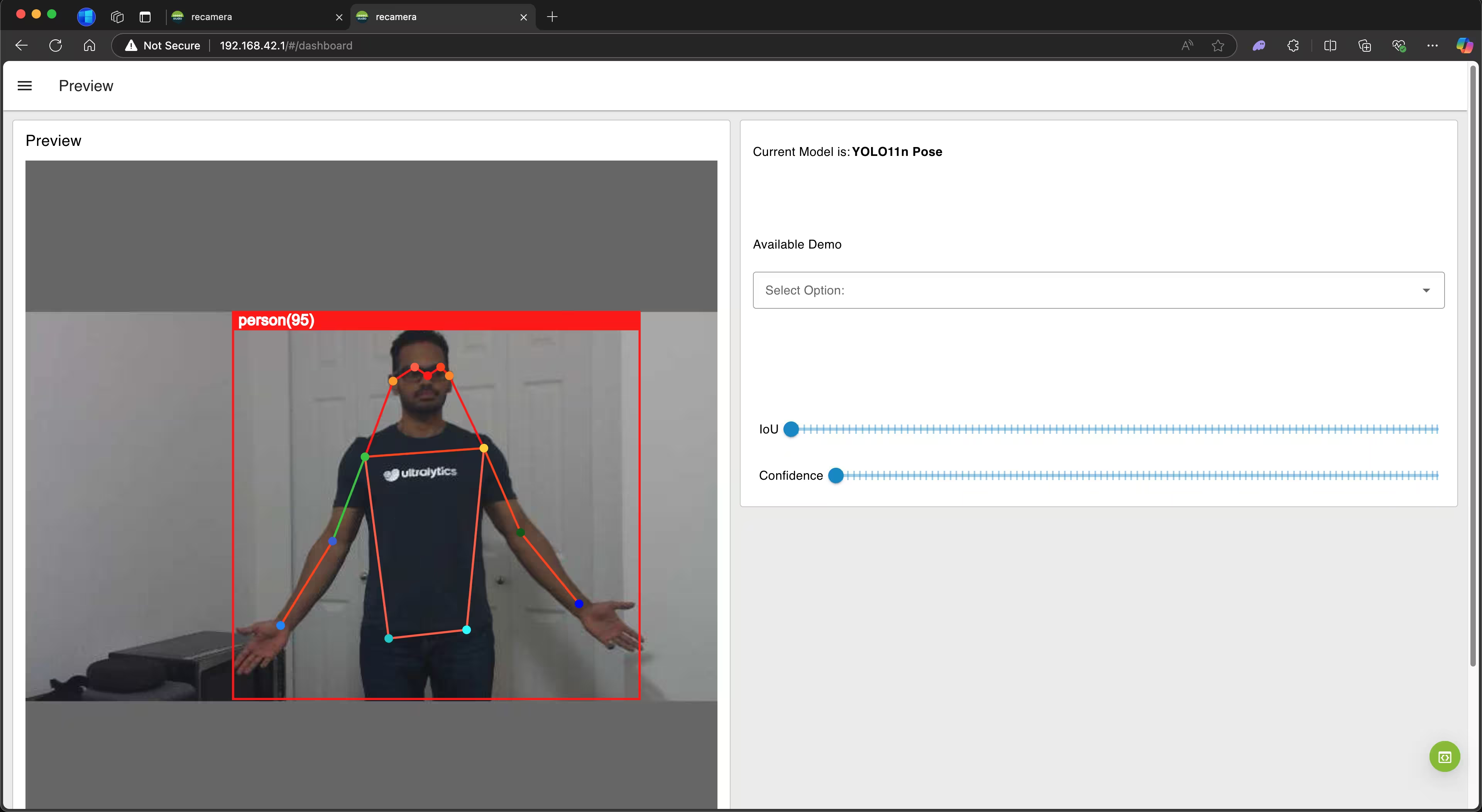

步骤 1:如果你已将 reCamera 连接到网络,请在 Web 浏览器中输入 reCamera 的 IP 地址以打开 Node-RED 控制面板。如果你通过 USB 将 reCamera 连接到 PC,则可以输入 192.168.42.1。此时你会看到 YOLO26n 检测模型已默认加载。

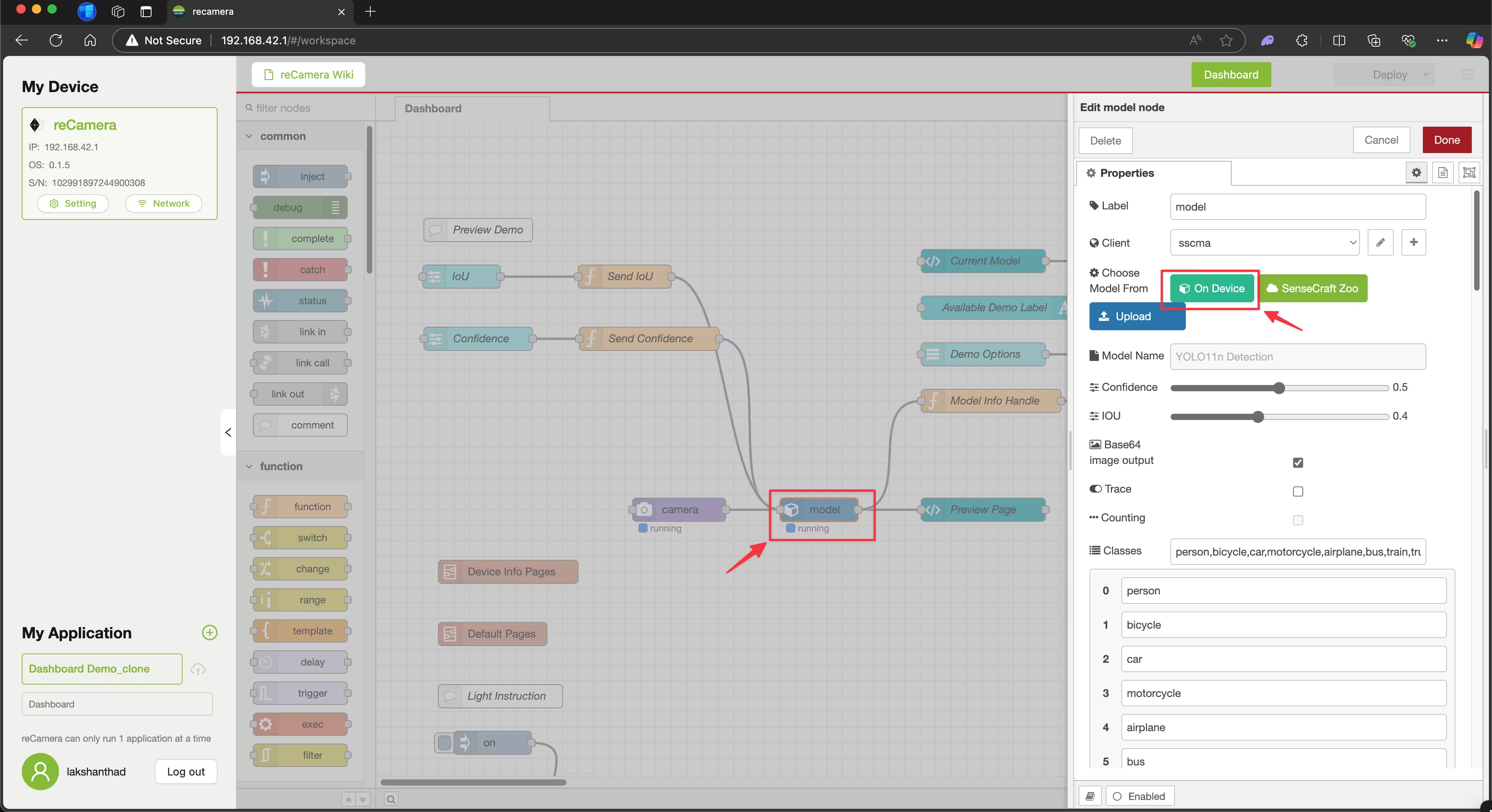

步骤 2:点击右下角的绿色圆圈以进入 Node-RED 流程编辑器。

步骤 3:点击 model 节点并点击 On Device。

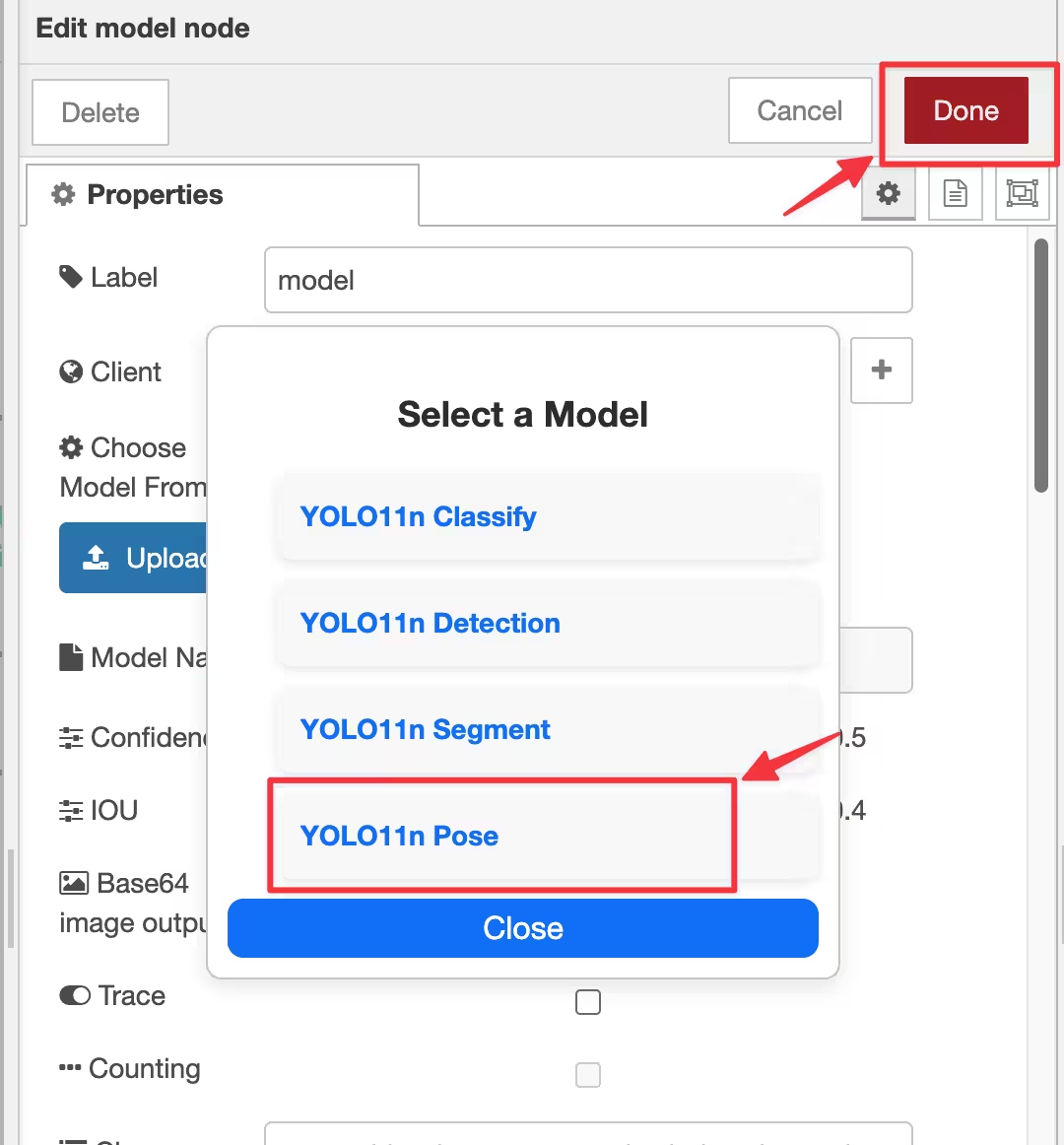

步骤 4:从四款预装的 YOLO26n 模型中选择一个,然后点击 Done。例如,在此我们将选择 YOLO26n Pose

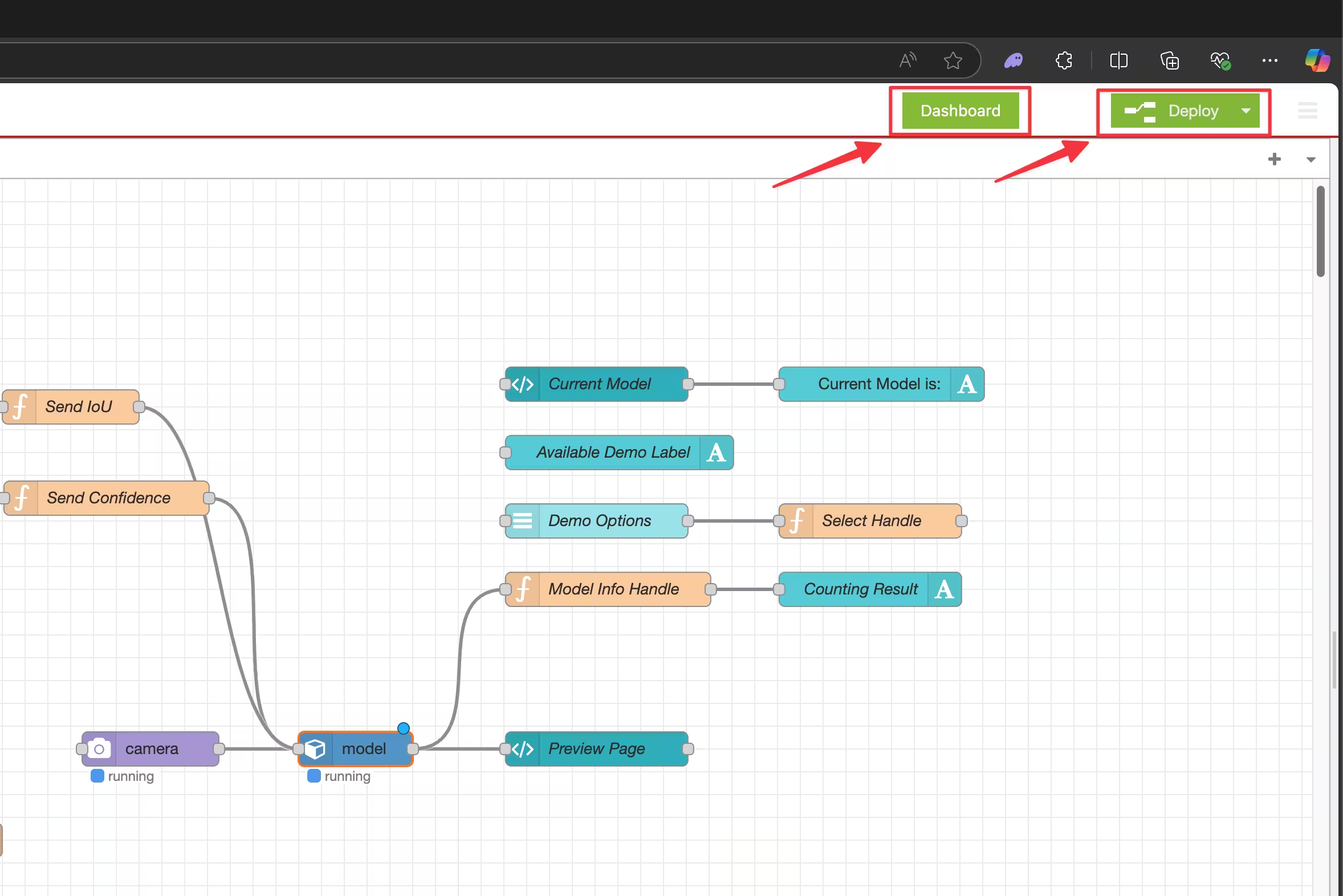

步骤 5:点击 Deploy,部署完成后点击 Dashboard。

现在你就可以看到正在运行的 YOLO26n 姿态估计模型了!

Link to this section导出为 cvimodel:转换你的 YOLO26 模型#

如果你想在 reCamera 上使用 自定义训练的 YOLO26 模型,请按照以下步骤操作。

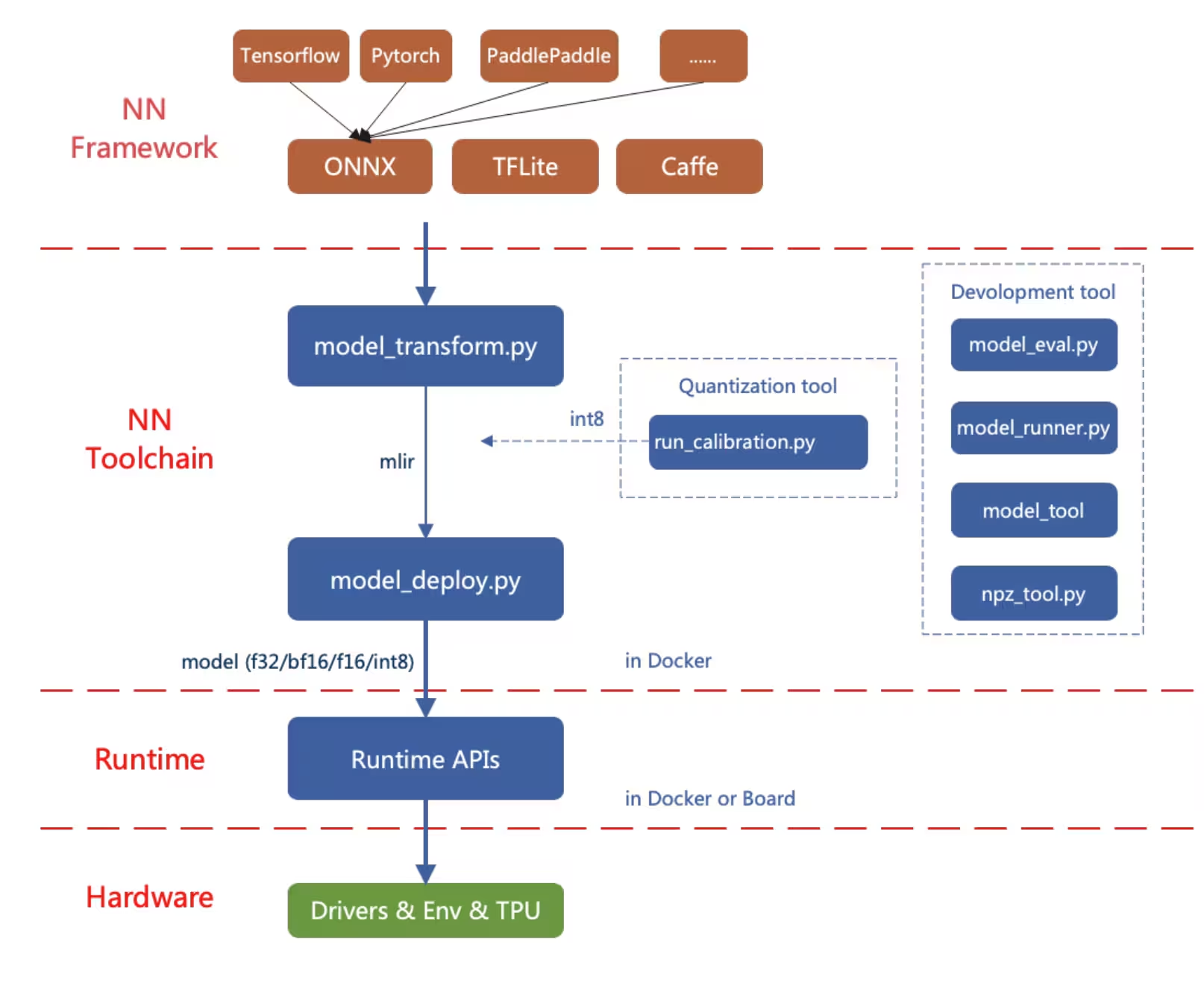

在这里,我们首先将 PyTorch 模型转换为 ONNX,然后将其转换为 MLIR 模型格式。最后,将 MLIR 转换为 cvimodel 以便在设备上进行推理。

Link to this section导出为 ONNX#

将 Ultralytics YOLO26 模型导出为 ONNX 模型格式。

Link to this section安装#

要安装所需的软件包,请运行:

pip install ultralytics有关安装过程的详细说明和最佳实践,请查看我们的 Ultralytics 安装指南。在安装 YOLO26 所需软件包时,如果遇到任何困难,请查阅我们的 常见问题指南 获取解决方案和建议。

Link to this section使用方法#

from ultralytics import YOLO

# Load a YOLO26 model

model = YOLO("yolo26n.pt")

# Export the model to ONNX format

model.export(format="onnx", opset=14) # creates 'yolo26n.onnx'有关导出过程的更多详情,请访问 Ultralytics 导出文档页面。

Link to this section将 ONNX 导出为 MLIR 和 cvimodel#

获得 ONNX 模型后,请参考 转换和量化 AI 模型 页面,将 ONNX 模型转换为 MLIR,然后再转换为 cvimodel。

我们正积极致力于将 reCamera 支持直接集成到 Ultralytics 软件包中,即将发布。在此期间,请查看我们关于 将 Ultralytics YOLO 模型与 Seeed Studio 的 reCamera 集成 的博客,以获取更多见解。

Link to this section基准测试#

即将推出。

Link to this sectionreCamera 的实际应用场景#

reCamera 先进的计算机视觉能力和模块化设计使其适用于广泛的现实场景,帮助开发者和企业轻松应对各种独特挑战。

-

跌倒检测:专为安全和医疗保健应用设计,reCamera 可以实时检测跌倒情况,非常适合养老护理、医院以及需要快速响应的工业环境。

-

个人防护装备检测:reCamera 可用于通过实时检测 PPE 合规性来确保工作场所安全。它有助于识别工人是否佩戴了头盔、手套或其他安全装备,从而降低工业环境中的风险。

-

火灾检测:reCamera 的实时处理能力使其成为工业和住宅区域 火灾检测 的绝佳选择,通过提供预警来防止潜在灾难。

-

废弃物检测:它也可用于废弃物检测应用,成为环境监测和 废弃物管理 的极佳工具。

-

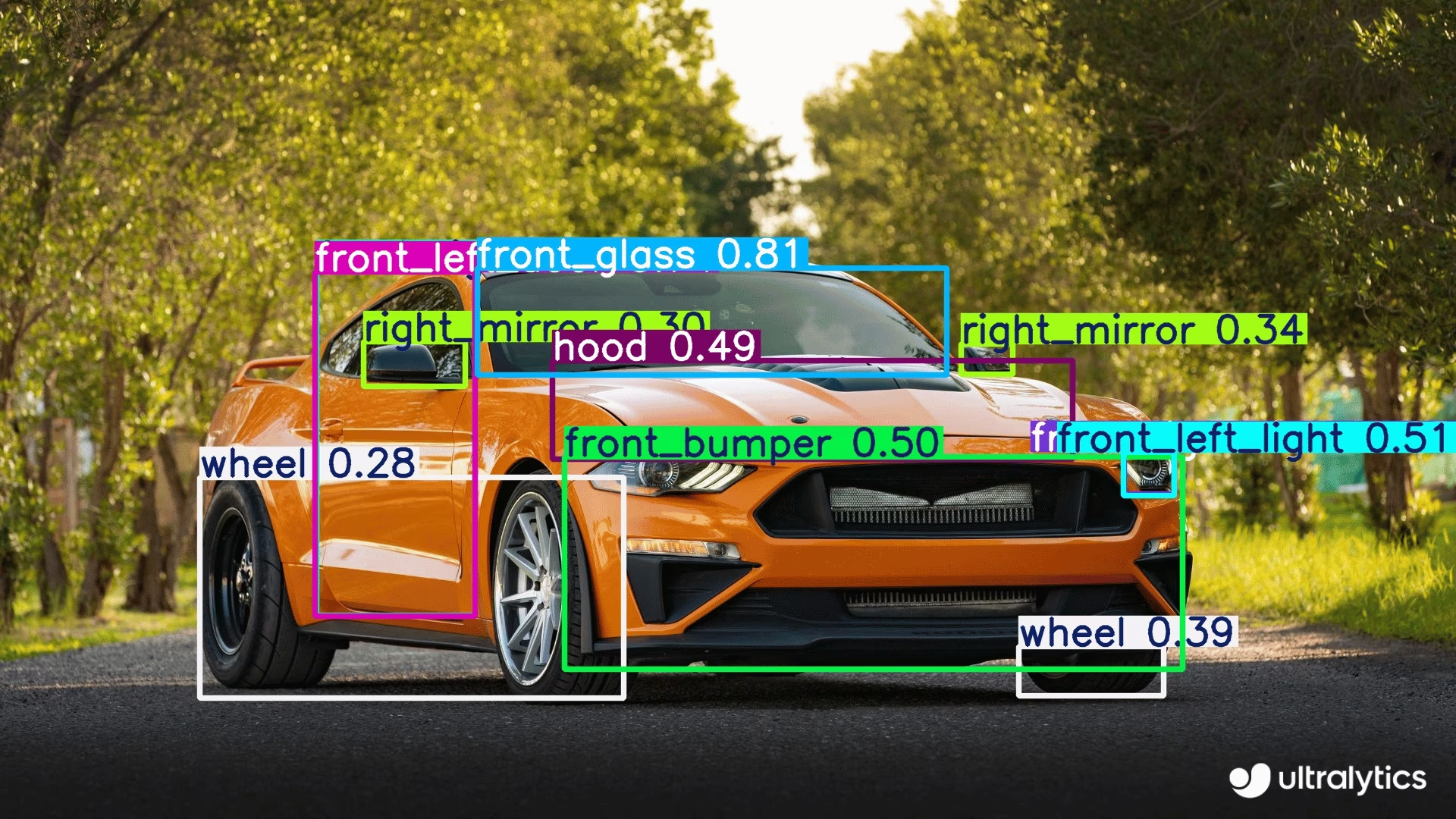

汽车零部件检测:在制造和汽车行业中,它有助于检测和分析汽车零部件,用于质量控制、装配线监控和库存管理。

Link to this section常见问题 (FAQ)#

Link to this section如何首次安装和设置 reCamera?#

要首次设置你的 reCamera,请遵循以下步骤:

- 将 reCamera 连接到电源

- 使用 reCamera 快速入门指南 将其连接到你的 WiFi 网络

- 在 Web 浏览器中输入设备的 IP 地址以访问 Node-RED Web UI(如果通过 USB 连接,请使用

192.168.42.1) - 通过控制面板界面立即开始使用预装的 YOLO26 模型

Link to this section我可以在 reCamera 上使用我自定义训练的 YOLO26 模型吗?#

可以,你可以在 reCamera 上使用自定义训练的 YOLO26 模型。该过程包括:

- 使用

model.export(format="onnx", opset=14)将你的 PyTorch 模型导出为 ONNX 格式 - 将 ONNX 模型转换为 MLIR 格式

- 将 MLIR 转换为 cvimodel 格式以进行设备内推理

- 将转换后的模型加载到你的 reCamera 上

有关详细说明,请参阅 转换和量化 AI 模型 指南。

Link to this sectionreCamera 与传统 IP 摄像机有何不同?#

与需要外部硬件进行处理的传统 IP 摄像机不同,reCamera:

- 凭借其 RISC-V SG200X 处理器,将 AI 处理直接集成在设备上

- 为实时边缘 AI 应用提供 1 TOPS 的计算能力

- 采用模块化设计,允许组件升级和定制

- 支持 H.264/H.265 压缩、HDR 成像和 3D 降噪等先进视频技术

- 预装了 Ultralytics YOLO26 模型,可立即使用

这些特性使 reCamera 成为无需额外外部处理硬件即可运行的独立边缘 AI 应用解决方案。