Guía de inicio rápido: NVIDIA Jetson con Ultralytics YOLO26

Esta guía completa proporciona un recorrido detallado para desplegar Ultralytics YOLO26 en dispositivos NVIDIA Jetson. Además, presenta benchmarks de rendimiento para demostrar las capacidades de YOLO26 en estos dispositivos pequeños y potentes.

Nuevo soporte de producto

Hemos actualizado esta guía con el último NVIDIA Jetson AGX Thor Developer Kit, que ofrece hasta 2070 FP4 TFLOPS de computación de IA y 128 GB de memoria con una potencia configurable entre 40 W y 130 W. Ofrece más de 7,5 veces más computación de IA que NVIDIA Jetson AGX Orin, con una eficiencia energética 3,5 veces mejor para ejecutar sin problemas los modelos de IA más populares.

Ver: Cómo usar Ultralytics YOLO26 en dispositivos NVIDIA Jetson

Nota

Esta guía ha sido probada con NVIDIA Jetson AGX Thor Developer Kit (Jetson T5000) ejecutando la última versión estable de JetPack, JP7.0, NVIDIA Jetson AGX Orin Developer Kit (64GB) ejecutando la versión de JetPack JP6.2, NVIDIA Jetson Orin Nano Super Developer Kit ejecutando la versión de JetPack JP6.1, Seeed Studio reComputer J4012 basado en NVIDIA Jetson Orin NX de 16 GB ejecutando la versión de JetPack JP6.0/ la versión de JetPack JP5.1.3 y Seeed Studio reComputer J1020 v2 basado en NVIDIA Jetson Nano de 4 GB ejecutando la versión de JetPack JP4.6.1. Se espera que funcione en toda la línea de hardware NVIDIA Jetson, incluidos los dispositivos más recientes y los heredados.

¿Qué es NVIDIA Jetson?

NVIDIA Jetson es una serie de placas de computación embebidas diseñadas para llevar la computación de IA (inteligencia artificial) acelerada a dispositivos de borde. Estos dispositivos compactos y potentes están construidos alrededor de la arquitectura GPU de NVIDIA y pueden ejecutar algoritmos complejos de IA y modelos de aprendizaje profundo directamente en el dispositivo, sin depender de recursos de computación en la nube. Las placas Jetson se utilizan a menudo en robótica, vehículos autónomos, automatización industrial y otras aplicaciones donde la inferencia de IA debe realizarse localmente con baja latencia y alta eficiencia. Además, estas placas se basan en la arquitectura ARM64 y funcionan con un menor consumo de energía en comparación con los dispositivos de computación GPU tradicionales.

Comparación de la serie NVIDIA Jetson

NVIDIA Jetson AGX Thor es la última iteración de la familia NVIDIA Jetson basada en la arquitectura NVIDIA Blackwell, que aporta un rendimiento de IA drásticamente mejorado en comparación con las generaciones anteriores. La siguiente tabla compara algunos de los dispositivos Jetson en el ecosistema.

| Jetson AGX Thor(T5000) | Jetson AGX Orin 64GB | Jetson Orin NX 16GB | Jetson Orin Nano Super | Jetson AGX Xavier | Jetson Xavier NX | Jetson Nano | |

|---|---|---|---|---|---|---|---|

| Rendimiento de la IA | 2070 TFLOPS | 275 TOPS | 100 TOPS | 67 TOPS | 32 TOPS | 21 TOPS | 472 GFLOPS |

| GPU | GPU de arquitectura NVIDIA Blackwell de 2560 núcleos con 96 Tensor Cores | GPU NVIDIA Ampere architecture de 2048 núcleos con 64 Tensor Cores | GPU NVIDIA Ampere architecture de 1024 núcleos con 32 Tensor Cores | GPU NVIDIA Ampere architecture de 1024 núcleos con 32 Tensor Cores | GPU NVIDIA Volta architecture de 512 núcleos con 64 Tensor Cores | GPU NVIDIA Volta™ architecture de 384 núcleos con 48 Tensor Cores | GPU NVIDIA Maxwell™ architecture de 128 núcleos |

| Frecuencia Máxima de la GPU | 1.57 GHz | 1.3 GHz | 918 MHz | 1020 MHz | 1377 MHz | 1100 MHz | 921MHz |

| CPU | CPU Arm® Neoverse®-V3AE de 14 núcleos y 64 bits 1MB L2 + 16MB L3 | CPU NVIDIA Arm® Cortex A78AE v8.2 de 64 bits y 12 núcleos, 3 MB de L2 + 6 MB de L3 | CPU NVIDIA Arm® Cortex A78AE v8.2 de 64 bits y 8 núcleos, 2 MB de L2 + 4 MB de L3 | CPU Arm® Cortex®-A78AE v8.2 de 64 bits y 6 núcleos, 1,5 MB de L2 + 4 MB de L3 | CPU NVIDIA Carmel Arm®v8.2 de 64 bits y 8 núcleos, 8 MB de L2 + 4 MB de L3 | CPU NVIDIA Carmel Arm®v8.2 de 64 bits y 6 núcleos, 6 MB de L2 + 4 MB de L3 | Procesador MPCore Arm® Cortex®-A57 de cuatro núcleos |

| Frecuencia Máxima de la CPU | 2.6 GHz | 2.2 GHz | 2.0 GHz | 1.7 GHz | 2.2 GHz | 1.9 GHz | 1.43GHz |

| Memoria | 128GB 256-bit LPDDR5X 273GB/s | 64 GB LPDDR5 de 256 bits 204,8 GB/s | 16 GB LPDDR5 de 128 bits 102,4 GB/s | 8GB 128-bit LPDDR5 102 GB/s | 32 GB LPDDR4x de 256 bits 136,5 GB/s | 8 GB LPDDR4x de 128 bits 59,7 GB/s | 4 GB LPDDR4 de 64 bits 25.6 GB/s |

Para obtener una tabla de comparación más detallada, visita la sección Comparar especificaciones de la página oficial de NVIDIA Jetson.

¿Qué es NVIDIA JetPack?

El SDK NVIDIA JetPack que impulsa los módulos Jetson es la solución más completa y proporciona un entorno de desarrollo completo para la creación de aplicaciones de IA aceleradas de extremo a extremo y reduce el tiempo de comercialización. JetPack incluye Jetson Linux con bootloader, kernel de Linux, entorno de escritorio Ubuntu y un conjunto completo de bibliotecas para la aceleración de la computación de GPU, multimedia, gráficos y visión artificial. También incluye ejemplos, documentación y herramientas de desarrollo tanto para el ordenador host como para el kit de desarrollo, y es compatible con SDK de nivel superior como DeepStream para el análisis de vídeo en streaming, Isaac para la robótica y Riva para la IA conversacional.

Flashear JetPack a NVIDIA Jetson

El primer paso después de adquirir un dispositivo NVIDIA Jetson es flashear NVIDIA JetPack en el dispositivo. Existen varias formas diferentes de flashear dispositivos NVIDIA Jetson.

- Si posee un Kit de Desarrollo NVIDIA oficial, como el Jetson AGX Thor Developer Kit, puede descargar una imagen y preparar una memoria USB de arranque para flashear JetPack al SSD incluido.

- Si posees un Kit de Desarrollo oficial de NVIDIA, como el Kit de Desarrollo Jetson Orin Nano, puedes descargar una imagen y preparar una tarjeta SD con JetPack para arrancar el dispositivo.

- Si posee cualquier otro kit de desarrollo de NVIDIA, puede flashear JetPack al dispositivo usando SDK Manager.

- Si posee un dispositivo Seeed Studio reComputer J4012, puede flashear JetPack al SSD incluido, y si posee un dispositivo Seeed Studio reComputer J1020 v2, puede flashear JetPack a la eMMC/SSD.

- Si posee cualquier otro dispositivo de terceros impulsado por el módulo NVIDIA Jetson, se recomienda seguir el flasheo por línea de comandos.

Nota

Para los métodos 1, 4 y 5 anteriores, después de flashear el sistema e iniciar el dispositivo, ingrese "sudo apt update && sudo apt install nvidia-jetpack -y" en la terminal del dispositivo para instalar todos los componentes restantes de JetPack necesarios.

Soporte de JetPack según el dispositivo Jetson

La siguiente tabla destaca las versiones de NVIDIA JetPack compatibles con diferentes dispositivos NVIDIA Jetson.

| JetPack 4 | JetPack 5 | JetPack 6 | JetPack 7 | |

|---|---|---|---|---|

| Jetson Nano | ✅ | ❌ | ❌ | ❌ |

| Jetson TX2 | ✅ | ❌ | ❌ | ❌ |

| Jetson Xavier NX | ✅ | ✅ | ❌ | ❌ |

| Jetson AGX Xavier | ✅ | ✅ | ❌ | ❌ |

| Jetson AGX Orin | ❌ | ✅ | ✅ | ❌ |

| Jetson Orin NX | ❌ | ✅ | ✅ | ❌ |

| Jetson Orin Nano | ❌ | ✅ | ✅ | ❌ |

| Jetson AGX Thor | ❌ | ❌ | ❌ | ✅ |

Inicio rápido con Docker

La forma más rápida de empezar con Ultralytics YOLO26 en NVIDIA Jetson es ejecutarlo con imágenes Docker precompiladas para Jetson. Consulte la tabla anterior y elija la versión de JetPack según el dispositivo Jetson que posea.

t=ultralytics/ultralytics:latest-jetson-jetpack4

sudo docker pull $t && sudo docker run -it --ipc=host --runtime=nvidia $t

t=ultralytics/ultralytics:latest-jetson-jetpack5

sudo docker pull $t && sudo docker run -it --ipc=host --runtime=nvidia $t

t=ultralytics/ultralytics:latest-jetson-jetpack6

sudo docker pull $t && sudo docker run -it --ipc=host --runtime=nvidia $t

t=ultralytics/ultralytics:latest-nvidia-arm64

sudo docker pull $t && sudo docker run -it --ipc=host --runtime=nvidia $t

Una vez hecho esto, vaya a la sección Usar TensorRT en NVIDIA Jetson.

Comenzar con la instalación nativa

Para una instalación nativa sin Docker, consulte los pasos siguientes.

Ejecutar en JetPack 7.0

Instalar el paquete Ultralytics

Aquí instalaremos el paquete Ultralytics en Jetson con dependencias opcionales para poder exportar los modelos de PyTorch a otros formatos diferentes. Nos centraremos principalmente en las exportaciones de NVIDIA TensorRT porque TensorRT se asegurará de que podamos obtener el máximo rendimiento de los dispositivos Jetson.

Actualizar la lista de paquetes, instalar pip y actualizar a la última versión

sudo apt update sudo apt install python3-pip -y pip install -U pipInstalar

ultralyticspaquete pip con dependencias opcionalespip install ultralytics[export]Reiniciar el dispositivo

sudo reboot

Instalar PyTorch y Torchvision

La instalación de ultralytics anterior instalará Torch y Torchvision. Sin embargo, estos 2 paquetes instalados a través de pip no son compatibles para ejecutarse en Jetson AGX Thor, que viene con JetPack 7.0 y CUDA 13. Por lo tanto, debemos instalarlos manualmente.

Instalar torch y torchvision según JP7.0

pip install torch torchvision --index-url https://download.pytorch.org/whl/cu130

Instalar onnxruntime-gpu

El onnxruntime-gpu paquete alojado en PyPI no tiene aarch64 binarios para Jetson. Por lo tanto, necesitamos instalar este paquete manualmente. Este paquete es necesario para algunas de las exportaciones.

Aquí descargaremos e instalaremos onnxruntime-gpu 1.24.0 con Python3.12 soporte.

pip install https://github.com/ultralytics/assets/releases/download/v0.0.0/onnxruntime_gpu-1.24.0-cp312-cp312-linux_aarch64.whl

Ejecutar en JetPack 6.1

Instalar el paquete Ultralytics

Aquí instalaremos el paquete Ultralytics en Jetson con dependencias opcionales para poder exportar los modelos de PyTorch a otros formatos diferentes. Nos centraremos principalmente en las exportaciones de NVIDIA TensorRT porque TensorRT se asegurará de que podamos obtener el máximo rendimiento de los dispositivos Jetson.

Actualizar la lista de paquetes, instalar pip y actualizar a la última versión

sudo apt update sudo apt install python3-pip -y pip install -U pipInstalar

ultralyticspaquete pip con dependencias opcionalespip install ultralytics[export]Reiniciar el dispositivo

sudo reboot

Instalar PyTorch y Torchvision

La instalación de ultralytics anterior instalará Torch y Torchvision. Sin embargo, estos dos paquetes instalados a través de pip no son compatibles con la plataforma Jetson, que se basa en la arquitectura ARM64. Por lo tanto, debemos instalar manualmente una rueda pip de PyTorch precompilada y compilar o instalar Torchvision desde la fuente.

Instalar torch 2.10.0 y torchvision 0.25.0 de acuerdo con JP6.1

pip install https://github.com/ultralytics/assets/releases/download/v0.0.0/torch-2.10.0-cp310-cp310-linux_aarch64.whl

pip install https://github.com/ultralytics/assets/releases/download/v0.0.0/torchvision-0.25.0-cp310-cp310-linux_aarch64.whl

Nota

Visite la página de PyTorch para Jetson para acceder a todas las diferentes versiones de PyTorch para las diferentes versiones de JetPack. Para obtener una lista más detallada sobre la compatibilidad de PyTorch y Torchvision, visite la página de compatibilidad de PyTorch y Torchvision.

Instalar cuDSS para solucionar un problema de dependencia con torch 2.10.0

wget https://developer.download.nvidia.com/compute/cudss/0.7.1/local_installers/cudss-local-tegra-repo-ubuntu2204-0.7.1_0.7.1-1_arm64.deb

sudo dpkg -i cudss-local-tegra-repo-ubuntu2204-0.7.1_0.7.1-1_arm64.deb

sudo cp /var/cudss-local-tegra-repo-ubuntu2204-0.7.1/cudss-*-keyring.gpg /usr/share/keyrings/

sudo apt-get update

sudo apt-get -y install cudss

Instalar onnxruntime-gpu

El onnxruntime-gpu paquete alojado en PyPI no tiene aarch64 binarios para Jetson. Por lo tanto, necesitamos instalar este paquete manualmente. Este paquete es necesario para algunas de las exportaciones.

Puede encontrar todos los onnxruntime-gpu paquetes, organizados por versión de JetPack, versión de Python y otros detalles de compatibilidad, en el Matriz de compatibilidad de Jetson Zoo con ONNX Runtime.

Para JetPack 6 con Python 3.10 soporte, puedes instalar onnxruntime-gpu 1.23.0:

pip install https://github.com/ultralytics/assets/releases/download/v0.0.0/onnxruntime_gpu-1.23.0-cp310-cp310-linux_aarch64.whl

Alternativamente, para onnxruntime-gpu 1.20.0:

pip install https://github.com/ultralytics/assets/releases/download/v0.0.0/onnxruntime_gpu-1.20.0-cp310-cp310-linux_aarch64.whl

Ejecutar en JetPack 5.1.2

Instalar el paquete Ultralytics

Aquí instalaremos el paquete Ultralytics en Jetson con dependencias opcionales para que podamos exportar los modelos PyTorch a otros formatos diferentes. Nos centraremos principalmente en las exportaciones NVIDIA TensorRT porque TensorRT se asegurará de que podamos obtener el máximo rendimiento de los dispositivos Jetson.

Actualizar la lista de paquetes, instalar pip y actualizar a la última versión

sudo apt update sudo apt install python3-pip -y pip install -U pipInstalar

ultralyticspaquete pip con dependencias opcionalespip install ultralytics[export]Reiniciar el dispositivo

sudo reboot

Instalar PyTorch y Torchvision

La instalación de ultralytics anterior instalará Torch y Torchvision. Sin embargo, estos dos paquetes instalados a través de pip no son compatibles con la plataforma Jetson, que se basa en la arquitectura ARM64. Por lo tanto, debemos instalar manualmente una rueda pip de PyTorch precompilada y compilar o instalar Torchvision desde la fuente.

Desinstalar PyTorch y Torchvision actualmente instalados

pip uninstall torch torchvisionInstalar

torch 2.1.0ytorchvision 0.16.2de acuerdo con JP5.1.2pip install https://github.com/ultralytics/assets/releases/download/v0.0.0/torch-2.1.0a0+41361538.nv23.06-cp38-cp38-linux_aarch64.whl pip install https://github.com/ultralytics/assets/releases/download/v0.0.0/torchvision-0.16.2+c6f3977-cp38-cp38-linux_aarch64.whl

Nota

Visite la página de PyTorch para Jetson para acceder a todas las diferentes versiones de PyTorch para las diferentes versiones de JetPack. Para obtener una lista más detallada sobre la compatibilidad de PyTorch y Torchvision, visite la página de compatibilidad de PyTorch y Torchvision.

Instalar onnxruntime-gpu

El onnxruntime-gpu paquete alojado en PyPI no tiene aarch64 binarios para Jetson. Por lo tanto, necesitamos instalar este paquete manualmente. Este paquete es necesario para algunas de las exportaciones.

Puede encontrar todos los onnxruntime-gpu paquetes, organizados por versión de JetPack, versión de Python y otros detalles de compatibilidad, en el Matriz de compatibilidad de Jetson Zoo con ONNX Runtime. Aquí descargaremos e instalaremos onnxruntime-gpu 1.17.0 con Python3.8 soporte.

wget https://nvidia.box.com/shared/static/zostg6agm00fb6t5uisw51qi6kpcuwzd.whl -O onnxruntime_gpu-1.17.0-cp38-cp38-linux_aarch64.whl

pip install onnxruntime_gpu-1.17.0-cp38-cp38-linux_aarch64.whl

Nota

onnxruntime-gpu automáticamente revertirá la versión de numpy a la última. Por lo tanto, necesitamos reinstalar numpy a 1.23.5 para solucionar un problema ejecutando:

pip install numpy==1.23.5

Usar TensorRT en NVIDIA Jetson

Entre todos los formatos de exportación de modelos compatibles con Ultralytics, TensorRT ofrece el mayor rendimiento de inferencia en dispositivos NVIDIA Jetson, lo que la convierte en nuestra principal recomendación para implementaciones en Jetson. Para obtener instrucciones de configuración y uso avanzado, consulte nuestra guía de integración de TensorRT.

Convertir el modelo a TensorRT y ejecutar la inferencia

El modelo YOLO26n en formato PyTorch se convierte a TensorRT para ejecutar inferencia con el modelo exportado.

Ejemplo

from ultralytics import YOLO

# Load a YOLO26n PyTorch model

model = YOLO("yolo26n.pt")

# Export the model to TensorRT

model.export(format="engine") # creates 'yolo26n.engine'

# Load the exported TensorRT model

trt_model = YOLO("yolo26n.engine")

# Run inference

results = trt_model("https://ultralytics.com/images/bus.jpg")

# Export a YOLO26n PyTorch model to TensorRT format

yolo export model=yolo26n.pt format=engine # creates 'yolo26n.engine'

# Run inference with the exported model

yolo predict model=yolo26n.engine source='https://ultralytics.com/images/bus.jpg'

Nota

Visite la página de exportación para acceder a argumentos adicionales al exportar modelos a diferentes formatos de modelo

Usar el Acelerador de Aprendizaje Profundo (DLA) de NVIDIA

NVIDIA Deep Learning Accelerator (DLA) es un componente de hardware especializado integrado en los dispositivos NVIDIA Jetson que optimiza la inferencia de aprendizaje profundo para la eficiencia energética y el rendimiento. Al descargar tareas de la GPU (liberándola para procesos más intensivos), DLA permite que los modelos se ejecuten con un menor consumo de energía manteniendo un alto rendimiento, ideal para sistemas integrados y aplicaciones de IA en tiempo real.

Los siguientes dispositivos Jetson están equipados con hardware DLA:

| Dispositivo Jetson | Núcleos DLA | Frecuencia máxima de DLA |

|---|---|---|

| Jetson AGX Orin Series | 2 | 1.6 GHz |

| Jetson Orin NX 16GB | 2 | 614 MHz |

| Jetson Orin NX 8GB | 1 | 614 MHz |

| Jetson AGX Xavier Series | 2 | 1.4 GHz |

| Jetson Xavier NX Series | 2 | 1.1 GHz |

Ejemplo

from ultralytics import YOLO

# Load a YOLO26n PyTorch model

model = YOLO("yolo26n.pt")

# Export the model to TensorRT with DLA enabled (only works with FP16 or INT8)

model.export(format="engine", device="dla:0", half=True) # dla:0 or dla:1 corresponds to the DLA cores

# Load the exported TensorRT model

trt_model = YOLO("yolo26n.engine")

# Run inference

results = trt_model("https://ultralytics.com/images/bus.jpg")

# Export a YOLO26n PyTorch model to TensorRT format with DLA enabled (only works with FP16 or INT8)

# Once DLA core number is specified at export, it will use the same core at inference

yolo export model=yolo26n.pt format=engine device="dla:0" half=True # dla:0 or dla:1 corresponds to the DLA cores

# Run inference with the exported model on the DLA

yolo predict model=yolo26n.engine source='https://ultralytics.com/images/bus.jpg'

Nota

Al utilizar las exportaciones de DLA, es posible que algunas capas no sean compatibles para ejecutarse en DLA y recurran a la GPU para su ejecución. Esta alternativa puede introducir latencia adicional e impactar el rendimiento general de la inferencia. Por lo tanto, DLA no está diseñado principalmente para reducir la latencia de la inferencia en comparación con TensorRT que se ejecuta completamente en la GPU. En cambio, su propósito principal es aumentar el rendimiento y mejorar la eficiencia energética.

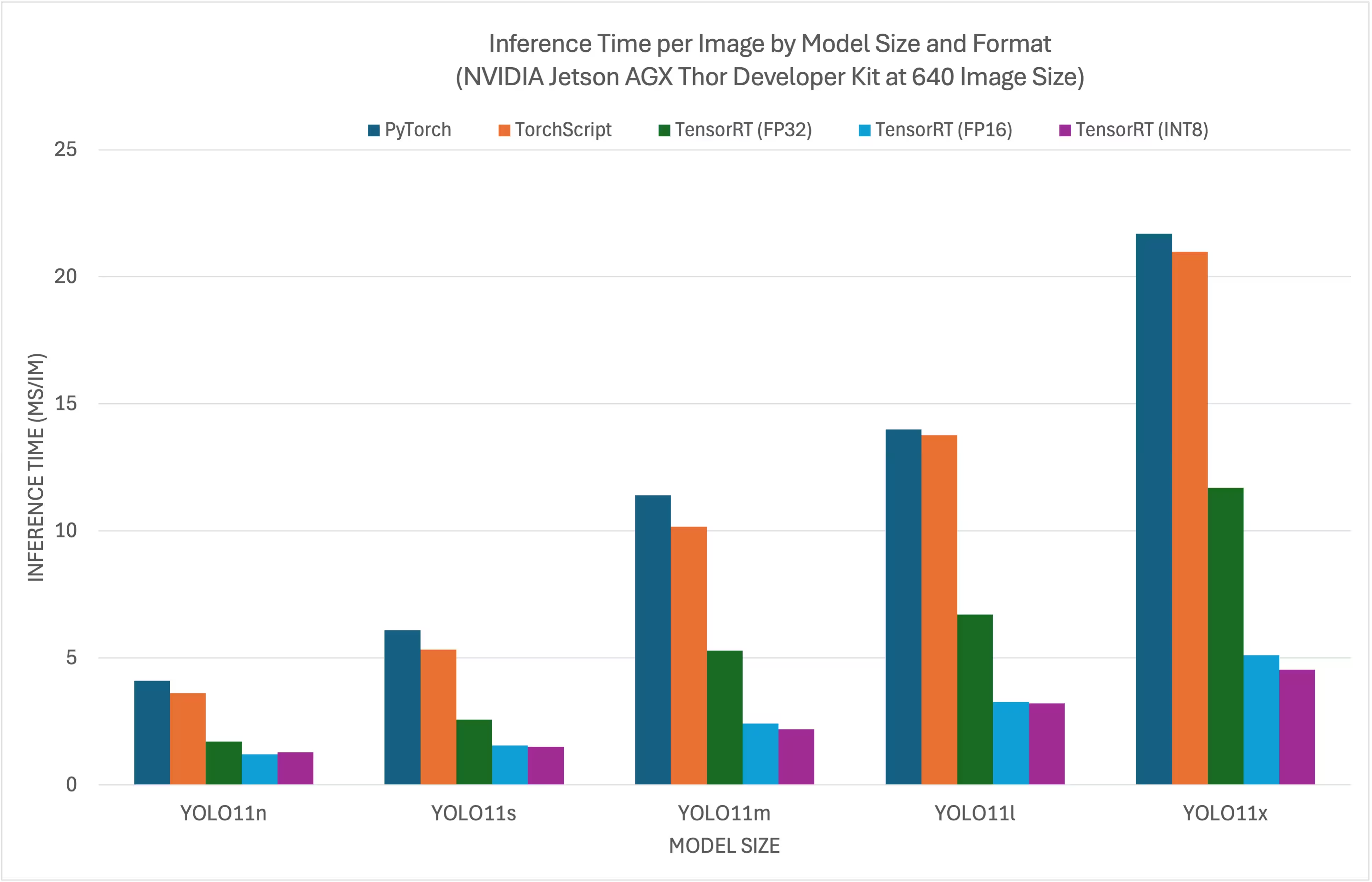

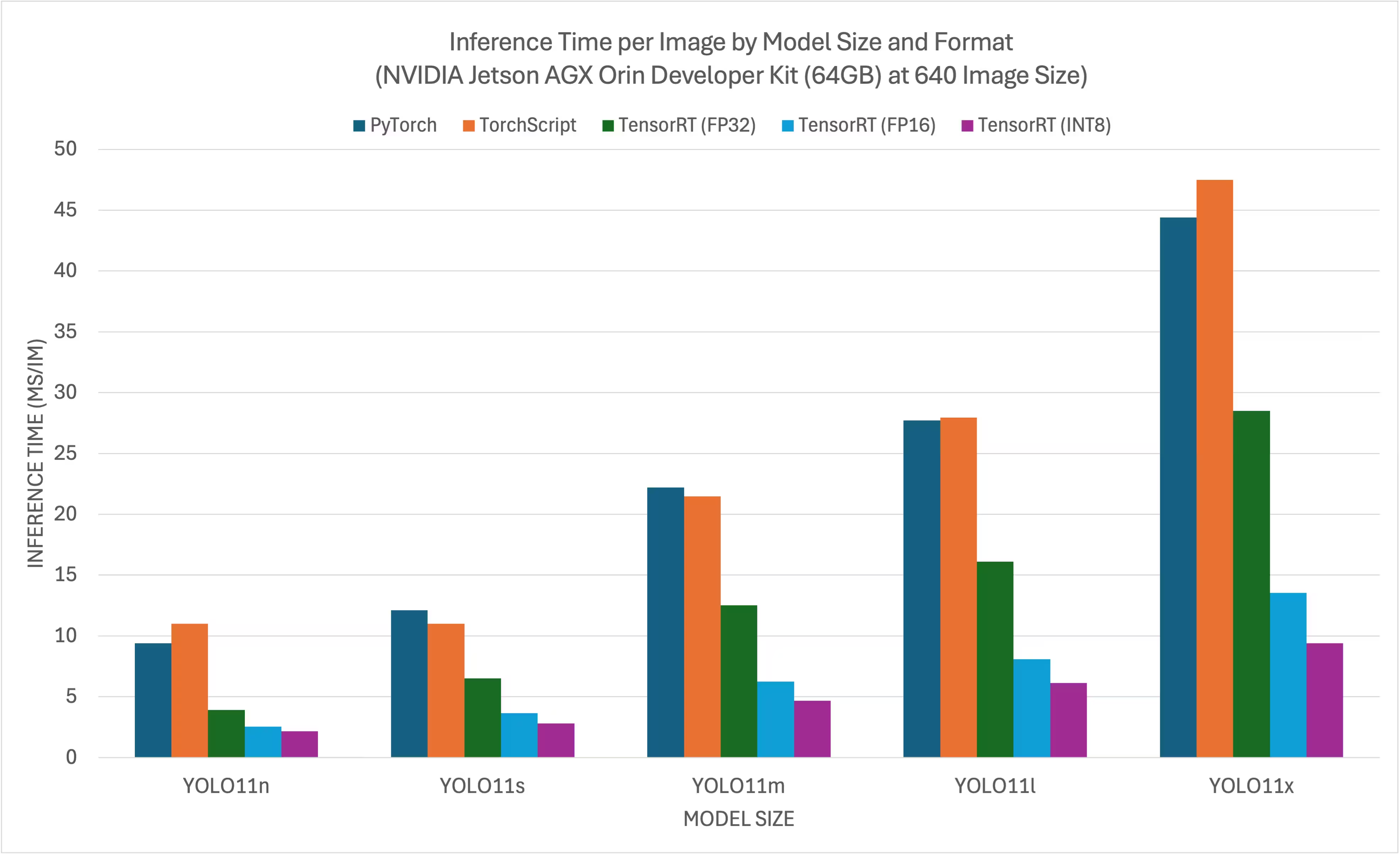

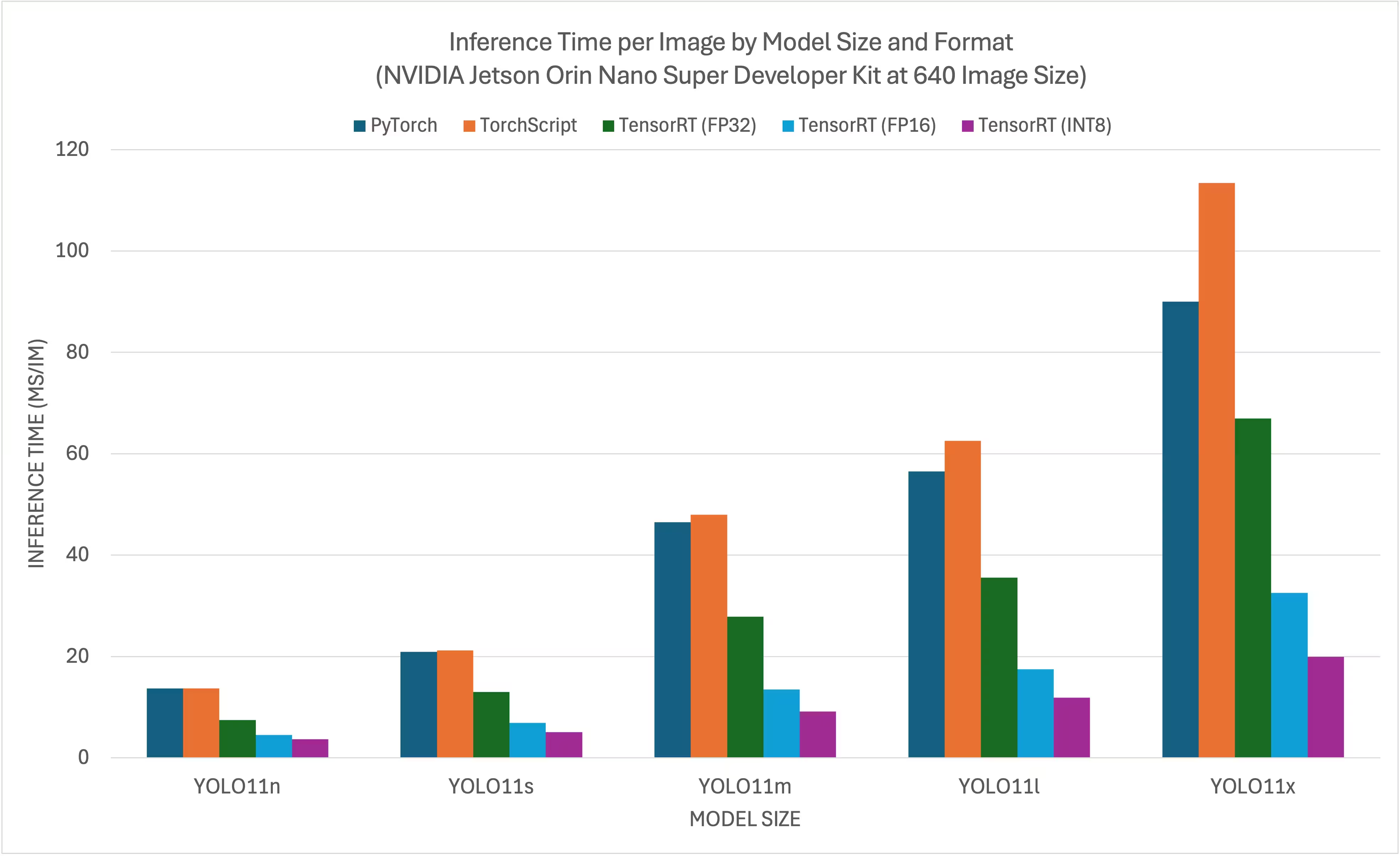

Benchmarks de YOLO11/YOLO26 en NVIDIA Jetson

Los benchmarks de YOLO11/YOLO26 fueron ejecutados por el equipo de Ultralytics en 11 formatos de modelo diferentes, midiendo la velocidad y la precisión: PyTorch, TorchScript, ONNX, OpenVINO, TensorRT, TF SavedModel, TF GraphDef, TF Lite, MNN, NCNN, ExecuTorch. Los benchmarks se ejecutaron en NVIDIA Jetson AGX Thor Developer Kit, NVIDIA Jetson AGX Orin Developer Kit (64GB), NVIDIA Jetson Orin Nano Super Developer Kit y Seeed Studio reComputer J4012 impulsado por un dispositivo Jetson Orin NX de 16GB con precisión FP32 y un tamaño de imagen de entrada predeterminado de 640.

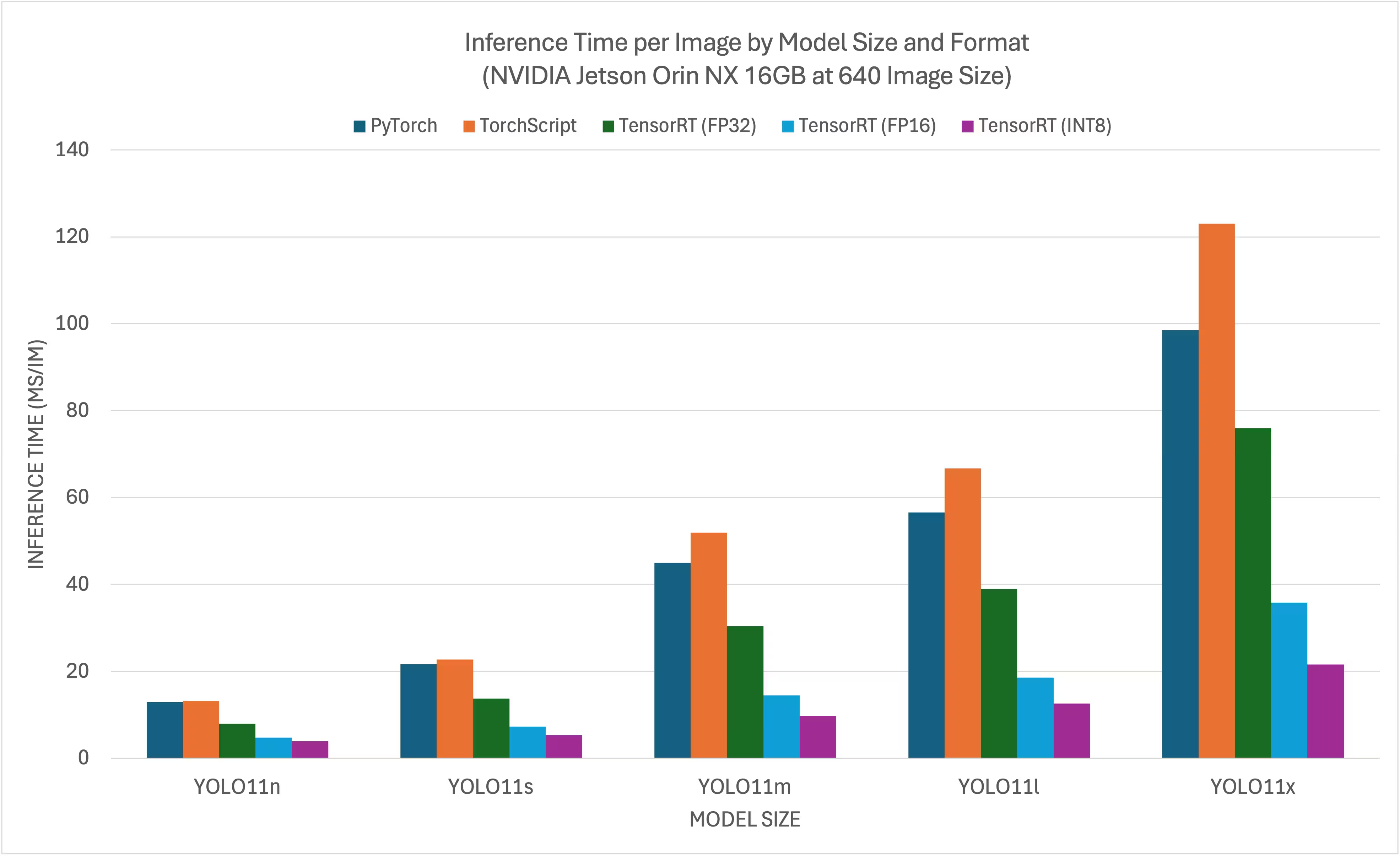

Gráficos comparativos

Aunque todas las exportaciones de modelos funcionan en NVIDIA Jetson, solo hemos incluido PyTorch, TorchScript, TensorRT para la tabla comparativa a continuación porque utilizan la GPU en el Jetson y garantizan los mejores resultados. Todas las demás exportaciones solo utilizan la CPU y el rendimiento no es tan bueno como el de las tres anteriores. Puede encontrar los benchmarks para todas las exportaciones en la sección posterior a esta tabla.

Kit de desarrollo NVIDIA Jetson AGX Thor

NVIDIA Jetson AGX Orin Developer Kit (64GB)

NVIDIA Jetson Orin Nano Super Developer Kit

NVIDIA Jetson Orin NX 16GB

Tablas de comparación detalladas

La siguiente tabla representa los resultados de benchmark para cinco modelos diferentes (YOLO11n, YOLO11s, YOLO11m, YOLO11l, YOLO11x) en 11 formatos diferentes (PyTorch, TorchScript, ONNX, OpenVINO, TensorRT, TF SavedModel, TF GraphDef, TF Lite, MNN, NCNN, ExecuTorch), lo que nos da el estado, el tamaño, la métrica mAP50-95(B) y el tiempo de inferencia para cada combinación.

Kit de desarrollo NVIDIA Jetson AGX Thor

Rendimiento

| Formato | Estado | Tamaño en disco (MB) | mAP50-95(B) | Tiempo de inferencia (ms/im) |

|---|---|---|---|---|

| PyTorch | ✅ | 5.3 | 0.4798 | 7.39 |

| TorchScript | ✅ | 9.8 | 0.4789 | 4.21 |

| ONNX | ✅ | 9.5 | 0.4767 | 6.58 |

| OpenVINO | ✅ | 10.1 | 0.4794 | 17.50 |

| TensorRT (FP32) | ✅ | 13.9 | 0.4791 | 1.90 |

| TensorRT (FP16) | ✅ | 7.6 | 0.4797 | 1.39 |

| TensorRT (INT8) | ✅ | 6.5 | 0.4273 | 1.52 |

| TF SavedModel | ✅ | 25.7 | 0.4764 | 47.24 |

| TF GraphDef | ✅ | 9.5 | 0.4764 | 45.98 |

| TF Lite | ✅ | 9.9 | 0.4764 | 182.04 |

| MNN | ✅ | 9.4 | 0.4784 | 21.83 |

| Formato | Estado | Tamaño en disco (MB) | mAP50-95(B) | Tiempo de inferencia (ms/im) |

|---|---|---|---|---|

| PyTorch | ✅ | 19.5 | 0.5738 | 7.99 |

| TorchScript | ✅ | 36.8 | 0.5664 | 6.01 |

| ONNX | ✅ | 36.5 | 0.5666 | 9.31 |

| OpenVINO | ✅ | 38.5 | 0.5656 | 35.56 |

| TensorRT (FP32) | ✅ | 38.9 | 0.5664 | 2.95 |

| TensorRT (FP16) | ✅ | 21.0 | 0.5650 | 1.77 |

| TensorRT (INT8) | ✅ | 13.5 | 0.5010 | 1.75 |

| TF SavedModel | ✅ | 96.6 | 0.5665 | 88.87 |

| TF GraphDef | ✅ | 36.5 | 0.5665 | 89.20 |

| TF Lite | ✅ | 36.9 | 0.5665 | 604.25 |

| MNN | ✅ | 36.4 | 0.5651 | 53.75 |

| Formato | Estado | Tamaño en disco (MB) | mAP50-95(B) | Tiempo de inferencia (ms/im) |

|---|---|---|---|---|

| PyTorch | ✅ | 42.2 | 0.6237 | 10.76 |

| TorchScript | ✅ | 78.5 | 0.6217 | 10.57 |

| ONNX | ✅ | 78.2 | 0.6211 | 14.91 |

| OpenVINO | ✅ | 82.2 | 0.6204 | 86.27 |

| TensorRT (FP32) | ✅ | 82.2 | 0.6230 | 5.56 |

| TensorRT (FP16) | ✅ | 41.6 | 0.6209 | 2.58 |

| TensorRT (INT8) | ✅ | 24.3 | 0.5595 | 2.49 |

| TF SavedModel | ✅ | 205.8 | 0.6229 | 200.96 |

| TF GraphDef | ✅ | 78.2 | 0.6229 | 203.00 |

| TF Lite | ✅ | 78.6 | 0.6229 | 1867.12 |

| MNN | ✅ | 78.0 | 0.6176 | 142.00 |

| Formato | Estado | Tamaño en disco (MB) | mAP50-95(B) | Tiempo de inferencia (ms/im) |

|---|---|---|---|---|

| PyTorch | ✅ | 50.7 | 0.6258 | 13.34 |

| TorchScript | ✅ | 95.5 | 0.6248 | 13.86 |

| ONNX | ✅ | 95.0 | 0.6247 | 18.44 |

| OpenVINO | ✅ | 99.9 | 0.6238 | 106.67 |

| TensorRT (FP32) | ✅ | 99.0 | 0.6249 | 6.74 |

| TensorRT (FP16) | ✅ | 50.3 | 0.6243 | 3.34 |

| TensorRT (INT8) | ✅ | 29.0 | 0.5708 | 3.24 |

| TF SavedModel | ✅ | 250.0 | 0.6245 | 259.74 |

| TF GraphDef | ✅ | 95.0 | 0.6245 | 263.42 |

| TF Lite | ✅ | 95.4 | 0.6245 | 2367.83 |

| MNN | ✅ | 94.8 | 0.6272 | 174.39 |

| Formato | Estado | Tamaño en disco (MB) | mAP50-95(B) | Tiempo de inferencia (ms/im) |

|---|---|---|---|---|

| PyTorch | ✅ | 113.2 | 0.6565 | 20.92 |

| TorchScript | ✅ | 213.5 | 0.6595 | 21.76 |

| ONNX | ✅ | 212.9 | 0.6590 | 26.72 |

| OpenVINO | ✅ | 223.6 | 0.6620 | 205.27 |

| TensorRT (FP32) | ✅ | 217.2 | 0.6593 | 12.29 |

| TensorRT (FP16) | ✅ | 112.1 | 0.6611 | 5.16 |

| TensorRT (INT8) | ✅ | 58.9 | 0.5222 | 4.72 |

| TF SavedModel | ✅ | 559.2 | 0.6593 | 498.85 |

| TF GraphDef | ✅ | 213.0 | 0.6593 | 507.43 |

| TF Lite | ✅ | 213.3 | 0.6593 | 5134.22 |

| MNN | ✅ | 212.8 | 0.6625 | 347.84 |

Evaluado con Ultralytics 8.4.7

Nota

El tiempo de inferencia no incluye el pre/post-procesamiento.

NVIDIA Jetson AGX Orin Developer Kit (64GB)

Rendimiento

| Formato | Estado | Tamaño en disco (MB) | mAP50-95(B) | Tiempo de inferencia (ms/im) |

|---|---|---|---|---|

| PyTorch | ✅ | 5.3 | 0.4790 | 11.58 |

| TorchScript | ✅ | 9.8 | 0.4770 | 4.60 |

| ONNX | ✅ | 9.5 | 0.4770 | 9.87 |

| OpenVINO | ✅ | 9.6 | 0.4820 | 28.80 |

| TensorRT (FP32) | ✅ | 11.5 | 0.0450 | 4.18 |

| TensorRT (FP16) | ✅ | 7.9 | 0.0450 | 2.62 |

| TensorRT (INT8) | ✅ | 5.4 | 0.4640 | 2.30 |

| TF SavedModel | ✅ | 24.6 | 0.4760 | 71.10 |

| TF GraphDef | ✅ | 9.5 | 0.4760 | 70.02 |

| TF Lite | ✅ | 9.9 | 0.4760 | 227.94 |

| MNN | ✅ | 9.4 | 0.4760 | 32.46 |

| NCNN | ✅ | 9.3 | 0.4810 | 29.93 |

| Formato | Estado | Tamaño en disco (MB) | mAP50-95(B) | Tiempo de inferencia (ms/im) |

|---|---|---|---|---|

| PyTorch | ✅ | 20.0 | 0.5730 | 13.18 |

| TorchScript | ✅ | 36.8 | 0.5670 | 11.48 |

| ONNX | ✅ | 36.5 | 0.5660 | 13.47 |

| OpenVINO | ✅ | 36.7 | 0.5650 | 58.30 |

| TensorRT (FP32) | ✅ | 38.5 | 0.5660 | 6.82 |

| TensorRT (FP16) | ✅ | 21.9 | 0.5660 | 3.76 |

| TensorRT (INT8) | ✅ | 12.5 | 0.5480 | 2.98 |

| TF SavedModel | ✅ | 92.2 | 0.5660 | 145.62 |

| TF GraphDef | ✅ | 36.5 | 0.5660 | 146.26 |

| TF Lite | ✅ | 36.9 | 0.5660 | 753.52 |

| MNN | ✅ | 36.4 | 0.5650 | 79.50 |

| NCNN | ✅ | 36.4 | 0.5700 | 58.73 |

| Formato | Estado | Tamaño en disco (MB) | mAP50-95(B) | Tiempo de inferencia (ms/im) |

|---|---|---|---|---|

| PyTorch | ✅ | 43.0 | 0.6220 | 19.36 |

| TorchScript | ✅ | 78.5 | 0.6230 | 20.02 |

| ONNX | ✅ | 78.2 | 0.6230 | 25.40 |

| OpenVINO | ✅ | 78.3 | 0.6190 | 130.76 |

| TensorRT (FP32) | ✅ | 80.2 | 0.6220 | 12.60 |

| TensorRT (FP16) | ✅ | 42.5 | 0.6220 | 6.24 |

| TensorRT (INT8) | ✅ | 23.4 | 0.5820 | 4.72 |

| TF SavedModel | ✅ | 196.3 | 0.6230 | 306.76 |

| TF GraphDef | ✅ | 78.2 | 0.6230 | 314.23 |

| TF Lite | ✅ | 78.5 | 0.6230 | 2331.63 |

| MNN | ✅ | 78.0 | 0.6220 | 206.93 |

| NCNN | ✅ | 78.0 | 0.6220 | 143.03 |

| Formato | Estado | Tamaño en disco (MB) | mAP50-95(B) | Tiempo de inferencia (ms/im) |

|---|---|---|---|---|

| PyTorch | ✅ | 51.0 | 0.6230 | 23.53 |

| TorchScript | ✅ | 95.5 | 0.6250 | 24.23 |

| ONNX | ✅ | 95.0 | 0.6250 | 31.73 |

| OpenVINO | ✅ | 95.3 | 0.6240 | 162.80 |

| TensorRT (FP32) | ✅ | 97.3 | 0.6250 | 15.90 |

| TensorRT (FP16) | ✅ | 51.4 | 0.6240 | 7.93 |

| TensorRT (INT8) | ✅ | 29.9 | 0.5920 | 5.97 |

| TF SavedModel | ✅ | 238.4 | 0.6250 | 394.30 |

| TF GraphDef | ✅ | 95.0 | 0.6250 | 398.63 |

| TF Lite | ✅ | 95.4 | 0.6250 | 2925.27 |

| MNN | ✅ | 94.8 | 0.6250 | 255.87 |

| NCNN | ✅ | 94.8 | 0.6320 | 177.70 |

| Formato | Estado | Tamaño en disco (MB) | mAP50-95(B) | Tiempo de inferencia (ms/im) |

|---|---|---|---|---|

| PyTorch | ✅ | 114 | 0.6610 | 38.37 |

| TorchScript | ✅ | 213.5 | 0.6590 | 41.23 |

| ONNX | ✅ | 212.9 | 0.6590 | 52.03 |

| OpenVINO | ✅ | 213.2 | 0.6590 | 300.40 |

| TensorRT (FP32) | ✅ | 215.2 | 0.6590 | 28.43 |

| TensorRT (FP16) | ✅ | 110.3 | 0.6570 | 13.50 |

| TensorRT (INT8) | ✅ | 59.9 | 0.6080 | 9.33 |

| TF SavedModel | ✅ | 533.3 | 0.6590 | 738.60 |

| TF GraphDef | ✅ | 212.9 | 0.6590 | 785.70 |

| TF Lite | ✅ | 217.6 | 0.6900 | 6476.80 |

| MNN | ✅ | 213.3 | 0.6590 | 519.77 |

| NCNN | ✅ | 212.8 | 0.6670 | 300.00 |

Comparado con Ultralytics .4.32

Nota

El tiempo de inferencia no incluye el pre/post-procesamiento.

NVIDIA Jetson Orin Nano Super Developer Kit

Rendimiento

| Formato | Estado | Tamaño en disco (MB) | mAP50-95(B) | Tiempo de inferencia (ms/im) |

|---|---|---|---|---|

| PyTorch | ✅ | 5.3 | 0.4790 | 15.60 |

| TorchScript | ✅ | 9.8 | 0.4770 | 12.60 |

| ONNX | ✅ | 9.5 | 0.4760 | 15.76 |

| OpenVINO | ✅ | 9.6 | 0.4820 | 56.23 |

| TensorRT (FP32) | ✅ | 11.3 | 0.4770 | 7.53 |

| TensorRT (FP16) | ✅ | 8.1 | 0.4800 | 4.57 |

| TensorRT (INT8) | ✅ | 5.3 | 0.4490 | 3.80 |

| TF SavedModel | ✅ | 24.6 | 0.4760 | 118.33 |

| TF GraphDef | ✅ | 9.5 | 0.4760 | 116.30 |

| TF Lite | ✅ | 9.9 | 0.4760 | 286.00 |

| MNN | ✅ | 9.4 | 0.4760 | 68.77 |

| NCNN | ✅ | 9.3 | 0.4810 | 47.50 |

| Formato | Estado | Tamaño en disco (MB) | mAP50-95(B) | Tiempo de inferencia (ms/im) |

|---|---|---|---|---|

| PyTorch | ✅ | 20.0 | 0.5730 | 22.83 |

| TorchScript | ✅ | 36.8 | 0.5670 | 21.83 |

| ONNX | ✅ | 36.5 | 0.5664 | 26.29 |

| OpenVINO | ✅ | 36.7 | 0.5653 | 127.09 |

| TensorRT (FP32) | ✅ | 38.2 | 0.5664 | 13.60 |

| TensorRT (FP16) | ✅ | 21.3 | 0.5649 | 7.17 |

| TensorRT (INT8) | ✅ | 12.7 | 0.5468 | 5.25 |

| TF SavedModel | ✅ | 92.2 | 0.5665 | 263.69 |

| TF GraphDef | ✅ | 36.5 | 0.5665 | 268.21 |

| TF Lite | ✅ | 36.9 | 0.5665 | 949.63 |

| MNN | ✅ | 36.4 | 0.5644 | 184.68 |

| NCNN | ✅ | 36.4 | 0.5697 | 107.48 |

| Formato | Estado | Tamaño en disco (MB) | mAP50-95(B) | Tiempo de inferencia (ms/im) |

|---|---|---|---|---|

| PyTorch | ✅ | 43.0 | 0.6220 | 44.43 |

| TorchScript | ✅ | 78.5 | 0.6230 | 44.00 |

| ONNX | ✅ | 78.2 | 0.6225 | 53.44 |

| OpenVINO | ✅ | 78.3 | 0.6186 | 303.26 |

| TensorRT (FP32) | ✅ | 80.0 | 0.6217 | 28.19 |

| TensorRT (FP16) | ✅ | 42.6 | 0.6225 | 13.59 |

| TensorRT (INT8) | ✅ | 23.4 | 0.5817 | 9.30 |

| TF SavedModel | ✅ | 196.3 | 0.6229 | 636.03 |

| TF GraphDef | ✅ | 78.2 | 0.6229 | 659.57 |

| TF Lite | ✅ | 78.5 | 0.6229 | 2905.17 |

| MNN | ✅ | 78.0 | 0.6168 | 500.09 |

| NCNN | ✅ | 78.0 | 0.6224 | 332.39 |

| Formato | Estado | Tamaño en disco (MB) | mAP50-95(B) | Tiempo de inferencia (ms/im) |

|---|---|---|---|---|

| PyTorch | ✅ | 51.0 | 0.6230 | 60.97 |

| TorchScript | ✅ | 95.5 | 0.6250 | 56.20 |

| ONNX | ✅ | 95.0 | 0.6247 | 68.12 |

| OpenVINO | ✅ | 95.3 | 0.6238 | 397.84 |

| TensorRT (FP32) | ✅ | 97.1 | 0.6250 | 35.88 |

| TensorRT (FP16) | ✅ | 51.4 | 0.6225 | 17.42 |

| TensorRT (INT8) | ✅ | 30.0 | 0.5923 | 11.83 |

| TF SavedModel | ✅ | 238.4 | 0.6245 | 835.83 |

| TF GraphDef | ✅ | 95.0 | 0.6245 | 852.16 |

| TF Lite | ✅ | 95.4 | 0.6245 | 3650.85 |

| MNN | ✅ | 94.8 | 0.6257 | 612.37 |

| NCNN | ✅ | 94.8 | 0.6323 | 405.45 |

| Formato | Estado | Tamaño en disco (MB) | mAP50-95(B) | Tiempo de inferencia (ms/im) |

|---|---|---|---|---|

| PyTorch | ✅ | 113.2 | 0.6561 | 98.44 |

| TorchScript | ✅ | 214.0 | 0.6593 | 98.0 |

| ONNX | ✅ | 212.9 | 0.6595 | 122.43 |

| OpenVINO | ✅ | 213.2 | 0.6592 | 760.72 |

| TensorRT (FP32) | ✅ | 215.1 | 0.6593 | 67.17 |

| TensorRT (FP16) | ✅ | 110.2 | 0.6637 | 32.60 |

| TensorRT (INT8) | ✅ | 59.9 | 0.6170 | 19.99 |

| TF SavedModel | ✅ | 533.3 | 0.6593 | 1647.06 |

| TF GraphDef | ✅ | 212.9 | 0.6593 | 1670.30 |

| TF Lite | ✅ | 213.3 | 0.6590 | 8066.30 |

| MNN | ✅ | 212.8 | 0.6600 | 1227.90 |

| NCNN | ✅ | 212.8 | 0.6666 | 782.24 |

Comparado con Ultralytics .4.33

Nota

El tiempo de inferencia no incluye el pre/post-procesamiento.

NVIDIA Jetson Orin NX 16GB

Rendimiento

| Formato | Estado | Tamaño en disco (MB) | mAP50-95(B) | Tiempo de inferencia (ms/im) |

|---|---|---|---|---|

| PyTorch | ✅ | 5.3 | 0.4799 | 13.90 |

| TorchScript | ✅ | 9.8 | 0.4787 | 11.60 |

| ONNX | ✅ | 9.5 | 0.4763 | 14.18 |

| OpenVINO | ✅ | 9.6 | 0.4819 | 40.19 |

| TensorRT (FP32) | ✅ | 11.4 | 0.4770 | 7.01 |

| TensorRT (FP16) | ✅ | 8.0 | 0.4789 | 4.13 |

| TensorRT (INT8) | ✅ | 5.5 | 0.4489 | 3.49 |

| TF SavedModel | ✅ | 24.6 | 0.4764 | 92.34 |

| TF GraphDef | ✅ | 9.5 | 0.4764 | 92.06 |

| TF Lite | ✅ | 9.9 | 0.4764 | 254.43 |

| MNN | ✅ | 9.4 | 0.4760 | 48.55 |

| NCNN | ✅ | 9.3 | 0.4805 | 34.31 |

| Formato | Estado | Tamaño en disco (MB) | mAP50-95(B) | Tiempo de inferencia (ms/im) |

|---|---|---|---|---|

| PyTorch | ✅ | 19.5 | 0.5738 | 20.40 |

| TorchScript | ✅ | 36.8 | 0.5664 | 19.20 |

| ONNX | ✅ | 36.5 | 0.5664 | 24.35 |

| OpenVINO | ✅ | 36.7 | 0.5653 | 88.18 |

| TensorRT (FP32) | ✅ | 38.5 | 0.5664 | 12.62 |

| TensorRT (FP16) | ✅ | 21.5 | 0.5652 | 6.41 |

| TensorRT (INT8) | ✅ | 12.6 | 0.5468 | 4.78 |

| TF SavedModel | ✅ | 92.2 | 0.5665 | 195.16 |

| TF GraphDef | ✅ | 36.5 | 0.5665 | 197.57 |

| TF Lite | ✅ | 36.9 | 0.5665 | 827.48 |

| MNN | ✅ | 36.4 | 0.5649 | 123.47 |

| NCNN | ✅ | 36.4 | 0.5697 | 74.04 |

| Formato | Estado | Tamaño en disco (MB) | mAP50-95(B) | Tiempo de inferencia (ms/im) |

|---|---|---|---|---|

| PyTorch | ✅ | 42.2 | 0.6237 | 38.60 |

| TorchScript | ✅ | 78.5 | 0.6227 | 40.50 |

| ONNX | ✅ | 78.2 | 0.6225 | 48.87 |

| OpenVINO | ✅ | 78.3 | 0.6186 | 205.69 |

| TensorRT (FP32) | ✅ | 80.1 | 0.6217 | 24.69 |

| TensorRT (FP16) | ✅ | 42.6 | 0.6225 | 11.66 |

| TensorRT (INT8) | ✅ | 23.4 | 0.5817 | 8.22 |

| TF SavedModel | ✅ | 196.3 | 0.6229 | 451.48 |

| TF GraphDef | ✅ | 78.2 | 0.6229 | 460.94 |

| TF Lite | ✅ | 78.5 | 0.6229 | 2555.53 |

| MNN | ✅ | 78.0 | 0.6217 | 333.33 |

| NCNN | ✅ | 78.0 | 0.6224 | 214.60 |

| Formato | Estado | Tamaño en disco (MB) | mAP50-95(B) | Tiempo de inferencia (ms/im) |

|---|---|---|---|---|

| PyTorch | ✅ | 50.7 | 0.6258 | 48.60 |

| TorchScript | ✅ | 95.5 | 0.6249 | 51.60 |

| ONNX | ✅ | 95.0 | 0.6247 | 61.95 |

| OpenVINO | ✅ | 95.3 | 0.6238 | 272.47 |

| TensorRT (FP32) | ✅ | 97.1 | 0.6250 | 31.64 |

| TensorRT (FP16) | ✅ | 51.4 | 0.6225 | 14.77 |

| TensorRT (INT8) | ✅ | 30.0 | 0.5923 | 10.49 |

| TF SavedModel | ✅ | 238.4 | 0.6245 | 596.46 |

| TF GraphDef | ✅ | 95.0 | 0.6245 | 606.10 |

| TF Lite | ✅ | 95.4 | 0.6245 | 3275.55 |

| MNN | ✅ | 94.8 | 0.6247 | 408.15 |

| NCNN | ✅ | 94.8 | 0.6323 | 262.99 |

| Formato | Estado | Tamaño en disco (MB) | mAP50-95(B) | Tiempo de inferencia (ms/im) |

|---|---|---|---|---|

| PyTorch | ✅ | 113.2 | 0.6561 | 84.40 |

| TorchScript | ✅ | 213.5 | 0.6594 | 91.20 |

| ONNX | ✅ | 212.9 | 0.6595 | 109.34 |

| OpenVINO | ✅ | 213.2 | 0.6592 | 520.88 |

| TensorRT (FP32) | ✅ | 215.1 | 0.6593 | 57.18 |

| TensorRT (FP16) | ✅ | 109.7 | 0.6632 | 26.76 |

| TensorRT (INT8) | ✅ | 60.0 | 0.6170 | 17.32 |

| TF SavedModel | ✅ | 533.3 | 0.6593 | 1170.50 |

| TF GraphDef | ✅ | 212.9 | 0.6593 | 1217.87 |

| TF Lite | ✅ | 213.3 | 0.6593 | 7247.11 |

| MNN | ✅ | 212.8 | 0.6591 | 820.90 |

| NCNN | ✅ | 212.8 | 0.6666 | 534.30 |

Comparado con Ultralytics .4.33

Nota

El tiempo de inferencia no incluye el pre/post-procesamiento.

Explore más pruebas de rendimiento de Seeed Studio que se ejecutan en diferentes versiones de hardware NVIDIA Jetson.

Reproducir nuestros resultados

Para reproducir los benchmarks de Ultralytics anteriores en todos los formatos de exportación, ejecute este código:

Ejemplo

from ultralytics import YOLO

# Load a YOLO11n PyTorch model

model = YOLO("yolo11n.pt")

# Benchmark YOLO11n speed and accuracy on the COCO128 dataset for all export formats

results = model.benchmark(data="coco128.yaml", imgsz=640)

# Benchmark YOLO11n speed and accuracy on the COCO128 dataset for all export formats

yolo benchmark model=yolo11n.pt data=coco128.yaml imgsz=640

Tenga en cuenta que los resultados de los benchmarks pueden variar según la configuración exacta de hardware y software de un sistema, así como la carga de trabajo actual del sistema en el momento en que se ejecutan los benchmarks. Para obtener los resultados más fiables, utilice un conjunto de datos con un gran número de imágenes, p. ej., data='coco.yaml' (5000 imágenes de validación).

Mejores prácticas al usar NVIDIA Jetson

Al utilizar NVIDIA Jetson, existen algunas mejores prácticas a seguir para habilitar el máximo rendimiento en el NVIDIA Jetson que ejecuta YOLO26.

Habilitar el modo de máxima potencia (MAX Power Mode)

Habilitar el modo de máxima potencia en Jetson asegurará que todos los núcleos de la CPU y la GPU estén activados.

sudo nvpmodel -m 0Habilitar los relojes de Jetson (Jetson Clocks)

Habilitar los relojes de Jetson asegurará que todos los núcleos de la CPU y la GPU estén sincronizados a su frecuencia máxima.

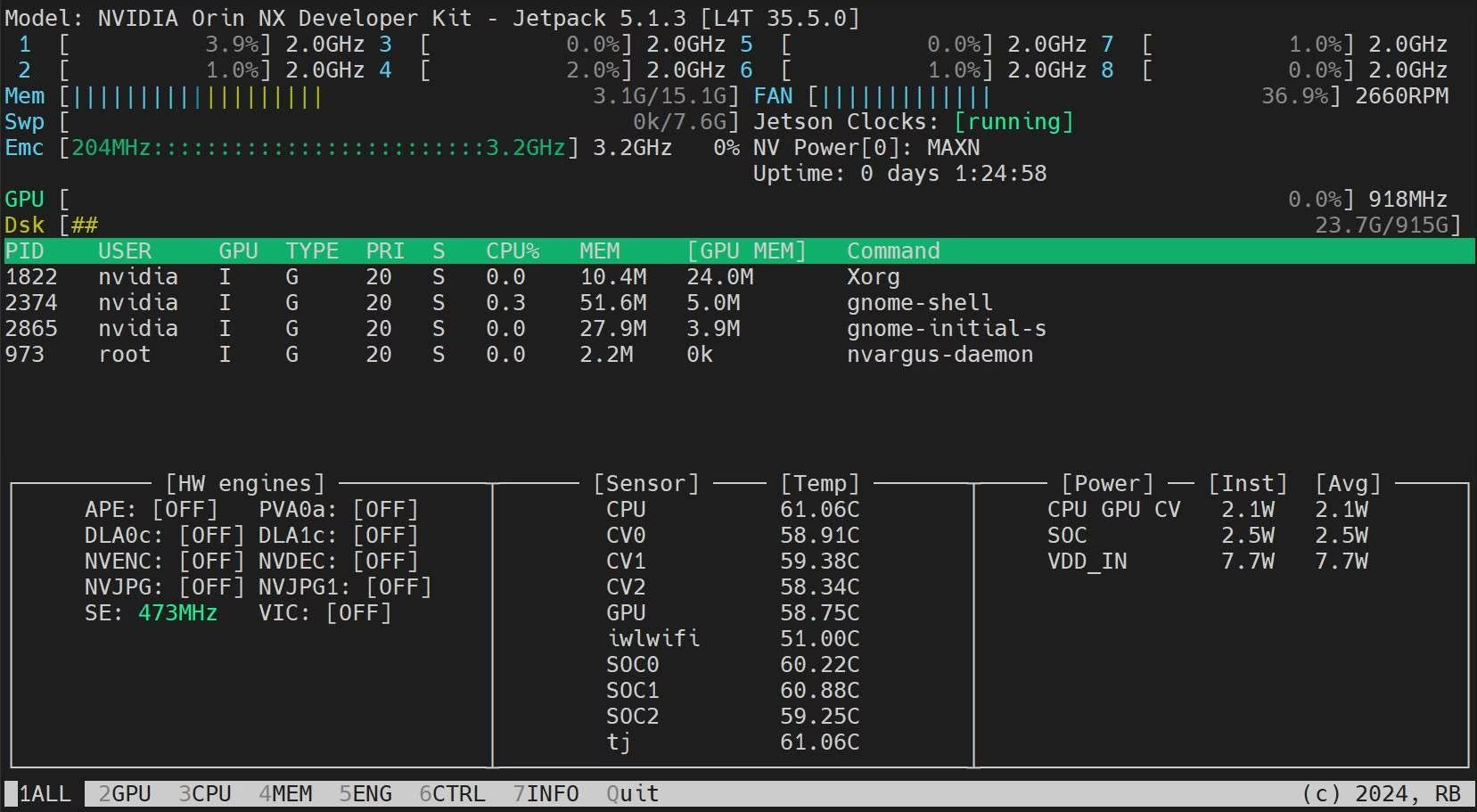

sudo jetson_clocksInstalar la aplicación Jetson Stats

Podemos utilizar la aplicación Jetson Stats para supervisar las temperaturas de los componentes del sistema y comprobar otros detalles del sistema, como ver la utilización de la CPU, la GPU y la RAM, cambiar los modos de energía, establecer los relojes máximos y comprobar la información de JetPack.

sudo apt update sudo pip install jetson-stats sudo reboot jtop

Consejos para optimizar la memoria en NVIDIA

La memoria disponible suele ser el factor limitante en los dispositivos Jetson, especialmente en las variantes con menos memoria, como el Jetson Orin Nano (8 GB) o el Orin NX de 8 GB. Los consejos que se ofrecen a continuación son modificaciones prácticas y de bajo riesgo que, en conjunto, pueden liberar varios cientos de megabytes y permitirte ejecutar YOLO más grandes o gestionar cargas de trabajo paralelas adicionales. Para obtener información más detallada, consulta el NVIDIA sobre cómo maximizar la eficiencia de la memoria en Jetson.

1. Cambiar al arranque sin interfaz gráfica (sin GUI)

Si tu Jetson está conectado a través de SSH o funciona como un dispositivo de producción sin una pantalla conectada, al eliminar el entorno de escritorio y el servidor de pantalla puedes recuperar hasta 865 MB de RAM:

sudo systemctl set-default multi-user.target

sudo reboot

Para restaurar el escritorio más tarde:

sudo systemctl set-default graphical.target

sudo reboot

2. Desactivar los servicios del sistema que no se utilicen

Los servicios en segundo plano no esenciales (Bluetooth, gestores de conectividad, demonios de hardware en desuso) consumen en total unos 32 MB. Haz una lista de los servicios activos y desactiva todos aquellos que no sean necesarios para tu implementación:

# List running services

systemctl list-units --type=service --state=running

# Disable a service

sudo systemctl disable <service-name>

3. Uso de la memoria del perfil

Antes de optimizar, identifica qué procesos están consumiendo realmente memoria RAM. procrank ordena los procesos según el PSS (tamaño proporcional del conjunto), que refleja el consumo real de memoria por proceso con mayor precisión que el RSS (tamaño del conjunto residente, es decir, el total de páginas de RAM física asignadas a un proceso, incluidas las páginas compartidas con otros procesos):

git clone https://github.com/csimmonds/procrank_linux.git

cd procrank_linux && make

sudo ./procrank

Para ver las asignaciones GPU NvMap (CUDA/canalCUDA) por proceso:

sudo cat /sys/kernel/debug/nvmap/iovmm/clients

4. Ejecutar la inferencia sin pantalla en el entorno de producción

En el caso de los flujos de inferencia que no requieren vista previa en tiempo real, desactivar los componentes relacionados con la visualización (Tiler, OSD, DisplaySink) puede suponer un ahorro de más de 200 MB solo en el flujo. Con Ultralytics YOLO, desactive el visor y guarde los resultados en el disco:

Ejemplo

from ultralytics import YOLO

model = YOLO("yolo11n.engine")

# show=False prevents any display window; save=True writes annotated output to disk

results = model.predict(source="video.mp4", show=False, save=True)

yolo predict model=yolo11n.engine source=video.mp4 show=False save=True

Impacto acumulativo

| Optimización | Aprox. de memoria ahorrada |

|---|---|

| Desactivar la interfaz gráfica de usuario del escritorio | ~865 MB |

| Desactivar los servicios del sistema operativo que no se utilicen | ~32 MB |

| Proceso de inferencia sin interfaz gráfica (sin pantalla) | ~más de 200 MB |

| Total (victorias fáciles) | ~1 GB o más |

Combinar estos cambios resulta especialmente útil cuando se utilizan modelos TensorRT en dispositivos con memoria limitada, ya que puede marcar la diferencia entre poder almacenar una variante del modelo más grande en la memoria o no.

Próximos pasos

Para obtener más información y soporte, consulte la documentación de Ultralytics YOLO26.

Preguntas frecuentes

¿Cómo despliego Ultralytics YOLO26 en dispositivos NVIDIA Jetson?

Desplegar Ultralytics YOLO26 en dispositivos NVIDIA Jetson es un proceso sencillo. Primero, flashee su dispositivo Jetson con el SDK de NVIDIA JetPack. Luego, utilice una imagen Docker precompilada para una configuración rápida o instale manualmente los paquetes requeridos. Los pasos detallados para cada enfoque se pueden encontrar en las secciones Inicio rápido con Docker e Inicio con instalación nativa.

¿Qué benchmarks de rendimiento puedo esperar de los modelos YOLO11 en dispositivos NVIDIA Jetson?

Los modelos YOLO11 se han comparado en varios dispositivos NVIDIA Jetson, mostrando mejoras significativas en el rendimiento. Por ejemplo, el formato TensorRT ofrece el mejor rendimiento de inferencia. La tabla en la sección Tablas de comparación detalladas proporciona una visión completa de las métricas de rendimiento como mAP50-95 y el tiempo de inferencia en diferentes formatos de modelo.

¿Por qué debería usar TensorRT para desplegar YOLO26 en NVIDIA Jetson?

Se recomienda encarecidamente TensorRT para desplegar modelos YOLO26 en NVIDIA Jetson debido a su rendimiento óptimo. Acelera la inferencia aprovechando las capacidades de la GPU del Jetson, asegurando la máxima eficiencia y velocidad. Obtenga más información sobre cómo convertir a TensorRT y ejecutar inferencia en la sección Uso de TensorRT en NVIDIA Jetson.

¿Cómo puedo instalar PyTorch y Torchvision en NVIDIA Jetson?

Para instalar PyTorch y Torchvision en NVIDIA Jetson, primero desinstale cualquier versión existente que pueda haber sido instalada a través de pip. A continuación, instale manualmente las versiones compatibles de PyTorch y Torchvision para la arquitectura ARM64 de Jetson. En la sección Instalar PyTorch y Torchvision se proporcionan instrucciones detalladas para este proceso.

¿Cuáles son las mejores prácticas para maximizar el rendimiento en NVIDIA Jetson al usar YOLO26?

Para maximizar el rendimiento en NVIDIA Jetson con YOLO26, siga estas mejores prácticas:

- Habilite el modo de máxima potencia para utilizar todos los núcleos de la CPU y la GPU.

- Habilite los relojes de Jetson para ejecutar todos los núcleos a su frecuencia máxima.

- Instale la aplicación Jetson Stats para supervisar las métricas del sistema.

Para obtener comandos y detalles adicionales, consulte la sección Prácticas recomendadas al utilizar NVIDIA Jetson.

¿Cómo puedo liberar memoria en NVIDIA para ejecutar YOLO más grandes?

La memoria RAM disponible suele ser el cuello de botella en los dispositivos Jetson con poca memoria. Tres medidas sencillas que, en conjunto, pueden liberar más de 1 GB:

- Cambiar al arranque sin interfaz gráfica (

sudo systemctl set-default multi-user.target) para eliminar la interfaz gráfica de usuario del escritorio (ahorro de unos 865 MB). - Desactiva los servicios que no utilices, como el Bluetooth o los gestores de conectividad (ahorro de unos 32 MB).

- Ejecutar la inferencia sin pantalla configurando

show=Falseen tu YOLOpredictllamada, lo que evita asignar memoria del canal de visualización (se ahorran unos 200 MB).

Utilice procrank para analizar el uso de la memoria RAM por proceso y sudo cat /sys/kernel/debug/nvmap/iovmm/clients para comprobar GPU . Consulte el Consejos para optimizar la memoria Consulte la sección para obtener más información.

¿Por qué la exportación de TensorRT desactiva la función «end2end» en JetPack 6?

TensorRT .3.0, incluido en JetPack 6, presenta un problema conocido que impide la compilación del motor INT8 cuando end2end=True está habilitada. Cuando Ultralytics esta combinación, deshabilita automáticamente la rama end2end para garantizar que la exportación se realice correctamente.

Para restablecer las exportaciones INT8 de extremo a extremo, actualiza TensorRT una versión más reciente (por ejemplo, 10.7.0 o superior):

wget https://developer.download.nvidia.com/compute/cuda/repos/ubuntu2204/arm64/cuda-keyring_1.1-1_all.deb

sudo dpkg -i cuda-keyring_1.1-1_all.deb

sudo apt-get update

sudo apt-get install -y tensorrt

Después de actualizar, vuelve a ejecutar la exportación. Para obtener más información, consulta el problema n.º 23841 de GitHub.