Modelos Compatibles con Ultralytics

¡Bienvenido a la documentación del modelo de Ultralytics! Ofrecemos soporte para una amplia gama de modelos, cada uno de ellos adaptado a tareas específicas como detección de objetos, segmentación de instancias, clasificación de imágenes, estimación de poses y seguimiento de múltiples objetos. Si está interesado en contribuir con su arquitectura de modelo a Ultralytics, consulte nuestra Guía de contribución.

Modelos destacados

Estos son algunos de los modelos clave admitidos:

- YOLOv3: La tercera iteración de la familia de modelos YOLO, originalmente de Joseph Redmon, conocida por sus eficientes capacidades de detección de objetos en tiempo real.

- YOLOv4: Una actualización nativa de darknet a YOLOv3, lanzada por Alexey Bochkovskiy en 2020.

- YOLOv5: Una versión mejorada de la arquitectura YOLO de Ultralytics, que ofrece mejores compensaciones de rendimiento y velocidad en comparación con las versiones anteriores.

- YOLOv6: Lanzado por Meituan en 2022, y en uso en muchos de los robots de reparto autónomos de la compañía.

- YOLOv7: Modelos YOLO actualizados lanzados en 2022 por los autores de YOLOv4. Solo se admite la inferencia.

- YOLOv8: Un modelo versátil que presenta capacidades mejoradas como la segmentación de instancias, la estimación de pose/puntos clave y la clasificación.

- YOLOv9: Un modelo experimental entrenado en la base de código Ultralytics YOLOv5 que implementa información de gradiente programable (PGI).

- YOLOv10: Desarrollado por la Universidad de Tsinghua, con entrenamiento sin NMS y una arquitectura impulsada por la eficiencia y la precisión, que ofrece un rendimiento y una latencia de última generación.

- YOLO11: Modelos YOLO de Ultralytics que ofrecen alto rendimiento en múltiples tareas, incluyendo detection, segmentation, estimación de pose, tracking y clasificación.

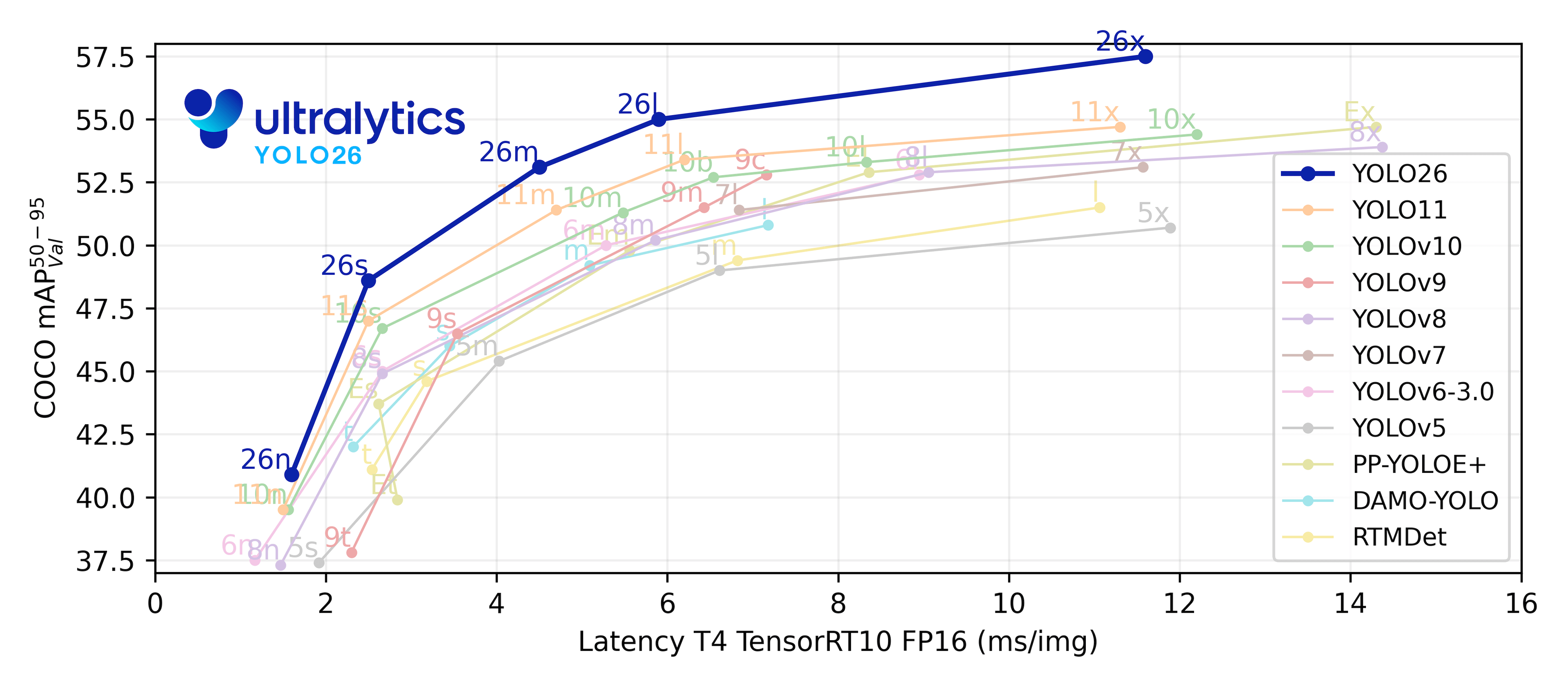

- YOLO26 🚀 NUEVO: El último modelo YOLO de próxima generación de Ultralytics optimizado para despliegue en el borde con inferencia de extremo a extremo sin NMS.

- Segment Anything Model (SAM): El modelo Segment Anything original de Meta (SAM).

- Segment Anything Model 2 (SAM2): La próxima generación del Segment Anything Model de Meta para vídeos e imágenes.

- Segment Anything Model 3 (SAM3) 🚀 NUEVO: El Modelo Segment Anything de tercera generación de Meta con Segmentación de Conceptos Promptable para segmentación basada en ejemplares de texto e imagen.

- Mobile Segment Anything Model (MobileSAM): MobileSAM para aplicaciones móviles, por la Universidad de Kyung Hee.

- Fast Segment Anything Model (FastSAM): FastSAM por Image & Video Analysis Group, Institute of Automation, Academia China de Ciencias.

- YOLO-NAS: Modelos YOLO Neural Architecture Search (NAS).

- Transformadores de detección en tiempo real (RT-DETR): Modelos Transformer de Detection en tiempo real (RT-DETR) de PaddlePaddle de Baidu.

- YOLO-World: Modelos de detección de objetos de vocabulario abierto en tiempo real de Tencent AI Lab.

- YOLOE: Un detector de objetos de vocabulario abierto mejorado que mantiene el rendimiento en tiempo real de YOLO mientras detecta clases arbitrarias más allá de sus datos de entrenamiento.

Ver: Ejecute modelos Ultralytics YOLO con tan solo unas pocas líneas de código.

Primeros pasos: Ejemplos de uso

Este ejemplo proporciona ejemplos sencillos de entrenamiento e inferencia de YOLO. Para obtener documentación completa sobre estos y otros modos, consulte las páginas de documentación de Predict, Train, Val y Export.

Tenga en cuenta que el siguiente ejemplo destaca los modelos Detect de YOLO11 para la detección de objetos. Para tareas adicionales admitidas, consulte los documentos de Segment, Classify y Pose.

Ejemplo

PyTorch preentrenados *.pt modelos, así como la configuración *.yaml los archivos se pueden pasar a la YOLO(), SAM(), NAS() y RTDETR() clases para crear una instancia de modelo en python:

from ultralytics import YOLO

# Load a COCO-pretrained YOLO26n model

model = YOLO("yolo26n.pt")

# Display model information (optional)

model.info()

# Train the model on the COCO8 example dataset for 100 epochs

results = model.train(data="coco8.yaml", epochs=100, imgsz=640)

# Run inference with the YOLO26n model on the 'bus.jpg' image

results = model("path/to/bus.jpg")

Hay comandos de la CLI disponibles para ejecutar directamente los modelos:

# Load a COCO-pretrained YOLO26n model and train it on the COCO8 example dataset for 100 epochs

yolo train model=yolo26n.pt data=coco8.yaml epochs=100 imgsz=640

# Load a COCO-pretrained YOLO26n model and run inference on the 'bus.jpg' image

yolo predict model=yolo26n.pt source=path/to/bus.jpg

Contribución de nuevos modelos

¿Está interesado en contribuir con su modelo a Ultralytics? ¡Excelente! Siempre estamos abiertos a ampliar nuestra cartera de modelos.

Bifurque el repositorio: Comience bifurcando el repositorio de Ultralytics en GitHub.

Clone su bifurcación: Clone su bifurcación en su máquina local y cree una nueva rama para trabajar.

Implemente su modelo: Agregue su modelo siguiendo los estándares y pautas de codificación proporcionados en nuestra Guía de contribución.

Pruebe a fondo: Asegúrese de probar su modelo rigurosamente, tanto de forma aislada como parte de la canalización.

Cree una solicitud de extracción: Una vez que esté satisfecho con su modelo, cree una solicitud de extracción al repositorio principal para su revisión.

Revisión de código y fusión: Después de la revisión, si su modelo cumple con nuestros criterios, se fusionará en el repositorio principal.

Para obtener pasos detallados, consulte nuestra Guía de contribución.

Preguntas frecuentes

¿Cuál es el último modelo Ultralytics YOLO?

El último modelo Ultralytics YOLO es YOLO26, lanzado en enero de 2026. YOLO26 presenta inferencia de extremo a extremo sin NMS, despliegue en el borde optimizado y soporta las cinco tareas (detection, segmentation, clasificación, estimación de pose y OBB) además de versiones de vocabulario abierto. Para cargas de trabajo de producción estables, tanto YOLO26 como YOLO11 son opciones recomendadas.

¿Cómo puedo entrenar un modelo YOLO con datos personalizados?

Entrenar un modelo YOLO en datos personalizados se puede lograr fácilmente utilizando las bibliotecas de Ultralytics. Aquí tienes un ejemplo rápido:

Ejemplo

from ultralytics import YOLO

# Load a YOLO model

model = YOLO("yolo26n.pt") # or any other YOLO model

# Train the model on custom dataset

results = model.train(data="custom_data.yaml", epochs=100, imgsz=640)

yolo train model=yolo26n.pt data='custom_data.yaml' epochs=100 imgsz=640

Para obtener instrucciones más detalladas, visite la página de documentación de Train.

¿Qué versiones de YOLO son compatibles con Ultralytics?

Ultralytics admite una amplia gama de versiones de YOLO (You Only Look Once) desde YOLOv3 hasta YOLO11, junto con modelos como YOLO-NAS, SAM y RT-DETR. Cada versión está optimizada para diversas tareas, como la detección, la segmentación y la clasificación. Para obtener información detallada sobre cada modelo, consulta la documentación de Modelos compatibles con Ultralytics.

¿Por qué debería usar Ultralytics Platform para proyectos de aprendizaje automático?

Ultralytics Platform proporciona una plataforma sin código y de extremo a extremo para el entrenamiento, despliegue y gestión de modelos YOLO. Simplifica los flujos de trabajo complejos, permitiendo a los usuarios centrarse en el rendimiento y la aplicación del modelo. El HUB también ofrece capacidades de entrenamiento en la nube, gestión integral de conjuntos de datos e interfaces fáciles de usar tanto para principiantes como para desarrolladores experimentados.

¿Qué tipos de tareas pueden realizar los modelos Ultralytics YOLO?

Los modelos Ultralytics YOLO son versátiles y pueden realizar tareas que incluyen detection de objetos, segmentation de instancias, clasificación, estimación de pose y detection de objetos orientados (OBB). El último modelo, YOLO26, soporta las cinco tareas además de detection de vocabulario abierto. Para obtener detalles sobre tareas específicas, consulte las páginas de Tareas.