Apprendre à exporter un modèle YOLO26 au format TFLite Edge TPU

Le déploiement de modèles de vision par ordinateur sur des appareils dotés d'une puissance de calcul limitée, tels que les systèmes mobiles ou embarqués, peut être délicat. L'utilisation d'un format de modèle optimisé pour des performances plus rapides simplifie le processus. Le format de modèle TensorFlow LiteEdge TPU ou TFLite Edge TPU est conçu pour utiliser une puissance minimale tout en offrant des performances rapides pour les réseaux neuronaux.

La fonctionnalité d'exportation au format TFLite Edge TPU vous permet d'optimiser vos modèles Ultralytics YOLO26 pour une inférence haute vitesse et basse consommation. Dans ce guide, nous vous accompagnerons dans la conversion de vos modèles au format TFLite Edge TPU, facilitant ainsi les bonnes performances de vos modèles sur divers appareils mobiles et embarqués.

Pourquoi devriez-vous exporter vers TFLite Edge TPU ?

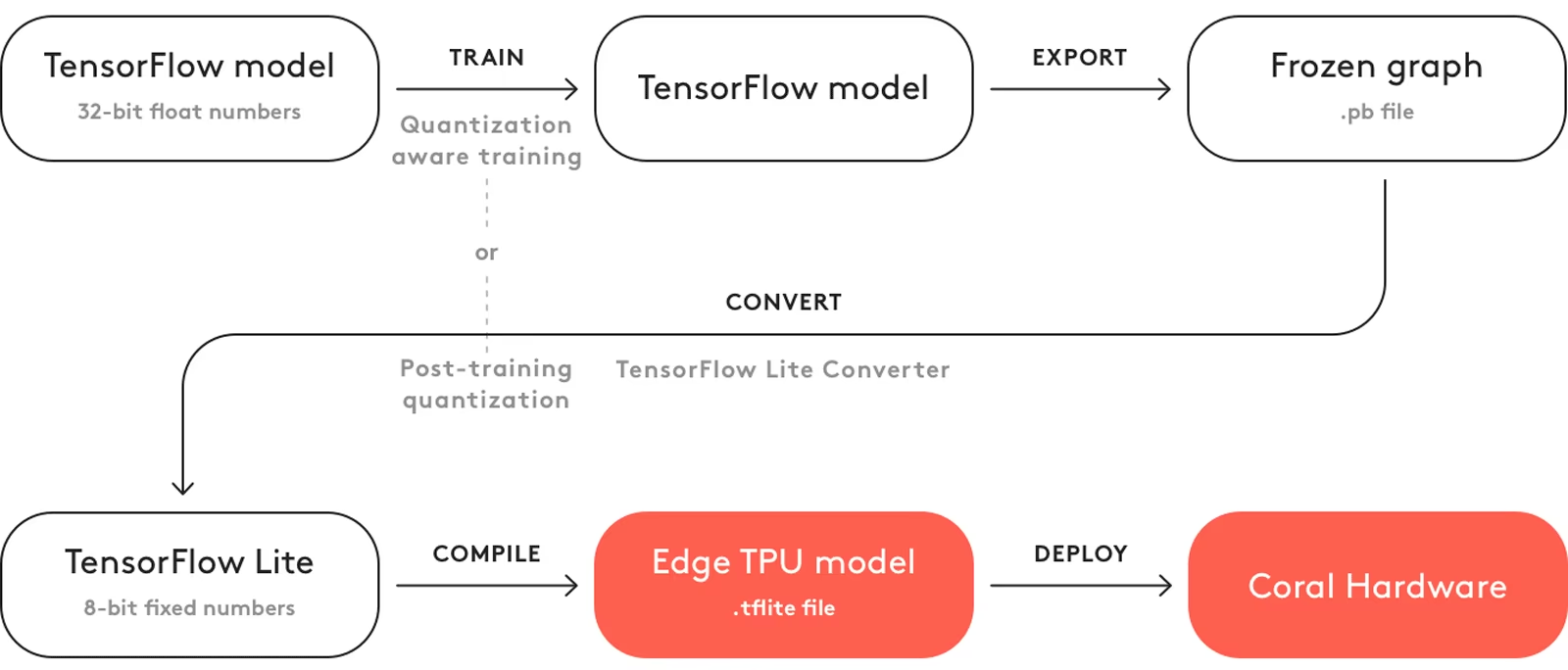

L'exportation de modèles vers TensorFlow Edge TPU rend les tâches d'apprentissage automatique rapides et efficaces. Cette technologie convient aux applications avec une puissance, des ressources informatiques et une connectivité limitées. L'Edge TPU est un accélérateur matériel de Google. Il accélère les modèles TensorFlow Lite sur les appareils périphériques. L'image ci-dessous montre un exemple du processus impliqué.

L'Edge TPU fonctionne avec des modèles quantifiés. La quantification rend les modèles plus petits et plus rapides sans perdre beaucoup de précision. Elle est idéale pour les ressources limitées de l'informatique de pointe, permettant aux applications de répondre rapidement en réduisant la latence et en permettant un traitement rapide des données localement, sans dépendance au cloud. Le traitement local préserve également la confidentialité et la sécurité des données des utilisateurs, car elles ne sont pas envoyées à un serveur distant.

Principales caractéristiques de TFLite Edge TPU

Voici les principales caractéristiques qui font de TFLite Edge TPU un excellent choix de format de modèle pour les développeurs :

Performances optimisées sur les appareils Edge : Le TFLite Edge TPU atteint des performances de réseau neuronal à haute vitesse grâce à la quantification, à l’optimisation du modèle, à l’accélération matérielle et à l’optimisation du compilateur. Son architecture minimaliste contribue à sa plus petite taille et à sa rentabilité.

Débit de calcul élevé : TFLite Edge TPU combine une accélération matérielle spécialisée et une exécution d’exécution efficace pour atteindre un débit de calcul élevé. Il est bien adapté au déploiement de modèles d’apprentissage automatique avec des exigences de performance rigoureuses sur les appareils périphériques.

Calculs matriciels efficaces : Le TensorFlow Edge TPU est optimisé pour les opérations matricielles, qui sont cruciales pour les calculs de réseaux neuronaux. Cette efficacité est essentielle dans les modèles d'apprentissage automatique, en particulier ceux qui nécessitent de nombreuses multiplications et transformations matricielles complexes.

Options de déploiement avec TFLite Edge TPU

Avant de nous plonger dans l'exportation des modèles YOLO26 au format TFLite Edge TPU, comprenons où les modèles TFLite Edge TPU sont généralement utilisés.

TFLite Edge TPU offre diverses options de déploiement pour les modèles d'apprentissage automatique, notamment :

Déploiement sur l’appareil : Les modèles TensorFlow Edge TPU peuvent être directement déployés sur des appareils mobiles et embarqués. Le déploiement sur l’appareil permet aux modèles de s’exécuter directement sur le matériel, éliminant ainsi le besoin de connectivité au cloud, soit en intégrant le modèle dans le bundle de l’application, soit en le téléchargeant à la demande.

Edge Computing avec les TPU TensorFlow Cloud : Dans les scénarios où les appareils périphériques ont des capacités de traitement limitées, les TPU TensorFlow Edge peuvent décharger les tâches d'inférence vers des serveurs cloud équipés de TPU.

Déploiement Hybride : Une approche hybride combine le déploiement sur l'appareil et dans le cloud et offre une solution polyvalente et évolutive pour le déploiement de modèles d'apprentissage automatique. Les avantages incluent le traitement sur l'appareil pour des réponses rapides et l'informatique en nuage pour des calculs plus complexes.

Exportation de modèles YOLO26 vers TFLite Edge TPU

Vous pouvez étendre la compatibilité des modèles et la flexibilité de déploiement en convertissant les modèles YOLO26 vers TensorFlow Edge TPU.

Installation

Pour installer le paquet requis, exécutez :

Installation

# Install the required package for YOLO26

pip install ultralytics

Pour des instructions détaillées et les meilleures pratiques liées au processus d'installation, consultez notre guide d'installation d'Ultralytics. Si vous rencontrez des difficultés lors de l'installation des paquets requis pour YOLO26, consultez notre guide des problèmes courants pour des solutions et des conseils.

Utilisation

Tous les modèles Ultralytics YOLO26 sont conçus pour prendre en charge l'exportation nativement, facilitant ainsi leur intégration dans votre flux de travail de déploiement préféré. Vous pouvez consulter la liste complète des formats d'exportation pris en charge et des options de configuration pour choisir la meilleure configuration pour votre application.

Utilisation

from ultralytics import YOLO

# Load the YOLO26 model

model = YOLO("yolo26n.pt")

# Export the model to TFLite Edge TPU format

model.export(format="edgetpu") # creates 'yolo26n_full_integer_quant_edgetpu.tflite'

# Load the exported TFLite Edge TPU model

edgetpu_model = YOLO("yolo26n_full_integer_quant_edgetpu.tflite")

# Run inference

results = edgetpu_model("https://ultralytics.com/images/bus.jpg")

# Export a YOLO26n PyTorch model to TFLite Edge TPU format

yolo export model=yolo26n.pt format=edgetpu # creates 'yolo26n_full_integer_quant_edgetpu.tflite'

# Run inference with the exported model

yolo predict model=yolo26n_full_integer_quant_edgetpu.tflite source='https://ultralytics.com/images/bus.jpg'

Arguments d'exportation

| Argument | Type | Par défaut | Description |

|---|---|---|---|

format | str | 'edgetpu' | Format cible pour le modèle exporté, définissant la compatibilité avec divers environnements de déploiement. |

imgsz | int ou tuple | 640 | Taille d'image souhaitée pour l'entrée du modèle. Peut être un entier pour les images carrées ou un tuple (height, width) pour des dimensions spécifiques. |

device | str | None | Spécifie le dispositif pour l'exportation : CPU (device=cpu). |

Astuce

Veuillez vous assurer d’utiliser une machine x86 Linux lors de l’exportation vers EdgeTPU.

Pour plus de détails sur le processus d'exportation, consultez la page de la documentation Ultralytics sur l'exportation.

Déploiement de modèles YOLO26 TFLite Edge TPU exportés

Après avoir exporté avec succès vos modèles Ultralytics YOLO26 au format TFLite Edge TPU, vous pouvez maintenant les déployer. La première étape principale et recommandée pour exécuter un modèle TFLite Edge TPU est d'utiliser la méthode YOLO("model_edgetpu.tflite"), comme décrit dans l'extrait de code d'utilisation précédent.

Cependant, pour obtenir des instructions détaillées sur le déploiement de vos modèles TFLite Edge TPU, consultez les ressources suivantes:

Coral Edge TPU sur un Raspberry Pi avec Ultralytics YOLO26: Découvrez comment intégrer les Coral Edge TPU avec un Raspberry Pi pour des capacités d'apprentissage automatique améliorées.

Exemples de code : Accédez à des exemples pratiques de déploiement de TensorFlow Edge TPU pour démarrer vos projets.

Exécuter l'inférence sur Edge TPU avec python : Découvrez comment utiliser l'API python TensorFlow Lite pour les applications Edge TPU, y compris les instructions de configuration et d'utilisation.

Résumé

Dans ce guide, nous avons appris à exporter les modèles Ultralytics YOLO26 au format TFLite Edge TPU. En suivant les étapes mentionnées ci-dessus, vous pouvez augmenter la vitesse et la puissance de vos applications de vision par ordinateur.

Pour plus de détails sur l'utilisation, consultez le site web officiel d'Edge TPU.

De plus, pour plus d'informations sur les autres intégrations Ultralytics YOLO26, veuillez consulter notre page de guide d'intégration. Vous y découvrirez des ressources et des informations précieuses.

FAQ

Comment exporter un modèle YOLO26 au format TFLite Edge TPU ?

Pour exporter un modèle YOLO26 au format TFLite Edge TPU, vous pouvez suivre ces étapes :

Utilisation

from ultralytics import YOLO

# Load the YOLO26 model

model = YOLO("yolo26n.pt")

# Export the model to TFLite Edge TPU format

model.export(format="edgetpu") # creates 'yolo26n_full_integer_quant_edgetpu.tflite'

# Load the exported TFLite Edge TPU model

edgetpu_model = YOLO("yolo26n_full_integer_quant_edgetpu.tflite")

# Run inference

results = edgetpu_model("https://ultralytics.com/images/bus.jpg")

# Export a YOLO26n PyTorch model to TFLite Edge TPU format

yolo export model=yolo26n.pt format=edgetpu # creates 'yolo26n_full_integer_quant_edgetpu.tflite'

# Run inference with the exported model

yolo predict model=yolo26n_full_integer_quant_edgetpu.tflite source='https://ultralytics.com/images/bus.jpg'

Pour des informations complètes sur l'exportation de modèles vers d'autres formats, consultez notre guide d'exportation.

Quels sont les avantages d'exporter des modèles YOLO26 vers TFLite Edge TPU ?

L'exportation de modèles YOLO26 vers TFLite Edge TPU offre plusieurs avantages :

- Performances optimisées : Obtenez des performances de réseau neuronal à haute vitesse avec une consommation d'énergie minimale.

- Latence réduite : Traitement rapide des données locales sans dépendre du cloud.

- Confidentialité améliorée : Le traitement local maintient les données des utilisateurs privées et sécurisées.

Cela le rend idéal pour les applications en edge computing, où les appareils ont une puissance et des ressources de calcul limitées. Apprenez-en davantage sur pourquoi vous devriez exporter.

Puis-je déployer des modèles TFLite Edge TPU sur des appareils mobiles et embarqués ?

Oui, les modèles TensorFlow Lite Edge TPU peuvent être déployés directement sur des appareils mobiles et embarqués. Cette approche de déploiement permet aux modèles de s'exécuter directement sur le matériel, offrant une inférence plus rapide et plus efficace. Pour des exemples d'intégration, consultez notre guide sur le déploiement de Coral Edge TPU sur Raspberry Pi.

Quels sont quelques cas d'utilisation courants pour les modèles TFLite Edge TPU ?

Les cas d'utilisation courants des modèles TFLite Edge TPU sont les suivants :

- Caméras intelligentes : Amélioration de l’analyse d’images et de vidéos en temps réel.

- Appareils IoT : Activation de la domotique et de l'automatisation industrielle.

- Santé : Accélère l'imagerie médicale et les diagnostics.

- Vente au détail : Amélioration de la gestion des stocks et de l'analyse du comportement des clients.

Ces applications bénéficient des hautes performances et de la faible consommation d'énergie des modèles TFLite Edge TPU. Découvrez-en davantage sur les scénarios d'utilisation.

Comment puis-je résoudre les problèmes lors de l'exportation ou du déploiement de modèles TFLite Edge TPU ?

Si vous rencontrez des problèmes lors de l'exportation ou du déploiement de modèles TFLite Edge TPU, consultez notre guide des problèmes courants pour obtenir des conseils de dépannage. Ce guide couvre les problèmes courants et les solutions pour vous aider à assurer un fonctionnement fluide. Pour une assistance supplémentaire, visitez notre centre d'aide.