Link to this sectionDataset COCO128#

Link to this sectionIntroduzione#

Ultralytics COCO128 è un dataset di object detection piccolo ma versatile, composto dalle prime 128 immagini del set COCO train 2017. Questo dataset è ideale per testare e sottoporre a debug modelli di object detection, o per sperimentare con nuovi approcci di rilevamento. Con 128 immagini, è abbastanza piccolo da essere facilmente gestibile, ma abbastanza vario da testare le pipeline di addestramento in cerca di errori e fungere da controllo di integrità prima di addestrare dataset più grandi.

Watch: Ultralytics COCO Dataset Overview

Questo dataset è inteso per l'uso con Ultralytics Platform e YOLO26.

Link to this sectionYAML del dataset#

Un file YAML (Yet Another Markup Language) viene utilizzato per definire la configurazione del dataset. Contiene informazioni sui percorsi del dataset, le classi e altre informazioni rilevanti. Nel caso del dataset COCO128, il file coco128.yaml è mantenuto su https://github.com/ultralytics/ultralytics/blob/main/ultralytics/cfg/datasets/coco128.yaml.

# Ultralytics 🚀 AGPL-3.0 License - https://ultralytics.com/license

# COCO128 dataset https://www.kaggle.com/datasets/ultralytics/coco128 (first 128 images from COCO train2017) by Ultralytics

# Documentation: https://docs.ultralytics.com/datasets/detect/coco/

# Example usage: yolo train data=coco128.yaml

# parent

# ├── ultralytics

# └── datasets

# └── coco128 ← downloads here (7 MB)

# Train/val/test sets as 1) dir: path/to/imgs, 2) file: path/to/imgs.txt, or 3) list: [path/to/imgs1, path/to/imgs2, ..]

path: coco128 # dataset root dir

train: images/train2017 # train images (relative to 'path') 128 images

val: images/train2017 # val images (relative to 'path') 128 images

test: # test images (optional)

# Classes

names:

0: person

1: bicycle

2: car

3: motorcycle

4: airplane

5: bus

6: train

7: truck

8: boat

9: traffic light

10: fire hydrant

11: stop sign

12: parking meter

13: bench

14: bird

15: cat

16: dog

17: horse

18: sheep

19: cow

20: elephant

21: bear

22: zebra

23: giraffe

24: backpack

25: umbrella

26: handbag

27: tie

28: suitcase

29: frisbee

30: skis

31: snowboard

32: sports ball

33: kite

34: baseball bat

35: baseball glove

36: skateboard

37: surfboard

38: tennis racket

39: bottle

40: wine glass

41: cup

42: fork

43: knife

44: spoon

45: bowl

46: banana

47: apple

48: sandwich

49: orange

50: broccoli

51: carrot

52: hot dog

53: pizza

54: donut

55: cake

56: chair

57: couch

58: potted plant

59: bed

60: dining table

61: toilet

62: tv

63: laptop

64: mouse

65: remote

66: keyboard

67: cell phone

68: microwave

69: oven

70: toaster

71: sink

72: refrigerator

73: book

74: clock

75: vase

76: scissors

77: teddy bear

78: hair drier

79: toothbrush

# Download script/URL (optional)

download: https://github.com/ultralytics/assets/releases/download/v0.0.0/coco128.zipLink to this sectionUtilizzo#

Per addestrare un modello YOLO26n sul dataset COCO128 per 100 epoch con una dimensione dell'immagine di 640, puoi utilizzare i seguenti frammenti di codice. Per un elenco completo degli argomenti disponibili, fai riferimento alla pagina di Training del modello.

from ultralytics import YOLO

# Load a model

model = YOLO("yolo26n.pt") # load a pretrained model (recommended for training)

# Train the model

results = model.train(data="coco128.yaml", epochs=100, imgsz=640)Link to this sectionImmagini campione e annotazioni#

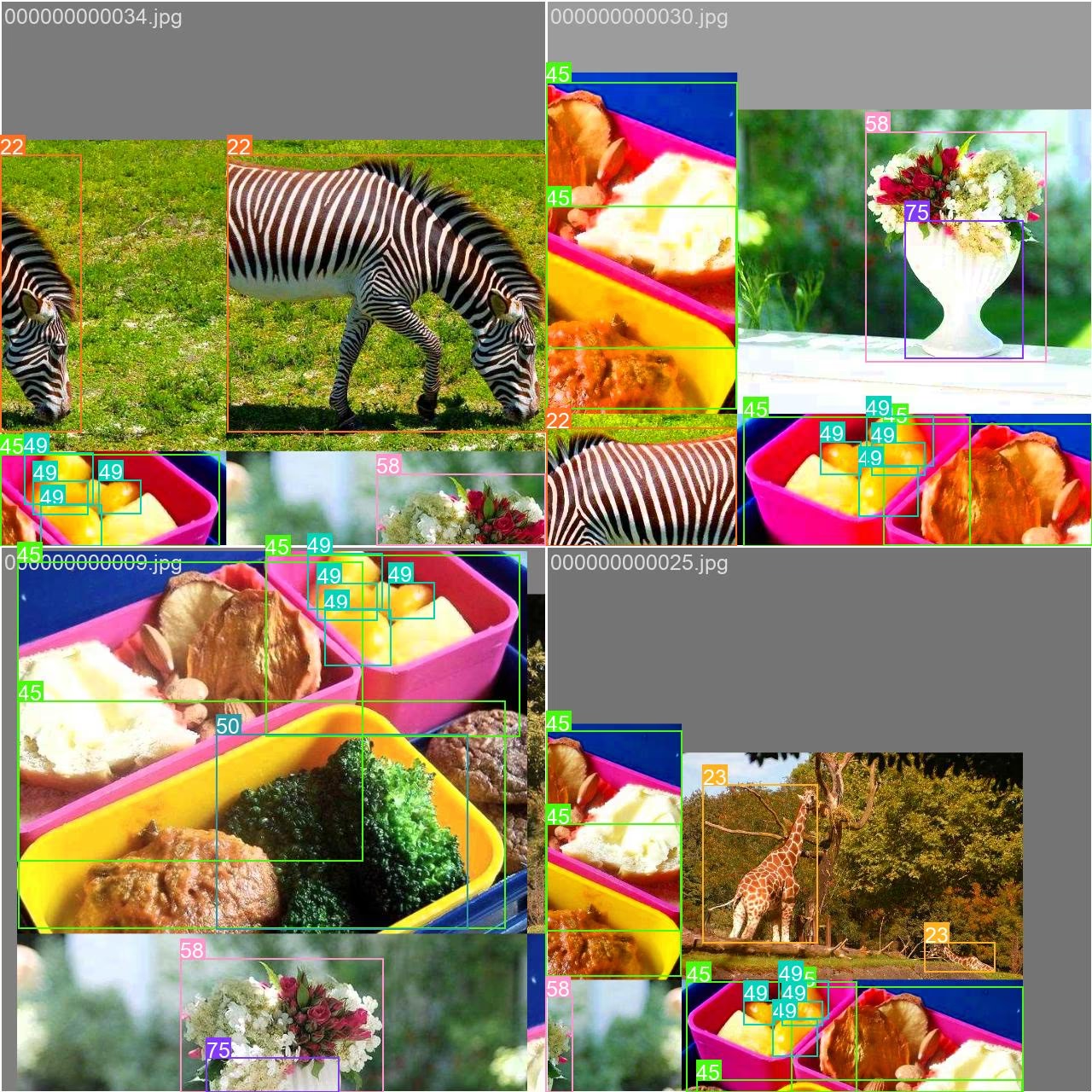

Ecco alcuni esempi di immagini dal dataset COCO128, insieme alle relative annotazioni:

- Immagine a mosaico: Questa immagine mostra un batch di addestramento composto da immagini del dataset a mosaico. Il mosaico è una tecnica utilizzata durante l'addestramento che combina più immagini in un'unica immagine per aumentare la varietà di oggetti e scene all'interno di ogni batch di addestramento. Ciò aiuta a migliorare la capacità del modello di generalizzare a diverse dimensioni, proporzioni e contesti degli oggetti.

L'esempio mostra la varietà e la complessità delle immagini nel dataset COCO128 e i vantaggi dell'utilizzo del mosaico durante il processo di addestramento.

Link to this sectionCitazioni e ringraziamenti#

Se utilizzi il dataset COCO nel tuo lavoro di ricerca o sviluppo, cita il seguente articolo:

@misc{lin2015microsoft,

title={Microsoft COCO: Common Objects in Context},

author={Tsung-Yi Lin and Michael Maire and Serge Belongie and Lubomir Bourdev and Ross Girshick and James Hays and Pietro Perona and Deva Ramanan and C. Lawrence Zitnick and Piotr Dollár},

year={2015},

eprint={1405.0312},

archivePrefix={arXiv},

primaryClass={cs.CV}

}Vorremmo ringraziare il COCO Consortium per aver creato e mantenuto questa preziosa risorsa per la comunità di computer vision. Per maggiori informazioni sul dataset COCO e i suoi creatori, visita il sito web del dataset COCO.

Link to this sectionFAQ#

Link to this sectionA cosa serve il dataset Ultralytics COCO128?#

Il dataset Ultralytics COCO128 è un subset compatto che contiene le prime 128 immagini del dataset COCO train 2017. Viene utilizzato principalmente per testare e sottoporre a debug modelli di object detection, sperimentare con nuovi approcci di rilevamento e validare le pipeline di addestramento prima di passare a dataset più grandi. Le sue dimensioni gestibili lo rendono perfetto per iterazioni rapide, pur offrendo abbastanza diversità da rappresentare un caso di test significativo.

Link to this sectionCome posso addestrare un modello YOLO26 utilizzando il dataset COCO128?#

Per addestrare un modello YOLO26 sul dataset COCO128, puoi utilizzare comandi Python o CLI. Ecco come fare:

from ultralytics import YOLO

# Load a pretrained model

model = YOLO("yolo26n.pt")

# Train the model

results = model.train(data="coco128.yaml", epochs=100, imgsz=640)Per ulteriori opzioni e parametri di addestramento, fai riferimento alla documentazione di Training.

Link to this sectionQuali sono i vantaggi dell'utilizzo dell'augmentation a mosaico con COCO128?#

L'augmentation a mosaico, come mostrato nelle immagini campione, combina più immagini di addestramento in un'unica immagine composita. Questa tecnica offre diversi vantaggi durante l'addestramento con COCO128:

- Aumenta la varietà di oggetti e contesti all'interno di ogni batch di addestramento

- Migliora la generalizzazione del modello attraverso diverse dimensioni e rapporti d'aspetto degli oggetti

- Migliora le prestazioni di rilevamento per oggetti a varie scale

- Massimizza l'utilità di un dataset piccolo creando campioni di addestramento più diversificati

Questa tecnica è particolarmente preziosa per dataset più piccoli come COCO128, aiutando i modelli ad apprendere caratteristiche più robuste da dati limitati.

Link to this sectionCome si confronta COCO128 con altre varianti del dataset COCO?#

COCO128 (128 immagini) si colloca tra COCO8 (8 immagini) e il dataset COCO completo (118K+ immagini) in termini di dimensioni:

- COCO8: Contiene solo 8 immagini (4 train, 4 val) - ideale per test rapidi e debug

- COCO128: Contiene 128 immagini - bilanciato tra dimensioni e diversità

- Full COCO: Contiene 118K+ immagini di addestramento - completo ma intensivo in termini di risorse

COCO128 fornisce un buon compromesso, offrendo maggiore diversità rispetto a COCO8 pur rimanendo molto più gestibile del dataset COCO completo per la sperimentazione e lo sviluppo iniziale del modello.

Link to this sectionPosso usare COCO128 per attività diverse dall'object detection?#

Sebbene COCO128 sia progettato principalmente per l'object detection, le annotazioni del dataset possono essere adattate per altre attività di computer vision:

- Instance segmentation: Utilizzando le maschere di segmentazione fornite nelle annotazioni

- Keypoint detection: Per immagini contenenti persone con annotazioni di keypoint

- Transfer learning: Come punto di partenza per il fine-tuning di modelli per attività personalizzate

Per attività specializzate come la segmentation, prendi in considerazione l'utilizzo di varianti appositamente create come COCO8-seg che includono le annotazioni appropriate.