Link to this sectionAddestramento nel Cloud#

L'addestramento nel cloud della Ultralytics Platform offre la possibilità di avviare l'addestramento con un singolo clic su GPU nel cloud, rendendo l'addestramento dei modelli accessibile senza configurazioni complesse. Addestra i modelli YOLO con lo streaming di metriche in tempo reale e il salvataggio automatico dei checkpoint.

graph LR

A[Configure] --> B[Start Training]

B --> C[Provision GPU]

C --> D[Download Dataset]

D --> E[Train]

E --> F[Stream Metrics]

F --> G[Save Checkpoints]

G --> H[Complete]

style A fill:#2196F3,color:#fff

style B fill:#FF9800,color:#fff

style E fill:#9C27B0,color:#fff

style H fill:#4CAF50,color:#fffLink to this sectionFinestra di dialogo per l'addestramento#

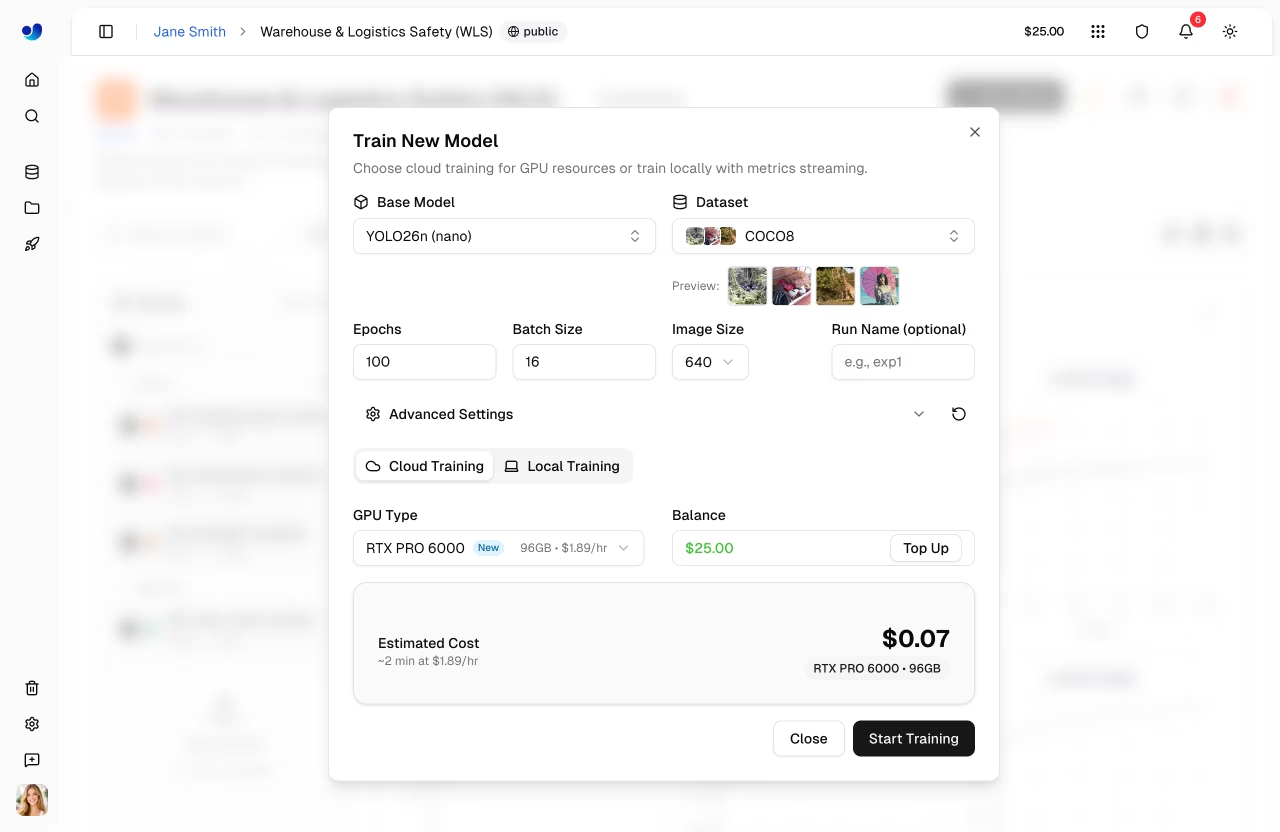

Avvia l'addestramento dall'interfaccia utente della piattaforma facendo clic su New Model in qualsiasi pagina del progetto (o Train da una pagina del dataset). La finestra di dialogo di addestramento presenta due schede: Cloud Training e Local Training.

Link to this sectionPassaggio 1: Seleziona il modello base#

Scegli tra i modelli ufficiali YOLO26 o i tuoi modelli già addestrati:

| Categoria | Descrizione |

|---|---|

| Ufficiali | Tutti i 30 modelli YOLO26 (5 dimensioni x 6 task) |

| I tuoi modelli | I tuoi modelli completati per il fine-tuning |

I modelli ufficiali sono organizzati per tipo di task (Detect, Segment, Semantic, Pose, OBB, Classify) con dimensioni che vanno da nano a xlarge.

Link to this sectionPassaggio 2: Seleziona il dataset#

Scegli un dataset su cui effettuare l'addestramento (vedi Datasets):

| Opzione | Descrizione |

|---|---|

| Ufficiali | Dataset curati da Ultralytics |

| I tuoi dataset | Dataset che hai caricato |

I dataset devono essere nello stato ready con almeno 1 immagine nel set di addestramento (train split), 1 immagine nel set di validazione o test split e almeno 1 immagine etichettata.

Un avviso di mancata corrispondenza del task appare se il task del modello (ad esempio, detect) non corrisponde al task del dataset (ad esempio, segment). L'addestramento fallirà se procedi con task non corrispondenti. Assicurati che sia il modello che il dataset utilizzino lo stesso tipo di task, come descritto nelle guide ai task.

Link to this sectionPassaggio 3: Configura i parametri#

Imposta i parametri fondamentali dell'addestramento:

| Parametro | Descrizione | Predefinito |

|---|---|---|

| Epoche | Numero di iterazioni di addestramento | 100 |

| Dimensione del batch | Campioni per iterazione | -1 (automatico) |

| Dimensione immagine | Risoluzione di input (menu a tendina 320/416/512/640/1280, qualsiasi multiplo di 32 da 32 a 4096 nell'editor YAML) | 640 |

| Nome dell'esecuzione | Nome facoltativo per l'esecuzione dell'addestramento | automatico |

Link to this sectionPassaggio 4: Impostazioni avanzate (facoltativo)#

Espandi Advanced Settings per accedere all'editor completo di parametri basato su YAML con oltre 40 parametri di addestramento organizzati per gruppo (vedi riferimento alla configurazione):

| Gruppo | Parametri |

|---|---|

| Tasso di apprendimento | lr0, lrf, momentum, weight_decay, warmup_epochs, warmup_momentum, warmup_bias_lr |

| Ottimizzatore | auto (predefinito), SGD, MuSGD, Adam, AdamW, NAdam, RAdam, RMSProp, Adamax |

| Pesi di perdita | box, cls, dfl, pose, kobj, label_smoothing |

| Aumentazione colore | hsv_h, hsv_s, hsv_v |

| Aumentazione geometrica | degrees, translate, scale, shear, perspective |

| Aumentazione ribaltamento e mix | flipud, fliplr, mosaic, mixup, copy_paste |

| Controllo dell'addestramento | patience, seed, deterministic, amp, cos_lr, close_mosaic, save_period |

| Dataset | fraction, freeze, single_cls, rect, multi_scale, resume |

I parametri riconoscono il task (ad esempio, copy_paste viene visualizzato solo per i task di segmentazione, pose/kobj solo per i task di posa). Un badge Modified appare quando i valori differiscono dai predefiniti e puoi ripristinare tutto ai predefiniti con il pulsante di ripristino.

Esempio: Ottimizzazione dell'aumentazione per piccoli dataset

Per piccoli dataset (<1000 immagini), aumenta l'aumentazione per ridurre l'overfitting:

mosaic: 1.0 # Keep mosaic on

mixup: 0.3 # Add mixup blending

copy_paste: 0.3 # Add copy-paste (segment only)

fliplr: 0.5 # Horizontal flip

degrees: 10.0 # Slight rotation

scale: 0.9 # Aggressive scalingLink to this sectionPassaggio 5: Seleziona GPU (scheda Cloud)#

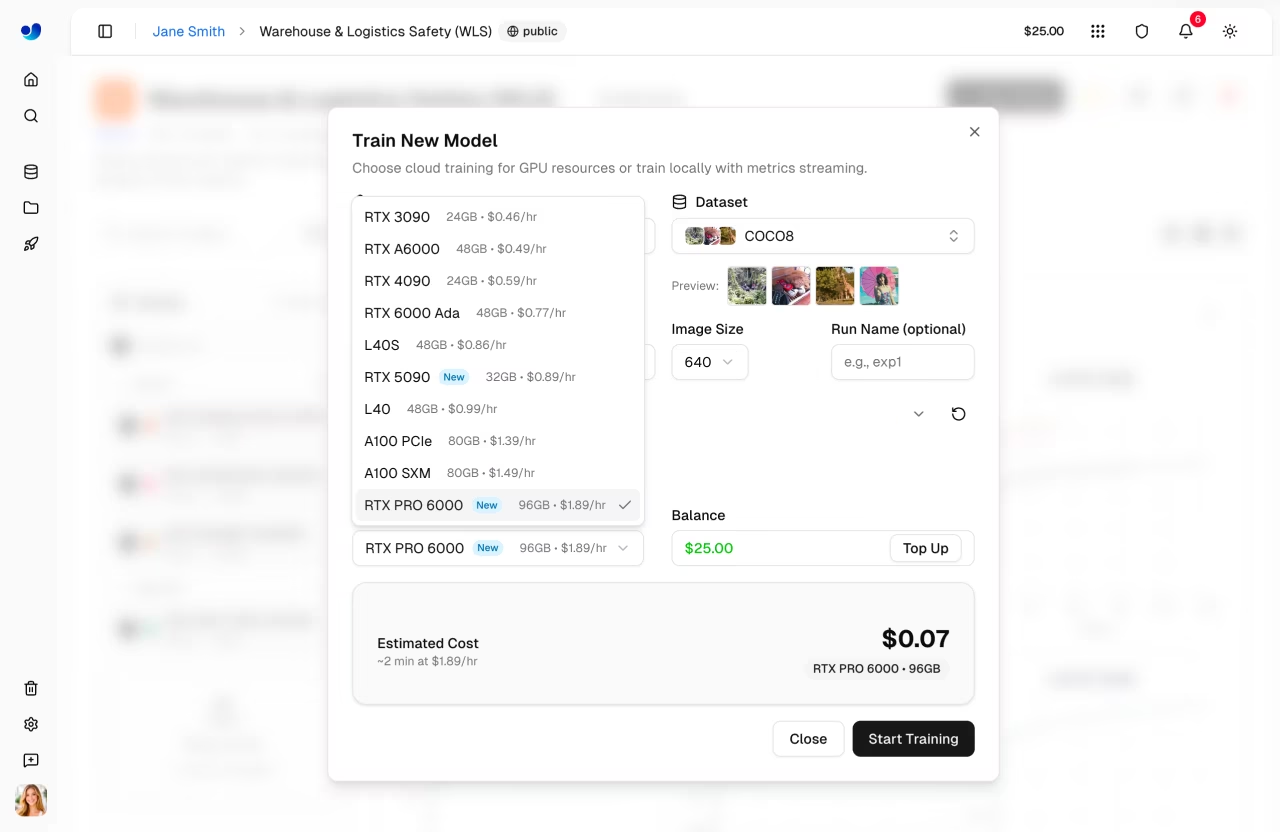

Scegli la tua GPU da Ultralytics Cloud:

| GPU | Generazione | VRAM | Costo/Ora | Ideale per |

|---|---|---|---|---|

| RTX 2000 Ada | Ada | 16 GB | $0.24 | Dataset piccoli, test |

| RTX A4500 | Ampere | 20 GB | $0.25 | Dataset medio-piccoli |

| RTX 4000 Ada | Ada | 20 GB | $0.26 | Dataset medi |

| RTX A5000 | Ampere | 24 GB | $0.27 | Dataset medi |

| L4 | Ada | 24 GB | $0.39 | Ottimizzato per l'inferenza |

| A40 | Ampere | 48 GB | $0.44 | Dimensioni batch più grandi |

| RTX 3090 | Ampere | 24 GB | $0.46 | Addestramento generale |

| RTX A6000 | Ampere | 48 GB | $0.49 | Modelli grandi |

| RTX PRO 4500 | Blackwell | 32 GB | $0.64 | Ottimo rapporto prezzo/prestazioni |

| RTX 4090 | Ada | 24 GB | $0.69 | Miglior rapporto prezzo/prestazioni |

| RTX 6000 Ada | Ada | 48 GB | $0.77 | Addestramento con batch grandi |

| L40S | Ada | 48 GB | $0.86 | Addestramento con batch grandi |

| RTX 5090 | Blackwell | 32 GB | $0.99 | Ultima generazione consumer |

| L40 | Ada | 48 GB | $0.99 | Modelli grandi |

| A100 PCIe | Ampere | 80 GB | $1.39 | Addestramento di produzione |

| A100 SXM | Ampere | 80 GB | $1.49 | Addestramento di produzione |

| RTX PRO 6000 | Blackwell | 96 GB | $1.89 | Predefinito consigliato |

| H100 PCIe | Hopper | 80 GB | $2.39 | Addestramento ad alte prestazioni |

| H100 SXM | Hopper | 80 GB | $2.99 | Addestramento più veloce |

| H100 NVL | Hopper | 94 GB | 3,07 $ | Massime prestazioni |

| H200 NVL | Hopper | 143 GB | 3,39 $ | Memoria massima |

| H200 SXM | Hopper | 141 GB | 3,99 $ | Massime prestazioni |

| B200 | Blackwell | 180 GB | 5,49 $ | Modelli grandi (Pro+) |

| B300 | Blackwell | 288 GB | 7,39 $ | Modelli più grandi (Pro+) |

- RTX PRO 6000: 96 GB Blackwell, predefinito consigliato per la maggior parte dei lavori

- A100 SXM: 80 GB HBM2e — ottima scelta per dimensioni di batch grandi o modelli più grandi

- H100 PCIe / H100 SXM / H100 NVL: 80–94 GB Hopper per addestramenti sensibili al tempo (disponibile in tutti i piani)

- H200 NVL / H200 SXM: 141–143 GB Hopper per carichi di lavoro ad alta memoria (disponibile in tutti i piani)

- B200 / B300: 180–288 GB NVIDIA Blackwell per carichi di lavoro all'avanguardia — richiede Pro o Enterprise

La finestra di dialogo mostra il tuo saldo attuale e un pulsante Top Up. Il costo e la durata stimati vengono calcolati in base alla tua configurazione (dimensione del modello, immagini del dataset, epoche, velocità della GPU).

Link to this sectionPassaggio 6: Avvia l'addestramento#

Fai clic su Start Training per lanciare il tuo lavoro. La piattaforma:

- Fornisce un'istanza GPU

- Scarica il tuo dataset

- Inizia l'addestramento

- Trasmette le metriche in tempo reale

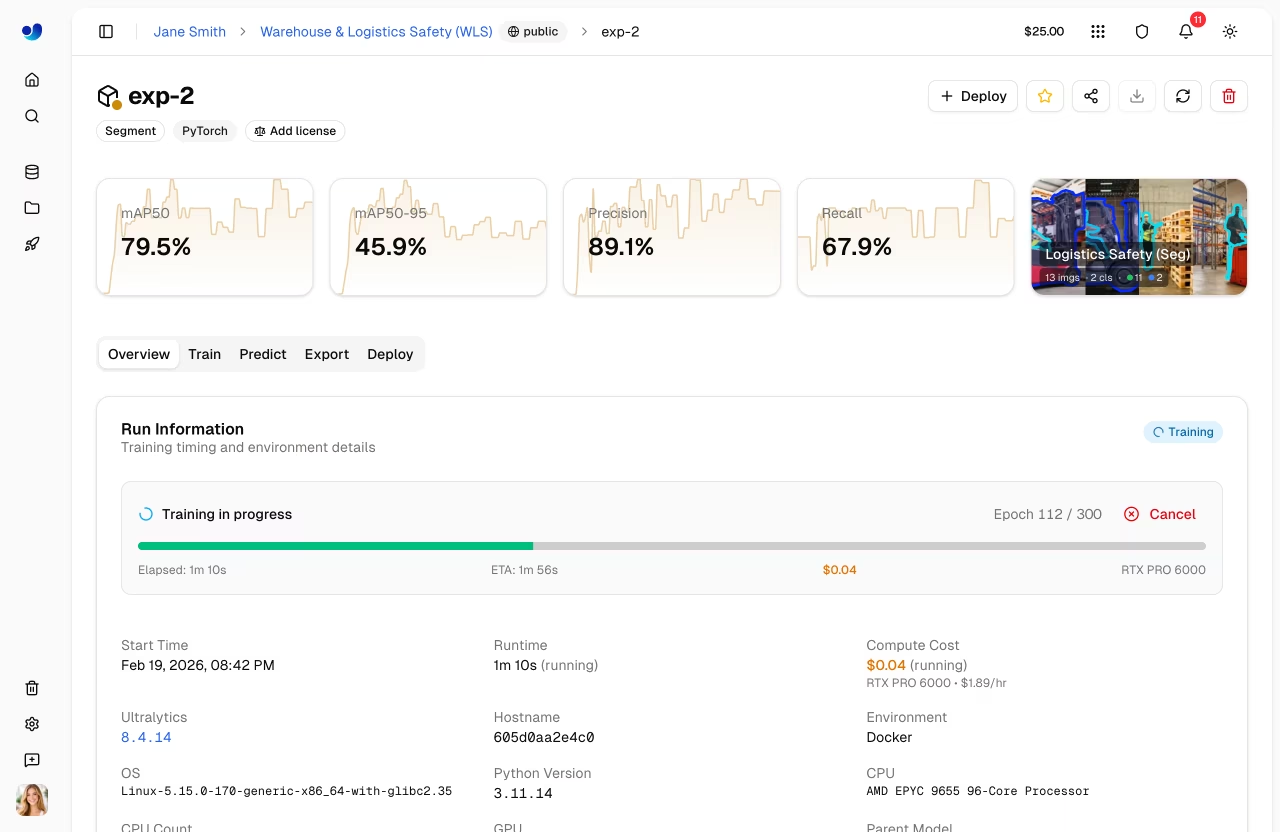

Link to this sectionCiclo di vita del lavoro di addestramento#

I lavori di addestramento avanzano attraverso i seguenti stati:

| Stato | Descrizione |

|---|---|

| Pending | Lavoro inviato, in attesa dell'allocazione GPU |

| Starting | GPU fornita, download del dataset e del modello in corso |

| Running | Addestramento in corso, metriche trasmesse in tempo reale |

| Completed | Addestramento terminato con successo |

| Failed | Addestramento fallito (vedi i log della console per i dettagli) |

| Cancelled | L'addestramento è stato annullato dall'utente |

I nuovi account ricevono crediti all'iscrizione — 5 $ per email personali e 25 $ per email aziendali. Controlla il tuo saldo in Impostazioni > Fatturazione.

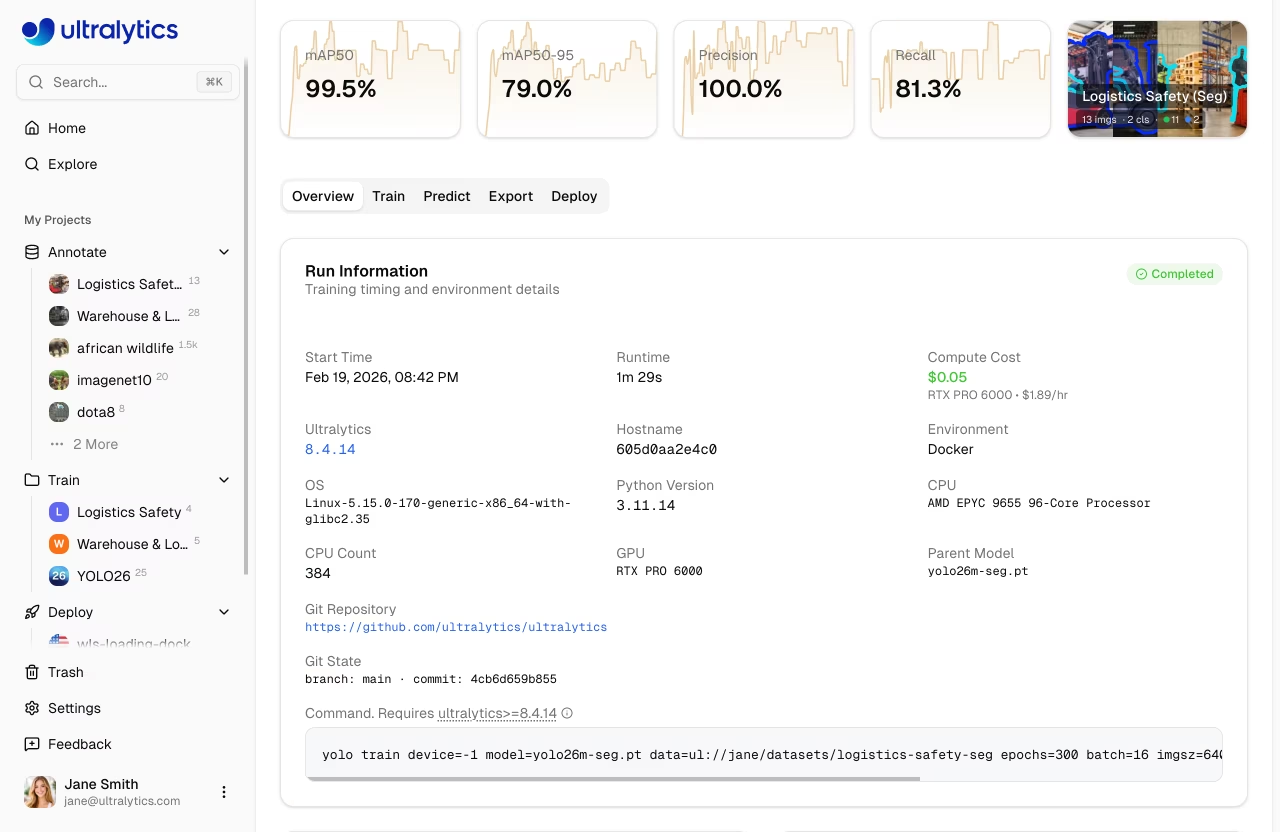

Link to this sectionMonitora l'addestramento#

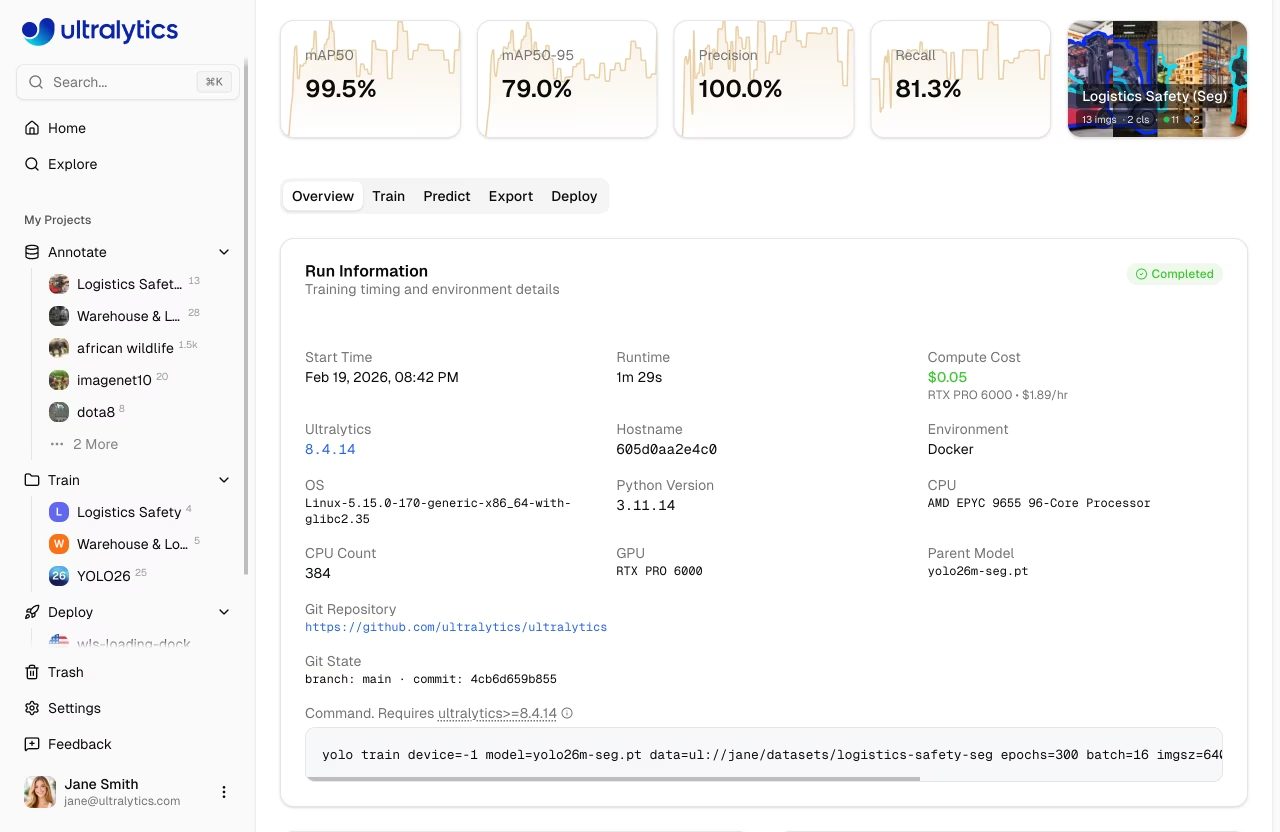

Visualizza l'avanzamento dell'addestramento in tempo reale nella scheda Train della pagina del modello:

Link to this sectionSottoscheda Grafici#

| Metrica | Descrizione |

|---|---|

| Perdita | Perdita di addestramento e validazione |

| mAP | Mean Average Precision (Precisione media) |

| Precision | Predizioni positive corrette |

| Recall | Verità fondamentali (ground truths) rilevate |

Link to this sectionSottoscheda Console#

Output della console dal vivo con supporto ai colori ANSI, barre di avanzamento e rilevamento degli errori.

Link to this sectionSottoscheda Sistema#

Utilizzo in tempo reale di GPU, memoria, temperatura, CPU e spazio su disco.

Link to this sectionCheckpoint#

Al termine dell'addestramento, il modello migliore (best.pt, il checkpoint con il mAP più alto) viene caricato sulla piattaforma e reso disponibile per il download, l'esportazione e il deployment.

Link to this sectionAnnulla Addestramento#

Fai clic su Cancel Training nella pagina del modello per interrompere un lavoro in esecuzione:

- L'istanza di calcolo viene terminata

- L'addebito dei crediti si interrompe

- Il miglior checkpoint rimane disponibile se è stato raggiunto prima della cancellazione

Link to this sectionAddestramento Remoto#

graph LR

A[Local GPU] --> B[Train]

B --> C[ultralytics Package]

C --> D[Stream Metrics]

D --> E[Platform Dashboard]

style A fill:#FF9800,color:#fff

style C fill:#2196F3,color:#fff

style E fill:#4CAF50,color:#fffAddestra sul tuo hardware mentre trasmetti le metriche alla piattaforma.

L'integrazione con la piattaforma richiede ultralytics>=8.4.60. Le versioni precedenti NON funzioneranno con la piattaforma.

pip install -U ultralyticsLink to this sectionConfigurazione della Chiave API#

- Vai su

Settings > API Keys - Crea una nuova chiave (o la piattaforma ne crea una automaticamente quando apri la scheda Addestramento Locale)

- Imposta la variabile d'ambiente:

export ULTRALYTICS_API_KEY="YOUR_API_KEY"Link to this sectionAddestra con lo Streaming#

Usa i parametri project e name per trasmettere le metriche:

yolo train model=yolo26n.pt data=coco.yaml epochs=100 \

project=username/my-project name=experiment-1La scheda Local Training nella finestra di dialogo dell'addestramento mostra un comando preconfigurato con la tua chiave API, i parametri selezionati e gli argomenti avanzati inclusi.

Link to this sectionUso dei dataset della piattaforma#

Addestra con i dataset archiviati sulla piattaforma utilizzando il formato URI ul://:

yolo train model=yolo26n.pt data=ul://username/datasets/my-dataset epochs=100 \

project=username/my-project name=exp1Il formato URI ul:// scarica e configura automaticamente il tuo dataset. Il modello viene collegato automaticamente al dataset sulla piattaforma (vedi Utilizzo dei Dataset della Piattaforma).

Link to this sectionFatturazione#

I costi di addestramento si basano sull'utilizzo della GPU:

Link to this sectionStima dei Costi#

Prima dell'inizio dell'addestramento, la piattaforma stima il costo totale tramite:

- Stima dei secondi per epoca in base alla dimensione del dataset, complessità del modello, dimensione dell'immagine, dimensione del batch e velocità della GPU

- Calcolo del tempo totale di addestramento moltiplicando i secondi per epoca per il numero di epoche, aggiungendo poi il tempo di avvio

- Calcolo del costo stimato moltiplicando le ore totali di addestramento per la tariffa oraria della GPU

Fattori che influenzano il costo:

| Fattore | Impatto |

|---|---|

| Dimensione del Dataset | Più immagini = tempo di addestramento più lungo (il calcolo scala approssimativamente in modo lineare rispetto alla dimensione del dataset) |

| Dimensione del Modello | I modelli più grandi (m, l, x) si addestrano più lentamente rispetto a (n, s) |

| Numero di Epoche | Moltiplicatore diretto sul tempo di addestramento |

| Dimensione immagine | Imgsz più grandi aumentano il calcolo: 320px=~0.3x, 640px=1.0x (base), 1280px=~3.5x |

| Dimensione del batch | I batch più grandi sono più efficienti (batch 32 = ~0.85x tempo, batch 8 = ~1.2x tempo rispetto alla base batch 16) |

| Velocità della GPU | Le GPU più veloci riducono il tempo di addestramento (es. H100 SXM = ~3.4x più veloce di RTX 4090) |

| Tempo di Avvio | Fino a 5 minuti per l'inizializzazione dell'istanza, il download dei dati e il riscaldamento (scala con la dimensione del dataset) |

Link to this sectionEsempi di Costo#

Le stime dei costi sono approssimative e dipendono da molti fattori. La finestra di dialogo dell'addestramento mostra una stima in tempo reale prima che tu inizi l'addestramento.

| Scenario | GPU | Costo Stimato |

|---|---|---|

| 500 immagini, YOLO26n, 50 epoche | RTX 4090 | ~$0.03 |

| 1000 immagini, YOLO26n, 100 epoche | RTX PRO 6000 | ~$0.27 |

| 5000 immagini, YOLO26s, 100 epoche | H100 SXM | ~$1.75 |

Link to this sectionFlusso di Fatturazione#

graph LR

A[Estimate Cost] --> B[Balance Check]

B --> C[Train]

C --> D[Charge Actual Runtime]

style A fill:#2196F3,color:#fff

style B fill:#FF9800,color:#fff

style C fill:#9C27B0,color:#fff

style D fill:#4CAF50,color:#fffFlusso di fatturazione dell'addestramento nel cloud:

- Stima: Costo calcolato prima dell'inizio dell'addestramento

- Controllo del Saldo: I crediti disponibili vengono controllati prima dell'avvio

- Addestramento: Il job viene eseguito sul calcolo selezionato

- Addebito: Il costo finale si basa sul runtime effettivo

La fatturazione traccia l'utilizzo effettivo del calcolo, incluse le esecuzioni parziali che vengono cancellate. Non ti viene mai addebitato alcun costo per le esecuzioni di addestramento fallite.

Link to this sectionFatturazione per Stato del Job#

| Stato | Addebitato? |

|---|---|

| Completed | Sì — tempo effettivo di GPU utilizzato |

| Cancelled | Sì — tempo di GPU dall'inizio alla cancellazione |

| Failed | No — le esecuzioni fallite non vengono addebitate |

| Bloccato | Parziale — viene addebitato solo il tempo effettivo di addestramento |

Se un'esecuzione di addestramento fallisce a causa di un errore di configurazione, un problema di memoria esaurita o qualsiasi altro guasto, non ti viene addebitato nulla. Viene fatturato solo il tempo di calcolo riuscito. I job bloccati (nessuna attività per oltre 4 ore) vengono terminati automaticamente e addebitati solo per il tempo in cui la GPU è stata attivamente in addestramento, non per il tempo di inattività.

Link to this sectionMetodi di pagamento#

| Metodo | Descrizione |

|---|---|

| Saldo dell'Account | Crediti pre-caricati |

| Pagamento per Job | Addebito al completamento del job |

L'avvio dell'addestramento richiede un saldo disponibile positivo e crediti sufficienti per il costo stimato del job.

Link to this sectionVisualizza i Costi di Addestramento#

Dopo l'addestramento, visualizza i costi dettagliati nella scheda Billing:

- Ripartizione dei costi per epoca

- Tempo totale di GPU

- Scarica il report dei costi

Link to this sectionSuggerimenti per l'Addestramento#

Link to this sectionScegli la Dimensione Corretta del Modello#

| Modello | Parametri | Ideale per |

|---|---|---|

| YOLO26n | 2.4M | Tempo reale, dispositivi edge |

| YOLO26s | 9.5M | Velocità/precisione bilanciate |

| YOLO26m | 20.4M | Precisione maggiore |

| YOLO26l | 24.8M | Precisione di produzione |

| YOLO26x | 55.7M | Precisione massima |

Link to this sectionOttimizza il Tempo di Addestramento#

- Inizia in piccolo: Testa con 10-20 epoche su una GPU economica per verificare che il tuo dataset e la tua configurazione funzionino

- Usa una GPU appropriata: RTX PRO 6000 gestisce bene la maggior parte dei carichi di lavoro

- Valida il dataset: Risolvi i problemi di etichettatura prima di spendere per l'addestramento

- Monitora presto: Cancella l'addestramento se la perdita si stabilizza — paghi solo per il tempo di calcolo utilizzato

Link to this sectionRisoluzione dei problemi#

| Problema | Soluzione |

|---|---|

| Addestramento bloccato allo 0% | Controlla il formato del dataset, riprova |

| Memoria esaurita | Riduci la dimensione del batch o usa una GPU più grande |

| Scarsa precisione | Aumenta le epoche, controlla la qualità dei dati |

| Addestramento lento | Considera una GPU più veloce |

| Errore di mancata corrispondenza del task | Assicurati che i task del modello e del dataset corrispondano |

Link to this sectionFAQ#

Link to this sectionQuanto tempo richiede l'addestramento?#

Il tempo di addestramento dipende da:

- Dimensione del dataset

- Dimensione del modello

- Numero di epoche

- GPU selezionata

Tempi tipici (1000 immagini, 100 epoche):

| Modello | RTX PRO 6000 | A100 SXM |

|---|---|---|

| YOLO26n | ~8 min | ~7 min |

| YOLO26m | ~16 min | ~13 min |

| YOLO26x | ~27 min | ~22 min |

I tempi di addestramento sono approssimativi e variano in base alla complessità del dataset, alle impostazioni di aumentazione e alla dimensione del batch. Usa la stima dei costi nella finestra di dialogo di addestramento per previsioni più precise.

Link to this sectionPosso addestrare durante la notte?#

Sì, l'addestramento continua fino al completamento. Riceverai una notifica al termine. Assicurati che il tuo account abbia un saldo sufficiente per l'addestramento basato sulle epoche.

Link to this sectionCosa succede se finisco i crediti?#

Se il tuo saldo crediti raggiunge lo zero durante un'esecuzione, l'addestramento continua fino al completamento e il tuo saldo diventa negativo. Questo assicura che il tuo lavoro di addestramento non venga mai interrotto a metà.

Al termine dell'addestramento, dovrai aggiungere crediti per riportare il saldo in positivo prima di iniziare nuovi lavori. Il modello completato, i checkpoint e tutti gli artefatti di addestramento sono completamente preservati indipendentemente dal saldo.

Un saldo negativo impedisce solo l'avvio di nuovi lavori di addestramento. I deployment esistenti e le altre funzionalità della piattaforma continuano a funzionare normalmente. Aggiungi crediti tramite Impostazioni > Fatturazione o abilita il rifornimento automatico per evitare interruzioni.

Link to this sectionCosa succede se l'addestramento costa più della stima?#

Le stime dei costi sono approssimative: il tempo di addestramento effettivo può variare a causa di fattori come la velocità di caricamento dei dati, il riscaldamento della GPU e il comportamento di convergenza del modello. Se il costo effettivo supera la stima, il saldo potrebbe diventare negativo (vedi sopra). La piattaforma non interrompe l'addestramento basandosi sulla stima.

Per gestire i costi:

- Monitora l'avanzamento dell'addestramento in tempo reale e annulla in anticipo se necessario

- Abilita il rifornimento automatico per ricaricare i crediti automaticamente

- Inizia con esecuzioni più brevi (meno epoche) per calibrare le aspettative

Link to this sectionPosso usare argomenti di addestramento personalizzati?#

Sì, espandi la sezione Impostazioni avanzate nella finestra di dialogo di addestramento per accedere a un editor YAML con oltre 40 parametri configurabili. I valori non predefiniti sono inclusi nei comandi di addestramento sia cloud che locali.

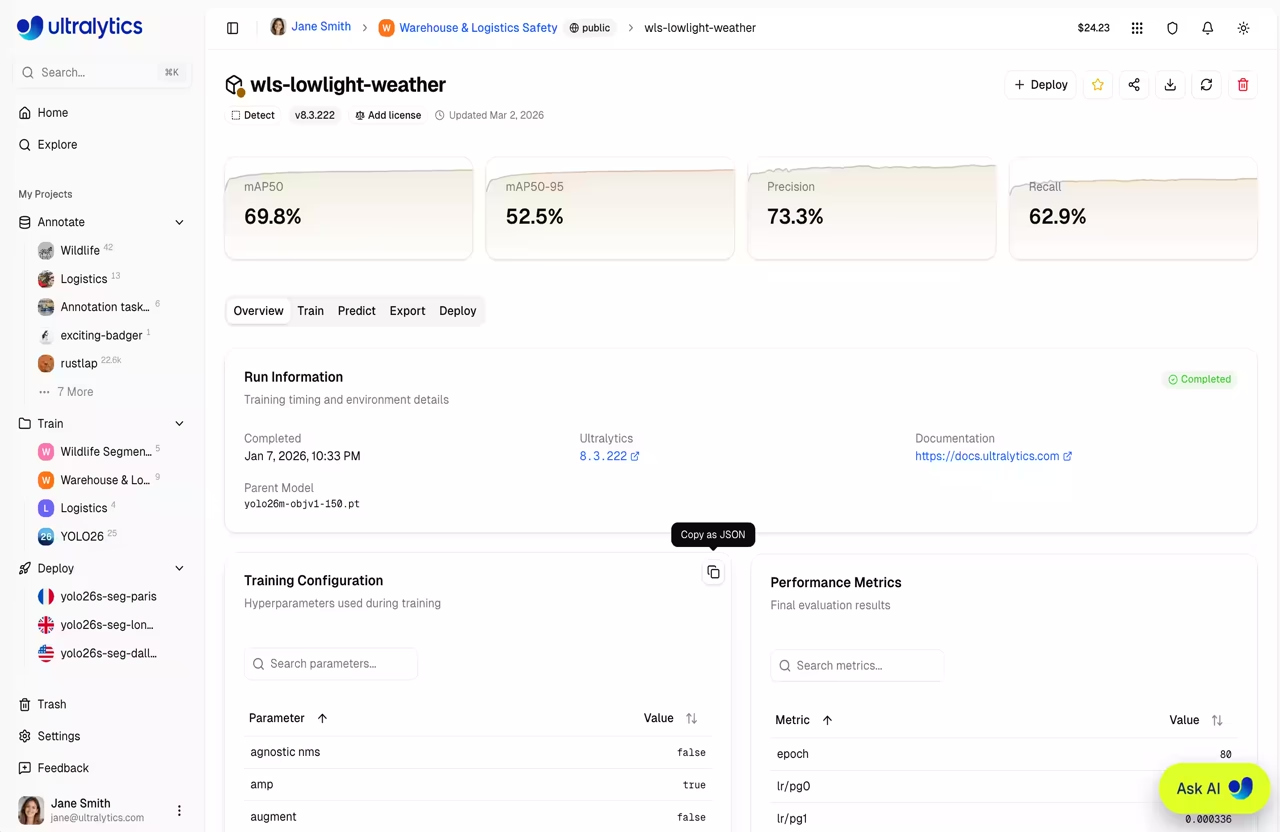

L'editor YAML supporta anche l'importazione di configurazioni da precedenti esecuzioni di addestramento:

- Copia da modello esistente: Nella pagina di qualsiasi modello completato, la scheda Configurazione addestramento ha un pulsante Copia come JSON. Copia il JSON e incollalo direttamente nell'editor YAML: rileva automaticamente il formato JSON e importa tutti i parametri.

- Incolla YAML o JSON: Incolla qualsiasi configurazione di addestramento YAML o JSON valida nell'editor. I parametri vengono convalidati automaticamente, con i valori fuori intervallo limitati e avvisi visualizzati.

- Trascina file: Trascina un file

.yamlo.jsondirettamente nell'editor per importarne i parametri.

Ciò rende semplice riprodurre o iterare configurazioni di addestramento precedenti senza dover reinserire manualmente ogni parametro.

Link to this sectionPosso addestrare da una pagina del dataset?#

Sì, il pulsante Addestra sulle pagine dei dataset apre la finestra di dialogo di addestramento con il dataset preselezionato e bloccato. Quindi selezioni un progetto e un modello per iniziare l'addestramento.

Link to this sectionRiferimento parametri di addestramento#

| Parametro | Tipo | Predefinito | Intervallo | Descrizione |

|---|---|---|---|---|

epochs | int | 100 | 1-10000 | Numero di epoche di addestramento |

batch | int | -1 (automatico) | -1 a 512 | Dimensione batch (-1 = adattamento automatico alla VRAM disponibile) |

imgsz | int | 640 | 32-4096 | Dimensione immagine in input |

patience | int | 100 | 1-1000 | Pazienza per arresto anticipato |

seed | int | 0 | 0-2147483647 | Seed casuale per la riproducibilità |

deterministic | bool | True | - | Modalità di addestramento deterministica |

amp | bool | True | - | Precisione mista automatica |

close_mosaic | int | 10 | 0-50 | Disabilita mosaic nelle ultime N epoche |

save_period | int | -1 | -1-100 | Salva checkpoint ogni N epoche |

workers | int | 8 | 0-64 | Worker del dataloader |

cache | seleziona | false | ram/disk/false | Memorizza immagini in cache |

Alcuni parametri si applicano solo a specifiche attività:

- Solo attività di rilevamento (detect, segment, pose, OBB — non classify):

box,dfl,degrees,translate,shear,perspective,mosaic,mixup,close_mosaic - Solo segmentazione:

copy_paste - Solo posa:

pose(peso della funzione di perdita),kobj(objectness dei punti chiave)