Link to this sectionTreinamento na Nuvem#

O Treinamento na Nuvem da Ultralytics Platform oferece treinamento com um clique em GPUs na nuvem, tornando o treinamento de modelos acessível sem configurações complexas. Treine modelos YOLO com streaming de métricas em tempo real e salvamento automático de checkpoints.

graph LR

A[Configure] --> B[Start Training]

B --> C[Provision GPU]

C --> D[Download Dataset]

D --> E[Train]

E --> F[Stream Metrics]

F --> G[Save Checkpoints]

G --> H[Complete]

style A fill:#2196F3,color:#fff

style B fill:#FF9800,color:#fff

style E fill:#9C27B0,color:#fff

style H fill:#4CAF50,color:#fffLink to this sectionDiálogo de Treinamento#

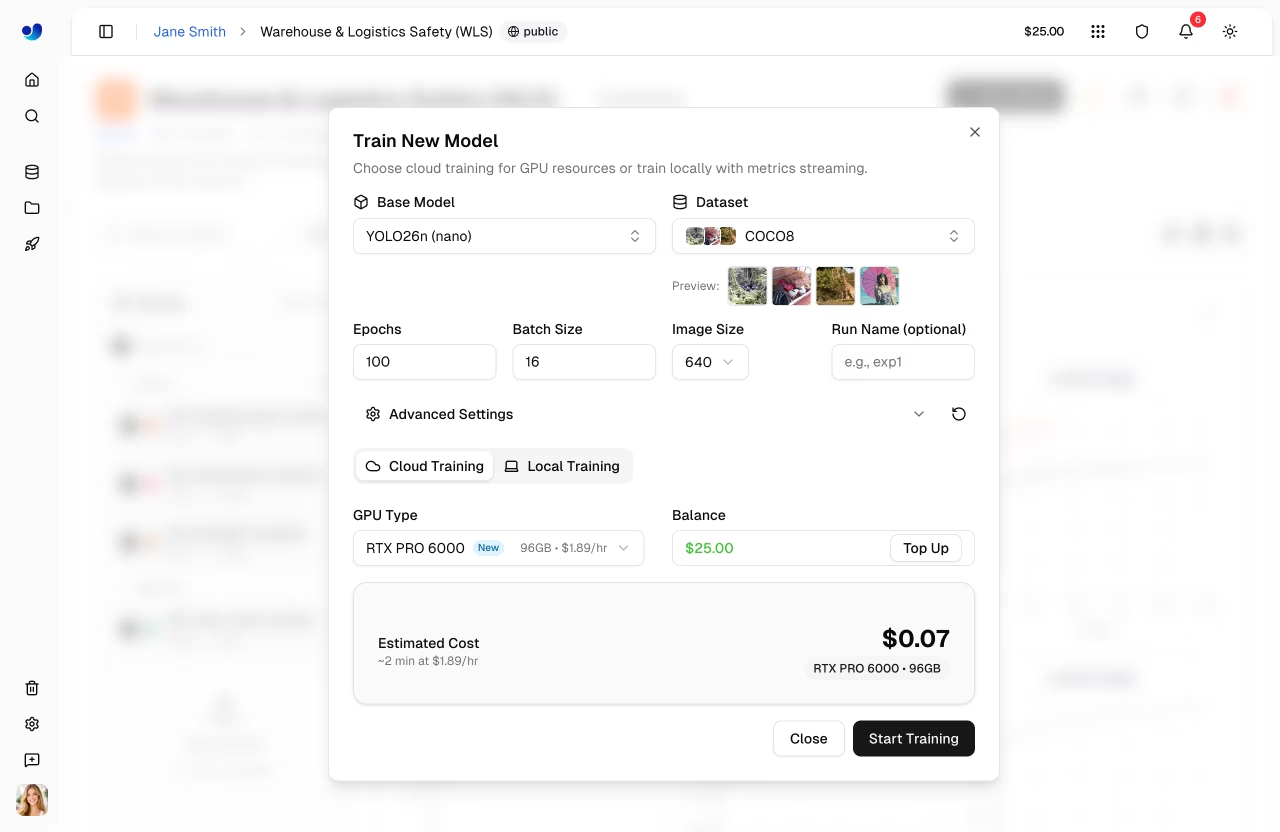

Inicie o treinamento a partir da interface do usuário da plataforma clicando em New Model em qualquer página de projeto (ou Train a partir de uma página de conjunto de dados). O diálogo de treinamento possui duas abas: Cloud Training e Local Training.

Link to this sectionPasso 1: Selecionar Modelo Base#

Escolha entre os modelos oficiais YOLO26 ou seus próprios modelos treinados:

| Categoria | Descrição |

|---|---|

| Oficial | Todos os 30 modelos YOLO26 (5 tamanhos x 6 tarefas) |

| Seus Modelos | Seus modelos concluídos para ajuste fino |

Os modelos oficiais são organizados por tipo de tarefa (Detect, Segment, Semantic, Pose, OBB, Classify) com tamanhos de nano a xlarge.

Link to this sectionPasso 2: Selecionar Conjunto de Dados#

Escolha um conjunto de dados para treinar (veja Datasets):

| Opção | Descrição |

|---|---|

| Oficial | Conjuntos de dados curados pela Ultralytics |

| Seus Conjuntos de Dados | Conjuntos de dados que você enviou |

Os conjuntos de dados devem estar com status ready com pelo menos 1 imagem no conjunto de treino, 1 imagem no conjunto de validação ou teste, e pelo menos 1 imagem rotulada.

Um aviso de incompatibilidade de tarefa aparece se a tarefa do modelo (por exemplo, detect) não corresponder à tarefa do conjunto de dados (por exemplo, segment). O treinamento falhará se você prosseguir com tarefas incompatíveis. Certifique-se de que tanto o modelo quanto o conjunto de dados utilizem o mesmo tipo de tarefa, conforme descrito nos guias de tarefas.

Link to this sectionPasso 3: Configurar Parâmetros#

Defina os principais parâmetros de treinamento:

| Parâmetro | Descrição | Predefinição |

|---|---|---|

| Epochs | Número de iterações de treinamento | 100 |

| Batch Size | Amostras por iteração | -1 (auto) |

| Tamanho da Imagem | Resolução de entrada (dropdown 320/416/512/640/1280, qualquer múltiplo de 32 de 32 a 4096 no editor YAML) | 640 |

| Run Name | Nome opcional para a execução do treinamento | auto |

Link to this sectionPasso 4: Configurações Avançadas (Opcional)#

Expanda Advanced Settings para acessar o editor de parâmetros baseado em YAML completo com mais de 40 parâmetros de treinamento organizados por grupo (veja referência de configuração):

| Grupo | Parâmetros |

|---|---|

| Taxa de Aprendizado | lr0, lrf, momentum, weight_decay, warmup_epochs, warmup_momentum, warmup_bias_lr |

| Optimizer | auto (padrão), SGD, MuSGD, Adam, AdamW, NAdam, RAdam, RMSProp, Adamax |

| Loss Weights | box, cls, dfl, pose, kobj, label_smoothing |

| Color Augmentation | hsv_h, hsv_s, hsv_v |

| Geometric Augment. | degrees, translate, scale, shear, perspective |

| Flip & Mix Augment. | flipud, fliplr, mosaic, mixup, copy_paste |

| Training Control | patience, seed, deterministic, amp, cos_lr, close_mosaic, save_period |

| Dataset | fraction, freeze, single_cls, rect, multi_scale, resume |

Os parâmetros reconhecem a tarefa (por exemplo, copy_paste só aparece para tarefas de segmentação, pose/kobj apenas para tarefas de pose). Um distintivo Modified aparece quando os valores diferem dos padrões, e você pode redefinir tudo para os padrões com o botão de reset.

Exemplo: Ajustando a Aumentação para Pequenos Conjuntos de Dados

Para conjuntos de dados pequenos (<1000 imagens), aumente a aumentação para reduzir o overfitting:

mosaic: 1.0 # Keep mosaic on

mixup: 0.3 # Add mixup blending

copy_paste: 0.3 # Add copy-paste (segment only)

fliplr: 0.5 # Horizontal flip

degrees: 10.0 # Slight rotation

scale: 0.9 # Aggressive scalingLink to this sectionPasso 5: Selecionar GPU (Aba Cloud)#

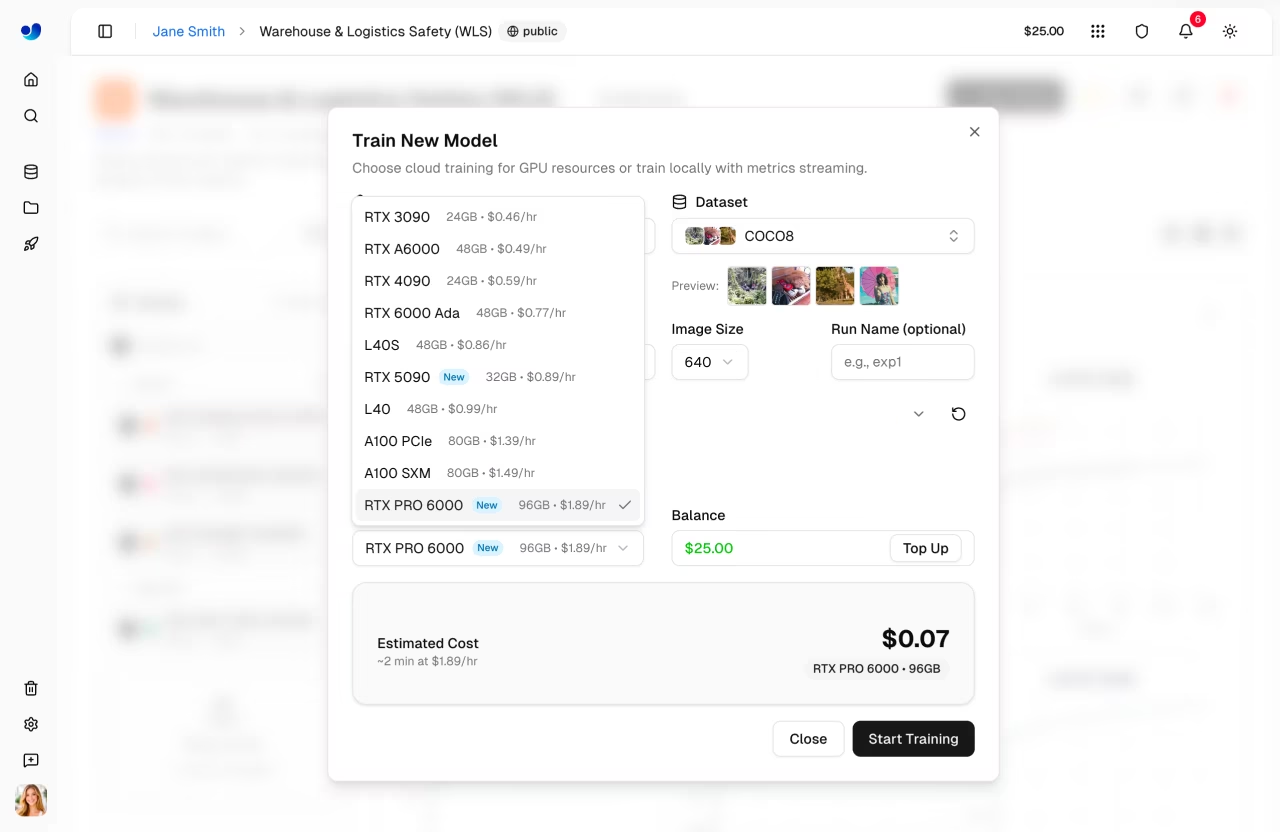

Escolha sua GPU da Ultralytics Cloud:

| GPU | Geração | VRAM | Custo/Hora | Melhor para |

|---|---|---|---|---|

| RTX 2000 Ada | Ada | 16 GB | $0.24 | Datasets pequenos, testes |

| RTX A4500 | Ampere | 20 GB | $0.25 | Datasets pequenos a médios |

| RTX 4000 Ada | Ada | 20 GB | $0.26 | Datasets médios |

| RTX A5000 | Ampere | 24 GB | $0.27 | Datasets médios |

| L4 | Ada | 24 GB | $0.39 | Otimizada para inferência |

| A40 | Ampere | 48 GB | $0.44 | Tamanhos de lote maiores |

| RTX 3090 | Ampere | 24 GB | $0.46 | Treinamento geral |

| RTX A6000 | Ampere | 48 GB | $0.49 | Modelos grandes |

| RTX PRO 4500 | Blackwell | 32 GB | $0.64 | Ótima relação preço/desempenho |

| RTX 4090 | Ada | 24 GB | $0.69 | Melhor relação preço/desempenho |

| RTX 6000 Ada | Ada | 48 GB | $0.77 | Treinamento com lotes grandes |

| L40S | Ada | 48 GB | $0.86 | Treinamento com lotes grandes |

| RTX 5090 | Blackwell | 32 GB | $0.99 | Última geração de consumidor |

| L40 | Ada | 48 GB | $0.99 | Modelos grandes |

| A100 PCIe | Ampere | 80 GB | $1.39 | Treinamento de produção |

| A100 SXM | Ampere | 80 GB | $1.49 | Treinamento de produção |

| RTX PRO 6000 | Blackwell | 96 GB | $1.89 | Padrão recomendado |

| H100 PCIe | Hopper | 80 GB | $2.39 | Treinamento de alto desempenho |

| H100 SXM | Hopper | 80 GB | $2.99 | Treinamento mais rápido |

| H100 NVL | Hopper | 94 GB | $3.07 | Desempenho máximo |

| H200 NVL | Hopper | 143 GB | $3.39 | Memória máxima |

| H200 SXM | Hopper | 141 GB | $3.99 | Desempenho máximo |

| B200 | Blackwell | 180 GB | $5.49 | Modelos grandes (Pro+) |

| B300 | Blackwell | 288 GB | $7.39 | Modelos maiores (Pro+) |

- RTX PRO 6000: 96 GB Blackwell, padrão recomendado para a maioria dos trabalhos

- A100 SXM: 80 GB HBM2e — excelente escolha para tamanhos de lote grandes ou modelos maiores

- H100 PCIe / H100 SXM / H100 NVL: 80–94 GB Hopper para treinamento sensível ao tempo (disponível em todos os planos)

- H200 NVL / H200 SXM: 141–143 GB Hopper para cargas de trabalho de alta memória (disponível em todos os planos)

- B200 / B300: 180–288 GB NVIDIA Blackwell para cargas de trabalho de ponta — requer Pro ou Enterprise

O diálogo mostra seu saldo atual e um botão Top Up. Um custo e duração estimados são calculados com base na sua configuração (tamanho do modelo, imagens do conjunto de dados, épocas, velocidade da GPU).

Link to this sectionPasso 6: Iniciar Treinamento#

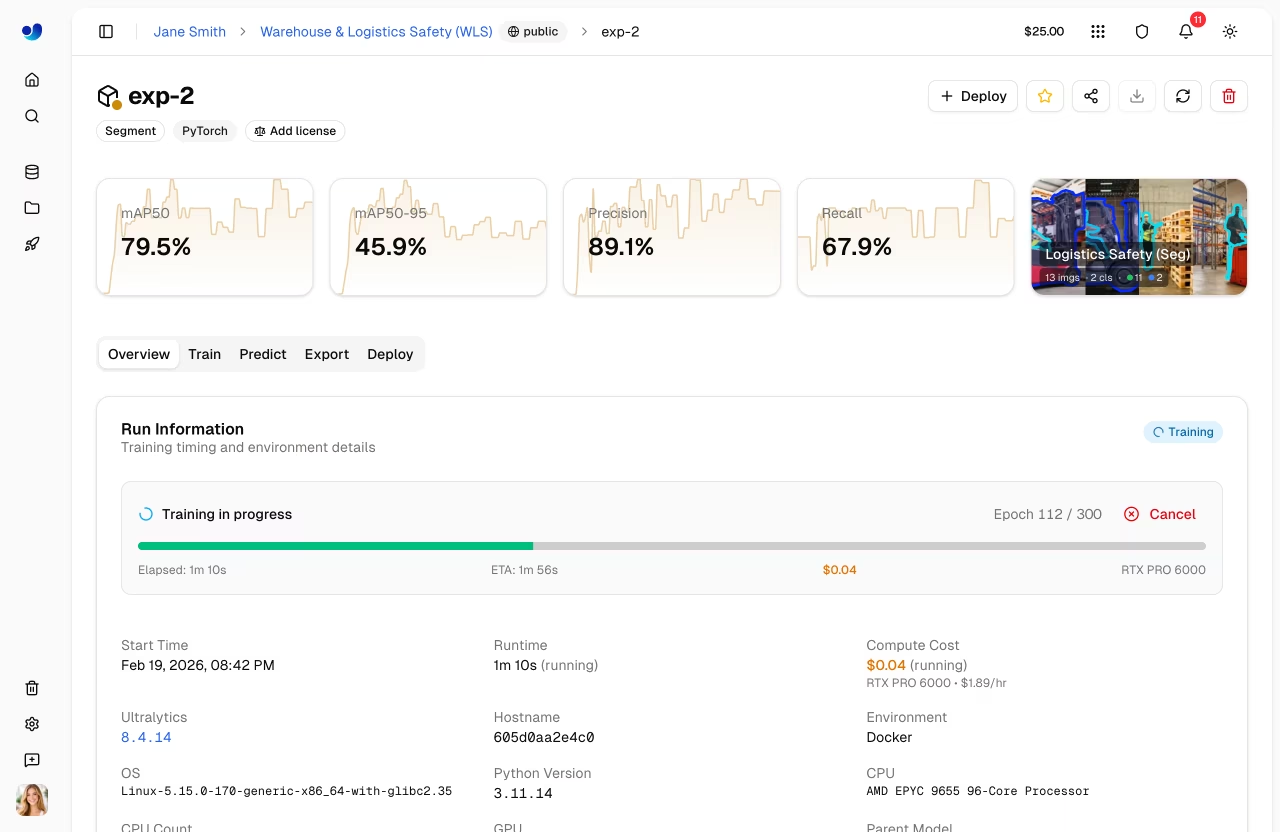

Clique em Start Training para iniciar seu trabalho. A Plataforma:

- Provisiona uma instância de GPU

- Faz o download do seu conjunto de dados

- Inicia o treinamento

- Transmite métricas em tempo real

Link to this sectionCiclo de Vida do Trabalho de Treinamento#

Os trabalhos de treinamento progridem através dos seguintes status:

| Status | Descrição |

|---|---|

| Pending | Trabalho enviado, aguardando alocação de GPU |

| Starting | GPU provisionada, baixando conjunto de dados e modelo |

| Running | Treinamento em progresso, métricas sendo transmitidas em tempo real |

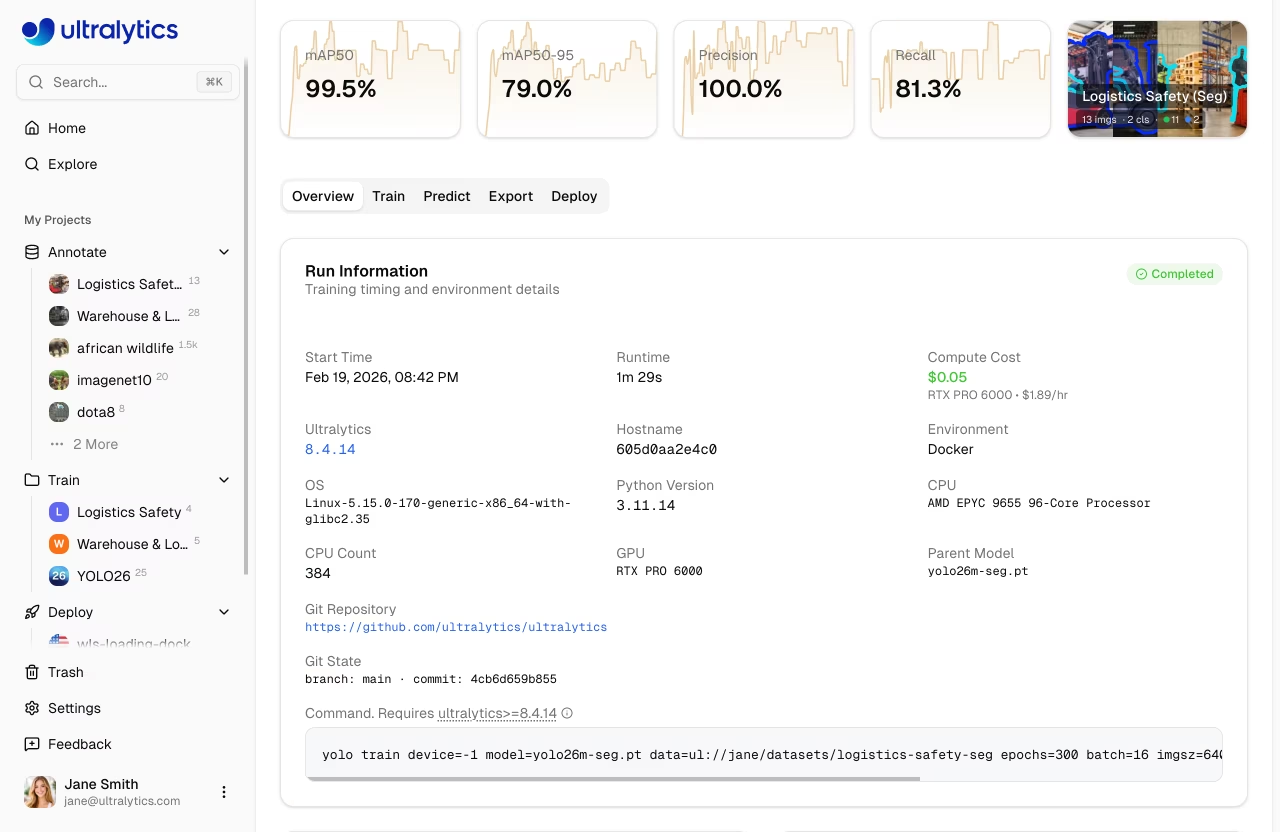

| Completed | Treinamento concluído com sucesso |

| Failed | O treinamento falhou (veja os logs do console para detalhes) |

| Cancelled | O treinamento foi cancelado pelo usuário |

Novas contas recebem créditos de inscrição — US$ 5 para e-mails pessoais e US$ 25 para e-mails corporativos. Verifique seu saldo em Configurações > Cobrança.

Link to this sectionMonitorar Treinamento#

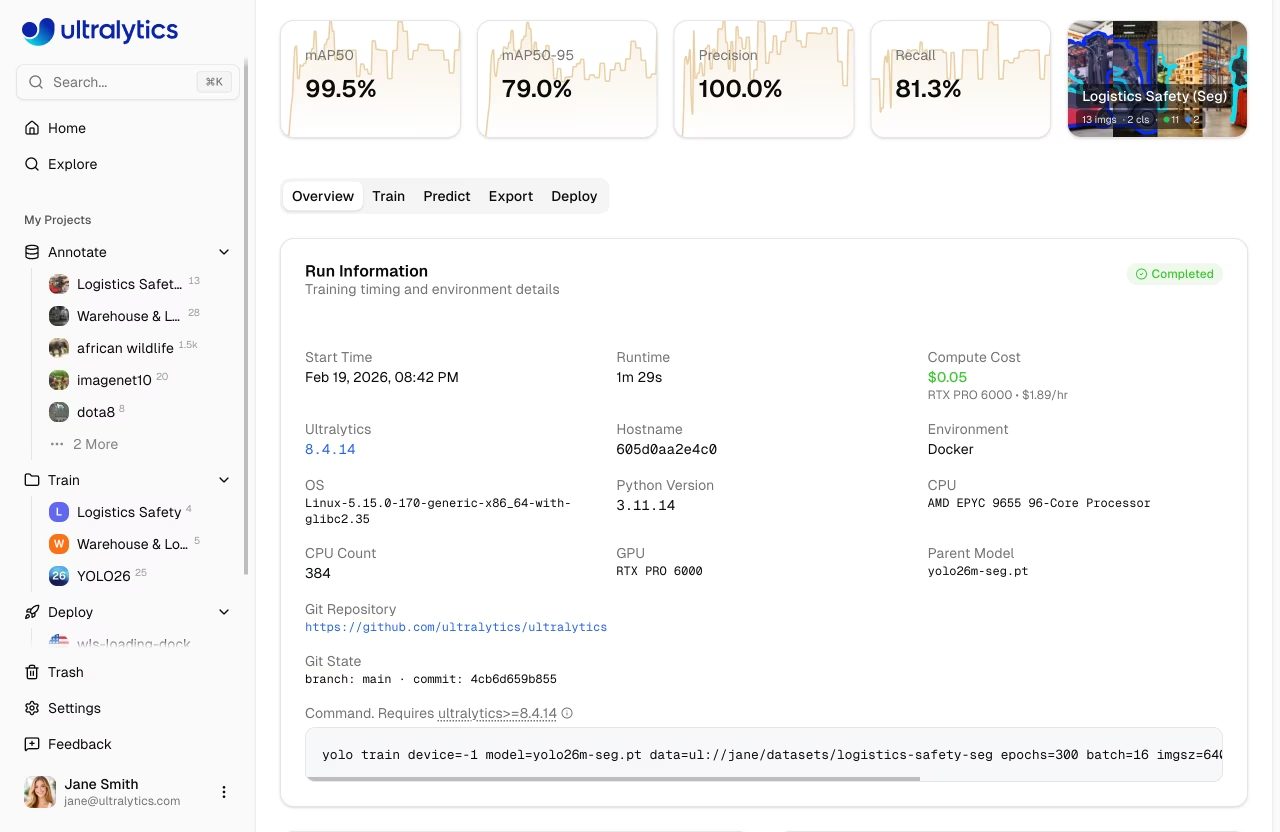

Veja o progresso do treinamento em tempo real na aba Train da página do modelo:

Link to this sectionSub-aba Charts#

| Métrica | Descrição |

|---|---|

| Perda | Perda de treinamento e validação |

| mAP | Precisão Média (Mean Average Precision) |

| Precision | Previsões positivas corretas |

| Recall | Verdades fundamentais detectadas |

Link to this sectionSub-aba Console#

Saída de console ao vivo com suporte a cores ANSI, barras de progresso e detecção de erros.

Link to this sectionSub-aba System#

Utilização de GPU, memória, temperatura, CPU e uso de disco em tempo real.

Link to this sectionCheckpoints#

Após a conclusão do treinamento, o melhor modelo (best.pt, o checkpoint com o maior mAP) é enviado para a plataforma e disponibilizado para download, exportação e implantação.

Link to this sectionCancelar Treinamento#

Clique em Cancel Training na página do modelo para interromper um trabalho em execução:

- A instância de computação é encerrada

- A cobrança de créditos é interrompida

- O melhor checkpoint permanece disponível se tiver sido alcançado antes do cancelamento

Link to this sectionTreinamento Remoto#

graph LR

A[Local GPU] --> B[Train]

B --> C[ultralytics Package]

C --> D[Stream Metrics]

D --> E[Platform Dashboard]

style A fill:#FF9800,color:#fff

style C fill:#2196F3,color:#fff

style E fill:#4CAF50,color:#fffTreine no seu próprio hardware enquanto transmite métricas para a plataforma.

A integração com a plataforma requer ultralytics>=8.4.60. Versões anteriores NÃO funcionarão com a plataforma.

pip install -U ultralyticsLink to this sectionConfigurar Chave de API#

- Vá para

Settings > API Keys - Crie uma nova chave (ou a plataforma cria uma automaticamente quando você abre a aba Local Training)

- Defina a variável de ambiente:

export ULTRALYTICS_API_KEY="YOUR_API_KEY"Link to this sectionTreinar com Streaming#

Use os parâmetros project e name para transmitir métricas:

yolo train model=yolo26n.pt data=coco.yaml epochs=100 \

project=username/my-project name=experiment-1A aba Local Training na caixa de diálogo de treinamento mostra um comando pré-configurado com sua chave de API, parâmetros selecionados e argumentos avançados incluídos.

Link to this sectionUsando conjuntos de dados da plataforma#

Treine com datasets armazenados na plataforma usando o formato de URI ul://:

yolo train model=yolo26n.pt data=ul://username/datasets/my-dataset epochs=100 \

project=username/my-project name=exp1O formato de URI ul:// baixa e configura automaticamente o seu dataset. O modelo é vinculado automaticamente ao dataset na plataforma (veja Using Platform Datasets).

Link to this sectionFaturamento#

Os custos de treinamento são baseados no uso de GPU:

Link to this sectionEstimativa de Custo#

Antes do início do treinamento, a plataforma estima o custo total através de:

- Estimativa de segundos por época a partir do tamanho do dataset, complexidade do modelo, tamanho da imagem, tamanho do lote (batch size) e velocidade da GPU

- Cálculo do tempo total de treinamento multiplicando os segundos por época pelo número de épocas, adicionando então a sobrecarga de inicialização

- Computação do custo estimado a partir das horas totais de treinamento multiplicadas pela taxa horária da GPU

Fatores que afetam o custo:

| Fator | Impacto |

|---|---|

| Tamanho do Dataset | Mais imagens = tempo de treinamento maior (a computação escala aproximadamente de forma linear com o tamanho do dataset) |

| Tamanho do Modelo | Modelos maiores (m, l, x) treinam mais lentamente que (n, s) |

| Número de Épocas | Multiplicador direto no tempo de treinamento |

| Tamanho da Imagem | Imgsz maiores aumentam a computação: 320px=~0.3x, 640px=1.0x (linha de base), 1280px=~3.5x |

| Batch Size | Lotes maiores são mais eficientes (lote 32 = ~0.85x do tempo, lote 8 = ~1.2x do tempo em comparação com a linha de base de 16) |

| Velocidade da GPU | GPUs mais rápidas reduzem o tempo de treinamento (por exemplo, H100 SXM = ~3.4x mais rápida que a RTX 4090) |

| Sobrecarga de Inicialização | Até 5 minutos para inicialização da instância, download de dados e aquecimento (escala com o tamanho do dataset) |

Link to this sectionExemplos de Custo#

As estimativas de custo são aproximadas e dependem de muitos fatores. A caixa de diálogo de treinamento mostra uma estimativa em tempo real antes de você iniciar o treinamento.

| Cenário | GPU | Custo Estimado |

|---|---|---|

| 500 imagens, YOLO26n, 50 épocas | RTX 4090 | ~$0.03 |

| 1000 imagens, YOLO26n, 100 épocas | RTX PRO 6000 | ~$0.27 |

| 5000 imagens, YOLO26s, 100 épocas | H100 SXM | ~$1.75 |

Link to this sectionFluxo de Faturamento#

graph LR

A[Estimate Cost] --> B[Balance Check]

B --> C[Train]

C --> D[Charge Actual Runtime]

style A fill:#2196F3,color:#fff

style B fill:#FF9800,color:#fff

style C fill:#9C27B0,color:#fff

style D fill:#4CAF50,color:#fffFluxo de faturamento de treinamento em nuvem:

- Estimativa: Custo calculado antes do início do treinamento

- Verificação de Saldo: Os créditos disponíveis são verificados antes do lançamento

- Treinar: O trabalho é executado na computação selecionada

- Cobrança: O custo final é baseado no tempo de execução real

O faturamento rastreia o uso real de computação, incluindo execuções parciais que são canceladas. Você nunca é cobrado por execuções de treinamento que falharam.

Link to this sectionFaturamento por Status do Trabalho#

| Status | Cobrado? |

|---|---|

| Completed | Sim — tempo de GPU real usado |

| Cancelled | Sim — tempo de GPU do início ao cancelamento |

| Failed | Não — execuções que falharam não são cobradas |

| Travado | Parcial — apenas o tempo de treinamento real é cobrado |

Se uma execução de treinamento falhar devido a um erro de configuração, problema de falta de memória (out-of-memory) ou qualquer outra falha, você não é cobrado. Apenas o tempo de computação bem-sucedido é faturado. Trabalhos travados (sem atividade por 4+ horas) são automaticamente encerrados e cobrados apenas pelo tempo em que a GPU estava treinando ativamente, não pelo tempo ocioso.

Link to this sectionMétodos de Pagamento#

| Método | Descrição |

|---|---|

| Saldo da Conta | Créditos pré-carregados |

| Pagar Por Trabalho | Cobrança na conclusão do trabalho |

O início do treinamento requer um saldo disponível positivo e créditos suficientes para o custo estimado do trabalho.

Link to this sectionVisualizar Custos de Treinamento#

Após o treinamento, veja os custos detalhados na aba Billing:

- Detalhamento de custo por época

- Tempo total de GPU

- Baixar relatório de custos

Link to this sectionDicas de Treinamento#

Link to this sectionEscolha o Tamanho de Modelo Correto#

| Modelo | Parâmetros | Melhor para |

|---|---|---|

| YOLO26n | 2.4M | Tempo real, dispositivos de borda (edge) |

| YOLO26s | 9.5M | Equilíbrio velocidade/precisão |

| YOLO26m | 20.4M | Maior precisão |

| YOLO26l | 24.8M | Precisão de produção |

| YOLO26x | 55.7M | Precisão máxima |

Link to this sectionOtimizar Tempo de Treinamento#

- Comece pequeno: Teste com 10-20 épocas em uma GPU econômica para verificar se seu dataset e configuração funcionam

- Use uma GPU apropriada: A RTX PRO 6000 lida bem com a maioria das cargas de trabalho

- Valide o dataset: Corrija problemas de rotulagem antes de gastar com treinamento

- Monitore desde cedo: Cancele o treinamento se a perda estagnar — você paga apenas pelo tempo de computação usado

Link to this sectionSolução de Problemas#

| Problema | Solução |

|---|---|

| Treinamento travado em 0% | Verifique o formato do dataset, tente novamente |

| Falta de memória (Out of memory) | Reduza o tamanho do lote ou use uma GPU maior |

| Baixa precisão | Aumente as épocas, verifique a qualidade dos dados |

| Treinamento lento | Considere uma GPU mais rápida |

| Erro de incompatibilidade de tarefa | Certifique-se de que as tarefas do modelo e do conjunto de dados coincidam |

Link to this sectionFAQ#

Link to this sectionQuanto tempo leva o treinamento?#

O tempo de treinamento depende de:

- Tamanho do conjunto de dados

- Tamanho do modelo

- Número de épocas

- GPU selecionada

Tempos típicos (1000 imagens, 100 épocas):

| Modelo | RTX PRO 6000 | A100 SXM |

|---|---|---|

| YOLO26n | ~8 min | ~7 min |

| YOLO26m | ~16 min | ~13 min |

| YOLO26x | ~27 min | ~22 min |

Os tempos de treinamento são aproximados e variam de acordo com a complexidade do conjunto de dados, as configurações de aumento e o tamanho do lote. Use a estimativa de custo do diálogo de treinamento para previsões mais precisas.

Link to this sectionPosso treinar durante a noite?#

Sim, o treinamento continua até a conclusão. Você receberá uma notificação quando o treinamento terminar. Certifique-se de que sua conta tenha saldo suficiente para o treinamento baseado em épocas.

Link to this sectionO que acontece se meus créditos acabarem?#

Se o seu saldo de créditos chegar a zero durante uma execução de treinamento, o treinamento continua até a conclusão e seu saldo fica negativo. Isso garante que seu trabalho de treinamento nunca seja interrompido no meio da execução.

Após a conclusão do treinamento, você precisará adicionar créditos para tornar seu saldo positivo novamente antes de iniciar novos trabalhos de treinamento. Seu modelo concluído, checkpoints e todos os artefatos de treinamento são totalmente preservados, independentemente do saldo.

Um saldo negativo apenas impede o início de novos trabalhos de treinamento. Implantações existentes e outros recursos da plataforma continuam funcionando normalmente. Adicione créditos via Settings > Billing ou ative o auto top-up para evitar interrupções.

Link to this sectionO que acontece se meu treinamento custar mais do que a estimativa?#

As estimativas de custo são aproximadas — o tempo real de treinamento pode variar devido a fatores como velocidade de carregamento de dados, aquecimento da GPU e comportamento de convergência do modelo. Se o custo real exceder a estimativa, seu saldo pode ficar negativo (veja acima). A plataforma não interrompe o treinamento com base na estimativa.

Para gerenciar custos:

- Monitore o progresso do treinamento em tempo real e cancele mais cedo se necessário

- Ative o auto top-up para reabastecer créditos automaticamente

- Comece com execuções mais curtas (menos épocas) para calibrar as expectativas

Link to this sectionPosso usar argumentos de treinamento personalizados?#

Sim, expanda a seção Advanced Settings no diálogo de treinamento para acessar um editor YAML com mais de 40 parâmetros configuráveis. Valores não padrão são incluídos nos comandos de treinamento na nuvem e local.

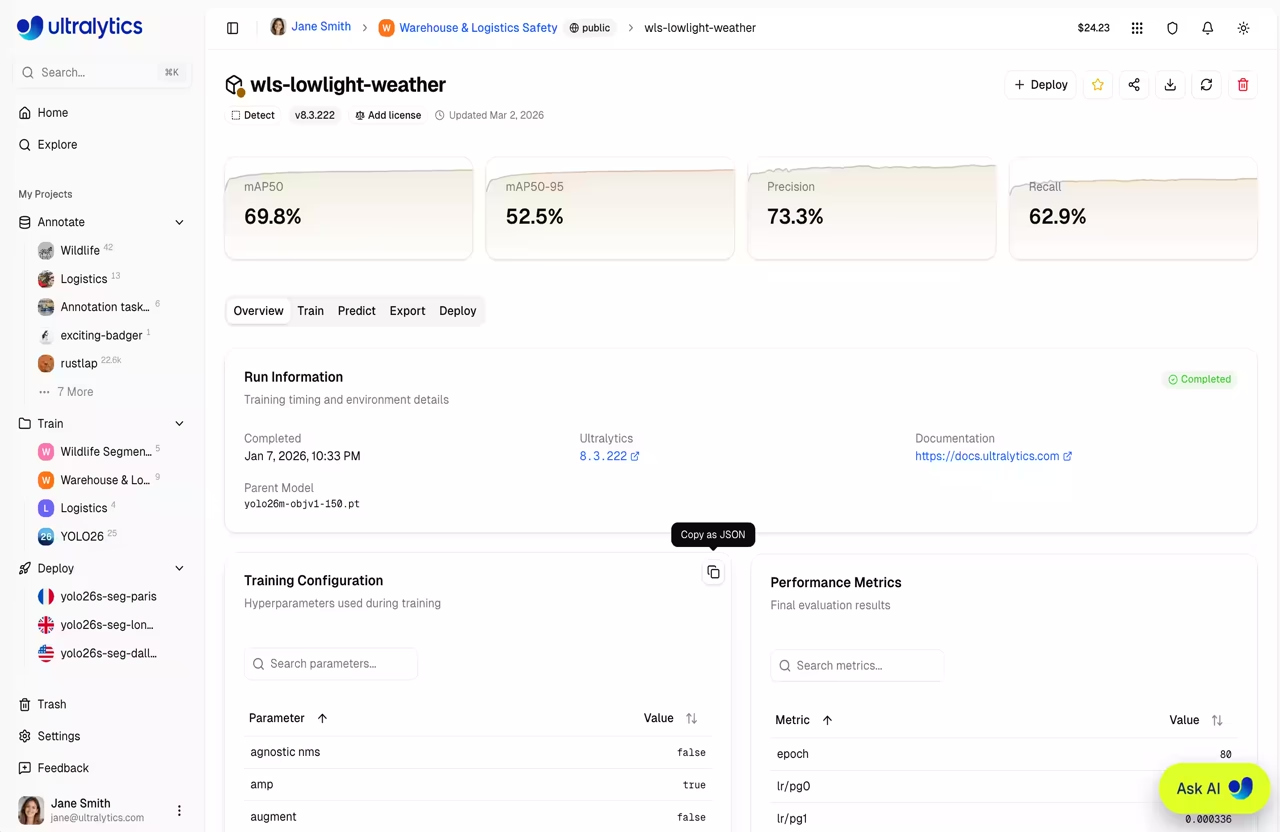

O editor YAML também suporta a importação de configurações de execuções de treinamento anteriores:

- Copy from existing model: Na página de qualquer modelo concluído, o cartão de Configuração de Treinamento possui um botão Copy as JSON. Copie o JSON e cole-o diretamente no editor YAML — ele detecta automaticamente o formato JSON e importa todos os parâmetros.

- Paste YAML or JSON: Cole qualquer configuração de treinamento YAML ou JSON válida no editor. Os parâmetros são validados automaticamente, com valores fora do intervalo sendo ajustados e avisos sendo exibidos.

- Drag and drop files: Arraste um arquivo

.yamlou.jsondiretamente para o editor para importar seus parâmetros.

Isso facilita a reprodução ou iteração em configurações de treinamento anteriores sem a necessidade de inserir manualmente cada parâmetro.

Link to this sectionPosso treinar a partir de uma página de conjunto de dados?#

Sim, o botão Train nas páginas de conjunto de dados abre o diálogo de treinamento com o conjunto de dados pré-selecionado e bloqueado. Em seguida, você seleciona um projeto e um modelo para começar o treinamento.

Link to this sectionReferência de parâmetros de treinamento#

| Parâmetro | Tipo | Predefinição | Intervalo | Descrição |

|---|---|---|---|---|

epochs | int | 100 | 1-10000 | Número de épocas de treinamento |

batch | int | -1 (auto) | -1 a 512 | Tamanho do lote (-1 = ajuste automático à VRAM disponível) |

imgsz | int | 640 | 32-4096 | Tamanho da imagem de entrada |

patience | int | 100 | 1-1000 | Paciência de parada antecipada |

seed | int | 0 | 0-2147483647 | Semente aleatória para reprodutibilidade |

deterministic | bool | True | - | Modo de treinamento determinístico |

amp | bool | True | - | Precisão mista automática |

close_mosaic | int | 10 | 0-50 | Desativar mosaico nas N épocas finais |

save_period | int | -1 | -1-100 | Salvar checkpoint a cada N épocas |

workers | int | 8 | 0-64 | Trabalhadores do carregador de dados |

cache | selecionar | false | ram/disk/false | Cache de imagens |

Alguns parâmetros aplicam-se apenas a tarefas específicas:

- Apenas tarefas de detecção (detect, segment, pose, OBB — não classificar):

box,dfl,degrees,translate,shear,perspective,mosaic,mixup,close_mosaic - Apenas segmentação:

copy_paste - Apenas pose:

pose(peso de perda),kobj(objetividade de pontos-chave)