Краткое руководство по началу работы: NVIDIA Jetson с Ultralytics YOLO26

Это всеобъемлющее руководство представляет подробное пошаговое руководство по развертыванию Ultralytics YOLO26 на устройствах NVIDIA Jetson. Кроме того, оно демонстрирует эталонные показатели производительности, чтобы показать возможности YOLO26 на этих компактных и мощных устройствах.

Новая поддержка продуктов

Мы обновили это руководство с помощью новейшего NVIDIA Jetson AGX Thor Developer Kit, который обеспечивает до 2070 FP4 TFLOPS вычислительной мощности AI и 128 ГБ памяти с настраиваемой мощностью от 40 Вт до 130 Вт. Он обеспечивает более чем в 7,5 раз более высокую вычислительную мощность AI, чем NVIDIA Jetson AGX Orin, с в 3,5 раза лучшей энергоэффективностью для бесперебойной работы самых популярных моделей AI.

Смотреть: Как использовать Ultralytics YOLO26 на устройствах NVIDIA Jetson

Примечание

Это руководство было протестировано с NVIDIA Jetson AGX Thor Developer Kit (Jetson T5000), работающим на последней стабильной версии JetPack JP7.0, NVIDIA Jetson AGX Orin Developer Kit (64GB), работающим на версии JetPack JP6.2, NVIDIA Jetson Orin Nano Super Developer Kit, работающим на версии JetPack JP6.1, Seeed Studio reComputer J4012 на базе NVIDIA Jetson Orin NX 16GB, работающим на версии JetPack JP6.0/ версии JetPack JP5.1.3 и Seeed Studio reComputer J1020 v2 на базе NVIDIA Jetson Nano 4GB, работающим на версии JetPack JP4.6.1. Ожидается, что оно будет работать со всей линейкой оборудования NVIDIA Jetson, включая новейшие и устаревшие устройства.

Что такое NVIDIA Jetson?

NVIDIA Jetson — это серия встраиваемых вычислительных плат, разработанных для обеспечения ускоренных вычислений ИИ (искусственного интеллекта) на периферийных устройствах. Эти компактные и мощные устройства построены на архитектуре GPU NVIDIA и могут запускать сложные алгоритмы ИИ и модели глубокого обучения непосредственно на устройстве, без использования ресурсов облачных вычислений. Платы Jetson часто используются в робототехнике, автономных транспортных средствах, промышленной автоматизации и других приложениях, где вывод ИИ должен выполняться локально с низкой задержкой и высокой эффективностью. Кроме того, эти платы основаны на архитектуре ARM64 и потребляют меньше энергии по сравнению с традиционными вычислительными устройствами на GPU.

Сравнение серий NVIDIA Jetson

NVIDIA Jetson AGX Thor — это последняя итерация семейства NVIDIA Jetson, основанная на архитектуре NVIDIA Blackwell, которая значительно улучшает производительность ИИ по сравнению с предыдущими поколениями. В таблице ниже сравниваются некоторые устройства Jetson в экосистеме.

| Jetson AGX Thor(T5000) | Jetson AGX Orin 64GB | Jetson Orin NX 16GB | Jetson Orin Nano Super | Jetson AGX Xavier | Jetson Xavier NX | Jetson Nano | |

|---|---|---|---|---|---|---|---|

| Производительность ИИ | 2070 TFLOPS | 275 TOPS | 100 TOPS | 67 TOPS | 32 TOPS | 21 TOPS | 472 GFLOPS |

| GPU | 2560-ядерный NVIDIA GPU с архитектурой Blackwell и 96 Tensor Cores | GPU NVIDIA Ampere с 2048 ядрами и 64 тензорными ядрами | GPU NVIDIA Ampere с 1024 ядрами и 32 тензорными ядрами | GPU NVIDIA Ampere с 1024 ядрами и 32 тензорными ядрами | GPU NVIDIA Volta с 512 ядрами и 64 тензорными ядрами | GPU NVIDIA Volta™ с 384 ядрами и 48 тензорными ядрами | GPU NVIDIA Maxwell™ с 128 ядрами |

| Максимальная частота GPU | 1.57 ГГц | 1.3 ГГц | 918 МГц | 1020 МГц | 1377 МГц | 1100 МГц | 921 МГц |

| CPU | 14-core Arm® Neoverse®-V3AE 64-bit CPU 1MB L2 + 16MB L3 | 12-ядерный NVIDIA Arm® Cortex A78AE v8.2 64-bit CPU 3MB L2 + 6MB L3 | 8-ядерный NVIDIA Arm® Cortex A78AE v8.2 64-bit CPU 2MB L2 + 4MB L3 | 6-ядерный Arm® Cortex®-A78AE v8.2 64-bit CPU 1.5MB L2 + 4MB L3 | 8-ядерный NVIDIA Carmel Arm®v8.2 64-bit CPU 8MB L2 + 4MB L3 | 6-ядерный NVIDIA Carmel Arm®v8.2 64-bit CPU 6MB L2 + 4MB L3 | Четырехъядерный процессор Arm® Cortex®-A57 MPCore |

| Максимальная частота CPU | 2.6 ГГц | 2.2 ГГц | 2.0 ГГц | 1.7 ГГц | 2.2 ГГц | 1.9 ГГц | 1,43 ГГц |

| Память | 128GB 256-bit LPDDR5X 273GB/s | 64 ГБ 256-bit LPDDR5 204.8 ГБ/с | 16 ГБ 128-bit LPDDR5 102.4 ГБ/с | 8GB 128-bit LPDDR5 102 GB/s | 32 ГБ 256-bit LPDDR4x 136.5 ГБ/с | 8 ГБ 128-bit LPDDR4x 59.7 ГБ/с | 4GB 64-bit LPDDR4 25.6GB/s |

Более подробную таблицу сравнения можно найти в разделе Compare Specifications на официальной странице NVIDIA Jetson.

Что такое NVIDIA JetPack?

NVIDIA JetPack SDK, лежащий в основе модулей Jetson, является наиболее полным решением и предоставляет полноценную среду разработки для создания комплексных ускоренных AI-приложений и сокращает время выхода на рынок. JetPack включает Jetson Linux с загрузчиком, ядро Linux, среду рабочего стола Ubuntu и полный набор библиотек для ускорения GPU-вычислений, мультимедиа, графики и компьютерного зрения. Он также включает в себя примеры, документацию и инструменты разработчика как для хост-компьютера, так и для комплекта разработчика, и поддерживает SDK более высокого уровня, такие как DeepStream для потоковой аналитики видео, Isaac для робототехники и Riva для разговорного AI.

Прошивка JetPack на NVIDIA Jetson

Первый шаг после приобретения устройства NVIDIA Jetson — это прошивка NVIDIA JetPack на устройство. Существует несколько различных способов прошивки устройств NVIDIA Jetson.

- Если у вас есть официальный комплект для разработки NVIDIA, такой как Jetson AGX Thor Developer Kit, вы можете загрузить образ и подготовить загрузочную USB-флешку для прошивки JetPack на прилагаемый SSD.

- Если у вас есть официальный комплект разработчика NVIDIA, такой как Jetson Orin Nano Developer Kit, вы можете загрузить образ и подготовить SD-карту с JetPack для загрузки устройства.

- Если у вас есть какой-либо другой комплект разработчика NVIDIA, вы можете прошить JetPack на устройство с помощью SDK Manager.

- Если у вас есть устройство Seeed Studio reComputer J4012, вы можете прошить JetPack на прилагаемый SSD, а если у вас есть устройство Seeed Studio reComputer J1020 v2, вы можете прошить JetPack на eMMC/ SSD.

- Если у вас есть какое-либо другое стороннее устройство на базе модуля NVIDIA Jetson, рекомендуется использовать прошивку через командную строку.

Примечание

Для методов 1, 4 и 5, после прошивки системы и загрузки устройства, пожалуйста, введите "sudo apt update && sudo apt install nvidia-jetpack -y" в терминале устройства, чтобы установить все остальные необходимые компоненты JetPack.

Поддержка JetPack в зависимости от устройства Jetson

В таблице ниже показаны версии NVIDIA JetPack, поддерживаемые различными устройствами NVIDIA Jetson.

| JetPack 4 | JetPack 5 | JetPack 6 | JetPack 7 | |

|---|---|---|---|---|

| Jetson Nano | ✅ | ❌ | ❌ | ❌ |

| Jetson TX2 | ✅ | ❌ | ❌ | ❌ |

| Jetson Xavier NX | ✅ | ✅ | ❌ | ❌ |

| Jetson AGX Xavier | ✅ | ✅ | ❌ | ❌ |

| Jetson AGX Orin | ❌ | ✅ | ✅ | ❌ |

| Jetson Orin NX | ❌ | ✅ | ✅ | ❌ |

| Jetson Orin Nano | ❌ | ✅ | ✅ | ❌ |

| Jetson AGX Thor | ❌ | ❌ | ❌ | ✅ |

Быстрый старт с Docker

Самый быстрый способ начать работу с Ultralytics YOLO26 на NVIDIA Jetson — это запустить его с предварительно собранными образами Docker для Jetson. Обратитесь к таблице выше и выберите версию JetPack в соответствии с имеющимся у вас устройством Jetson.

t=ultralytics/ultralytics:latest-jetson-jetpack4

sudo docker pull $t && sudo docker run -it --ipc=host --runtime=nvidia $t

t=ultralytics/ultralytics:latest-jetson-jetpack5

sudo docker pull $t && sudo docker run -it --ipc=host --runtime=nvidia $t

t=ultralytics/ultralytics:latest-jetson-jetpack6

sudo docker pull $t && sudo docker run -it --ipc=host --runtime=nvidia $t

t=ultralytics/ultralytics:latest-nvidia-arm64

sudo docker pull $t && sudo docker run -it --ipc=host --runtime=nvidia $t

После этого перейдите к разделу Использование TensorRT на NVIDIA Jetson.

Начало с собственной установки

Для нативной установки без Docker, пожалуйста, обратитесь к шагам ниже.

Запуск на JetPack 7.0

Установка пакета Ultralytics

Здесь мы установим пакет Ultralytics на Jetson с необязательными зависимостями, чтобы мы могли экспортировать модели PyTorch в другие различные форматы. Мы в основном сосредоточимся на экспорте NVIDIA TensorRT, потому что TensorRT позволит нам получить максимальную производительность от устройств Jetson.

Обновите список пакетов, установите pip и обновите до последней версии

sudo apt update sudo apt install python3-pip -y pip install -U pipУстановите

ultralyticsпакет pip с необязательными зависимостямиpip install ultralytics[export]Перезагрузите устройство

sudo reboot

Установка PyTorch и Torchvision

Приведенная выше установка ultralytics установит Torch и Torchvision. Однако эти 2 пакета, установленные через pip, несовместимы для работы на Jetson AGX Thor, который поставляется с JetPack 7.0 и CUDA 13. Поэтому нам необходимо установить их вручную.

Установите torch и torchvision согласно JP7.0

pip install torch torchvision --index-url https://download.pytorch.org/whl/cu130

Установите onnxruntime-gpu

Параметр onnxruntime-gpu пакет, размещенный в PyPI, не имеет aarch64 бинарных файлов для Jetson. Поэтому нам нужно вручную установить этот пакет. Этот пакет необходим для некоторых экспортов.

Здесь мы скачаем и установим onnxruntime-gpu 1.24.0 с Python3.12 поддержкой.

pip install https://github.com/ultralytics/assets/releases/download/v0.0.0/onnxruntime_gpu-1.24.0-cp312-cp312-linux_aarch64.whl

Запуск на JetPack 6.1

Установка пакета Ultralytics

Здесь мы установим пакет Ultralytics на Jetson с необязательными зависимостями, чтобы мы могли экспортировать модели PyTorch в другие различные форматы. Мы в основном сосредоточимся на экспорте NVIDIA TensorRT, потому что TensorRT позволит нам получить максимальную производительность от устройств Jetson.

Обновите список пакетов, установите pip и обновите до последней версии

sudo apt update sudo apt install python3-pip -y pip install -U pipУстановите

ultralyticsпакет pip с необязательными зависимостямиpip install ultralytics[export]Перезагрузите устройство

sudo reboot

Установка PyTorch и Torchvision

Приведенная выше установка ultralytics установит Torch и Torchvision. Однако эти два пакета, установленные через pip, несовместимы с платформой Jetson, которая основана на архитектуре ARM64. Поэтому нам необходимо вручную установить предварительно собранный pip wheel PyTorch и скомпилировать или установить Torchvision из исходного кода.

Установите torch 2.10.0 и torchvision 0.25.0 согласно JP6.1

pip install https://github.com/ultralytics/assets/releases/download/v0.0.0/torch-2.10.0-cp310-cp310-linux_aarch64.whl

pip install https://github.com/ultralytics/assets/releases/download/v0.0.0/torchvision-0.25.0-cp310-cp310-linux_aarch64.whl

Примечание

Посетите страницу PyTorch для Jetson, чтобы получить доступ ко всем различным версиям PyTorch для разных версий JetPack. Для получения более подробного списка совместимости PyTorch и Torchvision посетите страницу совместимости PyTorch и Torchvision.

Установите cuDSS чтобы исправить проблему с зависимостями с torch 2.10.0

wget https://developer.download.nvidia.com/compute/cudss/0.7.1/local_installers/cudss-local-tegra-repo-ubuntu2204-0.7.1_0.7.1-1_arm64.deb

sudo dpkg -i cudss-local-tegra-repo-ubuntu2204-0.7.1_0.7.1-1_arm64.deb

sudo cp /var/cudss-local-tegra-repo-ubuntu2204-0.7.1/cudss-*-keyring.gpg /usr/share/keyrings/

sudo apt-get update

sudo apt-get -y install cudss

Установите onnxruntime-gpu

Параметр onnxruntime-gpu пакет, размещенный в PyPI, не имеет aarch64 бинарных файлов для Jetson. Поэтому нам нужно вручную установить этот пакет. Этот пакет необходим для некоторых экспортов.

Вы можете найти все доступные onnxruntime-gpu packages — с разбивкой по версии JetPack, версии Python и другим деталям совместимости — в Jetson Zoo ONNX Runtime compatibility matrix.

Для JetPack 6 с Python 3.10 поддержку, вы можете установить onnxruntime-gpu 1.23.0:

pip install https://github.com/ultralytics/assets/releases/download/v0.0.0/onnxruntime_gpu-1.23.0-cp310-cp310-linux_aarch64.whl

В качестве альтернативы, для onnxruntime-gpu 1.20.0:

pip install https://github.com/ultralytics/assets/releases/download/v0.0.0/onnxruntime_gpu-1.20.0-cp310-cp310-linux_aarch64.whl

Запуск на JetPack 5.1.2

Установка пакета Ultralytics

Здесь мы установим пакет Ultralytics на Jetson с дополнительными зависимостями, чтобы мы могли экспортировать модели PyTorch в другие различные форматы. Мы сосредоточимся в основном на экспорте NVIDIA TensorRT, потому что TensorRT позволит нам получить максимальную производительность от устройств Jetson.

Обновите список пакетов, установите pip и обновите до последней версии

sudo apt update sudo apt install python3-pip -y pip install -U pipУстановите

ultralyticsпакет pip с необязательными зависимостямиpip install ultralytics[export]Перезагрузите устройство

sudo reboot

Установка PyTorch и Torchvision

Приведенная выше установка ultralytics установит Torch и Torchvision. Однако эти два пакета, установленные через pip, несовместимы с платформой Jetson, которая основана на архитектуре ARM64. Поэтому нам необходимо вручную установить предварительно собранный pip wheel PyTorch и скомпилировать или установить Torchvision из исходного кода.

Удалите установленные в данный момент PyTorch и Torchvision

pip uninstall torch torchvisionУстановите

torch 2.1.0иtorchvision 0.16.2согласно JP5.1.2pip install https://github.com/ultralytics/assets/releases/download/v0.0.0/torch-2.1.0a0+41361538.nv23.06-cp38-cp38-linux_aarch64.whl pip install https://github.com/ultralytics/assets/releases/download/v0.0.0/torchvision-0.16.2+c6f3977-cp38-cp38-linux_aarch64.whl

Примечание

Посетите страницу PyTorch для Jetson, чтобы получить доступ ко всем различным версиям PyTorch для разных версий JetPack. Для получения более подробного списка совместимости PyTorch и Torchvision посетите страницу совместимости PyTorch и Torchvision.

Установите onnxruntime-gpu

Параметр onnxruntime-gpu пакет, размещенный в PyPI, не имеет aarch64 бинарных файлов для Jetson. Поэтому нам нужно вручную установить этот пакет. Этот пакет необходим для некоторых экспортов.

Вы можете найти все доступные onnxruntime-gpu packages — с разбивкой по версии JetPack, версии Python и другим деталям совместимости — в Jetson Zoo ONNX Runtime compatibility matrixЗдесь мы загрузим и установим onnxruntime-gpu 1.17.0 с Python3.8 поддержкой.

wget https://nvidia.box.com/shared/static/zostg6agm00fb6t5uisw51qi6kpcuwzd.whl -O onnxruntime_gpu-1.17.0-cp38-cp38-linux_aarch64.whl

pip install onnxruntime_gpu-1.17.0-cp38-cp38-linux_aarch64.whl

Примечание

onnxruntime-gpu автоматически вернет версию numpy к последней. Поэтому нам нужно переустановить numpy до 1.23.5 чтобы исправить проблему, выполнив:

pip install numpy==1.23.5

Использование TensorRT на NVIDIA Jetson

Среди всех форматов экспорта моделей, поддерживаемых Ultralytics, TensorRT предлагает самую высокую производительность вывода на устройствах NVIDIA Jetson, что делает его нашей главной рекомендацией для развертываний Jetson. Инструкции по настройке и расширенному использованию см. в нашем специальном руководстве по интеграции TensorRT.

Преобразование модели в TensorRT и запуск вывода

Модель YOLO26n в формате PyTorch преобразуется в TensorRT для выполнения инференса с экспортированной моделью.

Пример

from ultralytics import YOLO

# Load a YOLO26n PyTorch model

model = YOLO("yolo26n.pt")

# Export the model to TensorRT

model.export(format="engine") # creates 'yolo26n.engine'

# Load the exported TensorRT model

trt_model = YOLO("yolo26n.engine")

# Run inference

results = trt_model("https://ultralytics.com/images/bus.jpg")

# Export a YOLO26n PyTorch model to TensorRT format

yolo export model=yolo26n.pt format=engine # creates 'yolo26n.engine'

# Run inference with the exported model

yolo predict model=yolo26n.engine source='https://ultralytics.com/images/bus.jpg'

Примечание

Посетите страницу экспорта, чтобы получить доступ к дополнительным аргументам при экспорте моделей в различные форматы.

Использование NVIDIA Deep Learning Accelerator (DLA)

NVIDIA Deep Learning Accelerator (DLA) — это специализированный аппаратный компонент, встроенный в устройства NVIDIA Jetson, который оптимизирует вывод глубокого обучения для повышения энергоэффективности и производительности. Перенося задачи с GPU (освобождая его для более интенсивных процессов), DLA позволяет моделям работать с меньшим энергопотреблением, сохраняя при этом высокую пропускную способность, что идеально подходит для встроенных систем и приложений искусственного интеллекта в реальном времени.

Следующие устройства Jetson оснащены аппаратным обеспечением DLA:

| Устройство Jetson | Ядра DLA | Максимальная частота DLA |

|---|---|---|

| Серия Jetson AGX Orin | 2 | 1.6 ГГц |

| Jetson Orin NX 16GB | 2 | 614 МГц |

| Jetson Orin NX 8GB | 1 | 614 МГц |

| Серия Jetson AGX Xavier | 2 | 1.4 ГГц |

| Серия Jetson Xavier NX | 2 | 1.1 ГГц |

Пример

from ultralytics import YOLO

# Load a YOLO26n PyTorch model

model = YOLO("yolo26n.pt")

# Export the model to TensorRT with DLA enabled (only works with FP16 or INT8)

model.export(format="engine", device="dla:0", half=True) # dla:0 or dla:1 corresponds to the DLA cores

# Load the exported TensorRT model

trt_model = YOLO("yolo26n.engine")

# Run inference

results = trt_model("https://ultralytics.com/images/bus.jpg")

# Export a YOLO26n PyTorch model to TensorRT format with DLA enabled (only works with FP16 or INT8)

# Once DLA core number is specified at export, it will use the same core at inference

yolo export model=yolo26n.pt format=engine device="dla:0" half=True # dla:0 or dla:1 corresponds to the DLA cores

# Run inference with the exported model on the DLA

yolo predict model=yolo26n.engine source='https://ultralytics.com/images/bus.jpg'

Примечание

При использовании экспорта DLA некоторые слои могут не поддерживаться для работы на DLA и будут переключаться на GPU для выполнения. Этот откат может привести к дополнительной задержке и повлиять на общую производительность логического вывода. Поэтому DLA в первую очередь предназначен не для уменьшения задержки логического вывода по сравнению с TensorRT, работающим полностью на GPU. Вместо этого его основная цель — увеличить пропускную способность и повысить энергоэффективность.

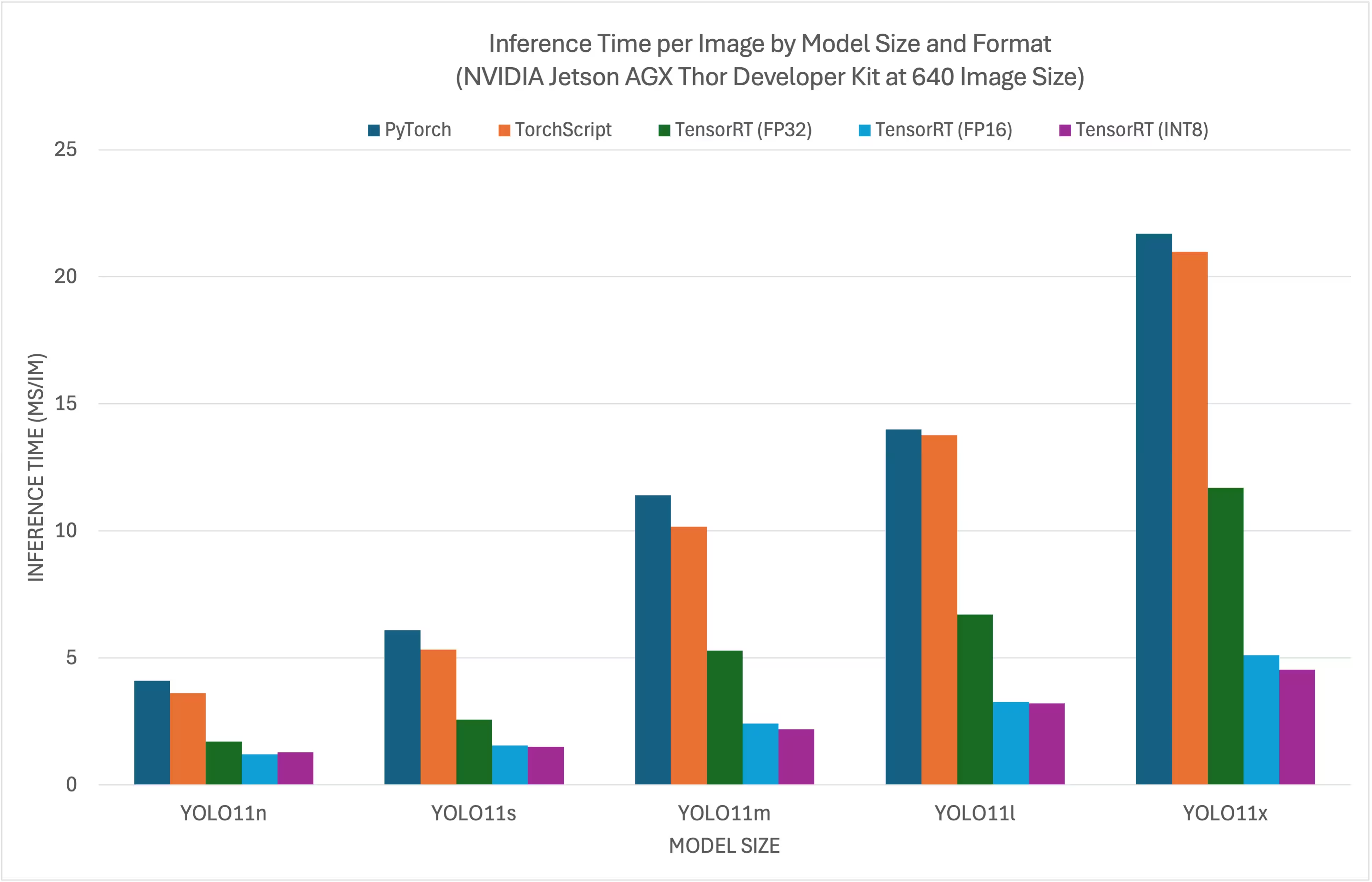

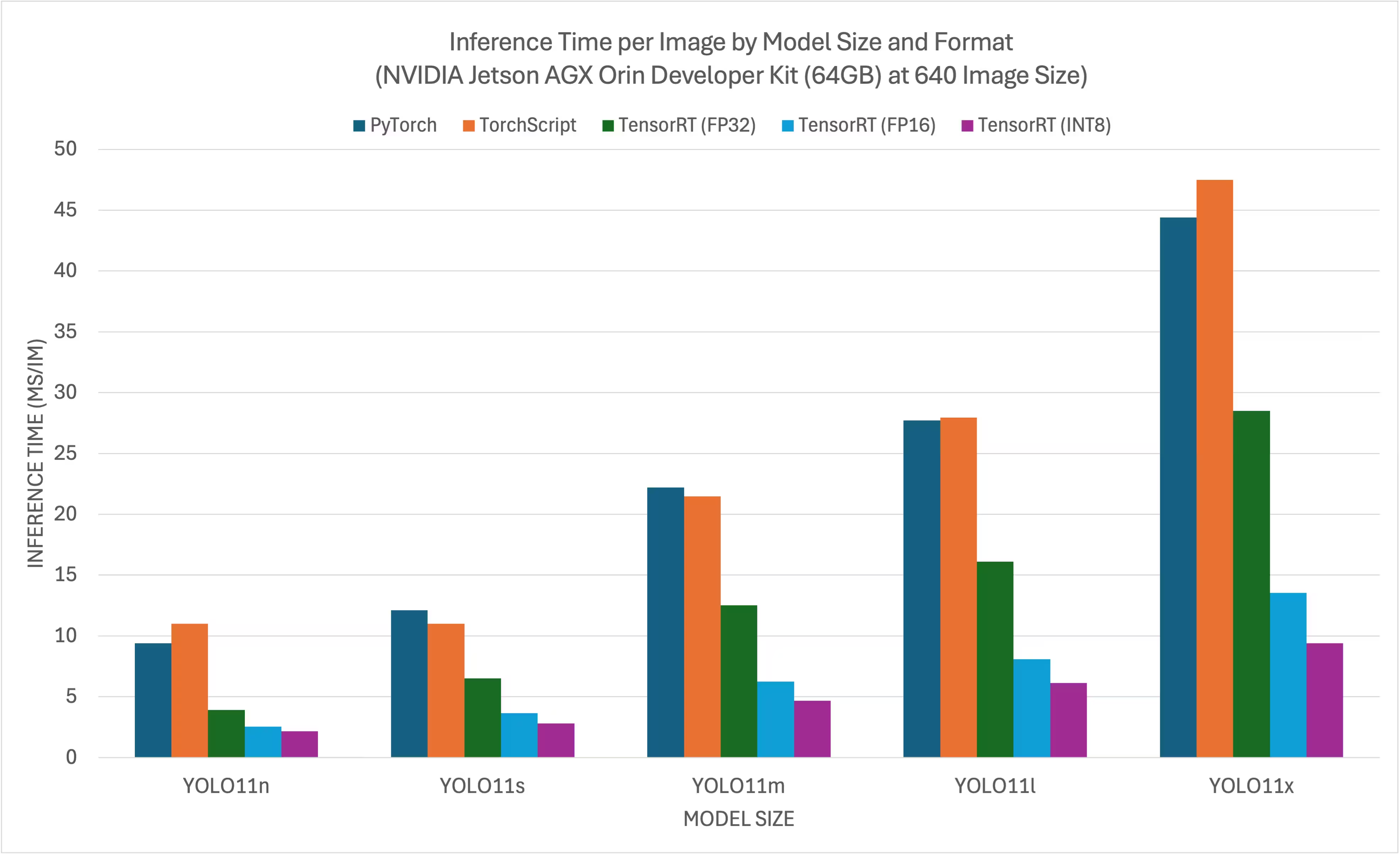

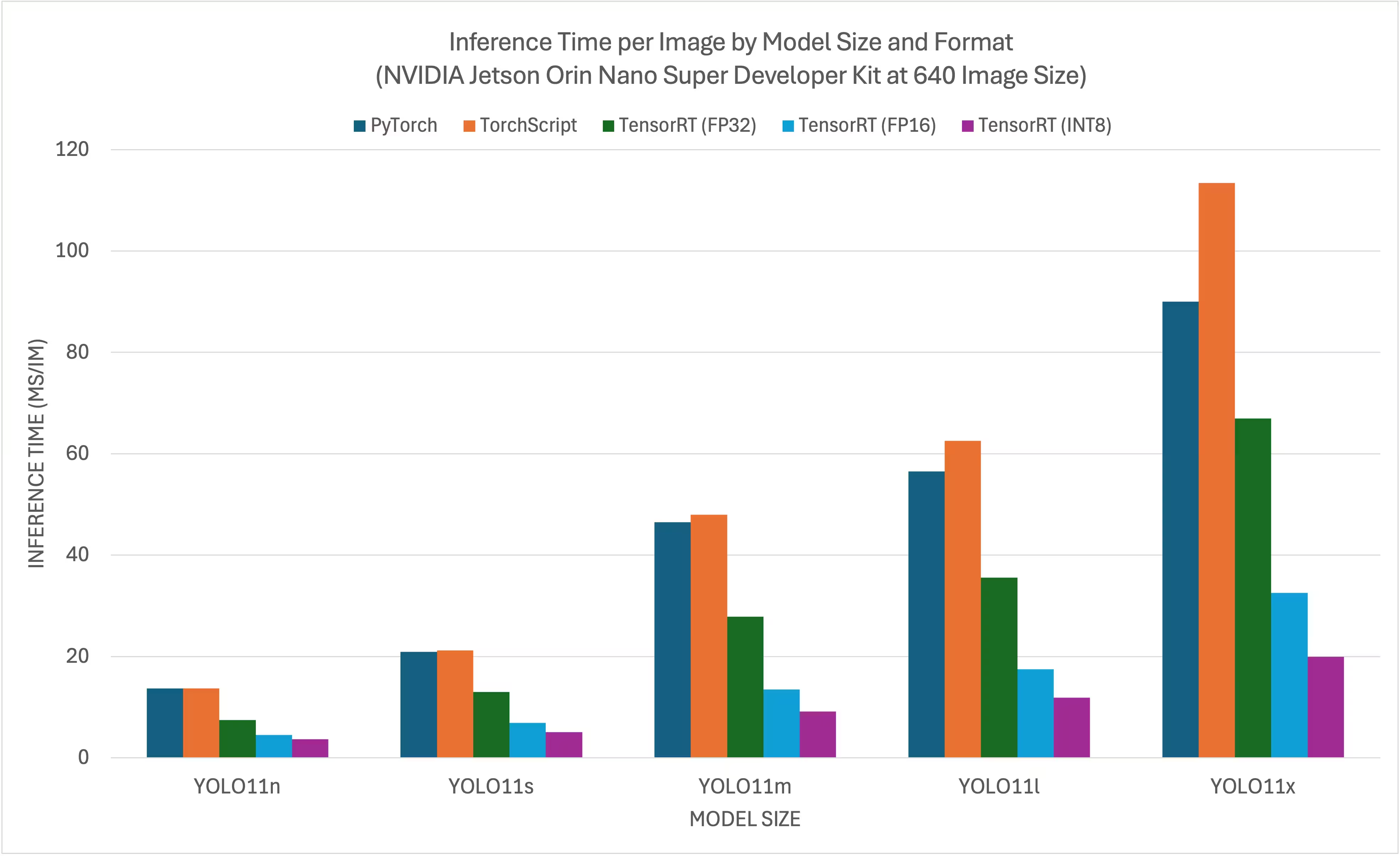

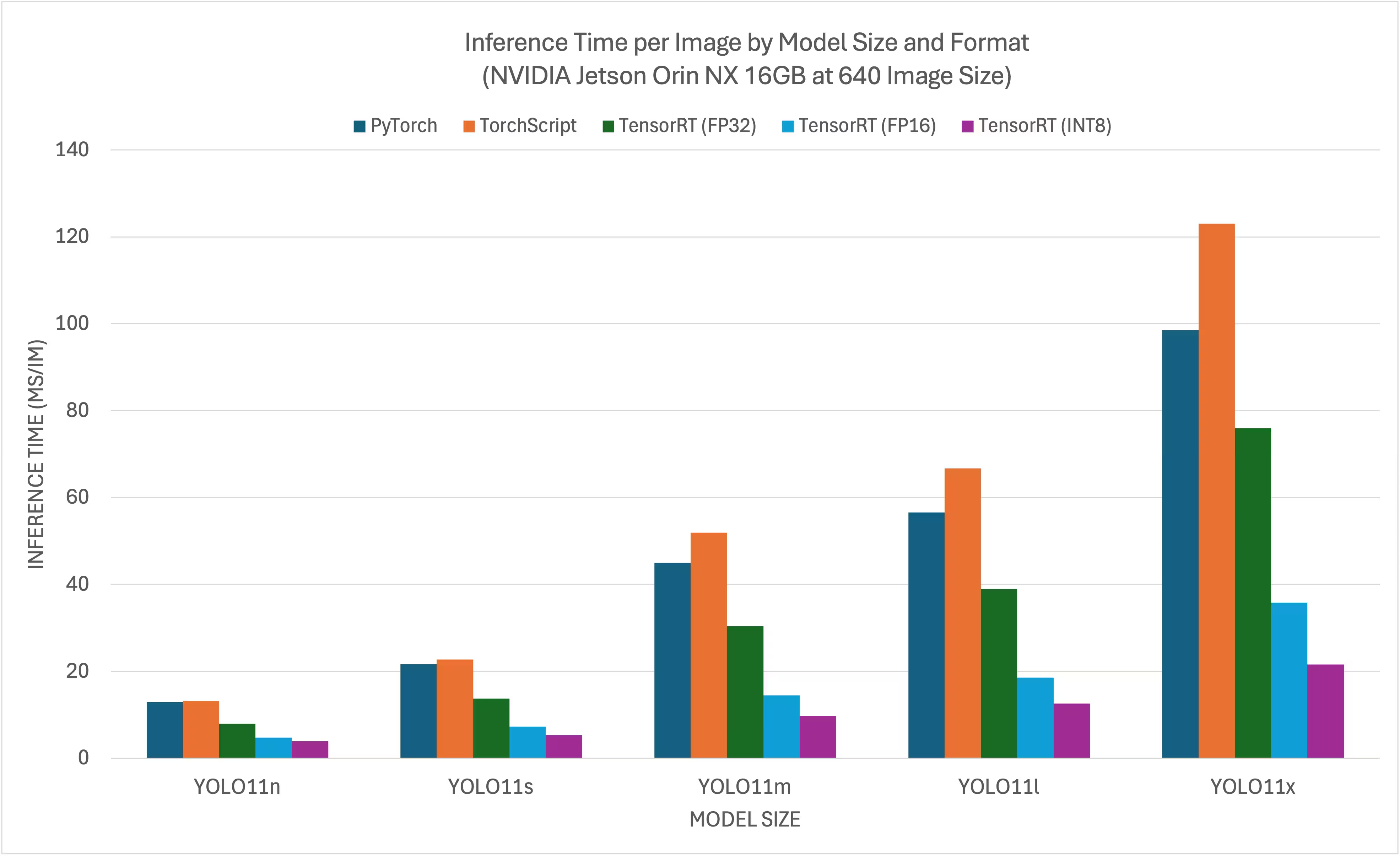

Бенчмарки NVIDIA Jetson YOLO11/YOLO26

Бенчмарки YOLO11/YOLO26 были проведены командой Ultralytics на 11 различных форматах моделей, измеряя скорость и точность: PyTorch, TorchScript, ONNX, OpenVINO, TensorRT, TF SavedModel, TF GraphDef, TF Lite, MNN, NCNN, ExecuTorch. Бенчмарки были запущены на NVIDIA Jetson AGX Thor Developer Kit, NVIDIA Jetson AGX Orin Developer Kit (64GB), NVIDIA Jetson Orin Nano Super Developer Kit и Seeed Studio reComputer J4012 на базе устройства Jetson Orin NX 16GB с точностью FP32 точность и размером входного изображения по умолчанию 640.

Сравнительные графики

Хотя все экспорты моделей работают на NVIDIA Jetson, мы включили только PyTorch, TorchScript, TensorRT в сравнительную таблицу ниже, поскольку они используют GPU на Jetson и гарантированно дают наилучшие результаты. Все остальные экспорты используют только CPU, и их производительность не так хороша, как у вышеупомянутых трех. Вы можете найти бенчмарки для всех экспортов в разделе после этой таблицы.

Комплект разработчика NVIDIA Jetson AGX Thor

NVIDIA Jetson AGX Orin Developer Kit (64GB)

NVIDIA Jetson Orin Nano Super Developer Kit

NVIDIA Jetson Orin NX 16GB

Подробные сравнительные таблицы

В таблице ниже представлены результаты бенчмаркинга для пяти различных моделей (YOLO11n, YOLO11s, YOLO11m, YOLO11l, YOLO11x) в 11 различных форматах (PyTorch, TorchScript, ONNX, OpenVINO, TensorRT, TF SavedModel, TF GraphDef, TF Lite, MNN, NCNN, ExecuTorch), показывающие статус, размер, метрику mAP50-95(B) и время инференса для каждой комбинации.

Комплект разработчика NVIDIA Jetson AGX Thor

Производительность

| Формат | Статус | Размер на диске (МБ) | mAP50-95(B) | Время инференса (мс/изобр.) |

|---|---|---|---|---|

| PyTorch | ✅ | 5.3 | 0.4798 | 7.39 |

| TorchScript | ✅ | 9.8 | 0.4789 | 4.21 |

| ONNX | ✅ | 9.5 | 0.4767 | 6.58 |

| OpenVINO | ✅ | 10.1 | 0.4794 | 17.50 |

| TensorRT (FP32) | ✅ | 13.9 | 0.4791 | 1.90 |

| TensorRT (FP16) | ✅ | 7.6 | 0.4797 | 1.39 |

| TensorRT (INT8) | ✅ | 6.5 | 0.4273 | 1.52 |

| TF SavedModel | ✅ | 25.7 | 0.4764 | 47.24 |

| TF GraphDef | ✅ | 9.5 | 0.4764 | 45.98 |

| TF Lite | ✅ | 9.9 | 0.4764 | 182.04 |

| MNN | ✅ | 9.4 | 0.4784 | 21.83 |

| Формат | Статус | Размер на диске (МБ) | mAP50-95(B) | Время инференса (мс/изобр.) |

|---|---|---|---|---|

| PyTorch | ✅ | 19.5 | 0.5738 | 7.99 |

| TorchScript | ✅ | 36.8 | 0.5664 | 6.01 |

| ONNX | ✅ | 36.5 | 0.5666 | 9.31 |

| OpenVINO | ✅ | 38.5 | 0.5656 | 35.56 |

| TensorRT (FP32) | ✅ | 38.9 | 0.5664 | 2.95 |

| TensorRT (FP16) | ✅ | 21.0 | 0.5650 | 1.77 |

| TensorRT (INT8) | ✅ | 13.5 | 0.5010 | 1.75 |

| TF SavedModel | ✅ | 96.6 | 0.5665 | 88.87 |

| TF GraphDef | ✅ | 36.5 | 0.5665 | 89.20 |

| TF Lite | ✅ | 36.9 | 0.5665 | 604.25 |

| MNN | ✅ | 36.4 | 0.5651 | 53.75 |

| Формат | Статус | Размер на диске (МБ) | mAP50-95(B) | Время инференса (мс/изобр.) |

|---|---|---|---|---|

| PyTorch | ✅ | 42.2 | 0.6237 | 10.76 |

| TorchScript | ✅ | 78.5 | 0.6217 | 10.57 |

| ONNX | ✅ | 78.2 | 0.6211 | 14.91 |

| OpenVINO | ✅ | 82.2 | 0.6204 | 86.27 |

| TensorRT (FP32) | ✅ | 82.2 | 0.6230 | 5.56 |

| TensorRT (FP16) | ✅ | 41.6 | 0.6209 | 2.58 |

| TensorRT (INT8) | ✅ | 24.3 | 0.5595 | 2.49 |

| TF SavedModel | ✅ | 205.8 | 0.6229 | 200.96 |

| TF GraphDef | ✅ | 78.2 | 0.6229 | 203.00 |

| TF Lite | ✅ | 78.6 | 0.6229 | 1867.12 |

| MNN | ✅ | 78.0 | 0.6176 | 142.00 |

| Формат | Статус | Размер на диске (МБ) | mAP50-95(B) | Время инференса (мс/изобр.) |

|---|---|---|---|---|

| PyTorch | ✅ | 50.7 | 0.6258 | 13.34 |

| TorchScript | ✅ | 95.5 | 0.6248 | 13.86 |

| ONNX | ✅ | 95.0 | 0.6247 | 18.44 |

| OpenVINO | ✅ | 99.9 | 0.6238 | 106.67 |

| TensorRT (FP32) | ✅ | 99.0 | 0.6249 | 6.74 |

| TensorRT (FP16) | ✅ | 50.3 | 0.6243 | 3.34 |

| TensorRT (INT8) | ✅ | 29.0 | 0.5708 | 3.24 |

| TF SavedModel | ✅ | 250.0 | 0.6245 | 259.74 |

| TF GraphDef | ✅ | 95.0 | 0.6245 | 263.42 |

| TF Lite | ✅ | 95.4 | 0.6245 | 2367.83 |

| MNN | ✅ | 94.8 | 0.6272 | 174.39 |

| Формат | Статус | Размер на диске (МБ) | mAP50-95(B) | Время инференса (мс/изобр.) |

|---|---|---|---|---|

| PyTorch | ✅ | 113.2 | 0.6565 | 20.92 |

| TorchScript | ✅ | 213.5 | 0.6595 | 21.76 |

| ONNX | ✅ | 212.9 | 0.6590 | 26.72 |

| OpenVINO | ✅ | 223.6 | 0.6620 | 205.27 |

| TensorRT (FP32) | ✅ | 217.2 | 0.6593 | 12.29 |

| TensorRT (FP16) | ✅ | 112.1 | 0.6611 | 5.16 |

| TensorRT (INT8) | ✅ | 58.9 | 0.5222 | 4.72 |

| TF SavedModel | ✅ | 559.2 | 0.6593 | 498.85 |

| TF GraphDef | ✅ | 213.0 | 0.6593 | 507.43 |

| TF Lite | ✅ | 213.3 | 0.6593 | 5134.22 |

| MNN | ✅ | 212.8 | 0.6625 | 347.84 |

Протестировано с Ultralytics 8.4.7

Примечание

Время логического вывода не включает предварительную/постобработку.

NVIDIA Jetson AGX Orin Developer Kit (64GB)

Производительность

| Формат | Статус | Размер на диске (МБ) | mAP50-95(B) | Время инференса (мс/изобр.) |

|---|---|---|---|---|

| PyTorch | ✅ | 5.3 | 0.4790 | 11.58 |

| TorchScript | ✅ | 9.8 | 0.4770 | 4.60 |

| ONNX | ✅ | 9.5 | 0.4770 | 9.87 |

| OpenVINO | ✅ | 9.6 | 0.4820 | 28.80 |

| TensorRT (FP32) | ✅ | 11.5 | 0.0450 | 4.18 |

| TensorRT (FP16) | ✅ | 7.9 | 0.0450 | 2.62 |

| TensorRT (INT8) | ✅ | 5.4 | 0.4640 | 2.30 |

| TF SavedModel | ✅ | 24.6 | 0.4760 | 71.10 |

| TF GraphDef | ✅ | 9.5 | 0.4760 | 70.02 |

| TF Lite | ✅ | 9.9 | 0.4760 | 227.94 |

| MNN | ✅ | 9.4 | 0.4760 | 32.46 |

| NCNN | ✅ | 9.3 | 0.4810 | 29.93 |

| Формат | Статус | Размер на диске (МБ) | mAP50-95(B) | Время инференса (мс/изобр.) |

|---|---|---|---|---|

| PyTorch | ✅ | 20.0 | 0.5730 | 13.18 |

| TorchScript | ✅ | 36.8 | 0.5670 | 11.48 |

| ONNX | ✅ | 36.5 | 0.5660 | 13.47 |

| OpenVINO | ✅ | 36.7 | 0.5650 | 58.30 |

| TensorRT (FP32) | ✅ | 38.5 | 0.5660 | 6.82 |

| TensorRT (FP16) | ✅ | 21.9 | 0.5660 | 3.76 |

| TensorRT (INT8) | ✅ | 12.5 | 0.5480 | 2.98 |

| TF SavedModel | ✅ | 92.2 | 0.5660 | 145.62 |

| TF GraphDef | ✅ | 36.5 | 0.5660 | 146.26 |

| TF Lite | ✅ | 36.9 | 0.5660 | 753.52 |

| MNN | ✅ | 36.4 | 0.5650 | 79.50 |

| NCNN | ✅ | 36.4 | 0.5700 | 58.73 |

| Формат | Статус | Размер на диске (МБ) | mAP50-95(B) | Время инференса (мс/изобр.) |

|---|---|---|---|---|

| PyTorch | ✅ | 43.0 | 0.6220 | 19.36 |

| TorchScript | ✅ | 78.5 | 0.6230 | 20.02 |

| ONNX | ✅ | 78.2 | 0.6230 | 25.40 |

| OpenVINO | ✅ | 78.3 | 0.6190 | 130.76 |

| TensorRT (FP32) | ✅ | 80.2 | 0.6220 | 12.60 |

| TensorRT (FP16) | ✅ | 42.5 | 0.6220 | 6.24 |

| TensorRT (INT8) | ✅ | 23.4 | 0.5820 | 4.72 |

| TF SavedModel | ✅ | 196.3 | 0.6230 | 306.76 |

| TF GraphDef | ✅ | 78.2 | 0.6230 | 314.23 |

| TF Lite | ✅ | 78.5 | 0.6230 | 2331.63 |

| MNN | ✅ | 78.0 | 0.6220 | 206.93 |

| NCNN | ✅ | 78.0 | 0.6220 | 143.03 |

| Формат | Статус | Размер на диске (МБ) | mAP50-95(B) | Время инференса (мс/изобр.) |

|---|---|---|---|---|

| PyTorch | ✅ | 51.0 | 0.6230 | 23.53 |

| TorchScript | ✅ | 95.5 | 0.6250 | 24.23 |

| ONNX | ✅ | 95.0 | 0.6250 | 31.73 |

| OpenVINO | ✅ | 95.3 | 0.6240 | 162.80 |

| TensorRT (FP32) | ✅ | 97.3 | 0.6250 | 15.90 |

| TensorRT (FP16) | ✅ | 51.4 | 0.6240 | 7.93 |

| TensorRT (INT8) | ✅ | 29.9 | 0.5920 | 5.97 |

| TF SavedModel | ✅ | 238.4 | 0.6250 | 394.30 |

| TF GraphDef | ✅ | 95.0 | 0.6250 | 398.63 |

| TF Lite | ✅ | 95.4 | 0.6250 | 2925.27 |

| MNN | ✅ | 94.8 | 0.6250 | 255.87 |

| NCNN | ✅ | 94.8 | 0.6320 | 177.70 |

| Формат | Статус | Размер на диске (МБ) | mAP50-95(B) | Время инференса (мс/изобр.) |

|---|---|---|---|---|

| PyTorch | ✅ | 114 | 0.6610 | 38.37 |

| TorchScript | ✅ | 213.5 | 0.6590 | 41.23 |

| ONNX | ✅ | 212.9 | 0.6590 | 52.03 |

| OpenVINO | ✅ | 213.2 | 0.6590 | 300.40 |

| TensorRT (FP32) | ✅ | 215.2 | 0.6590 | 28.43 |

| TensorRT (FP16) | ✅ | 110.3 | 0.6570 | 13.50 |

| TensorRT (INT8) | ✅ | 59.9 | 0.6080 | 9.33 |

| TF SavedModel | ✅ | 533.3 | 0.6590 | 738.60 |

| TF GraphDef | ✅ | 212.9 | 0.6590 | 785.70 |

| TF Lite | ✅ | 217.6 | 0.6900 | 6476.80 |

| MNN | ✅ | 213.3 | 0.6590 | 519.77 |

| NCNN | ✅ | 212.8 | 0.6670 | 300.00 |

Тестирование проведено с использованием Ultralytics .4.32

Примечание

Время логического вывода не включает предварительную/постобработку.

NVIDIA Jetson Orin Nano Super Developer Kit

Производительность

| Формат | Статус | Размер на диске (МБ) | mAP50-95(B) | Время инференса (мс/изобр.) |

|---|---|---|---|---|

| PyTorch | ✅ | 5.3 | 0.4790 | 15.60 |

| TorchScript | ✅ | 9.8 | 0.4770 | 12.60 |

| ONNX | ✅ | 9.5 | 0.4760 | 15.76 |

| OpenVINO | ✅ | 9.6 | 0.4820 | 56.23 |

| TensorRT (FP32) | ✅ | 11.3 | 0.4770 | 7.53 |

| TensorRT (FP16) | ✅ | 8.1 | 0.4800 | 4.57 |

| TensorRT (INT8) | ✅ | 5.3 | 0.4490 | 3.80 |

| TF SavedModel | ✅ | 24.6 | 0.4760 | 118.33 |

| TF GraphDef | ✅ | 9.5 | 0.4760 | 116.30 |

| TF Lite | ✅ | 9.9 | 0.4760 | 286.00 |

| MNN | ✅ | 9.4 | 0.4760 | 68.77 |

| NCNN | ✅ | 9.3 | 0.4810 | 47.50 |

| Формат | Статус | Размер на диске (МБ) | mAP50-95(B) | Время инференса (мс/изобр.) |

|---|---|---|---|---|

| PyTorch | ✅ | 20.0 | 0.5730 | 22.83 |

| TorchScript | ✅ | 36.8 | 0.5670 | 21.83 |

| ONNX | ✅ | 36.5 | 0.5664 | 26.29 |

| OpenVINO | ✅ | 36.7 | 0.5653 | 127.09 |

| TensorRT (FP32) | ✅ | 38.2 | 0.5664 | 13.60 |

| TensorRT (FP16) | ✅ | 21.3 | 0.5649 | 7.17 |

| TensorRT (INT8) | ✅ | 12.7 | 0.5468 | 5.25 |

| TF SavedModel | ✅ | 92.2 | 0.5665 | 263.69 |

| TF GraphDef | ✅ | 36.5 | 0.5665 | 268.21 |

| TF Lite | ✅ | 36.9 | 0.5665 | 949.63 |

| MNN | ✅ | 36.4 | 0.5644 | 184.68 |

| NCNN | ✅ | 36.4 | 0.5697 | 107.48 |

| Формат | Статус | Размер на диске (МБ) | mAP50-95(B) | Время инференса (мс/изобр.) |

|---|---|---|---|---|

| PyTorch | ✅ | 43.0 | 0.6220 | 44.43 |

| TorchScript | ✅ | 78.5 | 0.6230 | 44.00 |

| ONNX | ✅ | 78.2 | 0.6225 | 53.44 |

| OpenVINO | ✅ | 78.3 | 0.6186 | 303.26 |

| TensorRT (FP32) | ✅ | 80.0 | 0.6217 | 28.19 |

| TensorRT (FP16) | ✅ | 42.6 | 0.6225 | 13.59 |

| TensorRT (INT8) | ✅ | 23.4 | 0.5817 | 9.30 |

| TF SavedModel | ✅ | 196.3 | 0.6229 | 636.03 |

| TF GraphDef | ✅ | 78.2 | 0.6229 | 659.57 |

| TF Lite | ✅ | 78.5 | 0.6229 | 2905.17 |

| MNN | ✅ | 78.0 | 0.6168 | 500.09 |

| NCNN | ✅ | 78.0 | 0.6224 | 332.39 |

| Формат | Статус | Размер на диске (МБ) | mAP50-95(B) | Время инференса (мс/изобр.) |

|---|---|---|---|---|

| PyTorch | ✅ | 51.0 | 0.6230 | 60.97 |

| TorchScript | ✅ | 95.5 | 0.6250 | 56.20 |

| ONNX | ✅ | 95.0 | 0.6247 | 68.12 |

| OpenVINO | ✅ | 95.3 | 0.6238 | 397.84 |

| TensorRT (FP32) | ✅ | 97.1 | 0.6250 | 35.88 |

| TensorRT (FP16) | ✅ | 51.4 | 0.6225 | 17.42 |

| TensorRT (INT8) | ✅ | 30.0 | 0.5923 | 11.83 |

| TF SavedModel | ✅ | 238.4 | 0.6245 | 835.83 |

| TF GraphDef | ✅ | 95.0 | 0.6245 | 852.16 |

| TF Lite | ✅ | 95.4 | 0.6245 | 3650.85 |

| MNN | ✅ | 94.8 | 0.6257 | 612.37 |

| NCNN | ✅ | 94.8 | 0.6323 | 405.45 |

| Формат | Статус | Размер на диске (МБ) | mAP50-95(B) | Время инференса (мс/изобр.) |

|---|---|---|---|---|

| PyTorch | ✅ | 113.2 | 0.6561 | 98.44 |

| TorchScript | ✅ | 214.0 | 0.6593 | 98.0 |

| ONNX | ✅ | 212.9 | 0.6595 | 122.43 |

| OpenVINO | ✅ | 213.2 | 0.6592 | 760.72 |

| TensorRT (FP32) | ✅ | 215.1 | 0.6593 | 67.17 |

| TensorRT (FP16) | ✅ | 110.2 | 0.6637 | 32.60 |

| TensorRT (INT8) | ✅ | 59.9 | 0.6170 | 19.99 |

| TF SavedModel | ✅ | 533.3 | 0.6593 | 1647.06 |

| TF GraphDef | ✅ | 212.9 | 0.6593 | 1670.30 |

| TF Lite | ✅ | 213.3 | 0.6590 | 8066.30 |

| MNN | ✅ | 212.8 | 0.6600 | 1227.90 |

| NCNN | ✅ | 212.8 | 0.6666 | 782.24 |

Тестирование проведено с использованием Ultralytics .4.33

Примечание

Время логического вывода не включает предварительную/постобработку.

NVIDIA Jetson Orin NX 16GB

Производительность

| Формат | Статус | Размер на диске (МБ) | mAP50-95(B) | Время инференса (мс/изобр.) |

|---|---|---|---|---|

| PyTorch | ✅ | 5.3 | 0.4799 | 13.90 |

| TorchScript | ✅ | 9.8 | 0.4787 | 11.60 |

| ONNX | ✅ | 9.5 | 0.4763 | 14.18 |

| OpenVINO | ✅ | 9.6 | 0.4819 | 40.19 |

| TensorRT (FP32) | ✅ | 11.4 | 0.4770 | 7.01 |

| TensorRT (FP16) | ✅ | 8.0 | 0.4789 | 4.13 |

| TensorRT (INT8) | ✅ | 5.5 | 0.4489 | 3.49 |

| TF SavedModel | ✅ | 24.6 | 0.4764 | 92.34 |

| TF GraphDef | ✅ | 9.5 | 0.4764 | 92.06 |

| TF Lite | ✅ | 9.9 | 0.4764 | 254.43 |

| MNN | ✅ | 9.4 | 0.4760 | 48.55 |

| NCNN | ✅ | 9.3 | 0.4805 | 34.31 |

| Формат | Статус | Размер на диске (МБ) | mAP50-95(B) | Время инференса (мс/изобр.) |

|---|---|---|---|---|

| PyTorch | ✅ | 19.5 | 0.5738 | 20.40 |

| TorchScript | ✅ | 36.8 | 0.5664 | 19.20 |

| ONNX | ✅ | 36.5 | 0.5664 | 24.35 |

| OpenVINO | ✅ | 36.7 | 0.5653 | 88.18 |

| TensorRT (FP32) | ✅ | 38.5 | 0.5664 | 12.62 |

| TensorRT (FP16) | ✅ | 21.5 | 0.5652 | 6.41 |

| TensorRT (INT8) | ✅ | 12.6 | 0.5468 | 4.78 |

| TF SavedModel | ✅ | 92.2 | 0.5665 | 195.16 |

| TF GraphDef | ✅ | 36.5 | 0.5665 | 197.57 |

| TF Lite | ✅ | 36.9 | 0.5665 | 827.48 |

| MNN | ✅ | 36.4 | 0.5649 | 123.47 |

| NCNN | ✅ | 36.4 | 0.5697 | 74.04 |

| Формат | Статус | Размер на диске (МБ) | mAP50-95(B) | Время инференса (мс/изобр.) |

|---|---|---|---|---|

| PyTorch | ✅ | 42.2 | 0.6237 | 38.60 |

| TorchScript | ✅ | 78.5 | 0.6227 | 40.50 |

| ONNX | ✅ | 78.2 | 0.6225 | 48.87 |

| OpenVINO | ✅ | 78.3 | 0.6186 | 205.69 |

| TensorRT (FP32) | ✅ | 80.1 | 0.6217 | 24.69 |

| TensorRT (FP16) | ✅ | 42.6 | 0.6225 | 11.66 |

| TensorRT (INT8) | ✅ | 23.4 | 0.5817 | 8.22 |

| TF SavedModel | ✅ | 196.3 | 0.6229 | 451.48 |

| TF GraphDef | ✅ | 78.2 | 0.6229 | 460.94 |

| TF Lite | ✅ | 78.5 | 0.6229 | 2555.53 |

| MNN | ✅ | 78.0 | 0.6217 | 333.33 |

| NCNN | ✅ | 78.0 | 0.6224 | 214.60 |

| Формат | Статус | Размер на диске (МБ) | mAP50-95(B) | Время инференса (мс/изобр.) |

|---|---|---|---|---|

| PyTorch | ✅ | 50.7 | 0.6258 | 48.60 |

| TorchScript | ✅ | 95.5 | 0.6249 | 51.60 |

| ONNX | ✅ | 95.0 | 0.6247 | 61.95 |

| OpenVINO | ✅ | 95.3 | 0.6238 | 272.47 |

| TensorRT (FP32) | ✅ | 97.1 | 0.6250 | 31.64 |

| TensorRT (FP16) | ✅ | 51.4 | 0.6225 | 14.77 |

| TensorRT (INT8) | ✅ | 30.0 | 0.5923 | 10.49 |

| TF SavedModel | ✅ | 238.4 | 0.6245 | 596.46 |

| TF GraphDef | ✅ | 95.0 | 0.6245 | 606.10 |

| TF Lite | ✅ | 95.4 | 0.6245 | 3275.55 |

| MNN | ✅ | 94.8 | 0.6247 | 408.15 |

| NCNN | ✅ | 94.8 | 0.6323 | 262.99 |

| Формат | Статус | Размер на диске (МБ) | mAP50-95(B) | Время инференса (мс/изобр.) |

|---|---|---|---|---|

| PyTorch | ✅ | 113.2 | 0.6561 | 84.40 |

| TorchScript | ✅ | 213.5 | 0.6594 | 91.20 |

| ONNX | ✅ | 212.9 | 0.6595 | 109.34 |

| OpenVINO | ✅ | 213.2 | 0.6592 | 520.88 |

| TensorRT (FP32) | ✅ | 215.1 | 0.6593 | 57.18 |

| TensorRT (FP16) | ✅ | 109.7 | 0.6632 | 26.76 |

| TensorRT (INT8) | ✅ | 60.0 | 0.6170 | 17.32 |

| TF SavedModel | ✅ | 533.3 | 0.6593 | 1170.50 |

| TF GraphDef | ✅ | 212.9 | 0.6593 | 1217.87 |

| TF Lite | ✅ | 213.3 | 0.6593 | 7247.11 |

| MNN | ✅ | 212.8 | 0.6591 | 820.90 |

| NCNN | ✅ | 212.8 | 0.6666 | 534.30 |

Тестирование проведено с использованием Ultralytics .4.33

Примечание

Время логического вывода не включает предварительную/постобработку.

Ознакомьтесь с результатами других тестов от Seeed Studio, выполненных на различных версиях оборудования NVIDIA Jetson.

Воспроизведение наших результатов

Чтобы воспроизвести вышеуказанные тесты Ultralytics для всех форматов экспорта, запустите этот код:

Пример

from ultralytics import YOLO

# Load a YOLO11n PyTorch model

model = YOLO("yolo11n.pt")

# Benchmark YOLO11n speed and accuracy on the COCO128 dataset for all export formats

results = model.benchmark(data="coco128.yaml", imgsz=640)

# Benchmark YOLO11n speed and accuracy on the COCO128 dataset for all export formats

yolo benchmark model=yolo11n.pt data=coco128.yaml imgsz=640

Обратите внимание, что результаты бенчмаркинга могут варьироваться в зависимости от точной аппаратной и программной конфигурации системы, а также от текущей загрузки системы во время выполнения бенчмарков. Для получения наиболее надежных результатов используйте набор данных с большим количеством изображений, например, data='coco.yaml' (5000 изображений для проверки).

Рекомендации по использованию NVIDIA Jetson

При использовании NVIDIA Jetson существует несколько рекомендаций, которым следует придерживаться для достижения максимальной производительности на NVIDIA Jetson, работающем с YOLO26.

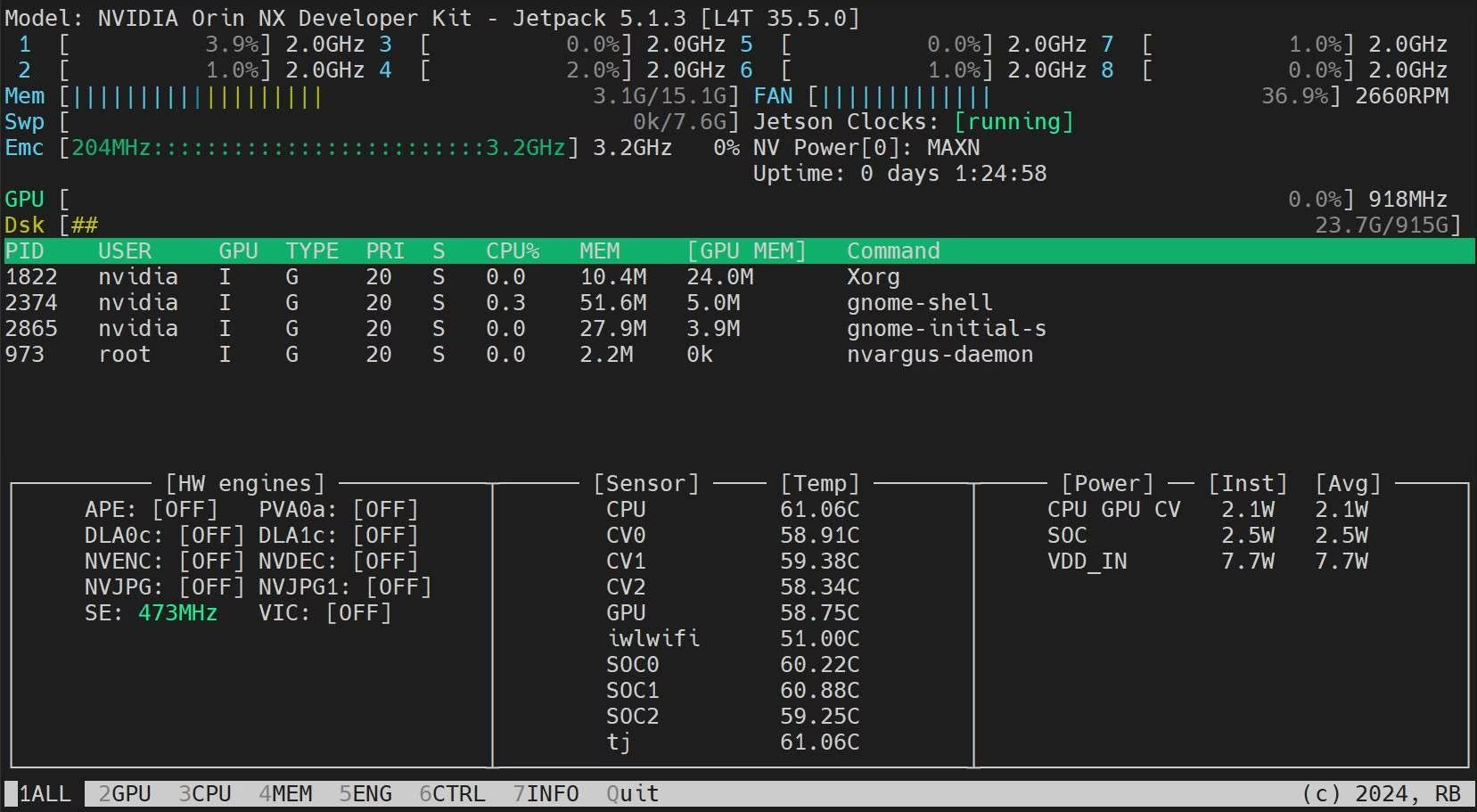

Включите режим максимальной производительности (MAX Power Mode)

Включение режима MAX Power Mode на Jetson гарантирует, что все ядра CPU и GPU будут включены.

sudo nvpmodel -m 0Включите Jetson Clocks

Включение Jetson Clocks обеспечит работу всех ядер CPU и GPU на их максимальной частоте.

sudo jetson_clocksУстановите приложение Jetson Stats

Мы можем использовать приложение Jetson Stats для мониторинга температуры компонентов системы и проверки других системных данных, таких как использование CPU, GPU, RAM, изменение режимов питания, установка максимальной частоты, проверка информации о JetPack.

sudo apt update sudo pip install jetson-stats sudo reboot jtop

Советы по оптимизации памяти для NVIDIA

Объём доступной памяти часто является ограничивающим фактором на устройствах Jetson, особенно на моделях с меньшим объёмом памяти, таких как Jetson Orin Nano (8 ГБ) или Orin NX 8 ГБ. Приведенные ниже рекомендации представляют собой практичные и безопасные изменения, которые в совокупности позволяют освободить несколько сотен мегабайт памяти и дают возможность запускать более объёмные YOLO или поддерживать дополнительные параллельные рабочие нагрузки. Подробную информацию см. в NVIDIA , посвящённом повышению эффективности использования памяти на устройствах Jetson.

1. Переключиться на загрузку в режиме без графического интерфейса

Если ваш Jetson подключен по SSH или работает в качестве производственного устройства без подключенного дисплея, отключение среды рабочего стола и сервера отображения может освободить до 865 МБ оперативной памяти:

sudo systemctl set-default multi-user.target

sudo reboot

Чтобы восстановить рабочий стол позже:

sudo systemctl set-default graphical.target

sudo reboot

2. Отключить неиспользуемые системные службы

Необязательные фоновые службы (Bluetooth, менеджеры подключений, неиспользуемые аппаратные демоны) в совокупности потребляют около 32 МБ. Выведите список активных служб и отключите все, что не требуется для вашей конфигурации:

# List running services

systemctl list-units --type=service --state=running

# Disable a service

sudo systemctl disable <service-name>

3. Использование памяти профилем

Перед началом оптимизации определите, какие процессы на самом деле потребляют оперативную память. procrank сортирует процессы по показателю PSS (Proportional Set Size), который более точно отражает фактический объем памяти, занимаемый каждым процессом, чем показатель RSS (Resident Set Size — общее количество страниц физической оперативной памяти, отображенных процессом, включая страницы, совместно используемые с другими процессами):

git clone https://github.com/csimmonds/procrank_linux.git

cd procrank_linux && make

sudo ./procrank

Чтобы просмотреть распределение ресурсов GPU NvMap (CUDA) по процессам:

sudo cat /sys/kernel/debug/nvmap/iovmm/clients

4. Запуск Inference без визуализации в производственной среде

Для конвейеров инференции, которым не требуется предварительный просмотр в реальном времени, отключение компонентов, связанных с отображением (Tiler, OSD, DisplaySink), может сэкономить более 200 МБ только за счет самого конвейера. При использовании Ultralytics YOLO отключите окно просмотра и вместо этого записывайте результаты на диск:

Пример

from ultralytics import YOLO

model = YOLO("yolo11n.engine")

# show=False prevents any display window; save=True writes annotated output to disk

results = model.predict(source="video.mp4", show=False, save=True)

yolo predict model=yolo11n.engine source=video.mp4 show=False save=True

Совокупное воздействие

| Оптимизация | Приблизительный объем сэкономленной памяти |

|---|---|

| Отключить графический интерфейс пользователя на рабочем столе | ~865 МБ |

| Отключить неиспользуемые службы ОС | около 32 МБ |

| Конвейер вывода без интерфейса (без экрана) | ~200+ МБ |

| Всего (легкие победы) | ~1 ГБ и более |

Сочетание этих изменений особенно ценно при оптимизации моделей TensorRT для устройств с ограниченным объемом памяти — от этого может зависеть, поместится ли в память более крупный вариант модели или нет.

Следующие шаги

Для дальнейшего изучения и поддержки см. документацию Ultralytics YOLO26.

Часто задаваемые вопросы

Как развернуть Ultralytics YOLO26 на устройствах NVIDIA Jetson?

Развертывание Ultralytics YOLO26 на устройствах NVIDIA Jetson — это простой процесс. Сначала прошейте ваше устройство Jetson с помощью NVIDIA JetPack SDK. Затем используйте предварительно собранный образ Docker для быстрой настройки или вручную установите необходимые пакеты. Подробные шаги для каждого подхода можно найти в разделах Быстрый старт с Docker и Начало работы с нативной установкой.

Каковы ожидаемые показатели производительности моделей YOLO11 на устройствах NVIDIA Jetson?

Модели YOLO11 были протестированы на различных устройствах NVIDIA Jetson, демонстрируя значительное повышение производительности. Например, формат TensorRT обеспечивает наилучшую производительность при выводе. В таблице в разделе Подробные сравнительные таблицы представлен всесторонний обзор показателей производительности, таких как mAP50-95 и время вывода, для различных форматов моделей.

Почему следует использовать TensorRT для развертывания YOLO26 на NVIDIA Jetson?

TensorRT настоятельно рекомендуется для развертывания моделей YOLO26 на NVIDIA Jetson благодаря его оптимальной производительности. Он ускоряет инференс, используя возможности GPU Jetson, обеспечивая максимальную эффективность и скорость. Узнайте больше о том, как преобразовать в TensorRT и запустить инференс, в разделе Использование TensorRT на NVIDIA Jetson.

Как установить PyTorch и Torchvision на NVIDIA Jetson?

Чтобы установить PyTorch и Torchvision на NVIDIA Jetson, сначала удалите все существующие версии, которые могли быть установлены через pip. Затем вручную установите совместимые версии PyTorch и Torchvision для архитектуры ARM64 Jetson. Подробные инструкции для этого процесса приведены в разделе Установка PyTorch и Torchvision.

Каковы лучшие практики для максимизации производительности на NVIDIA Jetson при использовании YOLO26?

Для максимизации производительности на NVIDIA Jetson с YOLO26 следуйте этим рекомендациям:

- Включите режим MAX Power Mode, чтобы использовать все ядра CPU и GPU.

- Включите Jetson Clocks, чтобы все ядра работали на максимальной частоте.

- Установите приложение Jetson Stats для мониторинга системных показателей.

Для получения команд и дополнительных сведений обратитесь к разделу Рекомендации по использованию NVIDIA Jetson.

Как освободить память на NVIDIA для запуска более объёмных YOLO ?

Доступный объем оперативной памяти часто становится «узким местом» на устройствах Jetson с ограниченным объемом памяти. Три простых способа, которые в совокупности позволяют освободить более 1 ГБ:

- Переключиться на загрузку без интерфейса (

sudo systemctl set-default multi-user.target) для отключения графического интерфейса пользователя (~865 МБ экономии). - Отключите неиспользуемые службы, такие как Bluetooth или менеджеры подключений (экономия около 32 МБ).

- Выполнить вывод без отображения результатов путём настройки

show=Falseв твоем YOLOpredictвызов, который позволяет избежать выделения памяти конвейера отображения (экономия около 200+ МБ).

Используйте procrank для анализа использования ОЗУ в каждом процессе и sudo cat /sys/kernel/debug/nvmap/iovmm/clients чтобы проверить GPU . См. Советы по оптимизации памяти раздел с полной информацией.

Почему при экспорте TensorRT в TensorRT отключается режим end-to-end в JetPack 6?

TensorRT .3.0, поставляемом в составе JetPack 6, обнаружена известная проблема, которая не позволяет скомпилировать движок INT8, когда end2end=True включена. Когда Ultralytics такую комбинацию, он автоматически отключает ветвь end2end, чтобы обеспечить успешный экспорт.

Чтобы восстановить экспорт данных INT8 по принципу «end-to-end», обновите TensorRT более новой версии (например, 10.7.0 или выше):

wget https://developer.download.nvidia.com/compute/cuda/repos/ubuntu2204/arm64/cuda-keyring_1.1-1_all.deb

sudo dpkg -i cuda-keyring_1.1-1_all.deb

sudo apt-get update

sudo apt-get install -y tensorrt

После обновления запустите экспорт заново. Подробнее см. в задаче GitHub № 23841.