SAM 2: Her Şeyi Segment Etme Modeli 2

SAM Evrimi

SAM 2, video segmentasyon yetenekleriyle orijinal SAM üzerine inşa edilmiştir. Metin ve görüntü örnek istemleriyle İstem Tabanlı Kavram Segmentasyonu için SAM 3'e bakın.

Meta'nın Segment Anything Model (SAM)'inin halefi olan SAM 2, hem görüntülerde hem de videolarda kapsamlı nesne segmentasyonu için tasarlanmış son teknoloji bir araçtır. Gerçek zamanlı işlemeyi ve sıfır atış genellemesini destekleyen birleşik, istemlenebilir bir model mimarisi aracılığıyla karmaşık görsel verileri işlemede mükemmeldir.

Ultralytics SAM

SAM .1 modelleri, Ultralytics akıllı etiketleme özelliğini destekleyerek, veri kümelerinin hızlı bir şekilde etiketlenmesi için tıklama tabanlı segmentasyon olanağı sunar. Ayrıntılar için etiketleme kılavuzuna bakın.

Temel Özellikler

İzle: Ultralytics kullanarak Meta'nın SAM2'si ile Çıkarım Nasıl Çalıştırılır | Adım Adım Kılavuz 🎉

Birleşik Model Mimarisi

SAM 2, görüntü ve video segmentasyonunun yeteneklerini tek bir modelde birleştirir. Bu birleşim, dağıtımı basitleştirir ve farklı medya türlerinde tutarlı performans sağlar. Kullanıcıların noktalar, sınırlayıcı kutular veya maskeler gibi çeşitli istem türleri aracılığıyla ilgi nesnelerini belirtmelerini sağlayan esnek bir istem tabanlı arayüzden yararlanır.

Gerçek Zamanlı Performans

Model, saniyede yaklaşık 44 kare işleyerek gerçek zamanlı çıkarım hızlarına ulaşır. Bu, SAM 2'yi video düzenleme ve artırılmış gerçeklik gibi anında geri bildirim gerektiren uygulamalar için uygun hale getirir.

Sıfır Atış Genelleme

SAM 2, daha önce hiç karşılaşmadığı nesneleri segment edebilir ve güçlü sıfır atış genellemesi gösterir. Bu, önceden tanımlanmış kategorilerin olası tüm nesneleri kapsamayabileceği çeşitli veya gelişen görsel alanlarda özellikle yararlıdır.

İnteraktif İyileştirme

Kullanıcılar, ek istemler sağlayarak segmentasyon sonuçlarını yinelemeli olarak iyileştirebilir ve çıktı üzerinde hassas kontrol sağlayabilir. Bu etkileşim, video açıklama veya tıbbi görüntüleme gibi uygulamalarda sonuçları ince ayar yapmak için çok önemlidir.

Görsel Zorlukların Gelişmiş Yönetimi

SAM 2, nesne gizlenmesi ve yeniden ortaya çıkması gibi yaygın video segmentasyon zorluklarını yönetmek için mekanizmalar içerir. Nesneleri kareler boyunca track etmek için gelişmiş bir bellek mekanizması kullanır ve nesneler geçici olarak gizlendiğinde veya sahneden çıkıp yeniden girdiğinde bile sürekliliği sağlar.

SAM 2'nin mimarisi ve yetenekleri hakkında daha derin bir anlayış için SAM 2 araştırma makalesini inceleyin.

Performans ve Teknik Detaylar

SAM 2, çeşitli metriklerde önceki modellerden daha iyi performans göstererek bu alanda yeni bir kıstas belirlemektedir:

| Metrik | SAM 2 | Önceki SOTA |

|---|---|---|

| İnteraktif Video Segmentasyonu | En İyi | - |

| İnsan Etkileşimleri Gerekli | 3 kat daha az | Temel Çizgi |

| Görüntü Bölütleme Doğruluğu | Geliştirilmiş | SAM |

| Çıkarım Hızı | 6 kat daha hızlı | SAM |

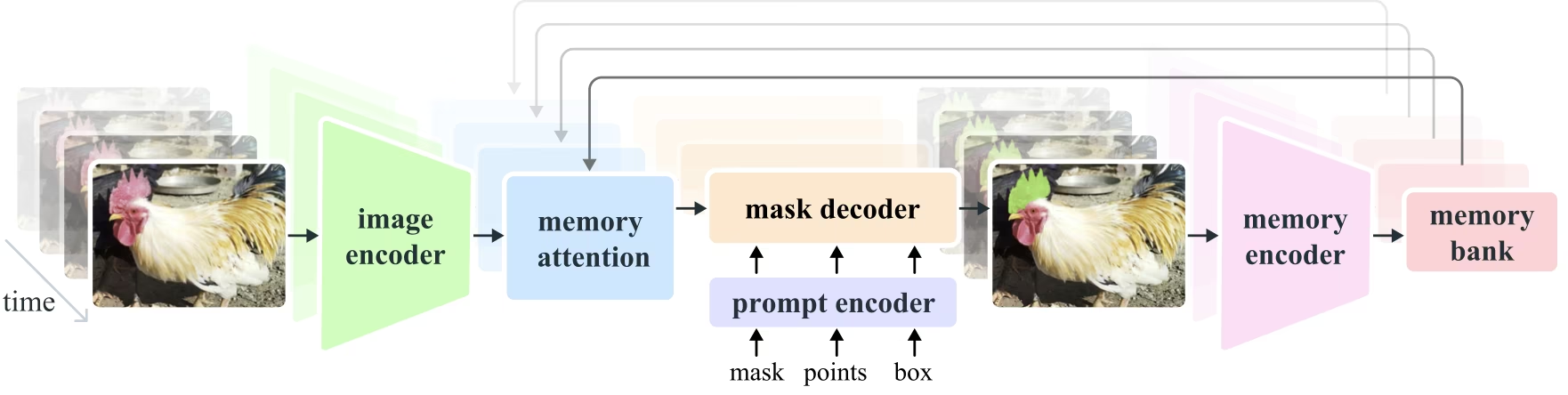

Model Mimarisi

Temel Bileşenler

- Görüntü ve Video Kodlayıcı: Hem görüntülerden hem de video karelerinden üst düzey özellikler çıkarmak için transformer tabanlı bir mimari kullanır. Bu bileşen, her zaman adımında görsel içeriği anlamaktan sorumludur.

- İstem Kodlayıcı: Bölütleme görevine rehberlik etmek için kullanıcı tarafından sağlanan istemleri (noktalar, kutular, maskeler) işler. Bu, SAM 2'nin kullanıcı girdisine uyum sağlamasına ve bir sahne içindeki belirli nesneleri hedeflemesine olanak tanır.

- Bellek Mekanizması: Bir bellek kodlayıcı, bellek bankası ve bellek dikkat modülü içerir. Bu bileşenler toplu olarak geçmiş çerçevelerden bilgi depolar ve kullanır, bu da modelin zaman içinde tutarlı nesne takibi sağlamasına olanak tanır.

- Maske Kod Çözücü: Kodlanmış görüntü özelliklerine ve istemlere göre son segmentasyon maskelerini oluşturur. Videoda, kareler arasında doğru takibi sağlamak için bellek bağlamını da kullanır.

Bellek Mekanizması ve Örtüşme Yönetimi

Bellek mekanizması, SAM 2'nin video verilerindeki zamansal bağımlılıkları ve tıkanmaları işlemesini sağlar. Nesneler hareket ettikçe ve etkileşimde bulundukça, SAM 2 özelliklerini bir bellek bankasına kaydeder. Bir nesne tıkandığında, model yeniden göründüğünde konumunu ve görünümünü tahmin etmek için bu belleğe güvenebilir. Tıkanma başlığı özellikle nesnelerin görünür olmadığı senaryoları ele alır ve bir nesnenin tıkanma olasılığını tahmin eder.

Çoklu Maske Belirsizliği Çözümü

Belirsizliğin olduğu durumlarda (örneğin, örtüşen nesneler), SAM 2 birden fazla maske tahmini oluşturabilir. Bu özellik, tek bir maskenin sahnenin nüanslarını yeterince tanımlayamadığı karmaşık sahneleri doğru bir şekilde temsil etmek için çok önemlidir.

SA-V Veri Kümesi

SAM 2'nin eğitimi için geliştirilen SA-V veri kümesi, mevcut en büyük ve en çeşitli video segmentasyon veri kümelerinden biridir. İçeriği:

- 51.000+ Video: 47 ülke genelinde çekilmiş olup, çok çeşitli gerçek dünya senaryoları sunmaktadır.

- 600.000+ Maske Açıklaması: Tüm nesneleri ve parçaları kapsayan, "maskletler" olarak adlandırılan detaylı uzamsal-zamansal maske açıklamaları.

- Veri Kümesi Ölçeği: Önceki en büyük veri kümelerinden 4,5 kat daha fazla video ve 53 kat daha fazla açıklama içerir ve benzeri görülmemiş çeşitlilik ve karmaşıklık sunar.

Kıyaslamalar

Video Nesne Segmentasyonu

SAM 2, başlıca video segmentasyon kıyaslama testlerinde üstün performans göstermiştir:

| Veri Kümesi | J&F | J | F |

|---|---|---|---|

| DAVIS 2017 | 82.5 | 79.8 | 85.2 |

| YouTube-VOS | 81.2 | 78.9 | 83.5 |

İnteraktif Segmentasyon

Etkileşimli segmentasyon görevlerinde, SAM 2 önemli ölçüde verimlilik ve doğruluk gösterir:

| Veri Kümesi | NoC@90 | AUC |

|---|---|---|

| DAVIS Etkileşimli | 1.54 | 0.872 |

Kurulum

SAM 2'yi kurmak için aşağıdaki komutu kullanın. Tüm SAM 2 modelleri ilk kullanımda otomatik olarak indirilecektir.

pip install ultralytics

SAM 2 Nasıl Kullanılır: Görüntü ve Video Bölütlemede Çok Yönlülük

Aşağıdaki tablo, mevcut SAM 2 modellerini, önceden eğitilmiş ağırlıklarını, desteklenen görevleri ve Çıkarım, Doğrulama, Eğitim ve Dışa Aktarma gibi farklı çalışma modlarıyla uyumluluklarını detaylandırmaktadır.

| Model Türü | Önceden Eğitilmiş Ağırlıklar | Desteklenen Görevler | Çıkarım | Doğrulama | Eğitim | Dışa aktar |

|---|---|---|---|---|---|---|

| SAM 2 minik | sam2_t.pt | Örnek Segmentasyonu | ✅ | ❌ | ❌ | ❌ |

| SAM 2 küçük | sam2_s.pt | Örnek Segmentasyonu | ✅ | ❌ | ❌ | ❌ |

| SAM 2 temeli | sam2_b.pt | Örnek Segmentasyonu | ✅ | ❌ | ❌ | ❌ |

| SAM 2 büyük | sam2_l.pt | Örnek Segmentasyonu | ✅ | ❌ | ❌ | ❌ |

| SAM 2.1 minik | sam2.1_t.pt | Örnek Segmentasyonu | ✅ | ❌ | ❌ | ❌ |

| SAM 2.1 küçük | sam2.1_s.pt | Örnek Segmentasyonu | ✅ | ❌ | ❌ | ❌ |

| SAM 2.1 temel | sam2.1_b.pt | Örnek Segmentasyonu | ✅ | ❌ | ❌ | ❌ |

| SAM 2.1 büyük | sam2.1_l.pt | Örnek Segmentasyonu | ✅ | ❌ | ❌ | ❌ |

SAM 2 Tahmin Örnekleri

SAM 2, gerçek zamanlı video düzenleme, tıbbi görüntüleme ve otonom sistemler dahil olmak üzere geniş bir görev yelpazesinde kullanılabilir. Hem statik hem de dinamik görsel verileri segment edebilme yeteneği, onu araştırmacılar ve geliştiriciler için çok yönlü bir araç haline getirir.

İstemlerle Bölümlere Ayırma

İstemlerle Bölümlere Ayırma

Görüntülerde veya videolarda belirli nesneleri bölümlere ayırmak için istemleri kullanın.

from ultralytics import SAM

# Load a model

model = SAM("sam2.1_b.pt")

# Display model information (optional)

model.info()

# Run inference with bboxes prompt

results = model("path/to/image.jpg", bboxes=[100, 100, 200, 200])

# Run inference with single point

results = model(points=[900, 370], labels=[1])

# Run inference with multiple points

results = model(points=[[400, 370], [900, 370]], labels=[1, 1])

# Run inference with multiple points prompt per object

results = model(points=[[[400, 370], [900, 370]]], labels=[[1, 1]])

# Run inference with negative points prompt

results = model(points=[[[400, 370], [900, 370]]], labels=[[1, 0]])

Her Şeyi Segmentlere Ayır

Her Şeyi Segmentlere Ayır

Belirli istemler olmadan tüm görüntü veya video içeriğini bölümlere ayırın.

from ultralytics import SAM

# Load a model

model = SAM("sam2.1_b.pt")

# Display model information (optional)

model.info()

# Run inference

model("path/to/video.mp4")

# Run inference with a SAM 2 model

yolo predict model=sam2.1_b.pt source=path/to/video.mp4

Video Segmentasyonu ve Nesne Takibi

Video Segmentasyonu

Belirli istemlerle tüm video içeriğini segmentlere ayırın ve nesneleri track edin.

from ultralytics.models.sam import SAM2VideoPredictor

# Create SAM2VideoPredictor

overrides = dict(conf=0.25, task="segment", mode="predict", imgsz=1024, model="sam2_b.pt")

predictor = SAM2VideoPredictor(overrides=overrides)

# Run inference with single point

results = predictor(source="test.mp4", points=[920, 470], labels=[1])

# Run inference with multiple points

results = predictor(source="test.mp4", points=[[920, 470], [909, 138]], labels=[1, 1])

# Run inference with multiple points prompt per object

results = predictor(source="test.mp4", points=[[[920, 470], [909, 138]]], labels=[[1, 1]])

# Run inference with negative points prompt

results = predictor(source="test.mp4", points=[[[920, 470], [909, 138]]], labels=[[1, 0]])

- Bu örnek, SAM 2'nin herhangi bir istem (bbox/nokta/maske) sağlanmaması durumunda bir görüntünün veya videonun tüm içeriğini bölümlere ayırmak için nasıl kullanılabileceğini göstermektedir.

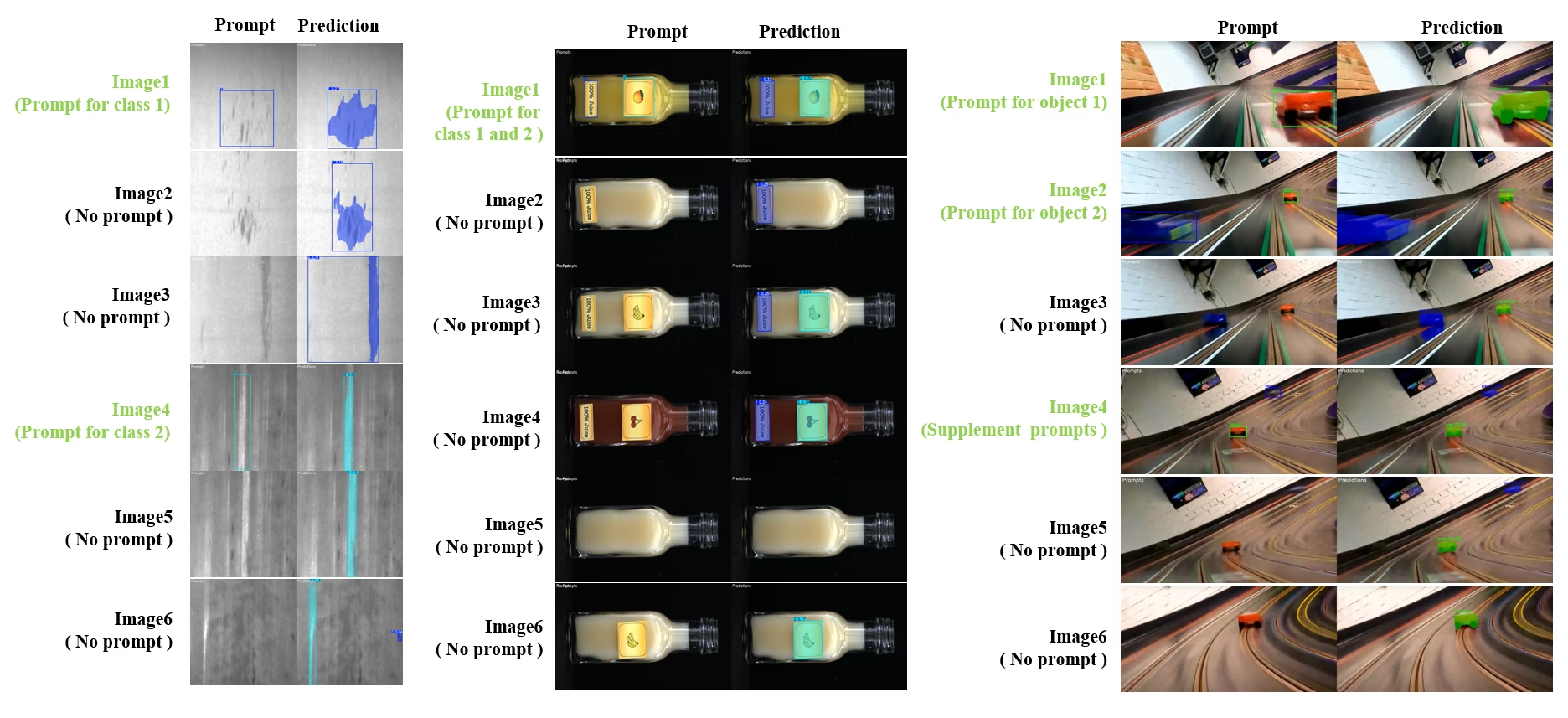

Dinamik Etkileşimli segment ve track

SAM2DynamicInteractivePredictor, birden fazla kareyle dinamik etkileşimi ve sürekli öğrenme yeteneklerini sağlayan, SAM2'nin gelişmiş, eğitim gerektirmeyen bir uzantısıdır. Bu tahminci, bir görüntü dizisi boyunca geliştirilmiş track performansı için gerçek zamanlı prompt güncellemelerini ve bellek yönetimini destekler. Orijinal SAM2 ile karşılaştırıldığında, SAM2DynamicInteractivePredictor, ek eğitim gerektirmeden önceden eğitilmiş SAM2 modellerinden en iyi şekilde yararlanmak için çıkarım akışını yeniden yapılandırır.

Temel Özellikler

Üç önemli geliştirme sunar:

- Dinamik Etkileşimli: Video işleme sırasında herhangi bir zamanda sonraki karelerde birleştirme/takip edilmeyen yeni örnekler için yeni istemler ekleyin

- Sürekli Öğrenme: Model performansını zamanla iyileştirmek için mevcut örneklere yeni istemler ekleyin

- Bağımsız Çoklu Görüntü Desteği: Bellek paylaşımı ve görüntüler arası nesne track etme ile birden fazla bağımsız görüntüyü (mutlaka bir video dizisinden olmak zorunda değil) işleyin

Temel Yetenekler

- İstem Esnekliği: Sınır kutuları, noktaları ve maskeleri istem olarak kabul eder

- Bellek Bankası Yönetimi: Kareler arasında nesne durumlarını depolamak için dinamik bir bellek bankası tutar

- Çoklu Nesne track etme: Bireysel nesne ID'leri ile birden fazla nesneyi eş zamanlı olarak track etmeyi destekler

- Gerçek Zamanlı Güncellemeler: Önceki kareleri yeniden işlemeye gerek kalmadan çıkarım sırasında yeni istemler eklemeye olanak tanır

- Bağımsız Görüntü İşleme: Görüntüler arası nesne tutarlılığı için paylaşılan bellek bağlamı ile bağımsız görüntüleri işleyin

Dinamik Nesne Ekleme

from ultralytics.models.sam import SAM2DynamicInteractivePredictor

# Create SAM2DynamicInteractivePredictor

overrides = dict(conf=0.01, task="segment", mode="predict", imgsz=1024, model="sam2_t.pt", save=False)

predictor = SAM2DynamicInteractivePredictor(overrides=overrides, max_obj_num=10)

# Define a category by box prompt

predictor(source="image1.jpg", bboxes=[[100, 100, 200, 200]], obj_ids=[0], update_memory=True)

# Detect this particular object in a new image

results = predictor(source="image2.jpg")

# Add new category with a new object ID

results = predictor(

source="image4.jpg",

bboxes=[[300, 300, 400, 400]], # New object

obj_ids=[1], # New object ID

update_memory=True, # Add to memory

)

# Perform inference

results = predictor(source="image5.jpg")

# Add refinement prompts to the same category to boost performance

# This helps when object appearance changes significantly

results = predictor(

source="image6.jpg",

points=[[150, 150]], # Refinement point

labels=[1], # Positive point

obj_ids=[1], # Same object ID

update_memory=True, # Update memory with new information

)

# Perform inference on new image

results = predictor(source="image7.jpg")

Not

SAM2DynamicInteractivePredictor SAM2 modelleriyle çalışmak üzere tasarlanmıştır ve tümü tarafından kategori ekleme/iyileştirme desteği sunar kutu/nokta/maske istemleri SAM2'nin yerel olarak desteklediği. Özellikle video etiketleme veya etkileşimli düzenleme görevleri gibi nesnelerin zaman içinde göründüğü veya değiştiği senaryolar için kullanışlıdır.

Argümanlar

| Ad | Varsayılan Değer | Veri Türü | Açıklama |

|---|---|---|---|

max_obj_num | 3 | int | Önceden ayarlanmış maksimum kategori sayısı |

update_memory | False | bool | Belleği yeni istemlerle güncelleyip güncellemeyeceği |

obj_ids | None | List[int] | İstemlere karşılık gelen nesne ID'lerinin listesi |

Kullanım Alanları

SAM2DynamicInteractivePredictor için idealdir:

- Video açıklama iş akışları (dizide yeni nesnelerin göründüğü durumlarda)

- Etkileşimli video düzenleme (gerçek zamanlı nesne ekleme ve iyileştirme gerektiren)

- Gözetim uygulamaları (dinamik nesne track etme ihtiyaçları olan)

- Tıbbi görüntüleme (zaman serileri boyunca anatomik yapıları track etmek için)

- Otonom sistemler (adaptif nesne detect etme ve track etme gerektiren)

- Çoklu görüntü veri kümeleri (bağımsız görüntüler arasında tutarlı nesne segment etme için)

- Görüntü koleksiyonu analizi (nesnelerin farklı sahneler arasında track edilmesi gereken)

- Alanlar arası segment etme (çeşitli görüntü bağlamlarından belleği kullanarak)

- Yarı otomatik açıklama (minimum manuel müdahale ile verimli veri kümesi oluşturma için)

SAM'in YOLO ile Karşılaştırılması

Burada, en küçük SAM2 varyantı da dahil olmak üzere Meta’nın SAM modellerini, YOLO26n-seg dahil Ultralytics modelleriyle karşılaştırıyoruz:

| Model | Boyut (MB) | Parametreler (M) | Hız (CPU) (ms/resim) |

|---|---|---|---|

| Meta SAM-b | 375 | 93.7 | 41703 |

| Meta SAM2-b | 162 | 80.8 | 28867 |

| Meta SAM2-t | 78.1 | 38.9 | 23430 |

| MobileSAM | 40.7 | 10.1 | 23802 |

| YOLOv8 backbone ile FastSAM-s | 23.9 | 11.8 | 58.0 |

| Ultralytics YOLOv8n-seg | 7,1 (11,0 kat daha küçük) | 3.4 (11.4 kat daha az) | 24,8 (945 kat daha hızlı) |

| Ultralytics YOLO11n-seg | 6,2 (12,6 kat daha küçük) | 2.9 (13.4 kat daha az) | 24,3 (964 kat daha hızlı) |

| Ultralytics YOLO26n-seg | 6.7 (11.7 kat daha küçük) | 2,7 (14,4 kat daha az) | 25,2 (930 kat daha hızlı) |

Bu karşılaştırma, SAM varyantları ile YOLO segmentasyon modelleri arasındaki model boyutları ve hızlarındaki önemli farklılıkları göstermektedir. SAM benzersiz otomatik segmentasyon yetenekleri sunsa da, YOLO modelleri, özellikle YOLOv8n-seg, YOLO11n-seg ve YOLO26n-seg, önemli ölçüde daha küçük, daha hızlı ve daha hesaplama açısından verimlidir.

SAM PyTorch ile, YOLO ise ONNX ile ölçülmüştür. Testler, 16 GB RAM'e sahip bir 2025 model Apple M4 Air üzerinde torch==2.10.0, ultralytics==8.4.31ve onnxruntime==1.24.4. Bu testi yeniden oluşturmak için:

Örnek

from ultralytics import ASSETS, SAM, YOLO, FastSAM

# Profile SAM2-t, SAM2-b, SAM-b, MobileSAM

for file in ["sam_b.pt", "sam2_b.pt", "sam2_t.pt", "mobile_sam.pt"]:

model = SAM(file)

model.info()

model(ASSETS)

# Profile FastSAM-s

model = FastSAM("FastSAM-s.pt")

model.info()

model(ASSETS)

# Profile YOLO models (ONNX)

for file_name in ["yolov8n-seg.pt", "yolo11n-seg.pt", "yolo26n-seg.pt"]:

model = YOLO(file_name)

model.info()

onnx_path = model.export(format="onnx", dynamic=True)

model = YOLO(onnx_path)

model(ASSETS)

Otomatik Açıklama: Verimli Veri Kümesi Oluşturma

Otomatik etiketleme, SAM 2'nin güçlü bir özelliğidir ve kullanıcıların önceden eğitilmiş modellerden yararlanarak segmentasyon veri kümelerini hızlı ve doğru bir şekilde oluşturmasını sağlar. Bu yetenek, kapsamlı manuel çaba gerektirmeden büyük, yüksek kaliteli veri kümeleri oluşturmak için özellikle faydalıdır.

SAM 2 ile Otomatik Etiketleme Nasıl Yapılır?

İzle: Ultralytics Kullanarak Meta'nın Segment Anything 2 Modeli ile Otomatik Etiketleme | Veri Etiketleme

SAM 2'yi kullanarak veri kümenizi otomatik olarak etiketlemek için şu örneği izleyin:

Otomatik Açıklama Örneği

from ultralytics.data.annotator import auto_annotate

auto_annotate(data="path/to/images", det_model="yolo26x.pt", sam_model="sam2_b.pt")

| Argüman | Tür | Varsayılan | Açıklama |

|---|---|---|---|

data | str | gerekli | Açıklama veya segmentasyon için hedef resimleri içeren dizine giden yol. |

det_model | str | 'yolo26x.pt' | İlk nesne tespiti için YOLO tespit model yolu. |

sam_model | str | 'sam_b.pt' | Segmentasyon için SAM model yolu (SAM, SAM2 varyantlarını ve MobileSAM modellerini destekler). |

device | str | '' | Hesaplama cihazı (örneğin, 'cuda:0', 'cpu' veya otomatik cihaz algılama için ''). |

conf | float | 0.25 | Zayıf tespitleri filtrelemek için YOLO tespit güven eşiği. |

iou | float | 0.45 | Çakışan kutuları filtrelemek için Non-Maximum Suppression için IoU eşiği. |

imgsz | int | 640 | Görüntüleri yeniden boyutlandırmak için giriş boyutu (32'nin katı olmalıdır). |

max_det | int | 300 | Bellek verimliliği için görüntü başına maksimum tespit sayısı. |

classes | list[int] | None | Detect edilecek sınıf indekslerinin listesi (örn. [0, 1] kişi ve bisiklet için). |

output_dir | str | None | Açıklamalar için kaydetme dizini (veri yoluna göre varsayılan olarak './labels' olur). |

Bu fonksiyon, projelerini hızlandırmayı amaçlayan araştırmacılar ve geliştiriciler için ideal olan yüksek kaliteli segmentasyon veri kümelerinin hızlı bir şekilde oluşturulmasını kolaylaştırır.

Sınırlamalar

Güçlü yönlerine rağmen, SAM 2'nin bazı sınırlamaları vardır:

- İzleme Kararlılığı: SAM 2, uzun diziler veya önemli bakış açısı değişiklikleri sırasında nesnelerin izini kaybedebilir.

- Nesne Karışıklığı: Model, özellikle kalabalık sahnelerde, benzer görünümlü nesneleri bazen karıştırabilir.

- Çoklu Nesnelerle Verimlilik: Nesneler arası iletişim eksikliği nedeniyle, aynı anda birden fazla nesne işlenirken segmentasyon verimliliği azalır.

- Detaylı Doğruluk: Özellikle hızlı hareket eden nesnelerde ince ayrıntıları kaçırabilir. Ek istemler bu sorunu kısmen çözebilir, ancak zamansal düzgünlük garanti edilmez.

Alıntılar ve Teşekkürler

SAM 2, araştırma veya geliştirme çalışmalarınızın önemli bir parçasıysa, lütfen aşağıdaki referansı kullanarak atıfta bulunun:

@article{ravi2024sam2,

title={SAM 2: Segment Anything in Images and Videos},

author={Ravi, Nikhila and Gabeur, Valentin and Hu, Yuan-Ting and Hu, Ronghang and Ryali, Chaitanya and Ma, Tengyu and Khedr, Haitham and R{\"a}dle, Roman and Rolland, Chloe and Gustafson, Laura and Mintun, Eric and Pan, Junting and Alwala, Kalyan Vasudev and Carion, Nicolas and Wu, Chao-Yuan and Girshick, Ross and Doll{\'a}r, Piotr and Feichtenhofer, Christoph},

journal={arXiv preprint},

year={2024}

}

Bu çığır açan model ve veri kümesiyle yapay zeka topluluğuna katkılarından dolayı Meta AI'ya minnettarlığımızı sunuyoruz.

SSS

SAM 2 nedir ve orijinal Segment Anything Modelini (SAM) nasıl geliştirir?

Meta'nın Segment Anything Model (SAM)'inin halefi olan SAM 2, hem görüntülerde hem de videolarda kapsamlı nesne segmentasyonu için tasarlanmış son teknoloji bir araçtır. Gerçek zamanlı işlemeyi ve sıfır atış genellemesini destekleyen birleşik, istemlenebilir bir model mimarisi aracılığıyla karmaşık görsel verileri işlemede mükemmeldir. SAM 2, orijinal SAM'e göre çeşitli iyileştirmeler sunar, bunlar:

- Birleşik Model Mimarisi: Görüntü ve video segmentasyon yeteneklerini tek bir modelde birleştirir.

- Gerçek Zamanlı Performans: Saniyede yaklaşık 44 kare işler, bu da onu anında geri bildirim gerektiren uygulamalar için uygun hale getirir.

- Sıfır Atış Genellemesi: Daha önce hiç karşılaşmadığı nesneleri bölümlere ayırır, çeşitli görsel alanlarda kullanışlıdır.

- Etkileşimli İyileştirme: Kullanıcıların ek istemler sağlayarak segmentasyon sonuçlarını yinelemeli olarak iyileştirmesine olanak tanır.

- Görsel Zorlukların Gelişmiş Yönetimi: Nesne tıkanıklığı ve yeniden ortaya çıkması gibi yaygın video segmentasyon zorluklarını yönetir.

SAM 2'nin mimarisi ve yetenekleri hakkında daha fazla bilgi için SAM 2 araştırma makalesini inceleyin.

Gerçek zamanlı video segmentasyonu için SAM 2'yi nasıl kullanabilirim?

SAM 2, istem tabanlı arayüzünden ve gerçek zamanlı çıkarım yeteneklerinden yararlanarak gerçek zamanlı video segmentasyonu için kullanılabilir. İşte temel bir örnek:

İstemlerle Bölümlere Ayırma

Görüntülerde veya videolarda belirli nesneleri bölümlere ayırmak için istemleri kullanın.

from ultralytics import SAM

# Load a model

model = SAM("sam2_b.pt")

# Display model information (optional)

model.info()

# Segment with bounding box prompt

results = model("path/to/image.jpg", bboxes=[100, 100, 200, 200])

# Segment with point prompt

results = model("path/to/image.jpg", points=[150, 150], labels=[1])

Daha kapsamlı kullanım için SAM 2'yi Kullanma bölümüne bakın.

SAM 2'yi eğitmek için hangi veri kümeleri kullanılır ve bunlar performansını nasıl artırır?

SAM 2, mevcut en büyük ve en çeşitli video segmentasyon veri kümelerinden biri olan SA-V veri kümesi üzerinde eğitilmiştir. SA-V veri kümesi şunları içerir:

- 51.000+ Video: 47 ülke genelinde çekilmiş olup, çok çeşitli gerçek dünya senaryoları sunmaktadır.

- 600.000+ Maske Açıklaması: Tüm nesneleri ve parçaları kapsayan, "maskletler" olarak adlandırılan detaylı uzamsal-zamansal maske açıklamaları.

- Veri Kümesi Ölçeği: Önceki en büyük veri kümelerinden 4,5 kat daha fazla video ve 53 kat daha fazla açıklama içerir ve benzeri görülmemiş çeşitlilik ve karmaşıklık sunar.

Bu kapsamlı veri seti, SAM 2'nin başlıca video segmentasyon kıyaslamalarında üstün performans göstermesini ve sıfır atış genelleme yeteneklerini geliştirmesini sağlar. Daha fazla bilgi için SA-V Veri Seti bölümüne bakın.

SAM 2, video segmentasyonunda örtüşmeleri ve nesne yeniden görünmelerini nasıl ele alır?

SAM 2, video verilerindeki zamansal bağımlılıkları ve örtüşmeleri yönetmek için gelişmiş bir bellek mekanizması içerir. Bellek mekanizması şunlardan oluşur:

- Bellek Kodlayıcı ve Bellek Bankası: Geçmiş karelerden özellikleri depolar.

- Bellek Dikkat Modülü: Zaman içinde tutarlı nesne takibini sürdürmek için depolanmış bilgileri kullanır.

- Oklüzyon Başlığı: Özellikle nesnelerin görünür olmadığı senaryoları ele alır ve bir nesnenin örtülme olasılığını tahmin eder.

Bu mekanizma, nesneler geçici olarak gizlendiğinde veya sahneden çıkıp yeniden girdiğinde bile sürekliliği sağlar. Daha fazla ayrıntı için Bellek Mekanizması ve Oklüzyon İşleme bölümüne bakın.

SAM , YOLO26 gibi diğer segmentasyon modelleriyle karşılaştırıldığında nasıl bir performans sergiliyor?

Meta'nın SAM2 ve SAM2 gibi SAM modelleri, güçlü sıfır atış segmentasyon yetenekleri sunsa da, YOLO kıyasla önemli ölçüde daha büyük ve daha yavaştır. Örneğin, YOLO26n-seg, CPU üzerinde SAM2 yaklaşık 24 kat daha küçüktür ve 1145 kat daha hızlıdır. SAM , çok yönlü, komut tabanlı ve sıfır atışlı segmentasyon senaryolarında üstünlük sağlarken, YOLO26 hız, verimlilik ve NMS uçtan uca çıkarım ile gerçek zamanlı uygulamalar için optimize edilmiştir; bu da onu kaynak kısıtlı ortamlarda kullanıma daha uygun hale getirir.