Hướng dẫn Bắt đầu Nhanh: NVIDIA Jetson với Ultralytics YOLO26

Hướng dẫn toàn diện này cung cấp hướng dẫn chi tiết để triển khai Ultralytics YOLO26 trên các thiết bị NVIDIA Jetson. Ngoài ra, nó còn trình bày các điểm chuẩn hiệu suất để minh họa khả năng của YOLO26 trên các thiết bị nhỏ gọn và mạnh mẽ này.

Hỗ trợ sản phẩm mới

Chúng tôi đã cập nhật hướng dẫn này với Bộ công cụ phát triển NVIDIA Jetson AGX Thor mới nhất, cung cấp tới 2070 FP4 TFLOPS khả năng tính toán AI và 128 GB bộ nhớ với công suất có thể cấu hình từ 40 W đến 130 W. Nó mang lại khả năng tính toán AI cao hơn 7.5 lần so với NVIDIA Jetson AGX Orin, với hiệu quả năng lượng tốt hơn 3.5 lần để chạy liền mạch các mô hình AI phổ biến nhất.

Xem: Cách sử dụng Ultralytics YOLO26 trên các thiết bị NVIDIA Jetson

Lưu ý

Hướng dẫn này đã được thử nghiệm với NVIDIA Jetson AGX Thor Developer Kit (Jetson T5000) chạy phiên bản JetPack ổn định mới nhất là JP7.0, NVIDIA Jetson AGX Orin Developer Kit (64GB) chạy phiên bản JetPack JP6.2, NVIDIA Jetson Orin Nano Super Developer Kit chạy phiên bản JetPack JP6.1, Seeed Studio reComputer J4012 dựa trên NVIDIA Jetson Orin NX 16GB chạy phiên bản JetPack JP6.0/ phiên bản JetPack JP5.1.3 và Seeed Studio reComputer J1020 v2 dựa trên NVIDIA Jetson Nano 4GB chạy phiên bản JetPack JP4.6.1. Nó được kỳ vọng sẽ hoạt động trên toàn bộ dòng sản phẩm phần cứng NVIDIA Jetson, bao gồm các thiết bị mới nhất và cũ hơn.

NVIDIA Jetson là gì?

NVIDIA Jetson là một dòng bo mạch máy tính nhúng được thiết kế để mang điện toán AI (trí tuệ nhân tạo) tăng tốc đến các thiết bị biên. Các thiết bị nhỏ gọn và mạnh mẽ này được xây dựng dựa trên kiến trúc GPU của NVIDIA và có thể chạy các thuật toán AI phức tạp cùng các mô hình học sâu trực tiếp trên thiết bị, mà không cần dựa vào tài nguyên điện toán đám mây. Các bo mạch Jetson thường được sử dụng trong robot học, xe tự hành, tự động hóa công nghiệp và các ứng dụng khác mà suy luận AI cần được thực hiện cục bộ với độ trễ thấp và hiệu quả cao. Ngoài ra, các bo mạch này dựa trên kiến trúc ARM64 và hoạt động với công suất thấp hơn so với các thiết bị điện toán GPU truyền thống.

So sánh các dòng NVIDIA Jetson

NVIDIA Jetson AGX Thor là phiên bản mới nhất của dòng NVIDIA Jetson dựa trên kiến trúc NVIDIA Blackwell, mang lại hiệu suất AI được cải thiện đáng kể so với các thế hệ trước. Bảng dưới đây so sánh một vài thiết bị Jetson trong hệ sinh thái.

| Jetson AGX Thor(T5000) | Jetson AGX Orin 64GB | Jetson Orin NX 16GB | Jetson Orin Nano Super | Jetson AGX Xavier | Jetson Xavier NX | Jetson Nano | |

|---|---|---|---|---|---|---|---|

| Hiệu suất AI | 2070 TFLOPS | 275 TOPS | 100 TOPS | 67 TOPS | 32 TOPS | 21 TOPS | 472 GFLOPS |

| GPU | GPU kiến trúc NVIDIA Blackwell 2560 lõi với 96 Tensor Cores | GPU kiến trúc NVIDIA Ampere 2048 lõi với 64 Lõi Tensor | GPU kiến trúc NVIDIA Ampere 1024 lõi với 32 Lõi Tensor | GPU kiến trúc NVIDIA Ampere 1024 lõi với 32 Lõi Tensor | GPU kiến trúc NVIDIA Volta 512 lõi với 64 Lõi Tensor | GPU kiến trúc NVIDIA Volta™ 384 lõi với 48 Lõi Tensor | GPU kiến trúc NVIDIA Maxwell™ 128 lõi |

| Tần số tối đa của GPU | 1.57 GHz | 1.3 GHz | 918 MHz | 1020 MHz | 1377 MHz | 1100 MHz | 921MHz |

| CPU | 14-core Arm® Neoverse®-V3AE 64-bit CPU 1MB L2 + 16MB L3 | CPU 12 nhân NVIDIA Arm® Cortex A78AE v8.2 64-bit 3MB L2 + 6MB L3 | CPU 8 nhân NVIDIA Arm® Cortex A78AE v8.2 64-bit 2MB L2 + 4MB L3 | CPU 6 nhân Arm® Cortex®-A78AE v8.2 64-bit 1.5MB L2 + 4MB L3 | CPU 8 nhân NVIDIA Carmel Arm®v8.2 64-bit 8MB L2 + 4MB L3 | CPU 6 nhân NVIDIA Carmel Arm®v8.2 64-bit 6MB L2 + 4MB L3 | Bộ xử lý Quad-Core Arm® Cortex®-A57 MPCore |

| Tần số tối đa của CPU | 2.6 GHz | 2.2 GHz | 2.0 GHz | 1.7 GHz | 2.2 GHz | 1.9 GHz | 1.43GHz |

| Bộ nhớ | 128GB 256-bit LPDDR5X 273GB/s | 64GB 256-bit LPDDR5 204.8GB/s | 16GB 128-bit LPDDR5 102.4GB/s | 8GB 128-bit LPDDR5 102 GB/s | 32GB 256-bit LPDDR4x 136.5GB/s | 8GB 128-bit LPDDR4x 59.7GB/s | 4GB 64-bit LPDDR4 25.6GB/s |

Để có bảng so sánh chi tiết hơn, vui lòng truy cập phần So sánh thông số kỹ thuật trên trang NVIDIA Jetson chính thức.

NVIDIA JetPack là gì?

NVIDIA JetPack SDK cung cấp năng lượng cho các mô-đun Jetson là giải pháp toàn diện nhất và cung cấp môi trường phát triển đầy đủ để xây dựng các ứng dụng AI được tăng tốc đầu cuối và rút ngắn thời gian đưa ra thị trường. JetPack bao gồm Jetson Linux với bộ nạp khởi động, hạt nhân Linux, môi trường máy tính để bàn Ubuntu và một bộ thư viện hoàn chỉnh để tăng tốc điện toán GPU, đa phương tiện, đồ họa và thị giác máy tính. Nó cũng bao gồm các mẫu, tài liệu và công cụ dành cho nhà phát triển cho cả máy tính chủ và bộ công cụ dành cho nhà phát triển, đồng thời hỗ trợ các SDK cấp cao hơn như DeepStream để phân tích video trực tuyến, Isaac cho robot và Riva cho AI đàm thoại.

Cài đặt JetPack vào NVIDIA Jetson

Bước đầu tiên sau khi sở hữu một thiết bị NVIDIA Jetson là flash NVIDIA JetPack vào thiết bị. Có nhiều cách khác nhau để flash các thiết bị NVIDIA Jetson.

- Nếu bạn sở hữu một Bộ công cụ phát triển NVIDIA chính thức như Bộ công cụ phát triển Jetson AGX Thor, bạn có thể tải xuống một image và chuẩn bị một USB có khả năng khởi động để flash JetPack vào SSD đi kèm.

- Nếu bạn sở hữu một NVIDIA Development Kit chính thức, chẳng hạn như Jetson Orin Nano Developer Kit, bạn có thể tải xuống image và chuẩn bị thẻ SD với JetPack để khởi động thiết bị.

- Nếu bạn sở hữu bất kỳ NVIDIA Development Kit nào khác, bạn có thể flash JetPack vào thiết bị bằng SDK Manager.

- Nếu bạn sở hữu thiết bị Seeed Studio reComputer J4012, bạn có thể flash JetPack vào SSD đi kèm và nếu bạn sở hữu thiết bị Seeed Studio reComputer J1020 v2, bạn có thể flash JetPack vào eMMC/ SSD.

- Nếu bạn sở hữu bất kỳ thiết bị bên thứ ba nào khác được trang bị mô-đun NVIDIA Jetson, thì nên thực hiện flash bằng dòng lệnh.

Lưu ý

Đối với các phương pháp 1, 4 và 5 ở trên, sau khi flash hệ thống và khởi động thiết bị, vui lòng nhập "sudo apt update && sudo apt install nvidia-jetpack -y" vào terminal của thiết bị để cài đặt tất cả các thành phần JetPack còn lại cần thiết.

Hỗ trợ JetPack dựa trên thiết bị Jetson

Bảng dưới đây nêu bật các phiên bản NVIDIA JetPack được hỗ trợ bởi các thiết bị NVIDIA Jetson khác nhau.

| JetPack 4 | JetPack 5 | JetPack 6 | JetPack 7 | |

|---|---|---|---|---|

| Jetson Nano | ✅ | ❌ | ❌ | ❌ |

| Jetson TX2 | ✅ | ❌ | ❌ | ❌ |

| Jetson Xavier NX | ✅ | ✅ | ❌ | ❌ |

| Jetson AGX Xavier | ✅ | ✅ | ❌ | ❌ |

| Jetson AGX Orin | ❌ | ✅ | ✅ | ❌ |

| Jetson Orin NX | ❌ | ✅ | ✅ | ❌ |

| Jetson Orin Nano | ❌ | ✅ | ✅ | ❌ |

| Jetson AGX Thor | ❌ | ❌ | ❌ | ✅ |

Quick Start with Docker

Cách nhanh nhất để bắt đầu với Ultralytics YOLO26 trên NVIDIA Jetson là chạy bằng các ảnh docker dựng sẵn dành cho Jetson. Tham khảo bảng trên và chọn phiên bản JetPack phù hợp với thiết bị Jetson mà bạn sở hữu.

t=ultralytics/ultralytics:latest-jetson-jetpack4

sudo docker pull $t && sudo docker run -it --ipc=host --runtime=nvidia $t

t=ultralytics/ultralytics:latest-jetson-jetpack5

sudo docker pull $t && sudo docker run -it --ipc=host --runtime=nvidia $t

t=ultralytics/ultralytics:latest-jetson-jetpack6

sudo docker pull $t && sudo docker run -it --ipc=host --runtime=nvidia $t

t=ultralytics/ultralytics:latest-nvidia-arm64

sudo docker pull $t && sudo docker run -it --ipc=host --runtime=nvidia $t

Sau khi hoàn tất, hãy chuyển đến phần Sử dụng TensorRT trên NVIDIA Jetson.

Start with Native Installation

Để cài đặt gốc mà không cần Docker, vui lòng tham khảo các bước bên dưới.

Chạy trên JetPack 7.0

Cài đặt Gói Ultralytics

Ở đây, chúng ta sẽ cài đặt gói Ultralytics trên Jetson cùng với các dependency tùy chọn để có thể xuất các mô hình PyTorch sang các định dạng khác nhau. Chúng ta sẽ tập trung chủ yếu vào xuất NVIDIA TensorRT vì TensorRT sẽ đảm bảo chúng ta có thể khai thác tối đa hiệu suất của các thiết bị Jetson.

Cập nhật danh sách các gói, cài đặt pip và nâng cấp lên phiên bản mới nhất

sudo apt update sudo apt install python3-pip -y pip install -U pipCài đặt

ultralyticsgói pip với các dependency tùy chọnpip install ultralytics[export]Khởi động lại thiết bị

sudo reboot

Install PyTorch and Torchvision

Việc cài đặt Ultralytics ở trên sẽ cài đặt torch và Torchvision. Tuy nhiên, 2 gói này được cài đặt qua pip không tương thích để chạy trên Jetson AGX Thor đi kèm với JetPack 7.0 và CUDA 13. Do đó, chúng ta cần cài đặt chúng theo cách thủ công.

Cài đặt torch và torchvision theo JP7.0

pip install torch torchvision --index-url https://download.pytorch.org/whl/cu130

Cài đặt onnxruntime-gpu

Hàm onnxruntime-gpu gói được lưu trữ trong PyPI không có aarch64 các binary cho Jetson. Vì vậy, chúng ta cần cài đặt thủ công gói này. Gói này là cần thiết cho một số export.

Tại đây chúng ta sẽ tải xuống và cài đặt onnxruntime-gpu 1.24.0 với Python3.12 hỗ trợ.

pip install https://github.com/ultralytics/assets/releases/download/v0.0.0/onnxruntime_gpu-1.24.0-cp312-cp312-linux_aarch64.whl

Chạy trên JetPack 6.1

Cài đặt Gói Ultralytics

Ở đây, chúng ta sẽ cài đặt gói Ultralytics trên Jetson cùng với các dependency tùy chọn để có thể xuất các mô hình PyTorch sang các định dạng khác nhau. Chúng ta sẽ tập trung chủ yếu vào xuất NVIDIA TensorRT vì TensorRT sẽ đảm bảo chúng ta có thể khai thác tối đa hiệu suất của các thiết bị Jetson.

Cập nhật danh sách các gói, cài đặt pip và nâng cấp lên phiên bản mới nhất

sudo apt update sudo apt install python3-pip -y pip install -U pipCài đặt

ultralyticsgói pip với các dependency tùy chọnpip install ultralytics[export]Khởi động lại thiết bị

sudo reboot

Install PyTorch and Torchvision

Việc cài đặt Ultralytics ở trên sẽ cài đặt torch và Torchvision. Tuy nhiên, hai gói này được cài đặt qua pip không tương thích với nền tảng Jetson, vốn dựa trên kiến trúc ARM64. Do đó, chúng ta cần cài đặt thủ công một PyTorch pip wheel được xây dựng sẵn và biên dịch hoặc cài đặt Torchvision từ mã nguồn.

Cài đặt torch 2.10.0 và torchvision 0.25.0 theo JP6.1

pip install https://github.com/ultralytics/assets/releases/download/v0.0.0/torch-2.10.0-cp310-cp310-linux_aarch64.whl

pip install https://github.com/ultralytics/assets/releases/download/v0.0.0/torchvision-0.25.0-cp310-cp310-linux_aarch64.whl

Lưu ý

Truy cập trang PyTorch cho Jetson để truy cập tất cả các phiên bản PyTorch khác nhau cho các phiên bản JetPack khác nhau. Để có danh sách chi tiết hơn về khả năng tương thích của PyTorch, Torchvision, hãy truy cập trang khả năng tương thích của PyTorch và Torchvision.

Cài đặt cuDSS để khắc phục sự cố phụ thuộc với torch 2.10.0

wget https://developer.download.nvidia.com/compute/cudss/0.7.1/local_installers/cudss-local-tegra-repo-ubuntu2204-0.7.1_0.7.1-1_arm64.deb

sudo dpkg -i cudss-local-tegra-repo-ubuntu2204-0.7.1_0.7.1-1_arm64.deb

sudo cp /var/cudss-local-tegra-repo-ubuntu2204-0.7.1/cudss-*-keyring.gpg /usr/share/keyrings/

sudo apt-get update

sudo apt-get -y install cudss

Cài đặt onnxruntime-gpu

Hàm onnxruntime-gpu gói được lưu trữ trong PyPI không có aarch64 các binary cho Jetson. Vì vậy, chúng ta cần cài đặt thủ công gói này. Gói này là cần thiết cho một số export.

Bạn có thể tìm thấy tất cả onnxruntime-gpu các gói—được sắp xếp theo phiên bản JetPack, phiên bản Python và các chi tiết tương thích khác—trong Ma trận tương thích Jetson Zoo ONNX Runtime.

Cho JetPack 6 với Python 3.10 hỗ trợ, bạn có thể cài đặt onnxruntime-gpu 1.23.0:

pip install https://github.com/ultralytics/assets/releases/download/v0.0.0/onnxruntime_gpu-1.23.0-cp310-cp310-linux_aarch64.whl

Ngoài ra, đối với onnxruntime-gpu 1.20.0:

pip install https://github.com/ultralytics/assets/releases/download/v0.0.0/onnxruntime_gpu-1.20.0-cp310-cp310-linux_aarch64.whl

Chạy trên JetPack 5.1.2

Cài đặt Gói Ultralytics

Ở đây, chúng ta sẽ cài đặt gói Ultralytics trên Jetson cùng với các dependency tùy chọn để có thể xuất các mô hình PyTorch sang các định dạng khác nhau. Chúng ta sẽ tập trung chủ yếu vào xuất NVIDIA TensorRT vì TensorRT sẽ đảm bảo chúng ta có thể khai thác tối đa hiệu suất của các thiết bị Jetson.

Cập nhật danh sách các gói, cài đặt pip và nâng cấp lên phiên bản mới nhất

sudo apt update sudo apt install python3-pip -y pip install -U pipCài đặt

ultralyticsgói pip với các dependency tùy chọnpip install ultralytics[export]Khởi động lại thiết bị

sudo reboot

Install PyTorch and Torchvision

Việc cài đặt Ultralytics ở trên sẽ cài đặt torch và Torchvision. Tuy nhiên, hai gói này được cài đặt qua pip không tương thích với nền tảng Jetson, vốn dựa trên kiến trúc ARM64. Do đó, chúng ta cần cài đặt thủ công một PyTorch pip wheel được xây dựng sẵn và biên dịch hoặc cài đặt Torchvision từ mã nguồn.

Gỡ cài đặt PyTorch và Torchvision hiện tại.

pip uninstall torch torchvisionCài đặt

torch 2.1.0vàtorchvision 0.16.2theo JP5.1.2pip install https://github.com/ultralytics/assets/releases/download/v0.0.0/torch-2.1.0a0+41361538.nv23.06-cp38-cp38-linux_aarch64.whl pip install https://github.com/ultralytics/assets/releases/download/v0.0.0/torchvision-0.16.2+c6f3977-cp38-cp38-linux_aarch64.whl

Lưu ý

Truy cập trang PyTorch cho Jetson để truy cập tất cả các phiên bản PyTorch khác nhau cho các phiên bản JetPack khác nhau. Để có danh sách chi tiết hơn về khả năng tương thích của PyTorch, Torchvision, hãy truy cập trang khả năng tương thích của PyTorch và Torchvision.

Cài đặt onnxruntime-gpu

Hàm onnxruntime-gpu gói được lưu trữ trong PyPI không có aarch64 các binary cho Jetson. Vì vậy, chúng ta cần cài đặt thủ công gói này. Gói này là cần thiết cho một số export.

Bạn có thể tìm thấy tất cả onnxruntime-gpu các gói—được sắp xếp theo phiên bản JetPack, phiên bản Python và các chi tiết tương thích khác—trong Ma trận tương thích Jetson Zoo ONNX Runtime. Tại đây chúng ta sẽ tải xuống và cài đặt onnxruntime-gpu 1.17.0 với Python3.8 hỗ trợ.

wget https://nvidia.box.com/shared/static/zostg6agm00fb6t5uisw51qi6kpcuwzd.whl -O onnxruntime_gpu-1.17.0-cp38-cp38-linux_aarch64.whl

pip install onnxruntime_gpu-1.17.0-cp38-cp38-linux_aarch64.whl

Lưu ý

onnxruntime-gpu sẽ tự động hoàn nguyên phiên bản numpy về phiên bản mới nhất. Vì vậy, chúng ta cần cài đặt lại numpy thành 1.23.5 để khắc phục sự cố bằng cách thực thi:

pip install numpy==1.23.5

Use TensorRT on NVIDIA Jetson

Trong số tất cả các định dạng xuất mô hình được Ultralytics hỗ trợ, TensorRT mang lại hiệu suất suy luận cao nhất trên các thiết bị NVIDIA Jetson, khiến nó trở thành đề xuất hàng đầu của chúng tôi cho việc triển khai trên Jetson. Để biết hướng dẫn thiết lập và sử dụng nâng cao, hãy xem hướng dẫn tích hợp TensorRT chuyên dụng của chúng tôi.

Chuyển đổi mô hình sang TensorRT và chạy suy luận

Mô hình YOLO26n ở định dạng PyTorch được chuyển đổi sang TensorRT để chạy suy luận với mô hình đã xuất.

Ví dụ

from ultralytics import YOLO

# Load a YOLO26n PyTorch model

model = YOLO("yolo26n.pt")

# Export the model to TensorRT

model.export(format="engine") # creates 'yolo26n.engine'

# Load the exported TensorRT model

trt_model = YOLO("yolo26n.engine")

# Run inference

results = trt_model("https://ultralytics.com/images/bus.jpg")

# Export a YOLO26n PyTorch model to TensorRT format

yolo export model=yolo26n.pt format=engine # creates 'yolo26n.engine'

# Run inference with the exported model

yolo predict model=yolo26n.engine source='https://ultralytics.com/images/bus.jpg'

Lưu ý

Truy cập trang Xuất để truy cập các đối số bổ sung khi xuất mô hình sang các định dạng mô hình khác nhau

Sử dụng NVIDIA Deep Learning Accelerator (DLA)

NVIDIA Deep Learning Accelerator (DLA) là một thành phần phần cứng chuyên dụng được tích hợp trong các thiết bị NVIDIA Jetson, giúp tối ưu hóa suy luận học sâu để tiết kiệm năng lượng và tăng hiệu suất. Bằng cách giảm tải các tác vụ từ GPU (giải phóng GPU cho các quy trình chuyên sâu hơn), DLA cho phép các mô hình chạy với mức tiêu thụ điện năng thấp hơn trong khi vẫn duy trì thông lượng cao, lý tưởng cho các hệ thống nhúng và các ứng dụng AI thời gian thực.

Các thiết bị Jetson sau đây được trang bị phần cứng DLA:

| Thiết bị Jetson | Lõi DLA | Tần Số Tối Đa DLA |

|---|---|---|

| Dòng Jetson AGX Orin | 2 | 1.6 GHz |

| Jetson Orin NX 16GB | 2 | 614 MHz |

| Jetson Orin NX 8GB | 1 | 614 MHz |

| Dòng Jetson AGX Xavier | 2 | 1.4 GHz |

| Dòng Jetson Xavier NX | 2 | 1.1 GHz |

Ví dụ

from ultralytics import YOLO

# Load a YOLO26n PyTorch model

model = YOLO("yolo26n.pt")

# Export the model to TensorRT with DLA enabled (only works with FP16 or INT8)

model.export(format="engine", device="dla:0", half=True) # dla:0 or dla:1 corresponds to the DLA cores

# Load the exported TensorRT model

trt_model = YOLO("yolo26n.engine")

# Run inference

results = trt_model("https://ultralytics.com/images/bus.jpg")

# Export a YOLO26n PyTorch model to TensorRT format with DLA enabled (only works with FP16 or INT8)

# Once DLA core number is specified at export, it will use the same core at inference

yolo export model=yolo26n.pt format=engine device="dla:0" half=True # dla:0 or dla:1 corresponds to the DLA cores

# Run inference with the exported model on the DLA

yolo predict model=yolo26n.engine source='https://ultralytics.com/images/bus.jpg'

Lưu ý

Khi sử dụng DLA exports, một số layer có thể không được hỗ trợ để chạy trên DLA và sẽ quay trở lại GPU để thực thi. Việc quay trở lại này có thể gây thêm độ trễ và ảnh hưởng đến hiệu suất suy luận tổng thể. Do đó, DLA không được thiết kế chủ yếu để giảm độ trễ suy luận so với TensorRT chạy hoàn toàn trên GPU. Thay vào đó, mục đích chính của nó là tăng thông lượng và cải thiện hiệu quả năng lượng.

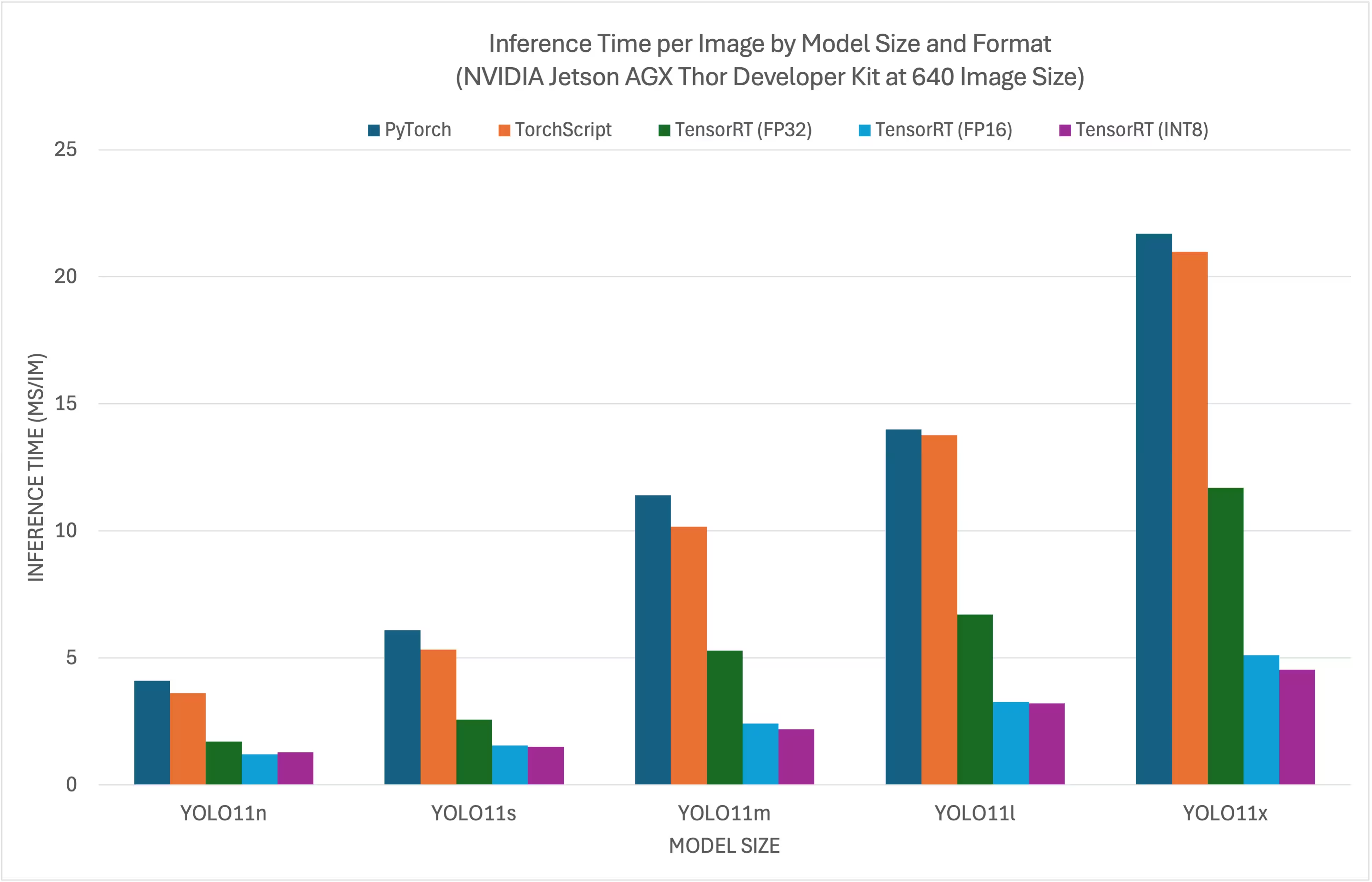

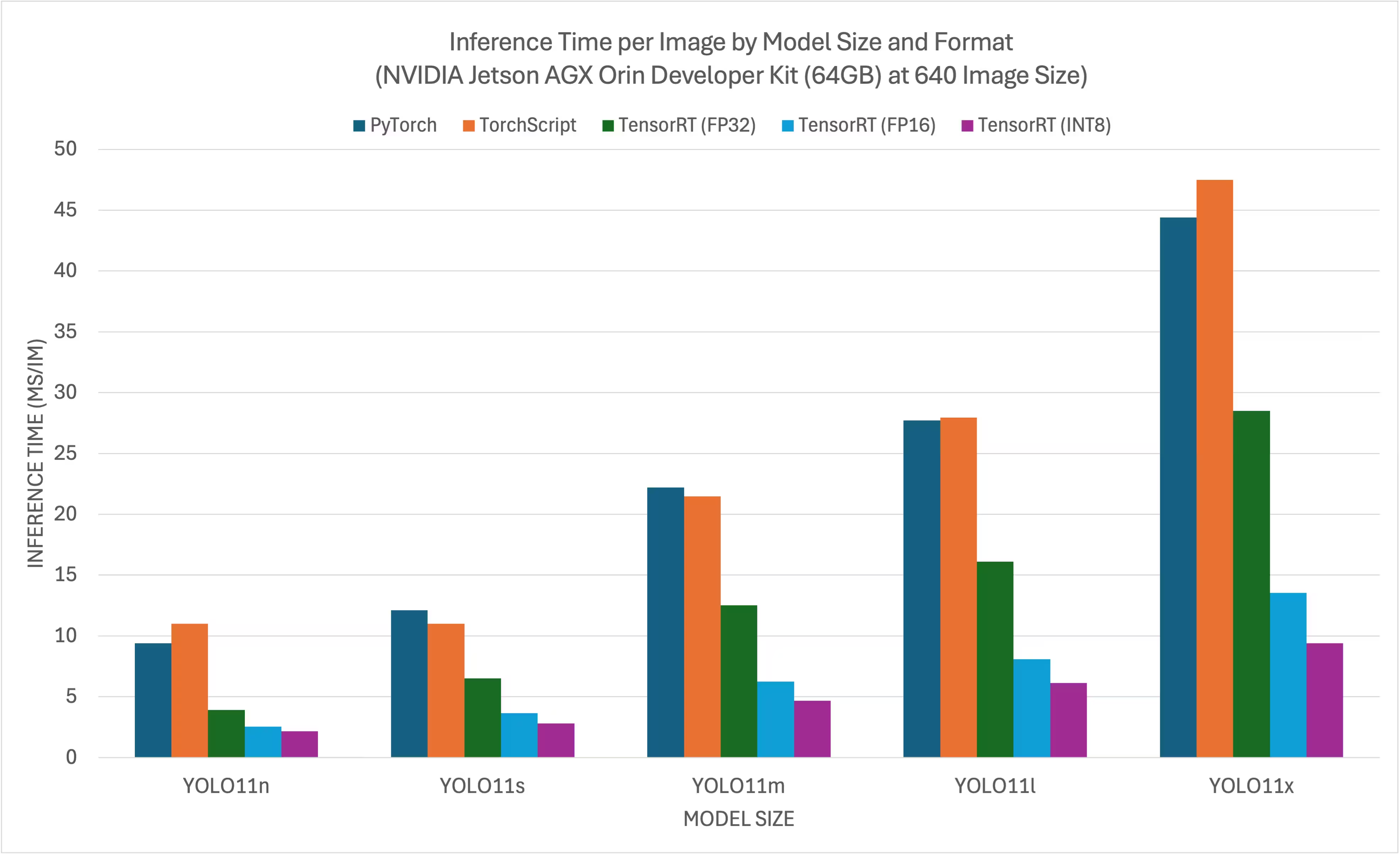

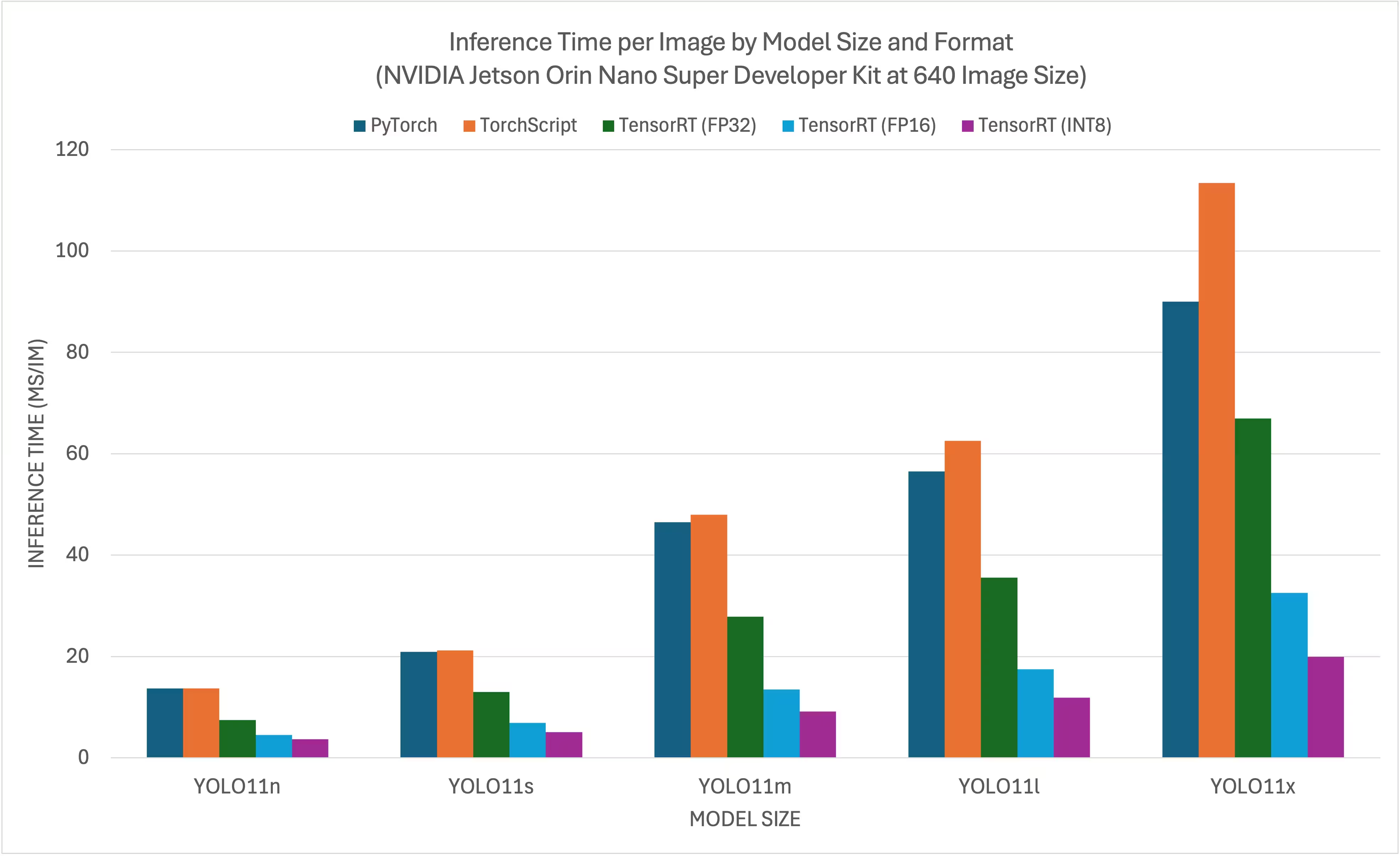

NVIDIA Jetson YOLO11 / Điểm chuẩn YOLO26

YOLO11 / Các bài kiểm tra hiệu năng YOLO26 đã được thực hiện bởi Ultralytics đội ngũ nghiên cứu trên 11 định dạng mô hình khác nhau để đo tốc độ và độ chính xác : PyTorch , TorchScript , ONNX , OpenVINO , TensorRT , TF SavedModel , TF GraphDef , TF Lite, MNN, NCNN ExecuTorch. Các bài kiểm tra hiệu năng đã được thực hiện trên NVIDIA Bộ công cụ phát triển Jetson AGX Thor, NVIDIA Bộ công cụ phát triển Jetson AGX Orin (64GB), NVIDIA Bộ phát triển Jetson Orin Nano Super Developer Kit và máy tính Seeed Studio reComputer J4012 sử dụng bộ xử lý Jetson Orin NX 16GB với độ chính xác FP32 và kích thước ảnh đầu vào mặc định là 640.

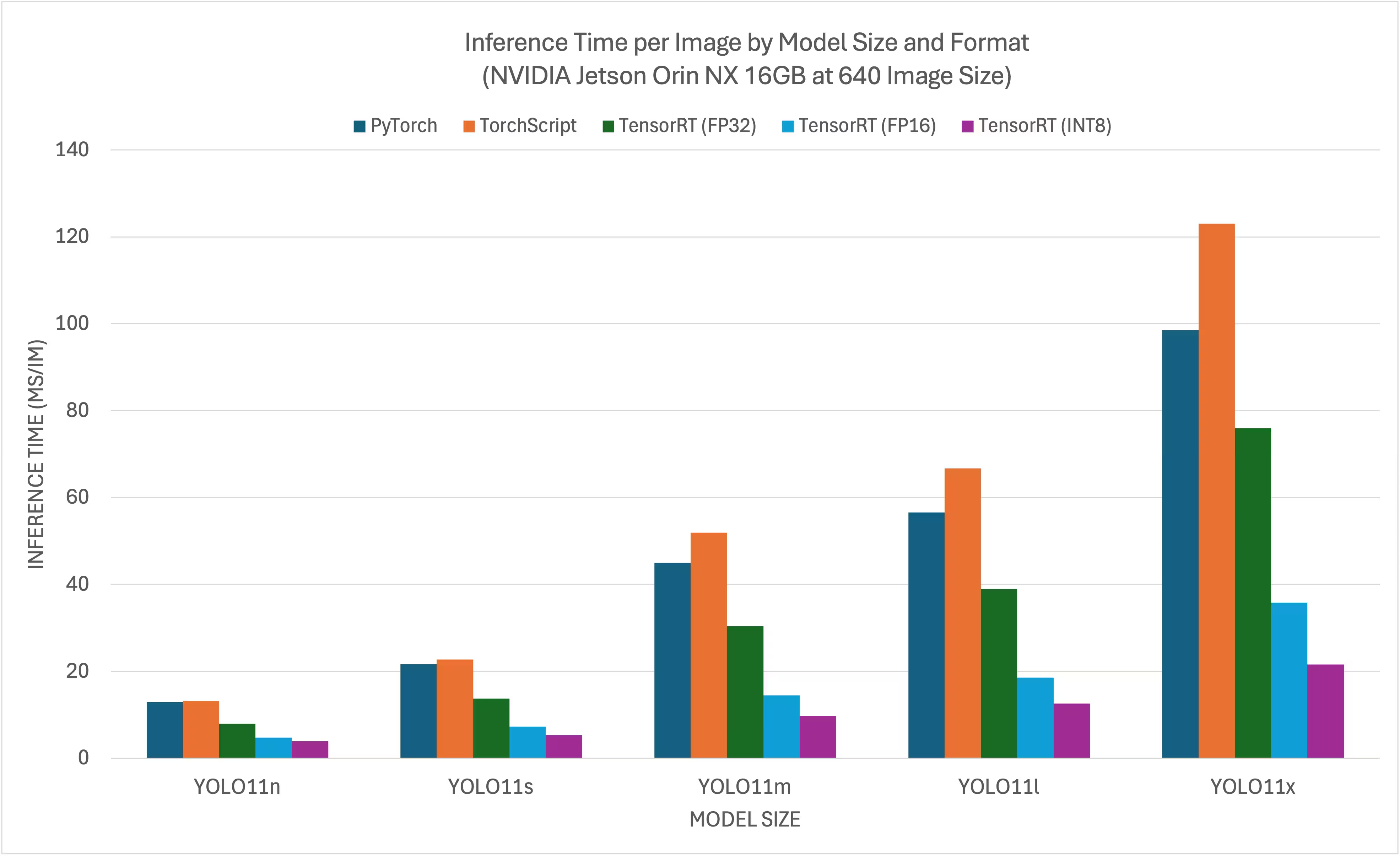

Biểu đồ So sánh

Mặc dù tất cả các định dạng xuất mô hình đều hoạt động trên NVIDIA Jetson, chúng tôi chỉ đưa vào PyTorch, TorchScript, TensorRT cho biểu đồ so sánh dưới đây vì chúng tận dụng GPU trên Jetson và được đảm bảo mang lại kết quả tốt nhất. Tất cả các định dạng xuất khác chỉ sử dụng CPU và hiệu suất không tốt bằng ba định dạng trên. Bạn có thể tìm thấy kết quả kiểm tra hiệu năng cho tất cả các định dạng xuất trong phần sau biểu đồ này.

Bộ công cụ phát triển NVIDIA Jetson AGX Thor

NVIDIA Jetson AGX Orin Developer Kit (64GB)

NVIDIA Jetson Orin Nano Super Developer Kit

NVIDIA Jetson Orin NX 16GB

Bảng so sánh chi tiết

Bảng dưới đây trình bày kết quả kiểm tra hiệu năng cho năm mô hình khác nhau (YOLO11n, YOLO11s, YOLO11m, YOLO11l, YOLO11x) trên 11 định dạng khác nhau (PyTorch, TorchScript, ONNX, OpenVINO, TensorRT, TF SavedModel, TF GraphDef, TF Lite, MNN, NCNN, ExecuTorch), cung cấp cho chúng ta trạng thái, kích thước, chỉ số mAP50-95(B) và thời gian suy luận cho mỗi sự kết hợp.

Bộ công cụ phát triển NVIDIA Jetson AGX Thor

Hiệu suất

| Định dạng | Trạng thái | Dung lượng trên ổ cứng (MB) | mAP50-95(B) | Thời gian suy luận (ms/ảnh) |

|---|---|---|---|---|

| PyTorch | ✅ | 5.3 | 0.4798 | 7.39 |

| TorchScript | ✅ | 9.8 | 0.4789 | 4.21 |

| ONNX | ✅ | 9.5 | 0.4767 | 6.58 |

| OpenVINO | ✅ | 10.1 | 0.4794 | 17.50 |

| TensorRT (FP32) | ✅ | 13.9 | 0.4791 | 1.90 |

| TensorRT (FP16) | ✅ | 7.6 | 0.4797 | 1.39 |

| TensorRT (INT8) | ✅ | 6.5 | 0.4273 | 1.52 |

| TF SavedModel | ✅ | 25.7 | 0.4764 | 47.24 |

| TF GraphDef | ✅ | 9.5 | 0.4764 | 45.98 |

| TF Lite | ✅ | 9.9 | 0.4764 | 182.04 |

| MNN | ✅ | 9.4 | 0.4784 | 21.83 |

| Định dạng | Trạng thái | Dung lượng trên ổ cứng (MB) | mAP50-95(B) | Thời gian suy luận (ms/ảnh) |

|---|---|---|---|---|

| PyTorch | ✅ | 19.5 | 0.5738 | 7.99 |

| TorchScript | ✅ | 36.8 | 0.5664 | 6.01 |

| ONNX | ✅ | 36.5 | 0.5666 | 9.31 |

| OpenVINO | ✅ | 38.5 | 0.5656 | 35.56 |

| TensorRT (FP32) | ✅ | 38.9 | 0.5664 | 2.95 |

| TensorRT (FP16) | ✅ | 21.0 | 0.5650 | 1.77 |

| TensorRT (INT8) | ✅ | 13.5 | 0.5010 | 1.75 |

| TF SavedModel | ✅ | 96.6 | 0.5665 | 88.87 |

| TF GraphDef | ✅ | 36.5 | 0.5665 | 89.20 |

| TF Lite | ✅ | 36.9 | 0.5665 | 604.25 |

| MNN | ✅ | 36.4 | 0.5651 | 53.75 |

| Định dạng | Trạng thái | Dung lượng trên ổ cứng (MB) | mAP50-95(B) | Thời gian suy luận (ms/ảnh) |

|---|---|---|---|---|

| PyTorch | ✅ | 42.2 | 0.6237 | 10.76 |

| TorchScript | ✅ | 78.5 | 0.6217 | 10.57 |

| ONNX | ✅ | 78.2 | 0.6211 | 14.91 |

| OpenVINO | ✅ | 82.2 | 0.6204 | 86.27 |

| TensorRT (FP32) | ✅ | 82.2 | 0.6230 | 5.56 |

| TensorRT (FP16) | ✅ | 41.6 | 0.6209 | 2.58 |

| TensorRT (INT8) | ✅ | 24.3 | 0.5595 | 2.49 |

| TF SavedModel | ✅ | 205.8 | 0.6229 | 200.96 |

| TF GraphDef | ✅ | 78.2 | 0.6229 | 203.00 |

| TF Lite | ✅ | 78.6 | 0.6229 | 1867.12 |

| MNN | ✅ | 78.0 | 0.6176 | 142.00 |

| Định dạng | Trạng thái | Dung lượng trên ổ cứng (MB) | mAP50-95(B) | Thời gian suy luận (ms/ảnh) |

|---|---|---|---|---|

| PyTorch | ✅ | 50.7 | 0.6258 | 13.34 |

| TorchScript | ✅ | 95.5 | 0.6248 | 13.86 |

| ONNX | ✅ | 95.0 | 0.6247 | 18.44 |

| OpenVINO | ✅ | 99.9 | 0.6238 | 106.67 |

| TensorRT (FP32) | ✅ | 99.0 | 0.6249 | 6.74 |

| TensorRT (FP16) | ✅ | 50.3 | 0.6243 | 3.34 |

| TensorRT (INT8) | ✅ | 29.0 | 0.5708 | 3.24 |

| TF SavedModel | ✅ | 250.0 | 0.6245 | 259.74 |

| TF GraphDef | ✅ | 95.0 | 0.6245 | 263.42 |

| TF Lite | ✅ | 95.4 | 0.6245 | 2367.83 |

| MNN | ✅ | 94.8 | 0.6272 | 174.39 |

| Định dạng | Trạng thái | Dung lượng trên ổ cứng (MB) | mAP50-95(B) | Thời gian suy luận (ms/ảnh) |

|---|---|---|---|---|

| PyTorch | ✅ | 113.2 | 0.6565 | 20.92 |

| TorchScript | ✅ | 213.5 | 0.6595 | 21.76 |

| ONNX | ✅ | 212.9 | 0.6590 | 26.72 |

| OpenVINO | ✅ | 223.6 | 0.6620 | 205.27 |

| TensorRT (FP32) | ✅ | 217.2 | 0.6593 | 12.29 |

| TensorRT (FP16) | ✅ | 112.1 | 0.6611 | 5.16 |

| TensorRT (INT8) | ✅ | 58.9 | 0.5222 | 4.72 |

| TF SavedModel | ✅ | 559.2 | 0.6593 | 498.85 |

| TF GraphDef | ✅ | 213.0 | 0.6593 | 507.43 |

| TF Lite | ✅ | 213.3 | 0.6593 | 5134.22 |

| MNN | ✅ | 212.8 | 0.6625 | 347.84 |

Được đánh giá hiệu năng với Ultralytics 8.4.7

Lưu ý

Thời gian suy luận không bao gồm tiền/hậu xử lý.

NVIDIA Jetson AGX Orin Developer Kit (64GB)

Hiệu suất

| Định dạng | Trạng thái | Dung lượng trên ổ cứng (MB) | mAP50-95(B) | Thời gian suy luận (ms/ảnh) |

|---|---|---|---|---|

| PyTorch | ✅ | 5.3 | 0.4790 | 11.58 |

| TorchScript | ✅ | 9.8 | 0.4770 | 4.60 |

| ONNX | ✅ | 9.5 | 0.4770 | 9.87 |

| OpenVINO | ✅ | 9.6 | 0.4820 | 28.80 |

| TensorRT (FP32) | ✅ | 11.5 | 0.0450 | 4.18 |

| TensorRT (FP16) | ✅ | 7.9 | 0.0450 | 2.62 |

| TensorRT (INT8) | ✅ | 5.4 | 0.4640 | 2.30 |

| TF SavedModel | ✅ | 24.6 | 0.4760 | 71.10 |

| TF GraphDef | ✅ | 9.5 | 0.4760 | 70.02 |

| TF Lite | ✅ | 9.9 | 0.4760 | 227.94 |

| MNN | ✅ | 9.4 | 0.4760 | 32.46 |

| NCNN | ✅ | 9.3 | 0.4810 | 29.93 |

| Định dạng | Trạng thái | Dung lượng trên ổ cứng (MB) | mAP50-95(B) | Thời gian suy luận (ms/ảnh) |

|---|---|---|---|---|

| PyTorch | ✅ | 20.0 | 0.5730 | 13.18 |

| TorchScript | ✅ | 36.8 | 0.5670 | 11.48 |

| ONNX | ✅ | 36.5 | 0.5660 | 13.47 |

| OpenVINO | ✅ | 36.7 | 0.5650 | 58.30 |

| TensorRT (FP32) | ✅ | 38.5 | 0.5660 | 6.82 |

| TensorRT (FP16) | ✅ | 21.9 | 0.5660 | 3.76 |

| TensorRT (INT8) | ✅ | 12.5 | 0.5480 | 2.98 |

| TF SavedModel | ✅ | 92.2 | 0.5660 | 145.62 |

| TF GraphDef | ✅ | 36.5 | 0.5660 | 146.26 |

| TF Lite | ✅ | 36.9 | 0.5660 | 753.52 |

| MNN | ✅ | 36.4 | 0.5650 | 79.50 |

| NCNN | ✅ | 36.4 | 0.5700 | 58.73 |

| Định dạng | Trạng thái | Dung lượng trên ổ cứng (MB) | mAP50-95(B) | Thời gian suy luận (ms/ảnh) |

|---|---|---|---|---|

| PyTorch | ✅ | 43.0 | 0.6220 | 19.36 |

| TorchScript | ✅ | 78.5 | 0.6230 | 20.02 |

| ONNX | ✅ | 78.2 | 0.6230 | 25.40 |

| OpenVINO | ✅ | 78.3 | 0.6190 | 130.76 |

| TensorRT (FP32) | ✅ | 80.2 | 0.6220 | 12.60 |

| TensorRT (FP16) | ✅ | 42.5 | 0.6220 | 6.24 |

| TensorRT (INT8) | ✅ | 23.4 | 0.5820 | 4.72 |

| TF SavedModel | ✅ | 196.3 | 0.6230 | 306.76 |

| TF GraphDef | ✅ | 78.2 | 0.6230 | 314.23 |

| TF Lite | ✅ | 78.5 | 0.6230 | 2331.63 |

| MNN | ✅ | 78.0 | 0.6220 | 206.93 |

| NCNN | ✅ | 78.0 | 0.6220 | 143.03 |

| Định dạng | Trạng thái | Dung lượng trên ổ cứng (MB) | mAP50-95(B) | Thời gian suy luận (ms/ảnh) |

|---|---|---|---|---|

| PyTorch | ✅ | 51.0 | 0.6230 | 23.53 |

| TorchScript | ✅ | 95.5 | 0.6250 | 24.23 |

| ONNX | ✅ | 95.0 | 0.6250 | 31.73 |

| OpenVINO | ✅ | 95.3 | 0.6240 | 162.80 |

| TensorRT (FP32) | ✅ | 97.3 | 0.6250 | 15.90 |

| TensorRT (FP16) | ✅ | 51.4 | 0.6240 | 7.93 |

| TensorRT (INT8) | ✅ | 29.9 | 0.5920 | 5.97 |

| TF SavedModel | ✅ | 238.4 | 0.6250 | 394.30 |

| TF GraphDef | ✅ | 95.0 | 0.6250 | 398.63 |

| TF Lite | ✅ | 95.4 | 0.6250 | 2925.27 |

| MNN | ✅ | 94.8 | 0.6250 | 255.87 |

| NCNN | ✅ | 94.8 | 0.6320 | 177.70 |

| Định dạng | Trạng thái | Dung lượng trên ổ cứng (MB) | mAP50-95(B) | Thời gian suy luận (ms/ảnh) |

|---|---|---|---|---|

| PyTorch | ✅ | 114 | 0.6610 | 38.37 |

| TorchScript | ✅ | 213.5 | 0.6590 | 41.23 |

| ONNX | ✅ | 212.9 | 0.6590 | 52.03 |

| OpenVINO | ✅ | 213.2 | 0.6590 | 300.40 |

| TensorRT (FP32) | ✅ | 215.2 | 0.6590 | 28.43 |

| TensorRT (FP16) | ✅ | 110.3 | 0.6570 | 13.50 |

| TensorRT (INT8) | ✅ | 59.9 | 0.6080 | 9.33 |

| TF SavedModel | ✅ | 533.3 | 0.6590 | 738.60 |

| TF GraphDef | ✅ | 212.9 | 0.6590 | 785.70 |

| TF Lite | ✅ | 217.6 | 0.6900 | 6476.80 |

| MNN | ✅ | 213.3 | 0.6590 | 519.77 |

| NCNN | ✅ | 212.8 | 0.6670 | 300.00 |

Được so sánh với Ultralytics 8.4.32

Lưu ý

Thời gian suy luận không bao gồm tiền/hậu xử lý.

NVIDIA Jetson Orin Nano Super Developer Kit

Hiệu suất

| Định dạng | Trạng thái | Dung lượng trên ổ cứng (MB) | mAP50-95(B) | Thời gian suy luận (ms/ảnh) |

|---|---|---|---|---|

| PyTorch | ✅ | 5.3 | 0.4790 | 15.60 |

| TorchScript | ✅ | 9.8 | 0.4770 | 12.60 |

| ONNX | ✅ | 9.5 | 0.4760 | 15.76 |

| OpenVINO | ✅ | 9.6 | 0.4820 | 56.23 |

| TensorRT (FP32) | ✅ | 11.3 | 0.4770 | 7.53 |

| TensorRT (FP16) | ✅ | 8.1 | 0.4800 | 4.57 |

| TensorRT (INT8) | ✅ | 5.3 | 0.4490 | 3.80 |

| TF SavedModel | ✅ | 24.6 | 0.4760 | 118.33 |

| TF GraphDef | ✅ | 9.5 | 0.4760 | 116.30 |

| TF Lite | ✅ | 9.9 | 0.4760 | 286.00 |

| MNN | ✅ | 9.4 | 0.4760 | 68.77 |

| NCNN | ✅ | 9.3 | 0.4810 | 47.50 |

| Định dạng | Trạng thái | Dung lượng trên ổ cứng (MB) | mAP50-95(B) | Thời gian suy luận (ms/ảnh) |

|---|---|---|---|---|

| PyTorch | ✅ | 20.0 | 0.5730 | 22.83 |

| TorchScript | ✅ | 36.8 | 0.5670 | 21.83 |

| ONNX | ✅ | 36.5 | 0.5664 | 26.29 |

| OpenVINO | ✅ | 36.7 | 0.5653 | 127.09 |

| TensorRT (FP32) | ✅ | 38.2 | 0.5664 | 13.60 |

| TensorRT (FP16) | ✅ | 21.3 | 0.5649 | 7.17 |

| TensorRT (INT8) | ✅ | 12.7 | 0.5468 | 5.25 |

| TF SavedModel | ✅ | 92.2 | 0.5665 | 263.69 |

| TF GraphDef | ✅ | 36.5 | 0.5665 | 268.21 |

| TF Lite | ✅ | 36.9 | 0.5665 | 949.63 |

| MNN | ✅ | 36.4 | 0.5644 | 184.68 |

| NCNN | ✅ | 36.4 | 0.5697 | 107.48 |

| Định dạng | Trạng thái | Dung lượng trên ổ cứng (MB) | mAP50-95(B) | Thời gian suy luận (ms/ảnh) |

|---|---|---|---|---|

| PyTorch | ✅ | 43.0 | 0.6220 | 44.43 |

| TorchScript | ✅ | 78.5 | 0.6230 | 44.00 |

| ONNX | ✅ | 78.2 | 0.6225 | 53.44 |

| OpenVINO | ✅ | 78.3 | 0.6186 | 303.26 |

| TensorRT (FP32) | ✅ | 80.0 | 0.6217 | 28.19 |

| TensorRT (FP16) | ✅ | 42.6 | 0.6225 | 13.59 |

| TensorRT (INT8) | ✅ | 23.4 | 0.5817 | 9.30 |

| TF SavedModel | ✅ | 196.3 | 0.6229 | 636.03 |

| TF GraphDef | ✅ | 78.2 | 0.6229 | 659.57 |

| TF Lite | ✅ | 78.5 | 0.6229 | 2905.17 |

| MNN | ✅ | 78.0 | 0.6168 | 500.09 |

| NCNN | ✅ | 78.0 | 0.6224 | 332.39 |

| Định dạng | Trạng thái | Dung lượng trên ổ cứng (MB) | mAP50-95(B) | Thời gian suy luận (ms/ảnh) |

|---|---|---|---|---|

| PyTorch | ✅ | 51.0 | 0.6230 | 60.97 |

| TorchScript | ✅ | 95.5 | 0.6250 | 56.20 |

| ONNX | ✅ | 95.0 | 0.6247 | 68.12 |

| OpenVINO | ✅ | 95.3 | 0.6238 | 397.84 |

| TensorRT (FP32) | ✅ | 97.1 | 0.6250 | 35.88 |

| TensorRT (FP16) | ✅ | 51.4 | 0.6225 | 17.42 |

| TensorRT (INT8) | ✅ | 30.0 | 0.5923 | 11.83 |

| TF SavedModel | ✅ | 238.4 | 0.6245 | 835.83 |

| TF GraphDef | ✅ | 95.0 | 0.6245 | 852.16 |

| TF Lite | ✅ | 95.4 | 0.6245 | 3650.85 |

| MNN | ✅ | 94.8 | 0.6257 | 612.37 |

| NCNN | ✅ | 94.8 | 0.6323 | 405.45 |

| Định dạng | Trạng thái | Dung lượng trên ổ cứng (MB) | mAP50-95(B) | Thời gian suy luận (ms/ảnh) |

|---|---|---|---|---|

| PyTorch | ✅ | 113.2 | 0.6561 | 98.44 |

| TorchScript | ✅ | 214.0 | 0.6593 | 98.0 |

| ONNX | ✅ | 212.9 | 0.6595 | 122.43 |

| OpenVINO | ✅ | 213.2 | 0.6592 | 760.72 |

| TensorRT (FP32) | ✅ | 215.1 | 0.6593 | 67.17 |

| TensorRT (FP16) | ✅ | 110.2 | 0.6637 | 32.60 |

| TensorRT (INT8) | ✅ | 59.9 | 0.6170 | 19.99 |

| TF SavedModel | ✅ | 533.3 | 0.6593 | 1647.06 |

| TF GraphDef | ✅ | 212.9 | 0.6593 | 1670.30 |

| TF Lite | ✅ | 213.3 | 0.6590 | 8066.30 |

| MNN | ✅ | 212.8 | 0.6600 | 1227.90 |

| NCNN | ✅ | 212.8 | 0.6666 | 782.24 |

Được so sánh với Ultralytics 8.4.33

Lưu ý

Thời gian suy luận không bao gồm tiền/hậu xử lý.

NVIDIA Jetson Orin NX 16GB

Hiệu suất

| Định dạng | Trạng thái | Dung lượng trên ổ cứng (MB) | mAP50-95(B) | Thời gian suy luận (ms/ảnh) |

|---|---|---|---|---|

| PyTorch | ✅ | 5.3 | 0.4799 | 13.90 |

| TorchScript | ✅ | 9.8 | 0.4787 | 11.60 |

| ONNX | ✅ | 9.5 | 0.4763 | 14.18 |

| OpenVINO | ✅ | 9.6 | 0.4819 | 40.19 |

| TensorRT (FP32) | ✅ | 11.4 | 0.4770 | 7.01 |

| TensorRT (FP16) | ✅ | 8.0 | 0.4789 | 4.13 |

| TensorRT (INT8) | ✅ | 5.5 | 0.4489 | 3.49 |

| TF SavedModel | ✅ | 24.6 | 0.4764 | 92.34 |

| TF GraphDef | ✅ | 9.5 | 0.4764 | 92.06 |

| TF Lite | ✅ | 9.9 | 0.4764 | 254.43 |

| MNN | ✅ | 9.4 | 0.4760 | 48.55 |

| NCNN | ✅ | 9.3 | 0.4805 | 34.31 |

| Định dạng | Trạng thái | Dung lượng trên ổ cứng (MB) | mAP50-95(B) | Thời gian suy luận (ms/ảnh) |

|---|---|---|---|---|

| PyTorch | ✅ | 19.5 | 0.5738 | 20.40 |

| TorchScript | ✅ | 36.8 | 0.5664 | 19.20 |

| ONNX | ✅ | 36.5 | 0.5664 | 24.35 |

| OpenVINO | ✅ | 36.7 | 0.5653 | 88.18 |

| TensorRT (FP32) | ✅ | 38.5 | 0.5664 | 12.62 |

| TensorRT (FP16) | ✅ | 21.5 | 0.5652 | 6.41 |

| TensorRT (INT8) | ✅ | 12.6 | 0.5468 | 4.78 |

| TF SavedModel | ✅ | 92.2 | 0.5665 | 195.16 |

| TF GraphDef | ✅ | 36.5 | 0.5665 | 197.57 |

| TF Lite | ✅ | 36.9 | 0.5665 | 827.48 |

| MNN | ✅ | 36.4 | 0.5649 | 123.47 |

| NCNN | ✅ | 36.4 | 0.5697 | 74.04 |

| Định dạng | Trạng thái | Dung lượng trên ổ cứng (MB) | mAP50-95(B) | Thời gian suy luận (ms/ảnh) |

|---|---|---|---|---|

| PyTorch | ✅ | 42.2 | 0.6237 | 38.60 |

| TorchScript | ✅ | 78.5 | 0.6227 | 40.50 |

| ONNX | ✅ | 78.2 | 0.6225 | 48.87 |

| OpenVINO | ✅ | 78.3 | 0.6186 | 205.69 |

| TensorRT (FP32) | ✅ | 80.1 | 0.6217 | 24.69 |

| TensorRT (FP16) | ✅ | 42.6 | 0.6225 | 11.66 |

| TensorRT (INT8) | ✅ | 23.4 | 0.5817 | 8.22 |

| TF SavedModel | ✅ | 196.3 | 0.6229 | 451.48 |

| TF GraphDef | ✅ | 78.2 | 0.6229 | 460.94 |

| TF Lite | ✅ | 78.5 | 0.6229 | 2555.53 |

| MNN | ✅ | 78.0 | 0.6217 | 333.33 |

| NCNN | ✅ | 78.0 | 0.6224 | 214.60 |

| Định dạng | Trạng thái | Dung lượng trên ổ cứng (MB) | mAP50-95(B) | Thời gian suy luận (ms/ảnh) |

|---|---|---|---|---|

| PyTorch | ✅ | 50.7 | 0.6258 | 48.60 |

| TorchScript | ✅ | 95.5 | 0.6249 | 51.60 |

| ONNX | ✅ | 95.0 | 0.6247 | 61.95 |

| OpenVINO | ✅ | 95.3 | 0.6238 | 272.47 |

| TensorRT (FP32) | ✅ | 97.1 | 0.6250 | 31.64 |

| TensorRT (FP16) | ✅ | 51.4 | 0.6225 | 14.77 |

| TensorRT (INT8) | ✅ | 30.0 | 0.5923 | 10.49 |

| TF SavedModel | ✅ | 238.4 | 0.6245 | 596.46 |

| TF GraphDef | ✅ | 95.0 | 0.6245 | 606.10 |

| TF Lite | ✅ | 95.4 | 0.6245 | 3275.55 |

| MNN | ✅ | 94.8 | 0.6247 | 408.15 |

| NCNN | ✅ | 94.8 | 0.6323 | 262.99 |

| Định dạng | Trạng thái | Dung lượng trên ổ cứng (MB) | mAP50-95(B) | Thời gian suy luận (ms/ảnh) |

|---|---|---|---|---|

| PyTorch | ✅ | 113.2 | 0.6561 | 84.40 |

| TorchScript | ✅ | 213.5 | 0.6594 | 91.20 |

| ONNX | ✅ | 212.9 | 0.6595 | 109.34 |

| OpenVINO | ✅ | 213.2 | 0.6592 | 520.88 |

| TensorRT (FP32) | ✅ | 215.1 | 0.6593 | 57.18 |

| TensorRT (FP16) | ✅ | 109.7 | 0.6632 | 26.76 |

| TensorRT (INT8) | ✅ | 60.0 | 0.6170 | 17.32 |

| TF SavedModel | ✅ | 533.3 | 0.6593 | 1170.50 |

| TF GraphDef | ✅ | 212.9 | 0.6593 | 1217.87 |

| TF Lite | ✅ | 213.3 | 0.6593 | 7247.11 |

| MNN | ✅ | 212.8 | 0.6591 | 820.90 |

| NCNN | ✅ | 212.8 | 0.6666 | 534.30 |

Được so sánh với Ultralytics 8.4.33

Lưu ý

Thời gian suy luận không bao gồm tiền/hậu xử lý.

Khám phá thêm các nỗ lực đo điểm chuẩn của Seeed Studio chạy trên các phiên bản phần cứng NVIDIA Jetson khác nhau.

Tái tạo Kết quả của Chúng tôi

Để tái tạo các điểm chuẩn Ultralytics ở trên trên tất cả các định dạng xuất, hãy chạy đoạn mã này:

Ví dụ

from ultralytics import YOLO

# Load a YOLO11n PyTorch model

model = YOLO("yolo11n.pt")

# Benchmark YOLO11n speed and accuracy on the COCO128 dataset for all export formats

results = model.benchmark(data="coco128.yaml", imgsz=640)

# Benchmark YOLO11n speed and accuracy on the COCO128 dataset for all export formats

yolo benchmark model=yolo11n.pt data=coco128.yaml imgsz=640

Lưu ý rằng kết quả đánh giá hiệu năng có thể khác nhau dựa trên cấu hình phần cứng và phần mềm chính xác của một hệ thống, cũng như khối lượng công việc hiện tại của hệ thống tại thời điểm chạy đánh giá hiệu năng. Để có kết quả đáng tin cậy nhất, hãy sử dụng tập dữ liệu có số lượng ảnh lớn, ví dụ: data='coco.yaml' (5000 ảnh val).

Các phương pháp tốt nhất khi sử dụng NVIDIA Jetson

Khi sử dụng NVIDIA Jetson, có một số phương pháp hay nhất cần tuân thủ để đạt được hiệu suất tối đa trên NVIDIA Jetson khi chạy YOLO26.

Bật Chế độ Nguồn Tối đa

Bật Chế độ Nguồn Tối đa trên Jetson sẽ đảm bảo tất cả các lõi CPU, GPU được bật.

sudo nvpmodel -m 0Bật Đồng hồ Jetson

Bật Đồng hồ Jetson sẽ đảm bảo tất cả các lõi CPU, GPU được định thời ở tần số tối đa của chúng.

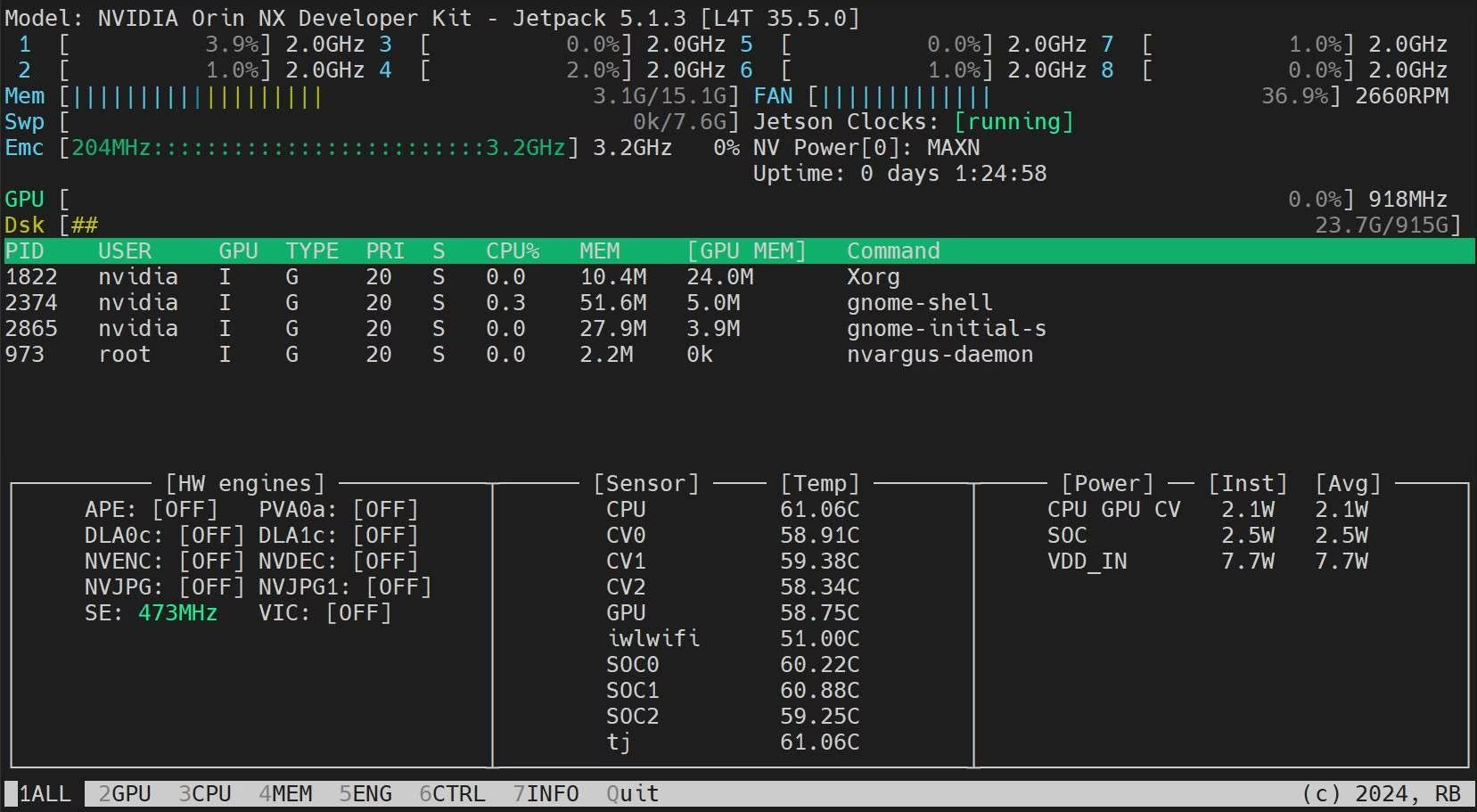

sudo jetson_clocksCài đặt Ứng dụng Jetson Stats

Chúng ta có thể sử dụng ứng dụng jetson stats để theo dõi nhiệt độ của các thành phần hệ thống và kiểm tra các chi tiết hệ thống khác, chẳng hạn như xem mức sử dụng CPU, GPU, RAM, thay đổi chế độ nguồn, đặt thành đồng hồ tối đa, kiểm tra thông tin JetPack

sudo apt update sudo pip install jetson-stats sudo reboot jtop

Mẹo tối ưu hóa bộ nhớ cho NVIDIA Jetson

Dung lượng bộ nhớ khả dụng thường là yếu tố hạn chế trên các thiết bị Jetson, đặc biệt là các phiên bản có bộ nhớ thấp hơn như Jetson Orin Nano (8 GB) hoặc Orin NX 8 GB. Các mẹo dưới đây là những thay đổi thiết thực, ít rủi ro, có thể giúp giải phóng vài trăm megabyte và cho phép bạn chạy các ứng dụng có dung lượng lớn hơn. YOLO các mô hình hoặc hỗ trợ thêm các khối lượng công việc song song. Để có thông tin toàn diện, hãy xem bài đăng trên blog NVIDIA về cách tối đa hóa hiệu quả bộ nhớ trên Jetson .

1. Chuyển sang chế độ Khởi động không giao diện đồ họa (Headless Boot/No-GUI)

Nếu Jetson của bạn được kết nối qua SSH hoặc đang chạy như một thiết bị sản xuất mà không có màn hình kèm theo, việc loại bỏ môi trường máy tính để bàn và máy chủ hiển thị có thể giúp tiết kiệm tới 865 MB RAM:

sudo systemctl set-default multi-user.target

sudo reboot

Để khôi phục màn hình nền sau này:

sudo systemctl set-default graphical.target

sudo reboot

2. Vô hiệu hóa các dịch vụ hệ thống không sử dụng

Các dịch vụ nền không thiết yếu (Bluetooth, trình quản lý kết nối, các tiến trình phần cứng không sử dụng) tiêu tốn khoảng 32 MB tổng cộng. Liệt kê các dịch vụ đang hoạt động và vô hiệu hóa bất kỳ dịch vụ nào mà hệ thống của bạn không cần:

# List running services

systemctl list-units --type=service --state=running

# Disable a service

sudo systemctl disable <service-name>

3. Hồ sơ sử dụng bộ nhớ

Trước khi tối ưu hóa, hãy xác định xem những tiến trình nào thực sự đang tiêu thụ RAM. procrank Sắp xếp các tiến trình theo PSS (Proportional Set Size), phản ánh chính xác hơn lượng bộ nhớ thực tế mà mỗi tiến trình sử dụng so với RSS (Resident Set Size, tổng số trang RAM vật lý mà một tiến trình ánh xạ, bao gồm cả các trang được chia sẻ với các tiến trình khác):

git clone https://github.com/csimmonds/procrank_linux.git

cd procrank_linux && make

sudo ./procrank

Để xem theo từng quy trình GPU và NvMap ( CUDA /phân bổ đường dẫn xử lý video):

sudo cat /sys/kernel/debug/nvmap/iovmm/clients

4. Thực hiện suy luận mà không cần màn hình hiển thị trong môi trường sản xuất

Đối với các pipeline suy luận không yêu cầu xem trước trực tiếp, việc vô hiệu hóa các thành phần liên quan đến hiển thị (Tiler, OSD, DisplaySink) có thể tiết kiệm hơn 200 MB bộ nhớ chỉ riêng cho pipeline đó. Ultralytics YOLO , ẩn trình xem và ghi kết quả vào đĩa thay vì hiển thị:

Ví dụ

from ultralytics import YOLO

model = YOLO("yolo11n.engine")

# show=False prevents any display window; save=True writes annotated output to disk

results = model.predict(source="video.mp4", show=False, save=True)

yolo predict model=yolo11n.engine source=video.mp4 show=False save=True

Tác động tích lũy

| Tối ưu hóa | Dung lượng bộ nhớ ước tính đã lưu |

|---|---|

| Vô hiệu hóa giao diện người dùng đồ họa (GUI) trên máy tính để bàn | ~865 MB |

| Vô hiệu hóa các dịch vụ hệ điều hành không sử dụng | ~32 MB |

| Hệ thống suy luận không giao diện người dùng (không có màn hình hiển thị) | ~200+ MB |

| Tổng số (thắng dễ dàng) | ~1 GB+ |

Việc kết hợp những thay đổi này đặc biệt có giá trị khi nhắm mục tiêu TensorRT Các mô hình INT8 trên các thiết bị có bộ nhớ hạn chế — điều này có thể tạo nên sự khác biệt giữa việc có thể chứa một biến thể mô hình lớn hơn trong bộ nhớ hay không.

Các bước tiếp theo

Để tìm hiểu thêm và được hỗ trợ, hãy xem Tài liệu Ultralytics YOLO26.

Câu hỏi thường gặp

Làm cách nào để triển khai Ultralytics YOLO26 trên các thiết bị NVIDIA Jetson?

Triển khai Ultralytics YOLO26 trên các thiết bị NVIDIA Jetson là một quy trình đơn giản. Đầu tiên, hãy flash thiết bị Jetson của bạn bằng NVIDIA JetPack SDK. Sau đó, bạn có thể sử dụng ảnh Docker dựng sẵn để thiết lập nhanh hoặc cài đặt thủ công các gói cần thiết. Các bước chi tiết cho từng phương pháp có thể được tìm thấy trong các phần Bắt đầu nhanh với Docker và Bắt đầu với cài đặt gốc.

Tôi có thể mong đợi những điểm chuẩn hiệu suất nào từ các mô hình YOLO11 trên các thiết bị NVIDIA Jetson?

Các mô hình YOLO11 đã được đánh giá hiệu năng trên nhiều thiết bị NVIDIA Jetson khác nhau, cho thấy những cải tiến đáng kể về hiệu suất. Ví dụ, định dạng TensorRT mang lại hiệu suất suy luận tốt nhất. Bảng trong phần Bảng so sánh chi tiết cung cấp cái nhìn toàn diện về các chỉ số hiệu suất như mAP50-95 và thời gian suy luận trên các định dạng mô hình khác nhau.

Tại sao tôi nên sử dụng TensorRT để triển khai YOLO26 trên NVIDIA Jetson?

TensorRT rất được khuyến nghị để triển khai các mô hình YOLO26 trên NVIDIA Jetson nhờ hiệu suất tối ưu của nó. Nó tăng tốc suy luận bằng cách tận dụng khả năng GPU của Jetson, đảm bảo hiệu quả và tốc độ tối đa. Tìm hiểu thêm về cách chuyển đổi sang TensorRT và chạy suy luận trong phần Sử dụng TensorRT trên NVIDIA Jetson.

Làm cách nào để cài đặt PyTorch và Torchvision trên NVIDIA Jetson?

Để cài đặt PyTorch và Torchvision trên NVIDIA Jetson, trước tiên hãy gỡ cài đặt mọi phiên bản hiện có đã được cài đặt qua pip. Sau đó, cài đặt thủ công các phiên bản PyTorch và Torchvision tương thích cho kiến trúc ARM64 của Jetson. Hướng dẫn chi tiết cho quy trình này được cung cấp trong phần Cài đặt PyTorch và Torchvision.

Các phương pháp hay nhất để tối đa hóa hiệu suất trên NVIDIA Jetson khi sử dụng YOLO26 là gì?

Để tối đa hóa hiệu suất trên NVIDIA Jetson với YOLO26, hãy làm theo các phương pháp hay nhất sau:

- Bật Chế độ Nguồn Tối đa (MAX Power Mode) để sử dụng tất cả các lõi CPU và GPU.

- Bật Jetson Clocks để chạy tất cả các lõi ở tần số tối đa của chúng.

- Cài đặt ứng dụng Jetson Stats để theo dõi các số liệu hệ thống.

Để biết các lệnh và chi tiết bổ sung, hãy tham khảo phần Các phương pháp tốt nhất khi sử dụng NVIDIA Jetson.

Làm thế nào để giải phóng bộ nhớ trên NVIDIA Jetson sẽ chạy trên quy mô lớn hơn YOLO mô hình?

Dung lượng RAM khả dụng thường là điểm nghẽn trên các thiết bị Jetson có bộ nhớ thấp. Ba giải pháp đơn giản có thể giúp bạn tiết kiệm hơn 1 GB RAM:

- Chuyển sang chế độ khởi động không có giao diện người dùng (

sudo systemctl set-default multi-user.target) để loại bỏ giao diện người dùng đồ họa trên máy tính (~tiết kiệm được 865 MB). - Tắt các dịch vụ không sử dụng như Bluetooth hoặc trình quản lý kết nối (tiết kiệm khoảng 32 MB).

- Thực hiện suy luận mà không cần màn hình hiển thị bằng cách thiết lập

show=Falsetrong bạn YOLOpredictcuộc gọi này tránh việc phân bổ bộ nhớ cho đường dẫn hiển thị (tiết kiệm được hơn 200 MB).

Sử dụng procrank để lập hồ sơ về mức sử dụng RAM cho từng tiến trình và sudo cat /sys/kernel/debug/nvmap/iovmm/clients để kiểm tra GPU phân bổ. Xem Mẹo tối ưu hóa bộ nhớ xem phần này để biết thêm chi tiết.

Tại sao tính năng xuất TensorRT của tôi lại vô hiệu hóa chế độ end-to-end trên JetPack 6?

TensorRT .3.0 đi kèm với JetPack 6 có một lỗi đã biết khiến việc biên dịch động cơ INT8 không thể thực hiện được khi end2end=True đã được bật. Khi Ultralytics sự kết hợp này, hệ thống sẽ tự động vô hiệu hóa nhánh end2end để đảm bảo quá trình xuất dữ liệu diễn ra thành công.

Để khôi phục tính năng xuất dữ liệu INT8 end-to-end, hãy nâng cấp TensorRT phiên bản mới hơn (ví dụ: 10.7.0 trở lên):

wget https://developer.download.nvidia.com/compute/cuda/repos/ubuntu2204/arm64/cuda-keyring_1.1-1_all.deb

sudo dpkg -i cuda-keyring_1.1-1_all.deb

sudo apt-get update

sudo apt-get install -y tensorrt

Sau khi nâng cấp, hãy chạy lại quá trình xuất dữ liệu. Để biết thêm chi tiết, hãy xem vấn đề GitHub #23841.