Link to this sectionEntrenamiento en la nube#

El entrenamiento en la nube de la Ultralytics Platform ofrece entrenamiento con un solo clic en GPUs en la nube, lo que hace que el entrenamiento de modelos sea accesible sin configuraciones complejas. Entrena modelos YOLO con transmisión de métricas en tiempo real y guardado automático de puntos de control.

graph LR

A[Configure] --> B[Start Training]

B --> C[Provision GPU]

C --> D[Download Dataset]

D --> E[Train]

E --> F[Stream Metrics]

F --> G[Save Checkpoints]

G --> H[Complete]

style A fill:#2196F3,color:#fff

style B fill:#FF9800,color:#fff

style E fill:#9C27B0,color:#fff

style H fill:#4CAF50,color:#fffLink to this sectionDiálogo de entrenamiento#

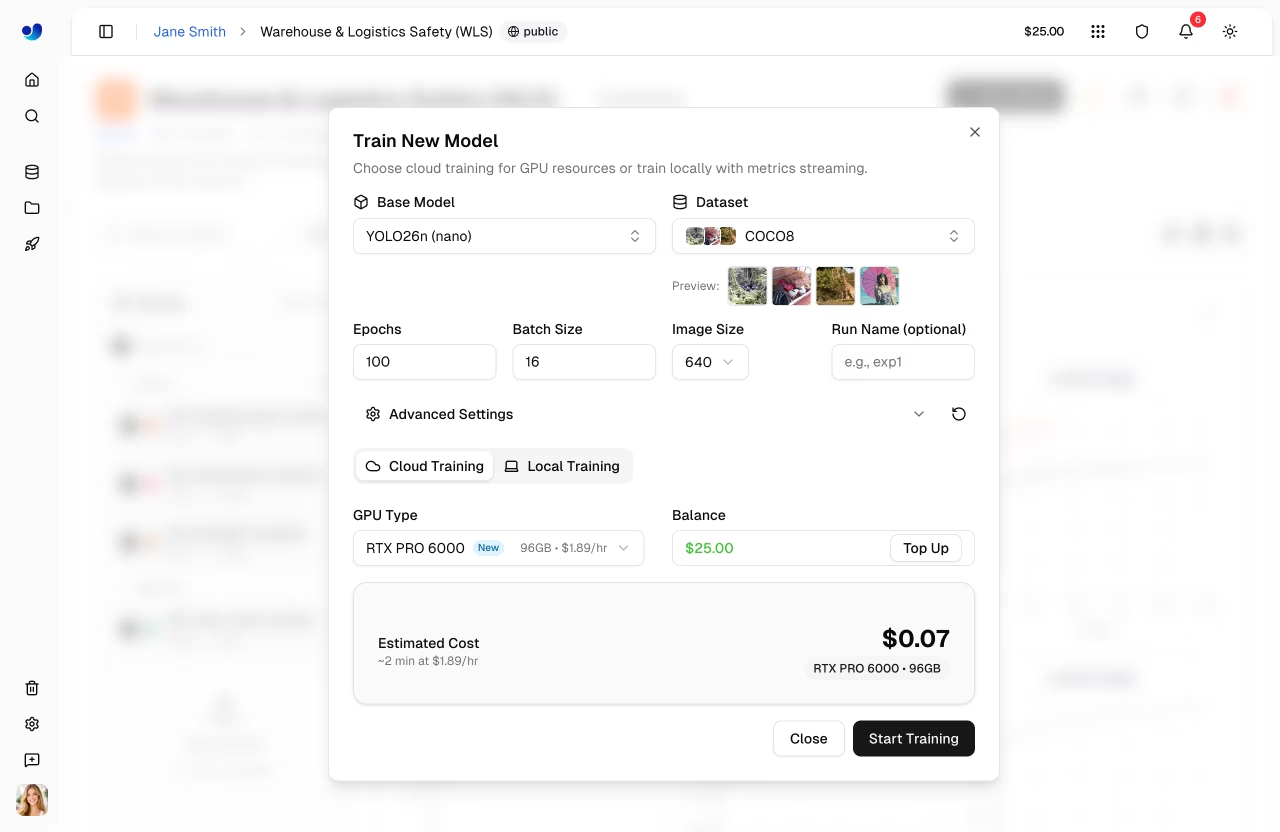

Inicia el entrenamiento desde la interfaz de usuario de la plataforma haciendo clic en New Model (Nuevo modelo) en cualquier página de proyecto (o en Train (Entrenar) desde una página de conjunto de datos). El diálogo de entrenamiento tiene dos pestañas: Cloud Training (Entrenamiento en la nube) y Local Training (Entrenamiento local).

Link to this sectionPaso 1: Seleccionar modelo base#

Elige entre los modelos oficiales de YOLO26 o tus propios modelos entrenados:

| Categoría | Descripción |

|---|---|

| Official (Oficiales) | Todos los 30 modelos de YOLO26 (5 tamaños x 6 tareas) |

| Your Models (Tus modelos) | Tus modelos completados para ajuste fino |

Los modelos oficiales están organizados por tipo de tarea (Detect, Segment, Semantic, Pose, OBB, Classify) con tamaños desde nano hasta xlarge.

Link to this sectionPaso 2: Seleccionar conjunto de datos#

Elige un conjunto de datos para entrenar (consulta Datasets):

| Opción | Descripción |

|---|---|

| Official (Oficiales) | Conjuntos de datos seleccionados por Ultralytics |

| Your Datasets (Tus conjuntos de datos) | Conjuntos de datos que has subido |

Los conjuntos de datos deben estar en estado ready (listo) con al menos 1 imagen en la división de entrenamiento, 1 imagen en la división de validación o prueba, y al menos 1 imagen etiquetada.

Aparece una advertencia de desajuste de tareas si la tarea del modelo (p. ej., detect) no coincide con la tarea del conjunto de datos (p. ej., segment). El entrenamiento fallará si procedes con tareas no coincidentes. Asegúrate de que tanto el modelo como el conjunto de datos utilicen el mismo tipo de tarea, tal como se describe en las guías de tareas.

Link to this sectionPaso 3: Configurar parámetros#

Establece los parámetros de entrenamiento principales:

| Parámetro | Descripción | Predeterminado |

|---|---|---|

| Epochs (Épocas) | Número de iteraciones de entrenamiento | 100 |

| Batch Size (Tamaño de lote) | Muestras por iteración | -1 (automático) |

| Image Size (Tamaño de imagen) | Resolución de entrada (menú desplegable 320/416/512/640/1280, cualquier múltiplo de 32 entre 32-4096 en el editor YAML) | 640 |

| Run Name (Nombre de la ejecución) | Nombre opcional para la ejecución de entrenamiento | automático |

Link to this sectionPaso 4: Configuración avanzada (opcional)#

Despliega Advanced Settings (Configuración avanzada) para acceder al editor de parámetros completo basado en YAML con más de 40 parámetros de entrenamiento organizados por grupo (consulta la referencia de configuración):

| Grupo | Parámetros |

|---|---|

| Learning Rate | lr0, lrf, momentum, weight_decay, warmup_epochs, warmup_momentum, warmup_bias_lr |

| Optimizer (Optimizador) | auto (predeterminado), SGD, MuSGD, Adam, AdamW, NAdam, RAdam, RMSProp, Adamax |

| Loss Weights (Pesos de pérdida) | box, cls, dfl, pose, kobj, label_smoothing |

| Color Augmentation (Aumentación de color) | hsv_h, hsv_s, hsv_v |

| Geometric Augment. (Aumentación geométrica) | degrees, translate, scale, shear, perspective |

| Flip & Mix Augment. (Aumentación de volteo y mezcla) | flipud, fliplr, mosaic, mixup, copy_paste |

| Training Control (Control de entrenamiento) | patience, seed, deterministic, amp, cos_lr, close_mosaic, save_period |

| Dataset (Conjunto de datos) | fraction, freeze, single_cls, rect, multi_scale, resume |

Los parámetros son sensibles a la tarea (p. ej., copy_paste solo aparece para tareas de segmentación, pose/kobj solo para tareas de pose). Aparece una insignia de Modified (Modificado) cuando los valores difieren de los predeterminados, y puedes restablecer todo a los valores predeterminados con el botón de restablecimiento.

Ejemplo: Ajuste de la aumentación para conjuntos de datos pequeños

Para conjuntos de datos pequeños (<1000 imágenes), aumenta la aumentación para reducir el sobreajuste:

mosaic: 1.0 # Keep mosaic on

mixup: 0.3 # Add mixup blending

copy_paste: 0.3 # Add copy-paste (segment only)

fliplr: 0.5 # Horizontal flip

degrees: 10.0 # Slight rotation

scale: 0.9 # Aggressive scalingLink to this sectionPaso 5: Seleccionar GPU (pestaña en la nube)#

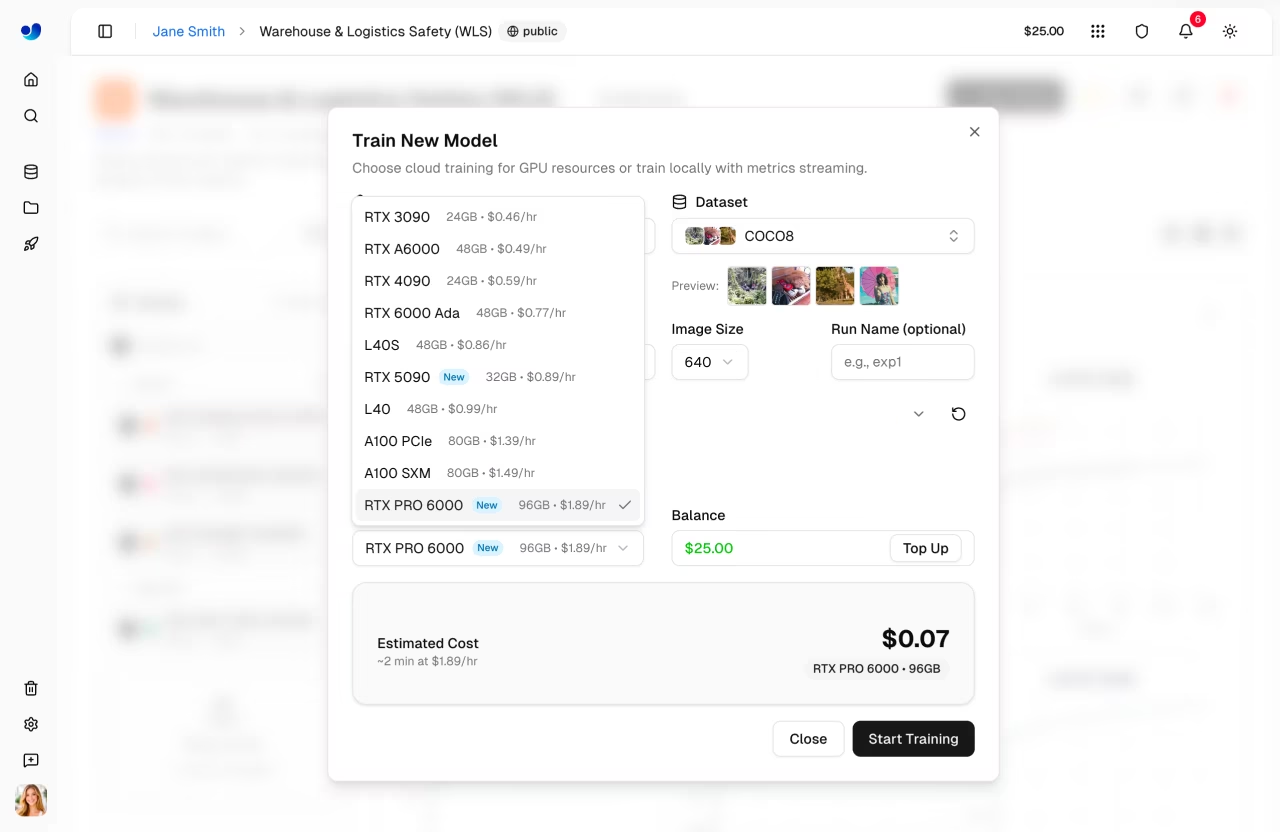

Elige tu GPU desde Ultralytics Cloud:

| GPU | Generación | VRAM | Coste/hora | Ideal para |

|---|---|---|---|---|

| RTX 2000 Ada | Ada | 16 GB | $0.24 | Datasets pequeños, pruebas |

| RTX A4500 | Ampere | 20 GB | $0.25 | Datasets pequeños a medianos |

| RTX 4000 Ada | Ada | 20 GB | $0.26 | Datasets medianos |

| RTX A5000 | Ampere | 24 GB | $0.27 | Datasets medianos |

| L4 | Ada | 24 GB | $0.39 | Optimizado para inferencia |

| A40 | Ampere | 48 GB | $0.44 | Tamaños de lote más grandes |

| RTX 3090 | Ampere | 24 GB | $0.46 | Entrenamiento general |

| RTX A6000 | Ampere | 48 GB | $0.49 | Modelos grandes |

| RTX PRO 4500 | Blackwell | 32 GB | $0.64 | Gran relación precio/rendimiento |

| RTX 4090 | Ada | 24 GB | $0.69 | Mejor relación precio/rendimiento |

| RTX 6000 Ada | Ada | 48 GB | $0.77 | Entrenamiento con lotes grandes |

| L40S | Ada | 48 GB | $0.86 | Entrenamiento con lotes grandes |

| RTX 5090 | Blackwell | 32 GB | $0.99 | Última generación de consumo |

| L40 | Ada | 48 GB | $0.99 | Modelos grandes |

| A100 PCIe | Ampere | 80 GB | $1.39 | Entrenamiento de producción |

| A100 SXM | Ampere | 80 GB | $1.49 | Entrenamiento de producción |

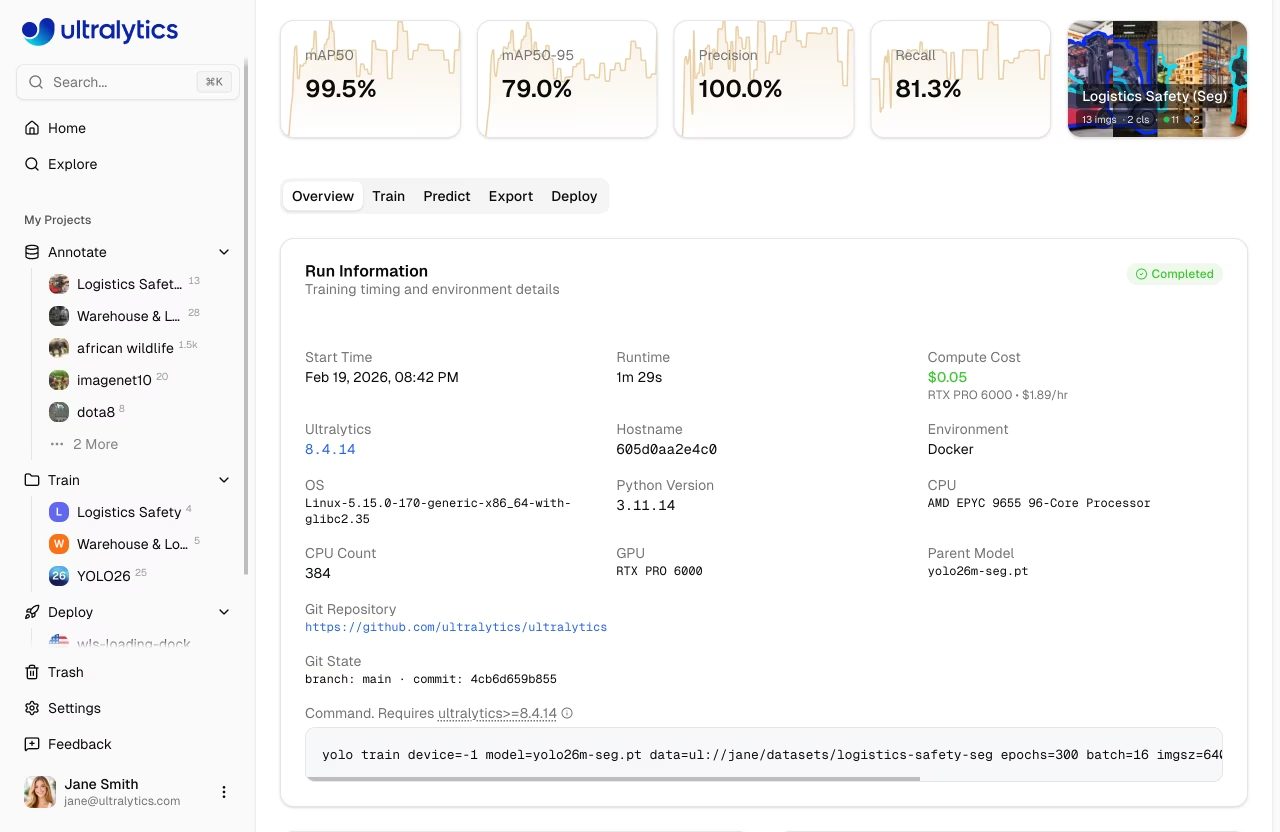

| RTX PRO 6000 | Blackwell | 96 GB | $1.89 | Predeterminado recomendado |

| H100 PCIe | Hopper | 80 GB | $2.39 | Entrenamiento de alto rendimiento |

| H100 SXM | Hopper | 80 GB | $2.99 | Entrenamiento más rápido |

| H100 NVL | Hopper | 94 GB | 3,07 $ | Máximo rendimiento |

| H200 NVL | Hopper | 143 GB | 3,39 $ | Máxima memoria |

| H200 SXM | Hopper | 141 GB | 3,99 $ | Máximo rendimiento |

| B200 | Blackwell | 180 GB | 5,49 $ | Modelos grandes (Pro+) |

| B300 | Blackwell | 288 GB | 7,39 $ | Modelos más grandes (Pro+) |

- RTX PRO 6000: 96 GB Blackwell, predeterminado recomendado para la mayoría de los trabajos

- A100 SXM: 80 GB HBM2e: una opción sólida para tamaños de lote grandes o modelos más grandes

- H100 PCIe / H100 SXM / H100 NVL: 80–94 GB Hopper para entrenamientos sensibles al tiempo (disponible en todos los planes)

- H200 NVL / H200 SXM: 141–143 GB Hopper para cargas de trabajo con alta memoria (disponible en todos los planes)

- B200 / B300: 180–288 GB NVIDIA Blackwell para cargas de trabajo de vanguardia; requiere Pro o Enterprise

El diálogo muestra tu balance actual y un botón de Top Up (Recargar). El coste y la duración estimados se calculan en función de tu configuración (tamaño del modelo, imágenes del conjunto de datos, épocas, velocidad de la GPU).

Link to this sectionPaso 6: Iniciar entrenamiento#

Haz clic en Start Training (Iniciar entrenamiento) para lanzar tu trabajo. La plataforma:

- Aprovisiona una instancia de GPU

- Descarga tu conjunto de datos

- Comienza el entrenamiento

- Transmite métricas en tiempo real

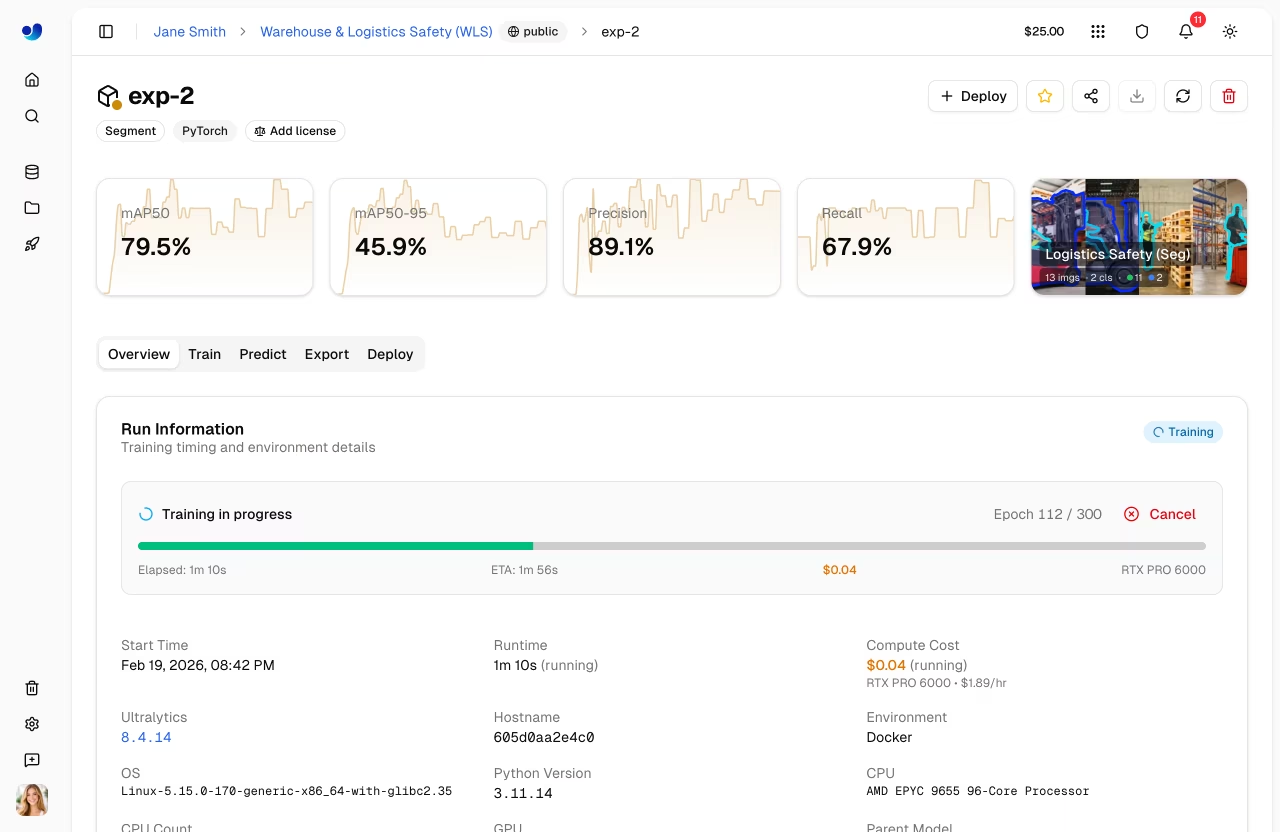

Link to this sectionCiclo de vida del trabajo de entrenamiento#

Los trabajos de entrenamiento progresan a través de los siguientes estados:

| Estado | Descripción |

|---|---|

| Pending (Pendiente) | Trabajo enviado, esperando asignación de GPU |

| Starting (Iniciando) | GPU aprovisionada, descargando conjunto de datos y modelo |

| Running (Ejecutándose) | Entrenamiento en curso, métricas transmitiéndose en tiempo real |

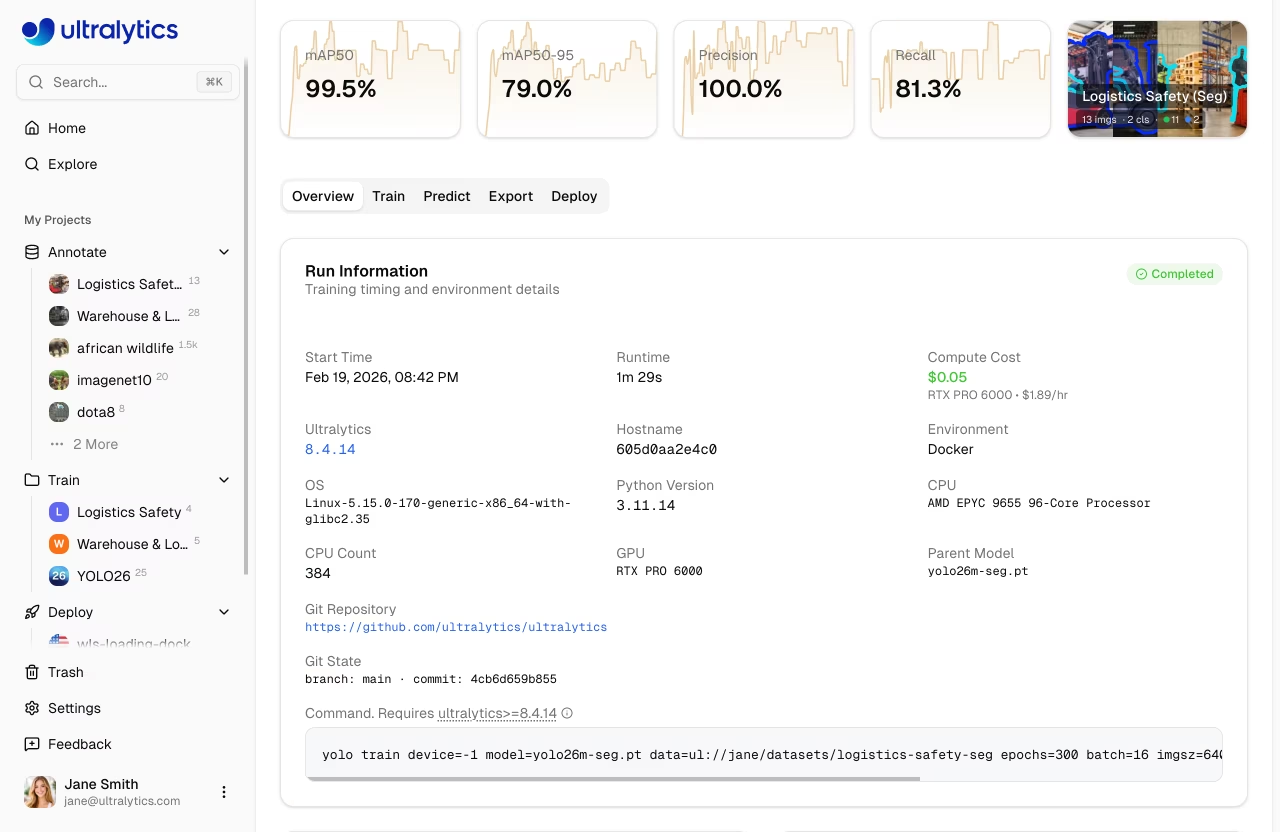

| Completed (Completado) | Entrenamiento finalizado correctamente |

| Failed (Fallido) | El entrenamiento falló (consulta los registros de la consola para obtener detalles) |

| Cancelled (Cancelado) | El entrenamiento fue cancelado por el usuario |

Las cuentas nuevas reciben créditos de registro: 5 $ para correos electrónicos personales y 25 $ para correos electrónicos de empresa. Consulta tu saldo en Settings > Billing (Configuración > Facturación).

Link to this sectionMonitorear entrenamiento#

Visualiza el progreso del entrenamiento en tiempo real en la pestaña Train (Entrenar) de la página del modelo:

Link to this sectionSubpestaña Charts (Gráficos)#

| Métrica | Descripción |

|---|---|

| Loss | Pérdida de entrenamiento y validación |

| mAP | Precisión media |

| Precision (Precisión) | Predicciones positivas correctas |

| Recall (Exhaustividad) | Verdades fundamentales detectadas |

Link to this sectionSubpestaña Console (Consola)#

Salida de consola en vivo con soporte de color ANSI, barras de progreso y detección de errores.

Link to this sectionSubpestaña System (Sistema)#

Utilización de GPU en tiempo real, memoria, temperatura, CPU y uso de disco.

Link to this sectionPuntos de control (Checkpoints)#

Una vez completado el entrenamiento, el mejor modelo (best.pt, el punto de control con el mAP más alto) se sube a la plataforma y se pone a disposición para su descarga, exportación y despliegue.

Link to this sectionCancelar entrenamiento#

Haz clic en Cancelar entrenamiento en la página del modelo para detener un trabajo en curso:

- La instancia de computación se termina

- Los créditos dejan de consumirse

- El mejor punto de control permanece disponible si se alcanzó antes de la cancelación

Link to this sectionEntrenamiento remoto#

graph LR

A[Local GPU] --> B[Train]

B --> C[ultralytics Package]

C --> D[Stream Metrics]

D --> E[Platform Dashboard]

style A fill:#FF9800,color:#fff

style C fill:#2196F3,color:#fff

style E fill:#4CAF50,color:#fffEntrena en tu propio hardware mientras transmites métricas a la plataforma.

La integración con la plataforma requiere ultralytics>=8.4.60. Las versiones anteriores NO funcionarán con la plataforma.

pip install -U ultralyticsLink to this sectionConfigurar clave de API#

- Ve a

Settings > API Keys - Crea una nueva clave (o la plataforma crea una automáticamente cuando abres la pestaña de Entrenamiento local)

- Establece la variable de entorno:

export ULTRALYTICS_API_KEY="YOUR_API_KEY"Link to this sectionEntrenar con transmisión de datos#

Usa los parámetros project y name para transmitir métricas:

yolo train model=yolo26n.pt data=coco.yaml epochs=100 \

project=username/my-project name=experiment-1La pestaña de Entrenamiento local en el cuadro de diálogo de entrenamiento muestra un comando preconfigurado con tu clave de API, parámetros seleccionados y argumentos avanzados incluidos.

Link to this sectionUso de datasets de la plataforma#

Entrena con conjuntos de datos almacenados en la plataforma usando el formato de URI ul:// :

yolo train model=yolo26n.pt data=ul://username/datasets/my-dataset epochs=100 \

project=username/my-project name=exp1El formato de URI ul:// descarga y configura automáticamente tu conjunto de datos. El modelo se vincula automáticamente al conjunto de datos en la plataforma (consulta Uso de conjuntos de datos de la plataforma).

Link to this sectionFacturación#

Los costes de entrenamiento se basan en el uso de la GPU:

Link to this sectionEstimación de costes#

Antes de que comience el entrenamiento, la plataforma estima el coste total mediante:

- Estimación de segundos por época a partir del tamaño del conjunto de datos, la complejidad del modelo, el tamaño de la imagen, el tamaño del lote y la velocidad de la GPU

- Cálculo del tiempo total de entrenamiento multiplicando los segundos por época por el número de épocas, añadiendo después la sobrecarga de inicio

- Cómputo del coste estimado a partir del total de horas de entrenamiento multiplicadas por la tarifa horaria de la GPU

Factores que afectan al coste:

| Factor | Impacto |

|---|---|

| Tamaño del conjunto de datos | Más imágenes = mayor tiempo de entrenamiento (la computación escala aproximadamente de forma lineal con el tamaño del conjunto de datos) |

| Tamaño del modelo | Los modelos más grandes (m, l, x) entrenan más lento que los (n, s) |

| Número de épocas | Multiplicador directo en el tiempo de entrenamiento |

| Image Size (Tamaño de imagen) | Las imágenes más grandes (imgsz) aumentan el cálculo: 320px=~0.3x, 640px=1.0x (base), 1280px=~3.5x |

| Batch Size (Tamaño de lote) | Los lotes (batch) más grandes son más eficientes (lote 32 = ~0.85x de tiempo, lote 8 = ~1.2x de tiempo respecto a la base de lote 16) |

| Velocidad de GPU | Las GPU más rápidas reducen el tiempo de entrenamiento (por ejemplo, H100 SXM = ~3.4x más rápida que la RTX 4090) |

| Sobrecarga de inicio | Hasta 5 minutos para la inicialización de la instancia, descarga de datos y calentamiento (escala con el tamaño del conjunto de datos) |

Link to this sectionEjemplos de costes#

Las estimaciones de costes son aproximadas y dependen de muchos factores. El cuadro de diálogo de entrenamiento muestra una estimación en tiempo real antes de que empieces a entrenar.

| Escenario | GPU | Coste estimado |

|---|---|---|

| 500 imágenes, YOLO26n, 50 épocas | RTX 4090 | ~$0.03 |

| 1000 imágenes, YOLO26n, 100 épocas | RTX PRO 6000 | ~$0.27 |

| 5000 imágenes, YOLO26s, 100 épocas | H100 SXM | ~$1.75 |

Link to this sectionFlujo de facturación#

graph LR

A[Estimate Cost] --> B[Balance Check]

B --> C[Train]

C --> D[Charge Actual Runtime]

style A fill:#2196F3,color:#fff

style B fill:#FF9800,color:#fff

style C fill:#9C27B0,color:#fff

style D fill:#4CAF50,color:#fffFlujo de facturación del entrenamiento en la nube:

- Estimación: Coste calculado antes de comenzar el entrenamiento

- Verificación de saldo: Los créditos disponibles se comprueban antes del lanzamiento

- Entrenamiento: El trabajo se ejecuta en la computación seleccionada

- Cargo: El coste final se basa en el tiempo de ejecución real

La facturación realiza un seguimiento del uso real de la computación, incluidas las ejecuciones parciales que se cancelan. Nunca se te cobrará por ejecuciones de entrenamiento fallidas.

Link to this sectionFacturación por estado del trabajo#

| Estado | ¿Cobrado? |

|---|---|

| Completed (Completado) | Sí — tiempo de GPU real utilizado |

| Cancelled (Cancelado) | Sí — tiempo de GPU desde el inicio hasta la cancelación |

| Failed (Fallido) | No — las ejecuciones fallidas no se cobran |

| Bloqueado (Stuck) | Parcial — solo se cobra el tiempo de entrenamiento real |

Si una ejecución de entrenamiento falla debido a un error de configuración, un problema de memoria insuficiente (out-of-memory) o cualquier otro fallo, no se te cobrará. Solo se factura el tiempo de computación exitoso. Los trabajos bloqueados (sin actividad durante más de 4 horas) se terminan automáticamente y solo se cobran por el tiempo que la GPU estuvo entrenando activamente, no por el tiempo de inactividad.

Link to this sectionMétodos de pago#

| Método | Descripción |

|---|---|

| Saldo de la cuenta | Créditos precargados |

| Pago por trabajo | Cargo al finalizar el trabajo |

El inicio del entrenamiento requiere un saldo disponible positivo y suficientes créditos para el coste estimado del trabajo.

Link to this sectionVer costes de entrenamiento#

Después del entrenamiento, consulta los costes detallados en la pestaña de Facturación:

- Desglose de costes por época

- Tiempo total de GPU

- Descargar informe de costes

Link to this sectionConsejos de entrenamiento#

Link to this sectionElige el tamaño de modelo correcto#

| Modelo | Parámetros | Ideal para |

|---|---|---|

| YOLO26n | 2.4M | Tiempo real, dispositivos de borde (edge) |

| YOLO26s | 9.5M | Velocidad/precisión equilibrada |

| YOLO26m | 20.4M | Mayor precisión |

| YOLO26l | 24.8M | Precisión de producción |

| YOLO26x | 55.7M | Máxima precisión |

Link to this sectionOptimiza el tiempo de entrenamiento#

- Empieza poco a poco: Prueba con 10-20 épocas en una GPU económica para verificar que tu conjunto de datos y tu configuración funcionan

- Usa una GPU adecuada: La RTX PRO 6000 gestiona bien la mayoría de las cargas de trabajo

- Valida el conjunto de datos: Corrige los problemas de etiquetado antes de gastar en entrenamiento

- Monitoriza pronto: Cancela el entrenamiento si la pérdida se estabiliza (plateau); solo pagas por el tiempo de computación utilizado

Link to this sectionSolución de problemas#

| Problema | Solución |

|---|---|

| Entrenamiento bloqueado al 0% | Verifica el formato del conjunto de datos, vuelve a intentarlo |

| Memoria insuficiente | Reduce el tamaño del lote (batch size) o utiliza una GPU más potente |

| Precisión deficiente | Aumenta las épocas y comprueba la calidad de los datos |

| Entrenamiento lento | Considera utilizar una GPU más rápida |

| Error de falta de coincidencia de tareas | Asegúrate de que las tareas del modelo y del conjunto de datos coincidan |

Link to this sectionFAQ#

Link to this section¿Cuánto tarda el entrenamiento?#

El tiempo de entrenamiento depende de:

- Tamaño del conjunto de datos

- Tamaño del modelo

- Número de épocas

- GPU seleccionada

Tiempos típicos (1000 imágenes, 100 épocas):

| Modelo | RTX PRO 6000 | A100 SXM |

|---|---|---|

| YOLO26n | ~8 min | ~7 min |

| YOLO26m | ~16 min | ~13 min |

| YOLO26x | ~27 min | ~22 min |

Los tiempos de entrenamiento son aproximados y varían según la complejidad del conjunto de datos, la configuración de aumento y el tamaño del lote. Utiliza la estimación de costes del diálogo de entrenamiento para obtener predicciones más precisas.

Link to this section¿Puedo entrenar durante la noche?#

Sí, el entrenamiento continúa hasta completarse. Recibirás una notificación cuando finalice. Asegúrate de que tu cuenta tenga saldo suficiente para el entrenamiento basado en épocas.

Link to this section¿Qué ocurre si me quedo sin créditos?#

Si tu saldo de créditos llega a cero durante una ejecución de entrenamiento, el entrenamiento continúa hasta completarse y tu saldo quedará en negativo. Esto garantiza que tu trabajo de entrenamiento nunca se interrumpa a mitad de proceso.

Una vez completado el entrenamiento, deberás añadir créditos para que tu saldo vuelva a ser positivo antes de iniciar nuevos trabajos de entrenamiento. Tu modelo completado, los puntos de control (checkpoints) y todos los artefactos de entrenamiento se conservan totalmente, independientemente del saldo.

Un saldo negativo solo impide iniciar nuevos trabajos de entrenamiento. Los despliegues existentes y otras funciones de la plataforma siguen funcionando con normalidad. Añade créditos a través de Configuración > Facturación o activa la recarga automática para evitar interrupciones.

Link to this section¿Qué ocurre si mi entrenamiento cuesta más de lo estimado?#

Las estimaciones de costes son aproximadas; el tiempo real de entrenamiento puede variar debido a factores como la velocidad de carga de datos, el calentamiento de la GPU y el comportamiento de convergencia del modelo. Si el coste real supera la estimación, tu saldo puede quedar en negativo (ver arriba). La plataforma no detiene el entrenamiento basándose en la estimación.

Para gestionar los costes:

- Monitoriza el progreso del entrenamiento en tiempo real y cancéalo antes si es necesario

- Activa la recarga automática para reponer créditos automáticamente

- Empieza con ejecuciones más cortas (menos épocas) para calibrar las expectativas

Link to this section¿Puedo utilizar argumentos de entrenamiento personalizados?#

Sí, expande la sección Configuración avanzada en el diálogo de entrenamiento para acceder a un editor YAML con más de 40 parámetros configurables. Los valores no predeterminados se incluyen tanto en los comandos de entrenamiento en la nube como en los locales.

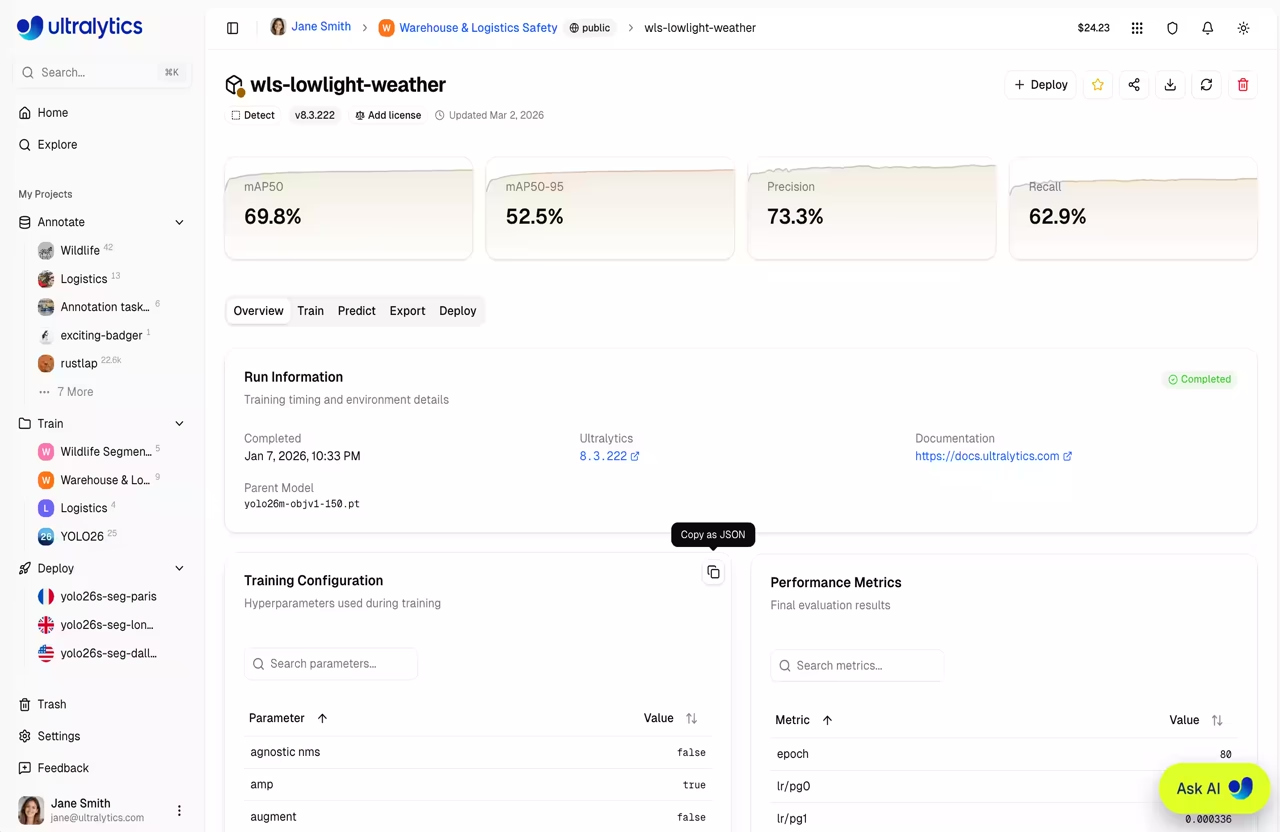

El editor YAML también permite importar configuraciones de ejecuciones de entrenamiento anteriores:

- Copiar desde un modelo existente: En la página de cualquier modelo completado, la tarjeta de Configuración de entrenamiento tiene un botón Copiar como JSON. Copia el JSON y pégalo directamente en el editor YAML; este detecta automáticamente el formato JSON e importa todos los parámetros.

- Pegar YAML o JSON: Pega cualquier configuración de entrenamiento YAML o JSON válida en el editor. Los parámetros se validan automáticamente, los valores fuera de rango se ajustan y se muestran advertencias.

- Arrastrar y soltar archivos: Arrastra un archivo

.yamlo.jsondirectamente al editor para importar sus parámetros.

Esto facilita la reproducción o la iteración sobre configuraciones de entrenamiento anteriores sin tener que volver a introducir manualmente cada parámetro.

Link to this section¿Puedo entrenar desde una página de conjunto de datos?#

Sí, el botón Entrenar en las páginas de conjuntos de datos abre el diálogo de entrenamiento con el conjunto de datos preseleccionado y bloqueado. A continuación, seleccionas un proyecto y un modelo para comenzar el entrenamiento.

Link to this sectionReferencia de parámetros de entrenamiento#

| Parámetro | Tipo | Predeterminado | Rango | Descripción |

|---|---|---|---|---|

epochs | entero | 100 | 1-10000 | Número de épocas de entrenamiento |

batch | entero | -1 (automático) | -1 a 512 | Tamaño del lote (-1 = ajuste automático a la VRAM disponible) |

imgsz | entero | 640 | 32-4096 | Tamaño de la imagen de entrada |

patience | entero | 100 | 1-1000 | Paciencia para la parada temprana (Early stopping) |

seed | entero | 0 | 0-2147483647 | Semilla aleatoria para la reproducibilidad |

deterministic | bool | True | - | Modo de entrenamiento determinista |

amp | bool | True | - | Precisión mixta automática |

close_mosaic | entero | 10 | 0-50 | Desactivar mosaico en las últimas N épocas |

save_period | entero | -1 | -1-100 | Guardar punto de control cada N épocas |

workers | entero | 8 | 0-64 | Trabajadores del cargador de datos (workers) |

cache | seleccionar | false | ram/disk/false | Caché de imágenes |

Algunos parámetros solo se aplican a tareas específicas:

- Solo tareas de detección (detect, segment, pose, OBB — no classify):

box,dfl,degrees,translate,shear,perspective,mosaic,mixup,close_mosaic - Solo segmentación:

copy_paste - Solo pose:

pose(peso de pérdida),kobj(objetividad de puntos clave)