Ultralytics YOLO26

Vue d'ensemble

Ultralytics YOLO26 est la dernière évolution de la série YOLO de détecteurs d'objets en temps réel, conçue dès le départ pour les appareils de périphérie (edge) et à basse consommation. Il introduit une conception rationalisée qui élimine les complexités inutiles tout en intégrant des innovations ciblées pour offrir un déploiement plus rapide, plus léger et plus accessible.

Explore et exécute des modèles YOLO26 directement sur Ultralytics Platform.

L'architecture de YOLO26 est guidée par trois principes fondamentaux :

- Simplicité : YOLO26 est un modèle natif de bout en bout, produisant des prédictions directement sans avoir besoin de suppression des non-maximums (NMS). En éliminant cette étape de post-traitement, l'inférence devient plus rapide, plus légère et plus facile à déployer dans des systèmes réels. Cette approche révolutionnaire a été introduite pour la première fois dans YOLOv10 par Ao Wang de l'Université Tsinghua et a été perfectionnée dans YOLO26.

- Efficacité de déploiement : La conception de bout en bout supprime une étape entière du pipeline, simplifiant considérablement l'intégration, réduisant la latence et rendant le déploiement plus robuste dans divers environnements.

- Innovation en entraînement : YOLO26 introduit l'optimiseur MuSGD, un hybride de SGD et Muon — inspiré par les percées de Kimi K2 de Moonshot AI dans l'entraînement de LLM. Cet optimiseur apporte une stabilité améliorée et une convergence plus rapide, transférant les avancées d'optimisation des modèles de langage vers la vision par ordinateur.

- Optimisations spécifiques aux tâches : YOLO26 introduit des améliorations ciblées pour des tâches spécialisées, notamment la perte de segmentation sémantique et des modules proto multi-échelle pour la Segmentation, l'estimation de log-vraisemblance résiduelle (RLE) pour une estimation de Pose de haute précision, et un décodage optimisé avec perte d'angle pour résoudre les problèmes de limites dans l'OBB.

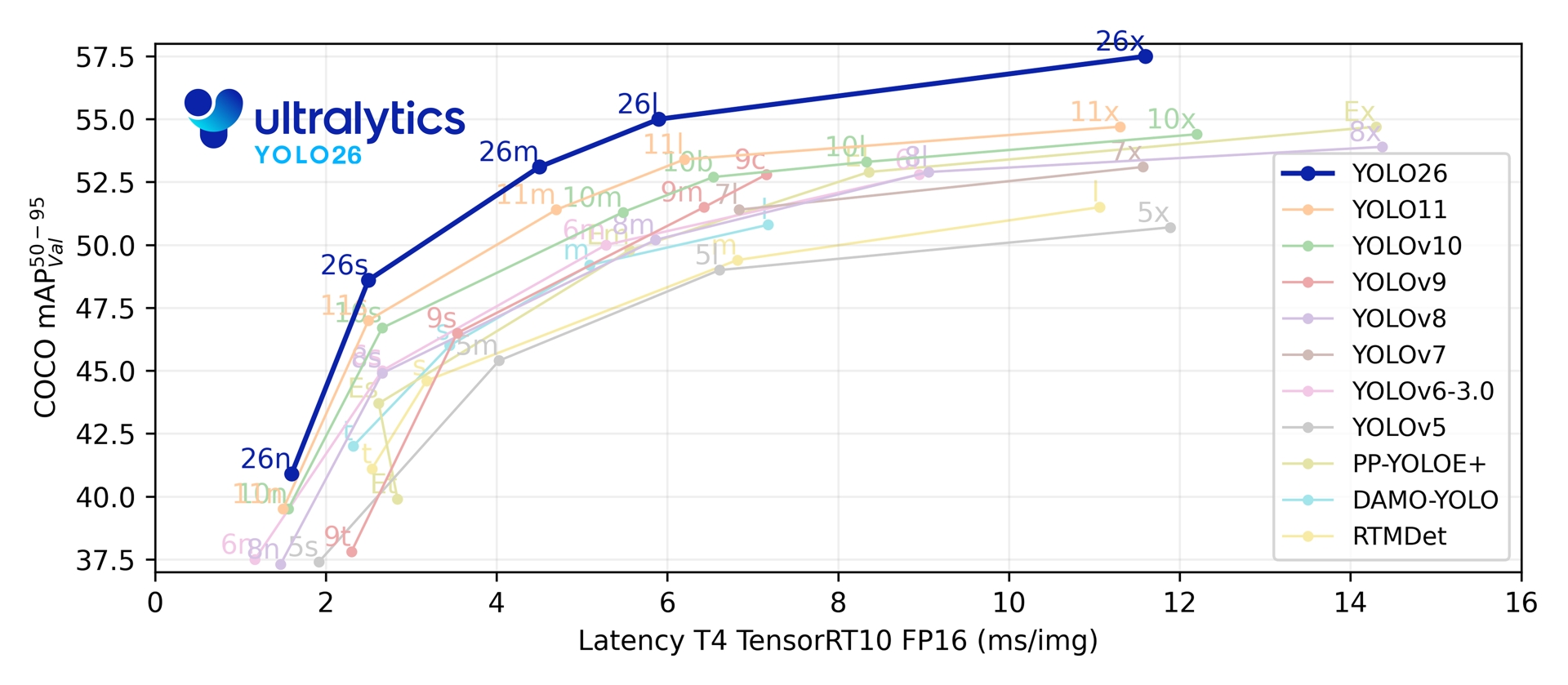

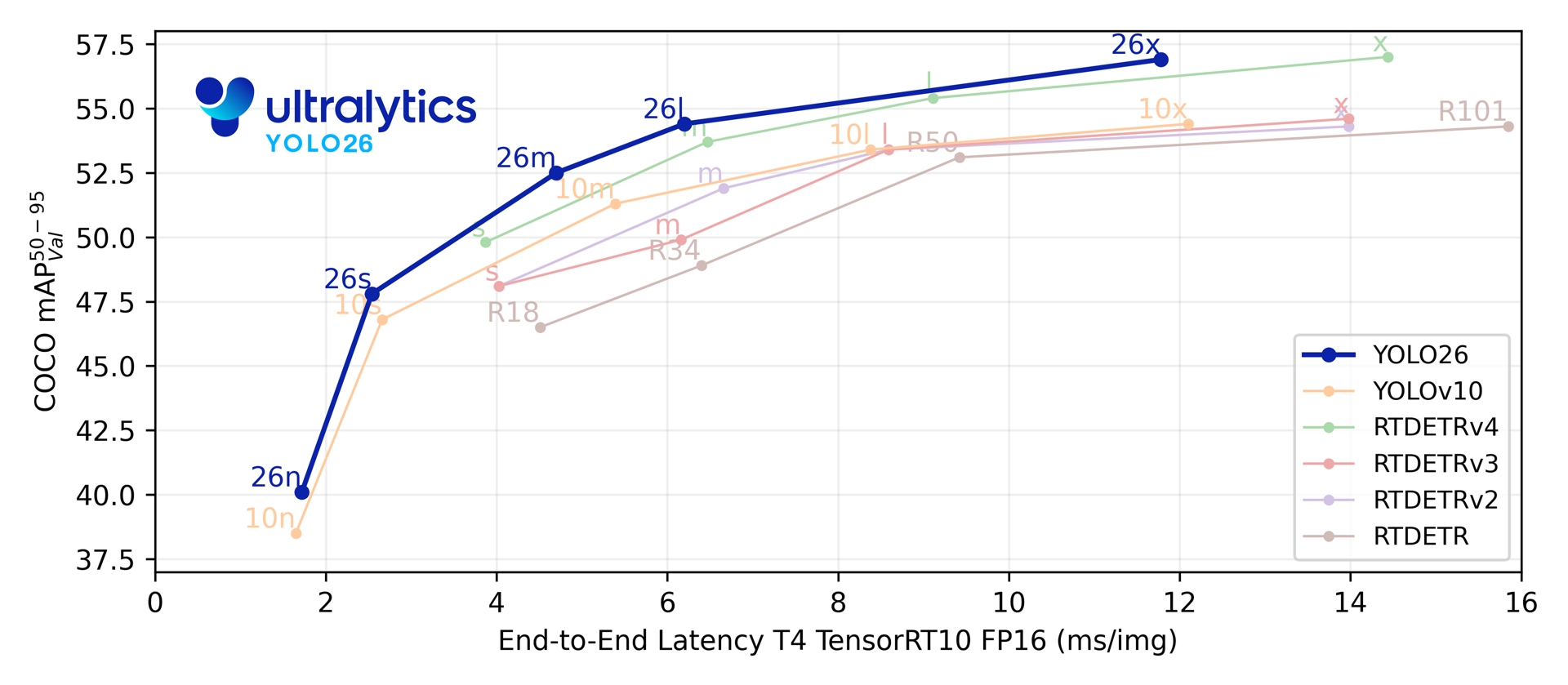

Ensemble, ces innovations offrent une famille de modèles qui atteint une précision supérieure sur les petits objets, permet un déploiement transparent et fonctionne jusqu'à 43 % plus rapidement sur les CPU — faisant de YOLO26 l'un des modèles YOLO les plus pratiques et déployables à ce jour pour les environnements aux ressources limitées.

Fonctionnalités clés

-

Suppression du DFL

Le module de Distribution Focal Loss (DFL), bien qu'efficace, compliquait souvent l'exportation et limitait la compatibilité matérielle. YOLO26 supprime entièrement le DFL, simplifiant l'inférence et élargissant le support pour les appareils de périphérie et à basse consommation. -

Inférence native de bout en bout sans NMS

Contrairement aux détecteurs traditionnels qui s'appuient sur le NMS comme étape de post-traitement séparée, YOLO26 est nativement de bout en bout. Les prédictions sont générées directement, réduisant la latence et rendant l'intégration dans les systèmes de production plus rapide, plus légère et plus fiable. -

ProgLoss + STAL

Des fonctions de perte améliorées augmentent la précision de détection, avec des améliorations notables dans la reconnaissance de petits objets, une exigence critique pour l'IoT, la robotique, l'imagerie aérienne et d'autres applications de périphérie. -

Optimiseur MuSGD

Un nouvel optimiseur hybride qui combine SGD avec Muon. Inspiré par Kimi K2 de Moonshot AI, MuSGD introduit des méthodes d'optimisation avancées issues de l'entraînement de LLM dans la vision par ordinateur, permettant un entraînement plus stable et une convergence plus rapide. -

Inférence CPU jusqu'à 43 % plus rapide

Spécifiquement optimisé pour l'informatique de périphérie, YOLO26 offre une inférence CPU nettement plus rapide, assurant des performances en temps réel sur les appareils sans GPU. -

Améliorations de la segmentation d'instance

Introduit une perte de segmentation sémantique pour améliorer la convergence du modèle et un module proto mis à niveau qui tire parti des informations multi-échelles pour une qualité de masque supérieure. -

Estimation de pose de précision

Intègre l'estimation de log-vraisemblance résiduelle (RLE) pour une localisation plus précise des points clés et optimise le processus de décodage pour une vitesse d'inférence accrue. -

Décodage OBB raffiné

Introduit une perte d'angle spécialisée pour améliorer la précision de détection des objets de forme carrée et optimise le décodage OBB pour résoudre les problèmes de discontinuité des limites.

Tâches et modes pris en charge

YOLO26 s'appuie sur la gamme de modèles polyvalents établie par les versions antérieures d'Ultralytics YOLO, offrant un support amélioré pour diverses tâches de vision par ordinateur :

| Modèle | Noms de fichiers | Tâche | Inférence | Validation | Entraînement | Exportation (Export) |

|---|---|---|---|---|---|---|

| YOLO26 | yolo26n.pt yolo26s.pt yolo26m.pt yolo26l.pt yolo26x.pt | Détection | ✅ | ✅ | ✅ | ✅ |

| YOLO26-seg | yolo26n-seg.pt yolo26s-seg.pt yolo26m-seg.pt yolo26l-seg.pt yolo26x-seg.pt | Segmentation d'instance | ✅ | ✅ | ✅ | ✅ |

| YOLO26-sem | yolo26n-sem.pt yolo26s-sem.pt yolo26m-sem.pt yolo26l-sem.pt yolo26x-sem.pt | Segmentation sémantique | ✅ | ✅ | ✅ | ✅ |

| YOLO26-pose | yolo26n-pose.pt yolo26s-pose.pt yolo26m-pose.pt yolo26l-pose.pt yolo26x-pose.pt | Pose/Points clés | ✅ | ✅ | ✅ | ✅ |

| YOLO26-obb | yolo26n-obb.pt yolo26s-obb.pt yolo26m-obb.pt yolo26l-obb.pt yolo26x-obb.pt | Détection orientée | ✅ | ✅ | ✅ | ✅ |

| YOLO26-cls | yolo26n-cls.pt yolo26s-cls.pt yolo26m-cls.pt yolo26l-cls.pt yolo26x-cls.pt | Classification | ✅ | ✅ | ✅ | ✅ |

Ce cadre unifié garantit que YOLO26 est applicable à la détection en temps réel, la segmentation d'instance, la segmentation sémantique, la classification, l'estimation de pose et la détection d'objets orientés — tout cela avec un support pour l'entraînement, la validation, l'inférence et l'exportation.

yolo26-p2.yaml et yolo26-p6.yaml ajoutent une tête de détection P2 (petits objets) ou P6 (grande entrée) et sont fournis uniquement en tant qu'architectures YAML. Aucun poids yolo26*-p2.pt ou yolo26*-p6.pt spécifique à l'échelle n'est publié. Instancie une configuration mise à l'échelle à partir de YAML (par exemple, YOLO("yolo26n-p6.yaml")) et entraîne-la ou ajuste-la selon tes besoins.

Mesures de performance

Consulte les Docs de détection pour des exemples d'utilisation avec ces modèles entraînés sur COCO, qui incluent 80 classes pré-entraînées.

| Modèle | taille (pixels) | mAPval 50-95 | mAPval 50-95(e2e) | Vitesse CPU ONNX (ms) | Vitesse T4 TensorRT10 (ms) | params (M) | FLOPs (B) |

|---|---|---|---|---|---|---|---|

| YOLO26n | 640 | 40.9 | 40.1 | 38.9 ± 0.7 | 1.7 ± 0.0 | 2.4 | 5.4 |

| YOLO26s | 640 | 48.6 | 47.8 | 87.2 ± 0.9 | 2.5 ± 0.0 | 9.5 | 20.7 |

| YOLO26m | 640 | 53.1 | 52.5 | 220.0 ± 1.4 | 4.7 ± 0.1 | 20.4 | 68.2 |

| YOLO26l | 640 | 55.0 | 54.4 | 286.2 ± 2.0 | 6.2 ± 0.2 | 24.8 | 86.4 |

| YOLO26x | 640 | 57.5 | 56.9 | 525.8 ± 4.0 | 11.8 ± 0.2 | 55.7 | 193.9 |

Les valeurs de Params et FLOPs sont celles du modèle fusionné après model.fuse(), qui fusionne les couches Conv et BatchNorm et supprime la tête de détection auxiliaire one-to-many. Les checkpoints pré-entraînés conservent l'architecture d'entraînement complète et peuvent afficher des nombres plus élevés.

Exemples d'utilisation

Cette section fournit des exemples simples d'entraînement et d'inférence avec YOLO26. Pour la documentation complète sur ces modes et d'autres modes, consulte les pages de doc Predict, Train, Val et Export.

Note que l'exemple ci-dessous concerne les modèles YOLO26 Detect pour la détection d'objets. Pour des tâches supplémentaires prises en charge, consulte la documentation sur Segment, Segmentation Sémantique, Classify, OBB et Pose.

Les modèles PyTorch pré-entraînés *.pt ainsi que les fichiers de configuration *.yaml peuvent être passés à la classe YOLO() pour créer une instance de modèle en Python :

from ultralytics import YOLO

# Load a COCO-pretrained YOLO26n model

model = YOLO("yolo26n.pt")

# Train the model on the COCO8 example dataset for 100 epochs

results = model.train(data="coco8.yaml", epochs=100, imgsz=640)

# Run inference with the YOLO26n model on the 'bus.jpg' image

results = model("path/to/bus.jpg")YOLO26 présente une architecture à double tête qui offre une flexibilité pour différents scénarios de déploiement :

- Tête One-to-One (Par défaut) : Produit des prédictions de bout en bout sans NMS, en renvoyant

(N, 300, 6)avec un maximum de 300 détections par image. Cette tête est optimisée pour une inférence rapide et un déploiement simplifié. - Tête One-to-Many : Génère des sorties YOLO traditionnelles nécessitant un post-traitement NMS, en renvoyant

(N, nc + 4, 8400)oùncest le nombre de classes. Cette tête atteint généralement une précision légèrement supérieure au prix d'un traitement supplémentaire.

Tu peux basculer entre les têtes pendant l'exportation, la prédiction ou la validation :

from ultralytics import YOLO

model = YOLO("yolo26n.pt")

# Use one-to-one head (default, no NMS required)

results = model.predict("image.jpg") # inference

metrics = model.val(data="coco.yaml") # validation

model.export(format="onnx") # export

# Use one-to-many head (requires NMS)

results = model.predict("image.jpg", end2end=False) # inference

metrics = model.val(data="coco.yaml", end2end=False) # validation

model.export(format="onnx", end2end=False) # exportLe choix dépend de tes exigences de déploiement : utilise la tête one-to-one pour un maximum de vitesse et de simplicité, ou la tête one-to-many lorsque la précision est la priorité absolue.

YOLOE-26 : Segmentation d'instance à vocabulaire ouvert

YOLOE-26 intègre l'architecture haute performance de YOLO26 aux capacités de vocabulaire ouvert de la série YOLOE. Elle permet la détection et la segmentation en temps réel de n'importe quelle classe d'objet en utilisant des prompts textuels, des prompts visuels ou un mode sans prompt pour une inférence zero-shot, éliminant ainsi efficacement les contraintes de l'entraînement à catégories fixes.

En tirant parti de la conception NMS-free, de bout en bout de YOLO26, YOLOE-26 offre une inférence rapide dans le monde ouvert. Cela en fait une solution puissante pour les applications en périphérie (edge) dans des environnements dynamiques où les objets d'intérêt représentent un vocabulaire large et évolutif.

Consulte la documentation YOLOE pour des exemples d'utilisation avec ces modèles entraînés sur les jeux de données Objects365v1, GQA et Flickr30k.

| Modèle | taille (pixels) | Type de prompt | mAPminival 50-95(e2e) | mAPminival 50-95 | mAPr | mAPc | mAPf | params (M) | FLOPs (B) |

|---|---|---|---|---|---|---|---|---|---|

| YOLOE-26n-seg | 640 | Texte/Visuel | 23.7 / 20.9 | 24.7 / 21.9 | 20.5 / 17.6 | 24.1 / 22.3 | 26.1 / 22.4 | 4.8 | 6.0 |

| YOLOE-26s-seg | 640 | Texte/Visuel | 29.9 / 27.1 | 30.8 / 28.6 | 23.9 / 25.1 | 29.6 / 27.8 | 33.0 / 29.9 | 13.1 | 21.7 |

| YOLOE-26m-seg | 640 | Texte/Visuel | 35.4 / 31.3 | 35.4 / 33.9 | 31.1 / 33.4 | 34.7 / 34.0 | 36.9 / 33.8 | 27.9 | 70.1 |

| YOLOE-26l-seg | 640 | Texte/Visuel | 36.8 / 33.7 | 37.8 / 36.3 | 35.1 / 37.6 | 37.6 / 36.2 | 38.5 / 36.1 | 32.3 | 88.3 |

| YOLOE-26x-seg | 640 | Texte/Visuel | 39.5 / 36.2 | 40.6 / 38.5 | 37.4 / 35.3 | 40.9 / 38.8 | 41.0 / 38.8 | 69.9 | 196.7 |

Exemple d'utilisation

YOLOE-26 prend en charge les invites textuelles et visuelles. L'utilisation des invites est simple : transmets-les simplement via la méthode predict comme indiqué ci-dessous :

Les invites textuelles te permettent de spécifier les classes que tu souhaites détecter via des descriptions textuelles. Le code suivant montre comment tu peux utiliser YOLOE-26 pour détecter des personnes et des bus dans une image :

from ultralytics import YOLO

# Initialize model

model = YOLO("yoloe-26l-seg.pt") # or select yoloe-26s/m-seg.pt for different sizes

# Set text prompt to detect person and bus. You only need to do this once after you load the model.

model.set_classes(["person", "bus"])

# Run detection on the given image

results = model.predict("path/to/image.jpg")

# Show results

results[0].show()Pour une plongée en profondeur dans les techniques de prompting, l'entraînement à partir de zéro et des exemples d'utilisation complets, visite la Documentation YOLOE.

Citations et remerciements

Ultralytics n'a pas publié de document de recherche formel pour YOLO26 en raison de la nature évolutive rapide des modèles. Au lieu de cela, nous nous concentrons sur la livraison de modèles de pointe et sur le fait de les rendre faciles à utiliser. Pour les dernières mises à jour sur les fonctionnalités, les architectures et l'utilisation de YOLO, visite notre dépôt GitHub et notre documentation.

Si tu utilises YOLO26 ou un autre logiciel Ultralytics dans ton travail, merci de le citer comme suit :

@software{yolo26_ultralytics,

author = {Glenn Jocher and Jing Qiu},

title = {Ultralytics YOLO26},

version = {26.0.0},

year = {2026},

url = {https://github.com/ultralytics/ultralytics},

orcid = {0000-0001-5950-6979, 0000-0003-3783-7069},

license = {AGPL-3.0}

}DOI en attente. YOLO26 est disponible sous les licences AGPL-3.0 et Enterprise.

FAQ

Quelles sont les principales améliorations apportées à YOLO26 par rapport à YOLO11 ?

- Suppression du DFL : Simplifie l'exportation et étend la compatibilité avec les périphériques edge

- Inférence de bout en bout sans NMS : Élimine le NMS pour un déploiement plus rapide et plus simple

- ProgLoss + STAL : Améliore la précision, particulièrement sur les petits objets

- Optimiseur MuSGD : Combine SGD et Muon (inspiré par Kimi K2 de Moonshot) pour un entraînement plus stable et efficace

- Inférence CPU jusqu'à 43 % plus rapide : Gains de performance majeurs pour les appareils utilisant uniquement le CPU

Quelles tâches YOLO26 prend-il en charge ?

YOLO26 est une famille de modèles unifiés, fournissant un support de bout en bout pour plusieurs tâches de vision par ordinateur :

- Détection d'objets

- Segmentation d'instance

- Segmentation sémantique

- Classification d'images

- Estimation de pose

- Détection d'objets orientés (OBB)

Chaque variante de taille (n, s, m, l, x) prend en charge toutes les tâches, ainsi que des versions à vocabulaire ouvert via YOLOE-26.

Pourquoi YOLO26 est-il optimisé pour le déploiement sur les périphériques edge ?

YOLO26 offre des performances edge de pointe avec :

- Inférence CPU jusqu'à 43 % plus rapide

- Taille de modèle et empreinte mémoire réduites

- Architecture simplifiée pour la compatibilité (sans DFL, sans NMS)

- Formats d'exportation flexibles incluant TensorRT, ONNX, CoreML, TFLite et OpenVINO

Comment puis-je commencer avec YOLO26 ?

Les modèles YOLO26 ont été publiés le 14 janvier 2026 et sont disponibles en téléchargement. Installe ou mets à jour le package ultralytics et charge un modèle :

from ultralytics import YOLO

# Load a pretrained YOLO26 nano model

model = YOLO("yolo26n.pt")

# Run inference on an image

results = model("image.jpg")Consulte la section Exemples d'utilisation pour les instructions d'entraînement, de validation et d'exportation.