Link to this sectionEntraînement dans le cloud#

L'entraînement dans le cloud de la plateforme Ultralytics permet de lancer un entraînement en un clic sur des GPU cloud, rendant l'entraînement de modèles accessible sans configuration complexe. Entraîne tes modèles YOLO avec un streaming de métriques en temps réel et une sauvegarde automatique des points de contrôle.

graph LR

A[Configure] --> B[Start Training]

B --> C[Provision GPU]

C --> D[Download Dataset]

D --> E[Train]

E --> F[Stream Metrics]

F --> G[Save Checkpoints]

G --> H[Complete]

style A fill:#2196F3,color:#fff

style B fill:#FF9800,color:#fff

style E fill:#9C27B0,color:#fff

style H fill:#4CAF50,color:#fffLink to this sectionFenêtre d'entraînement#

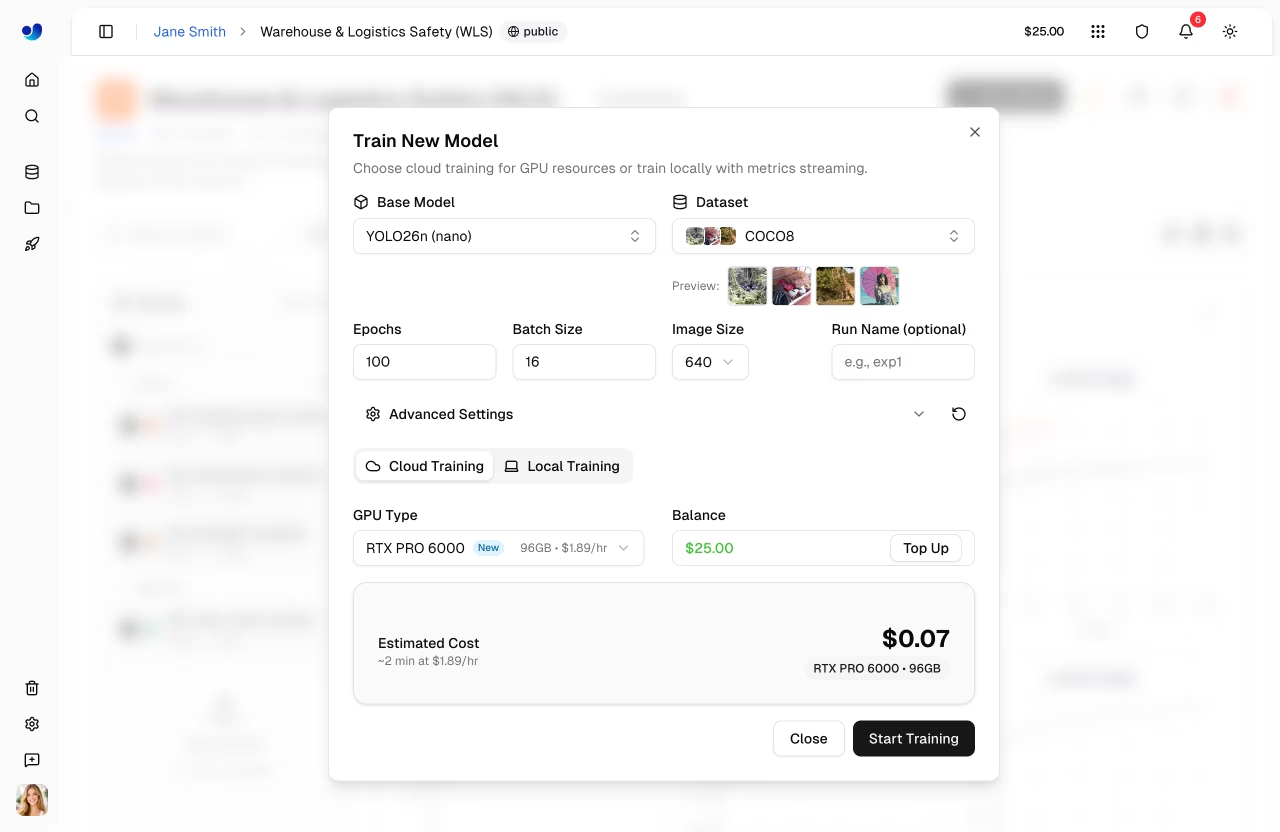

Démarre l'entraînement depuis l'interface utilisateur de la plateforme en cliquant sur Nouveau modèle sur n'importe quelle page de projet (ou Entraîner depuis une page de jeu de données). La fenêtre d'entraînement comporte deux onglets : Entraînement Cloud et Entraînement local.

Link to this sectionÉtape 1 : Sélectionner le modèle de base#

Choisis parmi les modèles officiels YOLO26 ou tes propres modèles entraînés :

| Catégorie | Description |

|---|---|

| Officiel | Tous les 30 modèles YOLO26 (5 tailles x 6 tâches) |

| Tes modèles | Tes modèles terminés pour le réglage fin |

Les modèles officiels sont organisés par type de tâche (Detect, Segment, Semantic, Pose, OBB, Classify) avec des tailles allant de nano à xlarge.

Link to this sectionÉtape 2 : Sélectionner le jeu de données#

Choisis un jeu de données sur lequel t'entraîner (voir Jeux de données) :

| Option | Description |

|---|---|

| Officiel | Jeux de données sélectionnés par Ultralytics |

| Tes jeux de données | Jeux de données que tu as téléchargés |

Les jeux de données doivent avoir le statut ready avec au moins 1 image dans le jeu d'entraînement, 1 image dans le jeu de validation ou de test, et au moins 1 image annotée.

Un avertissement d'inadéquation de tâche apparaît si la tâche du modèle (par exemple, detect) ne correspond pas à la tâche du jeu de données (par exemple, segment). L'entraînement échouera si tu poursuis avec des tâches incompatibles. Assure-toi que le modèle et le jeu de données utilisent le même type de tâche, tel que décrit dans les guides de tâches.

Link to this sectionÉtape 3 : Configurer les paramètres#

Définit les paramètres d'entraînement de base :

| Paramètre | Description | Défaut |

|---|---|---|

| Époques | Nombre d'itérations d'entraînement | 100 |

| Taille du lot | Échantillons par itération | -1 (auto) |

| Taille de l'image | Résolution d'entrée (menu déroulant 320/416/512/640/1280, tout multiple de 32 de 32 à 4096 dans l'éditeur YAML) | 640 |

| Nom de l'exécution | Nom optionnel pour l'exécution de l'entraînement | auto |

Link to this sectionÉtape 4 : Paramètres avancés (Optionnel)#

Développe les Paramètres avancés pour accéder à l'éditeur complet de paramètres basé sur YAML avec plus de 40 paramètres d'entraînement organisés par groupe (voir référence de configuration) :

| Groupe | Paramètres |

|---|---|

| Learning Rate | lr0, lrf, momentum, weight_decay, warmup_epochs, warmup_momentum, warmup_bias_lr |

| Optimiseur | auto (par défaut), SGD, MuSGD, Adam, AdamW, NAdam, RAdam, RMSProp, Adamax |

| Poids de perte | box, cls, dfl, pose, kobj, label_smoothing |

| Augmentation couleur | hsv_h, hsv_s, hsv_v |

| Augmentation géométrique | degrees, translate, scale, shear, perspective |

| Augmentation miroir & Mix | flipud, fliplr, mosaic, mixup, copy_paste |

| Contrôle de l'entraînement | patience, seed, deterministic, amp, cos_lr, close_mosaic, save_period |

| Jeu de données | fraction, freeze, single_cls, rect, multi_scale, resume |

Les paramètres sont conscients de la tâche (par exemple, copy_paste ne s'affiche que pour les tâches de segmentation, pose/kobj uniquement pour les tâches de pose). Un badge Modifié apparaît lorsque les valeurs diffèrent des valeurs par défaut, et tu peux réinitialiser toutes les valeurs par défaut avec le bouton de réinitialisation.

Exemple : Réglage de l'augmentation pour les petits jeux de données

Pour les petits jeux de données (<1000 images), augmente l'augmentation pour réduire le surapprentissage :

mosaic: 1.0 # Keep mosaic on

mixup: 0.3 # Add mixup blending

copy_paste: 0.3 # Add copy-paste (segment only)

fliplr: 0.5 # Horizontal flip

degrees: 10.0 # Slight rotation

scale: 0.9 # Aggressive scalingLink to this sectionÉtape 5 : Sélectionner le GPU (Onglet Cloud)#

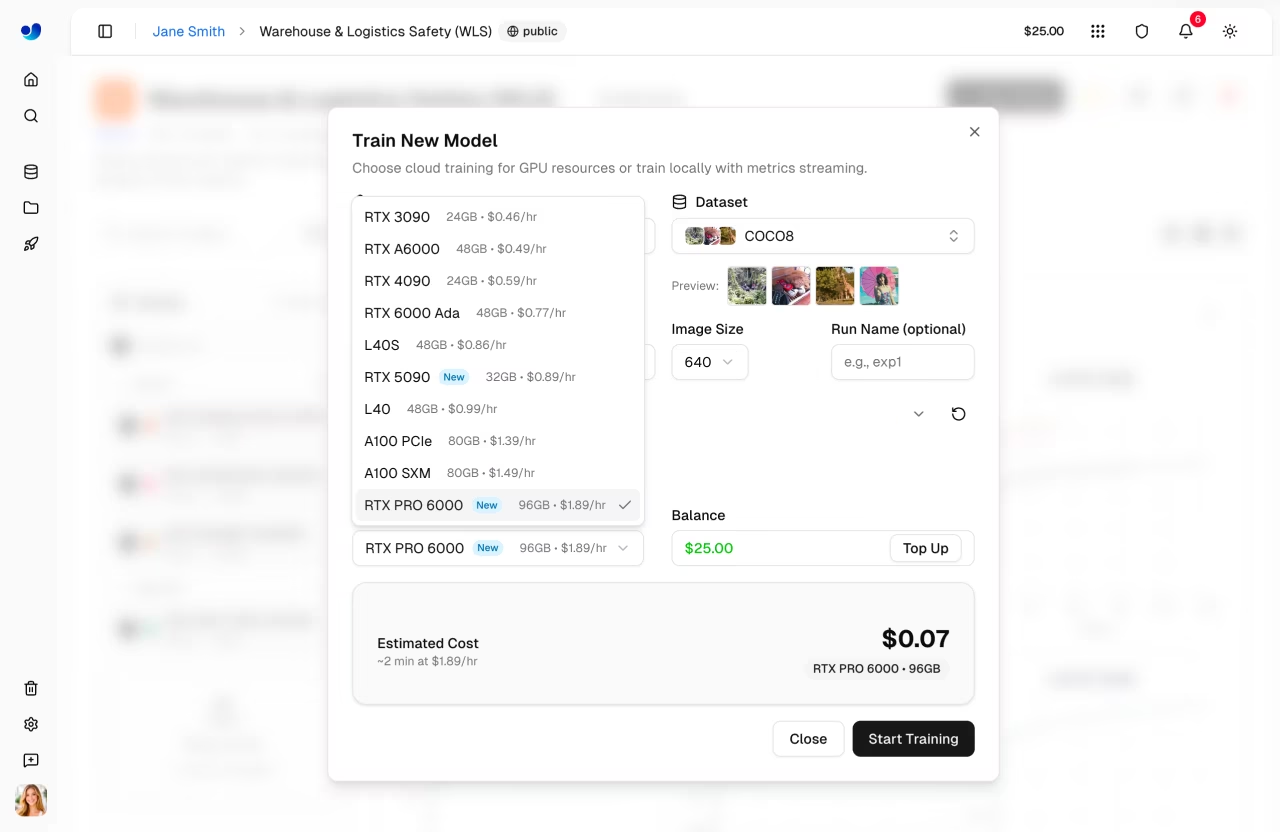

Choisis ton GPU depuis le cloud Ultralytics :

| GPU | Génération | VRAM | Coùt/Heure | Idéal pour |

|---|---|---|---|---|

| RTX 2000 Ada | Ada | 16 GB | $0.24 | Petits datasets, tests |

| RTX A4500 | Ampere | 20 GB | $0.25 | Datasets de taille petite à moyenne |

| RTX 4000 Ada | Ada | 20 GB | $0.26 | Datasets de taille moyenne |

| RTX A5000 | Ampere | 24 GB | $0.27 | Datasets de taille moyenne |

| L4 | Ada | 24 GB | $0.39 | Optimisé pour l'inférence |

| A40 | Ampere | 48 GB | $0.44 | Tailles de batch plus grandes |

| RTX 3090 | Ampere | 24 GB | $0.46 | Entranement général |

| RTX A6000 | Ampere | 48 GB | $0.49 | Grands modèles |

| RTX PRO 4500 | Blackwell | 32 GB | $0.64 | Excellent rapport prix/performance |

| RTX 4090 | Ada | 24 GB | $0.69 | Meilleur rapport prix/performance |

| RTX 6000 Ada | Ada | 48 GB | $0.77 | Entranement sur grands batchs |

| L40S | Ada | 48 GB | $0.86 | Entranement sur grands batchs |

| RTX 5090 | Blackwell | 32 GB | $0.99 | Dernière génération grand public |

| L40 | Ada | 48 GB | $0.99 | Grands modèles |

| A100 PCIe | Ampere | 80 GB | $1.39 | Entranement en production |

| A100 SXM | Ampere | 80 GB | $1.49 | Entranement en production |

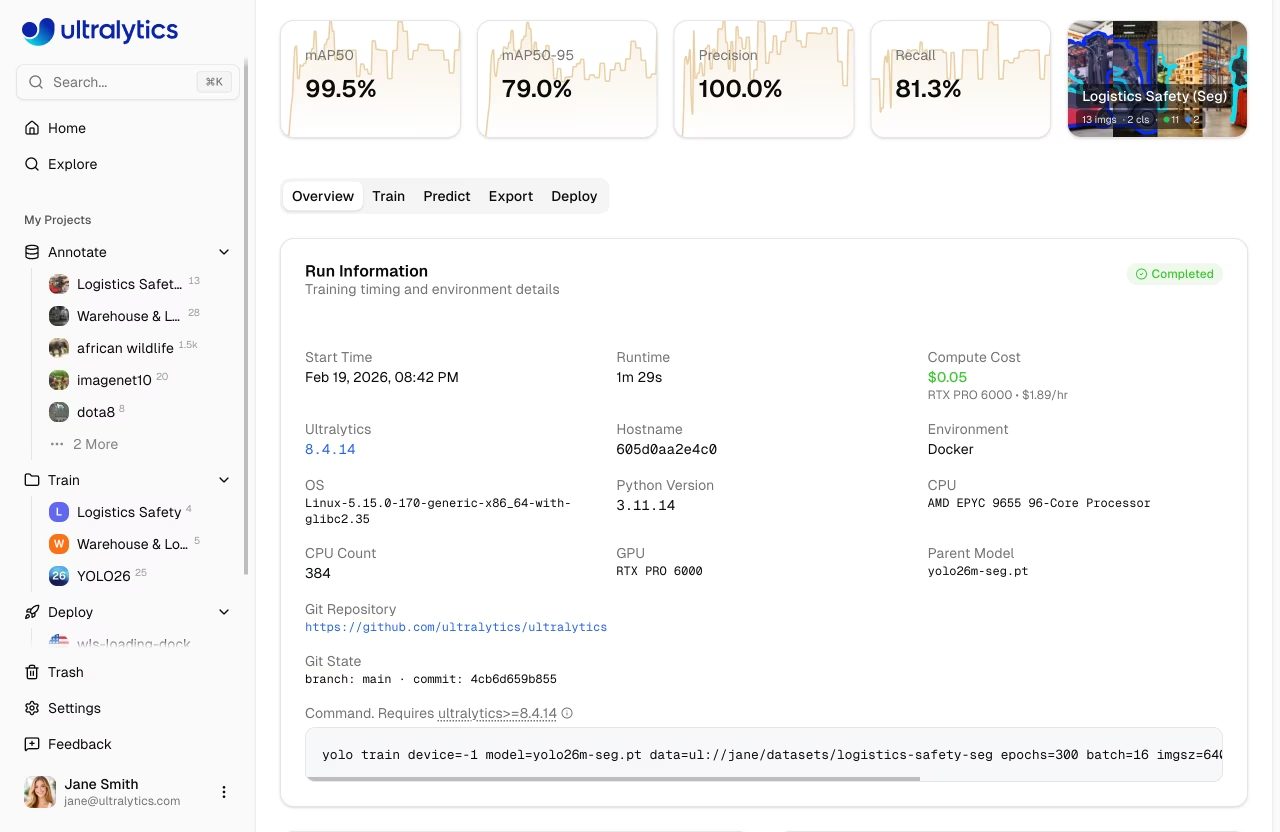

| RTX PRO 6000 | Blackwell | 96 GB | $1.89 | Par défaut recommandé |

| H100 PCIe | Hopper | 80 GB | $2.39 | Entranement haute performance |

| H100 SXM | Hopper | 80 GB | $2.99 | Entraînement le plus rapide |

| H100 NVL | Hopper | 94 Go | 3,07 $ | Performance maximale |

| H200 NVL | Hopper | 143 Go | 3,39 $ | Mémoire maximale |

| H200 SXM | Hopper | 141 Go | 3,99 $ | Performance maximale |

| B200 | Blackwell | 180 Go | 5,49 $ | Modèles larges (Pro+) |

| B300 | Blackwell | 288 Go | 7,39 $ | Modèles les plus larges (Pro+) |

- RTX PRO 6000 : 96 Go Blackwell, défaut recommandé pour la plupart des travaux

- A100 SXM : 80 Go HBM2e — un choix solide pour les grandes tailles de lot ou les modèles plus volumineux

- H100 PCIe / H100 SXM / H100 NVL : 80–94 Go Hopper pour un entraînement sensible au temps (disponible sur tous les plans)

- H200 NVL / H200 SXM : 141–143 Go Hopper pour les charges de travail à haute mémoire (disponible sur tous les plans)

- B200 / B300 : 180–288 Go NVIDIA Blackwell pour les charges de travail de pointe — nécessite Pro ou Enterprise

La fenêtre affiche ton solde actuel et un bouton Recharger. Un coût estimé et une durée sont calculés en fonction de ta configuration (taille du modèle, images du jeu de données, époques, vitesse du GPU).

Link to this sectionÉtape 6 : Démarrer l'entraînement#

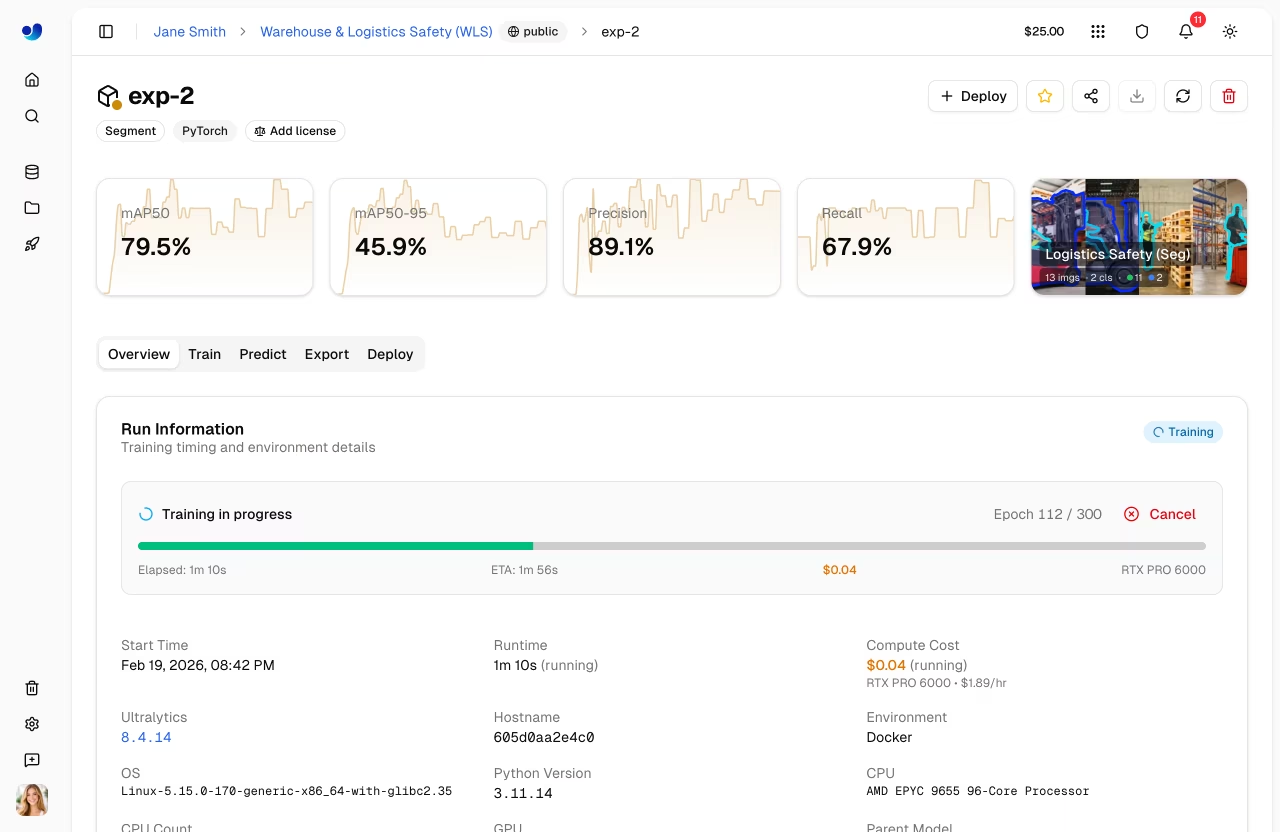

Clique sur Démarrer l'entraînement pour lancer ton travail. La plateforme :

- Provisionne une instance GPU

- Télécharge ton jeu de données

- Commence l'entraînement

- Diffuse les métriques en temps réel

Link to this sectionCycle de vie du travail d'entraînement#

Les travaux d'entraînement progressent selon les statuts suivants :

| Statut | Description |

|---|---|

| En attente | Travail soumis, en attente d'allocation GPU |

| Démarrage | GPU provisionné, téléchargement du jeu de données et du modèle en cours |

| En cours | Entraînement en cours, streaming des métriques en temps réel |

| Terminé | Entraînement terminé avec succès |

| Échoué | L'entraînement a échoué (voir les journaux de console pour plus de détails) |

| Annulé | L'entraînement a été annulé par l'utilisateur |

Les nouveaux comptes reçoivent des crédits d'inscription — 5 $ pour les e-mails personnels et 25 $ pour les e-mails professionnels. Vérifie ton solde dans Paramètres > Facturation.

Link to this sectionSurveiller l'entraînement#

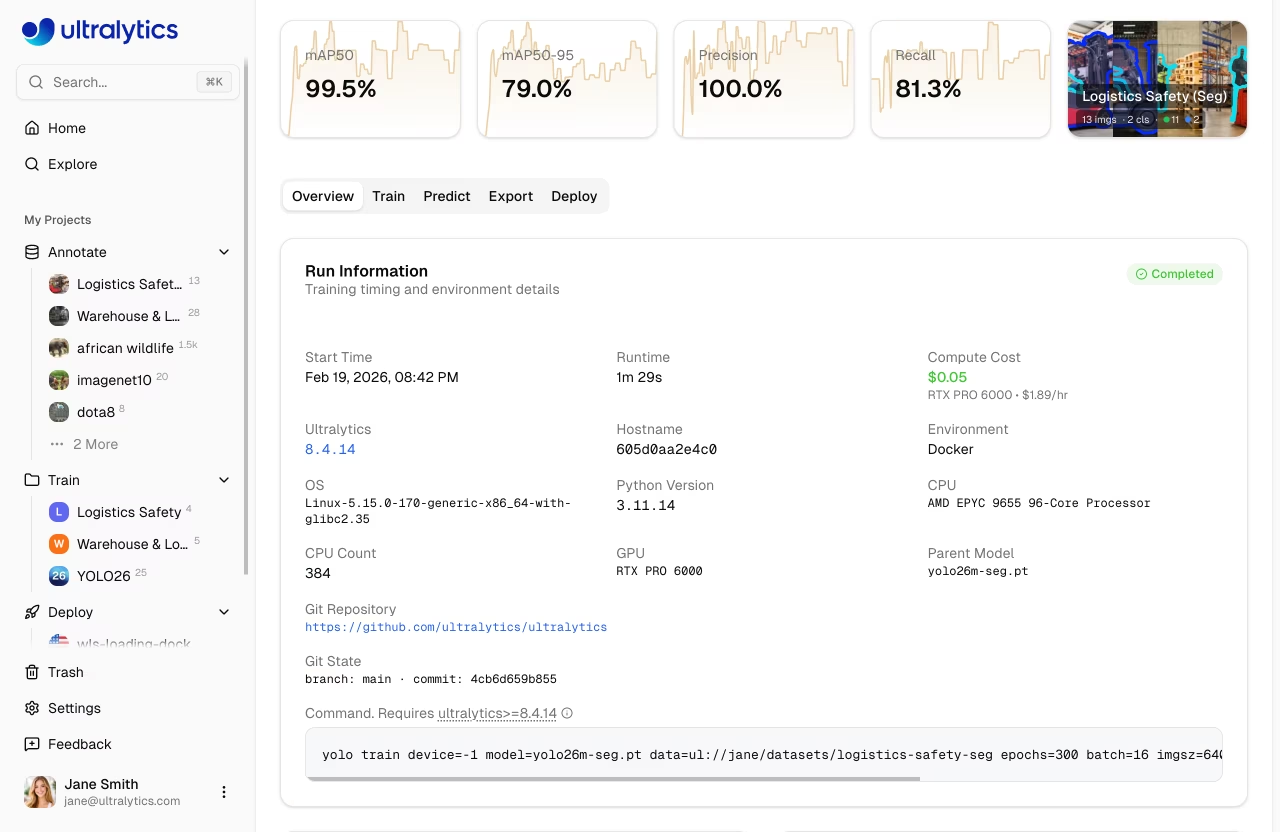

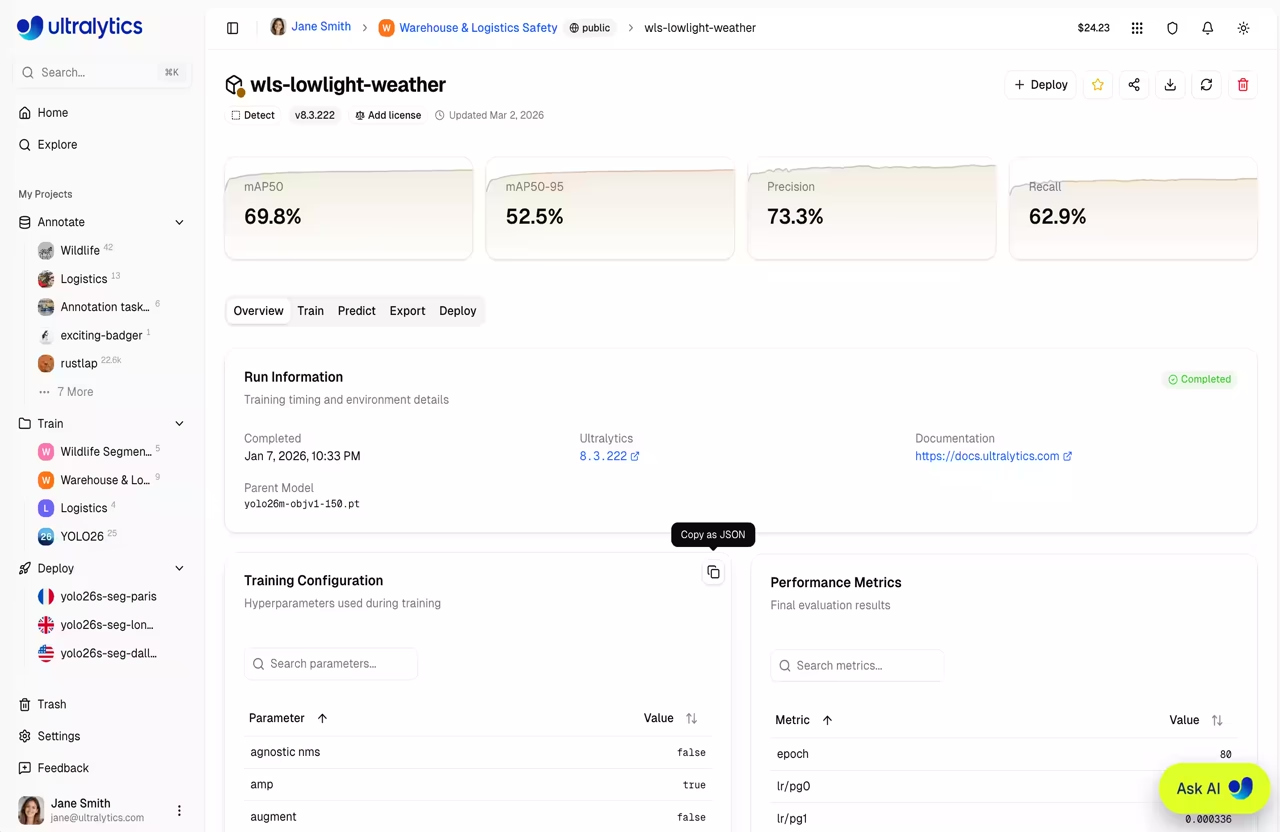

Visualise la progression de l'entraînement en temps réel sur l'onglet Entraîner de la page du modèle :

Link to this sectionSous-onglet Graphiques#

| Métrique | Description |

|---|---|

| Loss | Perte d'entraînement et de validation |

| mAP | Précision moyenne moyenne |

| Précision | Prédictions positives correctes |

| Rappel | Vérités terrain détectées |

Link to this sectionSous-onglet Console#

Sortie de console en direct avec support des couleurs ANSI, barres de progression et détection d'erreurs.

Link to this sectionSous-onglet Système#

Utilisation du GPU, mémoire, température, CPU et utilisation du disque en temps réel.

Link to this sectionPoints de contrôle#

Une fois l'entraînement terminé, le meilleur modèle (best.pt, le point de contrôle avec le mAP le plus élevé) est téléchargé sur la plateforme et rendu disponible pour le téléchargement, l'exportation et le déploiement.

Link to this sectionAnnuler l'entraînement#

Clique sur Annuler l'entraînement sur la page du modèle pour arrêter un travail en cours :

- L'instance de calcul est terminée

- Les crédits cessent d'être débités

- Le meilleur checkpoint reste disponible s'il a été atteint avant l'annulation

Link to this sectionEntraînement à distance#

graph LR

A[Local GPU] --> B[Train]

B --> C[ultralytics Package]

C --> D[Stream Metrics]

D --> E[Platform Dashboard]

style A fill:#FF9800,color:#fff

style C fill:#2196F3,color:#fff

style E fill:#4CAF50,color:#fffEntraîne-toi sur ton propre matériel tout en diffusant les métriques vers la plateforme.

L'intégration à la plateforme nécessite ultralytics>=8.4.60. Les versions inférieures ne fonctionneront PAS avec la plateforme.

pip install -U ultralyticsLink to this sectionConfigurer la clé API#

- Va dans

Settings > API Keys - Crée une nouvelle clé (ou la plateforme en crée une automatiquement lorsque tu ouvres l'onglet Local Training)

- Définit la variable d'environnement :

export ULTRALYTICS_API_KEY="YOUR_API_KEY"Link to this sectionS'entraîner avec le streaming#

Utilise les paramètres project et name pour diffuser les métriques :

yolo train model=yolo26n.pt data=coco.yaml epochs=100 \

project=username/my-project name=experiment-1L'onglet Local Training dans la boîte de dialogue d'entraînement affiche une commande préconfigurée avec ta clé API, les paramètres sélectionnés et les arguments avancés inclus.

Link to this sectionUtilisation des datasets de la plateforme#

Entraîne-toi avec des jeux de données stockés sur la plateforme en utilisant le format d'URI ul:// :

yolo train model=yolo26n.pt data=ul://username/datasets/my-dataset epochs=100 \

project=username/my-project name=exp1Le format d'URI ul:// télécharge et configure automatiquement ton jeu de données. Le modèle est automatiquement lié au jeu de données sur la plateforme (voir Using Platform Datasets).

Link to this sectionFacturation#

Les coûts d'entraînement sont basés sur l'utilisation du GPU :

Link to this sectionEstimation des coûts#

Avant le début de l'entraînement, la plateforme estime le coût total en :

- Estimant les secondes par époque à partir de la taille du jeu de données, de la complexité du modèle, de la taille de l'image, de la taille du batch et de la vitesse du GPU

- Calculant le temps total d'entraînement en multipliant les secondes par époque par le nombre d'époques, puis en ajoutant les frais généraux de démarrage

- Calculant le coût estimé à partir des heures totales d'entraînement multipliées par le tarif horaire du GPU

Facteurs affectant le coût :

| Facteur | Impact |

|---|---|

| Taille du jeu de données | Plus d'images = temps d'entraînement plus long (le calcul évolue de manière quasi linéaire avec la taille du jeu de données) |

| Taille du modèle | Les modèles plus grands (m, l, x) s'entraînent plus lentement que les modèles (n, s) |

| Nombre d'époques | Multiplicateur direct sur le temps d'entraînement |

| Taille de l'image | Une taille d'image plus grande augmente le calcul : 320px=~0.3x, 640px=1.0x (référence), 1280px=~3.5x |

| Taille du lot | Les batches plus grands sont plus efficaces (batch 32 = ~0.85x temps, batch 8 = ~1.2x temps par rapport à la référence batch 16) |

| Vitesse du GPU | Des GPU plus rapides réduisent le temps d'entraînement (par exemple, H100 SXM = ~3.4x plus rapide que RTX 4090) |

| Frais généraux de démarrage | Jusqu'à 5 minutes pour l'initialisation de l'instance, le téléchargement des données et l'échauffement (évolue avec la taille du jeu de données) |

Link to this sectionExemples de coûts#

Les estimations de coûts sont approximatives et dépendent de nombreux facteurs. La boîte de dialogue d'entraînement affiche une estimation en temps réel avant que tu ne lances l'entraînement.

| Scénario | GPU | Coût estimé |

|---|---|---|

| 500 images, YOLO26n, 50 époques | RTX 4090 | ~0,03 $ |

| 1000 images, YOLO26n, 100 époques | RTX PRO 6000 | ~0,27 $ |

| 5000 images, YOLO26s, 100 époques | H100 SXM | ~1,75 $ |

Link to this sectionFlux de facturation#

graph LR

A[Estimate Cost] --> B[Balance Check]

B --> C[Train]

C --> D[Charge Actual Runtime]

style A fill:#2196F3,color:#fff

style B fill:#FF9800,color:#fff

style C fill:#9C27B0,color:#fff

style D fill:#4CAF50,color:#fffFlux de facturation de l'entraînement dans le cloud :

- Estimation : Coût calculé avant le début de l'entraînement

- Vérification du solde : Les crédits disponibles sont vérifiés avant le lancement

- Entraînement : Le travail s'exécute sur le matériel sélectionné

- Débit : Le coût final est basé sur le temps d'exécution réel

La facturation suit l'utilisation réelle du calcul, y compris les exécutions partielles qui sont annulées. Tu n'es jamais facturé pour les entraînements ayant échoué.

Link to this sectionFacturation par statut de tâche#

| Statut | Facturé ? |

|---|---|

| Terminé | Oui — temps GPU réel utilisé |

| Annulé | Oui — temps GPU du début jusqu'à l'annulation |

| Échoué | Non — les exécutions ayant échoué ne sont pas facturées |

| Bloqué | Partiel — seul le temps d'entraînement réel est facturé |

Si un entraînement échoue en raison d'une erreur de configuration, d'un problème de mémoire insuffisante ou de toute autre défaillance, tu n'es pas facturé. Seul le temps de calcul réussi est facturé. Les tâches bloquées (aucune activité pendant plus de 4 heures) sont automatiquement terminées et facturées uniquement pour le temps pendant lequel le GPU était activement en train d'entraîner, et non pour le temps d'inactivité.

Link to this sectionMéthodes de paiement#

| Méthode | Description |

|---|---|

| Solde du compte | Crédits pré-chargés |

| Paiement par tâche | Débit à la fin de la tâche |

Le démarrage de l'entraînement nécessite un solde disponible positif et suffisamment de crédits pour le coût estimé de la tâche.

Link to this sectionVoir les coûts d'entraînement#

Après l'entraînement, consulte les coûts détaillés dans l'onglet Billing :

- Répartition des coûts par époque

- Temps GPU total

- Télécharger le rapport de coûts

Link to this sectionConseils pour l'entraînement#

Link to this sectionChoisir la bonne taille de modèle#

| Modèle | Paramètres | Idéal pour |

|---|---|---|

| YOLO26n | 2.4M | Temps réel, appareils de périphérie (edge) |

| YOLO26s | 9.5M | Vitesse/précision équilibrée |

| YOLO26m | 20.4M | Précision supérieure |

| YOLO26l | 24.8M | Précision de production |

| YOLO26x | 55.7M | Précision maximale |

Link to this sectionOptimiser le temps d'entraînement#

- Commence petit : Teste avec 10-20 époques sur un GPU économique pour vérifier que ton jeu de données et ta configuration fonctionnent

- Utilise un GPU approprié : La RTX PRO 6000 gère bien la plupart des charges de travail

- Valide le jeu de données : Corrige les problèmes d'étiquetage avant de dépenser dans l'entraînement

- Surveille rapidement : Annule l'entraînement si la perte stagne — tu ne paies que pour le temps de calcul utilisé

Link to this sectionDépannage#

| Problème | Solution |

|---|---|

| Entraînement bloqué à 0 % | Vérifie le format du jeu de données, réessaie |

| Mémoire insuffisante | Réduis la taille du batch ou utilise un GPU plus grand |

| Précision médiocre | Augmente les époques, vérifie la qualité des données |

| Entraînement lent | Envisage un GPU plus rapide |

| Erreur d'incompatibilité de tâche | Assure-toi que les tâches du modèle et du jeu de données correspondent |

Link to this sectionFAQ#

Link to this sectionCombien de temps prend l'entraînement ?#

La durée de l'entraînement dépend de :

- Taille du jeu de données

- Taille du modèle

- Le nombre d'époques

- GPU sélectionné

Temps typiques (1000 images, 100 époques) :

| Modèle | RTX PRO 6000 | A100 SXM |

|---|---|---|

| YOLO26n | ~8 min | ~7 min |

| YOLO26m | ~16 min | ~13 min |

| YOLO26x | ~27 min | ~22 min |

Les temps d'entraînement sont approximatifs et varient en fonction de la complexité du jeu de données, des paramètres d'augmentation et de la taille du lot (batch). Utilise l'estimation des coûts de la boîte de dialogue d'entraînement pour des prédictions plus précises.

Link to this sectionPuis-je entraîner pendant la nuit ?#

Oui, l'entraînement se poursuit jusqu'à son terme. Tu recevras une notification lorsque l'entraînement sera terminé. Assure-toi que ton compte dispose d'un solde suffisant pour l'entraînement basé sur les époques.

Link to this sectionQue se passe-t-il si je n'ai plus de crédits ?#

Si ton solde de crédits atteint zéro pendant un entraînement, celui-ci se poursuit jusqu'à son terme et ton solde devient négatif. Cela garantit que ton travail d'entraînement ne soit jamais interrompu en cours de route.

Une fois l'entraînement terminé, tu devras ajouter des crédits pour rendre ton solde positif avant de commencer de nouveaux travaux d'entraînement. Ton modèle terminé, tes points de contrôle et tous les artefacts d'entraînement sont entièrement préservés, quel que soit ton solde.

Un solde négatif empêche uniquement de lancer de nouveaux travaux d'entraînement. Les déploiements existants et les autres fonctionnalités de la plateforme continuent de fonctionner normalement. Ajoute des crédits via Paramètres > Facturation ou active le rechargement automatique pour éviter les interruptions.

Link to this sectionQue se passe-t-il si mon entraînement coûte plus cher que l'estimation ?#

Les estimations de coûts sont approximatives — le temps d'entraînement réel peut varier en raison de facteurs tels que la vitesse de chargement des données, le préchauffage du GPU et le comportement de convergence du modèle. Si le coût réel dépasse l'estimation, ton solde peut devenir négatif (voir ci-dessus). La plateforme n'arrête pas l'entraînement en fonction de l'estimation.

Pour gérer les coûts :

- Surveille la progression de l'entraînement en temps réel et annule plus tôt si nécessaire

- Active le rechargement automatique pour recharger automatiquement tes crédits

- Commence par des exécutions plus courtes (moins d'époques) pour calibrer tes attentes

Link to this sectionPuis-je utiliser des arguments d'entraînement personnalisés ?#

Oui, développe la section Paramètres avancés dans la boîte de dialogue d'entraînement pour accéder à un éditeur YAML avec plus de 40 paramètres configurables. Les valeurs non par défaut sont incluses dans les commandes d'entraînement sur le cloud et locales.

L'éditeur YAML prend également en charge l'importation de configurations à partir d'entraînements précédents :

- Copier depuis un modèle existant : Sur la page de n'importe quel modèle terminé, la carte de configuration d'entraînement dispose d'un bouton Copier en JSON. Copie le JSON et colle-le directement dans l'éditeur YAML — il détecte automatiquement le format JSON et importe tous les paramètres.

- Coller du YAML ou du JSON : Colle toute configuration d'entraînement YAML ou JSON valide dans l'éditeur. Les paramètres sont validés automatiquement, les valeurs hors limites sont ajustées et des avertissements sont affichés.

- Glisser-déposer des fichiers : Glisse un fichier

.yamlou.jsondirectement dans l'éditeur pour importer ses paramètres.

Cela facilite la reproduction ou l'itération sur des configurations d'entraînement précédentes sans avoir à saisir manuellement chaque paramètre.

Link to this sectionPuis-je entraîner à partir d'une page de jeu de données ?#

Oui, le bouton Entraîner sur les pages des jeux de données ouvre la boîte de dialogue d'entraînement avec le jeu de données présélectionné et verrouillé. Tu sélectionnes ensuite un projet et un modèle pour commencer l'entraînement.

Link to this sectionRéférence des paramètres d'entraînement#

| Paramètre | Type | Défaut | Plage | Description |

|---|---|---|---|---|

epochs | entier | 100 | 1-10000 | Nombre d'époques d'entraînement |

batch | entier | -1 (auto) | -1 à 512 | Taille du lot (-1 = ajustement automatique à la VRAM disponible) |

imgsz | entier | 640 | 32-4096 | Taille de l'image d'entrée |

patience | entier | 100 | 1-1000 | Patience pour l'arrêt anticipé |

seed | entier | 0 | 0-2147483647 | Graine aléatoire pour la reproductibilité |

deterministic | bool | True | - | Mode d'entraînement déterministe |

amp | bool | True | - | Précision mixte automatique |

close_mosaic | entier | 10 | 0-50 | Désactiver la mosaïque lors des N dernières époques |

save_period | entier | -1 | -1-100 | Enregistrer le point de contrôle tous les N époques |

workers | entier | 8 | 0-64 | Workers du chargeur de données |

cache | sélectionner | false | ram/disk/false | Mettre en cache les images |

Certains paramètres ne s'appliquent qu'à des tâches spécifiques :

- Tâches de détection uniquement (detect, segment, pose, OBB — pas classify) :

box,dfl,degrees,translate,shear,perspective,mosaic,mixup,close_mosaic - Segment uniquement :

copy_paste - Pose uniquement :

pose(poids de la perte),kobj(objectness des points clés)