Link to this sectionクラウドトレーニング#

Ultralytics Platform クラウドトレーニングでは、クラウドGPU上でのワンクリックトレーニングを提供しており、複雑な設定なしでモデルのトレーニングを開始できます。リアルタイムのメトリクスストリーミングと自動チェックポイント保存機能を使用して、YOLO モデルをトレーニングしてください。

graph LR

A[Configure] --> B[Start Training]

B --> C[Provision GPU]

C --> D[Download Dataset]

D --> E[Train]

E --> F[Stream Metrics]

F --> G[Save Checkpoints]

G --> H[Complete]

style A fill:#2196F3,color:#fff

style B fill:#FF9800,color:#fff

style E fill:#9C27B0,color:#fff

style H fill:#4CAF50,color:#fffLink to this sectionトレーニングダイアログ#

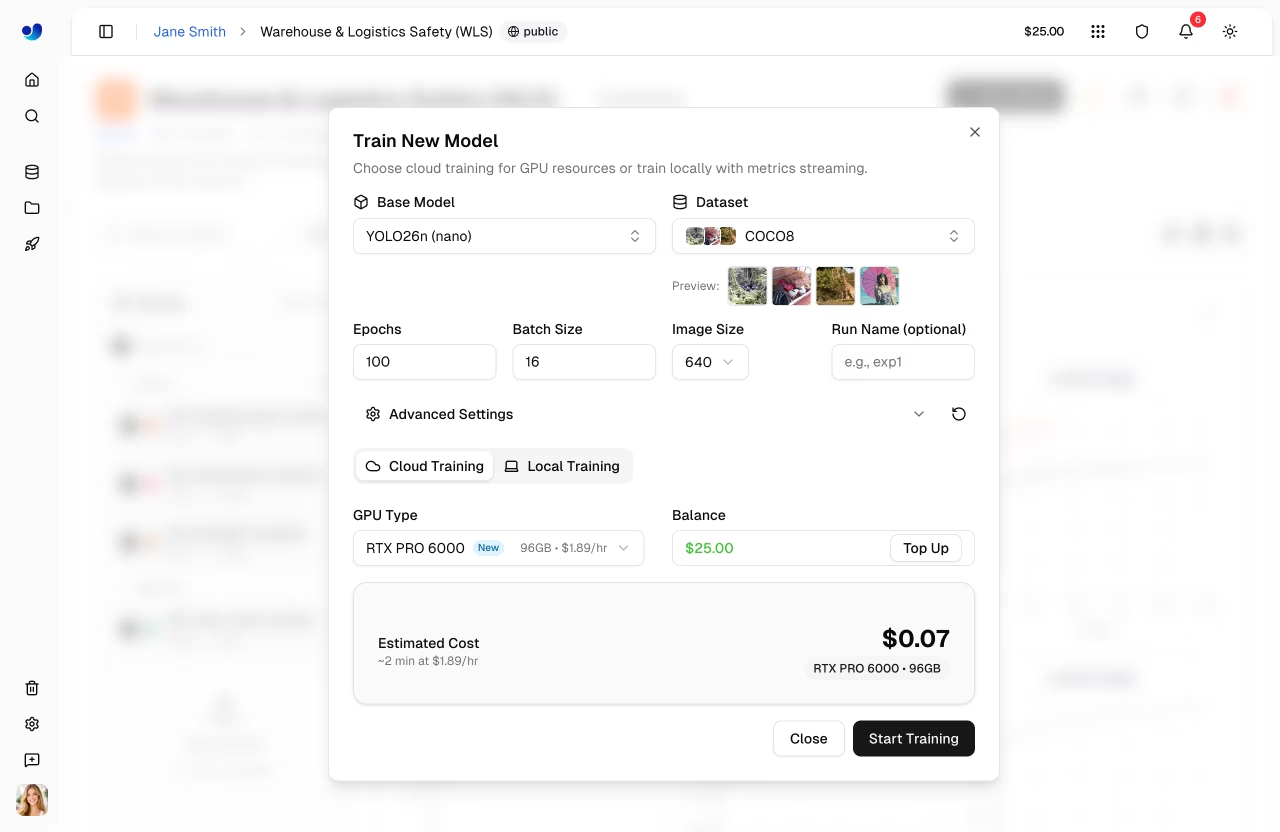

プラットフォームUIのプロジェクトページで New Model(またはデータセットページの Train)をクリックして、トレーニングを開始します。トレーニングダイアログには、Cloud Training と Local Training の2つのタブがあります。

Link to this sectionステップ 1: ベースモデルの選択#

公式の YOLO26 モデル、またはトレーニング済みの独自モデルから選択します。

| カテゴリ | 説明 |

|---|---|

| 公式 | 全30種類の YOLO26 モデル(5サイズ x 6タスク) |

| 自分のモデル | ファインチューニング用に完了済みのモデル |

公式モデルはタスクタイプ(Detect, Segment, Semantic, Pose, OBB, Classify)ごとに整理されており、サイズは nano から xlarge まであります。

Link to this sectionステップ 2: データセットの選択#

トレーニングに使用するデータセットを選択します(Datasets を参照)。

| オプション | 説明 |

|---|---|

| 公式 | Ultralytics による厳選データセット |

| 自分のデータセット | アップロード済みのデータセット |

データセットは ready ステータスであり、学習用データセットに少なくとも1枚の画像、検証またはテストデータセットに少なくとも1枚の画像が含まれ、かつ少なくとも1枚のラベル付き画像が存在する必要があります。

モデルのタスク(例: detect)とデータセットのタスク(例: segment)が一致しない場合、タスクの不一致に関する警告が表示されます。不一致のまま進めるとトレーニングは失敗します。 タスクガイド で説明されている通り、モデルとデータセットの両方で同じタスクタイプを使用するようにしてください。

Link to this sectionステップ 3: パラメータの設定#

主要なトレーニングパラメータを設定します。

| パラメータ | 説明 | デフォルト |

|---|---|---|

| Epochs(エポック数) | トレーニングの反復回数 | 100 |

| Batch Size(バッチサイズ) | 1反復あたりのサンプル数 | -1(自動) |

| Image Size(画像サイズ) | 入力解像度(320/416/512/640/1280のドロップダウン、YAMLエディタでは32〜4096の範囲で32の倍数を指定可能) | 640 |

| Run Name(実行名) | トレーニング実行の任意の名前 | 自動 |

Link to this sectionステップ 4: 高度な設定(オプション)#

Advanced Settings を展開すると、グループ別に整理された40以上のトレーニングパラメータを持つ完全なYAMLベースのパラメータエディタにアクセスできます(構成リファレンス を参照)。

| グループ | パラメータ |

|---|---|

| Learning Rate | lr0, lrf, momentum, weight_decay, warmup_epochs, warmup_momentum, warmup_bias_lr |

| Optimizer(オプティマイザ) | auto(デフォルト)、SGD、MuSGD、Adam、AdamW、NAdam、RAdam、RMSProp、Adamax |

| Loss Weights(損失重み) | box, cls, dfl, pose, kobj, label_smoothing |

| Color Augmentation(色拡張) | hsv_h, hsv_s, hsv_v |

| Geometric Augment.(幾何学拡張) | degrees, translate, scale, shear, perspective |

| Flip & Mix Augment.(反転&混合拡張) | flipud, fliplr, mosaic, mixup, copy_paste |

| Training Control(トレーニング制御) | patience, seed, deterministic, amp, cos_lr, close_mosaic, save_period |

| Dataset(データセット) | fraction, freeze, single_cls, rect, multi_scale, resume |

パラメータはタスクを認識します(例: copy_paste はセグメンテーションタスクでのみ表示され、pose/kobj はポーズ推定タスクでのみ表示されます)。デフォルト値から変更されると Modified バッジが表示され、リセットボタンですべてをデフォルト値に戻すことができます。

例: 小規模データセット向けの拡張調整

小規模なデータセット(1000枚未満)の場合、過学習を減らすために拡張設定を増やしてください。

mosaic: 1.0 # Keep mosaic on

mixup: 0.3 # Add mixup blending

copy_paste: 0.3 # Add copy-paste (segment only)

fliplr: 0.5 # Horizontal flip

degrees: 10.0 # Slight rotation

scale: 0.9 # Aggressive scalingLink to this sectionステップ 5: GPUの選択(クラウドタブ)#

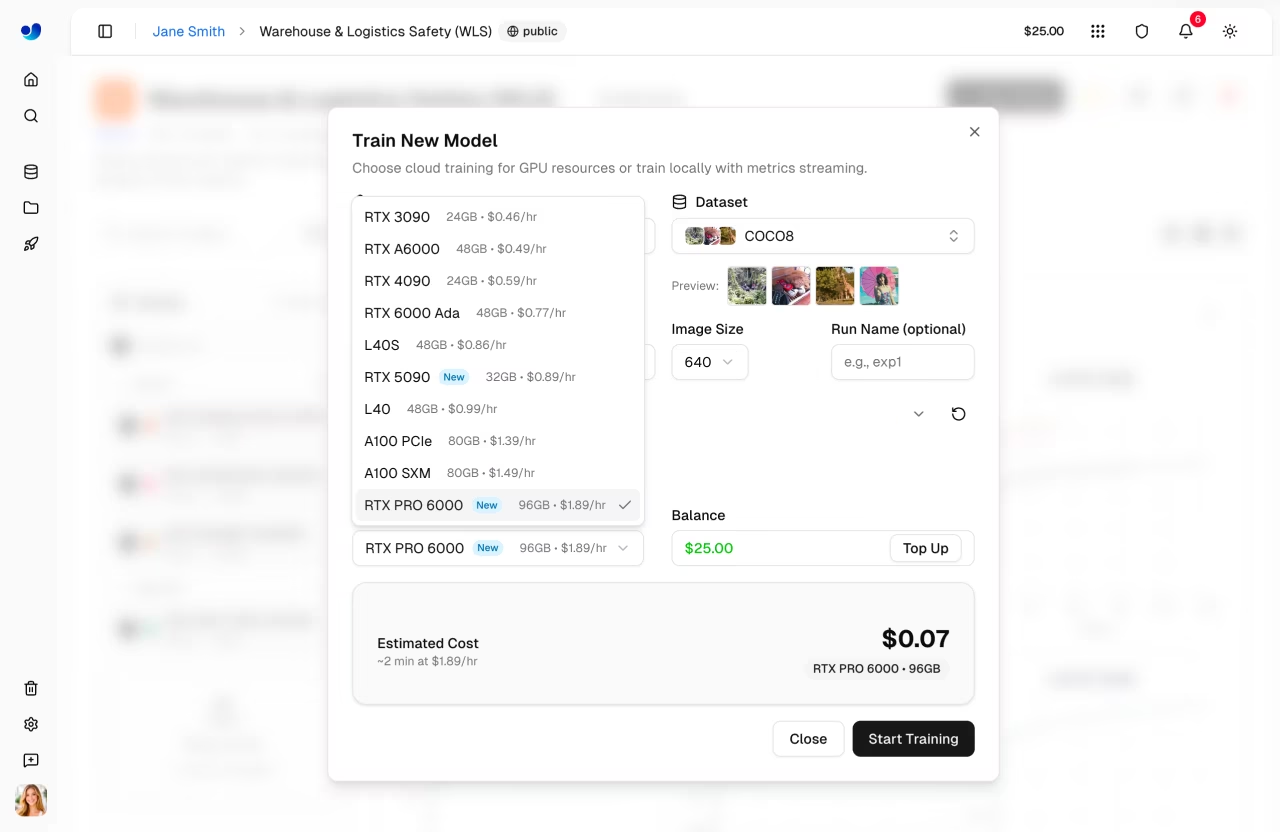

Ultralytics Cloud からGPUを選択します。

| GPU | 世代 | VRAM | 時間あたりのコスト | 最適な用途 |

|---|---|---|---|---|

| RTX 2000 Ada | Ada | 16 GB | $0.24 | 小規模データセット、テスト |

| RTX A4500 | Ampere | 20 GB | $0.25 | 小~中規模データセット |

| RTX 4000 Ada | Ada | 20 GB | $0.26 | 中規模データセット |

| RTX A5000 | Ampere | 24 GB | $0.27 | 中規模データセット |

| L4 | Ada | 24 GB | $0.39 | 推論に最適化 |

| A40 | Ampere | 48 GB | $0.44 | より大きなバッチサイズ |

| RTX 3090 | Ampere | 24 GB | $0.46 | 一般的なトレーニング |

| RTX A6000 | Ampere | 48 GB | $0.49 | 大規模モデル |

| RTX PRO 4500 | Blackwell | 32 GB | $0.64 | 優れた価格対性能 |

| RTX 4090 | Ada | 24 GB | $0.69 | 最高の価格対性能 |

| RTX 6000 Ada | Ada | 48 GB | $0.77 | 大規模バッチトレーニング |

| L40S | Ada | 48 GB | $0.86 | 大規模バッチトレーニング |

| RTX 5090 | Blackwell | 32 GB | $0.99 | 最新のコンシューマー世代 |

| L40 | Ada | 48 GB | $0.99 | 大規模モデル |

| A100 PCIe | Ampere | 80 GB | $1.39 | 本番環境でのトレーニング |

| A100 SXM | Ampere | 80 GB | $1.49 | 本番環境でのトレーニング |

| RTX PRO 6000 | Blackwell | 96 GB | $1.89 | 推奨のデフォルト |

| H100 PCIe | Hopper | 80 GB | $2.39 | 高性能トレーニング |

| H100 SXM | Hopper | 80 GB | $2.99 | 最速のトレーニング |

| H100 NVL | Hopper | 94 GB | $3.07 | 最大パフォーマンス |

| H200 NVL | Hopper | 143 GB | $3.39 | 最大メモリ |

| H200 SXM | Hopper | 141 GB | $3.99 | 最大パフォーマンス |

| B200 | Blackwell | 180 GB | $5.49 | 大規模モデル (Pro+) |

| B300 | Blackwell | 288 GB | $7.39 | 最大規模モデル (Pro+) |

- RTX PRO 6000: 96 GB Blackwell、ほとんどのジョブで推奨されるデフォルト

- A100 SXM: 80 GB HBM2e — 大規模なバッチサイズや大きなモデルに最適な選択肢

- H100 PCIe / H100 SXM / H100 NVL: 80–94 GB Hopper、時間にシビアなトレーニング用(全プランで利用可能)

- H200 NVL / H200 SXM: 141–143 GB Hopper、高メモリワークロード用(全プランで利用可能)

- B200 / B300: 180–288 GB NVIDIA Blackwell、最先端のワークロード用 — Pro または Enterprise が必要

ダイアログには現在の balance と Top Up ボタンが表示されます。推定コストと期間は、構成(モデルサイズ、データセットの画像枚数、エポック数、GPU速度)に基づいて計算されます。

Link to this sectionステップ 6: トレーニングの開始#

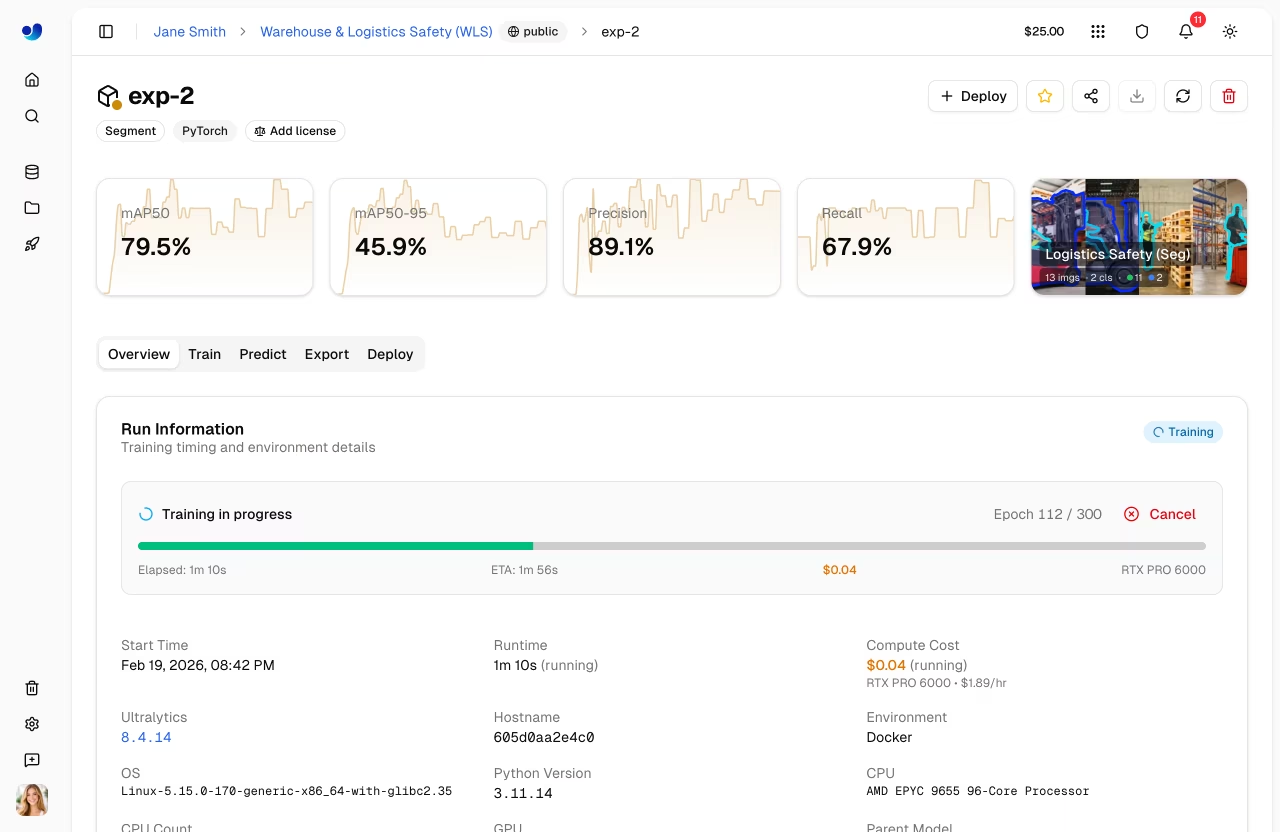

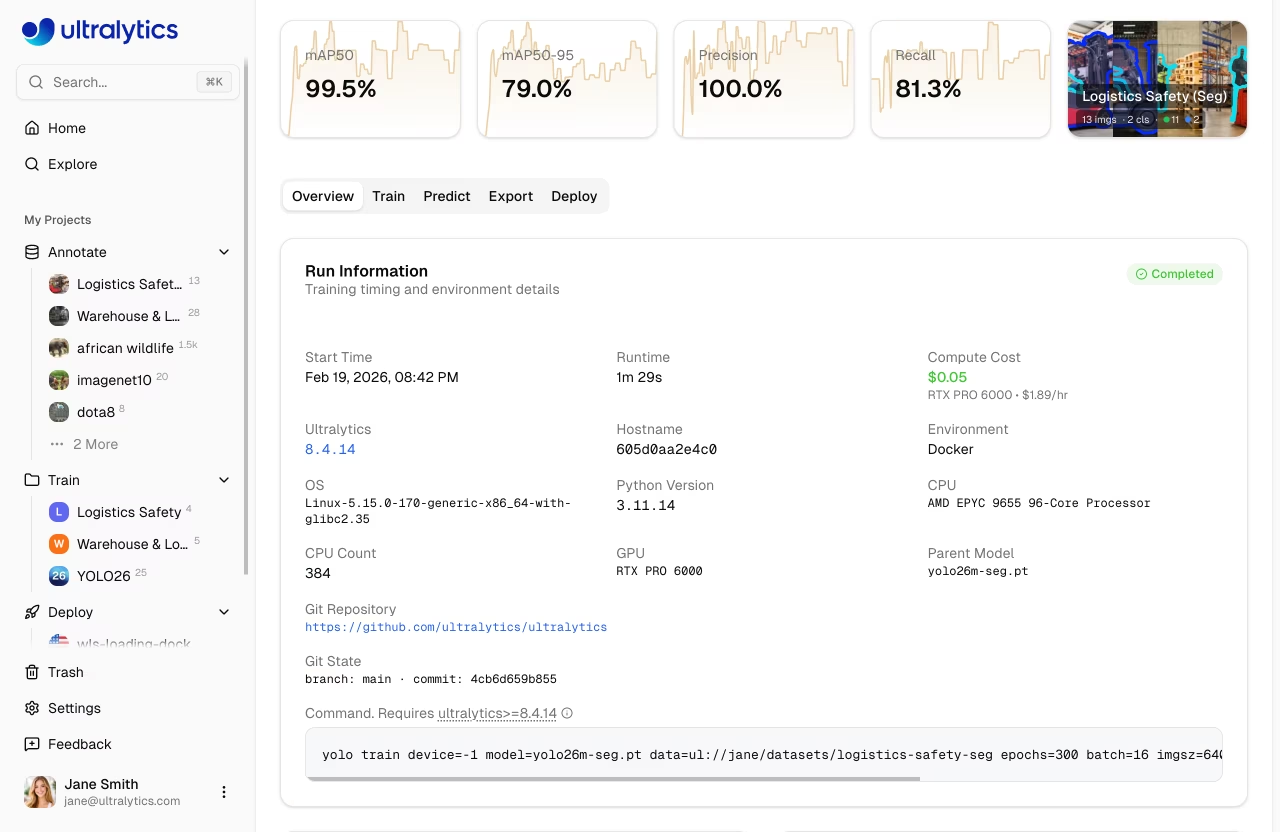

Start Training をクリックしてジョブを開始します。プラットフォームは以下の処理を行います。

- GPUインスタンスの準備

- データセットのダウンロード

- トレーニングの開始

- メトリクスのリアルタイムストリーミング

Link to this sectionトレーニングジョブのライフサイクル#

トレーニングジョブは以下のステータスに沿って進行します。

| ステータス | 説明 |

|---|---|

| Pending(待機中) | ジョブが送信され、GPU割り当てを待機中 |

| Starting(開始中) | GPUの準備が完了し、データセットとモデルをダウンロード中 |

| Running(実行中) | トレーニングが進行中で、メトリクスをリアルタイムでストリーミング中 |

| Completed(完了) | トレーニングが正常に終了 |

| Failed(失敗) | トレーニング失敗(詳細はコンソールログを参照) |

| Cancelled(キャンセル) | ユーザーによってトレーニングがキャンセルされました |

新規アカウントにはサインアップクレジットが付与されます(個人メールは$5、会社メールは$25)。Check your balance(Settings > Billing)から残高を確認できます。

Link to this sectionトレーニングの監視#

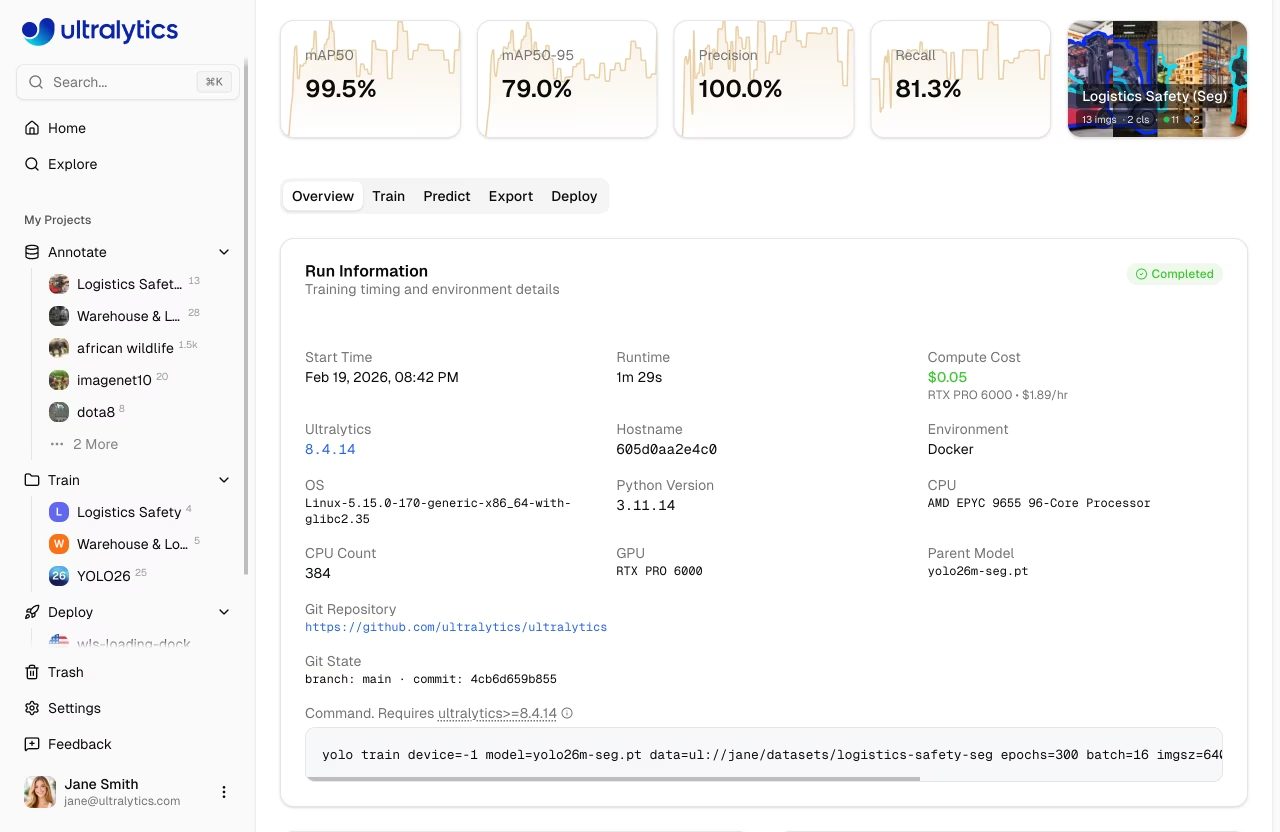

モデルページの Train タブで、リアルタイムのトレーニング進行状況を確認します。

Link to this sectionCharts(グラフ)サブタブ#

| メトリクス | 説明 |

|---|---|

| Loss | トレーニングと検証の損失(Loss) |

| mAP | Mean Average Precision |

| Precision(適合率) | 正しい陽性予測 |

| Recall(再現率) | 検出された正解データ |

Link to this sectionConsole(コンソール)サブタブ#

ANSIカラーサポート、プログレスバー、エラー検出を備えたライブコンソール出力。

Link to this sectionSystem(システム)サブタブ#

リアルタイムのGPU使用率、メモリ、温度、CPU、およびディスク使用量。

Link to this sectionチェックポイント#

トレーニング完了後、最適なモデル(best.pt、mAPが最も高いチェックポイント)がプラットフォームにアップロードされ、ダウンロード、エクスポート、およびデプロイが可能になります。

Link to this sectionトレーニングのキャンセル#

実行中のジョブを停止するには、モデルページのトレーニングをキャンセルをクリックしてください:

- コンピューティングインスタンスが終了します

- クレジットの課金が停止します

- キャンセル前に到達した最適なチェックポイントは引き続き利用可能です

Link to this sectionリモートトレーニング#

graph LR

A[Local GPU] --> B[Train]

B --> C[ultralytics Package]

C --> D[Stream Metrics]

D --> E[Platform Dashboard]

style A fill:#FF9800,color:#fff

style C fill:#2196F3,color:#fff

style E fill:#4CAF50,color:#fff自身のハードウェアでトレーニングを行い、メトリクスをプラットフォームにストリーミングします。

プラットフォームの統合には ultralytics>=8.4.60 が必要です。これより古いバージョンではプラットフォームは動作しません。

pip install -U ultralyticsLink to this sectionAPIキーのセットアップ#

Settings > API Keysに移動します- 新しいキーを作成します(ローカルトレーニングタブを開くと、プラットフォームが自動的にキーを作成することもあります)

- 環境変数を設定します:

export ULTRALYTICS_API_KEY="YOUR_API_KEY"Link to this sectionストリーミングトレーニング#

projectおよびnameパラメータを使用してメトリクスをストリーミングします:

yolo train model=yolo26n.pt data=coco.yaml epochs=100 \

project=username/my-project name=experiment-1トレーニングダイアログのローカルトレーニングタブには、APIキー、選択したパラメータ、および高度な引数が含まれた設定済みのコマンドが表示されます。

Link to this sectionプラットフォームデータセットの使用#

ul:// URI形式を使用して、プラットフォームに保存されたデータセットでトレーニングします:

yolo train model=yolo26n.pt data=ul://username/datasets/my-dataset epochs=100 \

project=username/my-project name=exp1ul:// URI形式は、データセットを自動的にダウンロードおよび構成します。モデルはプラットフォーム上のデータセットに自動的にリンクされます(プラットフォームデータセットの使用を参照してください)。

Link to this section請求#

トレーニング費用はGPUの使用量に基づいています:

Link to this sectionコスト見積もり#

トレーニング開始前に、プラットフォームは以下の方法で総コストを見積もります:

- データセットサイズ、モデルの複雑さ、画像サイズ、バッチサイズ、およびGPU速度からエポックあたりの秒数を推定します

- エポックあたりの秒数にエポック数を乗算し、起動時のオーバーヘッドを追加して総トレーニング時間を計算します

- 総トレーニング時間にGPUの時給を乗算して推定コストを計算します

コストに影響を与える要因:

| 要因 | 影響 |

|---|---|

| データセットサイズ | 画像が多いほどトレーニング時間が長くなります(計算コストはデータセットサイズにほぼ比例してスケーリングします) |

| モデルサイズ | 大きなモデル(m, l, x)は(n, s)よりもトレーニングが遅くなります |

| エポック数 | トレーニング時間の直接的な乗数になります |

| Image Size(画像サイズ) | imgszが大きいほど計算量が増加します:320px=約0.3倍、640px=1.0倍(ベースライン)、1280px=約3.5倍 |

| Batch Size(バッチサイズ) | バッチが大きいほど効率的です(バッチ32=約0.85倍の時間、バッチ8=約1.2倍の時間、バッチ16のベースラインと比較) |

| GPU速度 | 高速なGPUはトレーニング時間を短縮します(例:H100 SXM=RTX 4090より約3.4倍高速) |

| 起動オーバーヘッド | インスタンスの初期化、データダウンロード、ウォームアップに最大5分(データセットサイズに応じて変動) |

Link to this sectionコスト例#

コスト見積もりは概算であり、多くの要因に依存します。トレーニングダイアログには、トレーニング開始前にリアルタイムの見積もりが表示されます。

| シナリオ | GPU | 推定コスト |

|---|---|---|

| 500画像、YOLO26n、50エポック | RTX 4090 | 約$0.03 |

| 1000画像、YOLO26n、100エポック | RTX PRO 6000 | 約$0.27 |

| 5000画像、YOLO26s、100エポック | H100 SXM | 約$1.75 |

Link to this section請求フロー#

graph LR

A[Estimate Cost] --> B[Balance Check]

B --> C[Train]

C --> D[Charge Actual Runtime]

style A fill:#2196F3,color:#fff

style B fill:#FF9800,color:#fff

style C fill:#9C27B0,color:#fff

style D fill:#4CAF50,color:#fffクラウドトレーニングの請求フロー:

- 見積もり:トレーニング開始前にコストを計算

- 残高確認:開始前に利用可能なクレジットを確認

- トレーニング:選択したコンピューティングでジョブを実行

- 課金:最終コストは実際の実行時間に基づいて決定

請求は、キャンセルされた部分的な実行を含め、実際のコンピューティング使用量を追跡します。失敗したトレーニング実行に対して課金されることはありません。

Link to this sectionジョブステータス別の請求#

| ステータス | 課金対象か? |

|---|---|

| Completed(完了) | はい — 実際のGPU使用時間 |

| Cancelled(キャンセル) | はい — 開始からキャンセルまでのGPU時間 |

| Failed(失敗) | いいえ — 失敗した実行は課金されません |

| スタック(フリーズ) | 部分課金 — 実際のトレーニング時間のみ課金 |

構成エラー、メモリ不足問題、またはその他の障害によりトレーニング実行が失敗した場合、課金されません。成功したコンピューティング時間のみが請求されます。スタックしたジョブ(4時間以上アクティビティがないもの)は自動的に終了され、アイドル時間ではなくGPUがアクティブにトレーニングしていた時間のみが課金されます。

Link to this section支払い方法#

| メソッド | 説明 |

|---|---|

| アカウント残高 | 事前ロードされたクレジット |

| ジョブごとの支払い | ジョブ完了時に課金 |

トレーニングを開始するには、正の利用可能残高があり、推定ジョブコストを賄える十分なクレジットが必要です。

Link to this sectionトレーニングコストの表示#

トレーニング後、Billingタブで詳細なコストを表示できます:

- エポックごとのコスト内訳

- 総GPU時間

- コストレポートのダウンロード

Link to this sectionトレーニングのヒント#

Link to this section適切なモデルサイズを選択#

| モデル | パラメータ | 最適な用途 |

|---|---|---|

| YOLO26n | 2.4M | リアルタイム、エッジデバイス |

| YOLO26s | 9.5M | 速度と精度のバランス |

| YOLO26m | 20.4M | より高い精度 |

| YOLO26l | 24.8M | プロダクションレベルの精度 |

| YOLO26x | 55.7M | 最大の精度 |

Link to this sectionトレーニング時間の最適化#

- 小さく始める:安価なGPUで10〜20エポックテストし、データセットと構成が機能することを確認する

- 適切なGPUを使用する:RTX PRO 6000はほとんどのワークロードを良好に処理します

- データセットを検証する:トレーニングに費用をかける前にラベル付けの問題を修正する

- 早期に監視する:損失が横ばいになったらトレーニングをキャンセルする(使用したコンピューティング時間分のみ支払うことになります)

Link to this sectionトラブルシューティング#

| 問題 | 解決策 |

|---|---|

| トレーニングが0%でスタックする | データセット形式を確認し、再試行する |

| メモリ不足 | バッチサイズを減らすか、より大きなGPUを使用してください |

| 精度が低い | エポック数を増やし、データの品質を確認してください |

| 学習が遅い | より高速なGPUの利用を検討してください |

| タスクの不一致エラー | モデルとデータセットのタスクが一致していることを確認してください |

Link to this sectionよくある質問 (FAQ)#

Link to this sectionトレーニングにはどのくらい時間がかかりますか?#

トレーニング時間は以下に依存します:

- データセットサイズ

- モデルサイズ

- エポック数

- 選択されたGPU

一般的な所要時間(1000画像、100エポック):

| モデル | RTX PRO 6000 | A100 SXM |

|---|---|---|

| YOLO26n | 約8分 | 約7分 |

| YOLO26m | 約16分 | 約13分 |

| YOLO26x | 約27分 | 約22分 |

学習時間は概算であり、データセットの複雑さ、拡張設定、バッチサイズによって変動します。より正確な予測については、学習ダイアログのコスト見積もりを使用してください。

Link to this section夜間に学習を行えますか?#

はい、学習は完了まで継続されます。学習が終了すると通知が届きます。アカウントにエポックベースの学習を行うための十分な残高があることを確認してください。

Link to this sectionクレジットが不足した場合はどうなりますか?#

学習中にクレジット残高がゼロになった場合でも、学習は完了まで継続され、残高はマイナスになります。これにより、学習ジョブが途中で中断されることはありません。

学習完了後、新しい学習ジョブを開始する前に、クレジットを追加して残高をプラスに戻す必要があります。完成したモデル、チェックポイント、およびすべての学習成果物は、残高に関係なく完全に保存されます。

マイナス残高は、新規の学習ジョブの開始のみを制限します。既存のデプロイメントやその他のプラットフォーム機能は通常通り動作します。中断を避けるため、Settings > Billing からクレジットを追加するか、auto top-up を有効にしてください。

Link to this section学習コストが見積もりを超えた場合はどうなりますか?#

コスト見積もりは概算です。実際の学習時間は、データの読み込み速度、GPUのウォームアップ、モデルの収束状況などの要因によって異なります。実際のコストが見積もりを超えた場合、残高がマイナスになる可能性があります(上記参照)。プラットフォームは見積もりに基づいて学習を停止することはありません。

コストを管理するには:

- リアルタイムで学習の進行状況を監視し、必要に応じて早期にキャンセルしてください

- auto top-up を有効にして、クレジットを自動的に補充してください

- 最初は短い実行時間(少ないエポック数)で試して、予測を調整してください

Link to this sectionカスタム学習引数を使用できますか?#

はい、学習ダイアログの Advanced Settings セクションを展開すると、40以上の構成可能なパラメータを備えたYAMLエディタにアクセスできます。デフォルト以外の値は、クラウドとローカルの両方の学習コマンドに含まれます。

YAMLエディタは、以前の学習実行からの構成のインポートもサポートしています:

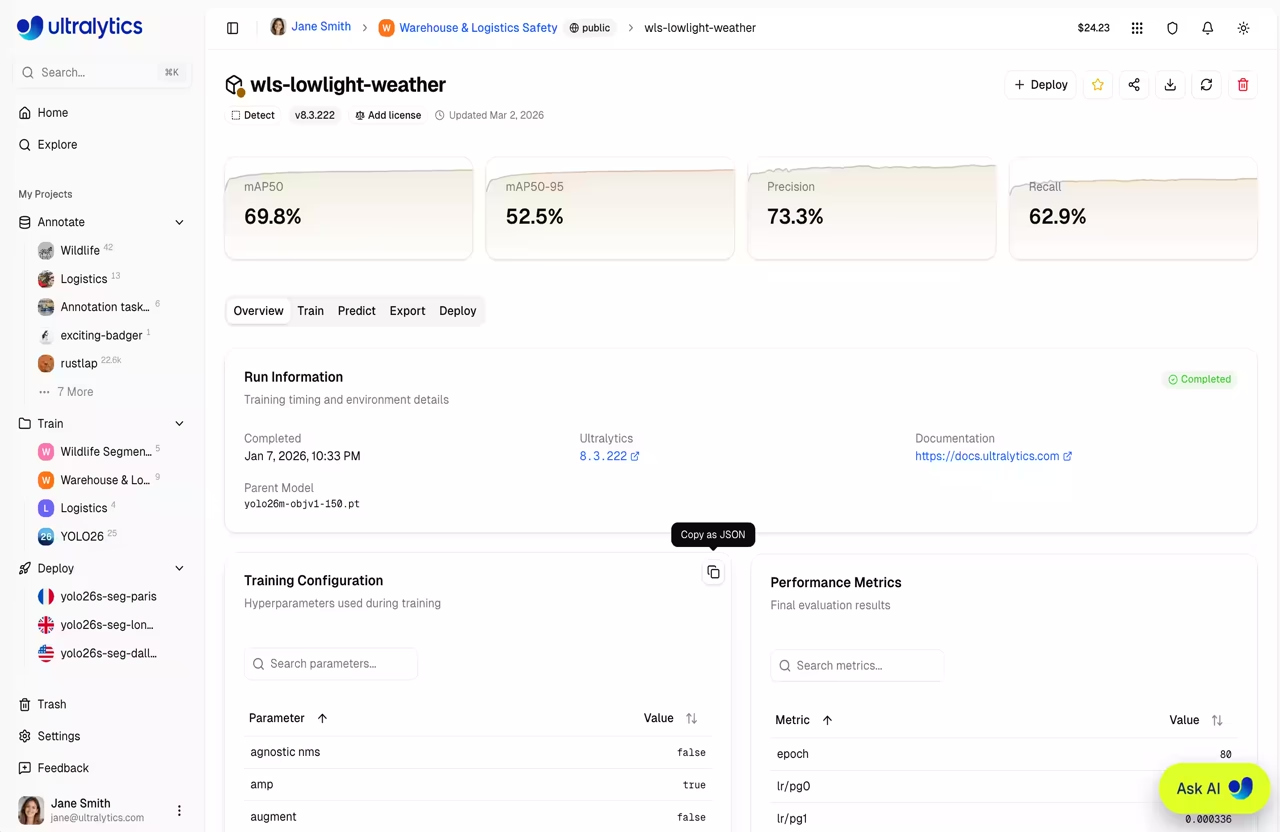

- 既存のモデルからコピー: 完了したモデルのページにある「Training Configuration」カードには、Copy as JSON ボタンがあります。JSONをコピーしてYAMLエディタに直接貼り付けると、JSON形式が自動的に検出され、すべてのパラメータがインポートされます。

- YAMLまたはJSONを貼り付け: 有効なYAMLまたはJSON学習構成をエディタに貼り付けます。パラメータは自動的に検証され、範囲外の値はクランプされ、警告が表示されます。

- ファイルをドラッグ&ドロップ:

.yamlまたは.jsonファイルをエディタに直接ドラッグして、パラメータをインポートします。

これにより、各パラメータを手動で再入力することなく、以前の学習構成を簡単に再現したり、反復したりできます。

Link to this sectionデータセットページから学習を開始できますか?#

はい、データセットページの Train ボタンを押すと、データセットが選択され固定された状態で学習ダイアログが開きます。その後、プロジェクトとモデルを選択して学習を開始します。

Link to this section学習パラメータリファレンス#

| パラメータ | タイプ | デフォルト | 範囲 | 説明 |

|---|---|---|---|---|

epochs | int | 100 | 1-10000 | 学習エポック数 |

batch | int | -1(自動) | -1から512 | バッチサイズ (-1 = 利用可能なVRAMに合わせて自動調整) |

imgsz | int | 640 | 32-4096 | 入力画像サイズ |

patience | int | 100 | 1-1000 | 早期終了の猶予期間 |

seed | int | 0 | 0-2147483647 | 再現性のための乱数シード |

deterministic | bool | True | - | 決定論的学習モード |

amp | bool | True | - | 自動混合精度 |

close_mosaic | int | 10 | 0-50 | 最後のNエポックでモザイクを無効にする |

save_period | int | -1 | -1-100 | Nエポックごとにチェックポイントを保存 |

workers | int | 8 | 0-64 | データローダーのワーカー数 |

cache | 選択 | false | ram/disk/false | 画像のキャッシュ |

一部のパラメータは特定のタスクにのみ適用されます:

- 検出タスクのみ(detect、segment、pose、OBB — classifyは含まれません):

box、dfl、degrees、translate、shear、perspective、mosaic、mixup、close_mosaic - セグメンテーションのみ:

copy_paste - ポーズのみ:

pose(損失の重み)、kobj(キーポイントオブジェクトネス)