COCO8-Datensatz

Einführung

Der Ultralytics COCO8-Datensatz ist ein kompakter und dennoch leistungsstarker object detection-Datensatz, bestehend aus den ersten 8 Bildern des COCO train 2017 Sets – 4 für das Training und 4 für die Validierung. Dieser Datensatz wurde speziell für schnelles Testen, Debugging und Experimentieren mit YOLO-Modellen und Trainingspipelines entwickelt. Seine geringe Größe macht ihn sehr handhabbar, während seine Vielfalt sicherstellt, dass er als effektiver Sanity Check dient, bevor auf größere Datensätze skaliert wird.

Ansehen: Ultralytics COCO Datensatz-Übersicht

COCO8 ist vollständig kompatibel mit der Ultralytics Platform und YOLO26, was eine nahtlose Integration in Ihre Computer-Vision-Workflows ermöglicht.

Datensatz-YAML

Die COCO8-Dataset-Konfiguration ist in einer YAML-Datei (Yet Another Markup Language) definiert, die Dataset-Pfade, Klassennamen und andere wesentliche Metadaten festlegt. Die offizielle coco8.yaml Datei in der Ultralytics GitHub-Repositorys.

Ultralytics/cfg/datasets/COCO8.yaml

# Ultralytics 🚀 AGPL-3.0 License - https://ultralytics.com/license

# COCO8 dataset (first 8 images from COCO train2017) by Ultralytics

# Documentation: https://docs.ultralytics.com/datasets/detect/coco8/

# Example usage: yolo train data=coco8.yaml

# parent

# ├── ultralytics

# └── datasets

# └── coco8 ← downloads here (1 MB)

# Train/val/test sets as 1) dir: path/to/imgs, 2) file: path/to/imgs.txt, or 3) list: [path/to/imgs1, path/to/imgs2, ..]

path: coco8 # dataset root dir

train: images/train # train images (relative to 'path') 4 images

val: images/val # val images (relative to 'path') 4 images

test: # test images (optional)

# Classes

names:

0: person

1: bicycle

2: car

3: motorcycle

4: airplane

5: bus

6: train

7: truck

8: boat

9: traffic light

10: fire hydrant

11: stop sign

12: parking meter

13: bench

14: bird

15: cat

16: dog

17: horse

18: sheep

19: cow

20: elephant

21: bear

22: zebra

23: giraffe

24: backpack

25: umbrella

26: handbag

27: tie

28: suitcase

29: frisbee

30: skis

31: snowboard

32: sports ball

33: kite

34: baseball bat

35: baseball glove

36: skateboard

37: surfboard

38: tennis racket

39: bottle

40: wine glass

41: cup

42: fork

43: knife

44: spoon

45: bowl

46: banana

47: apple

48: sandwich

49: orange

50: broccoli

51: carrot

52: hot dog

53: pizza

54: donut

55: cake

56: chair

57: couch

58: potted plant

59: bed

60: dining table

61: toilet

62: tv

63: laptop

64: mouse

65: remote

66: keyboard

67: cell phone

68: microwave

69: oven

70: toaster

71: sink

72: refrigerator

73: book

74: clock

75: vase

76: scissors

77: teddy bear

78: hair drier

79: toothbrush

# Download script/URL (optional)

download: https://github.com/ultralytics/assets/releases/download/v0.0.0/coco8.zip

Nutzung

Um ein YOLO26n-Modell auf dem COCO8-Datensatz für 100 Epochen mit einer Bildgröße von 640 zu trainieren, verwenden Sie die folgenden Beispiele. Eine vollständige Liste der Trainingsoptionen finden Sie in der YOLO Trainingsdokumentation.

Trainingsbeispiel

from ultralytics import YOLO

# Load a pretrained YOLO26n model

model = YOLO("yolo26n.pt")

# Train the model on COCO8

results = model.train(data="coco8.yaml", epochs=100, imgsz=640)

# Train YOLO26n on COCO8 using the command line

yolo detect train data=coco8.yaml model=yolo26n.pt epochs=100 imgsz=640

sample_images und Anmerkungen

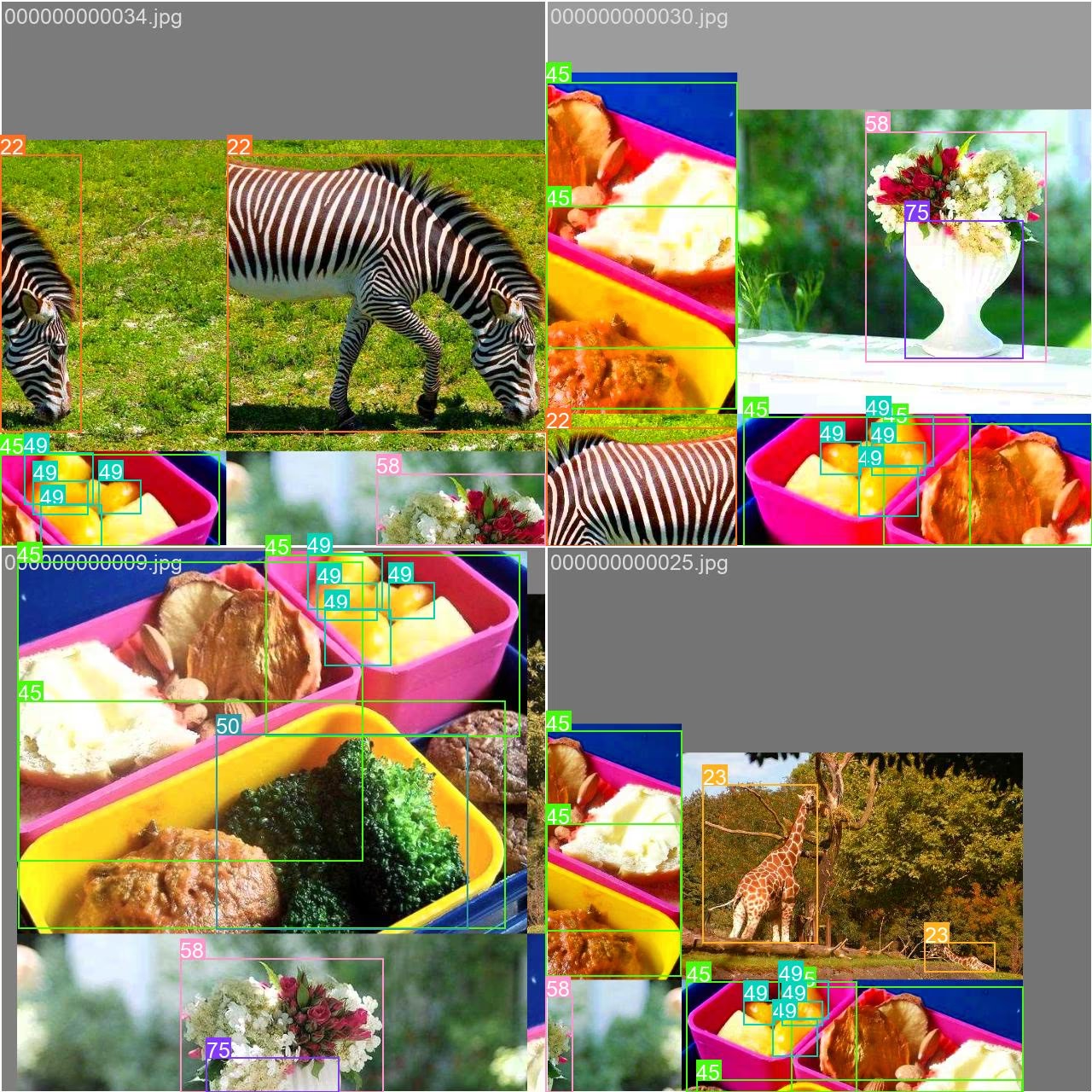

Nachfolgend ein Beispiel für einen mosaikierten Trainings-Batch aus dem COCO8-Datensatz:

- Mosaikbild: Dieses Bild veranschaulicht einen Trainings-Batch, bei dem mehrere Datensatzbilder mithilfe der Mosaic-Augmentierung kombiniert werden. Die Mosaic-Augmentierung erhöht die Vielfalt von Objekten und Szenen innerhalb jedes Batches und hilft dem Modell, sich besser an verschiedene Objektgrößen, Seitenverhältnisse und Hintergründe anzupassen.

Diese Technik ist besonders nützlich für kleine Datensätze wie COCO8, da sie den Wert jedes Bildes während des Trainings maximiert.

Zitate und Danksagungen

Wenn Sie den COCO-Datensatz in Ihrer Forschung oder Entwicklung verwenden, zitieren Sie bitte das folgende Paper:

@misc{lin2015microsoft,

title={Microsoft COCO: Common Objects in Context},

author={Tsung-Yi Lin and Michael Maire and Serge Belongie and Lubomir Bourdev and Ross Girshick and James Hays and Pietro Perona and Deva Ramanan and C. Lawrence Zitnick and Piotr Dollár},

year={2015},

eprint={1405.0312},

archivePrefix={arXiv},

primaryClass={cs.CV}

}

Besonderer Dank an das COCO Consortium für seine fortwährenden Beiträge zur Computer-Vision-Community.

FAQ

Wofür wird der Ultralytics COCO8-Datensatz verwendet?

Der Ultralytics COCO8-Datensatz ist für das schnelle Testen und Debuggen von Objekterkennungsmodellen konzipiert. Mit nur 8 Bildern (4 für Training, 4 für Validierung) ist er ideal, um Ihre YOLO-Trainingspipelines zu überprüfen und sicherzustellen, dass alles wie erwartet funktioniert, bevor auf größere Datensätze skaliert wird. Weitere Details finden Sie in der COCO8 YAML-Konfiguration.

Wie trainiere ich ein YOLO26-Modell mit dem COCO8-Datensatz?

Sie können ein YOLO26-Modell auf COCO8 entweder mit Python oder über die CLI trainieren:

Trainingsbeispiel

from ultralytics import YOLO

# Load a pretrained YOLO26n model

model = YOLO("yolo26n.pt")

# Train the model on COCO8

results = model.train(data="coco8.yaml", epochs=100, imgsz=640)

yolo detect train data=coco8.yaml model=yolo26n.pt epochs=100 imgsz=640

Weitere Trainingsoptionen finden Sie in der YOLO-Trainingsdokumentation.

Warum sollte ich die Ultralytics Platform für die Verwaltung meines COCO8-Trainings verwenden?

Die Ultralytics Platform optimiert das Dataset-Management, das Training und die Bereitstellung für YOLO-Modelle – einschließlich COCO8. Mit Funktionen wie Cloud-Training, Echtzeit-Monitoring und intuitiver Dataset-Verwaltung ermöglicht HUB Ihnen, Experimente mit einem einzigen Klick zu starten und manuelle Einrichtungsaufwände zu eliminieren. Erfahren Sie mehr über die Ultralytics Platform und wie sie Ihre Computer-Vision-Projekte beschleunigen kann.

Welche Vorteile bietet die Verwendung von Mosaic Augmentation beim Training mit dem COCO8-Datensatz?

Die Mosaic-Augmentierung, wie sie beim COCO8-Training verwendet wird, kombiniert während jedes Batches mehrere Bilder zu einem. Dies erhöht die Vielfalt von Objekten und Hintergründen und hilft Ihrem YOLO-Modell, besser auf neue Szenarien zu generalisieren. Die Mosaic-Augmentierung ist besonders wertvoll für kleine Datensätze, da sie die in jedem Trainingsschritt verfügbaren Informationen maximiert. Weitere Informationen hierzu finden Sie im Trainingsleitfaden.

Wie kann ich mein auf dem COCO8-Datensatz trainiertes YOLO26-Modell validieren?

Um Ihr YOLO26-Modell nach dem Training auf COCO8 zu validieren, verwenden Sie die Validierungsbefehle des Modells entweder in Python oder über die CLI. Dies bewertet die Leistung Ihres Modells anhand von Standardmetriken. Für Schritt-für-Schritt-Anleitungen besuchen Sie die YOLO Validierungsdokumentation.