Link to this sectionModelle#

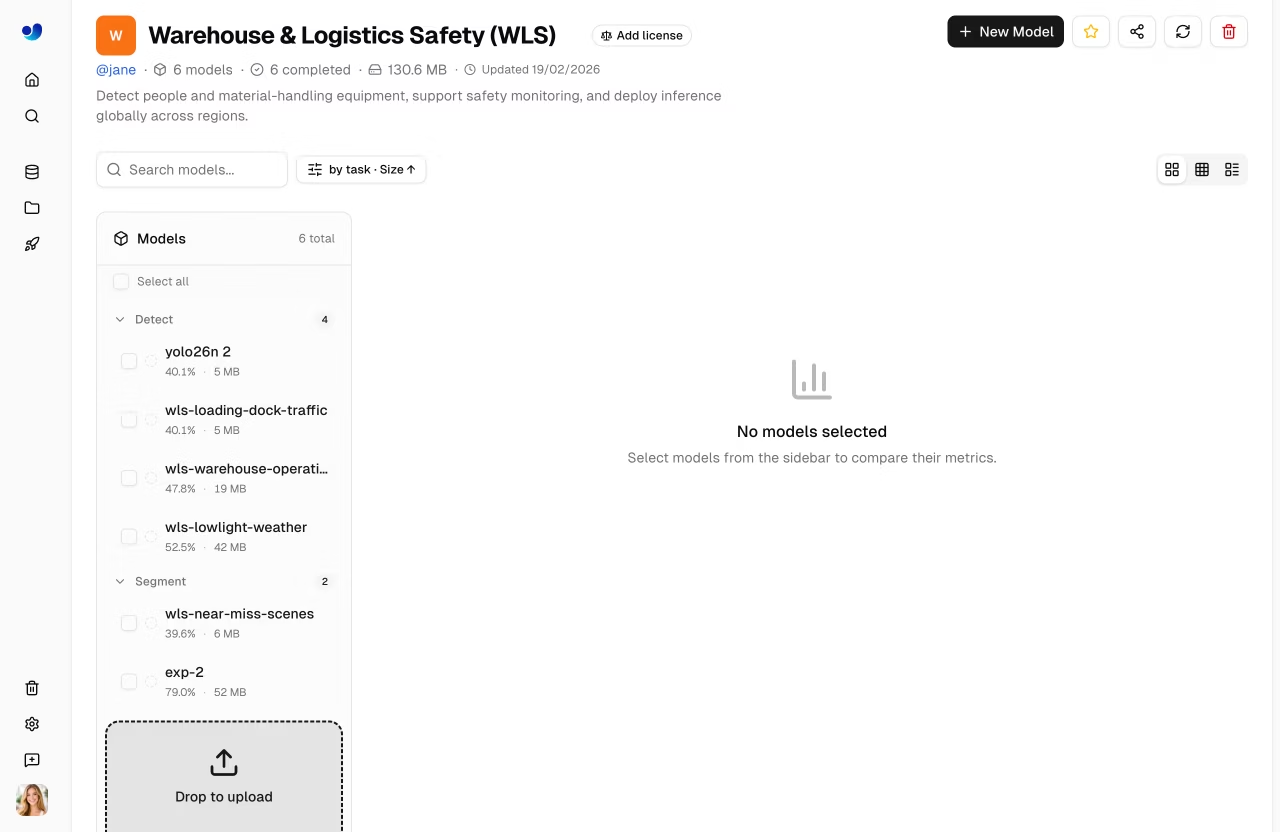

Die Ultralytics Platform bietet eine umfassende Modellverwaltung zum Trainieren, Analysieren und Bereitstellen von YOLO-Modellen. Lade vortrainierte Modelle hoch oder trainiere neue direkt auf der Plattform.

Link to this sectionModell hochladen#

Lade vorhandene Modellgewichte auf die Plattform hoch:

- Navigiere zu deinem Projekt

- Ziehe

.pt-Dateien per Drag-and-Drop auf die Projektseite oder in die Seitenleiste für Modelle - Die Modell-Metadaten werden automatisch aus der Datei ausgelesen

Mehrere Dateien können gleichzeitig hochgeladen werden (bis zu 3 gleichzeitig).

Unterstützte Modellformate:

| Format | Erweiterung | Beschreibung |

|---|---|---|

| PyTorch | .pt | Natives Ultralytics-Format |

Nach dem Hochladen analysiert die Plattform die Modell-Metadaten:

- Aufgabentyp (detect, segment, semantic, pose, OBB, classify)

- Architektur (YOLO26n, YOLO26s, etc.)

- Klassennamen und -anzahl

- Eingabegröße und Parameter

- Trainingsergebnisse und Metriken (falls im Checkpoint vorhanden)

Link to this sectionModell trainieren#

Trainiere ein neues Modell direkt auf der Plattform:

- Navigiere zu deinem Projekt

- Klicke auf Neues Modell

- Wähle das Basismodell und den Datensatz aus

- Konfiguriere die Trainingsparameter

- Wähle zwischen Cloud- oder lokalem Training

- Starte das Training

Siehe Cloud Training für detaillierte Anweisungen.

Link to this sectionModelllebenszyklus#

graph LR

A[Upload .pt] --> B[Overview]

C[Train] --> B

B --> D[Predict]

B --> E[Export]

B --> F[Deploy]

E --> G[19+ Formats]

F --> H[Endpoint]

style A fill:#4CAF50,color:#fff

style C fill:#FF9800,color:#fff

style E fill:#2196F3,color:#fff

style F fill:#9C27B0,color:#fffLink to this sectionModellseiten-Tabs#

Jede Modellseite hat die folgenden Tabs:

| Tab | Inhalt |

|---|---|

| Übersicht | Modell-Metadaten, Schlüsselmetriken, Datensatz-Link |

| Trainieren | Trainingsdiagramme, Konsolenausgabe, Systemstatistiken |

| Predict | Interaktive Browser-Inferenz |

| Exportieren | Formatkonvertierung mit GPU-Auswahl |

| Bereitstellen | Erstellung und Verwaltung von Endpunkten |

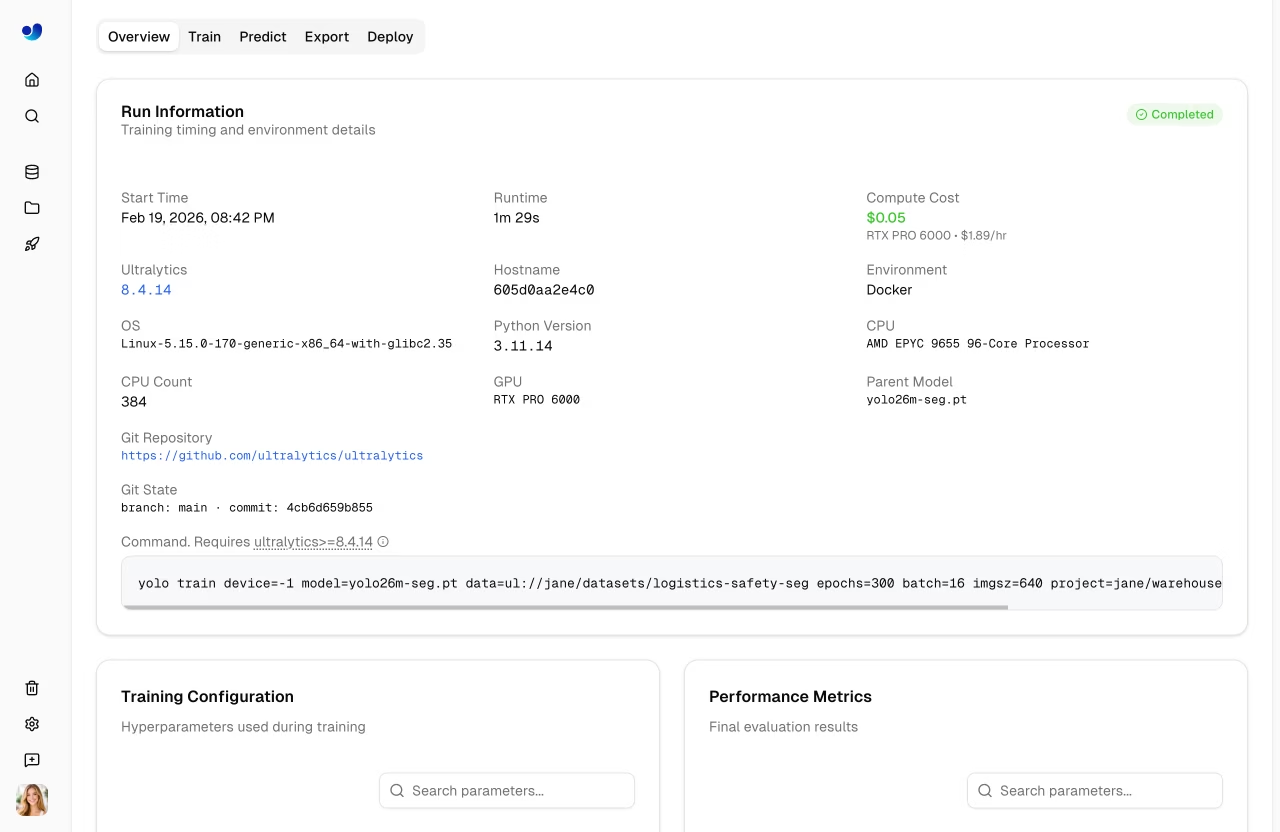

Link to this sectionÜbersicht-Tab#

Zeigt Modell-Metadaten und Schlüsselmetriken an:

- Modellname (bearbeitbar), Status-Badge, Aufgabentyp

- Endgültige Metriken (mAP50, mAP50-95, Präzision, Recall)

- Sparkline-Diagramme für Metriken, die den Trainingsfortschritt zeigen

- Trainingsargumente (Epochen, Batch-Größe, Bildgröße usw.)

- Datensatz-Link (bei Training mit einem Plattform-Datensatz)

- Download-Button für Modellgewichte

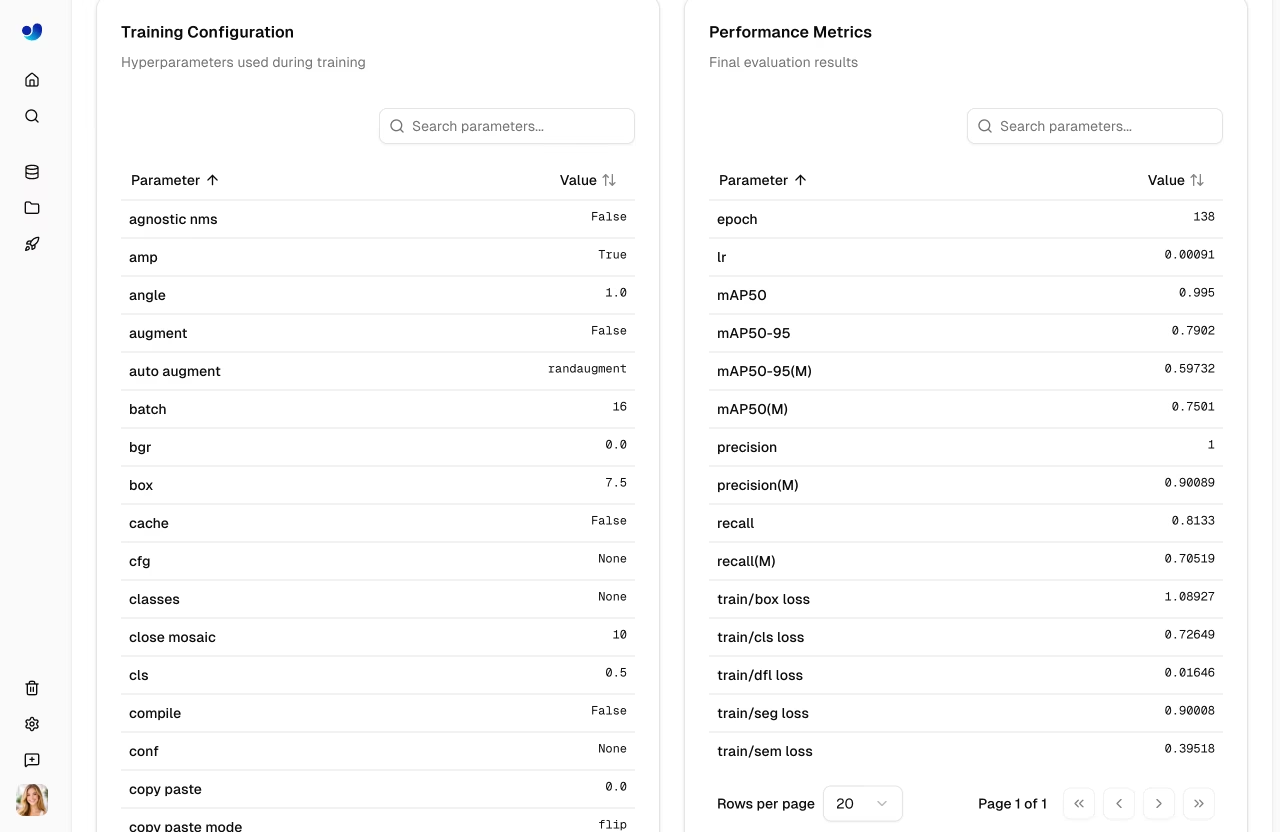

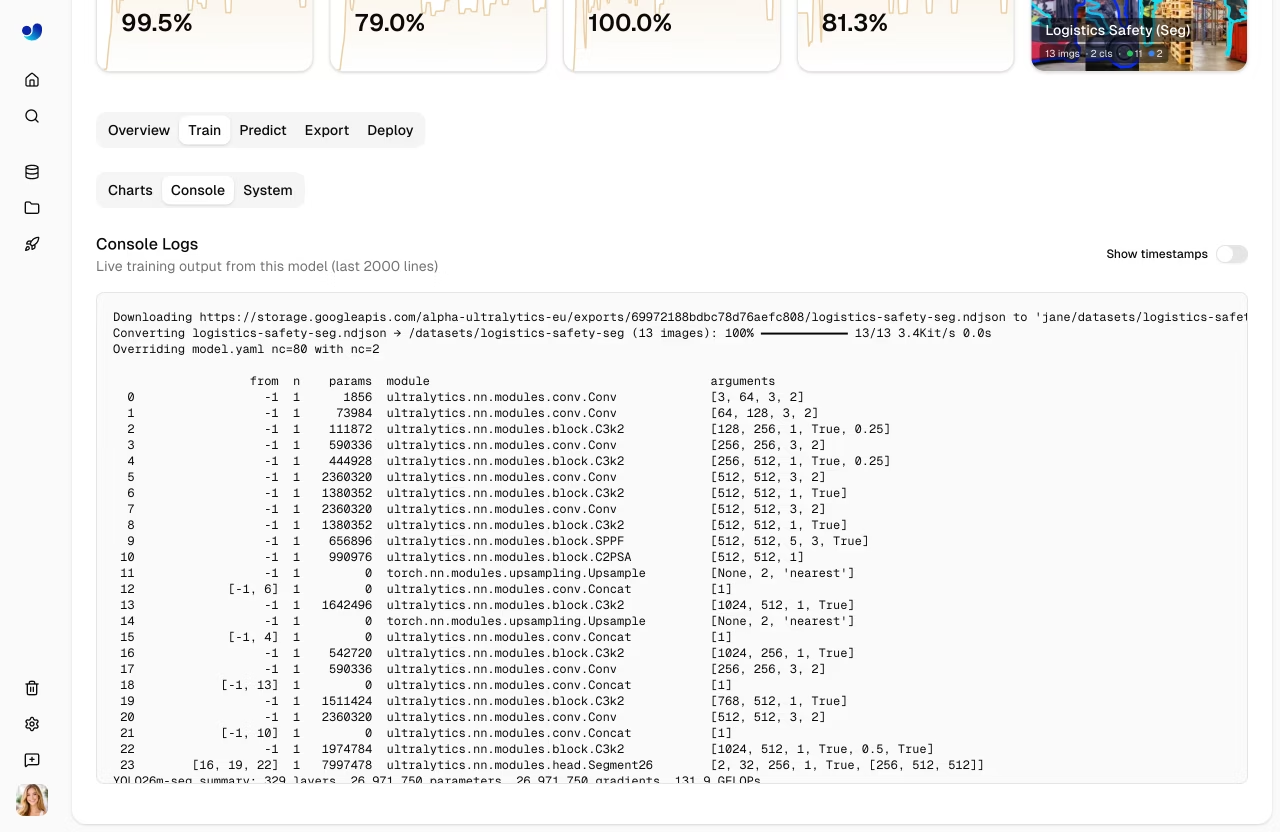

Link to this sectionTraining-Tab#

Der Training-Tab hat drei Unter-Tabs:

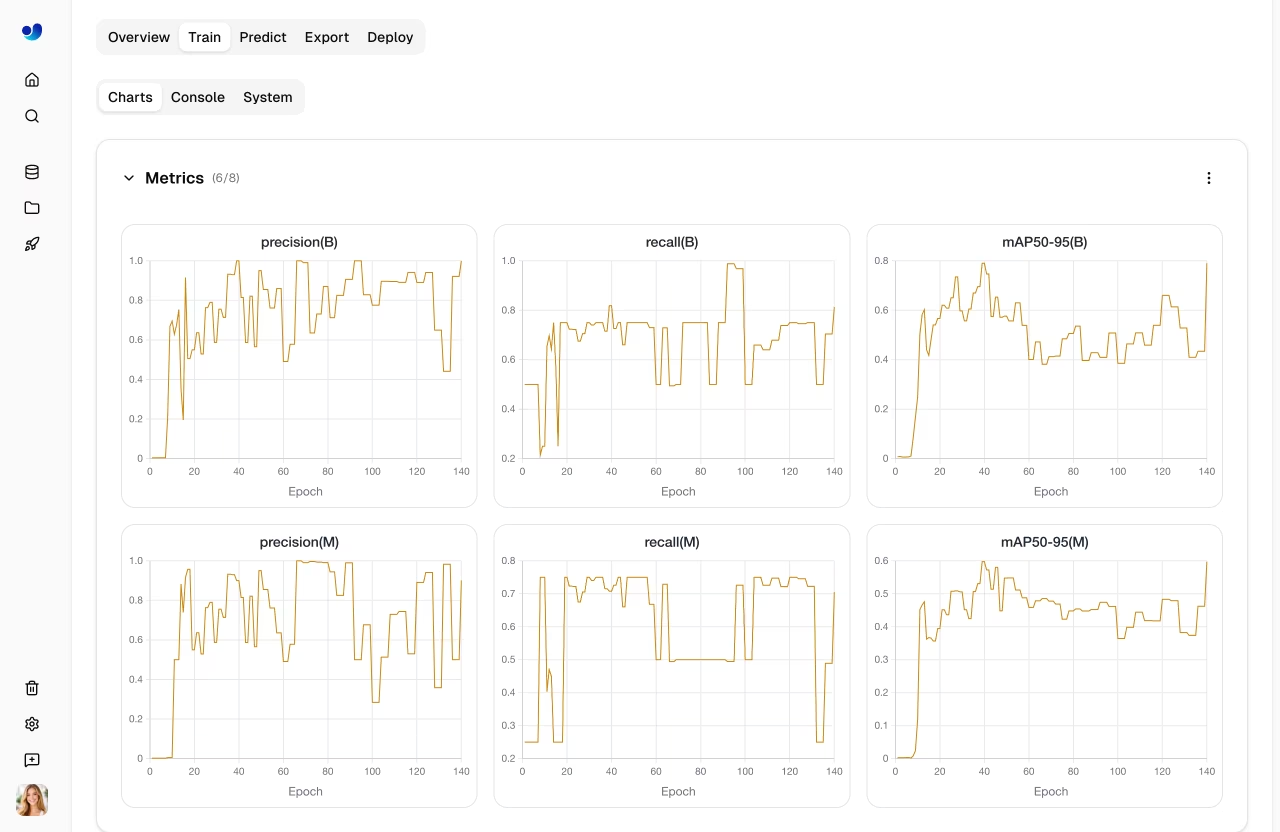

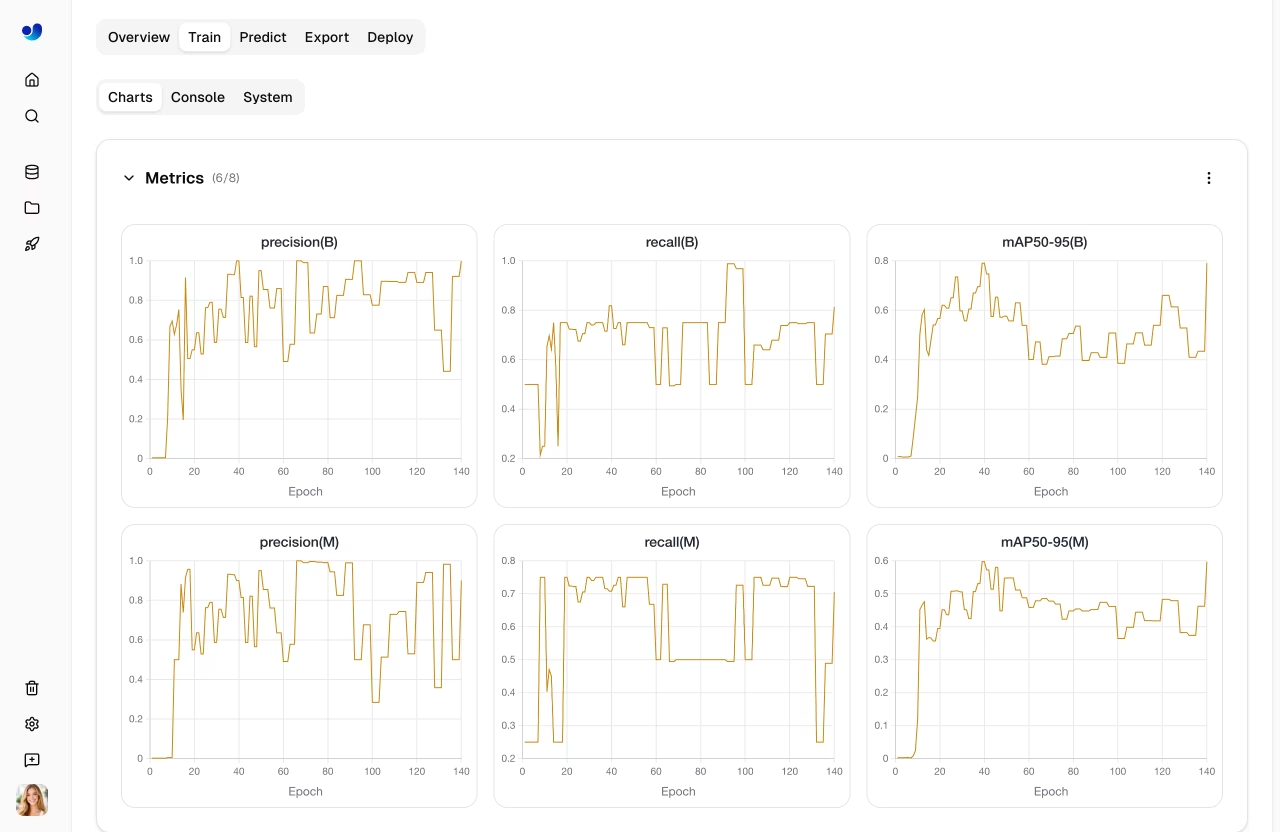

Link to this sectionCharts-Unter-Tab#

Interaktive Trainingsmetrik-Diagramme, die Verlustkurven und Leistungsmetriken über Epochen hinweg zeigen:

| Diagrammgruppe | Metriken |

|---|---|

| Metriken | mAP50, mAP50-95, Präzision, Recall |

| Trainingsverlust | train/box_loss, train/cls_loss, train/dfl_loss |

| Validierungsverlust | val/box_loss, val/cls_loss, val/dfl_loss |

| Lernrate | lr/pg0, lr/pg1, lr/pg2 |

Link to this sectionKonsole-Unter-Tab#

Live-Konsolenausgabe des Trainingsprozesses:

- Echtzeit-Log-Streaming während des Trainings

- Epochen-Fortschrittsbalken und Validierungsergebnisse

- Fehlererkennung mit hervorgehobenen Fehlerbannern

- ANSI-Farbunterstützung für formatierte Ausgaben

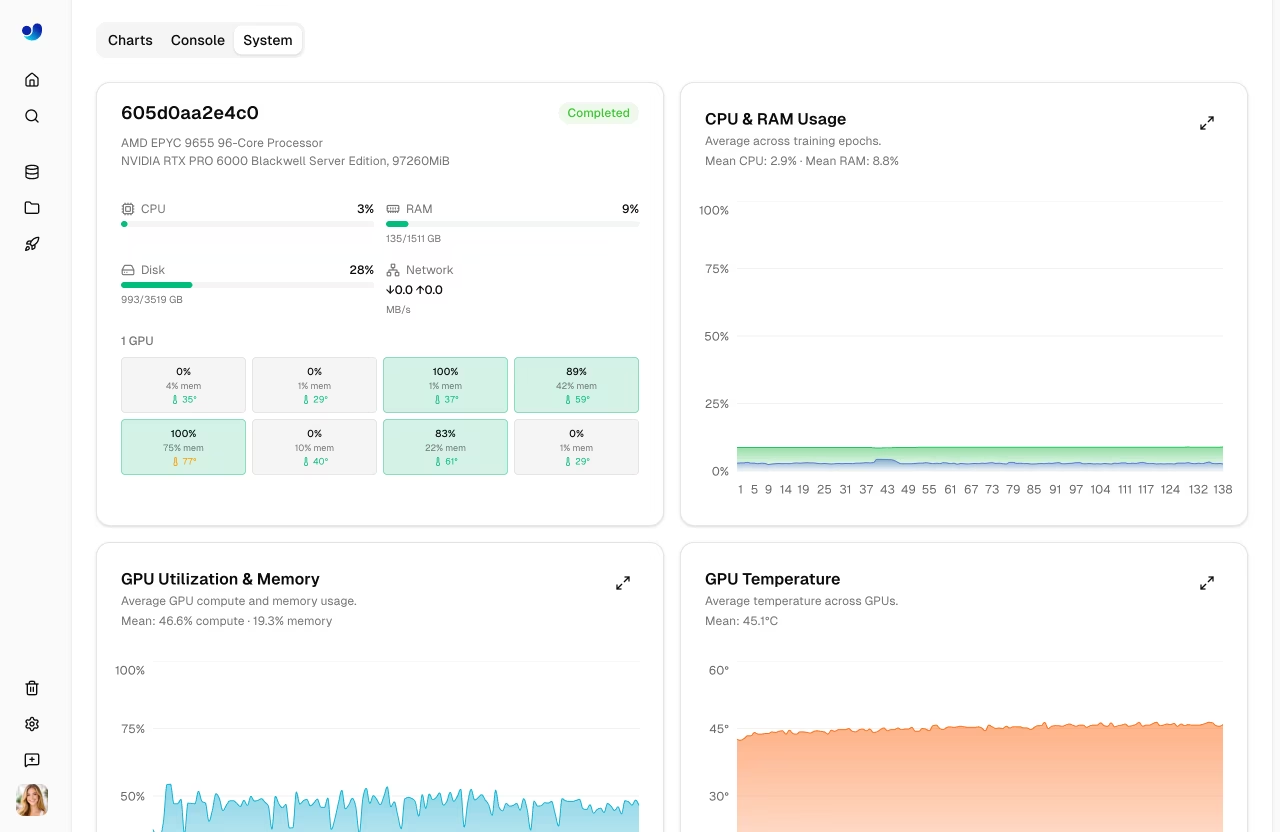

Link to this sectionSystem-Unter-Tab#

GPU- und Systemmetriken während des Trainings:

| Metrik | Beschreibung |

|---|---|

| GPU-Auslastung | GPU-Auslastung in Prozent |

| GPU-Speicher | GPU-Speichernutzung |

| GPU-Temperatur | GPU-Temperatur |

| CPU-Auslastung | CPU-Auslastung |

| RAM | System-Speichernutzung |

| Festplatte | Festplattennutzung |

Link to this sectionVorhersage-Tab#

Führe interaktive Inferenz direkt im Browser aus:

- Lade ein Bild hoch, verwende Beispielbilder oder nutze die Webcam

- Ergebnisse werden mit Bounding Boxes, Masken, semantischen Klassenkarten oder Keypoints angezeigt

- Auto-Inferenz, sobald ein Bild bereitgestellt wird

- Unterstützt alle Aufgabentypen (detect, segment, semantic, pose, OBB, classify)

Der Vorhersage-Tab führt die Inferenz auf der Ultralytics Cloud aus, sodass du keine lokale GPU benötigst. Die Ergebnisse werden mit interaktiven Overlays angezeigt, die dem Aufgabentyp des Modells entsprechen.

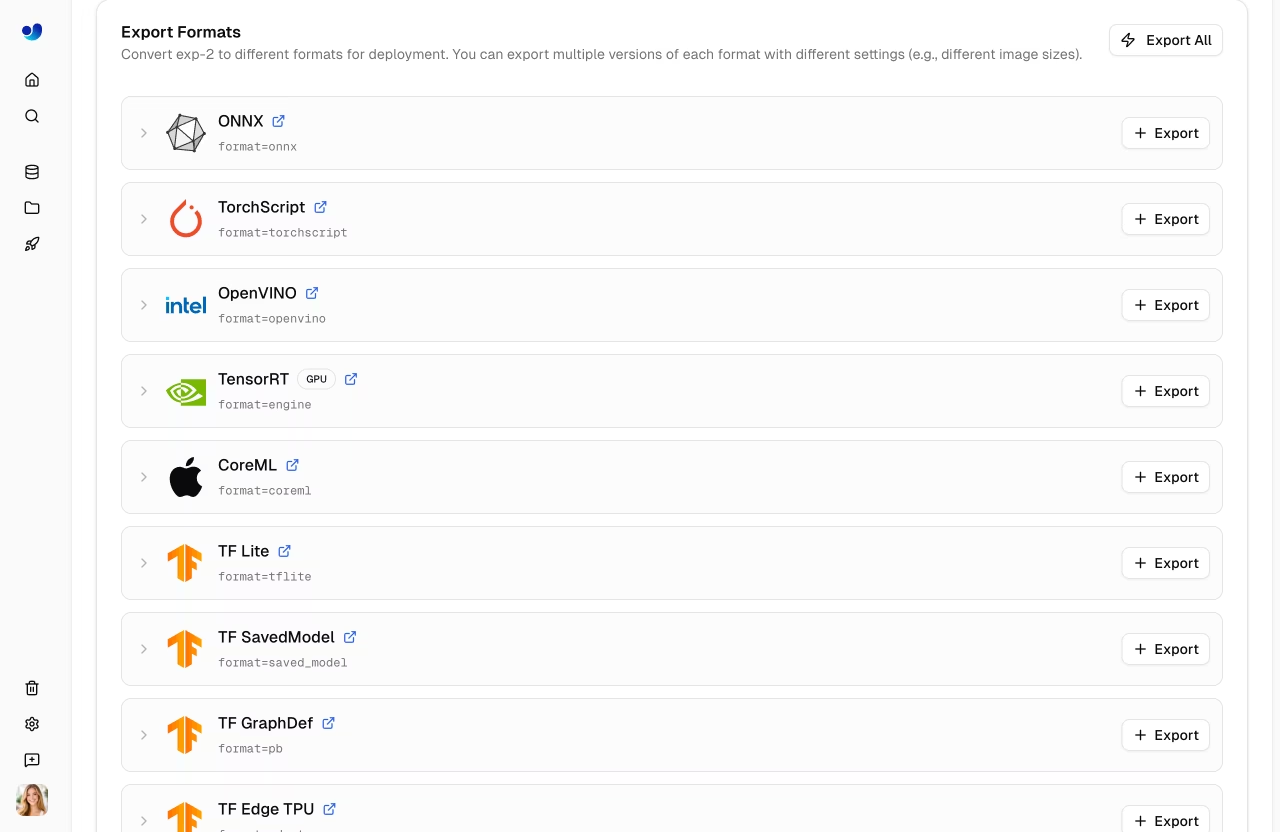

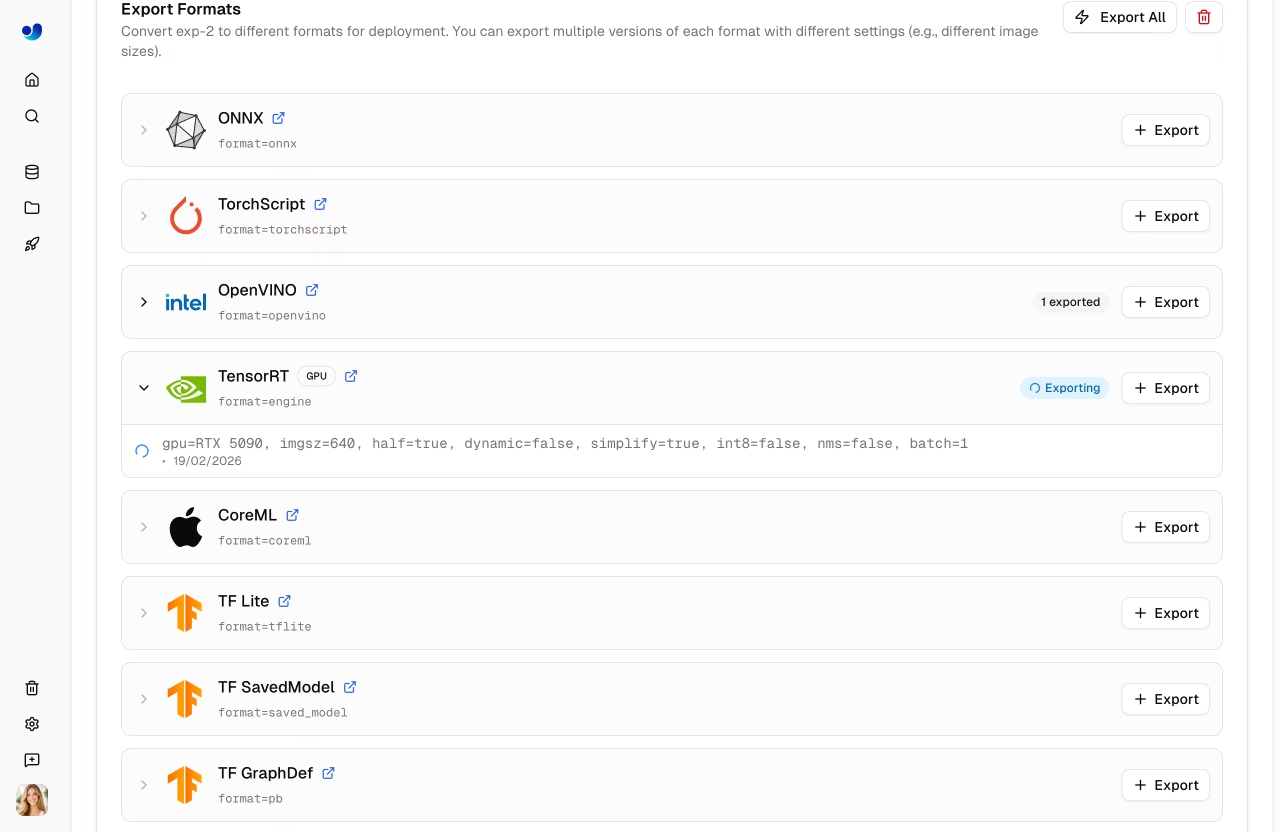

Link to this sectionExport-Tab#

Exportiere dein Modell in 19+ Bereitstellungsformate. Siehe Modell exportieren unten und die zentrale Exportmodus-Anleitung für vollständige Details.

Link to this sectionBereitstellen-Tab#

Erstelle und verwalte dedizierte Inferenz-Endpunkte. Siehe Bereitstellungen für Details.

Link to this sectionValidierungs-Plots#

Nach Abschluss des Trainings kannst du eine detaillierte Validierungsanalyse einsehen:

Link to this sectionKonfusionsmatrix#

Interaktive Heatmap, die die Vorhersagegenauigkeit pro Klasse zeigt:

Link to this sectionPR/F1-Kurven#

Leistungskurven bei verschiedenen Konfidenzschwellenwerten:

| Kurve | Beschreibung |

|---|---|

| Präzision-Recall | Abwägung zwischen Präzision und Recall |

| F1-Konfidenz | F1-Score bei verschiedenen Konfidenzlevels |

| Präzision-Konfidenz | Präzision bei verschiedenen Konfidenzlevels |

| Recall-Konfidenz | Recall bei verschiedenen Konfidenzlevels |

Link to this sectionModell exportieren#

graph LR

A[Select Format] --> B[Configure Args]

B --> C[Export]

C --> D{GPU Required?}

D -->|Yes| E[Cloud GPU Export]

D -->|No| F[CPU Export]

E --> G[Download]

F --> G

style A fill:#2196F3,color:#fff

style C fill:#FF9800,color:#fff

style G fill:#4CAF50,color:#fffExportiere dein Modell in 19+ Deployment-Formate:

- Navigiere zum Tab Export

- Wähle das Zielformat aus

- Konfiguriere Export-Argumente (Bildgröße, halbe Präzision, dynamisch, etc.)

- Wähle bei Formaten, die eine GPU erfordern (TensorRT), einen GPU-Typ aus

- Klicke auf Export

- Lade es nach Abschluss herunter

Link to this sectionUnterstützte Formate#

Die Plattform unterstützt den Export in 19+ Deployment-Formate: ONNX, TorchScript, OpenVINO, TensorRT, CoreML, TF SavedModel, TF GraphDef, TF Lite, TF Edge TPU, TF.js, PaddlePaddle, NCNN, MNN, RKNN, Qualcomm (QNN), IMX500, Axelera, ExecuTorch und DeepX.

Link to this sectionLeitfaden zur Formatauswahl#

| Ziel | Empfohlenes Format | Hinweise |

|---|---|---|

| NVIDIA GPUs | TensorRT | Maximale Inferenzgeschwindigkeit |

| Intel Hardware | OpenVINO | CPUs, GPUs und VPUs |

| Apple Geräte | CoreML | iOS, macOS, Apple Silicon |

| Android | TF Lite oder NCNN | Beste mobile Leistung |

| Webbrowser | TF.js oder ONNX | ONNX über ONNX Runtime Web |

| Edge-Geräte | TF Edge TPU oder RKNN | Coral und Rockchip (siehe unterstützte Chips) |

| Allgemein | ONNX | Funktioniert mit den meisten Runtimes |

Link to this sectionRKNN Chip-Unterstützung#

Wähle beim Export in das RKNN-Format dein Rockchip-Zielgerät aus:

| Chip | Beschreibung |

|---|---|

| RK3588 | High-End Edge-SoC |

| RK3576 | Mittelklasse Edge-SoC |

| RK3568 | Mittelklasse Edge-SoC |

| RK3566 | Mittelklasse Edge-SoC |

| RK3562 | Einstiegs-Edge-SoC |

| RV1103 | Bildverarbeitungsprozessor |

| RV1106 | Bildverarbeitungsprozessor |

| RV1103B | Bildverarbeitungsprozessor |

| RV1106B | Bildverarbeitungsprozessor |

| RK2118 | KI-Prozessor |

| RV1126B | Bildverarbeitungsprozessor |

Link to this sectionLebenszyklus von Export-Jobs#

Export-Jobs durchlaufen folgende Status:

| Status | Beschreibung |

|---|---|

| In Warteschlange | Export-Job wartet auf den Start |

| Startet | Export-Job initialisiert |

| Läuft | Export wird ausgeführt |

| Abgeschlossen | Export beendet — Download verfügbar |

| Fehlgeschlagen | Export fehlgeschlagen (siehe Fehlermeldung) |

| Abgebrochen | Export wurde vom Benutzer abgebrochen |

Die Exportdauer variiert je nach Format. TensorRT-Exporte können aufgrund der Engine-Optimierung einige Minuten dauern. Formate, die eine GPU erfordern (TensorRT), laufen auf Ultralytics Cloud-GPUs – die Standard-Export-GPU ist die RTX 4090.

Link to this sectionMassen-Exportaktionen#

- Alle exportieren: Klicke auf

Export All, um Export-Jobs für alle CPU-basierten Formate mit Standardeinstellungen zu starten. - Alle Exporte löschen: Klicke auf

Delete All, um alle Exporte für das Modell zu entfernen.

Link to this sectionFormatbeschränkungen#

Einige Exportformate haben Architektur- oder Aufgabenbeschränkungen:

| Format | Beschränkung |

|---|---|

| IMX500 | Nur verfügbar für YOLOv8n und YOLO11n |

| Axelera | Nur Detektionsmodelle |

- Klassifizierungsexporte enthalten kein NMS.

- CoreML-Exporte mit Batchgrößen größer als

1verwendendynamic=true. - Nicht unterstützte Format-/Modellkombinationen sind im Exportdialog deaktiviert, bevor du startest.

Link to this sectionModell klonen#

Klone ein Modell in ein anderes Projekt:

- Öffne die Modellseite

- Klicke auf den Clone-Button

- Wähle das Zielprojekt aus

- Klicke auf Clone

Das Modell und seine Gewichte werden in das Zielprojekt kopiert.

Link to this sectionModell herunterladen#

Lade deine Modellgewichte herunter:

- Navigiere zum Overview-Tab des Modells

- Klicke auf den Download-Button

- Die ursprüngliche

.pt-Datei wird automatisch heruntergeladen

Exportierte Formate können nach Abschluss des Exports über den Export-Tab heruntergeladen werden.

Link to this sectionDatensatzverknüpfung#

Modelle können mit ihrem Quelldatensatz verknüpft werden:

- Sieh dir an, welcher Datensatz für das Training verwendet wurde

- Klicke auf die Datensatzkarte im Overview-Tab, um dorthin zu navigieren

- Datenherkunft verfolgen

Wenn du mit Platform-Datensätzen unter Verwendung des ul:// URI-Formats trainierst, erfolgt die Verknüpfung automatisch.

# Train with a Platform dataset — linking is automatic

yolo train model=yolo26n.pt data=ul://username/datasets/my-dataset epochs=100Das ul://-Schema löst sich zu deinem Platform-Datensatz auf. Der Reiter „Overview“ (Übersicht) des trainierten Modells zeigt einen Link zurück zu diesem Datensatz (siehe Using Platform Datasets).

Link to this sectionSichtbarkeitseinstellungen#

Steuere, wer dein Modell sehen kann:

| Einstellung | Beschreibung |

|---|---|

| Privat | Nur du hast Zugriff |

| Öffentlich | Jeder kann es auf der Explore-Seite ansehen |

Um die Sichtbarkeit zu ändern, klicke auf das Sichtbarkeits-Badge (z. B. private oder public) im Seiten-Header. Die Sichtbarkeit wird auf Projektebene festgelegt, steuert also alle Modelle im Projekt. Die Umstellung auf „privat“ wird sofort wirksam. Die Umstellung auf „öffentlich“ zeigt vor der Anwendung einen Bestätigungsdialog an.

Link to this sectionModell löschen#

Entferne ein Modell, das du nicht mehr benötigst:

- Öffne das Aktionsmenü des Modells

- Klicke auf Delete

- Bestätige das Löschen

Gelöschte Modelle landen für 30 Tage im Papierkorb. Stelle sie unter Settings > Trash wieder her.

Link to this sectionSiehe auch#

- Inference: Teste Modelle im Browser mit dem Predict-Reiter

- Endpoints: Stelle Modelle mit dedizierten Endpunkten produktiv bereit

- Cloud Training: Konfiguriere und führe Trainings-Jobs auf Cloud-GPUs aus

- Export Formats: Vollständiger Leitfaden zu allen 19+ Exportformaten

Link to this sectionFAQ#

Link to this sectionWelche Modellarchitekturen werden unterstützt?#

Die Ultralytics Platform unterstützt vollständig alle YOLO-Architekturen mit dedizierten Projekten:

- YOLO26: n-, s-, m-, l-, x-Varianten (neueste, empfohlen) — platform.ultralytics.com/ultralytics/yolo26

- YOLO11: n-, s-, m-, l-, x-Varianten — platform.ultralytics.com/ultralytics/yolo11

- YOLOv8: n-, s-, m-, l-, x-Varianten — platform.ultralytics.com/ultralytics/yolov8

- YOLOv5: n-, s-, m-, l-, x-Varianten — platform.ultralytics.com/ultralytics/yolov5

YOLO26 unterstützt 6 Aufgabentypen: detect, segment, semantic, pose, OBB und classify. YOLO11 und YOLOv8 unterstützen dieselbe Auswahl mit Ausnahme der semantischen Segmentierung, während YOLOv5 detect, segment und classify unterstützt.

Link to this sectionKann ich mein trainiertes Modell herunterladen?#

Ja, lade deine Modellgewichte von der Modellseite herunter:

- Klicke auf das Download-Symbol auf dem Reiter „Overview“

- Die ursprüngliche

.pt-Datei wird automatisch heruntergeladen - Exportierte Formate können vom Reiter „Export“ heruntergeladen werden

Link to this sectionWie vergleiche ich Modelle projektübergreifend?#

Aktuell ist der Modellvergleich auf Projekte beschränkt. Um projektübergreifend zu vergleichen:

- Klone Modelle in ein einzelnes Projekt oder

- Exportiere Metriken und vergleiche sie extern

Link to this sectionWas ist die maximale Modellgröße?#

Hochgeladene .pt-Modelldateien sind auf 1 GB begrenzt, und Modelle nahe diesem Limit können länger zum Hochladen und Verarbeiten benötigen.

Link to this sectionKann ich vortrainierte Modelle feinabstimmen?#

Ja! Du kannst jedes der offiziellen YOLO26-Modelle als Basis verwenden oder eines deiner eigenen abgeschlossenen Modelle aus der Modellauswahl im Trainingsdialog auswählen. Die Platform unterstützt die Feinabstimmung von jedem hochgeladenen Checkpoint aus.