Ultralytics Platform

Ultralytics Platform è una piattaforma di visione artificiale end-to-end completa che ottimizza l'intero flusso di lavoro ML, dalla preparazione dei dati alla distribuzione del modello. Progettata per team e individui che necessitano di soluzioni di visione artificiale pronte per la produzione senza la complessità dell'infrastruttura.

Cos'è la piattaforma Ultralytics?

Ultralytics Platform è progettata per sostituire gli strumenti ML frammentati con una soluzione unificata. Combina le capacità di:

- Roboflow - Gestione e annotazione dei dati

- Weights & Biases - track degli esperimenti

- SageMaker - Addestramento su cloud

- HuggingFace - Deployment di modelli

- Arize - Monitoraggio

Tutto in un'unica piattaforma con supporto nativo per i modelli YOLO26 e YOLO11.

Flusso di lavoro: Caricamento → Annotazione → Training → Esportazione → Deployment

La Piattaforma offre un flusso di lavoro end-to-end:

graph LR

subgraph Data["📁 Data"]

A[Upload] --> B[Annotate]

B --> C[Analyze]

end

subgraph Train["🚀 Train"]

D[Configure] --> E[Train on GPU]

E --> F[View Metrics]

end

subgraph Deploy["🌐 Deploy"]

G[Export] --> H[Deploy Endpoint]

H --> I[Monitor]

end

Data --> Train --> Deploy| Fase | Funzionalità |

|---|---|

| Caricamento | Immagini (50 MB), video (1 GB) e file di set di dati (ZIP, TAR, inclusi .tar.gz/.tgz, NDJSON) con elaborazione automatica |

| Annota | Strumenti manuali, annotazione intelligente SAM, auto-etichettatura YOLO per tutti e 5 i tipi di task (vedi task supportati) |

| Addestramento | GPU cloud (20 gratuite + 3 esclusive per Pro), metriche in tempo reale, organizzazione dei progetti |

| Esportazione | 17 formati di deployment (ONNX, TensorRT, CoreML, TFLite, ecc.; vedi formati supportati) |

| Distribuisci | 43 regioni globali con endpoint dedicati, auto-scaling, monitoraggio |

Cosa puoi fare:

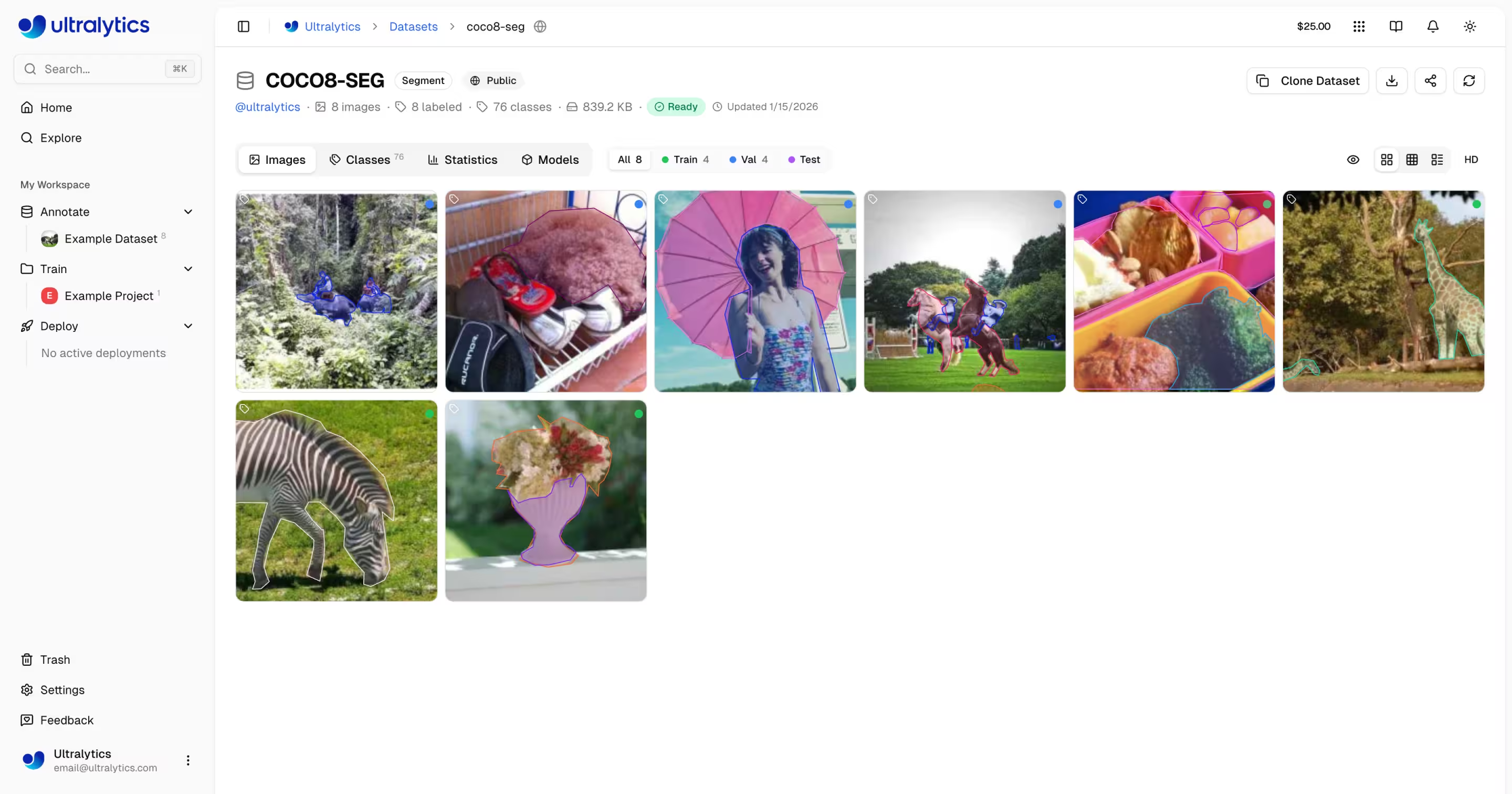

- Carica immagini, video e file di dataset per creare dataset di addestramento

- Visualizza le annotazioni con overlay interattivi per tutti i 5 tipi di task YOLO (vedi task supportati)

- Addestra modelli su GPU cloud (20 gratuite, 23 con Pro) con metriche in tempo reale

- Esporta in 17 formati di deploy (ONNX, TensorRT, CoreML, TFLite, ecc.)

- Esegui il deployment in 43 regioni globali con endpoint dedicati attivabili con un clic

- Monitora l'avanzamento del training, lo stato del deployment e le metriche di utilizzo

- Collabora rendendo pubblici progetti e dataset per la community

Infrastruttura Multi-Regione

I tuoi dati rimangono nella tua regione. La Piattaforma Ultralytics gestisce l'infrastruttura in tre regioni globali:

| Regione | Etichetta | Località | Ideale per |

|---|---|---|---|

| USA | Americhe | Iowa, USA | Utenti delle Americhe, più veloce per le Americhe |

| UE | Europa, Medio Oriente e Africa | Belgio, Europa | Utenti europei, conformità GDPR |

| AP | Asia Pacifico | Hong Kong, Asia-Pacifico | Utenti dell'Asia-Pacifico, latenza APAC più bassa |

Selezioni la tua regione durante l'onboarding, e tutti i tuoi dati, modelli e deployment rimangono in quella regione.

La regione è permanente

La regione dei dati non può essere modificata dopo la creazione dell'account. Durante l'onboarding, la piattaforma misura la latenza verso ogni regione e ne raccomanda quella più vicina. Scegli con attenzione.

Caratteristiche principali

Preparazione dei Dati

- Gestione dei set di dati: carica immagini, video o file di set di dati con elaborazione automatica

- Editor di annotazioni: Annotazione manuale per tutti i 5 tipi di task YOLO (detect, segment, pose, obb, classify; vedi task supportati)

- Modelli di Scheletro: Modelli di scheletro predefiniti (Persona, Mano, Volto, Cane, Scatola) e personalizzati per l'annotazione della posa con un clic.

- Annotazione Intelligente SAM: Annotazione intelligente basata su clic con 5 modelli — SAM 2.1 (Tiny, Small, Base, Large) e il nuovo SAM 3 per la massima precisione. Cambia i modelli per immagine dalla barra degli strumenti di annotazione.

- Auto-Annotazione: Usa modelli addestrati per pre-etichettare nuovi dati

- Versionamento dei Dataset: Crea snapshot NDJSON numerati con descrizioni per un addestramento riproducibile

- Statistiche: Distribuzione delle classi, heatmap di posizione e analisi delle dimensioni

graph LR

A[Upload Dataset/Images/Video] --> B[Auto-Process]

B --> C[Browse & Filter]

C --> D{Annotate}

D --> E[Manual Tools]

D --> F[SAM Smart]

D --> G[YOLO Auto-Label]

E --> H[Train-Ready Dataset]

F --> H

G --> HTipi di Attività Supportati

L'editor di annotazioni supporta tutti i 5 tipi di attività YOLO: detect (bounding box), segment (poligoni), pose (punti chiave), OBB (box orientati) e classify (etichette a livello di immagine). Ogni tipo di attività ha strumenti di disegno dedicati e scorciatoie da tastiera.

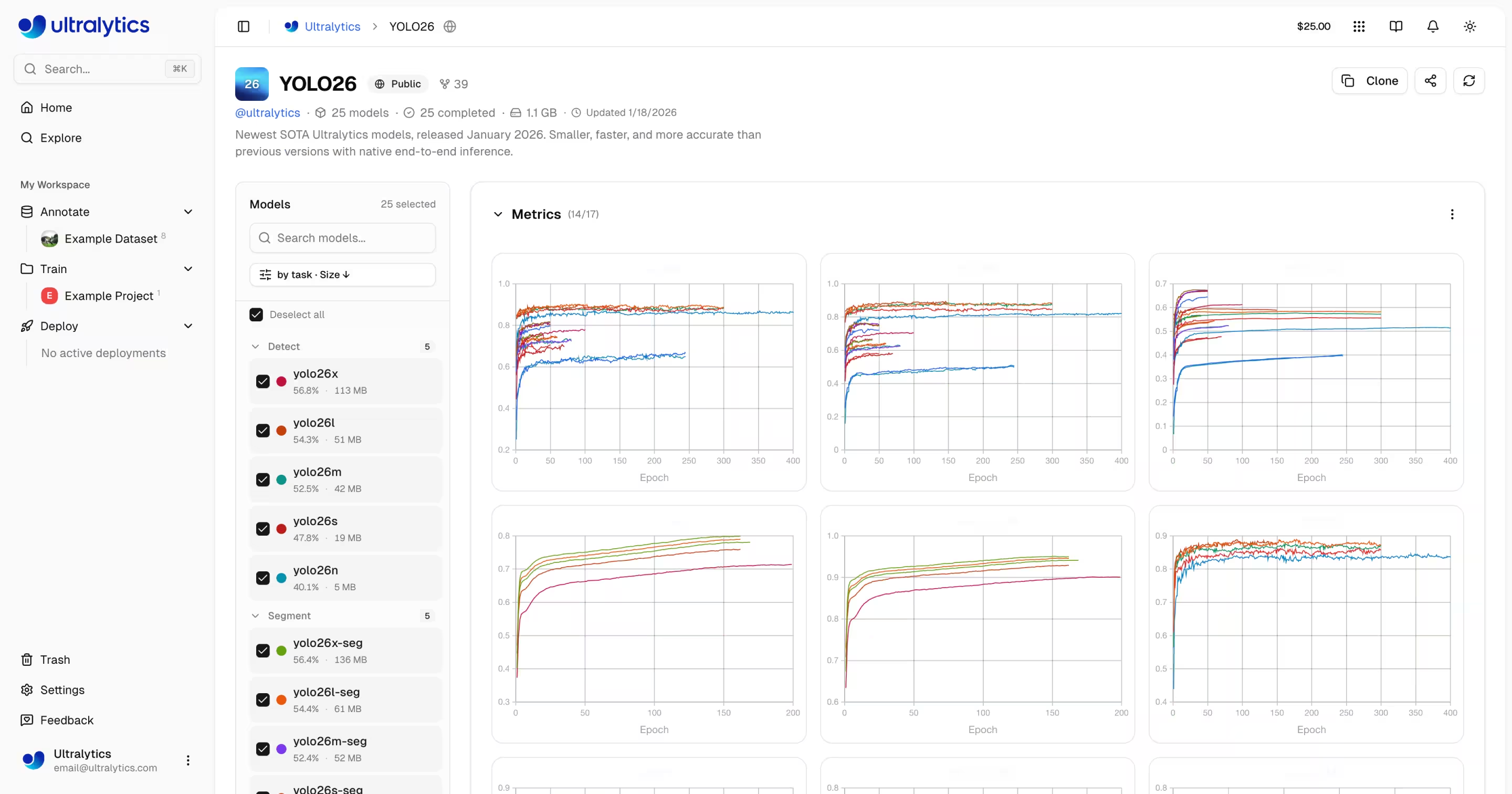

Addestramento del Modello

- Addestramento su Cloud: Addestra su GPU cloud (20 gratuite, 23 con Pro) con metriche in tempo reale

- Addestramento remoto: Addestra ovunque e trasmetti le metriche alla piattaforma (stile W&B)

- Organizzazione dei Progetti: Raggruppare modelli correlati, confrontare esperimenti, monitorare l'attività

- 17 Formati di Esportazione: ONNX, TensorRT, CoreML, TFLite e altro (vedi formati supportati)

È possibile addestrare i modelli tramite l'interfaccia utente web (addestramento in cloud) o dalla propria macchina (addestramento remoto):

- Naviga al tuo progetto

- Clicca

Train Model - Seleziona dataset, modello, GPU ed epoche

- Monitora le curve di perdita e le metriche in tempo reale

# Install ultralytics

pip install "ultralytics>=8.4.14"

# Set your API key

export ULTRALYTICS_API_KEY="YOUR_API_KEY"

# Train and stream metrics to the platform

yolo train model=yolo26n.pt data=coco.yaml epochs=100 project=username/my-project name=exp1

import os

from ultralytics import YOLO

os.environ["ULTRALYTICS_API_KEY"] = "YOUR_API_KEY"

model = YOLO("yolo26n.pt")

model.train(

data="coco.yaml",

epochs=100,

project="username/my-project",

name="exp1",

)

# Metrics stream to Platform automatically

Distribuzione

- Test di Inferenza: Testare i modelli direttamente nel browser con immagini personalizzate

- Endpoint Dedicati: Distribuire in 43 regioni globali con auto-scaling

- Monitoraggio: Metriche in tempo reale, log delle richieste e dashboard delle prestazioni

graph LR

A[Trained Model] --> B{Action}

B --> C[Browser Predict]

B --> D[Export Format]

B --> E[Deploy Endpoint]

D --> F[ONNX / TensorRT / CoreML / TFLite / ...]

E --> G[43 Global Regions]

G --> H[API Endpoint URL]

H --> I[Monitor & Scale]Una volta deployato, chiama il tuo endpoint da qualsiasi linguaggio:

import requests

url = "https://your-endpoint-url/predict"

headers = {"Authorization": "Bearer YOUR_API_KEY"}

with open("image.jpg", "rb") as f:

response = requests.post(url, headers=headers, files={"file": f})

print(response.json())

curl -X POST "https://your-endpoint-url/predict" \

-H "Authorization: Bearer YOUR_API_KEY" \

-F "file=@image.jpg"

const form = new FormData();

form.append("file", fileInput.files[0]);

const response = await fetch("https://your-endpoint-url/predict", {

method: "POST",

headers: { Authorization: "Bearer YOUR_API_KEY" },

body: form,

});

const results = await response.json();

console.log(results);

Gestione dell'Account

- Team e Organizzazioni: Collabora con i membri del team, gestisci ruoli e inviti

- Chiavi API: Gestione sicura delle chiavi per l'addestramento remoto e l'accesso API

- Crediti e Fatturazione: Addestramento pay-as-you-go con prezzi trasparenti

- Feed attività: Consente di trackare tutti gli eventi e le azioni dell'account

- Cestino e Ripristino: Eliminazione soft di 30 giorni con recupero degli elementi

- Conformità GDPR: Esportazione dei dati ed eliminazione dell'account

Livelli del Piano

| Funzionalità | Gratuito | Pro (29 $ al mese) | Enterprise |

|---|---|---|---|

| Credito di Iscrizione | $5 / $25* | - | Personalizzato |

| Credito Mensile | - | $30/posto/mese | Personalizzato |

| Modelli | 100 | 500 | Illimitato |

| Addestramenti concorrenti | 3 | 10 | Illimitato |

| Deployment | 3 | 10 | Illimitato |

| Archiviazione | 100 GB | 500 GB | Illimitato |

| Tipi di GPU Cloud | 20 | 23 (incl. H200/B200) | 23 |

| Team | - | Fino a 5 membri | Fino a 50 |

| Supporto | Community | Priorità | Dedicato |

*$5 all'iscrizione, o $25 con un'email aziendale/lavorativa verificata.

Link Rapidi

Inizia con queste risorse:

- Guida Rapida: Crea il tuo primo progetto e addestra un modello in pochi minuti

- Dataset: Carica e gestisci i tuoi dati di addestramento

- Annotazione: Etichetta i tuoi dati con strumenti manuali e assistiti dall'IA

- Progetti: Organizza i tuoi modelli e esperimenti

- Addestramento su Cloud: Addestra su GPU cloud

- Inferenza: Testa i tuoi modelli

- Endpoint: Distribuisci i modelli in produzione

- Monitoraggio: Monitora le prestazioni del deployment

- Chiavi API: Gestisci l'accesso API

- Fatturazione: Crediti e pagamenti

- Attività: Tracka gli eventi dell'account

- Cestino: Recupera gli elementi eliminati

- REST API: Riferimento API

FAQ

Come iniziare con la piattaforma Ultralytics?

Per iniziare con Ultralytics Platform:

- Registrati: Crea un account su platform.ultralytics.com

- Seleziona Regione: Scegli la tua regione dati (USA, UE o AP) durante l'onboarding

- Carica Dataset: Vai alla sezione Dataset per caricare i tuoi dati

- Addestra Modello: Crea un progetto e inizia l'addestramento su GPU cloud

- Deploy: Testa il tuo modello e distribuiscilo su un endpoint dedicato

Per una guida dettagliata, consulta la pagina Quickstart.

Quali sono i vantaggi della piattaforma Ultralytics?

Ultralytics Platform offre:

- Flusso di Lavoro Unificato: Dati, addestramento e deployment in un unico ambiente

- Multi-Regione: Residenza dei dati nelle regioni US, EU o AP

- Addestramento No-Code: Addestra modelli YOLO avanzati senza scrivere codice

- Metriche in Tempo Reale: Trasmetti in streaming l'avanzamento dell'addestramento e monitora i deployment

- 43 Regioni di Deployment: Distribuisci i modelli vicino ai tuoi utenti in tutto il mondo

- 5 Tipi di Task: Supporto per detection, segmentation, stima della posa, OBB e classificazione (vedi documentazione dei task)

- Annotazione Assistita da AI: SAM e auto-etichettatura per accelerare la preparazione dei dati

Quali opzioni GPU sono disponibili per l'addestramento in cloud?

Ultralytics Platform supporta diversi tipi di GPU per l'addestramento in cloud:

| GPU | Generazione | VRAM | Costo/Ora | Ideale per |

|---|---|---|---|---|

| RTX 2000 Ada | Ada | 16 GB | $0.24 | Dataset piccoli, test |

| RTX A4500 | Ampere | 20 GB | $0.25 | Dataset di piccole-medie dimensioni |

| RTX 4000 Ada | Ada | 20 GB | $0.26 | Dataset medi |

| RTX A5000 | Ampere | 24 GB | $0.27 | Dataset medi |

| L4 | Ada | 24 GB | $0.39 | Ottimizzato per l'inferenza |

| A40 | Ampere | 48 GB | $0.40 | Dimensioni dei batch più grandi |

| RTX 3090 | Ampere | 24 GB | $0.46 | Addestramento generale |

| RTX A6000 | Ampere | 48 GB | $0.49 | Modelli di grandi dimensioni |

| RTX PRO 4500 | Blackwell | 32 GB | $0.54 | Ottimo rapporto prezzo/prestazioni |

| RTX 4090 | Ada | 24 GB | $0.59 | Miglior rapporto prezzo/prestazioni |

| RTX 6000 Ada | Ada | 48 GB | $0.77 | Addestramento con batch di grandi dimensioni |

| L40S | Ada | 48 GB | $0.86 | Addestramento con batch di grandi dimensioni |

| RTX 5090 | Blackwell | 32 GB | $0.89 | Ultima generazione consumer |

| L40 | Ada | 48 GB | $0.99 | Modelli di grandi dimensioni |

| A100 PCIe | Ampere | 80 GB | $1.39 | Addestramento per la produzione |

| A100 SXM | Ampere | 80 GB | $1.49 | Addestramento per la produzione |

| RTX PRO 6000 | Blackwell | 96 GB | $1.69 | Predefinito consigliato |

| H100 PCIe | Hopper | 80 GB | $2.39 | Addestramento ad alte prestazioni |

| H100 SXM | Hopper | 80 GB | $2.69 | Addestramento più veloce |

| H100 NVL | Hopper | 94 GB | $3.07 | Massime prestazioni |

| H200 NVL | Hopper | 143 GB | $3.39 | Memoria massima (Pro+) |

| H200 SXM | Hopper | 141 GB | $3.59 | Prestazioni massime (Pro+) |

| B200 | Blackwell | 180 GB | $4.99 | Modelli più grandi (Pro+) |

Vedi Cloud Training per i prezzi completi e le opzioni GPU.

Come funziona l'addestramento remoto?

È possibile addestrare i modelli sul proprio hardware e trasmettere metriche in tempo reale alla piattaforma, in modo simile a Weights & Biases.

Requisiti di versione del pacchetto

L'integrazione della piattaforma richiede ultralytics>=8.4.14. Le versioni precedenti NON funzioneranno con la Piattaforma.

pip install "ultralytics>=8.4.14"

# Set your API key

export ULTRALYTICS_API_KEY="YOUR_API_KEY"

# Train with project/name to stream metrics

yolo train model=yolo26n.pt data=coco.yaml epochs=100 project=username/my-project name=exp1

import os

from ultralytics import YOLO

os.environ["ULTRALYTICS_API_KEY"] = "YOUR_API_KEY"

model = YOLO("yolo26n.pt")

model.train(

data="coco.yaml",

epochs=100,

project="username/my-project",

name="exp1",

)

# Train using a Platform dataset directly

export ULTRALYTICS_API_KEY="YOUR_API_KEY"

yolo train model=yolo26n.pt data=ul://username/datasets/my-dataset epochs=100 project=username/my-project name=exp1

Consulta Addestramento in Cloud per maggiori dettagli sull'addestramento remoto.

Quali strumenti di annotazione sono disponibili?

La Piattaforma include un editor di annotazioni completo che supporta:

- Strumenti manuali: Bounding box, poligoni, keypoint con template di scheletro, box orientati, classificazione

- Modelli di Scheletro: Posiziona tutti i keypoint contemporaneamente utilizzando modelli predefiniti (Persona, Mano, Volto, Cane, Scatola) o personalizzati.

- Annotazione Intelligente SAM: Clicca per generare maschere precise — scegli tra SAM 2.1 Tiny/Small/Base/Large o il nuovo SAM 3 tramite il selettore di modelli della barra degli strumenti

- Scorciatoie da Tastiera: Flussi di lavoro efficienti con tasti di scelta rapida

| Scorciatoia | Azione |

|---|---|

V | Seleziona la modalità |

S | Modalità di annotazione intelligente SAM |

A | Modalità di Annotazione Automatica |

1 - 9 | Selezionare la classe per numero. |

Delete | Elimina annotazione selezionata |

Ctrl+Z | Annulla |

Ctrl+Y | Ripeti |

Escape | Annulla azione corrente |

Consulta Annotazione per la guida completa.

Quali formati di esportazione sono supportati?

La Piattaforma supporta 17 formati di deployment:

| Formato | Estensione del File | Caso d'uso |

|---|---|---|

| ONNX | .onnx | Deployment multipiattaforma |

| TorchScript | .torchscript | Distribuzione C++ |

| OpenVINO | _openvino_model | hardware Intel |

| TensorRT | .engine | Inferenza su GPU NVIDIA |

| CoreML | .mlpackage | Dispositivi Apple |

| TFLite | .tflite | Dispositivi mobile/edge |

| TF SavedModel | _saved_model | Ecosistema TensorFlow |

| TF GraphDef | .pb | TensorFlow legacy |

| PaddlePaddle | _paddle_model | Ecosistema Baidu |

| NCNN | _ncnn_model | Mobile (Android/ARM) |

| Edge TPU | _edgetpu.tflite | Dispositivi Google Coral |

| TF.js | _web_model | Deployment su browser |

| MNN | .mnn | Alibaba mobile |

| RKNN | _rknn_model | NPU Rockchip |

| IMX500 | _imx_model | Sensore Sony IMX500 |

| Axelera | _axelera_model | Acceleratori AI Axelera |

| ExecuTorch | _executorch_model | PyTorch mobile |

Consultare Esportazione Modelli, la guida alla modalità di esportazione e l'indice delle integrazioni per le opzioni specifiche del formato.

Risoluzione dei problemi

Problemi del dataset

| Problema | Soluzione |

|---|---|

| Il dataset non viene elaborato | Verifica che il formato del file sia supportato (JPEG, PNG, WebP, ecc.). Dimensione massima dei file: immagini 50 MB, video 1 GB, set di dati 10 GB nella versione Free / 20 GB nella versione Pro / 50 GB nella versione Enterprise |

| Annotazioni mancanti | Verificare che le etichette siano in formato YOLO con .txt file corrispondenti ai nomi dei file immagine |

| "Split di addestramento richiesto" | Aggiungere train/ cartella alla struttura del tuo dataset, o crea suddivisioni in impostazioni del dataset |

| Nomi delle classi non definiti | Aggiungi un data.yaml file con names: elenco (vedi formato YOLO), o definire le classi nelle impostazioni del dataset |

Problemi di training

| Problema | Soluzione |

|---|---|

| L'addestramento non si avvierà | Verifica il saldo del credito in Impostazioni > Fatturazione. È richiesto un saldo positivo. |

| Errore di memoria insufficiente | Riduci la dimensione del batch, usa un modello più piccolo (n/s), o seleziona una GPU con più VRAM |

| Metriche scarse | Verifica la qualità del dataset, aumenta le epoche, prova l'aumento dei dati (data augmentation), controlla il bilanciamento delle classi |

| Addestramento lento | Seleziona una GPU più veloce, riduci la dimensione dell'immagine, verifica che il dataset non sia un collo di bottiglia |

Problemi di deployment

| Problema | Soluzione |

|---|---|

| Endpoint non risponde | Verifica lo stato dell'endpoint (Pronto vs Fermo). L'avvio a freddo potrebbe richiedere 5-15 secondi. |

| 401 Non autorizzato | Verifica che la chiave API sia corretta e abbia gli ambiti richiesti |

| Inferenza lenta | Verifica la dimensione del modello, valuta l'esportazione TensorRT, seleziona una regione più vicina. |

| Esportazione fallita | Alcuni formati richiedono architetture di modello specifiche. Prova ONNX per la massima compatibilità |

Domande frequenti

Posso cambiare il mio nome utente dopo la registrazione?

No, i nomi utente sono permanenti e non possono essere modificati. Scegli con attenzione durante la registrazione.

Posso cambiare la regione dei miei dati?

No, la regione dei dati viene selezionata durante la registrazione e non può essere modificata. Per cambiare regione, crea un nuovo account e ricarica i tuoi dati.

Come ottengo più crediti?

Vai su Impostazioni > Fatturazione > Aggiungi Crediti. Acquista crediti da $5 a $1000. I crediti acquistati non scadono mai.

Cosa succede se l'addestramento fallisce?

Ti viene addebitato solo il tempo di calcolo completato. I checkpoint vengono salvati e puoi riprendere l'addestramento.

Posso scaricare il mio modello addestrato?

Sì, clicca sull'icona di download su qualsiasi pagina del modello per scaricare il .pt file o i formati esportati.

Come posso condividere il mio lavoro pubblicamente?

Modifica le impostazioni del tuo progetto o dataset e imposta la visibilità su "Pubblico". I contenuti pubblici appaiono nella pagina Esplora.

Quali sono i limiti di dimensione dei file?

Immagini: 50 MB, video: 1 GB, set di dati: 10 GB nella versione gratuita, 20 GB nella versione Pro, 50 GB nella versione Enterprise. Per i file più grandi, suddividili in più caricamenti.

Per quanto tempo gli elementi eliminati vengono conservati nel Cestino?

30 giorni. Dopodiché, gli elementi vengono eliminati definitivamente e non possono essere recuperati.

Posso utilizzare i modelli della Piattaforma a fini commerciali?

I piani Free e Pro utilizzano la licenza AGPL. Per l'uso commerciale senza i requisiti AGPL, contatta sales@ultralytics.com per la licenza Enterprise.