Ultralytics Platform

Ultralytics Platformは、データ準備からモデルデプロイメントまで、MLワークフロー全体を効率化する包括的なエンドツーエンドのコンピュータービジョンプラットフォームです。インフラストラクチャの複雑さなしに、本番環境対応のコンピュータービジョンソリューションを必要とするチームや個人向けに構築されています。

Ultralytics Platformとは?

Ultralytics Platformは、断片化したMLツールを統合ソリューションに置き換えるように設計されています。以下の機能を組み合わせています。

- Roboflow - データ管理とアノテーション

- Weights & Biases - 実験track

- SageMaker - クラウド学習

- HuggingFace - モデルデプロイ

- Arize - モニタリング

YOLO26とYOLO11をネイティブサポートするオールインワンプラットフォーム YOLO11 モデルをネイティブサポートするオールインワンプラットフォーム。

ワークフロー: アップロード → アノテーション → トレーニング → エクスポート → デプロイ

プラットフォームはエンドツーエンドのワークフローを提供します:

graph LR

subgraph Data["📁 Data"]

A[Upload] --> B[Annotate]

B --> C[Analyze]

end

subgraph Train["🚀 Train"]

D[Configure] --> E[Train on GPU]

E --> F[View Metrics]

end

subgraph Deploy["🌐 Deploy"]

G[Export] --> H[Deploy Endpoint]

H --> I[Monitor]

end

Data --> Train --> Deploy| ステージ | 機能 |

|---|---|

| アップロード | 画像(50MB)、動画(1GB)、ZIPアーカイブ(10GB)の自動処理 |

| アノテーション | 手動ツール、SAM 、YOLO (対応タスク参照) |

| トレーニング | クラウドGPU(RTX 2000 AdaからB200までの22オプション)、リアルタイムメトリクス、プロジェクト組織化 |

| エクスポート | 17種類のデプロイ形式(ONNX、TensorRT、CoreML、TFLite;対応形式を参照) |

| デプロイ | 43のグローバルリージョンに専用エンドポイント、自動スケーリング、監視機能を提供 |

あなたができること:

- 画像、動画、ZIPアーカイブをアップロードしてトレーニングデータセットを作成する

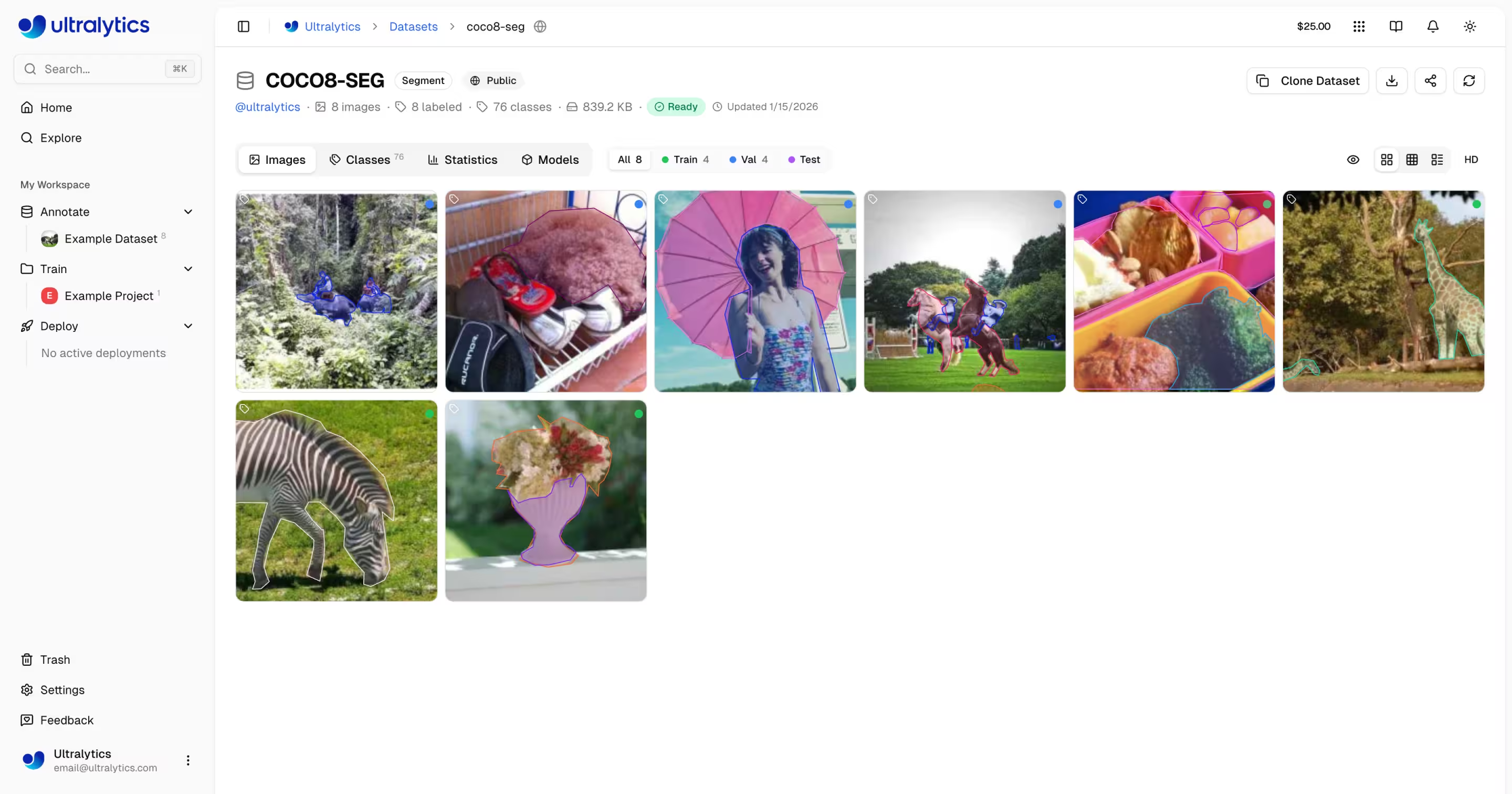

- 5つのYOLO タスクタイプすべてに対応したインタラクティブなオーバーレイでアノテーションを可視化(対応タスクを参照)

- GPU クラウドGPU でモデルをトレーニングし、リアルタイムメトリクスを取得

- 17種類のデプロイ形式(ONNX、TensorRT、CoreML、TFLite)へのエクスポート

- ワンクリック専用エンドポイントで43のグローバルリージョンにデプロイ

- トレーニングの進捗状況、デプロイメントの健全性、および使用状況の指標を監視する

- プロジェクトやデータセットを公開してコミュニティと協力する

マルチリージョンインフラストラクチャ

お客様のデータは、お客様のリージョンに留まります。Ultralytics Platformは、以下の3つのグローバルリージョンでインフラストラクチャを運用しています。

| リージョン | ラベル | ロケーション | 最適な用途 |

|---|---|---|---|

| 米国 | アメリカ大陸 | アイオワ州、米国 | アメリカ大陸のユーザー向け、アメリカ大陸最速 |

| 欧州 | ヨーロッパ、中東、アフリカ | ベルギー、ヨーロッパ | ヨーロッパのユーザー、GDPR準拠 |

| AP | アジア太平洋 | 香港、アジア太平洋地域 | アジア太平洋地域のユーザー、最低のAPACレイテンシー |

オンボーディング時にリージョンを選択すると、お客様のすべてのデータ、モデル、デプロイメントはそのリージョンに保持されます。

リージョンは永続的です

アカウント作成後のデータリージョン変更はできません。オンボーディング時にプラットフォームが各リージョンへの遅延を測定し、最も近いリージョンを推奨します。慎重に選択してください。

主な特徴

データ準備

- データセット管理: 画像、動画、またはZIPアーカイブを自動処理でアップロード

- アノテーションエディター:YOLO (detect、segment、姿勢推定、OBB、classify;対応タスク参照)に対する手動アノテーション

- SAM アノテーション:Segment Anything Modelを用いたクリックベースのインテリジェントアノテーション

- 自動アノテーション: 学習済みモデルを使用して新しいデータに事前ラベル付け

- 統計: クラス分布、ロケーションヒートマップ、次元分析

graph LR

A[Upload ZIP/Images/Video] --> B[Auto-Process]

B --> C[Browse & Filter]

C --> D{Annotate}

D --> E[Manual Tools]

D --> F[SAM Smart]

D --> G[YOLO Auto-Label]

E --> H[Train-Ready Dataset]

F --> H

G --> Hサポートされているタスクタイプ

アノテーションエディタは、以下の5つのYOLO タイプすべてをサポートしています: detect (バウンディングボックス)、 segment (ポリゴン)、 ポーズ (キーポイント)、 OBB (方向付きボックス)、および classify (画像レベルラベル)。各タスクタイプには専用の描画ツールとキーボードショートカットが用意されています。

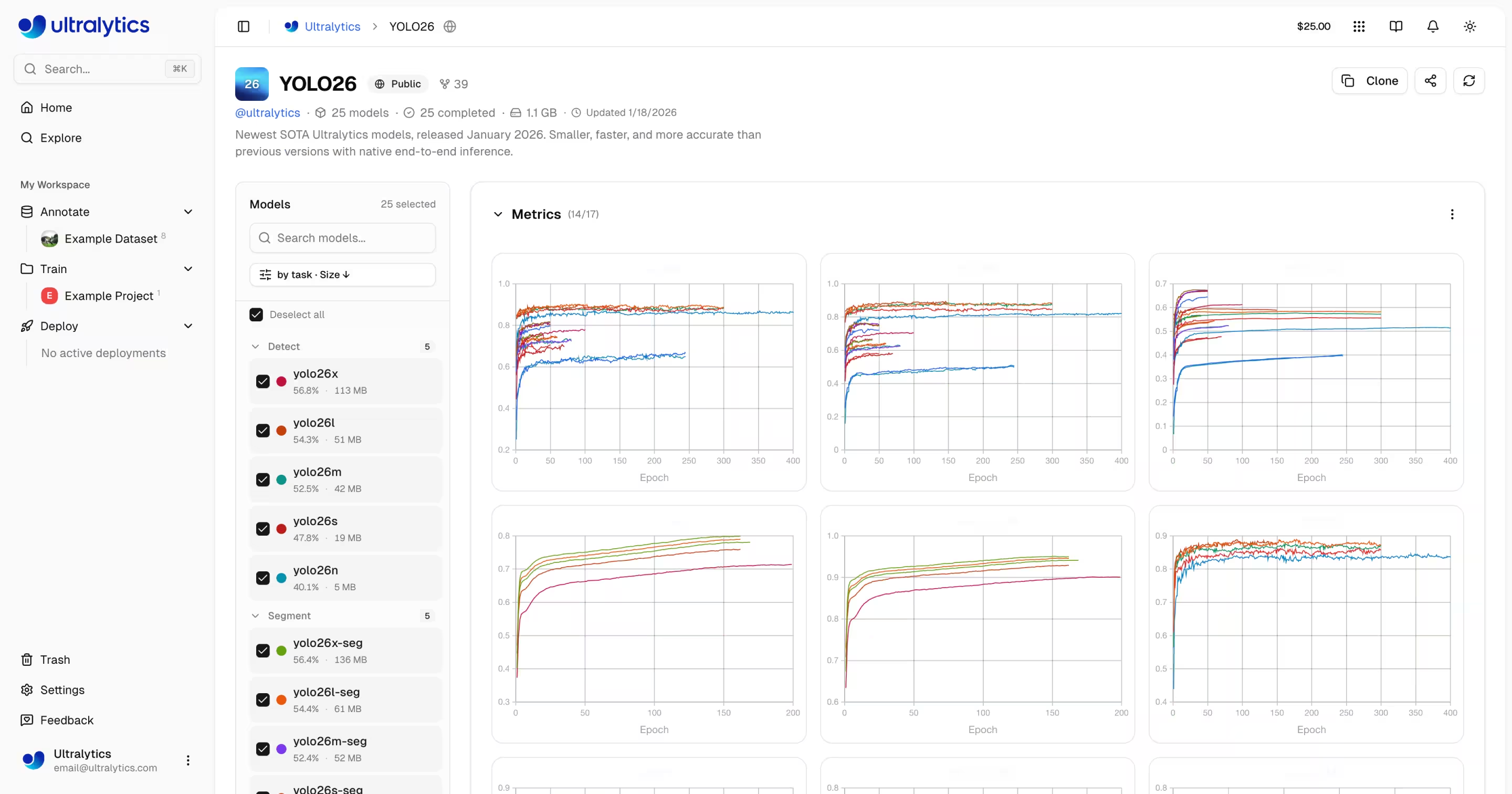

モデル学習

- クラウドトレーニング:GPU クラウドGPU でトレーニングを実施、リアルタイムメトリクス付き

- リモートトレーニング:どこでもトレーニング可能、測定値をプラットフォームへストリーミング(W&B方式)

- プロジェクト整理: 関連モデルのグループ化、実験の比較、アクティビティの追跡

- 17 種類の出力形式:ONNX、TensorRT、CoreML、TFLite など(対応形式を参照)

モデルは、Web UI(クラウドトレーニング)またはご自身のマシン(リモートトレーニング)からトレーニングできます:

- プロジェクトに移動します。

- クリック

Train Model - データセット、モデル、GPU、およびエポック数を選択してください

- リアルタイムの損失曲線と指標を監視する

# Install ultralytics

pip install "ultralytics>=8.4.14"

# Set your API key

export ULTRALYTICS_API_KEY="your_api_key"

# Train and stream metrics to the platform

yolo train model=yolo26n.pt data=coco.yaml epochs=100 project=username/my-project name=exp1

import os

from ultralytics import YOLO

os.environ["ULTRALYTICS_API_KEY"] = "your_api_key"

model = YOLO("yolo26n.pt")

model.train(

data="coco.yaml",

epochs=100,

project="username/my-project",

name="exp1",

)

# Metrics stream to Platform automatically

デプロイ

- 推論テスト: カスタム画像を使用してブラウザで直接モデルをテスト

- 専用エンドポイント: オートスケーリングで43のグローバルリージョンにデプロイ

- モニタリング: リアルタイムメトリクス、リクエストログ、パフォーマンスダッシュボード

graph LR

A[Trained Model] --> B{Action}

B --> C[Browser Predict]

B --> D[Export Format]

B --> E[Deploy Endpoint]

D --> F[ONNX / TensorRT / CoreML / TFLite / ...]

E --> G[43 Global Regions]

G --> H[API Endpoint URL]

H --> I[Monitor & Scale]デプロイ後、任意の言語からエンドポイントを呼び出せます:

import requests

url = "https://your-endpoint-url/predict"

headers = {"Authorization": "Bearer your_api_key"}

with open("image.jpg", "rb") as f:

response = requests.post(url, headers=headers, files={"file": f})

print(response.json())

curl -X POST "https://your-endpoint-url/predict" \

-H "Authorization: Bearer your_api_key" \

-F "file=@image.jpg"

const form = new FormData();

form.append("file", fileInput.files[0]);

const response = await fetch("https://your-endpoint-url/predict", {

method: "POST",

headers: { Authorization: "Bearer your_api_key" },

body: form,

});

const results = await response.json();

console.log(results);

アカウント管理

- チームと組織: チームメンバーとの共同作業、役割と招待の管理

- APIキー: リモートトレーニングおよびAPIアクセス用のセキュアなキー管理

- クレジットと請求: 透明性の高い料金設定による従量課金制トレーニング

- アクティビティフィード:アカウントのすべてのイベントとアクションを追跡

- ごみ箱と復元: 30日間のソフト削除とアイテム復元

- GDPR準拠: データのエクスポートとアカウントの削除

プラン階層

| 機能 | 無料 | Pro(月額29ドル) | エンタープライズ |

|---|---|---|---|

| サインアップクレジット | 5ドル / 25ドル* | - | カスタム |

| 月次クレジット | - | 月額30ドル/席 | カスタム |

| モデル | 100 | 500 | 無制限 |

| 同時トレーニング | 3 | 10 | 無制限 |

| デプロイ | 3 | 10 (ウォームスタート) | 無制限 |

| ストレージ | 100 GB | 500 GB | 無制限 |

| チーム | - | 最大5名まで | 最大50 |

| サポート | コミュニティ | 優先度 | 専用 |

*登録時5ドル、または認証済み企業/仕事用メールアドレスで25ドル。

クイックリンク

これらのリソースから始めましょう:

- クイックスタート: 最初のプロジェクトを作成し、数分でモデルをトレーニング

- データセット: トレーニングデータをアップロードして管理

- アノテーション: 手動およびAI支援ツールでデータにラベル付け

- プロジェクト: モデルと実験を整理

- クラウドトレーニング: クラウドGPUでトレーニング

- 推論: モデルをテスト

- エンドポイント: モデルを本番環境にデプロイ

- モニタリング: デプロイのパフォーマンスをtrack

- APIキー: APIアクセスを管理

- 請求: クレジットと支払い

- アクティビティ: アカウントイベントの追跡

- ごみ箱: 削除したアイテムを復元する

- REST API: APIリファレンス

よくある質問

Ultralytics Platformの利用を開始するには?

Ultralytics Platformを始めるには:

- サインアップ: platform.ultralytics.comでアカウントを作成

- リージョンの選択: オンボーディング中にデータリージョン (米国、EU、またはAP) を選択

- データセットのアップロード: データセットセクションに移動してデータをアップロード

- モデルのトレーニング: プロジェクトを作成し、クラウドGPUでトレーニングを開始

- デプロイ: モデルをテストし、専用のエンドポイントにデプロイ

詳細なガイドについては、クイックスタートページを参照してください。

Ultralytics Platformの利点は何ですか?

Ultralytics Platformが提供するもの:

- 統合ワークフロー: データ、トレーニング、デプロイメントを一箇所で

- マルチリージョン: 米国、EU、またはAPリージョンでのデータレジデンシー

- ノーコードトレーニング: コードを書かずに高度なYOLOモデルをトレーニング

- リアルタイムメトリクス: トレーニングの進捗状況をストリームし、デプロイメントを監視

- 43のデプロイリージョン: 世界中のユーザーの近くにモデルをデプロイ

- 5種類のタスクタイプ:検出、セグメンテーション、姿勢推定、OBB、分類のサポート(タスクドキュメント参照)

- AIアシストアノテーション: SAMと自動ラベリングによりデータ準備を高速化

クラウド学習で利用可能なGPUオプションは何ですか?

Ultralytics Platformは、クラウドトレーニング向けに複数のGPUタイプをサポートしています:

| GPU | VRAM | 1時間あたりのコスト | 最適な用途 |

|---|---|---|---|

| RTX 2000 Ada | 16ギガバイト | $0.24 | 小規模データセット、テスト |

| RTX A4500 | 20ギガバイト | $0.24 | 中小規模のデータセット |

| RTX A5000 | 24ギガバイト | $0.26 | 中規模データセット |

| RTX 4000 Ada | 20ギガバイト | $0.38 | 中規模データセット |

| L4 | 24ギガバイト | $0.39 | 推論最適化 |

| A40 | 48ギガバイト | $0.40 | より大きなバッチサイズ |

| RTX 3090 | 24ギガバイト | $0.46 | 一般訓練 |

| RTX A6000 | 48ギガバイト | $0.49 | 大型モデル |

| RTX 4090 | 24ギガバイト | $0.59 | 優れたコストパフォーマンス |

| RTX 6000 Ada | 48ギガバイト | $0.77 | 大規模バッチ学習 |

| L40S | 48ギガバイト | $0.86 | 大規模バッチ学習 |

| RTX 5090 | 32ギガバイト | $0.89 | 最新世代 |

| L40 | 48ギガバイト | $0.99 | 大型モデル |

| A100 PCIe | 80ギガバイト | $1.39 | 生産訓練 |

| A100 SXM | 80ギガバイト | $1.49 | 生産訓練 |

| RTX PRO 6000 | 96ギガバイト | $1.89 | 推奨されるデフォルト |

| H100 PCIe | 80ギガバイト | $2.39 | 最速トレーニング |

| H100 SXM | 80ギガバイト | $2.69 | 最速トレーニング |

| H100 NVL | 94 GB | $3.07 | 高記憶トレーニング |

| H200 NVL | 143ギガバイト | $3.39 | 最大メモリ |

| H200 SXM | 141ギガバイト | $3.59 | 最大限のパフォーマンス |

| B200 | 180ギガバイト | $4.99 | 最大モデル |

完全な価格とGPU については、クラウドトレーニングをご覧ください。

リモート学習はどのように機能しますか?

独自のハードウェアでモデルをトレーニングし、Weights & Biasesと同様にリアルタイムメトリクスをプラットフォームにストリーミングできます。

パッケージバージョンの要件

Platformのultralytics>=8.4.14が必要です。それより低いバージョンはPlatformでは動作しません。

pip install "ultralytics>=8.4.14"

# Set your API key

export ULTRALYTICS_API_KEY="your_api_key"

# Train with project/name to stream metrics

yolo train model=yolo26n.pt data=coco.yaml epochs=100 project=username/my-project name=exp1

import os

from ultralytics import YOLO

os.environ["ULTRALYTICS_API_KEY"] = "your_api_key"

model = YOLO("yolo26n.pt")

model.train(

data="coco.yaml",

epochs=100,

project="username/my-project",

name="exp1",

)

# Train using a Platform dataset directly

export ULTRALYTICS_API_KEY="your_api_key"

yolo train model=yolo26n.pt data=ul://username/datasets/my-dataset epochs=100 project=username/my-project name=exp1

リモートトレーニングの詳細については、クラウドトレーニングを参照してください。

利用可能なアノテーションツールは何ですか?

プラットフォームには、以下の機能をサポートする全機能搭載のアノテーションエディターが含まれています。

- 手動ツール: バウンディングボックス、ポリゴン、キーポイント、向き付きボックス、分類

- SAM :クリックしてSegment Anything Modelで精密なマスクを生成

- キーボードショートカット: ホットキーによる効率的なワークフロー

| ショートカット | アクション |

|---|---|

V | モードを選択 |

S | SAM アノテーションモード |

A | 自動注釈モード |

1 - 9 | 番号でクラスを選択 |

Delete | 選択したアノテーションを削除 |

Ctrl+Z | 元に戻す |

Ctrl+Y | やり直す |

Escape | 現在の操作をキャンセル |

完全なガイドについては、アノテーションを参照してください。

どのようなエクスポート形式がサポートされていますか?

プラットフォームは17のデプロイ形式をサポートしています:

| 形式 | ファイル拡張子 | ユースケース |

|---|---|---|

| ONNX | .onnx | クロスプラットフォームデプロイメント |

| TorchScript | .torchscript | C++のデプロイメント |

| OpenVINO | _openvino_model | Intel |

| TensorRT | .engine | NVIDIA GPU |

| CoreML | .mlpackage | Appleデバイス |

| TFLite | .tflite | モバイル/エッジデバイス |

| TF SavedModel | _saved_model | TensorFlowエコシステム |

| TF GraphDef | .pb | TensorFlow |

| PaddlePaddle | _paddle_model | 百度エコシステム |

| NCNN | _ncnn_model | モバイル(Android) |

| Edge TPU | _edgetpu.tflite | Google デバイス |

| TF.js | _web_model | ブラウザデプロイメント |

| MNN | .mnn | アリババモバイル |

| RKNN | _rknn_model | Rockchip NPU |

| IMX500 | _imx_model | ソニー IMX500 センサー |

| Axelera | _axelera_model | アクセレラAIアクセラレータ |

| ExecuTorch | _executorch_model | PyTorch |

フォーマット固有のオプションについては、モデルエクスポート、エクスポートモードガイド、および統合インデックスを参照してください。

トラブルシューティング

データセットの問題点

| 問題 | ソリューション |

|---|---|

| データセットは処理されません | ファイル形式がサポートされているか確認してください(JPEG、PNG、WebPなど)。最大ファイルサイズ:画像 50MB、動画 1GB、ZIP 10GB |

| 欠落した注釈 | ラベルが正しいことを確認する YOLO 形式 with .txt 画像ファイル名に一致するファイル |

| 列車の分割が必要 | 追加 train/ フォルダをデータセット構造に追加するか、分割を作成します データセット設定 |

| クラス名が未定義です | を追加します data.yaml ファイルを names: リスト(参照 YOLO 形式または、データセット設定でクラスを定義する |

訓練上の問題

| 問題 | ソリューション |

|---|---|

| トレーニングは開始されません | 設定>請求でクレジット残高を確認してください。残高がプラスである必要があります。 |

| メモリ不足エラー | バッチサイズを縮小する、より小さなモデル(n/s)を使用する、またはより多くのVRAMGPU を選択する |

| 不十分な指標 | データセットの品質を確認するエポック数を増やすデータ拡張を試すクラスバランスを確認する |

| トレーニングが遅い | より高速なGPUを選択する画像サイズを縮小するデータセットがボトルネックになっていないことを確認する |

デプロイメントの問題

| 問題 | ソリューション |

|---|---|

| エンドポイントが応答しません | エンドポイントの状態を確認(Ready 対 Stopped)。コールドスタートには5~15秒かかる場合があります |

| 401 アクセスが許可されていません | APIキーが正しく、必要なスコープを持っていることを確認してください |

| 遅い推論 | モデルのサイズを確認し、TensorRT を検討し、より近い領域を選択してください |

| エクスポートに失敗しました | 一部のフォーマットでは特定のモデルアーキテクチャが必要です。 ONNX で広範な互換性を実現 |

よくある質問

登録後にユーザー名を変更できますか?

いいえ、ユーザー名は永続的で変更できません。登録時に慎重に選択してください。

データリージョンを変更できますか?

いいえ、データリージョンは登録時に選択され、変更できません。リージョンを切り替えるには、新しいアカウントを作成し、データを再アップロードしてください。

どうすればクレジットをもっと獲得できますか?

設定 > 請求 > クレジット追加 に移動します。5ドルから1000ドルまでのクレジットを購入できます。購入したクレジットは有効期限がありません。

トレーニングが失敗した場合はどうなりますか?

完了した計算時間のみ課金されます。チェックポイントは保存され、トレーニングを再開できます。

学習済みモデルをダウンロードできますか?

はい、どのモデルページでもダウンロードアイコンをクリックしてダウンロードしてください。 .pt ファイルまたはエクスポートされた形式。

自分の作品を公開するにはどうすればよいですか?

プロジェクトまたはデータセットの設定を編集し、公開設定を「公開」に切り替えてください。公開されたコンテンツは「探索」ページに表示されます。

ファイルサイズの制限はどのくらいですか?

画像:50MB、動画:1GB、ZIPアーカイブ:10GB。それ以上のサイズのファイルは、複数回に分けてアップロードしてください。

削除されたアイテムはごみ箱にどのくらい保存されますか?

30日間。その後、アイテムは完全に削除され、復元できません。

プラットフォームモデルを商用利用できますか?

FreeおよびProプランはAGPLライセンスを採用しています。AGPL要件を伴わない商用利用については、エンタープライズライセンスに関するお問い合わせをultralyticsご連絡ください。