Link to this sectionUltralytics 지원 모델#

Ultralytics 모델 문서에 오신 것을 환영합니다! 저희는 객체 탐지, 인스턴스 분할, 의미론적 분할, 이미지 분류, 자세 추정, 다중 객체 추적 등 특정 작업에 맞춰진 다양한 모델을 지원합니다. Ultralytics에 모델 아키텍처를 기여하고 싶으시다면 기여 가이드를 확인해 주십시오.

Link to this section주요 모델#

지원되는 주요 모델은 다음과 같습니다:

- YOLOv3: Joseph Redmon이 처음 개발한 YOLO 모델 제품군의 세 번째 반복 버전으로, 효율적인 실시간 객체 탐지 기능으로 유명합니다.

- YOLOv4: 2020년 Alexey Bochkovskiy가 발표한 YOLOv3의 Darknet 기반 업데이트 버전입니다.

- YOLOv5: Ultralytics에서 개선한 YOLO 아키텍처로, 이전 버전에 비해 더 나은 성능과 속도 트레이드오프를 제공합니다.

- YOLOv6: 2022년 Meituan에서 발표했으며, 해당 기업의 많은 자율 주행 배달 로봇에 사용되고 있습니다.

- YOLOv7: 2022년 YOLOv4 저자들이 발표한 업데이트된 YOLO 모델입니다. 추론만 지원됩니다.

- YOLOv8: 인스턴스 분할, 자세/키포인트 추정 및 분류와 같은 향상된 기능을 갖춘 범용 모델입니다.

- YOLOv9: PGI(Programmable Gradient Information)를 구현한 Ultralytics YOLOv5 코드베이스에서 훈련된 실험적 모델입니다.

- YOLOv10: 칭화대학교에서 개발했으며, NMS 없는 훈련과 효율성 및 정확도 중심의 아키텍처를 특징으로 하여 최첨단 성능과 지연 시간을 제공합니다.

- YOLO11: 탐지, 분할, 자세 추정, 추적 및 분류를 포함한 여러 작업에서 고성능을 제공하는 Ultralytics의 YOLO 모델입니다.

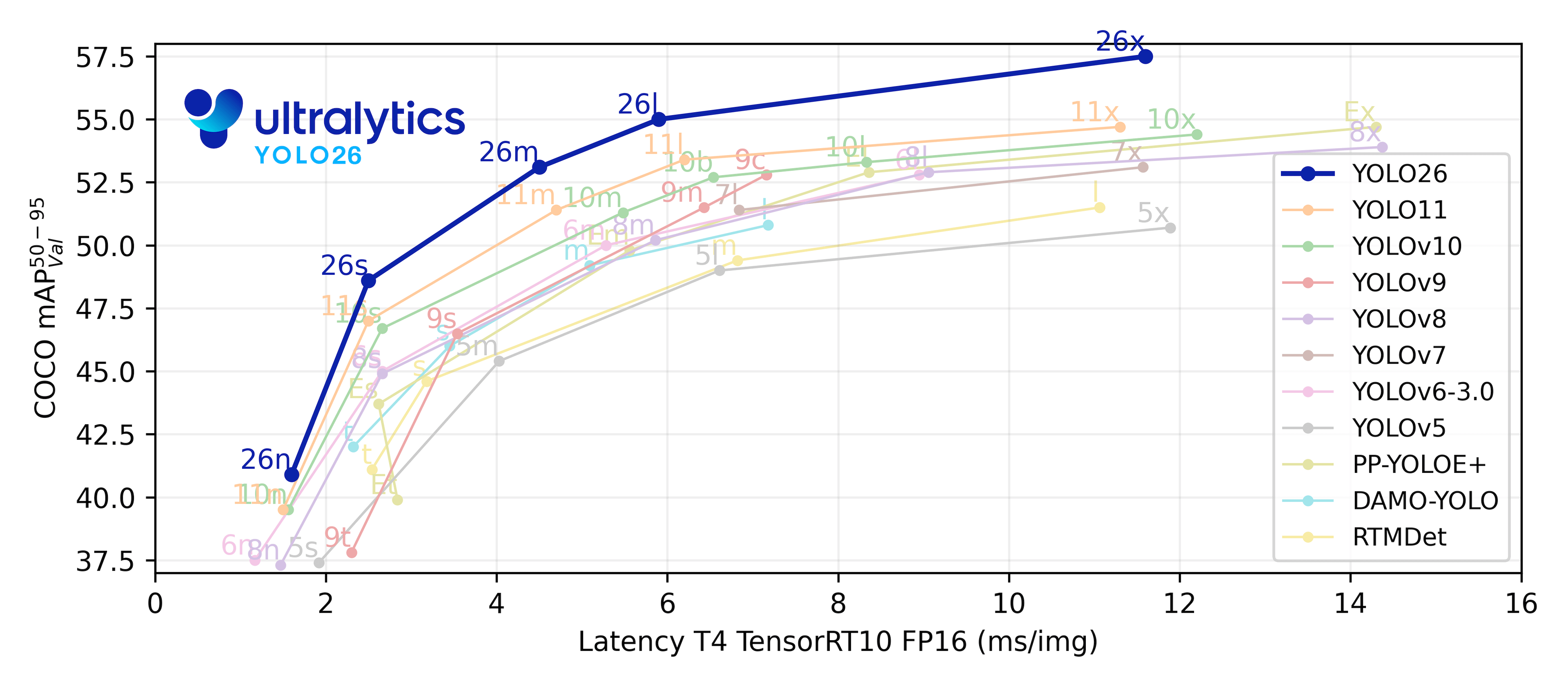

- YOLO26 🚀 신규: 엔드투엔드 NMS 없는 추론을 통해 엣지 배포에 최적화된 Ultralytics의 최신 차세대 YOLO 모델입니다.

- Segment Anything Model (SAM): Meta의 원본 Segment Anything Model (SAM)입니다.

- Segment Anything Model 2 (SAM2): 비디오 및 이미지를 위한 Meta의 차세대 Segment Anything Model입니다.

- Segment Anything Model 3 (SAM3) 🚀 신규: 텍스트 및 이미지 예제 기반 분할을 위한 프롬프트 가능 개념 분할 기능을 갖춘 Meta의 3세대 Segment Anything Model입니다.

- Mobile Segment Anything Model (MobileSAM): 경희대학교에서 개발한 모바일 애플리케이션용 MobileSAM입니다.

- Fast Segment Anything Model (FastSAM): 중국과학원 자동화연구소 이미지 및 비디오 분석 그룹에서 개발한 FastSAM입니다.

- YOLO-NAS: YOLO 신경망 구조 탐색 (NAS) 모델입니다.

- Real-Time Detection Transformers (RT-DETR): Baidu의 PaddlePaddle 실시간 Detection Transformer (RT-DETR) 모델입니다.

- YOLO-World: Tencent AI Lab에서 개발한 실시간 오픈 어휘 객체 탐지 모델입니다.

- YOLOE: YOLO의 실시간 성능을 유지하면서 훈련 데이터 이외의 임의의 클래스를 탐지할 수 있는 개선된 오픈 어휘 객체 탐지기입니다.

Watch: Run Ultralytics YOLO models in just a few lines of code.

Link to this section시작하기: 사용 예제#

이 예제는 간단한 YOLO 훈련 및 추론 예제를 제공합니다. 이들에 대한 전체 문서와 기타 모드는 Predict, Train, Val 및 Export 문서 페이지를 참조하십시오.

Note the below example spotlights YOLO11 Detect models for object detection. For additional supported tasks see the Segment, Classify and Pose docs.

PyTorch 사전 훈련된 *.pt 모델과 구성 *.yaml 파일을 YOLO(), SAM(), NAS() 및 RTDETR() 클래스에 전달하여 Python에서 모델 인스턴스를 생성할 수 있습니다:

from ultralytics import YOLO

# Load a COCO-pretrained YOLO26n model

model = YOLO("yolo26n.pt")

# Display model information (optional)

model.info()

# Train the model on the COCO8 example dataset for 100 epochs

results = model.train(data="coco8.yaml", epochs=100, imgsz=640)

# Run inference with the YOLO26n model on the 'bus.jpg' image

results = model("path/to/bus.jpg")Link to this section새 모델 기여하기#

귀하의 모델을 Ultralytics에 기여하고 싶으신가요? 좋습니다! 저희는 항상 모델 포트폴리오를 확장하는 데 열려 있습니다.

-

저장소 포크: Ultralytics GitHub 저장소를 포크하는 것부터 시작하세요.

-

포크 복제: 포크를 로컬 머신에 복제하고 작업을 수행할 새 브랜치를 만드세요.

-

모델 구현: 기여 가이드에 제공된 코딩 표준 및 지침에 따라 모델을 추가하세요.

-

철저한 테스트: 모델을 단독으로, 그리고 파이프라인의 일부로서 엄격하게 테스트하십시오.

-

풀 리퀘스트 생성: 모델이 만족스러우면 검토를 위해 메인 저장소에 풀 리퀘스트를 생성하세요.

-

코드 검토 및 병합: 검토 후 모델이 기준을 충족하면 메인 저장소에 병합됩니다.

자세한 단계는 기여 가이드를 참조하십시오.

Link to this sectionFAQ#

Link to this section최신 Ultralytics YOLO 모델은 무엇인가요?#

최신 Ultralytics YOLO 모델은 2026년 1월에 출시된 YOLO26입니다. YOLO26은 엔드투엔드 NMS 없는 추론, 최적화된 엣지 배포를 특징으로 하며 탐지, 인스턴스 분할, 의미론적 분할, 분류, 자세 추정, OBB 및 오픈 어휘 버전을 지원합니다. 안정적인 프로덕션 워크로드를 위해서는 YOLO26과 YOLO11 모두 권장되는 선택입니다.

Link to this section사용자 지정 데이터로 YOLO 모델을 어떻게 훈련하나요?#

사용자 지정 데이터로 YOLO 모델을 훈련하는 것은 Ultralytics 라이브러리를 사용하여 쉽게 수행할 수 있습니다. 간단한 예제는 다음과 같습니다:

from ultralytics import YOLO

# Load a YOLO model

model = YOLO("yolo26n.pt") # or any other YOLO model

# Train the model on custom dataset

results = model.train(data="custom_data.yaml", epochs=100, imgsz=640)더 자세한 지침은 Train 문서 페이지를 방문하십시오.

Link to this section어떤 YOLO 버전이 Ultralytics에서 지원되나요?#

Ultralytics는 YOLOv3부터 YOLO26까지의 광범위한 YOLO(You Only Look Once) 버전과 YOLO-NAS, SAM, RT-DETR과 같은 모델을 지원합니다. 각 버전은 탐지, 분할, 의미론적 분할, 분류와 같은 다양한 작업에 최적화되어 있습니다. 각 모델에 대한 자세한 정보는 Ultralytics 지원 모델 문서를 참조하십시오.

Link to this section머신 러닝 프로젝트에 Ultralytics Platform을 사용해야 하는 이유는 무엇인가요?#

Ultralytics Platform은 YOLO 모델을 훈련, 배포 및 관리하기 위한 노코드 엔드투엔드 플랫폼을 제공합니다. 복잡한 워크플로우를 단순화하여 사용자가 모델 성능과 애플리케이션에 집중할 수 있도록 합니다. 또한 HUB는 클라우드 훈련 기능, 포괄적인 데이터셋 관리 및 초보자와 숙련된 개발자 모두를 위한 사용자 친화적인 인터페이스를 제공합니다.

Link to this sectionUltralytics YOLO 모델은 어떤 작업을 수행할 수 있나요?#

Ultralytics YOLO 모델은 범용성이 뛰어나 객체 탐지, 인스턴스 분할, 의미론적 분할, 분류, 자세 추정 및 방향성 객체 탐지(OBB)를 포함한 작업을 수행할 수 있습니다. 최신 모델인 YOLO26은 위 6가지 작업과 오픈 어휘 탐지를 모두 지원합니다. 특정 작업에 대한 자세한 내용은 작업 페이지를 참조하십시오.